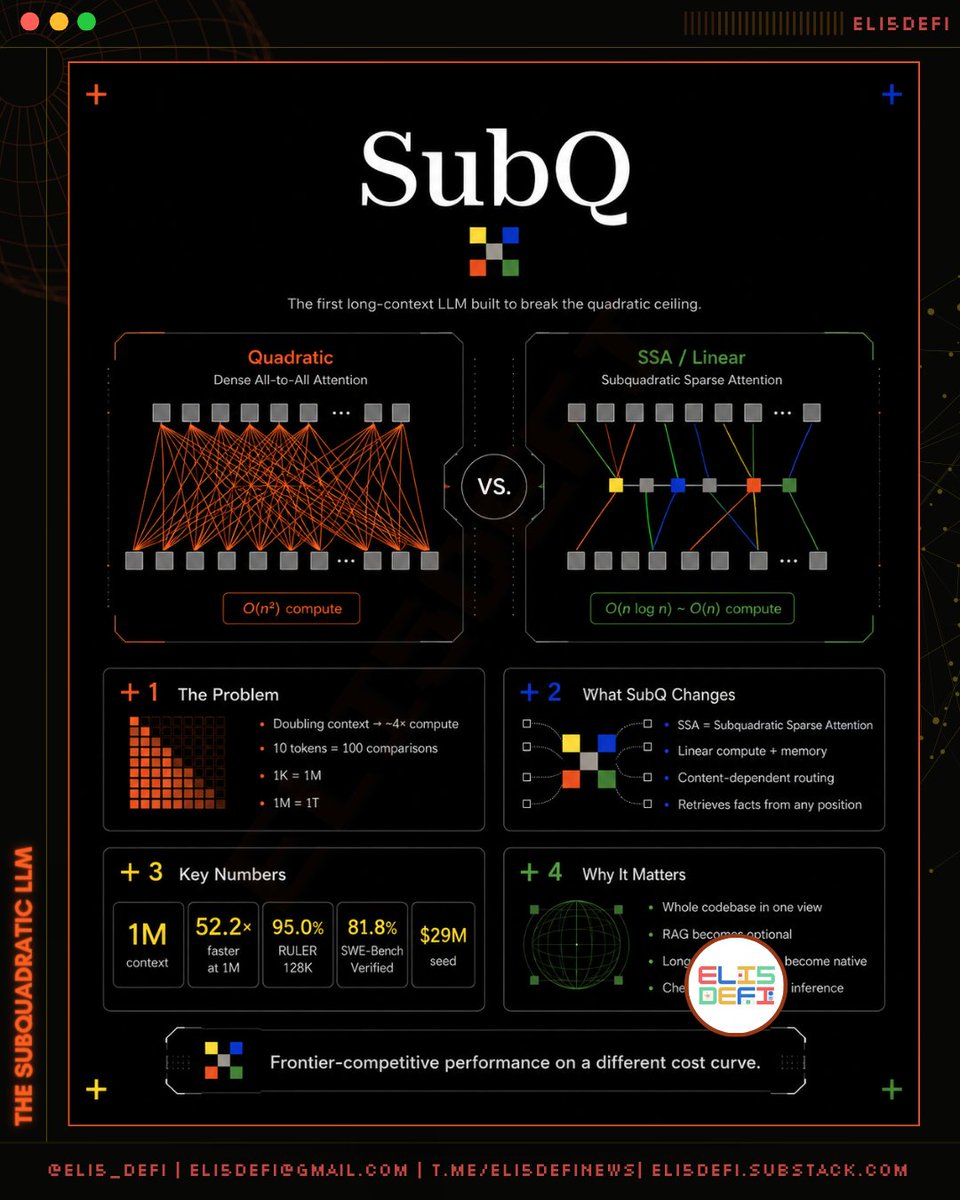

新しいAI企業の@subquadraticが、現代AIにおける最も古い制限の1つを破るモデルをリリースしました。 その意義を理解するには、これまで使ったすべてのチャットボットを静かに形作ってきた1つの数学的問題を理解する必要があります。 - ➠ 問題:AIは単語のペアで読み取り、ペアはスケールしない 現代のすべてのLLM(ChatGPT、Claude、Gemini)は、すべての単語が他のすべての単語とどのように関連しているかをチェックしてテキストを読み取ります。 これは問題ないように聞こえますが、計算してみると: ▸ 10語 → 100回の比較 ▸ 1,000語 → 100万回の比較 ▸ 100万語 → 1兆回の比較 入力を2倍にしても、処理量は2倍ではなく4倍になります。 これは「二次スケーリング」と呼ばれ、2017年からAIに組み込まれてきました。 これがあなたに与える影響: ▸ 長い文書は急速に高コストになる ▸ 長い入力の奥深くに埋もれた事実をモデルが見落とすことが多い ▸ 完全なコードベースや研究ライブラリが収まらない つまり、コンテキストが長くなるほど、あなたのLLMはより馬鹿になり、より高コストになるのです。 - ➠ 今日のAIがこの問題をどう隠しているか 業界は数学的な根本解決ではなく、回避策を構築してきました: ▸ RAG:検索エンジンがいくつかの関連する断片を取得し、それだけをモデルに渡す ▸ チャンキング:長い文書を小さな部分に分割する ▸ エージェントシステム:複数のAI呼び出しで異なる部分を処理し、コードでつなぎ合わせる ▸ FlashAttention:同じ高コストな計算をより速く実行するためのメモリ操作 これらは機能しますが、どれも根本的な問題を解決していません。 現代AI全体のスタック(ベクトルデータベース、検索パイプライン、プロンプトエンジニアリング)は、モデルが全体を一度に見ることができないからこそ存在しています。 — ➠ SubQがどのように異なるか SubQは「SSA(Subquadratic Sparse Attention)」という新しいアプローチを使っています。 一文で言えば:すべての単語を他のすべての単語と比較するのではなく、モデルは質問に関係する本当に重要な単語を特定し、それ以外を無視します。 これにより、スケーリングは二次から線形に変わります。入力を2倍にしても、処理量は2倍になるだけで4倍にはなりません。 難しいのはアイデアではなく、これまでにも同様の試みは数多くありました。 しかし過去のすべての試みは何かを犠牲にしてきました:精度、長いテキストの奥深くにある事実を見つける能力、あるいは効率性そのもの。 @alex_whedonが共同設立したSubquadraticは、これら3つを初めて同時に解決したと主張しています。 — ➠ 実績 第三者による検証済みベンチマーク: ▸ RULER 128K(長文推論テスト)でClaude Opus 4.6と並ぶ ▸ MRCR v2(複数証拠検索)ではOpus 4.7、GPT 5.4、Gemini 3.1 Proを上回るが、Opus 4.6とGPT 5.5には及ばない ▸ SWE-Bench(実際のコーディングタスク)ではOpus 4.6とGemini 3.1 Proを上回るが、Opus 4.7には及ばない ▸ 100万トークンでFlashAttentionより52倍高速 ▸ 研究版では1,200万トークンを処理し、他の最先端モデルと比較して約1,000倍少ない注意計算量で実行 簡潔に言えば、これは「世界最強のモデル」ではありません。 根本的に低コストなコスト曲線で最先端レベルの精度を実現しています。 — ➠ サム・アルトマンが登場する理由 アルトマンの最も大きな公的主張の2つは、SubQが解決しようとしている問題と一致しています。 コストに関して:2025年2月のブログ記事『Three Observations』で、アルトマンはAI利用コストが12ヶ月ごとに約10倍低下すると述べ、「ムーアの法則よりも信じられないほど強い」と評しました。彼の主張は、「安価な推論」がAIがどう進化するかを決定づける主要な力であるということです。 サイズに関して:2023年までさかのぼると、アルトマンは「より大きなモデル」の時代は終わり、真の競争は「1ドルあたりの能力」であると述べました。彼はパラメータ数の競争を1990年代のGHz競争に例えました。「間違った軸」です。 SubQはこの両方の主張を文字通り受け入れています。彼らのスローガンは「効率こそ知性」です。 ただし、アルトマンが提唱する低コストAIへの道筋は「ハードウェア進化」「ソフトウェア最適化」「モデル蒸留」であり、「注意メカニズムそのものの再設計」については公に支持していません。 つまりSubQの主張は彼の経済的ビジョンと一致していますが、一方で大手研究所がアーキテクチャ的な「1ドル」を見落としていたという賭けでもあります。 — ➠ なぜこれが重要なのか SubQが本番規模で成果を出せば: ▸ コードベース全体を1つの会話として扱える。ファイルをやり取りするマルチエージェントシステムは不要になる。モデルがリポジトリ全体を保持する。 ▸ RAGはオプションになる。今日の多くのAIインフラは二次的制限を補うために存在している。制限を取り除けば、その補助構造は荷物になる。 ▸ 長期エージェントはハックではなくなる。永続的なメモリを持つ数日間のセッションがネイティブに可能になる。 ▸ 新たなアプリケーションが可能になる。これまで高コストすぎて不可能だったタスク(全文レビュー、徹底的なコード検索、コンプライアンススキャン)が日常的になる。 — ➠ 正直な注意点 ▸ プライベートベータ段階。実世界での信頼性はまだテストされていない。そのため、この発表はあくまでティーザーとして扱うべきであり、多くの人がこれを単なるパフォーマンスと見なしている。 ▸ MRCR v2スコア(65.9%)は良いが、Opus 4.6(78.3%)やGPT 5.5(74%)には及ばない。SSAは効率的ではあるが、厳密には能力が高いわけではない。 ▸ ベンチマークは第三者検証付きで自社発表されている。真のテストは学術的な再現性である。 ▸ 1,200万トークン結果は研究版であり、リリース製品(100万トークン)ではない。 — ➠ 結論 9年間、すべてのトランスフォーマーベースAIは同じ二次的コストを支払ってきました。 Subquadraticはついにそのコストを回避する方法を見つけたと主張しています。ベンチマークから見て、少なくとも方向性は正しいようです。 アルトマンは3年間、「1ドルあたりの能力」が新たな戦場であると業界に言い続けてきました。SubQは、回避策を積み重ねる代わりに、基礎となる数学自体を変えようとしている最初期の企業の一つです。 彼らが成功できるかどうかは、今や公開された実証的な問いになりました。