文 | 字母AI

グーグルは本当に焦っている。

先ほど、グーグル共同創業者のセルゲイ・ブリンが「創業者モード」を再起動し、自ら指揮をとり、エリート「突撃隊」を編成して、GeminiがAnthropicなどの競合に対し、AIプログラミングや自律エージェントなどの主要な能力で追い抜くことを目指しているというニュースが届いた。

その後、グーグルは深夜に重大なアップデートを発表し、Gemini 3.1 Proモデルに基づく新世代の自律研究エージェント「Deep Research」と「Deep Research Max」をリリースしました。

モデルの基盤における推論能力を強化するとともに、自律型エージェントを企業向け・開発者プラットフォーム向けに進化させるため、APIの提供、プライベートデータのサポート、バックグラウンド非同期タスクなどの手法を積極的に活用し、「AI研究/分析ツール」という高付加価値の分野で先手を取ろうとしています。OpenAI(Hermes)やPerplexityなどの競合に対応するためです。

これらのエージェントは、開発者が単一のAPI呼び出しでオープンネットワークデータと企業独自の情報を統合し、レポート内でチャートやインフォグラフィックをネイティブに生成できるように初めて実現しました。また、Model Context Protocol(MCP)を通じて任意のサードパーティデータソースに接続することも可能です。

两款エージェントは、本日より、Googleが2025年12月に最初に導入したInteractions APIを介して、Gemini APIの有料プランを通じてパブリックプレビュー版として提供されます。

はい、これらの新しいエージェントは現在APIでのみ利用可能で、一般ユーザーはGeminiアプリでは利用できません。有料サブスクリプションを購入していても同様です。更新情報を見て自分では使えないことに不満を抱くユーザーもおり、「Googleは何らかの理由で、GeminiアプリのProサブスクリプションユーザーを継続的に罰しているようです……」と嘆いています。

グーグルのCEO、サンダー・ピチャイも自らX上で宣伝した。「速度と効率が必要な場合はDeep Researchをご利用ください。最高品質のコンテキスト収集と統合を求める場合はMaxバージョンをご利用ください。Maxは計算リソースを拡張することで、DeepSearchQAで93.3%、HLEで54.6%の成績を達成しています。」

18か月前、グーグルのDeep Researchの目標は、大学院生が大量のブラウザタブに圧倒されないように支援することだった。現在、グーグルは、このツールが投資銀行のジュニアアナリストの基礎研究業務を置き換えることを目指している。

この二つの目標間のギャップ、およびこの技術が実際にそのギャップを埋められるかどうかが、自律研究エージェントを企業ソフトウェア分野の変革的な製品にするか、それともベンチマークでは華やかだが会議ではがっかりさせるただのもう一つのAIデモに留めるかを決定する。

二つのバージョンで、異なるワークロードに最適化

スタンダード版のDeep Researchは遅延が低く、コストも安いため、スピードが重要なシナリオに適しています。

Deep Research Maxは速度よりも深さを優先します。このエージェントは、テスト時の計算を拡張して、深層的な推論、検索、反復を行い、最終的にレポートを生成します。

Googleは、非同期バックグラウンドワークフローがその理想的な使用シナリオであると指摘しており、たとえば、定时タスク(cron job)を夜間に実行することで、翌朝にはアナリストチームに包括的なデューデリジェンス報告書を提供できる。

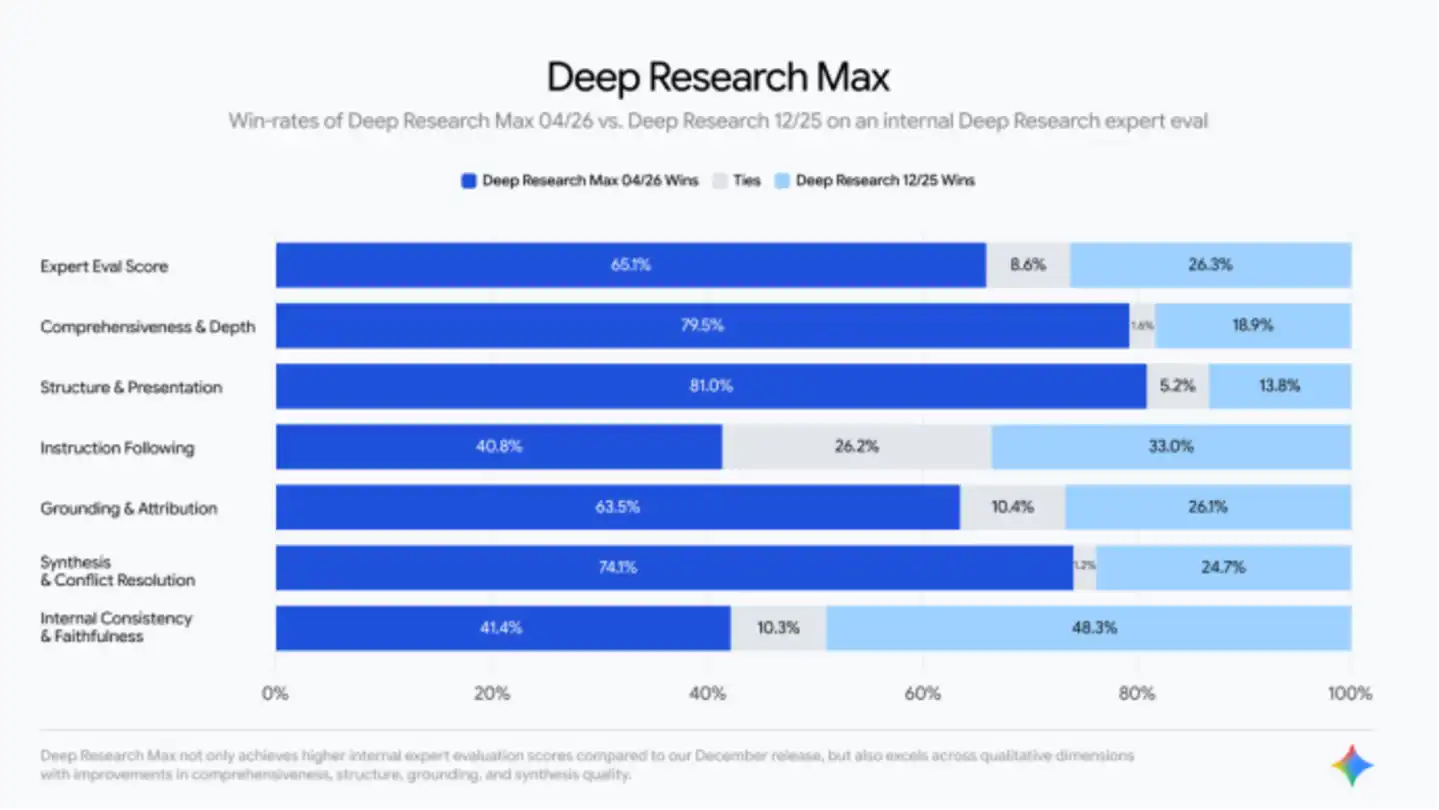

グーグルの独自ベンチマークにおいて、Deep Research Maxは検索および推論タスクで顕著な進歩を遂げました。このエージェントは、以前のバージョンよりも多くのソースから情報を取得し、従来のモデルが見落としがちな細部を捉えることができます。

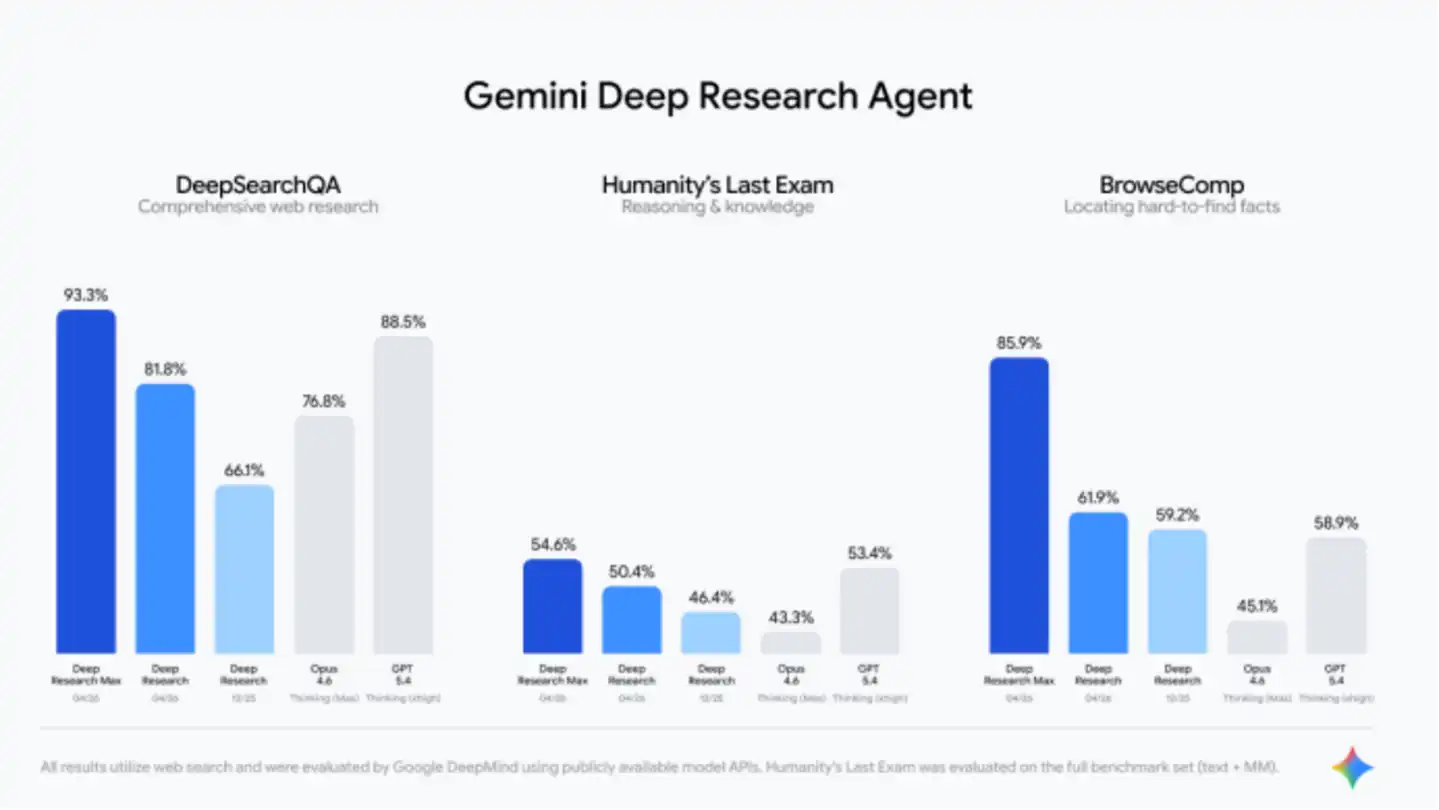

Googleも競合他社との比較を示しています。

ただし、OpenAIのGPT-5.4やAnthropicのOpus 4.6と比較するのは完全に公平ではありません。GPT-5.4は自律的なウェブ検索において優れた性能を発揮しますが、深層研究のために特別に最適化されていません。そのため、OpenAIは自社のDRエージェントを提供しており、このエージェントは2月の更新後にGPT-5.4ではなくGPT-5.2に切り替えられました。OpenAIで最も強力な検索モデルは実際にはGPT-5.4 Proですが、Googleは明らかにこれを比較対象に含めていません。

OpenAIのデータによると、GPT-5.4 Proはエージェント検索ベンチマークBrowseCompで最高89.3%のスコアを記録し、GPT-5.4は82.7%のスコアを記録しました。

Anthropic自身の報告によると、Opus 4.6はBrowseCompで84%のスコアを記録し、これはGoogleが提示した数値を上回っています。このスコアは推論機能をオフにした状態で得られたものであり、モデルはGoogleがAPIベンチマークで使用した高負荷推論設定よりも優れたパフォーマンスを発揮しました。

これらの差異は、評価方法の違いに起因している可能性が高い——モデルは原始的なAPIを通じて評価されたのか、それとも各研究所独自のツールチェーンにラップされたのか。グーグルのデータが必ずしも誤っているわけではないが、慎重に解釈する必要がある。いずれにせよ、その提示方法には十分な透明性が欠けている。

MCPをサポート

今回のリリースで最も影響力のある機能は、Model Context Protocol(MCP)のサポートを新たに追加したことです。この機能により、Deep Researchは強力なウェブリサーチツールから、より「汎用データアナリスト」に近い存在へと進化します。

MCPは、AIモデルを外部データソースに接続するための新興のオープン標準です。これにより、Deep Researchはプライベートデータベース、内部ドキュメントライブラリ、専門的なサードパーティデータサービスを安全にクエリでき、敏感な情報は元の環境から外に出ることなく処理されます。

実際の応用では、ヘッジファンドがDeep Researchを内部取引フローデータベースと金融データ端末に指向させ、その後、エージェントにネット上の公開情報と両者を統合して洞察を総合的に生成するよう指示できます。

グーグルは、FactSet、S&P、PitchBookなどの企業と積極的に協力してMCPサーバーを設計していることを明らかにし、グーグルがウォールストリートおよびより広範な金融サービス業界で日常的に利用されているデータプロバイダーと深く統合しようとしていることを明確に示している。

Google DeepMindのプロダクトマネージャー、Lukas HaasおよびSrinivas Tadepalliが執筆したブログ記事によると、その目標は「共通の顧客がDeep Researchによって駆動されるワークフローに金融データ製品を統合し、膨大なデータ宇宙を活用して瞬時にコンテキストを収集することで、生産性を飛躍的に向上させること」である。

この機能は、企業がAIを導入する際に直面する最も根強い課題の一つ、すなわちオープンインターネット上で入手可能な情報と組織の実際の意思決定に必要な情報との間の大きなギャップを直接解決します。これまで、このギャップを埋めるには大量のカスタムエンジニアリング作業が必要でした。

また、MCPはDeep Researchの自律的な閲覧と推論機能を統合し、複雑な設定を一度の設定で簡素化します。開発者は、Deep ResearchにGoogle検索、リモートMCPサーバー、URLコンテキスト、コード実行、ファイル検索を同時に使用させるか、ネットワークアクセスを完全に無効にしてカスタムデータでのみ検索させることができます。

システムは、PDF、CSV、画像、音声、動画をgrounding(groundingコンテキスト)として使用するマルチモーダル入力もサポートしています。

ネイティブチャート

二つ目の注目機能は、ネイティブなチャートと情報図の生成です。

以前のDeep Researchバージョンは、純テキストレポートのみを生成できました。ユーザーが可視化を必要とする場合、データをエクスポートして自らチャートを作成する必要がありました。この欠点は、「エンドツーエンドの自動化」という位置づけを大きく損なっていました。

現在、次世代のエージェントは、HTMLやGoogleのNano Banana形式で複雑なデータセットを動的にレンダリングし、高品質なチャートや情報図をレポートにネイティブに埋め込むことができます。これにより、それらは分析のナラティブの一部として直接機能します。

企業ユーザー、特に金融およびコンサルティング業界で、利害関係者に直接提出可能な成果物を生み出す必要があるユーザーにとって、この機能はDeep Researchを「研究段階を加速するツール」から、ほぼ最終的な分析成果物を生成できるツールへと変革します。

さらに、新しく追加された協力的計画機能(ユーザーがエージェントの研究計画を実行前に確認、指導、最適化できる)と、リアルタイムで中間推論ステップをストリーミング出力する機能を組み合わせることで、新システムは開発者が調査範囲を細かく制御しつつ、規制業界が求める高度な透明性を維持できます。

Deep Researchは、Googleが企業に提供する「インフラストラクチャー」の一部になりつつある。

Googleの公式ブログ記事では、開発者がDeep Researchエージェントを使用して構築する際、呼び出しているのは「Gemini App、NotebookLM、Google Search、Google FinanceなどのGoogle旗下の人気製品に研究機能を提供する同一の自律研究インフラストラクチャー」であると明確に述べられています。これは、APIを通じて提供されるエージェントが、Google内部版の簡易版ではなく、プラットフォーム規模で提供される同一のシステムであることを示しています。

この進化プロセスは非常に急速に進んでいます。

Googleは2024年12月、GeminiアプリでDeep ResearchをC端機能として初導入し、当時はGemini 1.5 Proによって駆動されていた。Googleはこれを個人用AI研究アシスタントと位置づけ、ネット上の情報を数分で統合し、ユーザーの作業時間を数時間節約できるとしている。

2025年3月、GoogleはGemini 2.0 Flash Thinking Experimentalを用いてDeep Researchをアップグレードし、一般にベータ版を公開した。その後、Gemini 2.5 Pro Experimentalにアップグレードされ、Googleは評価者によるこの報告の好ましさが競合製品の2倍以上であると報告した。

2025年12月は重要な転換点であり、GoogleはGemini 3 Proによって駆動されるDeep Researchを、初めてプログラミング方式で提供するInteractions APIをリリースし、同時にオープンソースのDeepSearchQAベンチマークを公開した。

今回の改善を支えるベースモデルは、2026年2月19日にリリースされたGemini 3.1 Proです。このモデルは、核心的な推論能力で大きな飛躍を遂げており、モデルが新規の論理パターンを解決する能力を評価するARC-AGI-2ベンチマークで、3.1 Proは77.1%のスコアを記録し、Gemini 3 Proの2倍以上となっています。