この狂った30日間、11の大型モデルが、にぎやかな花火ショーのようだった。

記事作成者、出典:0x9999in1、ME News

要約

- 極限の競争の30日間:3月26日から4月24日まで、世界で11の主要な大規模モデルが発表され、平均2.7日に1つ。市場は深刻な「パラメータ疲労」に直面している。

- パラメータ大胃王の「減量手術」:V4-Proの総パラメータは1.6Tだが、有効化されたのは49Bのみ。CSA+HCAアーキテクチャの再設計により、1Mコンテキスト下でのFLOPsは27%に低下、KVキャッシュは驚異的な10%まで削減された。

- 錬金術の代差分離:「先に独立した強化学習、その後オンライン蒸留で統合」という後学習パラダイムを初導入。V4-Pro-Maxは推論およびAgentタスクにおいて、閉源モデルの上限に迫る。

- 真の金銭的投票:GPT-5.5はナビダの1日4.2%の上昇をもたらしただけでピークに達したが、V4はMITによる完全なオープンソース化により、中国・香港のローカル計算能力チェーンの持続的な急騰を完全に引き起こした。

- 深いゲーム理論:閉源モデルは「税」を売っており、オープンソースの大規模モデルは「鉄」を売っている。V4の登場により、世界中の企業向けプライベートデプロイの計算能力帳簿がついに均衡した。

神々の狂騒の四月、市場の審美疲労と共に

狂っている。みんな狂っている。

AI分野に注目する観察者であれば、先月の30日間はおそらく生理的な不快感を覚えたことだろう。2026年3月26日から4月24日までのわずか1か月弱の間に、世界中で少なくとも11の顕著な影響力を持つ大規模モデルが市場に投入された。

リストがまるでメニューを読み上げているようだ:Anthropic Opus 4.6、Google Gemini 3.1 Pro、OpenAI GPT-5.5、Mistral Large 3、Meta Llama 4、月之暗面 Kimi K2.6、阿里 Qwen3-Next、字节豆包 2.5 Pro、腾讯混元 3.0、Kimi K2.6 Plus。

そして、4月23日午前、深水爆弾のように静かに上線したDeepSeek V4。

平均して2.7日ごとに新しいモデルが登場している。これは投資ファンドマネージャーですらリリース文を読み切れないスピードだ。投資家がA社の「パラメータ超え」を聞き終えた頃には、B社の「スコア圧倒」がすでに机の上に届いている。市場はすでに麻痺している。いわゆる「ベンチマーク(基準テスト)ランキング更新」は、現在の過当競争下で、ますます自己満足のデジタルゲームのように見えている。

でも、お金は賢い。あるいは、ローソク足は決して嘘をつかない。

この30日間の米中香港AI資産のローソク足を振り返ると、極めて冷酷な現実が見えてくる:この「神々の戦い」において、価格チャートに持続的な痕跡を残したのは、たった2つのノードだけである。

最初,4月8日,大洋彼岸的OpenAI发布了GPT-5.5。这位无可争议的王者,直接推动英伟达单日暴涨4.2%。然而,之后呢?没有后续了,当日见顶,利好出尽。人们发现,再伟大的闭源巨头,也很难再像两年前那样,轻易撬动全球资本这座沉重的大山。

二番目のノードは4月23日から24日です。DeepSeek V4 プレビューバージョンがリリースされました。派手な発表会も、衝撃的なプロモーション動画もありませんでした。重みはそのまま Hugging Face と ModelScope にアップロードされ、MIT ライセンスです。

結果?それは中港算力チェーンの連続ジャンプ上昇を引き起こした。

なぜ?なぜ多くの閉源のエキスパートが実現できなかったことを、オープンソースモデルが実現したのか?

この質問に答えるには、退屈な広報文を捨てて、DeepSeek V4のエンジンカバーを開け、その中にはどんなモンスターが詰まっているのかを見極める必要があります。

V4を解剖する:パラメーターの暴力美学に頼らない

大規模モデル。非常に費用がかかる。これは誰もが知っていることだ。

過去1年、大規模モデル企業は「火力不足への恐怖」に陥った。お前が1兆やるなら、俺は2兆やる。誰もが、力さえあれば、生み出される知能がすべてを解決できると考えていた。しかし、それに伴い、とてつもない計算コストが発生した。地主の余り米でも足りないほどだ。

DeepSeek V4は今回、MoE(混合専門家)モデルのV4-ProとV4-Flashを発表しました。まず、いくつかのコアデータをご覧ください。

V4-Pro:総パラメータ数1.6T(1.6兆)、ただし1トークンあたりの活性化パラメータは49B(490億)のみ。

V4-Flash:総パラメータ数284B(2840億)、アクティブパラメータは13B(130億)のみ。

理解しました。これは極めて抑制された「四両撥千斤」の手法です。MoEアーキテクチャの本質は、常にすべての警報を鳴らす必要がないことです。鶏を殺すタスクには、鶏を殺す専門家数名を動員し、竜を屠るタスクにはようやく竜を屠る刀を出します。1.6兆のベースが、「経験豊富で知識が豊か」であることを保証し、490億の活性化が、「反応が速く、機敏である」ことを保証します。

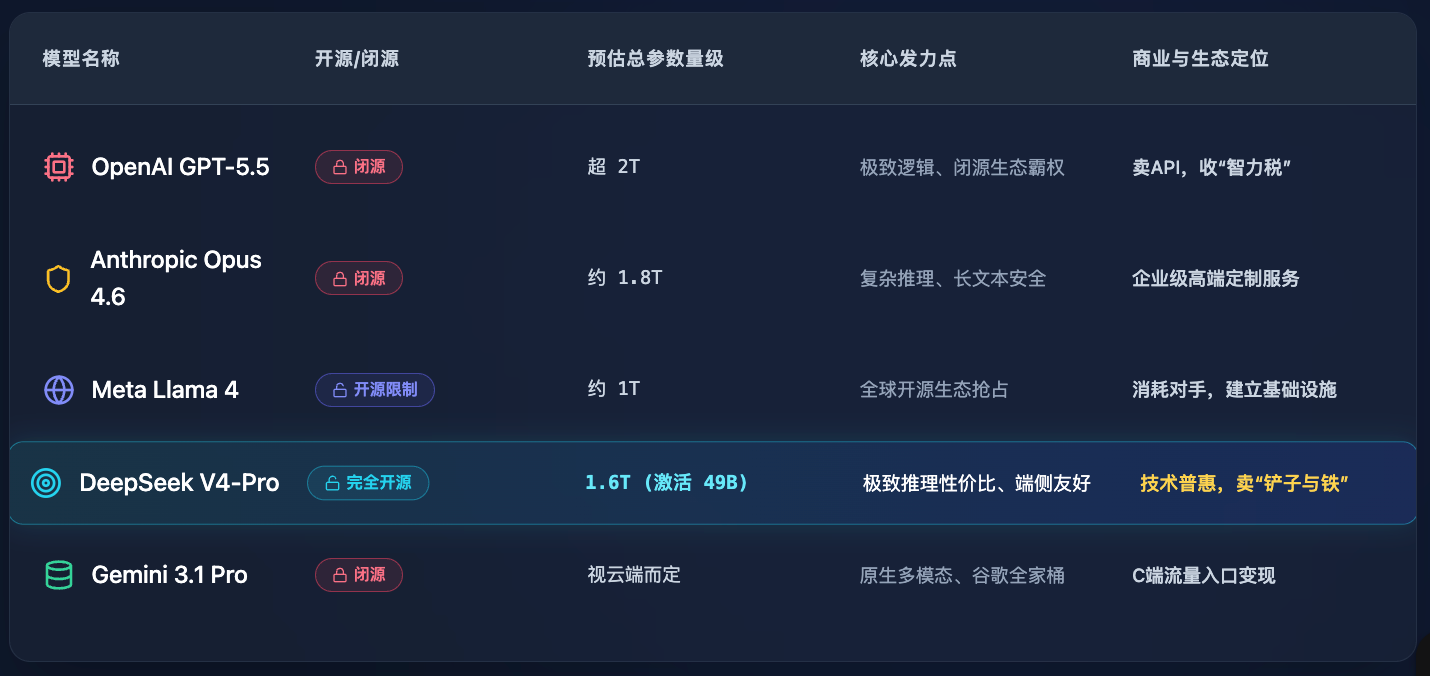

この差をより直観的に理解するために、現在の市場における主要な路線を比較する表を作成します(データは市場の公開予測および算出値に基づきます):

表を見ると、V4-Pro は総パラメータ数で GPT-5.5 を単に上回ることを追求していないが、その力を「この巨大なモデルをどれだけ少なく食べて、どれだけ速く動かすか」に集中させていることがわかる。

しかし、それだけでは不十分です。専門家が息をのむほどだったのは、彼が「メモリ刺客」を容赦なく駆逐したことです。

VRAM刺客の最期:アーキテクチャ上の三本の刮骨刀

「ビデオメモリの刺客」とは、「ロングコンテキスト(Long Context)」を指します。

現在、各社は自社が1M(百万)トークンのコンテキストをサポートしていると宣伝しています。听起来很爽,一整本《三国演义》塞进去,它几秒钟就能读完。しかし、その代償は何でしょうか?長文を推論する際、膨大なKVキャッシュ(推論時に履歴情報を格納するGPUメモリ使用量)が発生します。これは、本の1ページを読むたびに、前のページの内容を大きな黒板に書き写して目の前に置くようなものです。百万字目まで読み進めたとき、黒板が中关村のデータセンターすら埋め尽くしてしまうのです。

メモリは計算能力よりも高い。これはAI業界の暗黙のルールである。

DeepSeek V4はこの課題をどう解決したのか?彼らは底层のアテンションメカニズムに直接「外科手術」を施した。これが彼らのアーキテクチャアップグレードの第一弾、そして最も強力な一撃だ:ハイブリッドアテンションメカニズム(CSA + HCA)。

CSA(圧縮スパースアテンション)とHCA(高度圧縮アテンション)を組み合わせると、火星語のように聞こえますが、要するに、従来のように丸暗記するのではなく、「重要な部分を抽出」して「極簡ノートを作成」する方法を学んだということです。

効果は非常に劇的です:1Mのコンテキスト下で、V4-Proの1トークン推論に必要なFLOPs(浮動小数点演算回数)は、前世代のV3.2の27%に過ぎません!さらに恐ろしいことに、KVキャッシュはV3.2の10%に過ぎません!

これはどのような概念ですか?かつては10台の最高級サーバーが必要だった百万字の長文タスクが、今や1台のサーバーで簡単に処理できます。計算リソースのコストが1割に削減されました。これは劇的な最適化です。

もう二本の刀があります。

第二のツールは「多様体制約超接続(mHC)」です。従来の大規模モデルでは、層と層間の情報伝達に「従来の残差接続」が使われていました。これは、老朽化した錆びた鉄管で水を送るようなもので、水圧が高くなると漏れやすくなります。32Tトークンという膨大な事前学習データに対応するには、この古い管では耐えられません。mHCは、光纤ネットワークに切り替えたようなもので、層間の信号伝播の安定性を高めます。パケット損失も、ずれも発生しません。

三番目の刀、エンジンオイルの交換。従来の方法を捨て、Muonオプティマイザーを採用しましょう。これにより収束が加速されます。同じ丹を煉るのに、他人は四十九日かかるところ、これなら二十日で完成するかもしれません。時間はお金です。計算リソースはドルです。

この三刀が振り下ろされたことで、V4は大モデルの「富裕病」を完全に治した。

丹炉の中の秘密:それぞれが単独で行動するから万法が一つに帰するまで

大規模モデルについては業界内ではよく知られているが、事前学習は「文盲」を「多くの知識は持っているが話せない呆けた人」に変えるだけだ。本当にそれを絶世の高手にするのは、後学習(Post-training)である。

DeepSeek V4は、後学習で極めてハードコアな「二段階兵法」を展開しました。

過去、人々はMoEを訓練する際、まるで複数の教師が1人の生徒を教えるように、争いが起きやすかった。V4はどのように行うのか?

第1段階:「各自為戦」。これはSFT(監督微調整)とGRPO(グループ相対ポリシー最適化)強化学習を活用し、モデル内の各「エキスパートネットワーク」を分離して個別にトレーニングする。コードを書くエキスパートは毎日コード書きに専念し、数学のエキスパートは毎日数学の問題に取り組む。まったく関係なく、互いに干渉しない。これが単一の能力を極限まで引き上げる方法である。

第二段階:「万法帰宗」。オンラインディスティレーション技術を用いて、すでに絶世の武功を習得した専門家たちを一つの調和のとれたモデルに統合します。内部の無駄や遅延は一切ありません。

では、彼らが引き出した2つの「必殺技」を見てみましょう。

まずV4-Pro-Maxモードです。これは最高レベルの推論能力モードです。まるで遺伝子のロックが解除されたかのようです。彼ら自身(そしてすぐにコミュニティによって検証されました)によると、コーディングベンチマークではV4-Proはすでにトップレベルに達しており、複雑な推論およびエージェントタスクでは、GPT-5.5やOpus 4.6などの最先端のクローズドモデルとの差が大きく縮小されています。

次にV4-Flash-Maxです。これはより興味深いです。このモデルはわずか284Bのサイズですが、「十分な思考予算」を与えると、推論パフォーマンスがProに近づきます。これは何を示しているでしょうか?「アルゴリズムの質」が「パラメータの規模」に勝ち始めているということです。十分な時間を与えれば、小さな脳でも大きな課題を解くことができます。もちろん、純粋な知識量や極めて複雑なマルチステップAgentタスクについては、依然としてパラメータ規模に制約されます(結局、お腹の大きさは限られているため)。しかし、ほとんどの企業向け日常アプリケーションにとっては、この性能はすでに過剰です。

最後に、重みの保存はFP4+FP8ハイブリッド精度保存を極めて洗練された方法で採用しており、精度を維持しながらVRAMを節約しています。あらゆるところに理系学生らしい節約の魅力が滲んでいます。

より明確にこの後学習によるエンジニアリング効率の向上を比較するため、もう1枚のハードコアな指標比較表を示します:

資本の嗅覚:なぜV4は中港計算能力チェーンを点火したのか?

ここまで技術的な解説はほぼ終わりました。しかし、冒頭の灵魂の問いにはまだ答えられていません:

なぜGPT-5.5は計算能力セクターの持続的なブームを実現できなかったのに、DeepSeek V4はそれを成し遂げたのか?

このゲームを、コードの枠を超えて、資本とビジネスの視点で捉える必要があります。

GPT-5.5は非常に強力で、圧倒的な強さを誇る。しかし、それはクローズドソースである。クローズドソースとは何を意味するか?それはOpenAIが巨大な「ブラックホール」であるということだ。その能力を使いたいなら、APIを購入しなければならない。これは「徴税」モデルである。利益はシリコンバレーに流れ、計算リソースの需要はマイクロソフトのクラウドデータセンターに集中する。これは、世界中のハードウェアメーカー、ローカル計算センター、各国のサーバーエージェントにとって、ただ見上げるだけで、ほとんど恩恵を受けることができない。GPT-5.5がどれほど強力であっても、それは他人の祝祭に過ぎない。NVIDIAの株価が上昇するのは、OpenAIがさらに多くのGPUを購入すると人々が考えているからである。

しかし、DeepSeek V4は異なります。

それはオープンソースであり、極めて徹底的なMITライセンスです。MITライセンスは、オープンソース界で最も寛大な贈り物であり、企業が法的リスクを気にすることなく、無料で使用・改変・販売できます。

さらに致命的なのは、以前に大量のページを割いて論じたように、V4がモデルの推論コストとVRAM使用量を足首まで削減したことです。

この二点を組み合わせると、資本市場を狂わせる結論が導き出される:プライベートデプロイの臨界点が、ついに到来した。

かつて、企業が1TB以上の大型モデルを自社でデプロイしようとすると、ハードウェアの価格表を見て黙って閉じ、APIを購入し直していた。しかし今、V4はこう告げる:ごく少数のマシンで、GPT-4にほぼ匹敵し、GPT-5.5のレベルにも挑戦できる超脳をローカルで動かせる。データは県外にも、国外にも出さず、絶対に安全だ。

みんながローカルで実行できるようになったら、次に何が起こるでしょうか?

機械を購入!サーバーを購入!光モジュールを購入!知能計算センターを構築!

閉源大手は知的財産税を売っているが、オープンソース大手は本質的に業界全体のハードウェアメーカーに「商品を販売」している。DeepSeek V4 がその火種を投じた人物だ。それがより使いやすく、よりオープンソースであればあるほど、中国・香港・台湾等地のローカライズされた計算能力需要は爆発的に増加する。サーバー組立、液体冷却、データセンター運用を行う企業たちは、ついに大規模な実装による真の利益を見出した。

これが、4月23日にV4がリリースされた直後に中港算力チェーンが連続して急騰した理由です。資本は情熱のために支払っているのではなく、間もなく訪れる「千業百行のプライベートデプロイメントの狂潮」に先んじてポジションを取っているのです。

これが、基盤となる商業的な陽謀である。

結論:引き潮と岩礁

この狂った30日間、11の大型モデルが、にぎやかな花火ショーのようだった。

大手たちはパラメータのリングで大洋を振りかざし、計算力の重拳で相手を倒そうとしている。しかし騒ぎが静まった後、業界の地形を変えるのは、最も騒がしい者ではなく、むしろ他にいることが多い。

DeepSeek V4の登場は、冷静な刺客のようだ。どれだけお金をかけるかを競うのではなく、最も痛い弱点に刃を向ける:無駄なVRAMを削減し、デプロイのハードルを下げ、ハイエンドの戦場を一般ユーザー向けに変える。

「神々の黄昏」と呼ばれるこのAI戦争において、無意味にパラメータを積み重ねる時代は急速に幕を下ろしつつある。未来の戦場は、「極限のパフォーマンス」と「エンジニアリング効率」の間に最適なバランスを見出す者たちのものとなるだろう。

潮が引けば、誰が裸で泳いでいたか、誰が揺るぎない岩かがわかる。

V4はすでに武器を全員に配布しました。次は、各勢力がこの新しい大陸にどのように陣地を築くかです。

この層を見抜いた後で、いわゆる「衝撃の発表」や「再定義」などの騒ぎを聞くと、少し楽観的になり、不安が減るかもしれません。

結局、どんなに華麗な魔法でも、最終的には帳簿に落ちて、数銭の小銭を計算しなければならない。

引用元:

- DeepSeek V4シリーズ プレビュー 公式リリース、DeepSeekチーム、GitHub/ModelScope/HuggingFace。 (2026)。

- 4月のAIラリー:30日間の大規模モデルサイクルの分析, ME News Market Observer. (2026).

- スケーリング法則とトレーニング後パラダイムシフト、Journal of Artificial Intelligence Economics. (2026)。

- グローバル・コンピュート・サプライチェーン市場パルスレポート(2026年4月)、パナ・アジア・ファイナンシャル・データ・アナリティクス。(2026年)。