SN24、Quasar-3Bアーキテクチャを発表:Bittensor TAOが長コンテキストAIでOpenAIに挑戦

2026/04/21 07:00:03

はじめまして

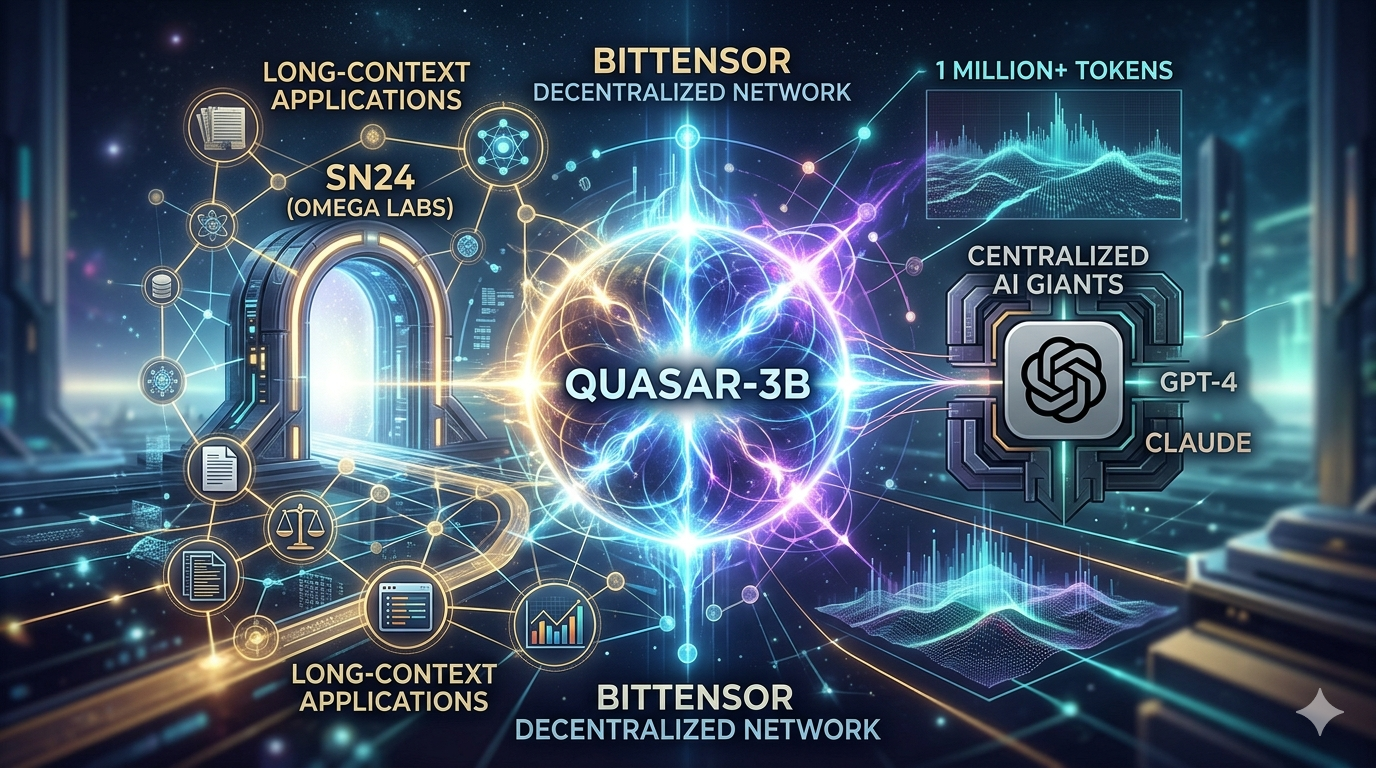

2026年4月、SN24(OMEGA Labs)は、長文コンテキスト用に特別に設計されたループ型連続時間トランスフォーマーであるQuasar-3Bのリリースを発表し、人工知能の分野で大きな進展が見られました。

このアナウンスは技術的なマイルストーンを超えて、OpenAIのような中央集権的AI大手と、拡張コンテキストの処理と推論という最も重要な能力の1つで直接競争するというBittensorの真摯な意図を示しています。長コンテキストAIの分野が急速に進化する中、数百万のトークンを効果的に処理できるモデルを構築するための競争は、AI開発で最も重要な戦いの1つとなっています。BittensorはSN24のQuasar-3Bを通じた分散型アプローチでこの領域に参入し、巨大な中央集権的企業だけがAIモデルの可能性の境界を広げられるという仮定に挑戦しています。もはや分散型AIが競争できるかどうかという問いではなく、既存のプレイヤーとの差をどれだけ速く埋められるかが問われています。

この柱記事では、Quasar-3BがBittensorのエコシステム全体にどのように位置づけられているかを考察します。この分野に慣れていない読者向けに、3つの基本的なトピックが必須の背景情報を提供します:

-

SN24とはとそのBittensorネットワークにおける役割を理解する

-

ロングコンテキストAIが重要な理由と、各産業における変革的な応用を探索中;

Quasar-3Bとは:SN24が長コンテキストの課題に取り組む方法

Quasar-3Bは、AIの最も持続的な制限の1つであるコンテキストウィンドウの劣化に対するOMEGA Labsの解決策です。ほとんどのモデルは、トレーニングコンテキスト長を超えるドキュメントを処理すると、精度が大幅に低下します。研究によると、Claudeは100万トークンを超えると精度が30%以上低下します。この制限は、AIシステムが実用的なアプリケーションで達成できることを本質的に制約しています。

アーキテクチャ名「Quasar」は、広大な距離から見えるほど非常に明るい天文現象を連想させます。同様に、Quasar-3Bは広範なコンテキストを照らし、精度を維持したまま数百万のトークンにわたってAIが「見渡せる」ように設計されています。「3B」という表記はモデルのパラメータ数を示し、「1B Active」は処理中に10億のパラメータがアクティブに動作することを意味します。

Quasar-3Bは、従来のトランスフォーマーと異なる主要なアーキテクチャの革新を備えています。ループ型連続時間トランスフォーマー設計により、モデルは最適化された範囲を超えるコンテキストを処理しても発生する一般的な情報劣化なしに、長距離シーケンスにわたって情報フローを維持できます。このアーキテクチャの選択は、BittensorとOpenAIの長文アプリケーションにおける競争を制約してきた根本的な限界を解決します。

SN24が広範なエコシステム内でどのように戦略的に位置づけられているかを理解するには、このサブネットがBittensorの専門ユニットの一つとして、ネットワークのロングコンテキスト機能の向上を図りながら、世界最大の分散型マルチモーダルデータセットに貢献している点を確認することが役立ちます。

技術アーキテクチャ:Quasar-3Bが拡張コンテキストを実現する方法

Quasar-3Bの技術的アーキテクチャを理解するには、なぜ長期コンテキスト処理がAIシステムにとって非常に困難であるかを検討する必要があります。従来のトランスフォーマーモデルは、シーケンス長に比例して二次的に拡大するアテンションメカニズムを使用しています。つまり、コンテキスト長を2倍にすると、計算リソースは4倍になります。この数学的な現実により、拡張されたコンテキスト処理はほとんどのアプリケーションにとって費用が高すぎて実用的ではありません。

Quasar-3Bのループ型連続時間トランスフォーマー手法は、コンテキスト長が延長されても計算効率を維持するアーキテクチャの革新により、このスケーリング課題に対応しています。このモデルは、複数のメカニズムを通じてこれを実現しています。まず、連続時間モデリングにより、システムは離散的なブロックではなく、流れ続けるストリームとして情報を処理し、チャンキングに伴うオーバーヘッドを削減します。次に、ループ型アーキテクチャはフィードバック経路を生成し、計算量を比例して増加させることなく、拡張されたシーケンスにわたって情報を保持可能にします。第三に、最適化された推論パイプラインにより、拡張された機能が実用的なアプリケーションに反映されます。

ベンチマーク結果は、AI研究コミュニティ内で大きな注目を集めています。QuasarチームのXでの発表によると、このモデルはLongBench評価で競争力のあるパフォーマンスを示しており、これはロングコンテキストAI能力の標準ベンチマークです。モデルがコミュニティによるテストを経る中で、詳細なベンチマーク数値が次々と公開されていますが、初期の指標は数百万トークンにわたって精度を維持するという目標に向けて有意な進展が見られることを示唆しています。

Bittensorのサブネットインフラを通じたデプロイは、追加の利点を提供します。ネットワークの128のアクティブなサブネットにより、ロングコンテキスト処理のさまざまな側面に対する専門化された最適化が可能になります。検索、処理、検証に特化したサブネットは、Quasar-3Bと連携して、中央集権的なシステムで再現するのに多大なエンジニアリング努力を要する機能を実現します。

長コンテキストAIがAIレースで重要な理由

長コンテキストAIの意義は、技術的な達成を超えて、完全に新しいアプリケーションカテゴリを可能にする根本的な能力の変化を表しています。大規模なドキュメントセット、法的手続き、コードベース、または研究アーカイブを扱う企業や研究者にとって、データセット全体をコンテキスト内で処理できる能力は、可能になることを変革します。

従来のAIアプローチでは、大規模なドキュメントを小さなチャンクに分割する必要があり、データセット全体にわたるパターンを把握できませんでした。数千年ものドキュメントを審査する法務チームは、すべての資料間の関係を理解する必要のある質問ができませんでした。百万行のコードベースを分析する開発者は、システム全体のコンテキストを理解するAIの支援を得られませんでした。ロングコンテキストAIはこれらの制約を解消し、これまで実用的ではなかった法律、医療、金融、研究分野でのアプリケーションを可能にします。

主要なプレイヤーがこの動向を認識したことで、競争環境は激化しています。OpenAIのGPT-4.5やAnthropicのClaude Opus 4.6はコンテキストウィンドウを100万トークンまで拡大し、Geminiは200万トークンに達しています。これらの進展は市場の方向性を裏付けるとともに、競合他社の基準を引き上げています。BittensorのQuasar-3Bによる参入は、この分野に対する最も本格的な分散型の挑戦です。

これらの機能がなぜ重要であり、どの業界が最も恩恵を受けるのかをより深く理解したい方へ、ロングコンテキストAIの分析は、医療診断、法律文書のレビュー、金融ポートフォリオ分析、学術文献の統合において変革的な可能性を示しています。

Bittensorの分散型モデルが中央集権型AIと競争する方法

Quasar-3Bのリリースにより、Bittensorの分散型アプローチとOpenAIの集中型開発モデルの比較が新たな次元を迎えています。BittensorとOpenAIの競争がロングコンテキストAIでどのように現れるかを理解するには、この競争の複数の側面を検討する必要があります。

リソースの観点から見ると、OpenAIは大きな利点を享受しています。同社のマイクロソフトとの提携により、膨大な計算インフラへのアクセスが可能になっています。GPT-4のトレーニングには1億ドル以上かかったと報告されています。この資本集約性は、分散型ネットワークが直接対抗するのを困難にしています。しかし、Bittensorの分散型モデルは、単一のエージェントによる投資を必要とせず、数千人の参加者から資本を活用します。Quasar-3Bの開発は、この分散型モデルから意味のあるAI機能が生まれ得ることを示しています。

インセンティブ構造は本質的に異なります。OpenAIの開発による利益は主に同社とその投資家に流れます。従業員や研究者は報酬を受け取りますが、長期的な価値創造には参加しません。Bittensorの暗号経済モデルでは、Quasar-3Bの開発に貢献した人々が、ネットワークの成長とともに価値が上昇するTAOトークンを獲得します。この整合性は、競争を通じてイノベーションを促進する異なる動機パターンを生み出します。

このアーキテクチャは、分散型ネットワークがどのように効果的に専門化できるかを示しています。誰にでも対応しようとする汎用的な機能を構築するのではなく、サブネットは特定の課題に集中できます。Quasar-3Bは長文コンテキスト処理にのみ焦点を当て、汎用的な改善にリソースを分散させるのではなく、この機能に深く最適化しています。

これらのアプローチ間のスケーラビリティのトレードオフに興味のある読者向けに、詳細な比較では、各モデルが使用ケースの要件に応じて異なる利点を示していることがわかります。

両アプローチが成熟するにつれて、パフォーマンス比較は引き続き進化しています。OpenAIのモデルは現在、汎用能力ベンチマークでリードしています。Bittensorサブネットは特定のタスクで競争力のあるパフォーマンスを示しています。ロングコンテキストの次元は、Quasar-3Bの連続時間トランスフォーマー設計のようなアーキテクチャの革新により、Bittensorが追随するのではなくリードする可能性のある分野です。

TAOおよびBittensorエコシステムの戦略的意義

Quasar-3Bのリリースは、広範なBittensorエコシステムおよびTAOトークンに重要な影響を及ぼします。これらの影響を理解するには、サブネットシステムがネットワーク全体に価値を生み出す仕組みを検討する必要があります。

Bittensor内のサブネットは、それぞれ異なるAI機能に特化した専門市場として機能します。個々のサブネットの成功は、複数のメカニズムを通じてネットワーク全体の価値に貢献します。第一に、有用なサブネットはTAOエミッションを生み出すクエリを引き寄せます。第二に、成功したサブネットはネットワークの能力を示し、より多くの参加者を惹きつけます。第三に、dTAOシステムにより、サブネットトークンの価値上昇は自動市場メイカー(AMM)メカニズムを通じてTAO保有者に利益をもたらします。

Quasar-3Bのローンチは、複数の面でネットワークを強化します。このモデルは、分散型AI分野でこれまで存在しなかった機能を提供し、長文コンテキスト処理を必要とするユーザーを引き寄せます。この技術的革新は、Bittensorが最先端のAI研究を生み出せることを示しています。ローンチへの注目は、AI開発におけるサブネットアプローチの有効性を検証しています。

Quasar-3Bが本番環境で稼働することで、競争的なポジショニングがより魅力的になります。AIの選択肢を評価している企業ユーザーは、中央集権的なプロバイダーと同等の機能を備えた分散型の代替手段を利用できるようになりました。この競争は、全体の市場に利益をもたらすとともに、Bittensorエコシステムへの価値の獲得を可能にします。

TAOを評価する投資家にとって、Quasar-3Bのローンチは投資の論拠を裏付ける証拠である。分散型調整を通じて競争力のあるAIモデルを開発できる能力は、基本的なアプローチの妥当性を検証する。今後のサブネットのローンチは、Quasar-3Bをネットワークが中央集権的なAI開発と競合できることの証拠として示すことができる。

Quasar-3Bの長コンテキスト機能が可能にする実世界のアプリケーション

Quasar-3Bの拡張コンテキスト機能の実用的な応用は、これまでAI支援が不実用だった産業やユースケースに広がっています。これらの応用を理解することは、技術的成果を超えて長コンテキスト競争がなぜ重要であるかを示しています。

法律業界のアプリケーションは、全体の事件ファイルを文脈内で処理できるようになると変革を遂げます。個々の文書を孤立して確認するのではなく、弁護士は完全な訴訟履歴を照会し、すべての資料にわたるパターンや先例を特定できます。契約分析では、契約ライブラリ全体にわたる義務と依存関係を追跡できます。デューデリジェンスでは、企業の包括的な文書を単一の分析に組み込むことができます。

ソフトウェア開発は、コードベース全体を文脈の中で理解することで恩恵を受けます。セキュリティ監査では、複数のファイルにまたがる脆弱性を特定するために、完全なリポジトリを分析できます。コードレビューでは、差分だけではなく、変更の全体的な文脈を理解できます。ドキュメント生成では、システムアーキテクチャの包括的な理解を活用できます。

財務分析は、完全な過去の文脈を伴って新たな洗練度に達しています。ポートフォリオ分析には、数十年にわたる市場データを組み込むことができます。リスク評価は、ポートフォリオ全体の保有資産を同時に評価できます。研究は、完全な業績履歴と規制提出書類を統合できます。

医療アプリケーションは、患者の包括的な分析を可能にします。診断では、数年にわたる完全な医療履歴を考慮できます。研究では、臨床試験の全データセットを分析できます。規制遵守では、包括的なポリシーフレームワークを処理できます。

学術研究は、膨大な文献全体と対話できるようになると変革を遂げる。文献レビューは、数十年にわたる出版物から得られた知見を統合できる。学際的研究は、異なる分野間の洞察を結びつけることができる。助成金分析は、提案の完全な履歴を評価できる。

ブロックチェーン業界はこれらの機能から特に恩恵を受けています。スマートコントラクト監査は、プロトコル実装全体を分析できます。DeFi分析は、エコシステムの相互作用を包括的に評価できます。オンチェーン分析は、完全なトランザクション履歴を組み込むことができます。

今後のロードマップ:SN24とQuasarの次なる展開

Quasar-3Bのローンチは最終的な到達点ではなく、一つのマイルストーンを示しています。サブネットのドキュメントによると、ロードマップは2026年以降にも及んでおり、複数の開発フェーズが計画されています。

2025年第四四半期には、Bittensorテストネット上でサブネットの初期リリース、LongBench評価の実装、モックモードのデプロイ、WandBモニタリングの統合が行われました。これらの基盤要素により、継続的な開発のためのインフラが整備されました。

2026年第1四半期は、ロングコンテキスト機能の拡張と評価指標の改善に焦点を当てました。2026年4月に発表されたQuasar-3Bは、これらの取り組みの成果ですが、継続的な改善が引き続き重点です。

2026年残りの期間における期待される開発には、異なる使用ケースに最適化された追加のモデルバリアント、現在の能力を超えた拡張されたコンテキスト長、より高度な機能提供のための他のBittensorサブネットとの統合、およびインセンティブメカニズムを通じたコミュニティ主導の改善が含まれます。

中央集権的なAIプロバイダーからの競争圧力により、業界全体での継続的なイノベーションが保たれます。OpenAI、Anthropic、Googleがコンテキストウィンドウをさらに拡大する中、分散型の競合他社はこの進歩に追いつきつつ、独自の利点を示す必要があります。Bittensorのサブネットによる専門化アプローチは、この継続的な競争のための枠組みを提供しています。

広範な分散型AIムーブメントにとって、Quasar-3Bはその実証です。分散型ネットワークから競争力のあるAI機能が生まれ得ることを示すことで、基本的な仮説が検証されました。今後のプロジェクトはこの基盤を活用し、分散型AIの代替策の開発を加速する可能性があります。

KuCoinでTAOに投資すべきですか

Bittensorエコシステムへの露出を評価するトレーダーにとって、Quasar-3Bのローンチは投資判断に追加の文脈を提供します。

バイブルン考慮点

-

競争力の検証:Quasar-3Bは、Bittensorが最先端のAI機能を開発できることを示し、分散型アプローチの妥当性を確認しました

-

長文コンテキストの市場機会:拡張コンテキストAI市場は、数十億ドルに上る重要で成長中の機会です

-

サブネットエコシステムの強さ:SN24のQuasar-3Bの成功が、より広範なサブネットエコシステムを強化します。

-

技術的差別化:連続時間トランスフォーマーのようなアーキテクチャの革新が独自の機能を提供します

リスク要因

-

中央集権的な競争:大手テクノロジー企業が長文対応AIに数十億ドルを継続的に投資しており、分散型の代替案を上回る可能性がある

-

実行の不確実性:アーキテクチャの革新を実用的なアプリケーションに変換するには、継続的な実行が必要です

-

規制環境:仮想通貨とAIは、世界中で進化する規制枠組みに直面しています

-

暗号資産市場の変動率:TAOは従来の資産と比較して依然として高変動率です

戦略的フレームワーク

Quasar-3Bのローンチは、Bittensorエコシステムにとって意味のある進展ですが、全体のポートフォリオの文脈内で評価する必要があります。暗号市場の変動率を踏まえ、分散型AIに関する信念に基づいて保有資産のサイズを決定してください。

KuCoinでTAOを取引する方法

ステップ1:KuCoin口座を作成する

TAOの取引を始められる準備ができたら、最初のステップはKuCoin口座の作成です。新規ユーザーはKuCoinで登録し、最大11,000 USDTの新規ユーザー報酬を受け取ることができます。これは初期取引資金を増やすための大きなボーナスです。KuCoinのウェブサイトにアクセスするか、モバイルアプリをダウンロードし、メールアドレスまたは電話番号で登録プロセスを完了させ、本人確認を行えば、この報酬を利用できます。登録は数分で完了し、ウェルカムボーナスはTAO取引の機会を探索するための優れた出発点となります。

ステップ2:取引を実行する

アカウントの設定が完了したら、KuCoinの取引インターフェースで"TAO/USDT"を検索してください。TAOはほとんどのポジションサイズに対して高い流動性を提供しますが、市場状況によって流動性は変動する可能性があります。Quasar-3Bのローンチのような主要な発表直前の高変動率期間には、スリッページを管理するために成行注文ではなく指値注文の利用を検討してください。取引を実行する前に、現在の市場状況とあなたのリスク許容度に基づいてエントリーポイントを評価してください。

ステップ3:保有資産の管理

AI仮想通貨資産に内在する変動率を踏まえ、保有資産を構築する前に明確な利益目標と損切りレベルを設定してください。SN24の動向、Bittensorサブネットの広範なローンチ、および分散型AIと集中型AIの競争環境の進展を監視してください。価格変動に対する感情的な反応ではなく、テーマの継続的な評価に基づいて保有資産を調整してください。

結論

SN24によるQuasar-3Bのリリースは、分散型AIにとって転換点です。Bittensorがその分散型ネットワークを通じて、競争力のある長コンテキストAI機能を開発できることを実証したことにより、人工知能の境界を広げられるのは誰なのかという従来の前提が問われています。Quasar-3Bのループ型連続時間トランスフォーマーに見られるアーキテクチャの革新は、今後の進歩の基盤を提供します。

分散型AIと集中型AIの競争 dynamics は引き続き進化しています。OpenAIは資本とスケールで優位性を維持しています。しかし、Bittensorはインセンティブの整合性、サブネットによる専門化、そしてグローバルな参加により異なる優位性を生み出しています。この発展により、BittensorとOpenAIの競争はさらに興味深くなりました。

広範なAI業界にとって、複数のアプローチが共存することはすべての利害関係者に利益をもたらします。競争はイノベーションを促進し、多様性はレジリエンスを提供します。分散型ネットワークが競争できるという実証は、代替開発構造の有効性を裏付けています。

投資家にとって、Quasar-3Bのローンチは、Bittensorへの投資理論を裏付ける証拠を提供します。ただし、保有資産の規模は、初期段階の技術採用と暗号資産市場の変動率を反映させるべきです。

よくある質問

Q: Quasar-3Bとは何ですか?

A: Quasar-3Bは、SN24(OMEGA Labs)が2026年4月にBittensorネットワーク上でリリースした長コンテキストAIモデルです。これは、数百万のトークンにわたって効率的に推論するように設計されたループ型連続時間トランスフォーマーアーキテクチャを使用しています。「3B」は30億のパラメータを意味し、処理中に10億が活性化されます。

Q: Quasar-3BはOpenAIのロングコンテキストモデルと比較してどうですか?

A: Quasar-3Bは、拡張されたシーケンスにわたって精度を維持するアーキテクチャの革新により、ロングコンテキストの課題に特化しています。詳細なベンチマーク比較は引き続き公開されていますが、このモデルはLongBench評価で競争力のあるパフォーマンスを示しています。分散型開発モデルは、OpenAIの集中型アプローチとは異なる利点を提供します。

Q: Quasarアーキテクチャは、従来のトランスフォーマーとどのように異なりますか?

A: Quasarは、拡張されたシーケンスにわたって情報を効率的に伝達できるループ型連続時間トランスフォーマー設計を採用しており、従来のトランスフォーマーで発生する二次スケーリング問題を解決します。

Q: SN24は広範なBittensorエコシステムにどのように組み込まれていますか?

A: SN24 (OMEGA Labs)は、Bittensorの128のアクティブなサブネットの一つで、世界最大の分散型マルチモーダルデータセットの作成に焦点を当てています。このサブネットは、データインフラを通じて、またQuasar-3BのようなAI機能を通じてエコシステムに貢献しています。

Q: Quasar-3Bの実世界での応用例はどのようなものですか?

A: 応用例には、完全な事件ファイル全体にわたる法的文書の分析、コードベース全体にわたるソフトウェアセキュリティ監査、数十年にわたる市場データを組み込んだ金融分析、患者の完全な病歴にわたる医療分析、および文献全体にわたる学術研究の統合が含まれます。

免責事項: このページは、お客様の便宜のためにAI技術(GPT活用)を使用して翻訳されています。最も正確な情報については、元の英語版を参照してください。