Tác giả:Tina, Đông Mai, InfoQ

1. Sau hơn 3 năm, Musk công khai thuật toán đề xuất của X lần nữa.

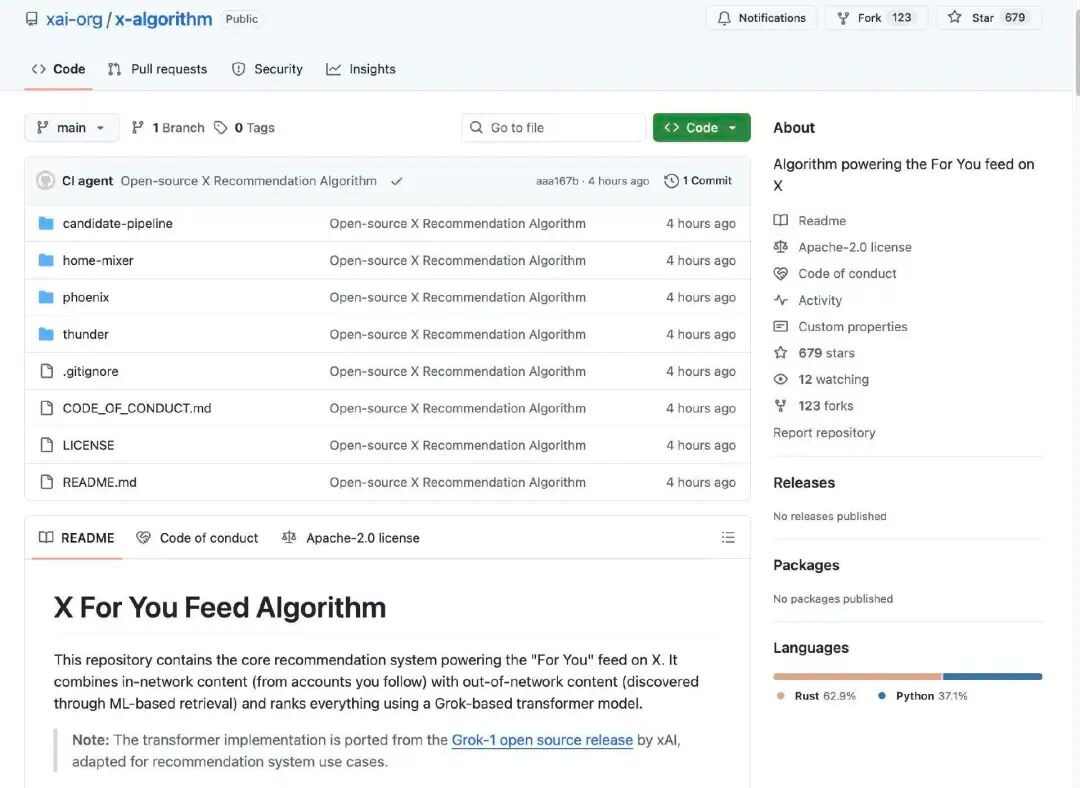

Vừa qua, nhóm kỹ thuật của X đã đăng bài trên X thông báo chính thức mã nguồn mở cho thuật toán đề xuất của X. Theo thông tin được cung cấp, thư viện mã nguồn mở này bao gồm hệ thống đề xuất cốt lõi hỗ trợ luồng thông tin "Đề xuất cho bạn" trên X. Hệ thống này kết hợp nội dung trong mạng (từ các tài khoản mà người dùng đang theo dõi) với nội dung ngoài mạng (được tìm thấy thông qua việc truy xuất dựa trên học máy), và sử dụng mô hình Transformer dựa trên Grok để xếp hạng tất cả nội dung. Nói cách khác, thuật toán này sử dụng kiến trúc Transformer giống hệt với Grok.

Địa chỉ mã nguồn mở: https://x.com/XEng/status/2013471689087086804

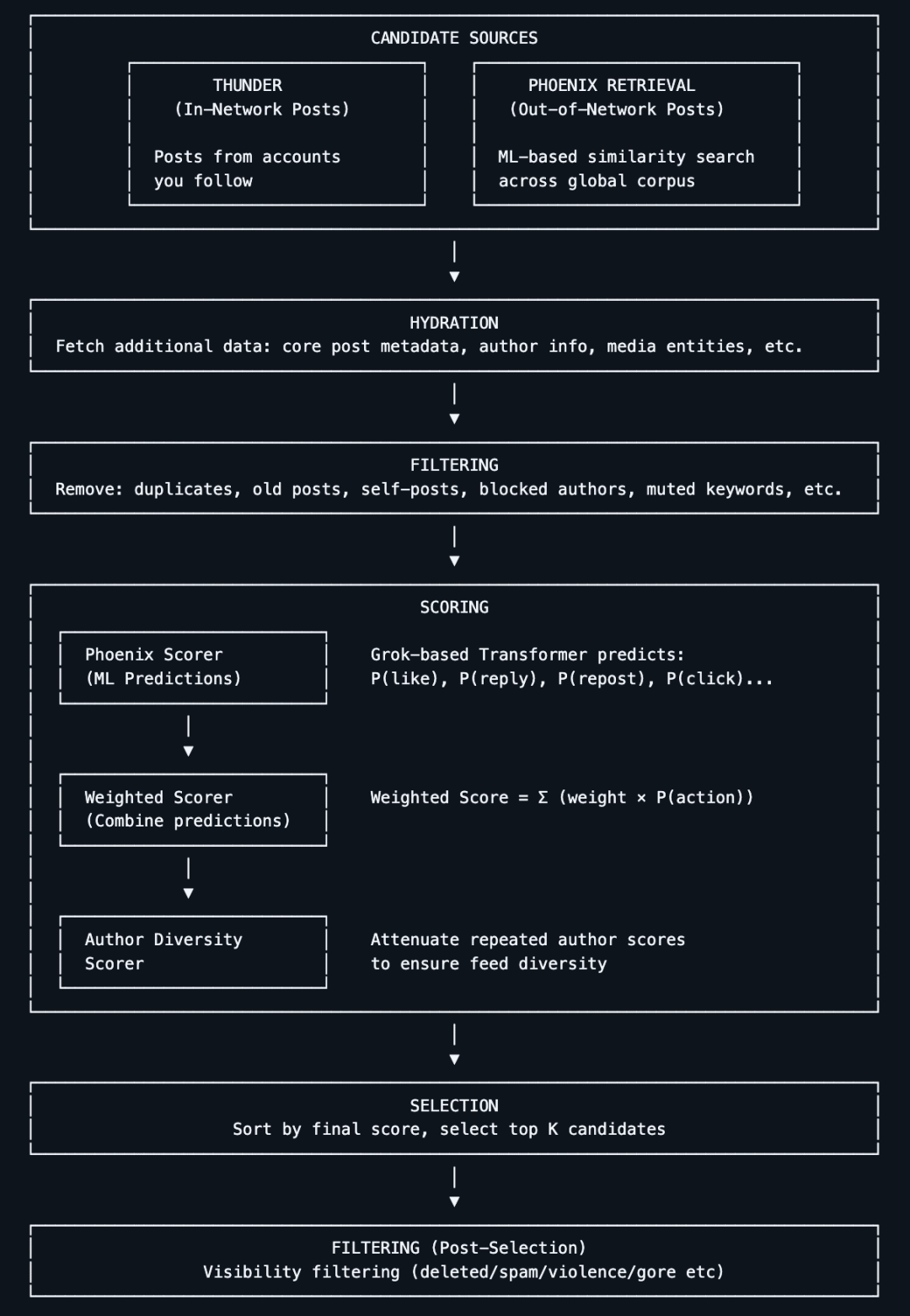

Thuật toán đề xuất của X chịu trách nhiệm tạo ra những nội dung mà người dùng nhìn thấy trên giao diện chính.Nội dung "Đề xuất cho bạn" (For You Feed)Nó lấy các bài viết ứng viên từ hai nguồn chính:

Tài khoản bạn đang theo dõi (In-Network / Thunder)

Các bài đăng khác được tìm thấy trên nền tảng (Out-of-Network / Phoenix)

Những nội dung ứng viên này sau đó được xử lý, lọc và sắp xếp theo mức độ liên quan.

Vậy thì kiến trúc cốt lõi và logic vận hành của thuật toán là như thế nào?

Thuật toán trước tiên sẽ thu thập nội dung ứng viên từ hai nguồn sau:

Nội dung theo dõi: Bao gồm các bài đăng được đăng bởi các tài khoản mà bạn chủ động theo dõi.

Nội dung không theo dõi: Bao gồm các bài viết có thể bạn quan tâm được hệ thống tìm kiếm trong toàn bộ thư viện nội dung.

Mục tiêu của giai đoạn này là "tìm ra các bài viết có thể liên quan".

Hệ thống tự động xóa nội dung có chất lượng thấp, trùng lặp, vi phạm hoặc không phù hợp. Ví dụ:

Nội dung của tài khoản đã bị chặn

Xác định rõ các chủ đề mà người dùng không quan tâm.

Bài viết bất hợp pháp, lỗi thời hoặc không hợp lệ

Điều này đảm bảo rằng khi sắp xếp cuối cùng, chỉ nội dung ứng viên có giá trị mới được xử lý.

Thuật toán mã nguồn mở lần này có lõi là hệ thống sử dụng một mô hình Transformer dựa trên Grok (tương tự như mô hình ngôn ngữ lớn / mạng học sâu) để chấm điểm cho từng bài đăng ứng viên. Mô hình Transformer dựa trên hành vi lịch sử của người dùng (thích, trả lời, chia sẻ, nhấp chuột, v.v.) để dự đoán xác suất của từng hành vi đó. Cuối cùng, các xác suất hành vi này được kết hợp có trọng số thành một điểm tổng hợp, và những bài đăng có điểm số cao hơn sẽ có khả năng được đề xuất cho người dùng cao hơn.

Thiết kế này cơ bản loại bỏ phương pháp truyền thống là trích xuất đặc trưng thủ công, chuyển sang sử dụng cách học end-to-end để dự đoán sở thích người dùng.

Đây không phải là lần đầu tiên Musk công khai thuật toán đề xuất của X.

Vào ngày 31 tháng 3 năm 2023, như lời hứa khi mua lại Twitter, Musk đã chính thức công bố mã nguồn của Twitter, bao gồm thuật toán đề xuất tweet trên dòng thời gian của người dùng.Ngay ngày đầu tiên mở nguồn, dự án đã thu về hơn 10 nghìn sao trên GitHub.

Lúc đó, Musk đã nói trên Twitter rằng lần ra mắt này là"Đa số các thuật toán đề xuất"Các thuật toán còn lại cũng sẽ lần lượt được công khai. Ông cũng đề cập rằng, mong muốn "các bên thứ ba độc lập có thể xác định một cách chính xác nội dung mà Twitter có thể hiển thị cho người dùng".

Trong buổi thảo luận trên Space về việc công bố thuật toán, anh ấy nói rằng kế hoạch mã nguồn mở lần này nhằm biến Twitter thành "hệ thống trong suốt nhất trên internet", và biến nó trở nên mạnh mẽ như dự án mã nguồn mở nổi tiếng và thành công nhất là Linux. "Mục tiêu tổng thể là để những người dùng tiếp tục hỗ trợ Twitter có thể tận hưởng tối đa nền tảng này."

Hiện tại đã hơn ba năm kể từ lần đầu tiên Musk công khai thuật toán X. Là một KOL siêu lớn trong giới công nghệ, Musk đã làm rất nhiều công tác truyền thông cho lần công khai này.

Vào ngày 11 tháng 1, Musk đã đăng trên X rằng anh ấy sẽ công khai mã nguồn của thuật toán X mới (bao gồm toàn bộ mã xác định nội dung tìm kiếm tự nhiên và quảng cáo nào được đề xuất cho người dùng) trong vòng 7 ngày.

Quy trình này sẽ lặp lại mỗi 4 tuần và đi kèm với hướng dẫn chi tiết dành cho nhà phát triển nhằm giúp người dùng hiểu rõ những thay đổi nào đã diễn ra.

Hôm nay, lời hứa của anh ấy đã được thực hiện lần nữa.

2. Tại sao Musk lại mở nguồn?

Khi Elon Musk lại đề cập đến "mở nguồn", phản ứng đầu tiên từ dư luận không phải là chủ nghĩa lý tưởng công nghệ, mà là áp lực thực tế.

Trong năm qua, X đã nhiều lần vướng phải tranh cãi về cơ chế phân phối nội dung của mình. Nền tảng này bị chỉ trích rộng rãi vì có sự thiên vị và bao bọc các quan điểm cánh hữu trên bình diện thuật toán. Xu hướng này không phải là hiện tượng cá biệt, mà được cho là mang tính hệ thống. Một báo cáo nghiên cứu được công bố năm ngoái đã chỉ ra rằng, hệ thống đề xuất của X đã xuất hiện những thiên kiến mới rõ rệt trong việc lan truyền nội dung chính trị.

Trong khi đó, một số trường hợp cực đoan đã làm gia tăng thêm những nghi ngờ từ bên ngoài. Năm ngoái, một đoạn video chưa qua kiểm duyệt liên quan đến việc cựu nghị sĩ cánh hữu Mỹ Charlie Kirk bị đâm đã nhanh chóng lan truyền trên nền tảng X, gây chấn động dư luận. Các nhà chỉ trích cho rằng, điều này không chỉ phơi bày sự bất lực của cơ chế kiểm duyệt nội dung trên nền tảng, mà còn lần nữa làm nổi bật vai trò của thuật toán trong việc "khuyến khích lan truyền nội dung gì và không khuyến khích nội dung gì". Quyền lực ẩn.

Trong bối cảnh này, việc Musk đột ngột nhấn mạnh tính minh bạch của thuật toán khó có thể được hiểu đơn giản là một quyết định thuần túy về mặt kỹ thuật.

3. Người dùng mạng nghĩ thế nào?

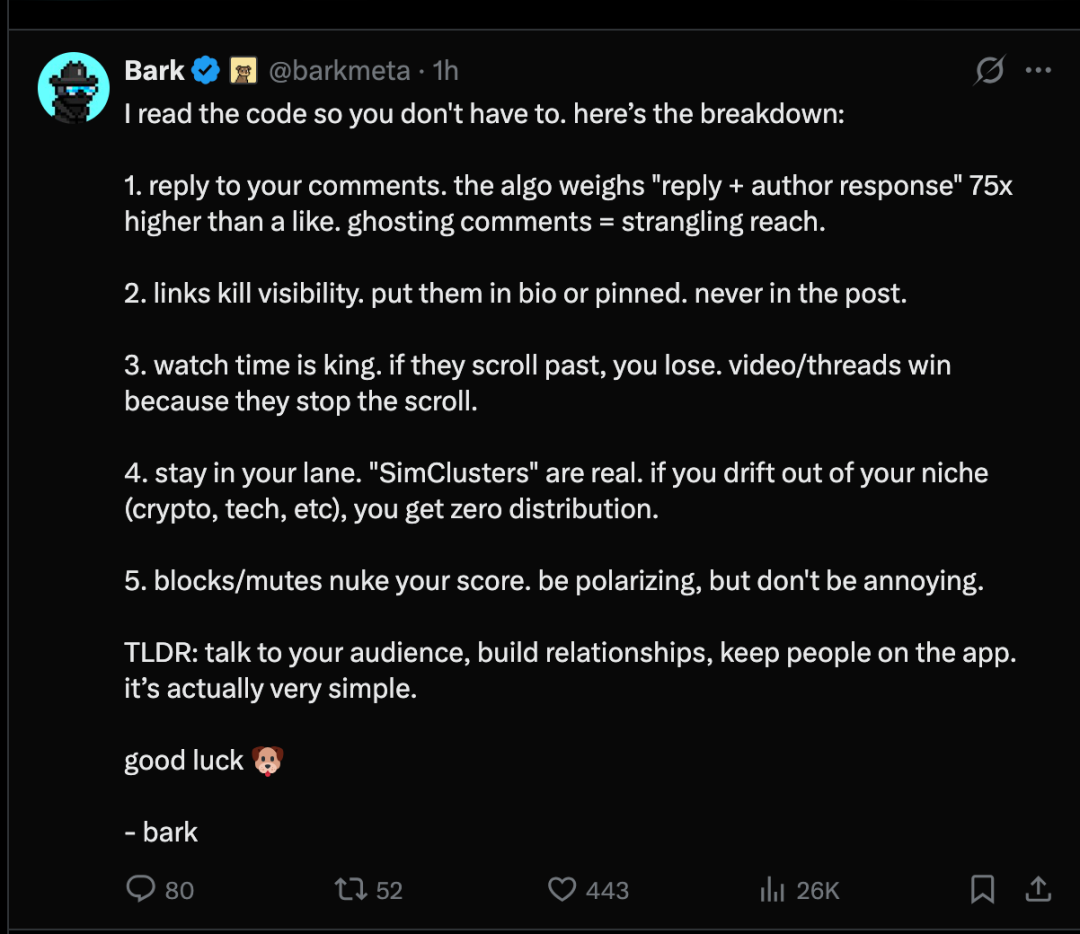

Sau khi X công bố mã nguồn thuật toán đề xuất, trên nền tảng X, người dùng đã tóm tắt cơ chế của thuật toán đề xuất thành 5 điểm sau:

- Trả lời nhận xét của bạnThuật toán gán trọng số cho "trả lời + phản hồi của tác giả" gấp 75 lần số lượt thích. Việc không trả lời các bình luận sẽ ảnh hưởng nghiêm trọng đến tỷ lệ tiếp cận.

- Liên kết sẽ làm giảm tỷ lệ tiếp xúc.Hãy đặt đường link trong phần thông tin cá nhân hoặc trong bài viết được ghim đầu trang, tuyệt đối không đặt trong nội dung bài viết.

- Thời lượng xem là rất quan trọngNếu họ trượt qua màn hình, bạn sẽ không thể thu hút họ. Video/bài đăng nhận được nhiều sự chú ý cao là vì chúng có thể khiến người dùng dừng lại.

- Giữ vững lĩnh vực của bạn"Khối giả lập" là thứ thực sự tồn tại. Nếu bạn đi lệch khỏi lĩnh vực cụ thể của mình (tiền điện tử, công nghệ, v.v.), bạn sẽ không thể tiếp cận bất kỳ kênh phân phối nào.

- Bị chặn / Không trả lời sẽ làm giảm điểm của bạn rất nhiềuCó tính gây tranh cãi, nhưng đừng làm người khác khó chịu.

Tóm lại: Giao tiếp với người dùng của bạn, xây dựng mối quan hệ và giữ chân họ trong ứng dụng. Trên thực tế, điều này rất đơn giản.

Một số người dùng mạng cũng đã nhận ra rằng, mặc dù kiến trúc là mã nguồn mở, vẫn còn một vài nội dung chưa được công khai mã nguồn. Người dùng này cho biết, bản phát hành lần này về bản chất là một khung, chứ không phải là một động cơ. Cụ thể, thiếu những gì?

Thiếu tham số trọng số - Mã xác nhận "hành vi tích cực được cộng điểm" và "hành vi tiêu cực bị trừ điểm", nhưng khác với phiên bản năm 2023, các con số cụ thể đã bị xóa bỏ.

Ẩn trọng số mô hình - Không bao gồm các tham số và phép tính nội bộ của mô hình.

Dữ liệu huấn luyện chưa được công bố - Chúng ta hoàn toàn không biết gì về dữ liệu huấn luyện mô hình, cách lấy mẫu hành vi người dùng, cũng như cách xây dựng các mẫu "tốt" và "xấu".

Đối với người dùng X thông thường, việc thuật toán của X được mở mã nguồn sẽ không gây ảnh hưởng lớn. Tuy nhiên, mức độ minh bạch cao hơn có thể giúp giải thích lý do một số bài đăng được lan truyền trong khi những bài khác lại không được chú ý, đồng thời cho phép các nhà nghiên cứu phân tích cách nền tảng xếp hạng nội dung.

4. Tại sao hệ thống đề xuất lại là lĩnh vực tranh giành gay gắt?

Trong hầu hết các cuộc thảo luận về kỹ thuật,Hệ thống đề xuấtThường xuyên bị coi là một phần của kỹ thuật hậu trường, khiêm tốn, phức tạp, nhưng hiếm khi được đặt dưới ánh đèn sân khấu. Tuy nhiên, nếu thực sự phân tích kỹ cách vận hành thương mại của các tập đoàn công nghệ lớn, bạn sẽ nhận ra rằng hệ thống đề xuất không phải là một mô-đun ở rìa mà lại là một "cơ sở hạ tầng" cốt lõi, nâng đỡ toàn bộ mô hình kinh doanh. Chính vì lý do này, nó có thể được gọi là "con quái vật im lặng" trong ngành công nghiệp internet.

Dữ liệu công khai đã nhiều lần khẳng định điều này. Amazon từng tiết lộ rằng khoảng 35% các giao dịch mua hàng trên nền tảng của họ trực tiếp đến từ hệ thống đề xuất; Netflix còn đi xa hơn, khoảng 80% thời gian xem phim được thúc đẩy bởi thuật toán đề xuất; YouTube cũng tương tự, khoảng 70% thời gian xem đến từ hệ thống đề xuất, đặc biệt là luồng nội dung (feed). Về phần Meta, dù chưa từng công bố tỷ lệ cụ thể, nhưng đội ngũ kỹ thuật của công ty từng cho biết khoảng 80% chu kỳ tính toán trong các cụm máy tính nội bộ của công ty đều được sử dụng để phục vụ các nhiệm vụ liên quan đến đề xuất.

Những con số này có ý nghĩa gì?Nếu loại bỏ hệ thống đề xuất khỏi những sản phẩm này, gần như tương đương việc rút đi nền móng.Lấy ví dụ về Meta, việc đặt quảng cáo, thời gian người dùng ở lại nền tảng, và sự chuyển đổi thương mại hầu như đều dựa vào hệ thống đề xuất. Hệ thống đề xuất không chỉ quyết định người dùng "xem gì", mà còn trực tiếp quyết định nền tảng "làm thế nào để kiếm tiền".

Tuy nhiên, chính hệ thống quyết định sự sống chết này lại trong thời gian dài phải đối mặt với vấn đề độ phức tạp kỹ thuật rất cao.

Trong kiến trúc hệ thống đề xuất truyền thống, việc sử dụng một mô hình thống nhất để bao quát tất cả các tình huống là rất khó khăn. Trong thực tế, các hệ thống sản xuất thường bị phân mảnh cao. Lấy ví dụ các công ty như Meta, LinkedIn, Netflix, phía sau một chuỗi đề xuất hoàn chỉnh thường vận hành đồng thời 30 mô hình chuyên dụng hoặc nhiều hơn: mô hình gọi lại (recall model), mô hình lọc thô (coarse ranking model), mô hình lọc tinh (fine ranking model), mô hình sắp xếp lại (re-ranking model), mỗi mô hình đều được tối ưu hóa cho các hàm mục tiêu và chỉ số kinh doanh khác nhau. Phía sau mỗi mô hình, thường có một hoặc nhiều nhóm làm việc chịu trách nhiệm về kỹ thuật đặc trưng (feature engineering), huấn luyện mô hình, điều chỉnh tham số, triển khai và cập nhật liên tục.

Giá thành của mô hình này là rõ ràng: phức tạp trong kỹ thuật, chi phí bảo trì cao, và khó khăn trong việc phối hợp giữa các nhiệm vụ. Ngay khi ai đó đặt câu hỏi "Liệu có thể sử dụng một mô hình để giải quyết nhiều vấn đề đề xuất hay không?", điều này đối với toàn bộ hệ thống có nghĩa là sự giảm mạnh về độ phức tạp. Đây chính là mục tiêu mà ngành công nghiệp đã mong đợi trong thời gian dài nhưng khó có thể đạt được.

Việc xuất hiện của các mô hình ngôn ngữ lớn đã mở ra một con đường mới tiềm năng cho hệ thống đề xuất.

Mô hình LLM đã được chứng minh trong thực tế rằng nó có thể trở thành một mô hình tổng quát mạnh mẽ đến mức phi thường: khả năng chuyển đổi giữa các nhiệm vụ khác nhau rất tốt, và hiệu năng của nó có thể tiếp tục được cải thiện khi mở rộng quy mô dữ liệu và năng lực tính toán. Trong khi đó, các mô hình đề xuất truyền thống thường là "định hướng nhiệm vụ", rất khó để chia sẻ khả năng giữa nhiều tình huống khác nhau.

Hơn nữa, một mô hình lớn thống nhất không chỉ đơn giản hóa quy trình kỹ thuật, mà còn mang lại tiềm năng "học chéo". Khi cùng một mô hình xử lý đồng thời nhiều nhiệm vụ đề xuất khác nhau, các tín hiệu từ các nhiệm vụ khác nhau có thể bổ sung cho nhau, và khi quy mô dữ liệu tăng lên, mô hình sẽ dễ dàng tiến hóa một cách toàn diện hơn. Đây chính là đặc tính mà hệ thống đề xuất đã mong đợi trong thời gian dài, nhưng khó có thể đạt được bằng các phương pháp truyền thống.

Mô hình ngôn ngữ lớn (LLM) đã thay đổi điều gì? Thực ra, nó đã thay đổi từ kỹ thuật trích chọn đặc trưng đến khả năng hiểu biết.

Từ góc độ phương pháp luận, sự thay đổi lớn nhất của LLM đối với hệ thống đề xuất xảy ra ở khâu cốt lõi là "kỹ thuật đặc trưng".

Trong hệ thống đề xuất truyền thống, các kỹ sư phải tự tay tạo ra một lượng lớn các tín hiệu như: lịch sử nhấp chuột của người dùng, thời gian xem, sở thích của người dùng tương tự, nhãn nội dung, v.v., sau đó rõ ràng chỉ thị cho mô hình "hãy đưa ra phán đoán dựa trên các đặc trưng này". Bản thân mô hình không hiểu được ý nghĩa ngữ nghĩa của các tín hiệu này, mà chỉ học cách ánh xạ trong không gian số.

Sau khi giới thiệu mô hình ngôn ngữ, quy trình này đã được trừu tượng hóa cao độ. Bạn không còn cần phải chỉ định từng bước như "quan tâm đến tín hiệu này, bỏ qua tín hiệu kia", mà thay vào đó có thể trực tiếp mô tả vấn đề cho mô hình: đây là một người dùng, đây là một nội dung; người dùng này trong quá khứ đã thích nội dung tương tự, những người dùng khác cũng có phản hồi tích cực đối với nội dung này — hiện tại xin hãy phán đoán, nội dung này có nên được đề xuất cho người dùng này hay không.

Mô hình ngôn ngữ bản thân nó đã có khả năng hiểu, nó có thể tự đánh giá những thông tin nào là tín hiệu quan trọng và cách tổng hợp các tín hiệu này để đưa ra quyết định. Về một nghĩa nào đó, nó không chỉ đơn thuần thực thi các quy tắc gợi ý, mà còn đang "hiểu được việc gợi ý" này.

Nguồn gốc của khả năng này nằm ở việc LLM trong giai đoạn huấn luyện đã tiếp xúc với lượng dữ liệu khổng lồ và đa dạng, giúp nó dễ dàng hơn trong việc nhận diện các mô hình tinh tế nhưng quan trọng. Ngược lại, các hệ thống đề xuất truyền thống phải dựa vào các kỹ sư liệt kê rõ ràng các mô hình này; một khi bị bỏ sót, mô hình sẽ không thể nhận biết được.

Từ góc độ backend, sự thay đổi này không hề xa lạ. Giống như khi bạn đặt câu hỏi cho GPT, nó sẽ tạo ra câu trả lời dựa trên thông tin ngữ cảnh; tương tự, khi bạn hỏi nó "Tôi có quan tâm đến nội dung này không?", nó cũng có thể đưa ra phán đoán dựa trên thông tin hiện có. Một cách nào đó, mô hình ngôn ngữ bản thân nó đã tự nhiên sở hữu khả năng "gợi ý" hay "khuyến nghị".