Khi tất cả đều tập trung vào cuộc chiến tại lớp mô hình, một đội ngũ sở hữu tiêu chuẩn mở cho suy luận đã chính thức hướng mũi tên vào cơ sở hạ tầng AI của thời đại mới, với danh sách nhà đầu tư vòng seed sang trọng nhất từ Thung lũng Silicon.

Tác giả bài viết, nguồn: Machine Heart

Ngày 5 tháng 5, công ty khởi nghiệp cơ sở hạ tầng AI RadixArk thông báo hoàn thành vòng gọi vốn hạt giống 100 triệu USD, định giá sau vòng gọi vốn là 400 triệu USD. Dù về số tiền, định giá hay danh sách nhà đầu tư, đây đều là khoản đầu tư sớm lớn nhất tính đến nay trong lĩnh vực AI Infra năm 2026.

Vòng này do Accel dẫn đầu và Spark Capital đồng dẫn đầu. Các nhà đầu tư tổ chức bao gồm NVentures thuộc NVIDIA, AMD, MediaTek, Databricks, cùng các tổ chức hàng đầu như Salience Capital, HOF Capital, Walden Catalyst, A&E Investment, LDVP và WTT Fubon Family. Từ GPU đến CPU, từ chip biên đến nền tảng dữ liệu, gần như tất cả các nhân vật then chốt trong phần cứng cốt lõi và lớp hệ thống đều đã tham gia.

Ngoài các tổ chức hàng đầu, nhiều nhà lãnh đạo công nghệ toàn cầu với nền tảng từ Intel, Broadcom, OpenAI, xAI, PyTorch cũng tham gia vào vòng đầu tư này với tư cách là nhà đầu tư thiên thần.

“CEO của ba ông lớn phần cứng + người sáng lập phòng thí nghiệm mô hình hàng đầu + người sáng tạo PyTorch” — việc tập hợp đầy đủ bộ ba này trong một vòng seed funding là cực kỳ hiếm gặp trong lịch sử AI Infra. Các nhà đầu tư am hiểu lĩnh vực này thẳng thắn cho biết: đây là đang đặt cược vào “tiêu chuẩn thực tế của cơ sở hạ tầng thế hệ tiếp theo”.

Trình động cơ suy luận tốt nhất thế giới, trong tay họ

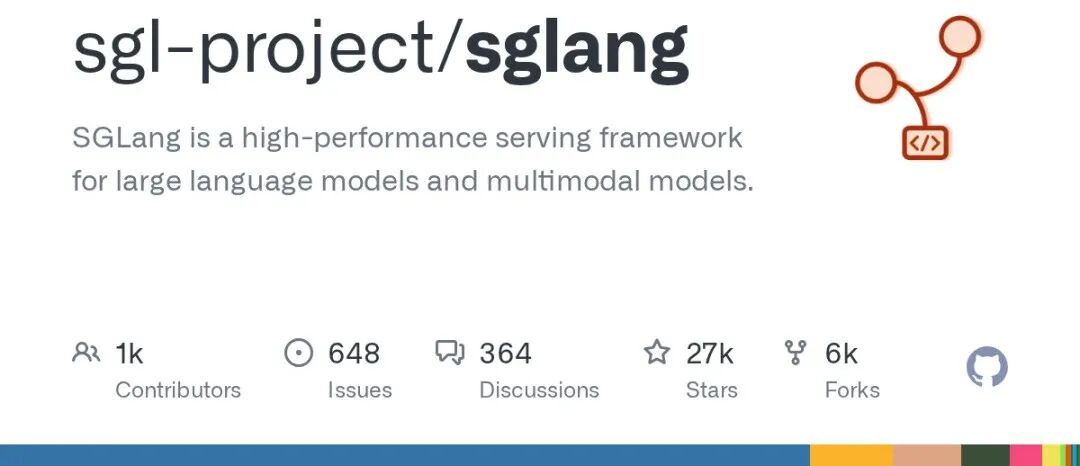

Câu chuyện về RadixArk phải bắt đầu từ một dự án mã nguồn mở có tên SGLang.

Kể từ khi ra đời năm 2023, SGLang đã trở thành một trong những tiêu chuẩn thực tế cho việc suy luận mô hình lớn mã nguồn mở với tốc độ cải tiến đáng kinh ngạc trong hai năm, tích lũy hơn 27K sao trên GitHub và được triển khai trên hơn 400K GPU. Hàng nghìn tỷ token lưu lượng sản xuất hàng ngày chạy trên SGLang, với người dùng bao gồm Google, Microsoft, NVIDIA, Oracle, AMD, LinkedIn, xAI và Thinking Machines Lab.

Trong hai năm qua, kiến trúc mô hình đã trải qua những thay đổi lớn như MoE, ngữ cảnh dài, mô hình suy luận và tích hợp đa phương tiện. Mỗi lần tái cấu trúc kiến trúc, SGLang đều đảm bảo tương thích Day-0—cơ chế hỗ trợ ngay khi phát hành mô hình mã nguồn mở đầu tiên trên thế giới, hiệu năng tiếp cận ngưỡng vật lý của máy móc. Một đánh giá thường được các nhà đầu tư nhắc đến là tốc độ phát triển và kỷ luật kỹ thuật của SGLang là đỉnh cao tuyệt đối trong các dự án mã nguồn mở.

Behind the underlying discipline is a founding team with deep expertise in systems and algorithms.

CEO Thịnh Dĩnh (Ying Sheng) tốt nghiệp cử nhân tại lớp ACM của Đại học Giao thông Thượng Hải, tiến sĩ tại Đại học Stanford, là người sáng lập LMSYS Org và một trong những người đồng sáng lập SGLang. Trong thời gian học tiến sĩ, cô từng là học giả khách mời tại Sky Lab, Đại học California, Berkeley, và từng làm việc tại Databricks và xAI, từng giữ chức trưởng nhóm suy luận của xAI. Công trình của Thịnh Dĩnh trong các hướng như thưa thớt sự chú ý và tái sử dụng bộ nhớ đệm KV đã thu hút sự quan tâm lớn từ ngành công nghiệp, trong đó cơ chế RadixAttention giai đoạn đầu của SGLang là một trong những tác phẩm tiêu biểu của cô.

CTO Chu Banghua (Banghua Zhu) tốt nghiệp cử nhân ngành Kỹ thuật Điện tử tại Đại học Thanh Hoa và tiến sĩ tại UC Berkeley, dưới sự hướng dẫn của các chuyên gia hàng đầu trong lĩnh vực học máy Michael I. Jordan và Jiantao Jiao. Trong thời gian học tiến sĩ, anh từng đồng sáng lập Nexusflow, sau đó được NVIDIA mua lại và đảm nhiệm vị trí Principal Research Scientist tại NVIDIA. Trong các dự án do anh phụ trách, có cả việc xây dựng toàn bộ hệ thống đào tạo cấp công nghiệp lẫn các tích lũy lâu dài về tối ưu hóa hệ thống nền tảng nội bộ và đào tạo quy mô lớn của NVIDIA.

Một kỹ thuật trưởng từ nhà sản xuất phần cứng cốt lõi đánh giá, đây là nhóm nhà sáng lập có giá trị cao nhất trong lĩnh vực khởi nghiệp AI Infra năm 2026: một bên là nhà sáng lập nghiên cứu nắm giữ tiêu chuẩn mở cho suy luận, bên còn lại là chuyên gia thuật toán mô hình lớn đến từ tầng nghiên cứu cốt lõi của nhà sản xuất GPU.

Nắm trong tay engine suy luận xử lý hàng nghìn tỷ token mỗi ngày – SGLang – đây đã là điểm khởi đầu lý tưởng cho việc khởi nghiệp trong lĩnh vực AI Infra. Và bộ bài của đội ngũ này còn không chỉ dừng lại ở một lá bài này.

Ngày-0: Huấn luyện DeepSeek V4 bằng học tăng cường

Ngoài động cơ suy luận, RadixArk cũng có những bước đột phá tại phía huấn luyện.

Tháng 11 năm 2025, nhóm đã mở nguồn khung học tăng cường Miles, tập trung vào tính ổn định và hiệu suất của việc huấn luyện RL quy mô lớn, hiện đã được hơn 20 nhóm sử dụng để huấn luyện RL cho các mô hình MoE.

Năm 2025–2026, cuộc cạnh tranh về khả năng Reasoning, Tool Use và Agentic sẽ được nâng lên một cấp độ hoàn toàn mới, và mỗi bước tiến đều đòi hỏi một hệ thống có thể chịu được RL phân tán quy mô cực lớn. Các chuyên gia trong ngành đã chỉ ra một điểm đau nhức thường được nhắc đến nhưng vẫn chưa được giải quyết lâu nay: điều khiến các đội ngũ mô hình lớn đau đầu nhất hiện nay còn vượt xa bất kỳ tối ưu hóa điểm nào. Những ma sát ở ranh giới trên toàn bộ chuỗi từ đào tạo đến RL và sau đó là suy luận khi đưa vào vận hành — dù từng phần riêng lẻ đều gần như tối ưu, nhưng khi ghép lại thì hiệu suất bị giảm sút ở khắp mọi nơi.

Sự kết hợp giữa Miles và SGLang đang nỗ lực lấp đầy khoảng cách hiệu suất trên toàn bộ chuỗi liên kết "đào tạo-RL-suy luận" mà các đội ngũ mô hình lớn hiện đang đối mặt.

Khả năng hỗ trợ của mô hình mới Day-0 là minh chứng trực quan cho năng lực kỹ thuật của đội ngũ Infra.

Vào ngày 25 tháng 4, DeepSeek-V4 với kiến trúc phức tạp đã được ra mắt. Ngay trong ngày đó, SGLang và Miles đã triển khai hỗ trợ đồng thời cho suy luận và huấn luyện RL của DeepSeek-V4. Điều này nhờ vào các tối ưu hóa hệ thống cấp nền tảng của đội ngũ, bao gồm bộ nhớ đệm tiền tố ShadowRadix được thiết kế cho sự chú ý hỗn hợp, Flash Compressor nén hoàn toàn trong một chip, Lightning TopK giảm độ trễ Top-K xuống còn 15 microgiây, cùng việc kết nối toàn bộ đường ống RL từ suy luận FP8 đến huấn luyện BF16.

Được bảo chứng bởi sự đồng thuận toàn diện:

Các ông lớn cùng gia nhập, rốt cuộc đang lo lắng điều gì?

NVIDIA, AMD, MediaTek, Broadcom, Intel—những công ty quan trọng nhất ở cấp phần cứng, cùng xuất hiện ở vòng seed round, điều này gần như không thể tưởng tượng trong ngành. Thực tế, các nhà sản xuất phần cứng hiểu rõ hơn ai hết rằng hiện nay năng lực tính toán vẫn đắt đỏ và khan hiếm, và việc chỉ đơn thuần tăng cường phần cứng đã không còn bền vững. Một hệ thống suy luận mã nguồn mở thực sự tách rời phần cứng, có thể khai thác tối đa hiệu năng chip trên các nền tảng dị cấu trúc, chính là nhu cầu cấp thiết nhất mà họ đang tìm kiếm.

Việc các nhân vật hàng đầu từ Databricks, PyTorch, OpenAI / Thinking Machines / xAI cùng gia nhập cho thấy kỳ vọng mạnh mẽ từ cấp độ mô hình và hệ thống đối với “cơ sở hạ tầng tích hợp huấn luyện-suy luận”. Mỗi cái tên trong đội hình thiên thần đều đại diện cho một góc nhìn đặt cược cực kỳ chính xác:

- Chen Liwu, CEO của Intel, một nhân vật uyên thâm trong ngành bán dẫn với hàng chục năm kinh nghiệm.

- John Schulman là đồng sáng lập trước đây của OpenAI, đồng sáng lập Thinking Machines Lab và một trong những người đặt nền móng cho học tăng cường.

- Soumith Chintala — đồng sáng lập PyTorch, người gác cổng cho các framework học sâu toàn cầu.

- Igor Babuschkin, cựu đồng sáng lập xAI, đã tự tay xây dựng các hệ thống đào tạo và nền tảng phần cứng phức tạp nhất ngành.

- Lilian Weng, đồng sáng lập Thinking Machines Lab, có hiểu biết trực tiếp nhất về việc ứng dụng thực tế các hệ thống AI.

Khi những người có thể tự mình huy động vốn trong mọi hoàn cảnh chọn cùng xuất hiện trên một bảng vốn, đó chính là sự đặt cược đầy nhiệt huyết vào tương lai.

Cơ sở hạ tầng dành cho tất cả mọi người: Đảm bảo quyền xây dựng AI không còn bị thiểu số độc quyền

Tầm nhìn của RadixArk có thể tóm gọn trong một câu: biến cơ sở hạ tầng AI thành một hàng hóa công cộng phổ biến, đáng tin cậy và không bị bất kỳ ai độc quyền, giống như điện. Nghe có vẻ như một tuyên bố lý tưởng, nhưng từ góc độ thực tiễn, họ đang biến câu nói này thành hiện thực:

- Academic community

Ba năm trước, một nghiên cứu sinh chuyên về tối ưu hóa suy luận LLM thường chỉ có hai lựa chọn: một là API của OpenAI, tính phí theo token và không thể nhìn thấy bất kỳ cấu trúc nội bộ nào;另一个 là mã nguồn mở cũ kỹ, trong README ghi “works on a single GPU”, cách xa bối cảnh phân tán thực tế được mô tả trong bài báo một khoảng cách kỹ thuật kéo dài nhiều năm.

SGLang đã phá vỡ sự lựa chọn nhị phân này—khả năng xử lý hàng ngày ở cấp độ công nghiệp và mã nguồn hoàn toàn mở, các nhóm nghiên cứu hệ thống của Stanford, Berkeley, CMU và UW đều coi nó là baseline mặc định. Đối với các nhà nghiên cứu làm về agent, prefix cache của RadixAttention tổ chức các tiền tố chung thành cấu trúc cây, chỉ tính một lần các KV giống nhau, giúp các thí nghiệm trước đây mất hai ngày nay chỉ cần nửa ngày là xong, và việc trích dẫn SGLang trong các bài báo nghiên cứu trên máy tính cục bộ gần như đã trở thành hành động mặc định.

- Startup

Một nhóm kỹ sư rời khỏi các công ty lớn, mang theo sự hiểu biết sâu sắc về một bối cảnh chuyên biệt để khởi nghiệp. Họ không có ngân sách tính toán hàng triệu đô la, không có đội ngũ Infra chuyên biệt, chỉ có trực giác mãnh liệt về sản phẩm.

Trước đây, việc xây dựng đường ống suy luận cấp sản xuất và gánh vác gánh nặng kỹ thuật để duy trì tương thích đa phần cứng thường vượt quá khả năng chịu đựng của các công ty giai đoạn seed, khiến họ tốn rất nhiều thời gian vào việc tái tạo lại những thứ đã có. Bây giờ, họ có thể trực tiếp triển khai các dịch vụ suy luận với hiệu năng gần như tiên tiến nhất trên nền tảng SGLang, đồng thời sử dụng Miles để huấn luyện các mô hình chuyên biệt theo lĩnh vực — hạ tầng không còn là điểm nghẽn, thời gian và chi phí tiết kiệm được có thể được đầu tư toàn bộ vào những thứ họ thực sự muốn tạo ra.

- Công ty công nghệ lớn

Tại sao những gã khổng lồ sở hữu hạ tầng nội bộ mạnh nhất thế giới như Google, Microsoft, NVIDIA lại xuất hiện trong danh sách người dùng của SGLang? Câu trả lời nằm trong cơ cấu nhà đầu tư đợt này – năm nhà sản xuất phần cứng cốt lõi là NVIDIA, AMD, MediaTek, Broadcom và Intel cùng tham gia. Họ hiểu rõ hơn bất kỳ ai rằng một hệ thống suy luận mã nguồn mở, không phụ thuộc vào phần cứng và không bị khóa bởi bất kỳ đối thủ nào, có ý nghĩa gì với toàn bộ hệ sinh thái. Việc sử dụng một hệ thống mã nguồn mở được cộng đồng cùng duy trì và hỗ trợ bởi nhiều nhà sản xuất phần cứng, chính là một chiến lược hạ tầng ở cấp độ cao hơn.

Các tuyên bố chính thức của RadixArk không mang tính cảm xúc, nhưng đủ sắc sảo:

AI thế hệ tiếp theo không nên bị giới hạn bởi quyền truy cập vào cơ sở hạ tầng riêng. Nhiều nhóm hơn nên có thể sở hữu mô hình của riêng họ, hệ thống của riêng họ và tương lai của riêng họ.

Cuộc gọi vốn hạt giống 100 triệu USD này nhằm biến câu nói này thành hiện thực kỹ thuật: biến SGLang thành tiêu chuẩn sản xuất Day-0 cho mọi mô hình mới; biến Miles thành khung hạ tầng cấp độ cơ sở cho việc huấn luyện quy mô lớn và RL; sau đó, xây dựng một nền tảng托管 dựa trên lõi mã nguồn mở, không khóa mô hình, không giam cầm khách hàng, nhưng vẫn cung cấp khả năng hạ tầng cấp cao nhất.

Tầm nhìn của RadixArk không bao giờ là thay thế bất kỳ ai. Mà là giúp một phòng thí nghiệm học thuật, một nhóm ba người, một startup vừa gọi được vòng seed, và những đế chế có vốn hóa hàng nghìn tỷ — cùng đứng trên cùng một tuyến cơ sở hạ tầng xuất phát.

Nếu Anthropic năm 2023, Mistral năm 2024 và Thinking Machines Lab năm 2025 mỗi cái đều đại diện cho một cú đặt cược có định hướng tại tầng mô hình AI, thì RadixArk năm 2026 đang đặt cược vào thứ sâu sắc hơn và kéo dài hơn: đưa quyền xây dựng AI tiên tiến thực sự trở về tay đủ nhiều người.

Sau khi huy động vốn thành công, đội ngũ đã khởi xướng một chương trình tri ân cộng đồng mã nguồn mở: tham gia đăng ký nền tảng và chia sẻ tweet, bạn sẽ nhận được điểm sử dụng miễn phí khi nền tảng RadixArk chính thức ra mắt. Đối với đội ngũ xuất thân từ cộng đồng mã nguồn mở, đây là cách họ dùng sức mạnh tính toán thực tế để cảm ơn những người đã đồng hành cùng SGLang cho đến hôm nay.

- Liên kết: platform.radixark.com