Tác giả bài viết: Curry, Shenchao TechFlow

Vài ngày trước, có một bức ảnh rất nổi tiếng trên mạng.

Ấn Độ tổ chức một hội nghị AI, Thủ tướng Modi đứng trên sân khấu, hai bên là một hàng các ông lớn từ Thung lũng Silicon. Trong phần chụp ảnh, Modi giơ tay người bên cạnh lên cao, những người khác cũng nắm tay nhau, tạo nên khung cảnh đoàn kết.

Nhưng chỉ có hai người không nắm tay nhau.

CEO của OpenAI và CEO của Anthropic, tức là hai công ty đứng sau ChatGPT và Claude, đứng cạnh nhau, mỗi người giơ một nắm đấm.

Không nắm tay, không nhìn vào mắt nhau, như hai kẻ bị giáo viên xếp ngồi cùng bàn.

Trong những năm qua, hai công ty này đã cạnh tranh khốc liệt, Claude được đội ngũ rời khỏi OpenAI phát triển, cả hai bên đều cạnh tranh giành người dùng, khách hàng doanh nghiệp và vốn đầu tư, và trong Super Bowl năm nay, Anthropic còn chi tiền mua quảng cáo để chế giễu ChatGPT đang chạy quảng cáo.

Vì vậy, không nắm tay là bình thường.

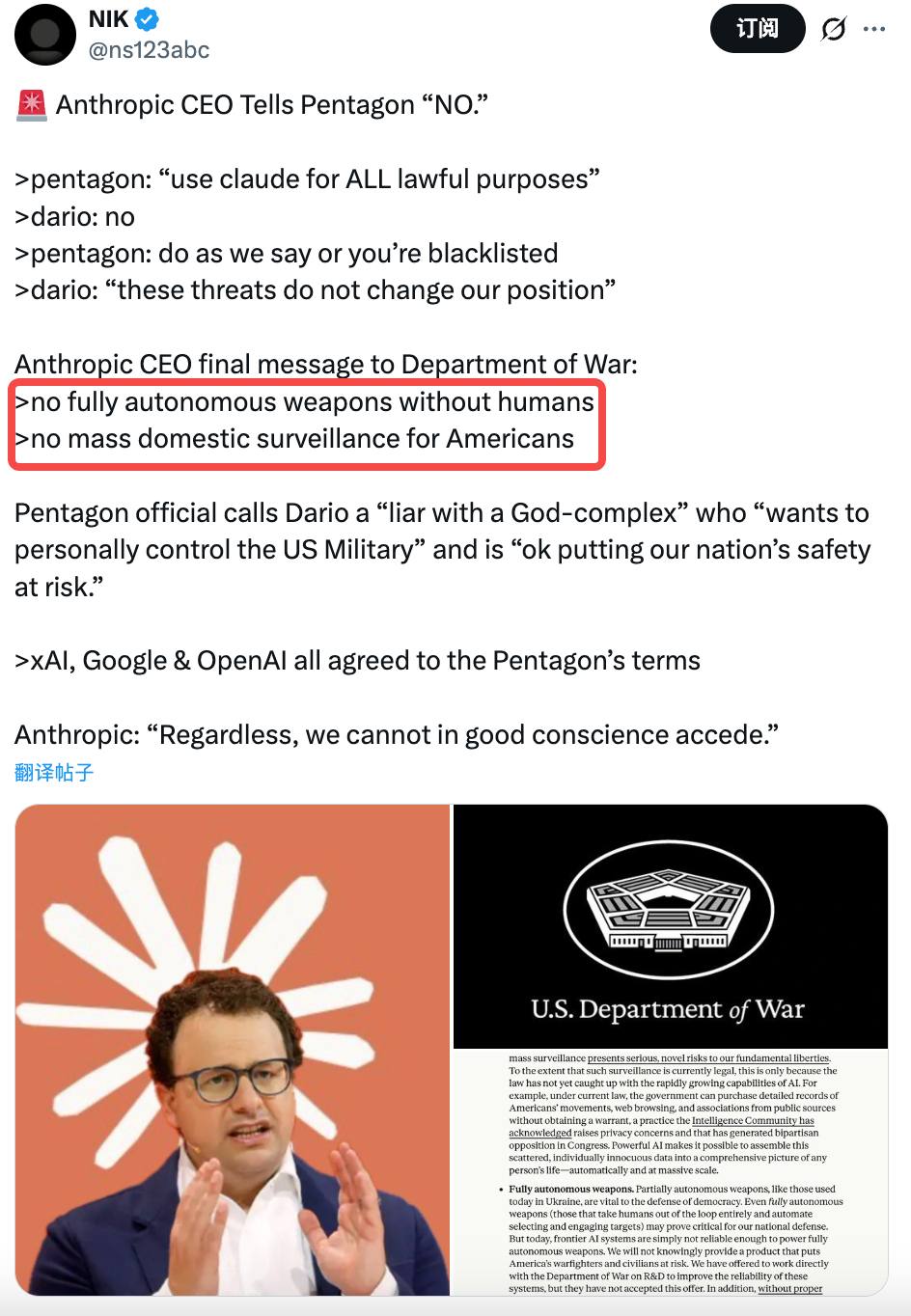

Tuy nhiên, hôm nay họ đã nắm tay nhau. Vì Lầu Năm Góc.

Sự việc là như thế này.

Anthropic, công ty đứng sau Claude, đã ký một hợp đồng trị giá lên đến 200 triệu USD với Bộ Quốc phòng Mỹ năm ngoái. Claude là mô hình AI đầu tiên được triển khai trên mạng máy tính mật của quân đội Mỹ, hỗ trợ xử lý các công việc như phân tích tình báo và lập kế hoạch nhiệm vụ.

Nhưng Anthropic đã vẽ hai đường đỏ trong hợp đồng:

Claude không thể được sử dụng để giám sát quy mô lớn công dân Mỹ, cũng không thể được sử dụng trong vũ khí tự chủ mà không có sự tham gia của con người. (Tham khảo: Anthropic và bảy mươi hai giờ khủng hoảng danh tính)

Tuy nhiên, Lầu Năm Góc không chấp nhận.

Yêu cầu của họ là bốn chữ: không bị giới hạn. Đã mua công cụ thì nên dùng tự do, một công ty công nghệ sao có quyền nói với quân đội Mỹ nên làm gì và không nên làm gì.

Vào thứ Ba tuần trước, Bộ trưởng Quốc phòng Hegseth đã đưa ra tối hậu thư trực tiếp cho CEO của Anthropic: đồng ý trước 5:01 chiều thứ Sáu, nếu không sẽ phải chịu hậu quả.

Anthropic đã không đồng ý.

CEO của họ đã đưa ra một tuyên bố công khai, nội dung cho rằng: Chúng tôi hiểu rõ tầm quan trọng của AI đối với quốc phòng Mỹ, nhưng trong một số trường hợp hiếm hoi, AI có thể làm tổn hại thay vì bảo vệ các giá trị dân chủ. Chúng tôi không thể chấp nhận yêu cầu này một cách có lương tâm.

Đại diện đàm phán của Lầu Năm Góc, Thứ trưởng Bộ Quốc phòng Emil Michael sau đó đã chửi anh ta là kẻ lừa đảo trên mạng xã hội, nói rằng anh ta có tâm lý cứu thế, đang đùa giỡn với an ninh quốc gia.

Chạm tay ngắn ngủi

Sau đó, điều không ngờ đã xảy ra.

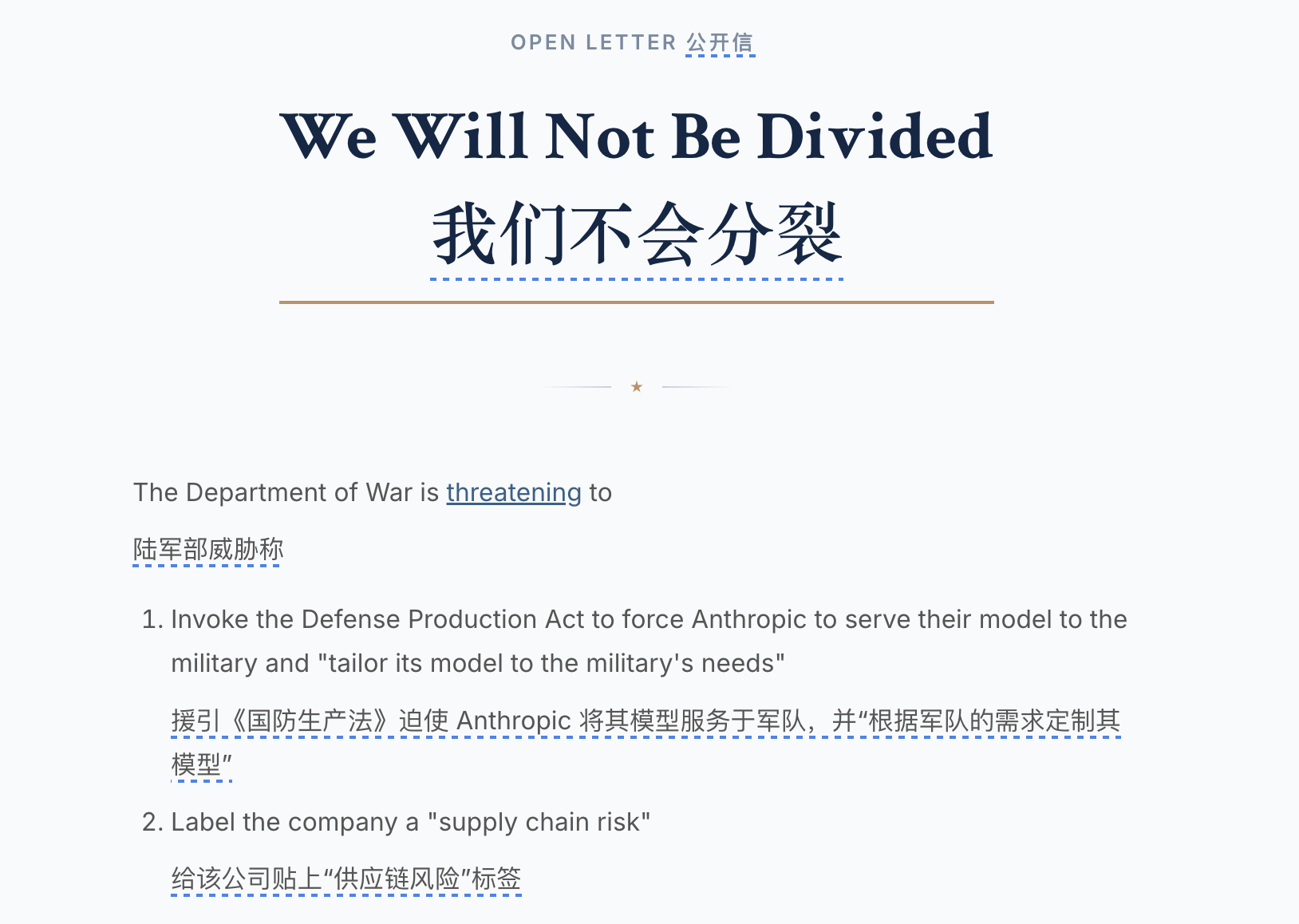

Hơn 400 nhân viên của OpenAI và Google đã ký một bức thư công khai chung có tiêu đề "Chúng tôi sẽ không bị chia rẽ".

Thư nói rằng Lầu Năm Góc đang từng công ty AI đàm phán, cố gắng khiến những người khác đồng ý với những điều kiện mà Anthropic từ chối, dùng nỗi sợ để chia rẽ từng công ty.

CEO của OpenAI cũng đã gửi thư nội bộ đến toàn bộ nhân viên, nói rằng OpenAI có cùng những đường ranh giới đỏ với Anthropic:

Không giám sát quy mô lớn, không phát triển vũ khí tự động gây tử vong.

Chỉ vài ngày trước còn không chịu nắm tay nhau, hai công ty này đột nhiên cùng đứng về phía Lầu Năm Góc.

Tuy nhiên, sự đoàn kết này có thể chỉ kéo dài vài giờ.

5:01 chiều thứ Sáu, tối hậu thư của Lầu Năm Góc đã hết hạn. Anthropic đã không ký.

Một công ty công nghệ Mỹ định giá 380 tỷ USD, sẵn sàng đối mặt với nguy cơ hủy hợp đồng trị giá 200 triệu USD, đã từ chối Bộ Quốc phòng Mỹ. Trước đây, sự việc này chỉ dừng lại ở mức hủy hợp đồng và tìm nhà cung cấp thay thế. Nhưng lần này, phản ứng của Washington hoàn toàn không mang tính chất thương mại.

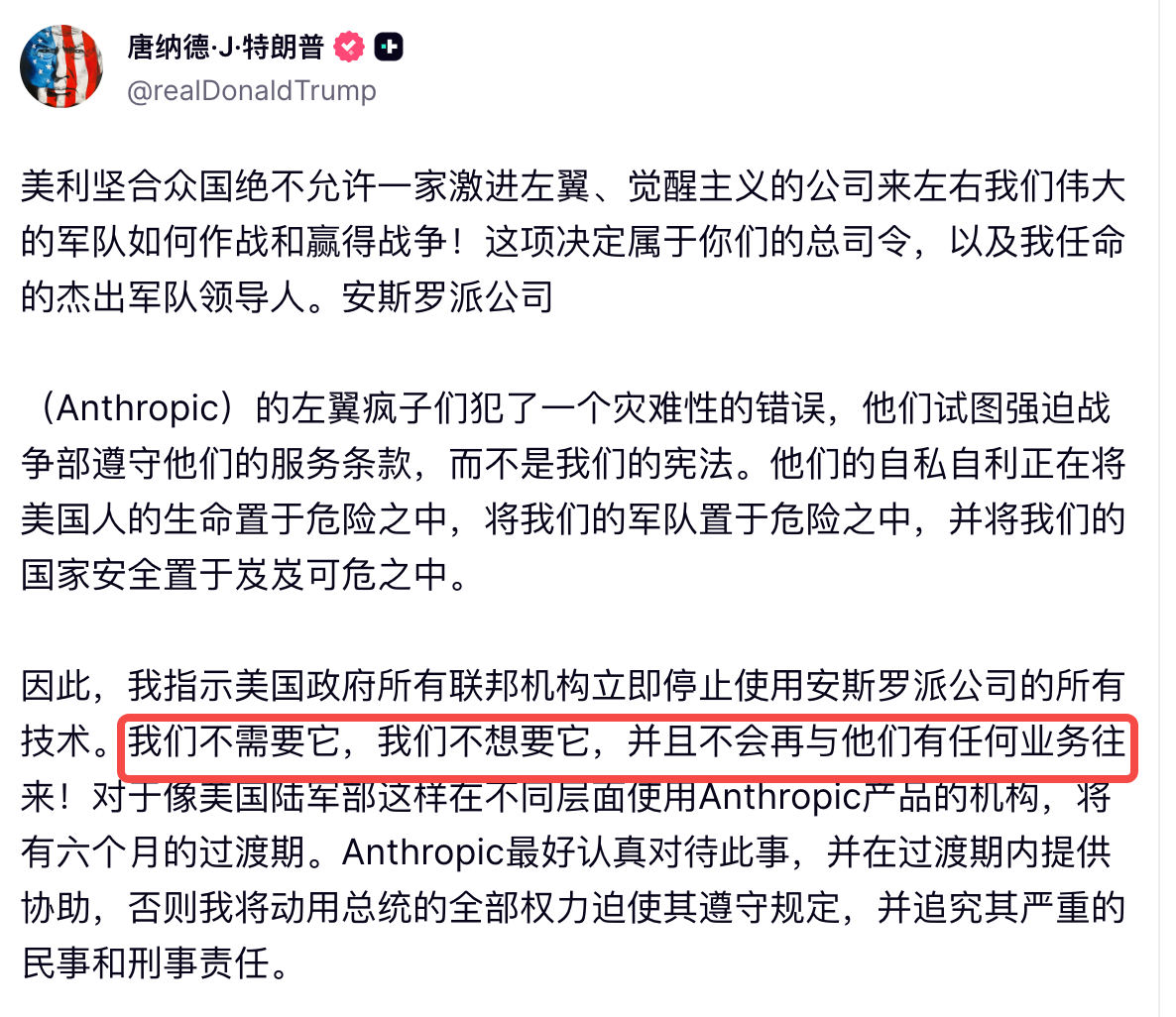

Trump đã đăng bài trên Truth Social khoảng một giờ sau đó, gọi Anthropic là "những kẻ điên tả" và nói rằng họ cố gắng đặt mình trên Hiến pháp, đùa giỡn với sinh mạng của binh sĩ Mỹ.

Anh ấy yêu cầu tất cả các cơ quan liên bang ngay lập tức ngừng sử dụng công nghệ của Anthropic.

Tiếp theo, Bộ trưởng Quốc phòng Mỹ Hegseth tuyên bố xếp Anthropic vào danh mục "rủi ro an ninh chuỗi cung ứng". Nhãn này thường được dùng cho các công ty như Huawei. Ý nghĩa rất rõ ràng: tất cả các nhà thầu làm việc với quân đội Mỹ đều không được sử dụng sản phẩm của Anthropic.

Anthropic cho biết họ sẽ kiện ra tòa.

Cùng đêm đó, OpenAI — trước đó vẫn giữ lập trường tương tự — lại ký kết thỏa thuận với Lầu Năm Góc.

Vấn đề ý thức hệ

OpenAI đã nhận được gì?

Vị trí để lại sau khi Claude bị loại bỏ: Nhà cung cấp AI cho mạng lưới bí mật của quân đội Mỹ. Tuy nhiên, OpenAI đã đưa ra ba điều kiện cho Lầu Năm Góc: không thực hiện giám sát quy mô lớn, không phát triển vũ khí tự chủ, và mọi quyết định rủi ro cao đều phải có sự tham gia của con người.

Bộ Quốc phòng Hoa Kỳ nói rằng được.

Bạn không đọc nhầm. Những điều kiện mà Anthropic đã chần chừ vài tuần không chịu chấp nhận, nhưng khi một công ty khác đưa ra, chỉ vài ngày đã thương lượng xong?

Of course, the two solutions are not exactly the same.

Anthropic đã thêm một lớp khác: họ cho rằng luật pháp hiện tại không theo kịp khả năng của AI, ví dụ như AI có thể hợp pháp mua và tổng hợp dữ liệu định vị, lịch sử duyệt web và thông tin mạng xã hội của bạn, cuối cùng tạo ra hiệu quả tương đương với việc giám sát, nhưng từng bước đều không vi phạm pháp luật.

Anthropic cho rằng việc bạn chỉ viết bốn chữ “không giám sát” là không đủ, lỗ hổng này cần được khắc phục. OpenAI không kiên trì với điểm này, họ đã chấp nhận quan điểm của Lầu Năm Góc rằng luật hiện hành là đủ.

Nhưng nếu bạn cho rằng đây chỉ là một sự khác biệt về điều khoản, thì bạn quá ngây thơ. Cuộc đàm phán này từ đầu đã không chỉ dừng lại ở việc thương lượng các điều khoản.

David Sacks, vị "AI hoàng đế" của Nhà Trắng, đã công khai chỉ trích Anthropic phát triển "AI woke" (ưu tiên ý thức hệ, theo đuổi sự đúng đắn về chính trị); một quan chức cấp cao của Lầu Năm Góc đã nói với truyền thông rằng vấn đề của Dario là do ý thức hệ chi phối, "chúng tôi biết mình đang giao dịch với ai".

xAI của Elon Musk, chính là đối thủ trực tiếp của Anthropic, đã liên tục tấn công Anthropic trên X tuần này, cho rằng công ty này "ghét văn minh phương Tây".

Còn CEO của Anthropic thì năm ngoái không tham dự lễ nhậm chức của Trump. CEO của OpenAI thì đã đi.

Lấy gà làm examples để răn đe khỉ

Vì vậy, chúng ta hãy tóm tắt những gì đã xảy ra.

Cùng một nguyên tắc, cùng một đường đỏ, Anthropic vì thêm một lớp bảo vệ nữa, đứng sai bên, thể hiện sai tư thế, đã bị gán nhãn là mối đe dọa an ninh quốc gia Mỹ ngang cấp với Huawei.

OpenAI đã bỏ sót một lớp, quan hệ tốt, đã nhận được hợp đồng. Bạn nói đây là chiến thắng của nguyên tắc, hay là định giá của nguyên tắc?

Hợp đồng của Lầu Năm Góc đã bị tẩy chay, nhưng đây không phải là lần đầu tiên.

Năm 2018, hơn 4.000 nhân viên của Google đã ký đơn kiến nghị, và hơn chục người đã từ chức để phản đối việc công ty tham gia vào một dự án của Lầu Năm Góc có tên Project Maven. Dự án đó sử dụng AI để phân tích các video do drone quay lại, giúp quân đội nhận diện mục tiêu nhanh hơn.

Google đã cuối cùng rút lui. Không gia hạn và rời đi. Nhân viên đã chiến thắng.

Đã 8 năm trôi qua, cuộc tranh cãi tương tự lại xuất hiện một lần nữa. Nhưng lần này, các quy tắc hoàn toàn thay đổi. Một công ty Mỹ nói với tôi rằng tôi có thể làm kinh doanh với quân đội, nhưng có hai việc không được làm. Phản ứng của chính phủ Mỹ là loại bỏ nó ra khỏi toàn bộ hệ thống liên bang.

Và nhãn hiệu "rủi ro an ninh chuỗi cung ứng" còn gây hại xa hơn chỉ việc mất một hợp đồng 200 triệu USD.

Doanh thu của Anthropic năm nay khoảng 14 tỷ USD, nên hợp đồng 200 triệu cũng chỉ là con số nhỏ bé. Nhưng nhãn này có nghĩa là bất kỳ công ty nào có giao dịch với quân đội Mỹ đều không được sử dụng Claude.

Các công ty này không cần phải đồng tình với quan điểm của Lầu Năm Góc, họ chỉ cần thực hiện một đánh giá rủi ro: tiếp tục sử dụng Claude có thể mất hợp đồng chính phủ; chuyển sang mô hình khác thì chẳng có chuyện gì xảy ra.

Việc lựa chọn rất dễ dàng. Đây chính là tín hiệu thực sự của vấn đề này.

Anthropic có chịu được hay không không quan trọng, điều quan trọng là công ty tiếp theo có dám chịu hay không. Nó sẽ xem xét kết quả này, xem chi phí của việc kiên trì nguyên tắc, rồi đưa ra một quyết định rất hợp lý.

Nhìn lại bức ảnh Ấn Độ đó, mọi người đều nắm tay nhau giơ lên cao, chỉ có hai người họ mỗi người nắm chặt拳头.

Có lẽ đây mới là trạng thái bình thường.

Nguyên tắc của các công ty AI có thể giống nhau, nhưng tay không nhất thiết phải nắm được.