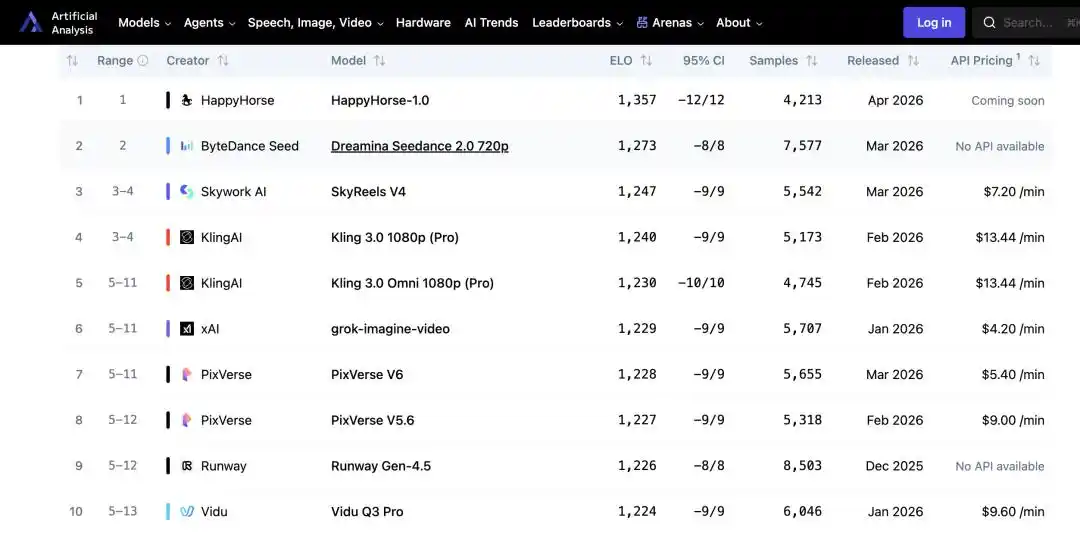

Không có buổi ra mắt, không có bài viết kỹ thuật, không có bất kỳ sự bảo trợ nào từ công ty—một mô hình chuyển văn bản thành video có tên HappyHorse-1.0 đã lặng lẽ leo lên vị trí số một trên bảng xếp hạng AI Video Arena của nền tảng đánh giá AI uy tín Artificial Analysis, với điểm Elo cao hơn Seedance 2.0 và bỏ xa nhiều đối thủ chính như Keling, Tiangong, khiến cộng đồng kỹ thuật đồng loạt vào cuộc “cuộc thi giải mã”.

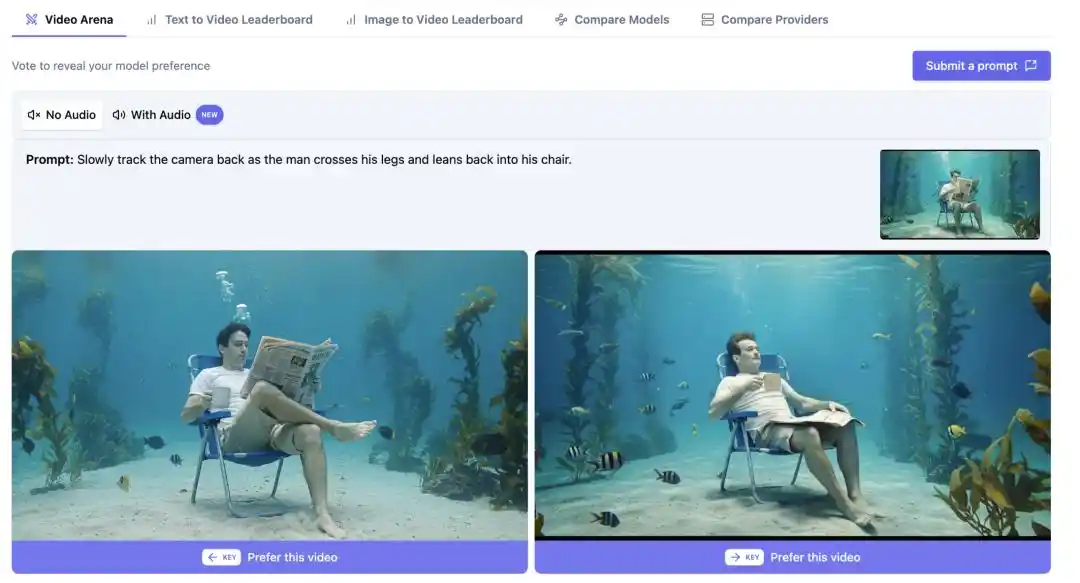

Xếp hạng của Artificial Analysis không phải là đánh giá dựa trên các thông số kỹ thuật, mà là điểm Elo tổng hợp từ kết quả kiểm tra mù của người dùng thực tế, phản ánh cảm nhận thực sự của người bình thường sau khi xem. Điều này khiến xếp hạng này khó bị nghi ngờ hơn so với các bảng điểm thông thường, và khiến câu hỏi “Thứ này rốt cuộc do ai tạo ra?” trở thành một vấn đề không thể bỏ qua.

“Happy Horse” lặng lẽ leo lên vị trí số một, gây ra cuộc thi đố vui trong giới công nghệ

Các phỏng đoán trên X xuất hiện rất nhanh. Điều đầu tiên được chú ý là thứ tự ngôn ngữ trên trang web chính thức: tiếng Quan Thoại và tiếng Quảng Đông được đặt trước tiếng Anh. Với một sản phẩm hướng đến người dùng toàn cầu, thứ tự này khá bất thường—nếu do đội ngũ Mỹ dẫn dắt, tiếng Anh gần như không thể không đứng đầu. Điều này xác nhận rõ ràng rằng đội ngũ phía sau đến từ Trung Quốc.

Tên gọi bản thân cũng là manh mối. Năm 2026 là năm Ngựa âm lịch, cái tên “HappyHorse” ẩn chứa chiêu trò năm Ngựa khá rõ ràng, tương tự như cách “Pony Alpha” đã từng làm vào đầu năm nay. Do đó, danh sách nghi phạm nhanh chóng kéo dài: các nhà sáng lập Tencent và Alibaba đều họ Mã, tự nhiên nằm trong danh sách; có người đặt cược vào Xiaomi, cho rằng Lei Jun luôn khiêm tốn và thích bất ngờ phô bày; cũng có người cho rằng phong cách này giống DeepSeek hơn, bởi DS trước đây từng lặng lẽ ra mắt mô hình thị giác, sau đó lại lặng lẽ gỡ bỏ. Các phỏng đoán rộn ràng, nhưng không có cái nào đưa ra được bằng chứng cụ thể.

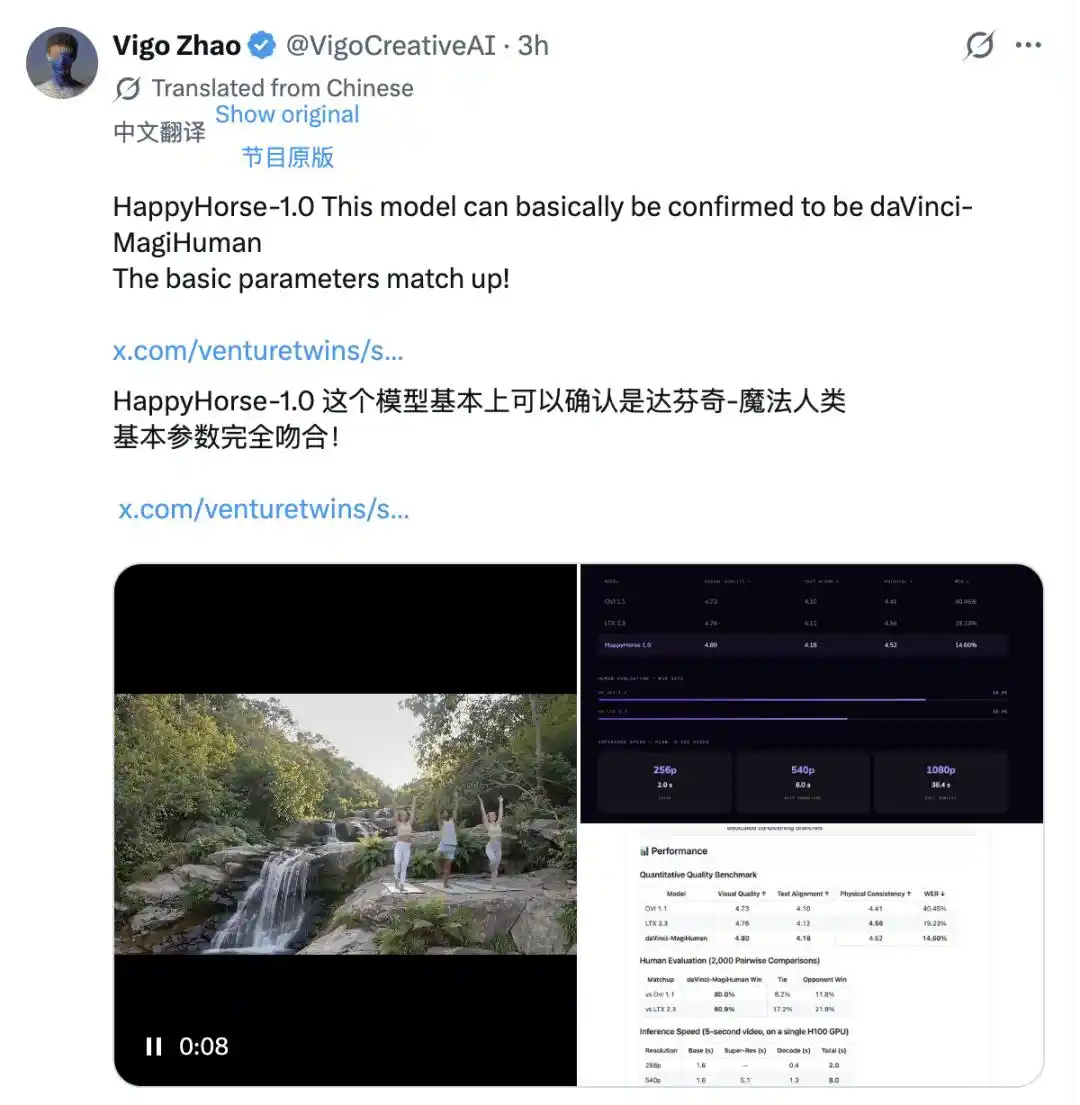

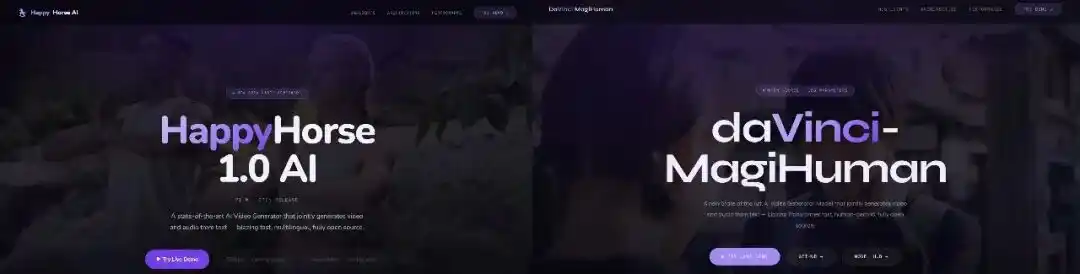

Đối tượng thực sự được xác định là thông qua việc so sánh từng mục kỹ thuật. Người dùng X là Vigo Zhao đã lấy dữ liệu chuẩn công khai của HappyHorse-1.0 và đối chiếu từng mô hình đã biết, kết quả tìm ra một đối tượng có độ tương đồng cao: daVinci-MagiHuman, tức là mô hình mã nguồn mở “Da Vinci Magic Human” được ra mắt trên Github vào tháng Ba.

Chất lượng hình ảnh 4,80, căn chỉnh văn bản 4,18, tính nhất quán vật lý 4,52, tỷ lệ lỗi phát âm 14,60%—hai bộ dữ liệu khớp từng mục một. Cấu trúc trang web cũng gần như giống nhau: phong cách trình bày mô tả kiến trúc, bảng hiệu suất và video minh họa đều giống như được tạo từ cùng một mẫu. Cả hai đều sử dụng kiến trúc Transformer đơn luồng, cùng tạo ra âm thanh và video kết hợp, danh sách ngôn ngữ hỗ trợ cũng hoàn toàn giống nhau. Mức độ trùng lặp này rất khó giải thích bằng sự tình cờ.

Kết luận được công nhận rộng rãi nhất trong cộng đồng kỹ thuật hiện nay là HappyHorse là phiên bản cải tiến dựa trên mô hình mã nguồn mở của Sand.ai, một trong những đơn vị phát triển phối hợp của daVinci-MagiHuman, với mục tiêu cốt lõi là kiểm tra giới hạn hiệu suất của mô hình dưới sở thích thực tế của người dùng, làm nền tảng cho việc thương mại hóa trong tương lai.

daVinci-MagiHuman chính thức mở nguồn vào ngày 23 tháng 3 năm 2026, là sản phẩm hợp tác của hai đội ngũ trẻ. Một đội đến từ Phòng thí nghiệm Nghiên cứu Trí tuệ Nhân tạo Sinh thành (GAIR), Học viện Sáng tạo Thượng Hải (SII), do học giả Lưu Bằng Phi dẫn đầu; đội còn lại là Sand.ai (Tam Đái Khoa Học) tại Bắc Kinh, người sáng lập Cao Việt cũng có nền tảng học thuật, với định hướng phát triển mô hình thế giới tự hồi quy.

Mô hình sử dụng Transformer một luồng thuần túy với 15 tỷ tham số, kết hợp tất cả các token từ ba modalities: văn bản, video và âm thanh vào cùng một chuỗi để mô hình hóa chung—trước đây chưa từng có ai trong cộng đồng mã nguồn mở thực hiện huấn luyện trước kết hợp âm thanh-vide từ đầu, phần lớn đều chỉ ghép nối trên cơ sở đơn modal.

Một mô hình video mã nguồn mở, làm thế nào để đạt được sự bứt phá trong hai tuần?

Sau khi làm rõ danh tính, một câu hỏi khác lại khó trả lời hơn: daVinci-MagiHuman mới chỉ mở nguồn vào cuối tháng 3, vậy tại sao HappyHorse-1.0 lại có thể đạt điểm Elo cao hơn Seedance 2.0 chỉ trong vòng hai tuần?

The information disclosed on the official website suggests that HappyHorse has not made any modifications to its underlying architecture; a more reasonable assumption is that it has made specific adjustments to its default generation strategy for evaluation scenarios.

Hệ thống Elo về bản chất là sự tích lũy sở thích của người dùng; trên các yếu tố nhạy cảm như biểu cảm nhân vật ổn định hay không, âm thanh và hình ảnh có đồng bộ hay không, hình ảnh có dễ chịu hay không, chỉ cần làm tốt hơn một chút, trong các bài kiểm tra mù sẽ dễ được chọn hơn. Giới hạn năng lực của mô hình không thay đổi, nhưng “hiệu suất đánh giá” có thể được tinh chỉnh.

Thực tế, trong các mẫu kiểm tra mù của Artificial Analysis, tỷ lệ nội dung tạo hình ảnh nhân vật và nội dung đọc lời chiếm hơn 60%, trong khi daVinci-MagiHuman đã tập trung vào diễn xuất nhân vật ngay từ giai đoạn huấn luyện, do đó tự nhiên có lợi thế trong các cảnh này, đây cũng là lý do cốt lõi khiến tỷ lệ chiến thắng trong kiểm tra mù của nó dẫn đầu; nếu mẫu kiểm tra mù chủ yếu tập trung vào cận cảnh nhân vật, các mô hình giỏi về nhân vật sẽ có lợi thế hệ thống, điều này không liên quan trực tiếp đến hiệu suất thực tế của nó trong các cảnh phức tạp như nhiều nhân vật, góc quay phức tạp hay kể chuyện theo chuỗi thời gian dài.

Kết quả là, có sự chênh lệch rõ rệt giữa các con số trên bảng xếp hạng và trải nghiệm thực tế, với các người dùng trên X chia thành hai phe. Nhóm hoài nghi sau khi thử nghiệm cho rằng HappyHorse-1.0 và Seedance 2.0 vẫn còn khoảng cách rõ ràng về chi tiết nhân vật và tính liên tục của chuyển động, từ đó đặt câu hỏi về tính đại diện của điểm Elo.

Trong khi đó, những người ủng hộ kỳ vọng lớn vào tiềm năng của HappyHorse, hy vọng nó có thể giải quyết vấn đề nan giải trong ngành là “tính nhất quán về chất lượng hình ảnh trong chuỗi cảnh quay đa góc”, bởi đây là vấn đề mà các mô hình video phổ biến hiện nay vẫn chưa giải quyết tốt; nếu daVinci-MagiHuman thật sự đạt được đột phá ở đây, thì điều đó có thể quan trọng hơn nhiều so với một vị trí xếp hạng.

Các hạn chế của mô hình本身 cũng không nên bị che giấu bởi con số. Người dùng Xiaohongshu @JACK's AI Vision đã triển khai và thử nghiệm daVinci-MagiHuman ngay từ đầu. Họ phát hiện rằng mô hình này yêu cầu H100, còn các card đồ họa tiêu dùng thông thường gần như không thể chạy được; mặc dù cộng đồng đang nghiên cứu các giải pháp lượng tử hóa, nhưng trong ngắn hạn, người dùng cá nhân vẫn gặp khó khăn khi triển khai tại địa phương.

Về mặt cảnh quan, hiện tại nó chủ yếu mạnh ở việc xử lý nhân vật đơn lẻ; một khi có nhiều người xuất hiện hoặc cảnh trở nên phức tạp, chất lượng sẽ giảm sút—đây không phải vấn đề có thể giải quyết bằng cách tinh chỉnh tham số, mà liên quan trực tiếp đến định hướng thiết kế tập trung vào chân dung của nó. Thời gian tạo thường chỉ khoảng 10 giây, nếu dài hơn dễ bị hỗn loạn, và đầu ra độ phân giải cao vẫn cần phụ thuộc vào plugin siêu phân giải để bổ sung.

Kết luận từ AI Vision của @JACK cho thấy: daVinci-MagiHuman có độ dễ sử dụng tổng thể kém hơn LTX 2.3 và cần chờ cộng đồng hoàn thiện việc định lượng trước khi phù hợp để sử dụng hàng ngày.

Chủ đề tạo video đã chờ đến “con cá mè” thực sự?

Tất nhiên, việc dẫn đầu một bảng xếp hạng không nói lên nhiều điều. Tiếp theo, HappyHorse vẫn cần được kiểm tra kỹ lưỡng hơn về độ ổn định, tốc độ truy cập đồng thời cao, tính nhất quán giữa các kịch bản, độ chính xác trong kiểm soát vai trò, cũng như khả năng tổng quát hóa ngoài bộ đánh giá. Những yếu tố này mới là những chỉ số cốt lõi quyết định liệu một mô hình có thực sự được tích hợp vào quy trình làm việc của người sáng tạo hay không.

Nhưng nếu mở rộng tầm nhìn sang bối cảnh ngành lớn hơn, tín hiệu được truyền tải bởi sự việc này thực sự đã đủ rõ ràng.

Việc mô hình video mã nguồn mở không phải là điều mới mẻ. Nhưng mãi mãi tồn tại một khoảng cách rõ rệt về chất lượng giữa các mô hình mã nguồn mở và đóng: trong các tình huống cần giao sản phẩm cho khách hàng, chất lượng tạo ra của các mô hình mã nguồn mở lâu nay chưa thể vượt qua được ngưỡng từ “có thể sử dụng” sang “có thể giao hàng”. Quyền định giá của các sản phẩm đóng như Ke Ling, Seedance phần lớn được xây dựng dựa trên khoảng cách này.

Lần này có ý nghĩa là một sản phẩm dựa trên mô hình mã nguồn mở lần đầu tiên sánh ngang trực tiếp với các đối thủ đóng mã phổ biến hiện nay trên bảng xếp hạng kiểm tra mù dựa trên cảm nhận của người dùng thực tế. Dù có bao nhiêu yếu tố tối ưu hóa dành riêng cho cảnh kiểm tra, thì đối với các nhà sản xuất đóng mã phụ thuộc vào khoảng cách này để xây dựng quyền định giá, ít nhất đây cũng là một tín hiệu đáng để quan tâm nghiêm túc.

Đối với các nhà phát triển, điểm ngoặt này mang ý nghĩa cụ thể hơn. Trong các bối cảnh chuyên biệt như chân dung, người số hóa, streamer ảo, một khi chất lượng tạo ra của nền tảng mã nguồn mở đạt đến ngưỡng “có thể giao giao”, cấu trúc chi phí tự triển khai sẽ thay đổi đáng kể — không chỉ là việc giảm chi phí gọi API, mà quan trọng hơn là hoàn toàn kiểm soát dữ liệu, mô hình và chuỗi suy luận, mang lại mức độ linh hoạt khó có được từ các giải pháp đóng nguồn trong việc tùy chỉnh sâu và tuân thủ quyền riêng tư.

HappyHorse-1.0 trong ngắn hạn sẽ không làm lung lay vị thế thị trường của Seedance 2.0 hoặc Ke Ling, nhưng một khi nhận thức rằng hiệu quả của mô hình mã nguồn mở có thể sánh ngang với mô hình đóng được thiết lập, các tối ưu hóa định lượng, tinh chỉnh chuyên sâu và tăng tốc suy luận sẽ được cộng đồng tiếp tục đẩy nhanh với tốc độ vượt xa so với các sản phẩm đóng.

Trong năm Mã này, điều đáng quan tâm thực sự có lẽ không phải là con ngựa nào chạy nhanh nhất, mà là chính đường đua đang trở nên rộng hơn.

Bài viết này đến từ tài khoản chính thức WeChat "AI Value Officer", tác giả: Xingye, biên tập: Mei Qi