Ba mươi ngày điên rồ này, mười một mô hình lớn, giống như một màn pháo hoa ồn ào.

Tác giả bài viết, nguồn: 0x9999in1, ME News

Tóm tắt ngắn

- Ba mươi ngày cạnh tranh khốc liệt: Từ ngày 26 tháng 3 đến ngày 24 tháng 4, đã ra mắt 11 mô hình lớn quan trọng trên toàn cầu, trung bình cứ 2,7 ngày một mô hình. Thị trường đang đối mặt với tình trạng “mệt mỏi thông số” nghiêm trọng.

- Cuộc “phẫu thuật giảm cân” của Param Đại Vị: Tổng tham số của V4-Pro đạt 1,6T, nhưng chỉ kích hoạt 49B. Nhờ tái cấu trúc kiến trúc CSA+HCA, FLOPs giảm xuống 27% trong ngữ cảnh 1M, bộ nhớ đệm KV giảm xuống mức cực kỳ đáng sợ là 10%.

- Sự tách biệt về thế hệ trong thuật luyện đan: Đưa ra mô hình hậu huấn luyện đầu tiên “tăng cường học độc lập trước, sau đó tinh chỉnh trực tuyến”, V4-Pro-Max đạt đến ngưỡng trần của các mô hình đóng nguồn trong nhiệm vụ suy luận và Agent.

- Phiếu bầu bằng vàng thật bạc thật: GPT-5.5 chỉ giúp NVIDIA tăng 4,2% trong một ngày rồi đạt đỉnh, trong khi V4 nhờ hoàn toàn mở nguồn bởi MIT đã hoàn toàn thổi bùng đợt tăng giá liên tục của chuỗi tính toán địa phương ở Trung Quốc và Hồng Kông.

- Logic của cuộc chơi sâu: Các mô hình đóng nguồn bán “thuế”, các mô hình lớn mã nguồn mở bán “sắt”. Sự xuất hiện của V4 đã giúp sổ sách năng lực tính toán cho việc triển khai riêng tư cấp doanh nghiệp toàn cầu cuối cùng cũng cân bằng được.

Tháng tư của cơn bão các vị thần, cùng với sự mệt mỏi về thị hiếu của thị trường

Điên rồi. Đều điên rồi.

Nếu bạn là một người theo dõi sát sao lĩnh vực AI, thì 30 ngày vừa qua rất có thể khiến bạn cảm thấy khó chịu về mặt sinh lý. Từ ngày 26 tháng 3 năm 2026 đến ngày 24 tháng 4, chỉ trong chưa đầy một tháng, ít nhất 11 mô hình lớn có ảnh hưởng đáng kể trên toàn cầu đã được tung ra thị trường.

Danh sách dài như đang điểm tên các món ăn: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

Và vào lúc rạng sáng ngày 23 tháng 4, DeepSeek V4 đã được ra mắt lặng lẽ như một quả bom dưới nước.

Trung bình, cứ mỗi 2,7 ngày lại có một mô hình mới ra đời. Đó là tốc độ mà ngay cả các quỹ đầu tư cũng không kịp đọc hết bản tin phát hành. Nhà đầu tư vừa nghe xong “vượt trội thông số” của công ty A, thì “đánh bại điểm số” của công ty B đã được đặt lên bàn. Thị trường thực chất đã trở nên vô cảm. Những gì gọi là “chạy benchmark”, trong bối cảnh cạnh tranh khốc liệt hiện nay, ngày càng giống như một trò chơi số tự娱自乐.

Nhưng tiền thông minh. Hay nói cách khác, biểu đồ nến không bao giờ nói dối.

Xem lại biểu đồ nến của các tài sản AI tại Trung Quốc, Mỹ và Hồng Kông trong 30 ngày qua, bạn sẽ nhận ra một thực tế cực kỳ lạnh lùng: Trong cuộc “chiến tranh giữa các vị thần” này, chỉ có hai điểm duy nhất để lại dấu ấn bền vững trên biểu đồ.

Đầu tiên, vào ngày 8 tháng 4, OpenAI ở bờ bên kia đại dương đã ra mắt GPT-5.5. Vị vua không thể tranh cãi này đã trực tiếp thúc đẩy NVIDIA tăng 4,2% trong một ngày. Sau đó thì sao? Không còn gì nữa, đỉnh điểm trong một ngày, tin tốt đã được phơi bày. Mọi người nhận ra rằng, dù là vị vua mã nguồn đóng vĩ đại đến đâu, cũng khó có thể dễ dàng xô đổ ngọn núi vốn khổng lồ toàn cầu như cách hai năm trước.

Nút thứ hai là từ ngày 23 đến ngày 24 tháng 4. Phiên bản xem trước DeepSeek V4 được phát hành. Không có buổi ra mắt hoành tráng, không có video quảng bá ấn tượng. Trọng số được tải trực tiếp lên Hugging Face và ModelScope, theo giấy phép MIT.

Kết quả? Nó đã thúc đẩy chuỗi tính toán Trung Quốc-Hồng Kông tăng gián đoạn liên tiếp.

Tại sao? Tại sao một mô hình mã nguồn mở lại có thể làm được điều mà nhiều chuyên gia mã nguồn đóng không thể làm được?

Để trả lời câu hỏi này, chúng ta phải như một người kể chuyện, gạt bỏ những bản tin truyền thông nhàm chán, mở nắp động cơ của DeepSeek V4 ra và xem bên trong có gì đang ẩn giấu.

Phân tích V4: Không còn mê tín vào vẻ đẹp của sự bạo lực thông số

Mô hình lớn. Tốn rất nhiều tiền. Việc này ai cũng biết.

Trong năm qua, các nhà phát triển mô hình lớn đã rơi vào tình trạng “nỗi sợ thiếu lửa”. Bạn làm một nghìn tỷ, tôi sẽ làm hai nghìn tỷ. Mọi người đều cho rằng, chỉ cần sức mạnh lớn thì gạch sẽ bay, và trí thông minh xuất hiện sẽ giải quyết mọi vấn đề. Nhưng đi kèm theo đó là chi phí tính toán cực kỳ kinh khủng. Ngay cả lương thực dư của địa chủ cũng không đủ để đốt.

DeepSeek V4 lần này giới thiệu hai mô hình MoE (hỗn hợp chuyên gia): V4-Pro và V4-Flash. Chúng ta hãy xem một vài số liệu cốt lõi.

V4-Pro: Tổng tham số 1.6T (1,6 nghìn tỷ), nhưng mỗi token chỉ kích hoạt 49B (49 tỷ).

V4-Flash: Tổng tham số 284B (284 tỷ), tham số kích hoạt chỉ 13B (13 tỷ).

Bạn đã hiểu chưa? Đây là một dạng “dùng bốn lạng đẩy cả ngàn cân” cực kỳ kiềm chế. Bản chất của kiến trúc MoE là không cần每次都拉响全部警报. Khi gặp nhiệm vụ giết gà, chỉ cần huy động vài chuyên gia giết gà; khi gặp nhiệm vụ giết rồng, mới mời ra thanh đao giết rồng. Nền tảng 1,6 nghìn tỷ đảm bảo nó “đã từng trải, kiến thức uyên thâm”; 490 tỷ được kích hoạt đảm bảo nó “phản ứng nhanh, thân thủ linh hoạt”.

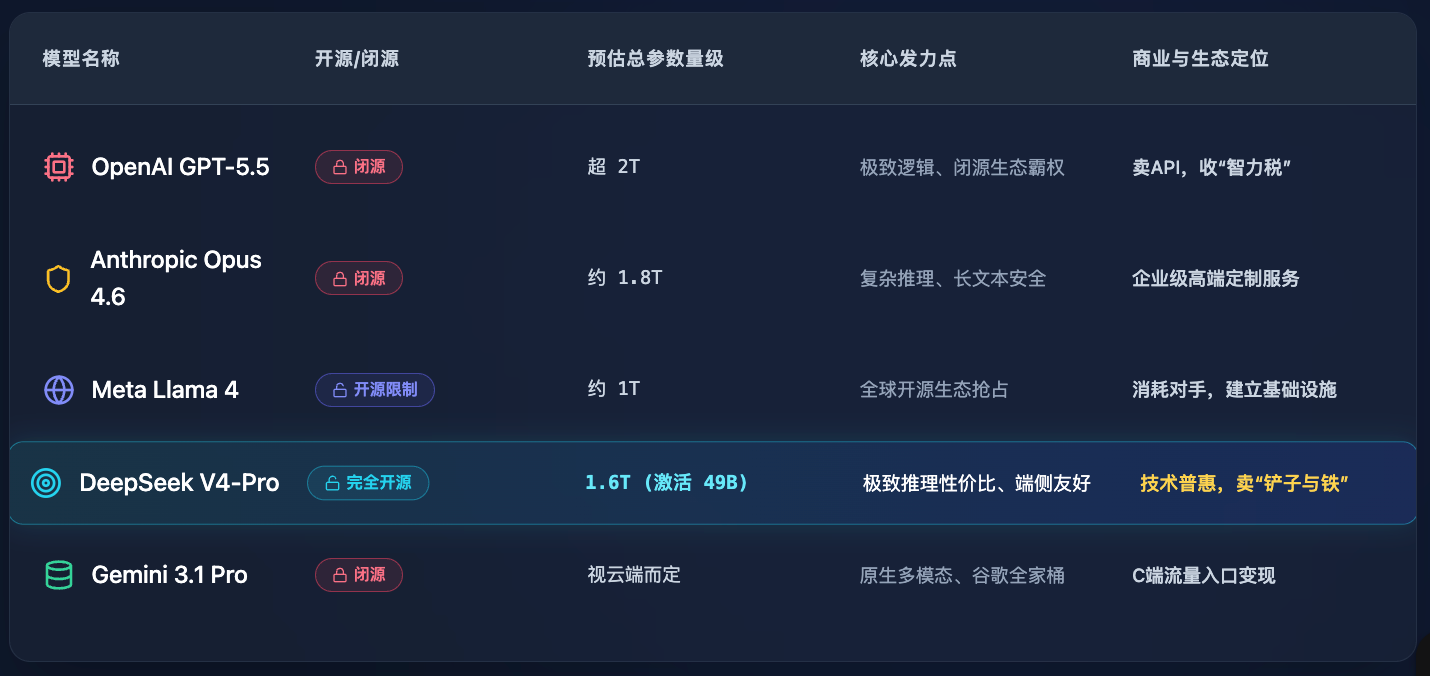

Để hiểu rõ hơn về sự khác biệt này, chúng ta lập một bảng so sánh các hướng đi chính hiện nay trên thị trường (dữ liệu là ước tính và tính toán công khai của thị trường):

Xem bảng có thể thấy, V4-Pro không nhất thiết theo đuổi việc vượt trội GPT-5.5 về tổng tham số, nhưng nó đã tập trung toàn bộ nỗ lực vào việc “làm thế nào để con quái vật này ăn ít hơn và chạy nhanh hơn”.

Nhưng điều đó vẫn chưa đủ. Điều khiến những người am hiểu phải hít một hơi thật sâu là sự tiêu diệt vô tình đối với “kẻ ám sát VRAM”.

Ngày tận thế của những kẻ sát hại VRAM: Ba con dao cạo xương trên kiến trúc

“显存刺客” là gì? Đó chính là “ngữ cảnh dài (Long Context)”.

Hiện nay, tất cả các bên đều quảng bá khả năng hỗ trợ 1M (một triệu) token trong ngữ cảnh. Nghe thì rất tuyệt vời, nhét nguyên cuốn “Tam Quốc Diễn Nghĩa” vào, nó có thể đọc xong trong vài giây. Nhưng chi phí là gì? Khi xử lý văn bản dài, sẽ tạo ra bộ nhớ đệm KV khổng lồ (lượng bộ nhớ GPU dùng để lưu trữ thông tin lịch sử trong quá trình suy luận). Điều này giống như mỗi khi bạn đọc một trang sách, bạn đều phải lấy một bảng đen lớn để chép lại nội dung trang trước và đặt trước mặt. Khi bạn đọc đến chữ thứ một triệu, bảng đen sẽ nhiều đến mức không thể nhét hết vào phòng máy của Trung Quan Châu.

Bộ nhớ đắt hơn sức tính toán. Đây là quy tắc ngầm trong ngành AI.

DeepSeek V4 giải quyết vấn đề này như thế nào? Họ trực tiếp thực hiện “phẫu thuật” trên cơ chế chú ý nền tảng. Đây là lưỡi dao đầu tiên và cũng là lưỡi dao mạnh nhất trong bản nâng cấp kiến trúc của họ: cơ chế chú ý hỗn hợp (CSA + HCA).

CSA (Compressed Sparse Attention) kết hợp với HCA (Heavy Compressed Attention), nghe như tiếng Hỏa Tinh, nhưng dịch ra tiếng người chính là: nó không còn học thuộc lòng máy móc nữa, mà đã học được cách “nhấn mạnh điểm quan trọng” và “ghi chú cực kỳ ngắn gọn”.

Hiệu quả cực kỳ mạnh mẽ: với ngữ cảnh 1M, FLOPs (số phép tính dấu phẩy động) cho việc suy luận một token của V4-Pro chỉ bằng 27% so với thế hệ trước V3.2! Đáng sợ hơn, bộ nhớ đệm KV chỉ bằng 10% của V3.2!

Đây là khái niệm gì? Tương đương với việc trước đây cần 10 máy chủ cao cấp mới xử lý xong nhiệm vụ văn bản dài hàng triệu chữ, giờ đây chỉ cần 1 máy chủ là đã dễ dàng hoàn thành. Chi phí tính toán giảm trực tiếp xuống 1/10. Đây là sự tối ưu mang tính cách mạng.

Còn hai con dao nữa.

Chiếc dao thứ hai gọi là “Siêu kết nối ràng buộc đa tạp (mHC)”. Các mô hình lớn trước đây sử dụng “kết nối dư truyền thống” để truyền thông tin giữa các lớp, giống như dùng những ống sắt cũ kỹ, gỉ sét để dẫn nước — khi áp suất tăng cao sẽ dễ bị rò rỉ. Trước lượng dữ liệu huấn luyện tiền xử lý khổng lồ 32T token, những ống cũ này không chịu nổi. mHC giống như thay thế bằng mạng cáp quang, tăng cường độ ổn định trong việc truyền tín hiệu giữa các lớp. Không mất gói, không lệch hướng.

Bước thứ ba: thay dầu động cơ. Bỏ qua truyền thống, chuyển sang sử dụng bộ tối ưu Muon. Công cụ này có tác dụng tăng tốc độ hội tụ. Cũng nấu một mẻ đan, người khác cần bảy bảy bốn chín ngày, nhưng nó có thể chỉ mất hai mươi ngày là xong. Thời gian chính là tiền bạc, thời gian máy chính là đô la Mỹ.

Ba nhát đao này bổ xuống, V4 đã chữa khỏi hoàn toàn “bệnh giàu có” của các mô hình lớn.

Bí mật trong lò luyện đan: Từ từng người một đến vạn pháp quy về một

Trong ngành mô hình lớn, ai cũng biết rằng việc tiền huấn luyện chỉ giúp một “người mù chữ” trở thành “người hiểu nhiều kiến thức nhưng không biết nói”. Điều thực sự biến nó thành một cao thủ tuyệt đỉnh chính là hậu huấn luyện (Post-training).

DeepSeek V4 đã áp dụng một chiến lược “hai giai đoạn” cực kỳ chuyên sâu trong giai đoạn hậu huấn luyện.

Trước đây, mọi người huấn luyện MoE giống như một nhóm giáo viên xung quanh một học sinh, rất dễ xảy ra xung đột. V4 làm thế nào?

Giai đoạn đầu tiên: “Tự lực cánh sinh”. Nó sử dụng SFT (tinh chỉnh có giám sát) và GRPO (tối ưu hóa chiến lược tương đối theo nhóm) để tăng cường học tập, tách riêng từng “mạng chuyên gia” trong mô hình và huấn luyện riêng lẻ. Chuyên gia lập trình thì ngày ngày luyện viết mã, chuyên gia toán học thì ngày ngày giải bài toán. Hoàn toàn không liên quan, không ảnh hưởng lẫn nhau. Đây là cách đẩy khả năng từng điểm đến cực hạn.

Giai đoạn hai: “Vạn pháp quy tông”. Thông qua kỹ thuật chưng cất trực tuyến, những chuyên gia đã luyện thành tuyệt kỹ này sẽ được hợp nhất thống nhất thành một mô hình hoàn chỉnh, không tiêu hao nội bộ, không gián đoạn.

Hãy cùng xem hai “chiêu thức lớn” mà họ đã ép ra.

Đầu tiên là chế độ V4-Pro-Max. Đây là chế độ có sức mạnh suy luận cao nhất. Điều này giống như mở khóa gen. Theo chính họ tự tuyên bố (và nhanh chóng được cộng đồng xác minh), trong các bài kiểm tra mã hóa, V4-Pro đã đạt đến mức đỉnh cao, và trong các nhiệm vụ suy luận phức tạp và Agent (đối tượng thông minh), khoảng cách với các mô hình đóng nguồn tiên tiến (như GPT-5.5, Opus 4.6) đã thu hẹp đáng kể.

Thứ hai là V4-Flash-Max. Cái này thú vị hơn nhiều. Nó chỉ là một mô hình nhỏ 284B, nhưng sau khi được cung cấp đủ ngân sách suy luận, hiệu suất suy luận của nó thậm chí có thể gần với Pro. Điều này cho thấy điều gì? Điều đó cho thấy “chất lượng thuật toán” bắt đầu vượt trội hơn “quy mô tham số”. Chỉ cần bạn cho nó đủ thời gian để suy nghĩ, bộ não nhỏ bé cũng có thể giải quyết những bài toán lớn. Tất nhiên, về mặt kho tàng kiến thức thuần túy và các tác vụ Agent đa bước cực kỳ phức tạp, nó vẫn bị giới hạn bởi quy mô tham số (vì “bụng” thì chỉ có vậy), nhưng đối với hầu hết các ứng dụng hàng ngày cấp doanh nghiệp, hiệu năng này đã dư dả.

Cuối cùng, việc lưu trữ trọng số được thực hiện một cách cực kỳ thông minh bằng phương pháp lưu trữ hỗn hợp FP4+FP8, vừa giữ được độ chính xác, vừa tiết kiệm bộ nhớ GPU. Mọi chi tiết đều toát lên vẻ quyến rũ của một sinh viên khoa học tinh tế và tính toán kỹ lưỡng.

Để so sánh rõ ràng hơn về sự cải thiện hiệu quả kỹ thuật mang lại từ quá trình huấn luyện sau, chúng tôi tiếp tục lập một bảng so sánh các chỉ số cứng:

Sức khứu giác của vốn: Tại sao V4 đã thổi bùng chuỗi tính toán Trung Quốc - Hồng Kông?

Đến đây, phần phân tích kỹ thuật gần như đã xong. Nhưng chúng ta vẫn chưa trả lời câu hỏi then chốt mở đầu:

Tại sao GPT-5.5 không thể khiến phân khúc tính toán tiếp tục bùng nổ, trong khi DeepSeek V4 lại làm được?

Điều này đòi hỏi chúng ta phải thoát khỏi mã nguồn và nhìn nhận cuộc chơi này bằng góc nhìn vốn và kinh doanh.

GPT-5.5 rất mạnh, mạnh đến mức không thể đánh bại. Nhưng nó là phần mềm đóng. Đóng nguồn có nghĩa gì? Nghĩa là OpenAI là một “hố đen” khổng lồ. Bạn muốn sử dụng khả năng của nó, bạn phải mua API của họ. Đây là mô hình “thu thuế”. Lợi nhuận chảy về Thung lũng Silicon, nhu cầu tính toán tập trung vào các trung tâm dữ liệu đám mây của Microsoft. Đối với các nhà sản xuất phần cứng toàn cầu, các trung tâm tính toán địa phương, các đại lý máy chủ của các quốc gia, ngoài việc ngước nhìn, họ chẳng chia được bao nhiêu. GPT-5.5 có mạnh đến đâu, đó cũng chỉ là cuộc ăn mừng của người khác. NVIDIA tăng giá là vì mọi người cho rằng OpenAI sẽ còn mua thêm nhiều card nữa.

Nhưng DeepSeek V4 thì khác.

Nó là mã nguồn mở. Và được cấp phép MIT cực kỳ rộng rãi. Giấy phép MIT là món quà hào phóng nhất trong cộng đồng mã nguồn mở, có nghĩa là các công ty thương mại có thể tự do sử dụng, chỉnh sửa và bán mà không lo ngại rủi ro pháp lý.

Đáng sợ hơn nữa, chúng ta đã dành rất nhiều đoạn trước đó để lập luận rằng: V4 đã giảm chi phí suy luận và lượng bộ nhớ GPU của mô hình xuống mức cổ chân.

Kết hợp hai điểm này lại, bạn sẽ đưa ra một kết luận khiến thị trường vốn điên đảo: điểm tới hạn của việc triển khai riêng lẻ đã thực sự đến.

Trước đây, khi doanh nghiệp muốn tự triển khai mô hình lớn hơn 1T, chỉ cần nhìn vào bảng báo giá phần cứng là lặng lẽ đóng lại, quay sang mua API. Giờ đây, V4 thông báo với mọi người: bạn chỉ cần rất ít máy chủ là có thể chạy tại chỗ một siêu não có hiệu năng gần như GPT-4, thậm chí thách thức mức độ của GPT-5.5. Dữ liệu không cần ra khỏi tỉnh, không cần ra khỏi nước, tuyệt đối an toàn.

既然大家都能够在本地运行了,接下来会发生什么?

Mua máy! Mua máy chủ! Mua module quang! Xây trung tâm tính toán thông minh!

Các công ty lớn đóng nguồn đang bán trí tuệ, trong khi các công ty lớn mã nguồn mở về bản chất đang “bán hàng” cho các nhà sản xuất phần cứng trong toàn ngành. DeepSeek V4 chính là người ném xuống ngọn lửa đầu tiên. Nó càng dễ sử dụng và càng mở nguồn, nhu cầu về năng lực tính toán địa phương tại Trung Quốc, Hồng Kông, Đài Loan... càng bùng nổ. Những doanh nghiệp sản xuất máy chủ, làm hệ thống làm mát bằng chất lỏng, vận hành trung tâm dữ liệu cuối cùng cũng nhìn thấy những đồng tiền thật từ việc triển khai quy mô lớn.

Đó là lý do tại sao chuỗi tính toán Trung Quốc - Hồng Kông liên tục tăng mạnh ngay sau khi V4 được ra mắt vào ngày 23 tháng 4. Vốn không trả tiền vì tình cảm, vốn đang đặt cược trước cho “cơn sóng triển khai riêng tư hóa hàng ngàn ngành nghề” sắp tới.

Đây, chính là âm mưu kinh doanh cốt lõi.

Kết luận: Triều rút và đá ngầm

Ba mươi ngày điên rồ này, mười một mô hình lớn, giống như một màn pháo hoa ồn ào.

Các ông lớn đang vung tiền trên sân khấu thông số, cố dùng những cú đấm sức mạnh tính toán để đánh gục đối thủ. Nhưng sau tiếng ồn ào, những người thực sự ở lại và thay đổi cảnh quan ngành thường không phải người ồn ào nhất.

Sự xuất hiện của DeepSeek V4 giống như một sát thủ lạnh lùng. Nó không so sánh với bạn về ai tiêu nhiều tiền hơn, mà chỉ tấn công vào điểm yếu đau nhất: loại bỏ bộ nhớ hiển thị không cần thiết, hạ thấp rào cản triển khai, biến các trận đấu cao cấp thành sân chơi dành cho người bình thường.

Trong cuộc chiến AI được gọi là “Ragnarok”, thời đại đổ dồn vào việc tích lũy tham số đang nhanh chóng kết thúc. Chiến trường tương lai sẽ thuộc về những người có thể tìm được điểm cân bằng hoàn hảo giữa “hiệu suất tối ưu” và “hiệu quả kỹ thuật”.

Sóng gió rồi sẽ rút đi, sau khi nước rút, mới biết ai đang lội nước trần truồng, ai mới là tảng đá bất khả xâm phạm.

V4 đã phân phát vũ khí đến tay tất cả mọi người. Bây giờ, hãy xem các chư hầu sẽ đóng trại ở vùng đất mới này như thế nào.

Khi bạn đã thấu hiểu được lớp này, bạn sẽ nghe những lời rầm rộ như “ra mắt gây chấn động”, “định nghĩa lại” một cách thản nhiên hơn và ít lo lắng hơn.

Sau tất cả, dù phép thuật có lộng lẫy đến đâu, cuối cùng cũng phải ghi vào sổ sách, tính toán cho cân bằng mấy đồng xu lẻ.

Nguồn trích dẫn:

- DeepSeek V4 Series Preview Official Release, DeepSeek Team, GitHub/ModelScope/HuggingFace. (2026).

- Cuộc bùng nổ AI tháng Tư: Phân tích chu kỳ 30 ngày của mô hình lớn, ME News Market Observer. (2026).

- Luật quy mô và sự chuyển dịch mô hình sau khi huấn luyện, Tạp chí Kinh tế Trí tuệ nhân tạo. (2026).

- Báo cáo tình hình thị trường chuỗi cung ứng tính toán toàn cầu (tháng 4 năm 2026), Phân tích dữ liệu tài chính Pan-Á. (2026).