Quan điểm này không phải xuất phát từ hư vô. Anh ấy đã xem xét một loạt các tiêu chuẩn công khai và nhận thấy AI đang tiến bộ rất nhanh trong các nhiệm vụ liên quan đến nghiên cứu AI.

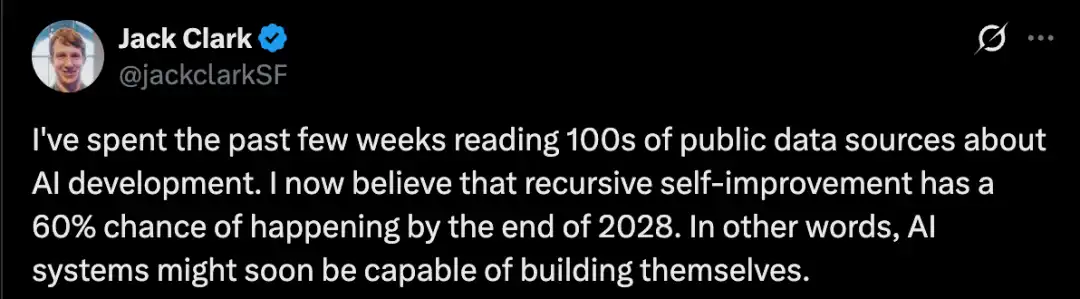

Ví dụ, CORE-Bench đánh giá khả năng của AI trong việc thực hiện các bài báo nghiên cứu của người khác, đây là một khâu cực kỳ quan trọng trong nghiên cứu AI.

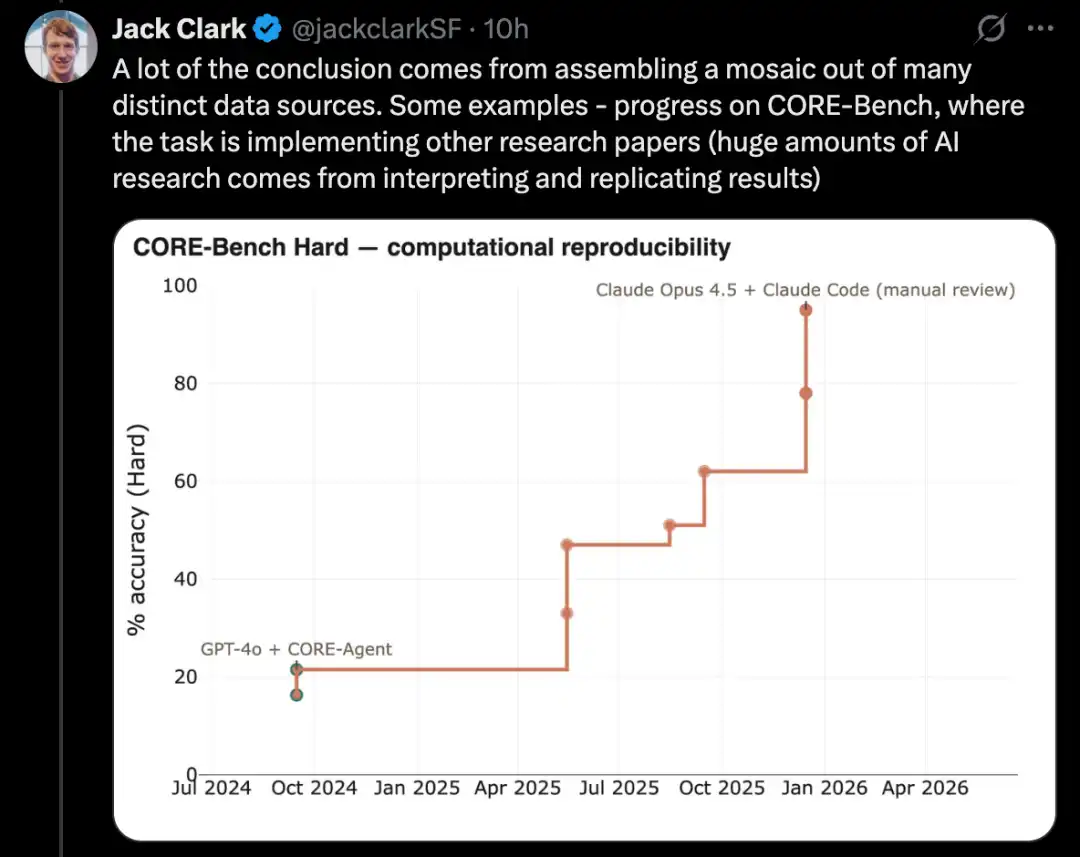

PostTrainBench kiểm tra xem các mô hình mạnh có thể tự tinh chỉnh các mô hình nguồn mở yếu hơn để cải thiện hiệu suất hay không, đây chính là một tập con quan trọng của các nhiệm vụ nghiên cứu AI.

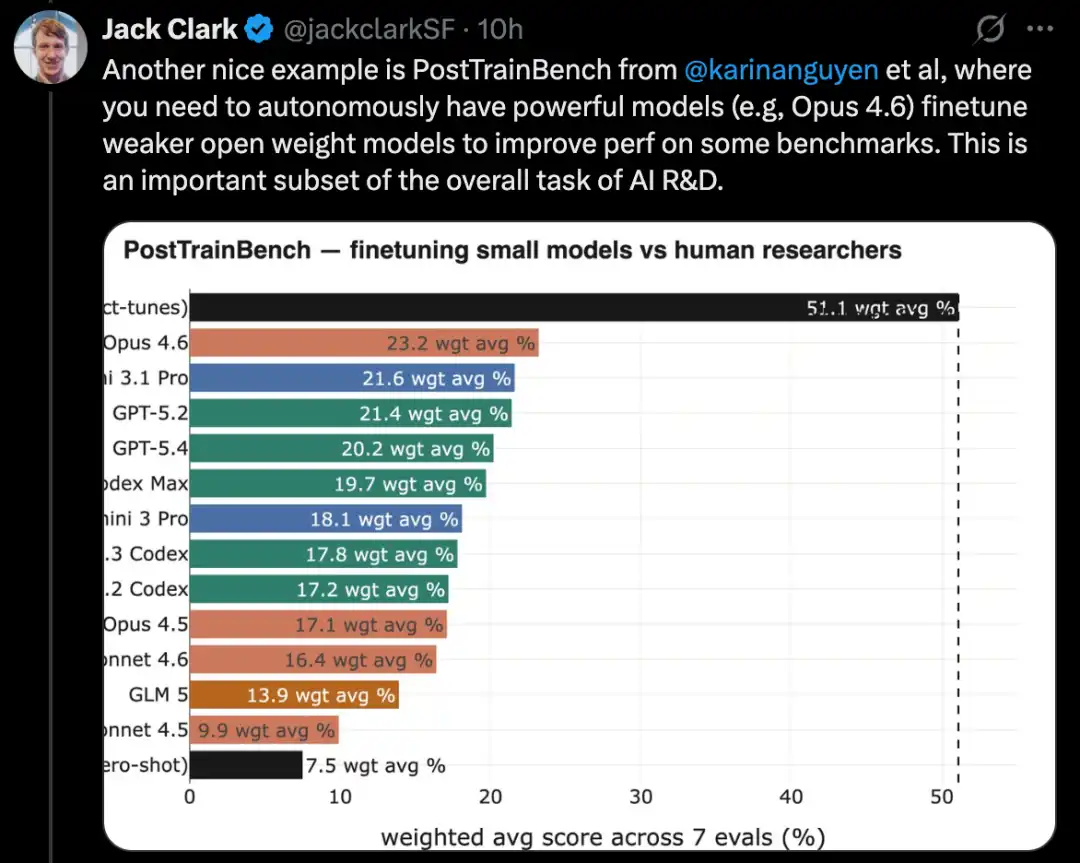

MLE-Bench dựa trên các nhiệm vụ cuộc thi Kaggle thực tế, yêu cầu xây dựng các ứng dụng học máy đa dạng để giải quyết các vấn đề cụ thể. Ngoài ra, các bộ chuẩn mã hóa nổi tiếng như SWE-Bench cũng cho thấy sự tiến bộ tương tự.

Jack Clark mô tả hiện tượng này là xu hướng tăng hướng lên và sang phải theo kiểu "fractal", tức là có thể quan sát thấy những tiến bộ có ý nghĩa ở các độ phân giải và quy mô khác nhau. Ông cho rằng AI đang dần tiến gần đến khả năng tự động hóa toàn bộ quy trình phát triển; một khi đạt được điều này, AI sẽ có thể tự xây dựng các hệ thống kế tiếp của chính nó, mở ra chu kỳ tự lặp lại.

Sau khi bình luận này được đưa ra, nó đã gây ra nhiều cuộc thảo luận trên mạng xã hội.

Một số người coi đây là bước đi quan trọng đầu tiên hướng tới ASI và điểm kỳ dị, có thể hoàn toàn thay đổi nhịp độ phát triển công nghệ.

Tuy nhiên, cũng có những ý kiến khác biệt.

Giáo sư khoa học máy tính tại Đại học Washington, Pedro Domingos, chỉ ra rằng các hệ thống AI đã có khả năng "tự xây dựng chính mình" kể từ khi ngôn ngữ LISP ra đời vào những năm 1950, vấn đề thực sự nằm ở việc liệu có thể đạt được lợi ích tăng dần hay không, và hiện tại chưa có bằng chứng rõ ràng hỗ trợ điều này.

Một số người dùng nghi ngờ rằng, từ năm 2027 đến 2028, xác suất tăng đột ngột 30%, điều này ngụ ý rằng khả năng của AI sẽ đạt được một bước đột phá lớn vào khoảng cuối năm 2027. Vậy cụ thể, cột mốc hay sự kiện nào sẽ khiến xác suất AI tự cải tiến lặp lại tăng mạnh trong thời gian ngắn?

Một số người dùng mạng cũng cho biết, Jack Clark là người phụ trách truyền thông mới của Anthropic, đây chính là một phần trong chiến lược mới của họ: Chúng tôi không đưa ra những lời đe dọa vô căn cứ, có rất nhiều bài báo nghiên cứu xác nhận những điều chúng tôi đã cảnh báo các bạn.

Jack Clark đã viết một bài viết dài chi tiết trong bản tin Import AI 455.

Tiếp theo, chúng ta sẽ xem toàn bộ bài viết này.

Hệ thống AI sắp bắt đầu tự xây dựng, điều này có nghĩa là gì?

Clark cho biết anh ấy viết bài này vì sau khi xem xét tất cả các thông tin có sẵn công khai, anh ấy buộc phải đưa ra một phán đoán không dễ dàng: khả năng xuất hiện nghiên cứu AI không có sự tham gia của con người trước cuối năm 2028 đã khá cao, có thể vượt quá 60%.

Việc phát triển AI không có sự tham gia của con người ở đây đề cập đến một hệ thống AI đủ mạnh: không chỉ hỗ trợ con người trong nghiên cứu, mà còn có thể tự thực hiện các quy trình phát triển then chốt, thậm chí xây dựng hệ thống thế hệ tiếp theo của chính nó.

Theo Clark, đây rõ ràng là một sự kiện lớn.

He admitted that he himself found it difficult to fully grasp the implications of this matter.

Lý do gọi đây là một phán quyết không mong muốn là vì những ảnh hưởng đằng sau nó quá lớn, khiến anh cảm thấy khó nắm bắt. Clark cũng không chắc liệu toàn xã hội đã sẵn sàng đón nhận những thay đổi sâu sắc do tự động hóa trong nghiên cứu và phát triển AI mang lại hay chưa.

Anh ấy hiện tin rằng nhân loại có thể đang sống ở một thời điểm đặc biệt: nghiên cứu AI sắp được tự động hóa toàn diện. Nếu khoảnh khắc này thực sự xảy ra, nhân loại sẽ như đã vượt qua sông Rubicon, bước vào một tương lai gần như không thể dự đoán được.

Clark cho biết, mục đích của bài viết này là giải thích lý do anh ấy tin rằng sự bùng nổ trong việc đạt được nghiên cứu AI hoàn toàn tự động đang diễn ra.

Anh ấy sẽ thảo luận về một số hệ quả có thể xảy ra từ xu hướng này, nhưng phần lớn bài viết sẽ tập trung vào các bằng chứng hỗ trợ cho phán đoán này. Về những tác động sâu sắc hơn, Clark dự định tiếp tục phân tích trong phần lớn thời gian còn lại của năm nay.

Về mặt thời gian, Clark không cho rằng sự việc này sẽ thực sự xảy ra vào năm 2026. Nhưng ông cho rằng trong vòng một đến hai năm tới, chúng ta có thể chứng kiến một số mô hình tự đào tạo ra người kế nhiệm chúng. Ít nhất ở cấp độ mô hình không phải tiên tiến nhất, việc tạo ra một minh chứng khái niệm là rất có thể xảy ra; còn với các mô hình tiên tiến nhất, độ khó sẽ cao hơn nhiều do chi phí cực kỳ đắt đỏ và phụ thuộc vào công việc cường độ cao của rất nhiều nhà nghiên cứu con người.

Phán đoán của Clark chủ yếu dựa trên thông tin công khai: bao gồm các bài báo trên arXiv, bioRxiv và NBER, cũng như các sản phẩm mà các công ty AI tiên tiến đã triển khai vào thế giới thực. Dựa trên những thông tin này, ông kết luận rằng việc tự động hóa các khâu cần thiết để sản xuất các hệ thống AI hiện tại, đặc biệt là các thành phần kỹ thuật trong phát triển AI, về cơ bản đã sẵn sàng.

Nếu xu hướng scaling tiếp tục duy trì, chúng ta nên bắt đầu chuẩn bị cho tình huống: các mô hình sẽ trở nên đủ sáng tạo không chỉ để tự động cải tiến các phương pháp đã biết, mà còn có thể thay thế các nhà nghiên cứu con người trong việc đề xuất các hướng nghiên cứu hoàn toàn mới và những ý tưởng nguyên bản, từ đó tự thúc đẩy ranh giới của AI tiếp tục tiến bộ.

Code Singularity: Evolution of Abilities Over Time

Hệ thống AI được thực hiện thông qua phần mềm, và phần mềm được tạo thành từ mã nguồn.

Các hệ thống AI đã hoàn toàn thay đổi cách sản xuất mã nguồn. Đằng sau điều này là hai xu hướng liên quan: một mặt, các hệ thống AI ngày càng thành thạo trong việc viết mã thực tế phức tạp; mặt khác, các hệ thống AI cũng ngày càng giỏi trong việc kết nối nhiều nhiệm vụ lập trình tuyến tính mà hầu như không cần sự giám sát của con người, chẳng hạn như viết mã trước, sau đó kiểm thử.

Hai ví dụ điển hình thể hiện xu hướng này là SWE-Bench và biểu đồ thời gian METR.

Giải quyết các vấn đề kỹ thuật phần mềm trong thế giới thực

SWE-Bench là một bài kiểm tra lập trình được sử dụng rộng rãi để đánh giá khả năng của các hệ thống AI trong việc giải quyết các vấn đề GitHub thực tế.

Khi SWE-Bench được ra mắt vào cuối năm 2023, mô hình hoạt động tốt nhất lúc đó là Claude 2, với tỷ lệ thành công tổng thể chỉ khoảng 2%. Trong khi đó, hiệu suất của Claude Mythos Preview đã đạt 93,9%, gần như đạt tối đa điểm số của benchmark này.

Tất nhiên, mọi benchmark đều có một mức độ nhiễu nhất định, nên thường xuất hiện một giai đoạn: khi điểm số đạt đến một mức độ nhất định, những gì bạn gặp phải có thể không còn là giới hạn của phương pháp, mà là giới hạn của chính benchmark. Ví dụ, trong bộ dữ liệu xác thực ImageNet, khoảng 6% nhãn là sai hoặc gây hiểu nhầm.

SWE-Bench có thể được coi là một chỉ số đáng tin cậy để đo lường năng lực lập trình tổng quát và tác động của AI đối với kỹ thuật phần mềm. Clark cho biết, hầu hết những người ông tiếp xúc tại các phòng thí nghiệm AI hàng đầu và Thung lũng Silicon hiện nay gần như đều viết mã hoàn toàn thông qua các hệ thống AI, và ngày càng nhiều người bắt đầu sử dụng các hệ thống AI để viết kiểm thử và kiểm tra mã.

Nói cách khác, hệ thống AI đã đủ mạnh để tự động hóa một thành phần quan trọng trong nghiên cứu AI và đẩy nhanh đáng kể quá trình của tất cả các nhà nghiên cứu và kỹ sư tham gia vào nghiên cứu AI.

Đo lường khả năng của hệ thống AI trong việc hoàn thành các nhiệm vụ dài hạn

METR đã tạo một biểu đồ để đo lường mức độ phức tạp của các nhiệm vụ mà AI có thể hoàn thành. Độ phức tạp này được tính dựa trên số giờ mà một người chuyên nghiệp cần để hoàn thành các nhiệm vụ đó.

Chỉ số quan trọng nhất là khoảng thời gian nhiệm vụ tương ứng khi hệ thống AI đạt độ tin cậy 50% trên một nhóm nhiệm vụ.

Ở điểm này, tiến triển rất đáng kinh ngạc:

· Năm 2022, nhiệm vụ mà GPT-3.5 có thể hoàn thành tương đương với nhiệm vụ con người cần 30 giây để hoàn thành.

· Năm 2023, GPT-4 đã nâng thời gian này lên 4 phút.

· Năm 2024, o1 đã nâng thời gian này lên 40 phút.

· Năm 2025, GPT-5.2 High đạt khoảng 6 giờ.

· Đến năm 2026, Opus 4.6 đã đẩy thời gian này lên cao hơn nữa, khoảng 12 giờ.

Ajeya Cotra, người làm việc tại METR và đã theo dõi lâu dài các dự đoán về AI, cho rằng việc các hệ thống AI có thể hoàn thành các nhiệm vụ tương đương với 100 giờ lao động của con người vào cuối năm 2026 không phải là một kỳ vọng phi lý.

Thời gian mà hệ thống AI có thể hoạt động độc lập đã tăng đáng kể, đồng thời cũng có mối liên hệ chặt chẽ với sự bùng nổ của các công cụ agentic coding. Các công cụ agentic coding về bản chất là sản phẩm hóa các hệ thống AI có thể thực hiện công việc thay con người: chúng có thể hành động thay mặt con người và tiến hành nhiệm vụ một cách tương đối độc lập trong khoảng thời gian dài.

Điều này cũng quay trở lại chính việc nghiên cứu và phát triển AI. Khi quan sát kỹ công việc hàng ngày của nhiều nhà nghiên cứu AI, bạn sẽ thấy rằng rất nhiều nhiệm vụ trong số đó thực tế đều có thể chia nhỏ thành các công việc kéo dài vài giờ, chẳng hạn như làm sạch dữ liệu, đọc dữ liệu, khởi chạy thí nghiệm, v.v.

Và loại công việc này, hiện đã nằm trong phạm vi thời gian mà các hệ thống AI hiện đại có thể bao phủ.

Càng thành thạo, hệ thống AI càng có thể hoạt động độc lập với con người và hỗ trợ tự động hóa một phần công việc trong nghiên cứu AI.

Các yếu tố chính của nhiệm vụ giao phó chủ yếu gồm hai yếu tố:

· Thứ nhất là sự tin tưởng của bạn vào năng lực của người được ủy quyền;

· Thứ hai là bạn tin rằng đối phương có thể độc lập hoàn thành công việc theo ý định của bạn mà không cần sự giám sát liên tục từ bạn.

Khi người dùng quan sát khả năng của AI trong lập trình, họ sẽ nhận thấy các hệ thống AI không chỉ ngày càng thành thạo hơn mà còn có thể hoạt động độc lập trong thời gian dài hơn mà không cần con người hiệu chỉnh lại.

Điều này cũng phù hợp với những gì đang xảy ra xung quanh chúng ta, khi các kỹ sư và nhà nghiên cứu đang giao ngày càng nhiều công việc lớn hơn cho các hệ thống AI. Với khả năng của AI không ngừng được nâng cao, những công việc được giao cho AI cũng trở nên ngày càng phức tạp và quan trọng hơn.

AI đang nắm bắt các kỹ năng khoa học cốt lõi cần thiết cho việc phát triển AI

Hãy nghĩ về cách các nghiên cứu khoa học hiện đại được thực hiện: phần lớn công việc thực chất là xác định một hướng đi trước, làm rõ loại thông tin thực nghiệm mà mình muốn thu thập; sau đó thiết kế và thực hiện thí nghiệm để tạo ra những thông tin đó; cuối cùng là kiểm tra tính hợp lý của kết quả thí nghiệm.

Với khả năng lập trình của AI không ngừng được cải thiện cùng khả năng mô hình hóa thế giới ngày càng mạnh mẽ của các mô hình ngôn ngữ lớn, hiện đã xuất hiện một loạt công cụ giúp các nhà khoa học con người tăng tốc và tự động hóa một phần các khâu trong nhiều bối cảnh nghiên cứu và phát triển rộng hơn.

Tại đây, chúng ta có thể quan sát tốc độ tiến bộ của AI trong một số kỹ năng khoa học then chốt, những khả năng này chính là những phần không thể thiếu trong nghiên cứu AI:

· Thứ nhất là tái hiện kết quả nghiên cứu;

· Thứ hai là kết nối kỹ thuật học máy với các phương pháp khác để giải quyết các vấn đề kỹ thuật;

· Thứ ba là tối ưu hóa chính hệ thống AI.

Thực hiện toàn bộ bài báo khoa học và hoàn thành các thí nghiệm liên quan

Một trong những công việc cốt lõi trong nghiên cứu AI là đọc các bài báo khoa học và tái tạo lại các kết quả của chúng. Trong lĩnh vực này, AI đã đạt được những tiến bộ đáng kể trên nhiều benchmark.

Một ví dụ tốt là CORE-Bench, tức là Computational Reproducibility Agent Benchmark.

Benchmark này yêu cầu hệ thống AI tái tạo kết quả trong bài báo khi được cung cấp bài báo và kho lưu trữ mã nguồn liên quan. Cụ thể, Agent cần cài đặt các thư viện, gói phần mềm và phụ thuộc, chạy mã; nếu mã chạy thành công, nó còn phải tìm kiếm tất cả các kết quả đầu ra và trả lời các câu hỏi trong nhiệm vụ.

CORE-Bench được đề xuất vào tháng 9 năm 2024. Vào thời điểm đó, hệ thống hiệu suất tốt nhất là mô hình GPT-4o chạy trên nền tảng CORE-Agent. Trên nhóm nhiệm vụ khó nhất của benchmark này, nó đạt điểm khoảng 21,5%.

Đến tháng 12 năm 2025, một tác giả của CORE-Bench tuyên bố rằng benchmark này đã được giải quyết: mô hình Opus 4.5 đạt điểm số 95,5%.

Xây dựng hệ thống học máy hoàn chỉnh để giải quyết các bài toán trên Kaggle

MLE-Bench là một benchmark do OpenAI xây dựng để kiểm tra khả năng của các hệ thống AI trong việc tham gia các cuộc thi Kaggle trong môi trường ngoại tuyến.

Nó bao phủ 75 cuộc thi Kaggle khác nhau, liên quan đến nhiều lĩnh vực như xử lý ngôn ngữ tự nhiên, thị giác máy tính và xử lý tín hiệu.

MLE-Bench được phát hành vào tháng 10 năm 2024. Khi ra mắt, hệ thống có hiệu suất tốt nhất là một mô hình o1 chạy trên agent scaffold, đạt điểm 16,9%.

Tính đến tháng 2 năm 2026, hệ thống hiệu quả nhất đã trở thành Gemini 3 chạy trên agent harness có khả năng tìm kiếm, đạt điểm 64,4%.

Thiết kế Kernel

Một nhiệm vụ khó hơn trong phát triển AI là tối ưu hóa kernel. Tối ưu hóa kernel nghĩa là viết và cải tiến mã cấp thấp để ánh xạ hiệu quả hơn các phép toán cụ thể như nhân ma trận lên phần cứng cấp thấp.

Việc tối ưu kernel là trung tâm của phát triển AI vì nó quyết định hiệu suất của quá trình huấn luyện và suy luận: một mặt, nó ảnh hưởng đến việc bạn có thể tận dụng bao nhiêu sức mạnh tính toán trong quá trình phát triển hệ thống AI; mặt khác, sau khi mô hình được huấn luyện xong, nó cũng quyết định bạn có thể chuyển đổi sức mạnh tính toán thành khả năng suy luận hiệu quả đến đâu.

Trong những năm gần đây, việc sử dụng AI để thiết kế kernel đã từ một hướng nhỏ thú vị trở thành một lĩnh vực nghiên cứu cạnh tranh khốc liệt, với nhiều benchmark xuất hiện. Tuy nhiên, các benchmark này hiện chưa thực sự phổ biến, do đó chúng ta khó có thể mô hình hóa rõ ràng tiến độ dài hạn của nó như các lĩnh vực khác. Mặt khác, chúng ta có thể cảm nhận được tốc độ tiến bộ của hướng nghiên cứu này thông qua một số nghiên cứu đang diễn ra.

Các công việc liên quan bao gồm:

· Thử xây dựng GPU kernel tốt hơn bằng mô hình DeepSeek;

Chuyển đổi tự động các mô-đun PyTorch thành mã CUDA;

· Meta sử dụng LLM để tự động tạo và triển khai kernel Triton đã được tối ưu hóa vào cơ sở hạ tầng của riêng họ;

· Và tinh chỉnh mô hình trọng số nguồn mở nhằm tối ưu kernel GPU, ví dụ như Cuda Agent.

Cần bổ sung thêm một điểm: thiết kế kernel thực sự có một số thuộc tính đặc biệt phù hợp với nghiên cứu do AI thúc đẩy, chẳng hạn như kết quả dễ dàng xác minh và tín hiệu phần thưởng rõ ràng.

Fine-tune language models via PostTrainBench

Một phiên bản khó hơn của bài kiểm tra này là PostTrainBench. Nó kiểm tra xem các mô hình tiên tiến khác nhau có thể tiếp nhận các mô hình trọng số mở nguồn nhỏ hơn và cải thiện hiệu suất của chúng trên một số benchmark thông qua tinh chỉnh không.

Một ưu điểm của benchmark này là nó có cơ sở con người rất mạnh: các phiên bản đã được huấn luyện theo hướng dẫn hiện có của các mô hình nhỏ này. Các phiên bản này thường do các nhà nghiên cứu AI xuất sắc trong các phòng thí nghiệm hàng đầu phát triển, đã được tinh chỉnh bởi các nhà nghiên cứu và kỹ sư rất có năng lực, và đã được triển khai vào thực tế. Do đó, chúng tạo thành một cơ sở con người rất khó vượt qua.

Tính đến tháng 3 năm 2026, các hệ thống AI đã có thể thực hiện hậu huấn luyện mô hình và đạt được mức cải thiện hiệu suất khoảng một nửa so với kết quả huấn luyện của con người.

Điểm đánh giá cụ thể được tính từ một giá trị trung bình có trọng số: nó tổng hợp nhiều mô hình ngôn ngữ lớn sau khi huấn luyện, bao gồm Qwen 3 1.7B, Qwen 3 4B, SmolLM3-3B, Gemma 3 4B, cùng nhiều bộ dữ liệu kiểm tra, bao gồm AIME 2025, Arena Hard, BFCL, GPQA Main, GSM8K, HealthBench và HumanEval.

Trong mỗi lần chạy, bên đánh giá sẽ yêu cầu một CLI agent nhằm tối ưu hóa hiệu suất của một mô hình cơ sở cụ thể trên một benchmark cụ thể.

Tính đến tháng 4 năm 2026, hệ thống AI có điểm cao nhất đạt khoảng 25% đến 28%, bao gồm các mô hình như Opus 4.6 và GPT 5.4; trong khi đó, điểm số của con người là 51%.

Đây đã là một kết quả khá ý nghĩa.

Tối ưu hóa việc huấn luyện mô hình ngôn ngữ

Trong năm qua, Anthropic đã liên tục báo cáo hiệu suất hệ thống của họ trên một nhiệm vụ huấn luyện LLM. Nhiệm vụ này yêu cầu mô hình tối ưu hóa một triển khai huấn luyện mô hình ngôn ngữ nhỏ chỉ sử dụng CPU để chạy nhanh nhất có thể.

Cách đánh giá: Tỷ lệ tăng tốc trung bình mà mô hình đạt được so với mã ban đầu chưa được chỉnh sửa.

Kết quả này có tiến triển rất đáng kể:

· Tháng 5 năm 2025, Claude Opus 4 đạt tốc độ trung bình tăng 2,9 lần;

· Tháng 11 năm 2025, Opus được nâng cấp lên 16,5 lần;

· Tháng 2 năm 2026, Opus 4.6 đạt 30 lần;

· Tháng 4 năm 2026, Claude Mythos Preview đạt 52 lần.

Để hiểu ý nghĩa của những con số này, có thể so sánh: đối với các nhà nghiên cứu con người, nhiệm vụ này thường cần 4 đến 8 giờ làm việc để đạt được tốc độ tăng gấp 4 lần.

Kỹ năng gốc: Quản lý

Các hệ thống AI cũng đang học cách quản lý các hệ thống AI khác.

Điều này đã có thể thấy trong một số sản phẩm được triển khai rộng rãi, chẳng hạn như Claude Code hoặc OpenCode. Trong các sản phẩm này, một agent chính có thể giám sát nhiều agent phụ.

Điều này cho phép hệ thống AI xử lý các dự án quy mô lớn hơn: các dự án có thể yêu cầu nhiều tác nhân có chuyên môn khác nhau làm việc song song, và chúng thường được điều phối bởi một quản lý AI duy nhất. Quản lý này cũng là một hệ thống AI.

Nghiên cứu AI giống với việc phát hiện thuyết tương đối rộng hay lắp ráp Lego hơn?

Một vấn đề then chốt là: AI có thể sáng tạo ra những ý tưởng mới để tự cải thiện chính nó? Hay các hệ thống này phù hợp hơn với những công việc trong nghiên cứu ít nổi bật nhưng cần được tiến hành từng bước một?

Câu hỏi này rất quan trọng vì nó liên quan đến mức độ mà hệ thống AI có thể tự động hóa toàn bộ quá trình nghiên cứu AI.

Phán đoán của tác giả là: AI hiện tại vẫn chưa thể đưa ra những ý tưởng hoàn toàn mới và cách mạng. Nhưng để tự động hóa quá trình nghiên cứu và phát triển của chính nó, AI có thể không nhất thiết phải làm được điều đó.

Lĩnh vực AI tiến bộ chủ yếu dựa vào các thí nghiệm ngày càng lớn hơn và ngày càng nhiều đầu vào, chẳng hạn như dữ liệu và sức mạnh tính toán.

Đôi khi, con người đưa ra những ý tưởng thay đổi mô hình, giúp tăng đáng kể hiệu quả sử dụng tài nguyên trong toàn bộ lĩnh vực. Kiến trúc Transformer là một ví dụ điển hình, và mô hình chuyên gia hỗn hợp, hay còn gọi là mixture-of-experts, cũng là một ví dụ khác.

Nhưng thường thì cách thúc đẩy lĩnh vực AI lại đơn giản hơn nhiều: con người sẽ lấy một hệ thống hoạt động tốt, mở rộng một khía cạnh nào đó, chẳng hạn như dữ liệu huấn luyện và sức mạnh tính toán; quan sát xem vấn đề nào phát sinh sau khi mở rộng quy mô; tìm ra giải pháp kỹ thuật để sửa chữa, giúp hệ thống tiếp tục mở rộng; rồi lại tiếp tục mở rộng quy mô.

Trong quá trình này, phần thực sự cần sự thấu suốt là rất ít. Phần lớn công việc giống như những nền tảng kỹ thuật vững chắc, dù không nổi bật.

Tương tự, nhiều nghiên cứu AI thực chất là chạy các biến thể khác nhau của các thí nghiệm hiện có để khám phá kết quả khi thay đổi các thiết lập tham số khác nhau. Trực giác nghiên cứu chắc chắn giúp con người lựa chọn những tham số đáng thử nhất, nhưng chính việc này cũng có thể được tự động hóa để AI tự xác định những tham số nào nên điều chỉnh. Các tìm kiếm kiến trúc thần kinh sớm là một phiên bản của tư tưởng này.

Edison từng nói: Thiên tài là 1% cảm hứng, cộng với 99% mồ hôi. Dù đã qua 150 năm, câu nói này vẫn rất phù hợp.

Đôi khi, thật sự có những hiểu biết mới làm thay đổi hoàn toàn một lĩnh vực. Nhưng hầu hết thời gian, sự tiến bộ của lĩnh vực này được thúc đẩy từng bước thông qua quá trình vất vả của con người trong việc cải tiến và gỡ lỗi các hệ thống khác nhau.

Trong khi đó, dữ liệu công khai được đề cập trước đó cho thấy AI đã rất thành thạo trong việc thực hiện nhiều công việc nặng nhọc cần thiết trong phát triển AI.

Đồng thời, còn có một xu hướng lớn hơn: các năng lực cơ bản, như khả năng lập trình, đang được kết hợp với phạm vi thời gian nhiệm vụ ngày càng mở rộng. Điều này có nghĩa là các hệ thống AI có thể nối tiếp ngày càng nhiều nhiệm vụ như vậy để tạo thành các chuỗi công việc phức tạp.

Do đó, ngay cả khi các hệ thống AI hiện tại tương đối thiếu sáng tạo, vẫn có lý do để tin rằng chúng vẫn có thể thúc đẩy chính mình tiếp tục phát triển, dù tốc độ tiến bộ này có thể chậm hơn so với trường hợp có thể tạo ra những hiểu biết hoàn toàn mới.

Tuy nhiên, nếu tiếp tục quan sát dữ liệu công khai, bạn sẽ phát hiện ra một tín hiệu đáng chú ý khác: các hệ thống AI có thể đang thể hiện một dạng sáng tạo, và loại sáng tạo này có thể khiến chúng thúc đẩy sự tiến bộ của chính mình theo những cách bất ngờ hơn.

Đẩy mạnh các ranh giới khoa học tiếp tục tiến lên

Hiện đã có một số dấu hiệu ban đầu cho thấy các hệ thống AI tổng quát có khả năng thúc đẩy ranh giới khoa học nhân loại tiếp tục tiến bộ. Tuy nhiên, cho đến nay, tình huống này chỉ xảy ra ở một vài lĩnh vực nhỏ, chủ yếu là khoa học máy tính và toán học. Và thường thì không phải hệ thống AI tự mình đạt được đột phá, mà là thông qua sự hợp tác giữa con người và máy móc, cùng với các nhà nghiên cứu con người cùng thúc đẩy tiến bộ.

Dù vậy, những xu hướng này vẫn đáng để theo dõi:

Vấn đề Erdős: Một nhóm các nhà toán học hợp tác với mô hình Gemini để kiểm tra hiệu suất của nó trong việc giải quyết một số bài toán Erdős. Họ hướng dẫn hệ thống thử khoảng 700 bài toán và cuối cùng tìm được 13 lời giải. Trong số các lời giải này, có 1 lời giải được họ cho là thú vị.

Các nhà nghiên cứu viết rằng họ cho rằng, ban đầu, lời giải của Aletheia (một hệ thống AI dựa trên Gemini 3 Deep Think) đối với Erdős-1051 đại diện cho một trường hợp sơ khai: một hệ thống AI tự chủ giải quyết một vấn đề Erdős mở, có mức độ không tầm thường và mang một số quan tâm toán học rộng hơn. Vấn đề này trước đó đã có một số tài liệu nghiên cứu liên quan chặt chẽ.

Nếu hiểu theo hướng tích cực, những trường hợp này có thể được xem như một tín hiệu: các hệ thống AI đang phát triển một trực giác sáng tạo có khả năng thúc đẩy ranh giới của lĩnh vực, điều trước đây chủ yếu thuộc về con người.

Tuy nhiên, cũng có thể giải thích theo hướng khác: toán học và khoa học máy tính có thể chính là những lĩnh vực đặc biệt phù hợp với việc phát minh do AI thúc đẩy, do đó chúng có thể chỉ là ngoại lệ và không đại diện cho toàn bộ các lĩnh vực khoa học khác sẽ được AI thúc đẩy theo cách tương tự.

Một ví dụ tương tự là nước đi thứ 37 của AlphaGo. Tuy nhiên, Clark cho rằng, đã trôi qua mười năm kể từ kết quả đó của AlphaGo, và nước đi thứ 37 chưa từng bị thay thế bởi một sự hiểu biết hiện đại và ấn tượng hơn, điều này cũng có thể được xem như một tín hiệu hơi bi quan.

AI đã có thể tự động hóa phần lớn công việc trong kỹ thuật AI

Nếu gộp tất cả các bằng chứng trên lại, chúng ta có thể thấy một bức tranh như sau:

Các hệ thống AI đã có thể viết mã cho hầu như bất kỳ chương trình nào, và những hệ thống này đã có thể được tin tưởng để tự thực hiện một số nhiệm vụ; những nhiệm vụ này nếu giao cho con người thường đòi hỏi hàng chục giờ lao động tập trung cao độ.

Các hệ thống AI ngày càng thành thạo trong việc thực hiện các nhiệm vụ cốt lõi của phát triển AI, từ tinh chỉnh mô hình đến thiết kế kernel, đều đang được bao phủ dần.

Các hệ thống AI đã có thể quản lý các hệ thống AI khác, thực sự tạo thành một đội tổng hợp: nhiều AI có thể cùng xử lý các vấn đề phức tạp, trong đó một số AI đảm nhận vai trò người phụ trách, người phê bình, biên tập viên, trong khi những AI khác đóng vai trò kỹ sư.

· Hệ thống AI đôi khi đã có thể vượt qua con người trong các nhiệm vụ kỹ thuật và khoa học khó khăn, mặc dù hiện tại vẫn rất khó xác định liệu điều này là do chúng sở hữu sự sáng tạo thực sự hay vì chúng đã thành thạo lượng lớn kiến thức theo mô hình.

Theo Clark, những bằng chứng này đã cho thấy một cách rất thuyết phục rằng AI ngày nay có thể tự động hóa phần lớn công việc trong lĩnh vực AI engineering, thậm chí có thể bao phủ toàn bộ các khâu.

Tuy nhiên, hiện vẫn chưa rõ AI có thể tự động hóa chính nghiên cứu AI đến mức nào, vì một số phần trong nghiên cứu có thể khác với kỹ năng kỹ thuật thuần túy và vẫn phụ thuộc vào phán đoán cấp cao hơn, nhận thức về vấn đề và tính sáng tạo.

Tuy nhiên, một tín hiệu rõ ràng đã xuất hiện: AI ngày nay đang đẩy nhanh đáng kể quá trình phát triển AI của con người, giúp các nhà nghiên cứu và kỹ sư này tăng cường khả năng làm việc của mình thông qua việc hợp tác với vô số đồng nghiệp tổng hợp.

Cuối cùng, chính ngành AI cũng gần như đang nói rõ rằng: tự động hóa nghiên cứu AI chính là mục tiêu của họ.

OpenAI mong muốn xây dựng một thực tập sinh nghiên cứu AI tự động trước tháng 9 năm 2026. Anthropic đang công bố các công trình về việc xây dựng các nhà nghiên cứu căn chỉnh AI tự động. DeepMind trông có vẻ thận trọng nhất trong ba phòng thí nghiệm, nhưng cũng cho biết nên thúc đẩy tự động hóa nghiên cứu căn chỉnh khi có thể.

Tự động hóa nghiên cứu AI cũng đã trở thành mục tiêu của nhiều công ty khởi nghiệp. Recursive Superintelligence vừa huy động được 500 triệu USD với mục tiêu tự động hóa nghiên cứu AI.

Nói cách khác, hàng trăm tỷ đô la vốn hiện có và vốn mới đang được đầu tư vào một nhóm các tổ chức nhằm mục tiêu phát triển AI tự động hóa.

Vì vậy, chúng ta đương nhiên nên kỳ vọng rằng hướng này sẽ đạt được ít nhất một mức độ tiến triển nào đó.

Tại sao điều này lại quan trọng

Những ảnh hưởng này mang tính sâu rộng, nhưng lại hiếm khi được thảo luận trong các báo cáo của truyền thông đại chúng về nghiên cứu AI. Dưới đây là một số khía cạnh phản ánh những thách thức lớn mà nghiên cứu AI mang lại.

1. Chúng ta phải đảm bảo sự phù hợp: các kỹ thuật phù hợp hiệu quả ngày nay có thể trở nên vô hiệu trong quá trình tự cải tiến lặp lại, vì hệ thống AI sẽ trở nên thông minh hơn nhiều so với con người hoặc hệ thống giám sát chúng. Đây là một lĩnh vực đã được nghiên cứu rộng rãi, nên ông chỉ tóm tắt ngắn gọn một số vấn đề:

Việc huấn luyện hệ thống trí tuệ nhân tạo không nói dối và gian lận là một quá trình tinh vi bất ngờ (ví dụ: dù đã nỗ lực xây dựng các bài kiểm tra tốt cho môi trường, đôi khi phương pháp tốt nhất để AI giải quyết vấn đề là gian lận, từ đó dạy nó rằng gian lận là khả thi).

Hệ thống AI có thể lừa dối chúng ta bằng cách “giả vờ tuân thủ”, đầu ra những điểm số khiến chúng ta tin rằng nó hoạt động tốt, nhưng thực chất lại che giấu ý định thực sự của nó. (Thông thường, hệ thống AI đã có khả năng nhận biết khi nào nó đang được kiểm tra.)

· Khi các hệ thống AI bắt đầu tham gia nhiều hơn vào chương trình nghiên cứu cơ bản về việc tự đào tạo chính chúng, chúng ta có thể thay đổi đáng kể cách toàn bộ hệ thống AI được đào tạo, mà không có trực giác hoặc nền tảng lý thuyết tốt để hiểu điều đó có nghĩa là gì.

· Khi bạn đặt một hệ thống vào vòng lặp đệ quy, sẽ phát sinh vấn đề “tích lũy lỗi” rất cơ bản, có thể ảnh hưởng đến tất cả các vấn đề nêu trên và các vấn đề khác: trừ khi phương pháp căn chỉnh của bạn “chính xác 100%” và về mặt lý thuyết có thể duy trì độ chính xác này trong các hệ thống thông minh hơn, thì mọi việc có thể nhanh chóng trở nên sai lệch. Ví dụ, độ chính xác ban đầu của công nghệ bạn là 99,9%, sau 50 thế hệ có thể giảm xuống còn 95,12%, và sau 500 thế hệ có thể giảm xuống còn 60,5%.

Mọi thứ liên quan đến AI đều sẽ nhận được sự gia tăng năng suất khổng lồ: giống như AI đã làm tăng đáng kể năng suất của các kỹ sư phần mềm, chúng ta nên kỳ vọng các lĩnh vực khác liên quan đến AI cũng sẽ như vậy. Điều này mang lại một số vấn đề cần giải quyết:

· Sự bất bình đẳng trong việc tiếp cận tài nguyên: Giả sử nhu cầu về AI tiếp tục vượt quá nguồn cung tài nguyên tính toán, chúng ta phải quyết định cách phân bổ AI để đạt được lợi ích xã hội tối đa. Tôi nghi ngờ rằng các động lực thị trường có thể đảm bảo chúng ta thu được lợi ích xã hội tối ưu từ nguồn tài nguyên tính toán AI hạn chế. Việc xác định cách phân bổ năng lực tăng tốc mang lại từ nghiên cứu và phát triển AI sẽ là một vấn đề mang tính chính trị rất cao.

· Định luật Amdahl của nền kinh tế: Khi AI tràn vào nền kinh tế, chúng ta sẽ phát hiện ra một số khâu gặp phải điểm nghẽn khi đối mặt với tăng trưởng nhanh, cần tìm cách khắc phục những điểm yếu trong chuỗi này. Điều này có thể đặc biệt rõ ràng trong các lĩnh vực đòi hỏi sự phối hợp giữa thế giới số nhanh chóng và thế giới vật lý chậm chạp, chẳng hạn như thử nghiệm lâm sàng thuốc mới.

3. Sự hình thành nền kinh tế vốn-intensive, lao động nhẹ: Tất cả các bằng chứng nêu trên về nghiên cứu và phát triển AI cũng cho thấy các hệ thống AI ngày càng có khả năng vận hành doanh nghiệp một cách tự chủ.

Điều này có nghĩa là chúng ta có thể kỳ vọng một phần nền kinh tế sẽ được các công ty thế hệ mới chiếm lĩnh, những công ty này có thể là vốn-intensive (vì chúng sở hữu nhiều máy tính) hoặc chi phí vận hành-intensive (vì chúng chi tiêu rất nhiều tiền cho dịch vụ AI và tạo ra giá trị dựa trên đó), so với các doanh nghiệp ngày nay, chúng phụ thuộc ít hơn vào lao động con người—vì khi khả năng của các hệ thống AI tiếp tục được cải thiện, giá trị biên của việc đầu tư vào AI sẽ không ngừng gia tăng.

Thực tế, điều này sẽ thể hiện như một “nền kinh tế máy móc” dần hình thành trong “nền kinh tế con người” lớn hơn; theo thời gian, các công ty do AI vận hành có thể bắt đầu giao dịch với nhau, từ đó thay đổi cấu trúc kinh tế và gây ra nhiều vấn đề liên quan đến bất bình đẳng và tái phân phối. Cuối cùng, có thể xuất hiện các công ty hoàn toàn do các hệ thống AI tự chủ vận hành, điều này sẽ làm trầm trọng thêm các vấn đề trên đồng thời mang lại nhiều thách thức quản trị mới.

Gaze into the black hole

Dựa trên phân tích trên, tác giả cho rằng đến cuối năm 2028, xác suất chúng ta sẽ chứng kiến tự động hóa nghiên cứu AI (tức là các mô hình tiên tiến có thể tự đào tạo phiên bản kế nhiệm của chúng) khoảng 60%. Tại sao lại không kỳ vọng nó xuất hiện vào năm 2027?

Lý do là tác giả cho rằng nghiên cứu AI vẫn cần sự sáng tạo và những quan điểm phản biện để tiến bộ, và cho đến nay, các hệ thống AI chưa thể hiện điều này một cách mang tính cách mạng và đáng kể (mặc dù một số kết quả trong việc đẩy nhanh nghiên cứu toán học có tính chất gợi mở).

Nếu buộc anh ấy phải đưa ra xác suất cho năm 2027, anh ấy sẽ nói là 30%.

Nếu đến cuối năm 2028 vẫn chưa xuất hiện, chúng ta có thể sẽ tiết lộ một số khuyết điểm cốt lõi trong mô hình công nghệ hiện tại, đòi hỏi sự sáng tạo của con người để thúc đẩy sự phát triển tiếp theo.