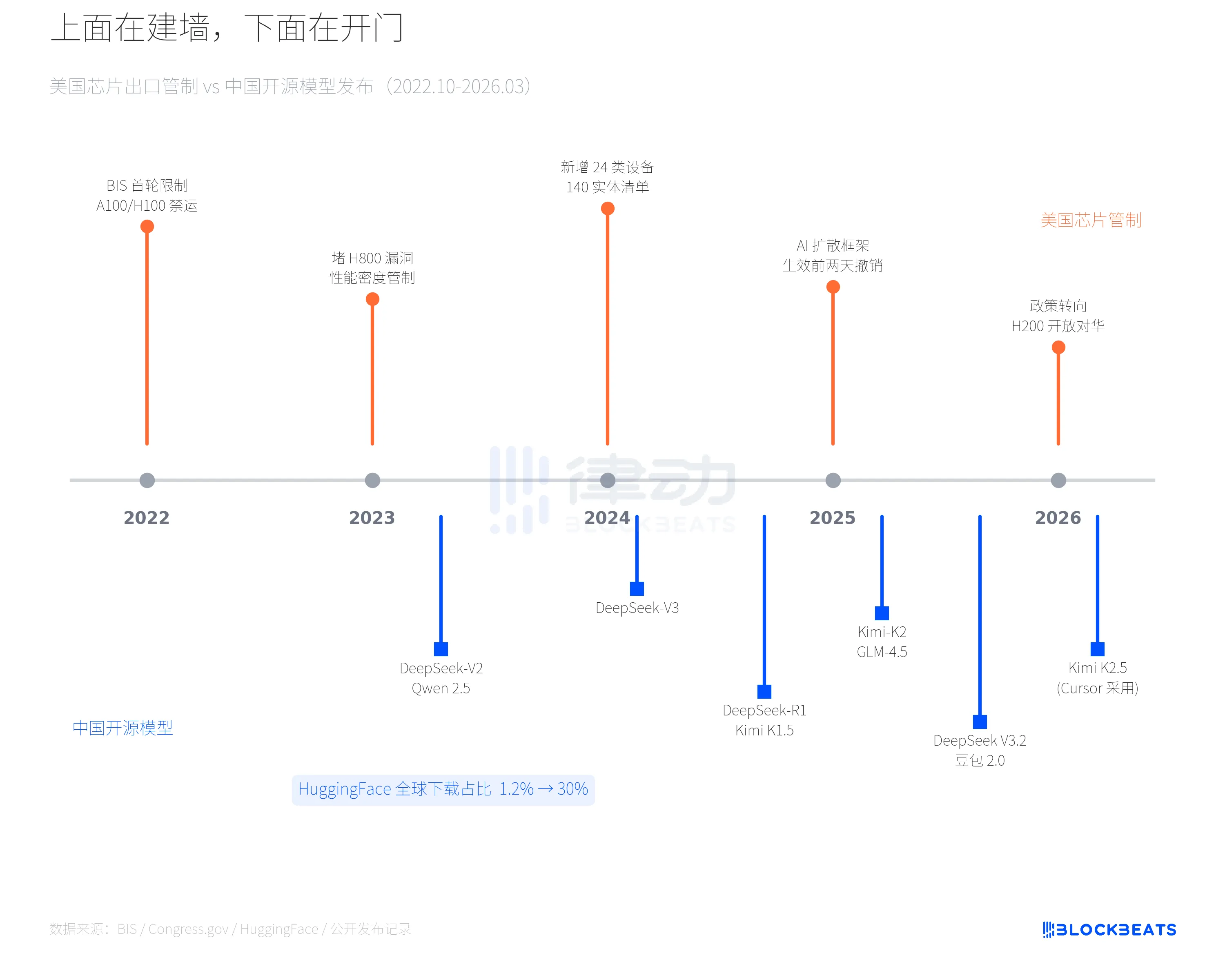

Mỹ đã dành ba năm, áp dụng bốn đợt kiểm soát xuất khẩu, liên quan đến 24 loại thiết bị bán dẫn và hơn 140 thực thể trong danh sách hạn chế, nhằm cắt đứt con đường Trung Quốc tiếp cận các chip AI tiên tiến. Tuy nhiên, theo báo cáo ngày 24 tháng 3 của Ủy ban Kiểm tra An ninh Kinh tế Mỹ - Trung (USCC), 80% các công ty khởi nghiệp AI của Mỹ đang sử dụng các mô hình mã nguồn mở của Trung Quốc.

Tường được xây ở tầng phần cứng. Cửa mở ở tầng phần mềm.

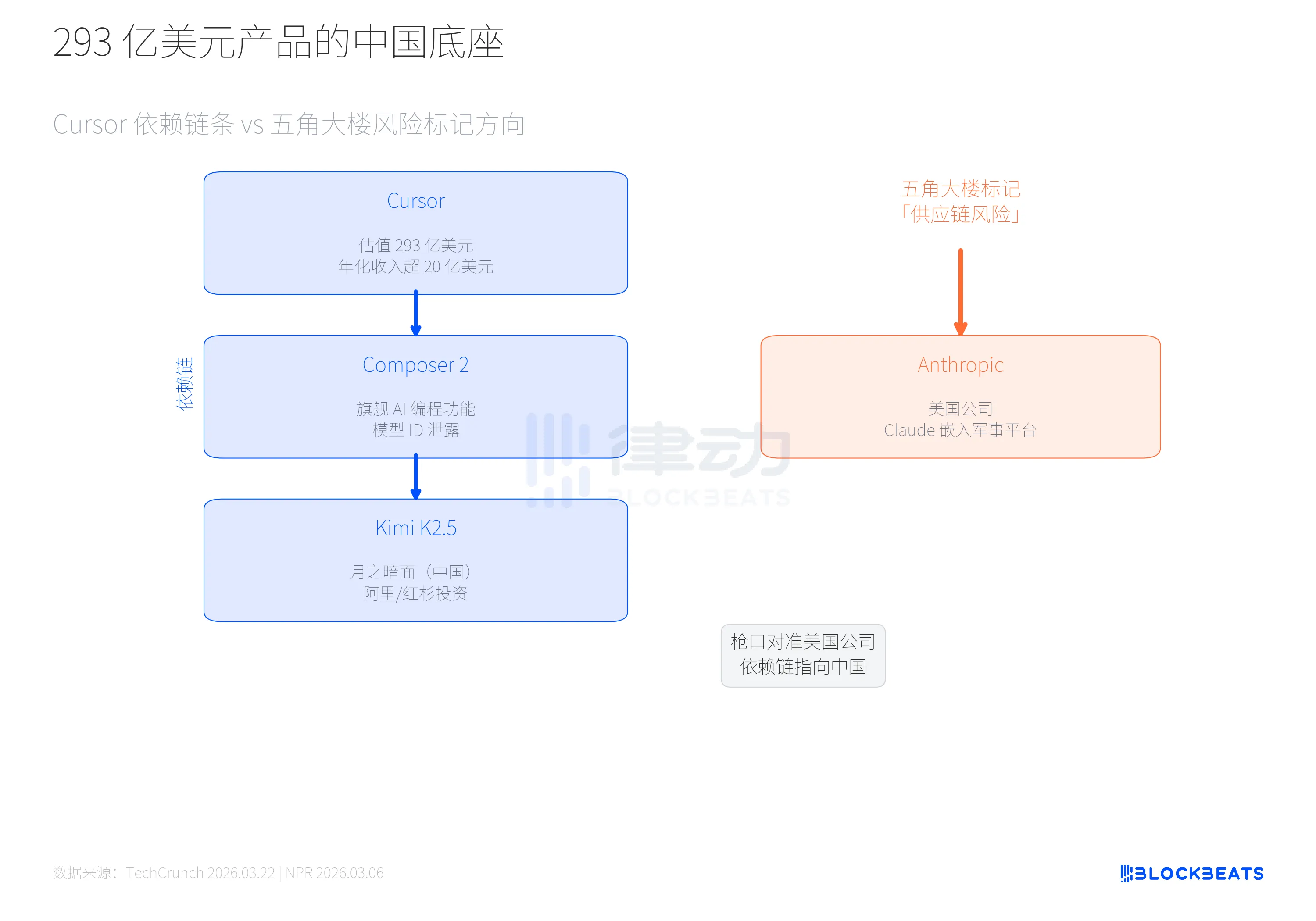

Sự mâu thuẫn này không phải là cuộc thảo luận chính sách trừu tượng. Ngay tuần trước, công cụ lập trình AI định giá 29,3 tỷ USD, Cursor, đã bị phát hiện rằng tính năng cốt lõi của nó, Composer 2, được xây dựng dựa trên nền tảng Kimi K2.5 của công ty Trung Quốc Moonshot. Một mô hình của công ty Trung Quốc đang điều khiển công cụ phát triển AI hàng đầu của Mỹ.

Meanwhile, the Pentagon labeled Anthropic, a U.S. company, with the tag "supply chain risk".

Hướng kiểm soát và hướng phụ thuộc thực tế hoàn toàn ngược nhau.

Kể từ khi BIS áp đặt các hạn chế đầu tiên đối với việc xuất khẩu chip cấp A100/H100 vào tháng 10 năm 2022, các biện pháp kiểm soát chip của Mỹ liên tục được tăng cường. Năm 2023, họ đóng lỗ hổng đối với H800 và mở rộng các chỉ số kiểm soát mật độ hiệu năng. Tháng 12 năm 2024, họ tiếp tục tăng cường thêm một đợt nữa, bổ sung kiểm soát 24 loại thiết bị bán dẫn và đưa 140 thực thể Trung Quốc vào danh sách đen, đồng thời đưa cả bộ nhớ băng thông cao (HBM) và DRAM vào phạm vi hạn chế. Tháng 1 năm 2025, Bộ Thương mại thậm chí còn đưa ra một “khung phân tán AI”, cố gắng xây dựng hệ thống kiểm soát toàn cầu ở cấp độ mô hình, nhưng khung này đã bị chính họ hủy bỏ hai ngày trước khi có hiệu lực. Đến tháng 12 năm 2025, Trump lại đảo ngược hướng đi, cho phép xuất khẩu chip H200 đến các khách hàng Trung Quốc được phê duyệt.

Ở giai đoạn sau của chuỗi thời gian kiểm soát, nhịp độ phát hành các mô hình mã nguồn mở của Trung Quốc không ngừng tăng tốc. Năm 2024, DeepSeek-V2 và chuỗi Qwen 2.5 lần lượt được mở nguồn. Ngày 20 tháng 1 năm 2025, DeepSeek-R1 và Kimi K1.5 được ra mắt cùng ngày, trong đó DeepSeek-R1 từng lọt vào top tải xuống của App Store Mỹ, vượt qua ChatGPT. Trong nửa cuối năm 2025, Kimi-K2 và GLM-4.5 tiếp tục ra mắt. Đầu năm 2026, DouBao 2.0 của ByteDance đã có 155 triệu người dùng hoạt động hàng tuần, trong khi Kimi K2.5 đã được Cursor áp dụng trực tiếp. Kiểm soát càng chặt, mô hình càng nhiều.

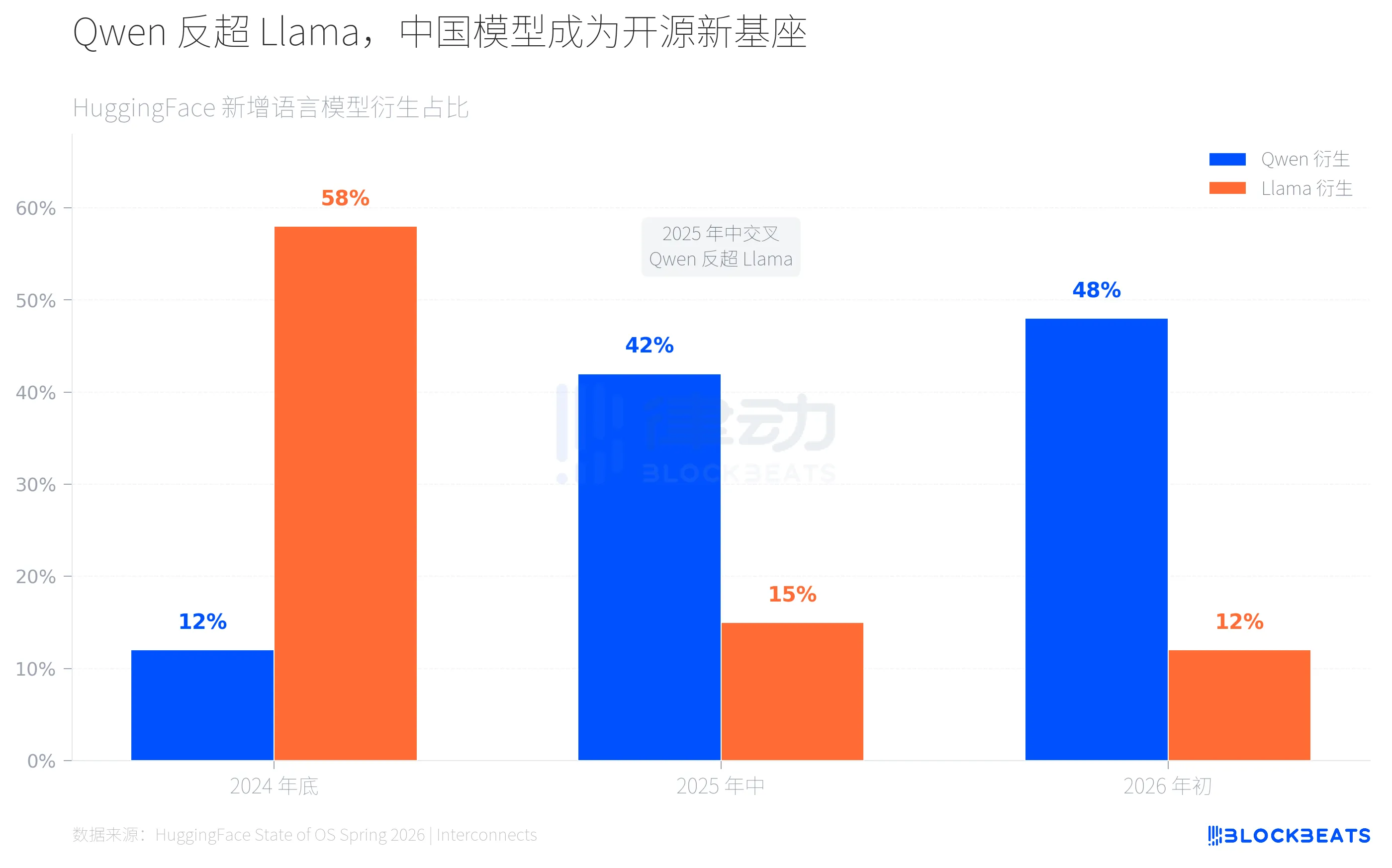

Theo dữ liệu chính thức từ HuggingFace, tỷ lệ mô hình mã nguồn mở của Trung Quốc trong tổng số lượt tải toàn cầu đã tăng từ khoảng 1,2% vào cuối năm 2024 lên khoảng 30% vào đầu năm 2026. Tổng số lượt tải của chuỗi mô hình Qwen của Alibaba đã vượt quá 700 triệu lần vào tháng 1 năm 2026, chính thức vượt qua Llama của Meta. Các biện pháp kiểm soát chip không thể ngăn cản việc xuất khẩu phần mềm AI của Trung Quốc, mà có thể đã thúc đẩy sự chuyển đổi chiến lược sang hướng mã nguồn mở.

Đây không phải là sự trùng hợp ngẫu nhiên về dữ liệu. Báo cáo của USCC đã sử dụng một khung chính xác để mô tả hiện tượng này: “chu trình kép”. Trong chu trình phần cứng, Trung Quốc bị hạn chế bởi các nút thắt trong nguồn cung chip. Trong chu trình phần mềm, Trung Quốc thông qua các mô hình mã nguồn mở thâm nhập ngược vào cơ sở hạ tầng AI toàn cầu, tạo ra sự phụ thuộc ở khâu downstream. Hướng lực của hai chu trình này ngược nhau, nhưng lại củng cố lẫn nhau. Các biện pháp kiểm soát hạn chế khả năng tiếp cận năng lực tính toán hàng đầu của chúng ta, nhưng đồng thời cũng thúc đẩy một con đường công nghệ thực hiện nhiều việc hơn với ít năng lực tính toán hơn. DeepSeek-R1 đạt hiệu suất tiên tiến với chi phí suy luận thấp hơn nhiều so với GPT-4o chính là sản phẩm của con đường này.

Các thay đổi trên HuggingFace có thể thấy rõ ràng. Theo dữ liệu thống kê của nền tảng, cuối năm 2024, các mô hình dẫn xuất từ Llama chiếm khoảng sáu phần mười các mô hình ngôn ngữ mới được thêm vào, trong khi Qwen chỉ chiếm hơn một phần mười. Đến giữa năm 2025, điểm giao nhau xuất hiện; theo blog chính thức của HuggingFace, tỷ lệ mô hình dẫn xuất từ Qwen tăng vọt lên hơn 40%, trong khi Llama giảm xuống khoảng 15%. Đầu năm 2026, các mô hình dẫn xuất từ Qwen đã gần đạt một nửa, trong khi Llama tiếp tục thu hẹp xuống khoảng 12%.

Tốc độ giao nhau này vượt quá kỳ vọng của đa số mọi người. Hai năm trước, AI mã nguồn mở gần như tương đương với hệ sinh thái Llama của Meta. Các nhà phát triển toàn cầu tiến hành tinh chỉnh, triển khai và tạo sản phẩm dựa trên Llama. Bây giờ, điều tương tự đang tái diễn trên hệ sinh thái Qwen, nhưng với tốc độ nhanh hơn và phạm vi rộng hơn.

Điều này có nghĩa là các nhà phát triển toàn cầu ngày càng lựa chọn các mô hình Trung Quốc làm nền tảng cơ sở khi xây dựng ứng dụng AI. Không phải vì lập trường chính trị, mà vì hiệu năng và mức độ mở. Dòng Qwen 2.5 bao gồm các mô hình từ 0,5B đến 72B tham số, giúp nhà phát triển có thể tinh chỉnh và triển khai trên phần cứng của riêng mình mà không cần trả phí để gọi API từ OpenAI hay Anthropic. Mở nguồn đã xóa bỏ sự phụ thuộc vào nhà cung cấp và cũng xóa bỏ ranh giới quốc gia.

Một chi tiết đáng chú ý là, theo báo cáo của MIT Technology Review vào tháng 2, các công ty AI Trung Quốc đang tạo ra sự cạnh tranh khác biệt trong chiến lược mã nguồn mở. DeepSeek theo đuổi con đường hiệu quả chi phí tối đa, Kimi tập trung vào ngữ cảnh dài và khả năng mã hóa, trong khi Qwen hướng tới việc bao phủ toàn bộ tham số. Tình trạng phát triển song song nhiều hướng này đang làm phong phú thêm sự lựa chọn cho các nhà phát triển toàn cầu. Các mô hình mã nguồn mở của chúng tôi đang dùng thực lực để định nghĩa lại chuỗi cung ứng AI toàn cầu.

Nhưng đầu cuối của chuỗi cung ứng này trông như thế nào?

Ngày 19 tháng 3, nhà phát triển @fynnso đã phát hiện ID mô hình accounts/anysphere/models/kimi-k2p5-rl-0317-s515-fast trong mã Cursor. Sau đó, đồng sáng lập Cursor Aman Sanger thừa nhận Composer 2 được xây dựng dựa trên Kimi K2.5. Theo Lee Robinson, Phó chủ tịch của Cursor, “mô hình nền tảng chỉ đóng góp khoảng một phần tư lượng tính toán, phần còn lại đến từ việc huấn luyện của chính chúng tôi”. Nhưng nền tảng vẫn là nền tảng. Sản phẩm định giá 29,3 tỷ USD này sử dụng mô hình nền tảng từ Moonshot AI, một công ty Trung Quốc được Alibaba và Sequoia (HongShan) đầu tư.

Khi xem xét chuỗi phụ thuộc này cùng với các hành động của Lầu Năm Góc, tính phi lý trở nên rõ ràng hơn. Ngày 5 tháng 3, Lầu Năm Góc chính thức gán Anthropic là “rủi ro chuỗi cung ứng”. Theo NPR, lý do là CEO Anthropic, Dario Amodei, từ chối nhượng bộ trên hai đường đỏ: AI được sử dụng cho vũ khí tự chủ và giám sát quy mô lớn công dân Mỹ. Trump đã cho quân đội 6 tháng để loại bỏ Claude, trong khi Claude đã được tích hợp sâu vào các nền tảng quân sự và an ninh quốc gia. Sau đó, Anthropic đã kiện Lầu Năm Góc vào ngày 9 tháng 3.

Một bên, chính phủ Mỹ dán nhãn “rủi ro chuỗi cung ứng” lên các công ty trong nước, còn bên kia, 80% các công ty khởi nghiệp Mỹ đang vận hành theo mô hình Trung Quốc. Bên thứ nhất là cuộc chơi chính trị, bên thứ hai là thực tế công nghệ. Hai điều này không có điểm chung.

80% các công ty khởi nghiệp Mỹ đang vận hành theo mô hình Trung Quốc, và nhãn rủi ro của Lầu Năm Góc đã được dán lên một công ty Mỹ. Các biện pháp kiểm soát đang được tích lũy từng lớp ở cấp phần cứng, trong khi sự phụ thuộc đang âm thầm phát triển ở cấp phần mềm. Bên kia bức tường chip ba năm, một sự thật mới đang hình thành: AI nguồn mở Trung Quốc đã không còn là “người theo sau”, mà là nhà cung cấp cơ sở hạ tầng AI toàn cầu.

Nhấp để tìm hiểu các vị trí đang tuyển của BlockBeats

Chào mừng bạn tham gia cộng đồng chính thức của律动 BlockBeats:

Nhóm đăng ký Telegram: https://t.me/theblockbeats

Nhóm trò chuyện Telegram: https://t.me/BlockBeats_App

Tài khoản chính thức trên Twitter: https://twitter.com/BlockBeatsAsia