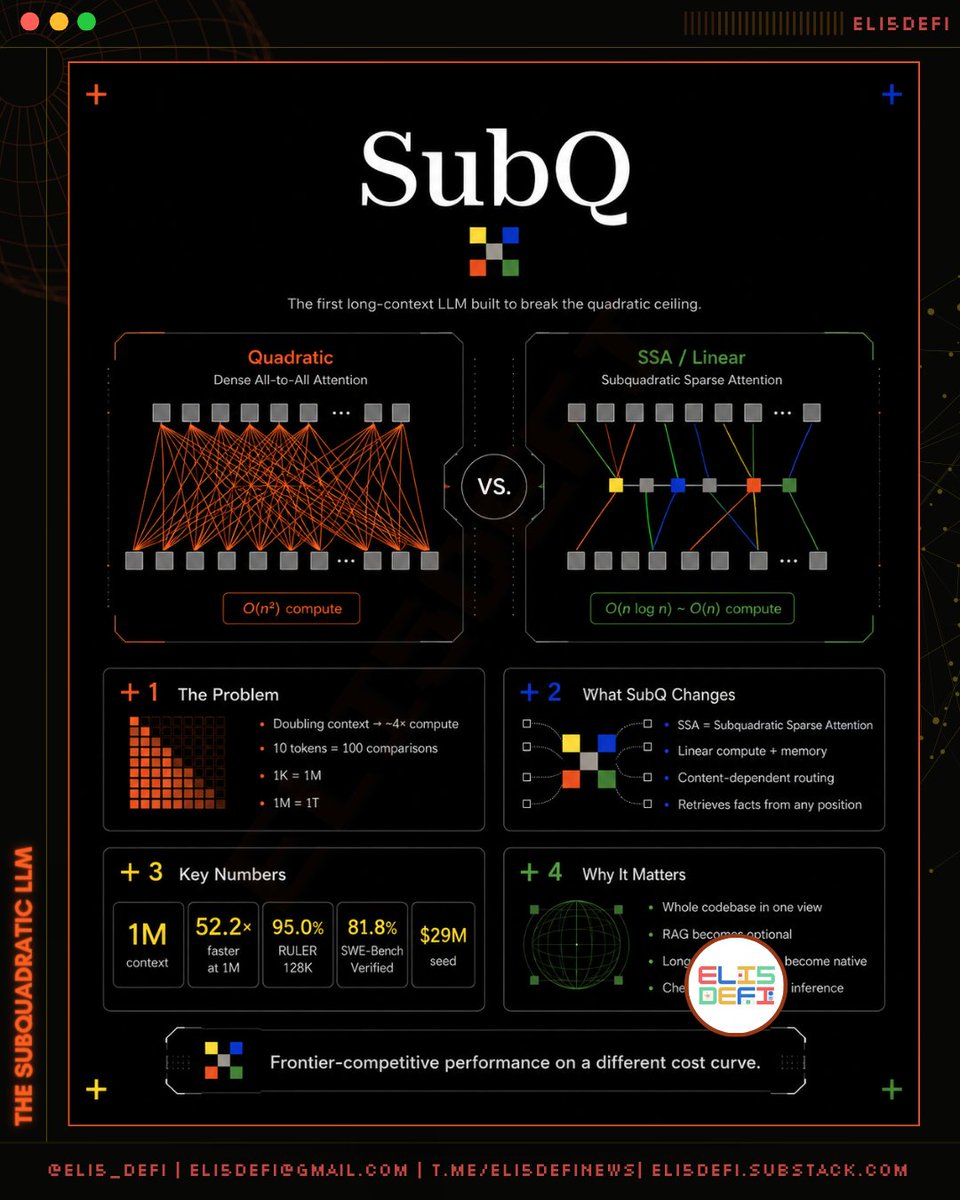

Sebuah syarikat AI baharu bernama @subquadratic baru sahaja melancarkan model yang memecahkan salah satu had paling lama dalam AI moden. Untuk memahami mengapa ia penting, anda perlu memahami satu masalah matematik yang secara senyap membentuk setiap chatbot yang pernah anda gunakan. - ➠ Masalahnya: AI Membaca dalam Pasangan, dan Pasangan Tidak Boleh Diskalakan Setiap LLM moden (ChatGPT, Claude, Gemini) membaca teks dengan memeriksa bagaimana setiap perkataan berkaitan dengan setiap perkataan lain. Ini kelihatan baik sehingga anda melakukan pengiraan: ▸ 10 perkataan → 100 perbandingan ▸ 1,000 perkataan → 1 juta perbandingan ▸ 1 juta perkataan → 1 trilion perbandingan Menggandakan input tidak menggandakan kerja. Ia mengkuadratkan ia. Ini dipanggil penskalaan kuadratik, dan ia telah dijadikan sebahagian daripada AI sejak 2017. Apa maksudnya untuk anda: ▸ Dokumen panjang menjadi mahal dengan cepat ▸ Model sering melewatkan fakta yang tersembunyi dalam input panjang ▸ Seluruh kod atau pustaka penyelidikan tidak muat Sekarang anda tahu mengapa, semakin panjang konteks, semakin bodoh dan mahal LLM anda menjadi. - ➠ Bagaimana AI Hari Ini Menyembunyikan Masalah Ini Industri membina penyelesaian sementara alih-alih memperbaiki matematiknya: ▸ RAG: enjin carian mengambil beberapa petikan relevan, dan hanya memberikan itu kepada model ▸ Pemotongan: dokumen panjang dipotong kepada bahagian-bahagian kecil ▸ Sistem agen: beberapa panggilan AI menangani bahagian-bahagian berbeza, disambung bersama dengan kod ▸ FlashAttention: trik memori pintar yang membuat pengiraan mahal yang sama berjalan lebih pantas Semua ini berfungsi, tetapi tiada satupun memperbaiki masalah sebenar. Seluruh tatanan AI moden (database vektor, saluran pengambilan, kejuruteraan prompt) wujud kerana model tidak boleh menangkap keseluruhan konteks dalam pandangan sekali gus. — ➠ Apa yang SubQ Lakukan Secara Berbeza SubQ menggunakan pendekatan baharu dipanggil SSA (Subquadratic Sparse Attention). Gagasan ini dalam satu ayat: alih-alih membandingkan setiap perkataan dengan setiap perkataan lain, model menentukan perkataan mana yang benar-benar penting untuk soalan itu, dan mengabaikan yang lain. Ini menukar penskalaan daripada kuadratik kepada linear. Menggandakan input kini menggandakan kerja, bukan mengkuadratkannya. Bahagian sukar bukanlah idea itu, kerana orang telah mencuba ini sebelum ini. Setiap percubaan sebelumnya mengorbankan sesuatu: ketepatan, keupayaan untuk mencari fakta yang tersembunyi jauh di dalam teks, atau kecekapan itu sendiri. Subquadratic, yang diasaskan bersama oleh @alex_whedon, mengeklaim mereka akhirnya menyelesaikan ketiga-tiga perkara ini secara serentak. — ➠ Bukti-Bukti Ujian disahkan pihak ketiga: ▸ Sama dengan Claude Opus 4.6 pada RULER 128K (uji kaji penalaran konteks panjang) ▸ Mengalahkan Opus 4.7, GPT 5.4, dan Gemini 3.1 Pro pada MRCR v2 (pengambilan bukti pelbagai), tetapi kalah kepada Opus 4.6 dan GPT 5.5 ▸ Mengalahkan Opus 4.6 dan Gemini 3.1 Pro pada SWE-Bench (tugasan pengaturcaraan sebenar), tertinggal dari Opus 4.7 ▸ 52× lebih pantas daripada FlashAttention pada 1 juta token ▸ Versi penyelidikan mampu menangani 12 juta token dengan kira-kira 1,000× kurang pengiraan perhatian berbanding model terkini lain Dengan ringkasnya, ini bukan "model terbaik di dunia." Ia adalah ketepatan tahap terkini dengan kos yang jauh lebih rendah. — ➠ Di Mana Sam Altman Masuk Dua dakwaan utama Altman secara terbuka menunjuk kepada masalah yang sama yang sedang dipecahkan oleh SubQ. Berkenaan kos: Dalam posting blog Februari 2025 bertajuk Three Observations, Altman menulis bahawa kos penggunaan AI turun kira-kira 10× setiap 12 bulan. Dia menyebutnya sebagai "lebih kuat secara luar biasa" berbanding Hukum Moore. Tesisnya: inferens yang lebih murah adalah kekuatan utama yang membentuk apa yang boleh menjadi AI. Berkenaan saiz: Kembali ke tahun 2023, Altman berkata era model yang semakin besar telah berakhir, dan persaingan sebenar adalah kemampuan per dolar. Dia membandingkan perlumbaan jumlah parameter dengan perlumbaan GHz pada cip tahun 1990-an. Paksi yang salah. SubQ mengambil kedua-dua teka-teki ini secara harfiah. Tagline mereka ialah Kecekapan adalah kecerdasan. Tetapi: Jalan yang dinyatakan Altman untuk AI yang lebih murah adalah kemajuan peranti keras, pengoptimuman perisian, dan distilasi model. Beliau belum menyokong secara terbuka reka bentuk semula matematik perhatian itu sendiri. Jadi, tawaran SubQ selari dengan ekonominya, tetapi ia juga merupakan teka-teki bahawa makmal besar meninggalkan dolar reka bentuk di atas meja. — ➠ Mengapa Ini Penting Jika SubQ berjaya pada skala pengeluaran: ▸ Kod sebagai satu perbualan tunggal. Tiada lagi sistem agen pelbagai yang menguruskan fail. Model menyimpan seluruh repositori. ▸ RAG menjadi pilihan. Banyak infrastruktur AI hari ini wujud untuk mengimbangi had kuadratik. Buang had itu, dan kerangka kerja menjadi beban. ▸ Agen jangka panjang berhenti menjadi trik. Sesi berhari-hari dengan ingatan kekal menjadi asli. ▸ Aplikasi baharu menjadi mungkin. Beban kerja yang terlalu mahal (ulasan dokumen penuh, carian kod menyeluruh, pemindaian kesesuaian) menjadi biasa. — ➠ Catatan Jujur ▸ Ia masih dalam beta peribadi. Kebolehpercayaan dunia nyata belum diuji tekanan. Jadi sehingga itu berlaku, anggap pengumuman ini sebagai teka-teka, walaupun ramai bimbang ia hanya tindakan performans. ▸ Skor MRCR v2 (65.9%) bagus tetapi tertinggal daripada Opus 4.6 (78.3%) dan GPT 5.5 (74%). SSA lebih cekap, bukan secara mutlak lebih cekap. ▸ Ujian diterbitkan sendiri dengan pengesahan pihak ketiga. Peniruan akademik adalah ujian sebenar. ▸ Keputusan 12juta token adalah model penyelidikan, bukan produk siap (yang 1juta). — ➠ Kesimpulan Selama sembilan tahun, setiap AI berasaskan transformer telah membayar cukai kuadratik yang sama. Subquadratic mengeklaim mereka akhirnya menemui cara untuk tidak membayarnya. Ujian menunjukkan mereka sekurang-kurangnya berada di arah yang betul. Altman telah memberitahu industri selama tiga tahun bahawa kemampuan per dolar adalah medan pertempuran baharu. SubQ adalah salah satu syarikat pertama yang cuba memenangi pertarungan ini dengan mengubah matematik asasnya, bukan menimbun penyelesaian sementara. Samada mereka berjaya atau tidak kini menjadi soal empirikal awam.

Kongsi

Sumber:Tunjukkan artikel asal

Penafian: Maklumat yang terdapat pada halaman ini mungkin telah diperoleh daripada pihak ketiga dan tidak semestinya menggambarkan pandangan atau pendapat KuCoin. Kandungan ini adalah disediakan bagi tujuan maklumat umum sahaja, tanpa sebarang perwakilan atau waranti dalam apa jua bentuk, dan juga tidak boleh ditafsirkan sebagai nasihat kewangan atau pelaburan. KuCoin tidak akan bertanggungjawab untuk sebarang kesilapan atau pengabaian, atau untuk sebarang akibat yang terhasil daripada penggunaan maklumat ini.

Pelaburan dalam aset digital boleh membawa risiko. Sila menilai risiko produk dan toleransi risiko anda dengan teliti berdasarkan keadaan kewangan anda sendiri. Untuk maklumat lanjut, sila rujuk kepada Terma Penggunaan dan Pendedahan Risiko kami.