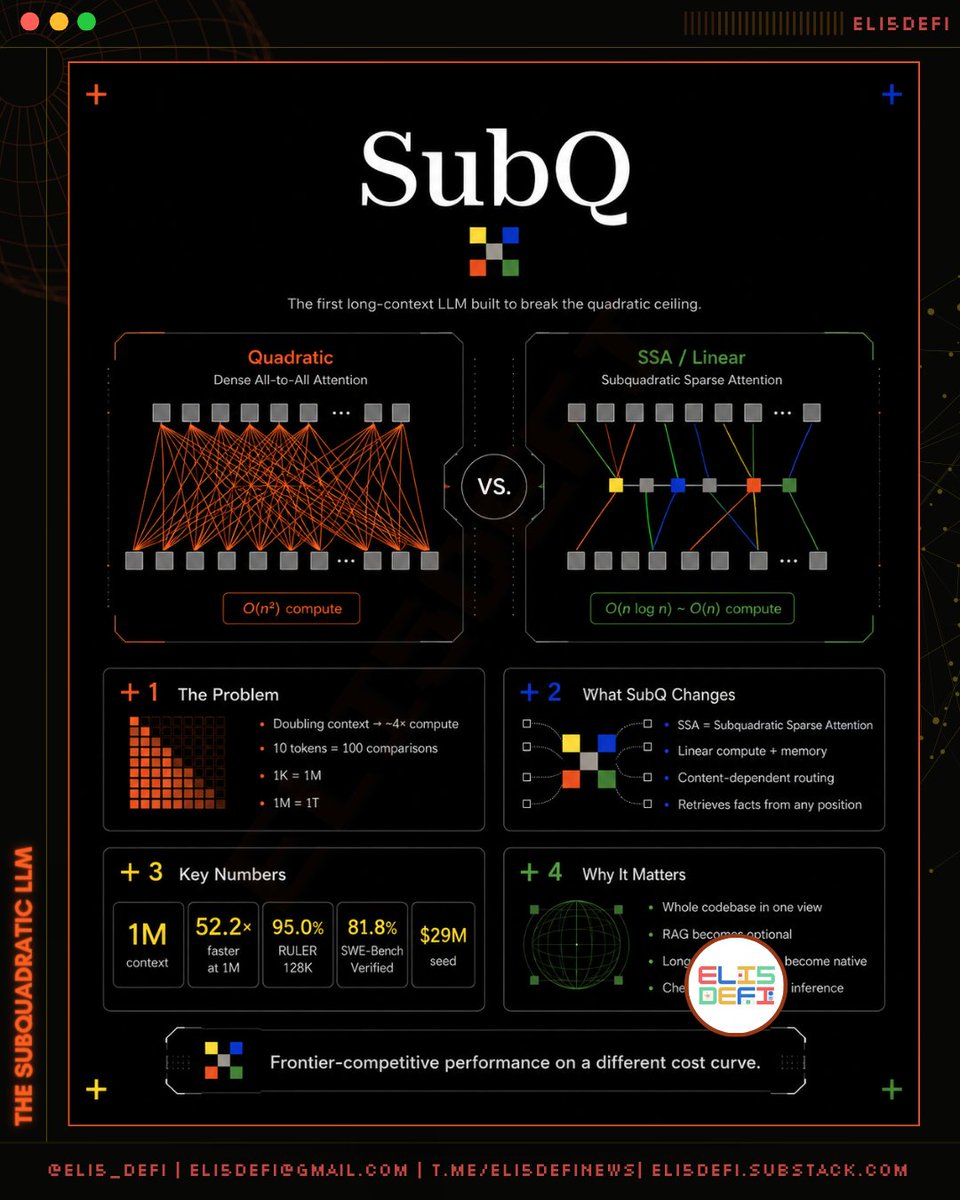

@subquadratic नाम की एक नई AI कंपनी ने अभी-अभी ऐसा मॉडल जारी किया है जिसने आधुनिक AI की सबसे पुरानी सीमाओं में से एक को तोड़ दिया है। यह क्यों मायने रखता है, इसे समझने के लिए आपको एक अकेली गणित की समस्या समझनी होगी, जो चुपचाप हर उस चैटबॉट को आकार दे रही है जिसे आपने कभी इस्तेमाल किया है। - ➠ समस्या: AI जोड़ों में पढ़ती है, और जोड़े स्केल नहीं होते हर आधुनिक LLM (ChatGPT, Claude, Gemini) टेक्स्ट को यह देखकर पढ़ती है कि हर शब्द हर दूसरे शब्द से कैसे संबंधित है। यह सुनने में ठीक लगता है जब तक कि आप गणित नहीं करते: ▸ 10 शब्द → 100 तुलना ▸ 1,000 शब्द → 1 मिलियन तुलना ▸ 1 मिलियन शब्द → 1 ट्रिलियन तुलना इनपुट को दोगुना करना काम को दोगुना नहीं करता। यह उसे चार गुना कर देता है। इसे quadratic scaling कहा जाता है, और यह 2017 से AI में जड़ जमाए हुए है। आपके लिए इसका मतलब: ▸ लंबे दस्तावेज़ बहुत जल्दी महंगे हो जाते हैं ▸ मॉडल अक्सर लंबे इनपुट में गहराई में छिपे तथ्यों को मिस कर देते हैं ▸ पूरी codebases या research libraries फिट नहीं हो पातीं अब आप जानते हैं कि क्यों, जितना लंबा context होता है, आपके LLM उतने ही कमज़ोर और महंगे होते जाते हैं। - ➠ आज की AI इस समस्या को कैसे छुपाती है इंडस्ट्री ने गणित को ठीक करने की बजाय उसके लिए workarounds बनाए: ▸ RAG: एक सर्च इंजन कुछ संबंधित snippets निकालता है और केवल वही मॉडल को देता है ▸ Chunking: लंबे दस्तावेज़ों को छोटे हिस्सों में काट दिया जाता है ▸ Agent systems: कई AI कॉल अलग-अलग हिस्से संभालते हैं, जिन्हें कोड के ज़रिए जोड़ा जाता है ▸ FlashAttention: मेमोरी की चतुर तरकीबें जो वही महंगा गणित तेज़ी से चलाती हैं ये काम तो करती हैं, लेकिन इनमें से कोई भी असली समस्या को हल नहीं करती। पूरा आधुनिक AI stack (vector databases, retrieval pipelines, prompt engineering) इसलिए मौजूद है क्योंकि मॉडल पूरे डेटा को एक साथ नजर में नहीं रख सकते। — ➠ SubQ अलग क्या करता है SubQ एक नए तरीके का इस्तेमाल करता है जिसे SSA (Subquadratic Sparse Attention) कहा जाता है। एक वाक्य में आइडिया: हर शब्द की हर दूसरे शब्द से तुलना करने की बजाय, मॉडल पहले यह पता लगाता है कि सवाल के लिए वास्तव में कौन से शब्द मायने रखते हैं, और बाकी को नज़रअंदाज़ कर देता है। यह scaling को quadratic से linear में बदल देता है। अब इनपुट को दोगुना करने से काम भी दोगुना होता है, चार गुना नहीं। कठिन हिस्सा आइडिया नहीं है, क्योंकि लोग पहले भी यह कोशिश कर चुके हैं। पहले की हर कोशिश में कुछ न कुछ कुर्बान करना पड़ा: या तो accuracy, या टेक्स्ट में बहुत पीछे दबे तथ्यों को ढूंढने की क्षमता, या खुद efficiency। Subquadratic, जिसकी सह-स्थापना @alex_whedon ने की है, दावा करता है कि उन्होंने एक साथ ये तीनों चीज़ें हल कर ली हैं। — ➠ प्रमाण थर्ड-पार्टी सत्यापित benchmarks: ▸ RULER 128K (एक long-context reasoning टेस्ट) पर Claude Opus 4.6 के बराबर ▸ MRCR v2 (multi-evidence retrieval) पर Opus 4.7, GPT 5.4, और Gemini 3.1 Pro को हराता है, लेकिन Opus 4.6 और GPT 5.5 से पीछे रहता है ▸ SWE-Bench (वास्तविक coding tasks) पर Opus 4.6 और Gemini 3.1 Pro से बेहतर, Opus 4.7 से पीछे ▸ 1 मिलियन tokens पर FlashAttention से 52× तेज़ ▸ एक research version 12 मिलियन tokens संभालता है, अन्य frontier models की तुलना में लगभग 1,000× कम attention compute के साथ संक्षेप में कहें तो, यह "दुनिया का सबसे अच्छा मॉडल" नहीं है। यह frontier-स्तर की accuracy है, एक मूल रूप से सस्ती cost curve पर। — ➠ यहाँ Sam Altman कहाँ आते हैं Altman के दो सबसे बड़े सार्वजनिक दावे उसी समस्या की ओर इशारा करते हैं जिसे SubQ हल कर रहा है। Cost पर: फरवरी 2025 के अपने ब्लॉग पोस्ट Three Observations में Altman ने लिखा कि AI का इस्तेमाल करने की लागत हर 12 महीने में लगभग 10× गिरती है। उन्होंने इसे Moore's Law से "अविश्वसनीय रूप से ज़्यादा मज़बूत" कहा। उनका सिद्धांत: सस्ता inference वह प्रमुख ताकत है जो तय करेगी AI क्या बन सकता है। Size पर: 2023 से ही Altman कह रहे हैं कि बड़े और बड़े मॉडल का दौर खत्म हो रहा है, और असली प्रतियोगिता है capability per dollar। उन्होंने parameter count की दौड़ की तुलना 1990s के chips में GHz race से की। गलत axis। SubQ इन दोनों दांवों को शब्दशः लेता है। उनका टैगलाइन है Efficiency is intelligence. पेंच यह है: Altman के अनुसार सस्ती AI का रास्ता है hardware प्रगति, software optimization, और model distillation। उन्होंने attention के गणित को दोबारा डिज़ाइन करने का सार्वजनिक रूप से समर्थन नहीं किया है। तो SubQ की pitch उनकी economics के साथ तो मेल खाती है, लेकिन यह यह भी दांव है कि बड़ी लैब्स मेज़ पर एक architectural dollar छोड़ गई हैं। — ➠ यह क्यों मायने रखता है अगर SubQ production scale पर deliver करता है: ▸ Codebases एक ही बातचीत की तरह। अब फाइलों को juggling करते multi-agent systems की ज़रूरत नहीं। मॉडल पूरा repo पकड़कर रखता है। ▸ RAG वैकल्पिक हो जाता है। आज की बहुत सी AI infrastructure quadratic ceiling की भरपाई के लिए बनी है। जब ceiling हटा देंगे, तो scaffolding बोझ बन जाएगी। ▸ Long-running agents एक hack होना बंद हो जाते हैं। persistent memory के साथ कई दिनों तक चलने वाले sessions स्वाभाविक हो जाते हैं। ▸ नई apps संभव हो जाती हैं। जो workloads अभी तक बहुत महंगे थे (पूरे दस्तावेज़ की समीक्षा, exhaustive code search, compliance scanning), वे रोजमर्रा के काम बन जाते हैं। — ➠ ईमानदार caveats ▸ यह private beta में है। वास्तविक दुनिया में reliability का अभी stress-test नहीं हुआ है। इसलिए तब तक इस घोषणा को एक teaser की तरह लें, भले ही कई लोग चिंतित हों कि यह सिर्फ performative act भर है। ▸ MRCR v2 स्कोर (65.9%) अच्छा है लेकिन Opus 4.6 (78.3%) और GPT 5.5 (74%) से पीछे है। SSA ज़्यादा efficient है, ज़रूरी नहीं कि ज़्यादा capable हो। ▸ Benchmarks self-published हैं, जिनकी third-party verification हुई है। असली परीक्षा है academic replication। ▸ 12M-token का परिणाम एक research model से है, न कि shipping product से (जो 1M है)। — ➠ Bottom Line पिछले नौ सालों से हर transformer‑based AI ने एक ही quadratic टैक्स चुकाया है। Subquadratic दावा करता है कि उन्होंने आखिरकार इसे न चुकाने का तरीका ढूंढ लिया है। Benchmarks इशारा करते हैं कि कम से कम दिशा सही लगती है। Altman तीन साल से इंडस्ट्री से कह रहे हैं कि capability per dollar नया battleground है। SubQ उन पहली कंपनियों में से है जो workarounds की परतें जोड़ने की बजाय, underlying math बदलकर यह लड़ाई जीतने की कोशिश कर रही हैं। यह वे कर पाते हैं या नहीं, अब एक सार्वजनिक empirical सवाल है।

साझा करें

स्रोत:मूल दिखाएं

डिस्क्लेमर: इस पेज पर दी गई जानकारी थर्ड पार्टीज़ से प्राप्त की गई हो सकती है और यह जरूरी नहीं कि KuCoin के विचारों या राय को दर्शाती हो। यह सामग्री केवल सामान्य सूचनात्मक उद्देश्यों के लिए प्रदान की गई है, किसी भी प्रकार के प्रस्तुतीकरण या वारंटी के बिना, न ही इसे वित्तीय या निवेश सलाह के रूप में माना जाएगा। KuCoin किसी भी त्रुटि या चूक के लिए या इस जानकारी के इस्तेमाल से होने वाले किसी भी नतीजे के लिए उत्तरदायी नहीं होगा।

डिजिटल संपत्तियों में निवेश जोखिम भरा हो सकता है। कृपया अपनी वित्तीय परिस्थितियों के आधार पर किसी प्रोडक्ट के जोखिमों और अपनी जोखिम सहनशीलता का सावधानीपूर्वक मूल्यांकन करें। अधिक जानकारी के लिए, कृपया हमारे उपयोग के नियम और जोखिम प्रकटीकरण देखें।