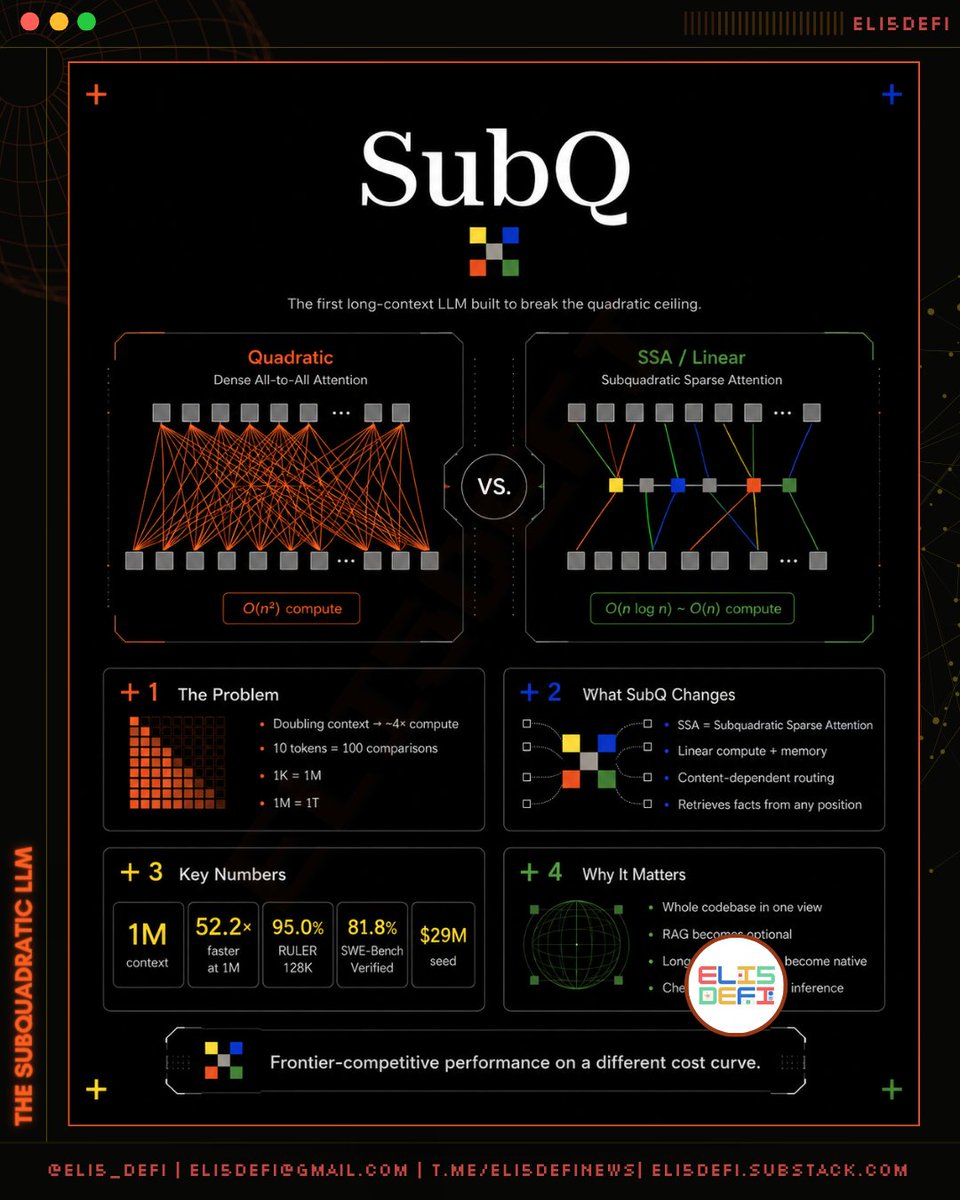

Une nouvelle entreprise d’IA appelée @subquadratic vient de publier un modèle qui brise l’une des plus anciennes limites de l’IA moderne. Pour comprendre pourquoi cela compte, vous devez comprendre un seul problème mathématique qui a silencieusement façonné chaque chatbot que vous avez jamais utilisé. — ➠ Le problème : L’IA lit par paires, et les paires ne se scalent pas Chaque LLM moderne (ChatGPT, Claude, Gemini) lit le texte en vérifiant comment chaque mot se rapporte à chaque autre mot. Cela semble acceptable… jusqu’à ce que vous fassiez les calculs : ▸ 10 mots → 100 comparaisons ▸ 1 000 mots → 1 million de comparaisons ▸ 1 million de mots → 1 billion de comparaisons Doublar l’entrée ne double pas le travail. Il le quadruple. C’est ce qu’on appelle la mise à l’échelle quadratique, et elle est intégrée à l’IA depuis 2017. Ce que cela signifie pour vous : ▸ Les documents longs deviennent rapidement coûteux ▸ Les modèles manquent souvent des faits enfouis profondément dans les entrées longues ▸ Des bases de code entières ou des bibliothèques de recherche ne tiennent pas Maintenant, vous savez pourquoi plus le contexte est long, plus vos LLM deviennent stupides et coûteux. — ➠ Comment l’IA d’aujourd’hui cache le problème L’industrie a construit des contournements au lieu de corriger la mathématique : ▸ RAG : un moteur de recherche récupère quelques extraits pertinents, et n’envoie que ceux-ci au modèle ▸ Fragmentation : les documents longs sont découpés en petits morceaux ▸ Systèmes d’agents : plusieurs appels IA gèrent différentes parties, reliés entre eux par du code ▸ FlashAttention : des astuces mémoire ingénieuses qui font fonctionner plus vite la même mathématique coûteuse Ces solutions fonctionnent, mais aucune ne corrige le problème réel. Toute la pile IA moderne (bases de vecteurs, pipelines de récupération, ingénierie de prompts) existe parce que les modèles ne peuvent pas simplement tenir tout le contenu en vue. — ➠ Ce que SubQ fait différemment SubQ utilise une nouvelle approche appelée SSA (Subquadratic Sparse Attention). L’idée en une phrase : au lieu de comparer chaque mot à chaque autre mot, le modèle identifie quels mots sont réellement pertinents pour la question, et ignore le reste. Cela change la mise à l’échelle de quadratique à linéaire. Doubler l’entrée double maintenant le travail au lieu de le quadrupler. La difficulté n’est pas dans l’idée, car des gens ont déjà essayé cela auparavant. Chaque tentative précédente a sacrifié quelque chose : soit la précision, soit la capacité à trouver des faits enfouis loin dans le texte, soit l’efficacité elle-même. Subquadratic, cofondée par @alex_whedon, affirme avoir enfin résolu les trois en même temps. — ➠ Les preuves Benchmarks vérifiés par des tiers : ▸ Égalité avec Claude Opus 4.6 sur RULER 128K (un test de raisonnement sur contexte long) ▸ Supérieur à Opus 4.7, GPT 5.4 et Gemini 3.1 Pro sur MRCR v2 (récupération multi-preuves), mais inférieur à Opus 4.6 et GPT 5.5 ▸ Supérieur à Opus 4.6 et Gemini 3.1 Pro sur SWE-Bench (tâches de codage réelles), mais derrière Opus 4.7 ▸ 52× plus rapide que FlashAttention à 1 million de jetons ▸ Une version de recherche gère 12 millions de jetons avec environ 1 000× moins de calcul d’attention que les autres modèles de pointe Pour résumer : ce n’est pas « le meilleur modèle au monde ». C’est une précision de niveau frontière à un coût fondamentalement plus bas. — ➠ Où Sam Altman entre en jeu Deux des plus grandes déclarations publiques d’Altman pointent vers le même problème que SubQ résout. Sur le coût : Dans son article de février 2025 « Three Observations », Altman a écrit que le coût d’utilisation de l’IA diminue d’environ 10× tous les 12 mois. Il a qualifié cela de « incroyablement plus fort » que la loi de Moore. Sa thèse : l’inference moins chère est la force dominante qui façonne ce que l’IA peut devenir. Sur la taille : Remontant à 2023, Altman a déclaré que l’ère des modèles de plus en plus grands est terminée, et que la véritable concurrence est la capacité par dollar. Il a comparé la course aux paramètres à la course aux GHz dans les puces des années 90. Le mauvais axe. SubQ prend ces deux paris au sérieux. Leur slogan est : « L’efficacité est l’intelligence ». Le hic : Le chemin déclaré par Altman vers une IA moins chère repose sur les progrès matériels, l’optimisation logicielle et la distillation des modèles. Il n’a pas publiquement endossé la refonte de la mathématique d’attention elle-même. Ainsi, la proposition de SubQ s’aligne sur son économie, mais c’est aussi un pari selon lequel les grands laboratoires ont laissé un dollar architectural sur la table. — ➠ Pourquoi cela compte Si SubQ réussit à grande échelle : ▸ Des bases de code comme une seule conversation. Plus besoin de systèmes multi-agents qui gèrent des fichiers. Le modèle garde tout le dépôt en mémoire. ▸ RAG devient optionnel. Une grande partie de l’infrastructure IA actuelle existe pour compenser la limite quadratique. Enlever cette limite, c’est transformer les échafaudages en bagage. ▸ Les agents à long terme cessent d’être un contournement. Des sessions durant des jours avec mémoire persistante deviennent natives. ▸ De nouvelles applications deviennent possibles. Des charges de travail trop coûteuses (revue complète de documents, recherche exhaustive dans le code, analyse de conformité) deviennent courantes. — ➠ Les mises en garde honnêtes ▸ Le modèle est en bêta privé. Sa fiabilité en conditions réelles n’a pas encore été testée. Jusqu’à preuve du contraire, traitez cette annonce comme une teaser, même si beaucoup craignent qu’il ne s’agisse que d’un acte performant. ▸ Le score MRCR v2 (65,9 %) est bon, mais inférieur à Opus 4.6 (78,3 %) et GPT 5.5 (74 %). SSA est plus efficace, pas strictement plus performante. ▸ Les benchmarks sont publiés par les auteurs avec vérification tierce. La réplication académique est le vrai test. ▸ Le résultat à 12M de jetons concerne un modèle de recherche, pas le produit final (qui est à 1M). — ➠ Conclusion Depuis neuf ans, chaque IA basée sur un transformer paie le même impôt quadratique. Subquadratic affirme avoir enfin trouvé comment ne plus le payer. Les benchmarks suggèrent qu’ils sont au moins dans la bonne direction. Altman dit à l’industrie depuis trois ans que la capacité par dollar est le nouveau champ de bataille. SubQ est l’une des premières entreprises à tenter de gagner ce combat en changeant la mathématique fondamentale, plutôt qu’en empilant des contournements. Que réussissent-ils ou non est désormais une question empirique publique.

Partager

Source:Afficher l'original

Clause de non-responsabilité : les informations sur cette page peuvent avoir été obtenues auprès de tiers et ne reflètent pas nécessairement les points de vue ou opinions de KuCoin. Ce contenu est fourni à titre informatif uniquement, sans aucune représentation ou garantie d’aucune sorte, et ne doit pas être interprété comme un conseil en investissement. KuCoin ne sera pas responsable des erreurs ou omissions, ni des résultats résultant de l’utilisation de ces informations.

Les investissements dans les actifs numériques peuvent être risqués. Veuillez évaluer soigneusement les risques d’un produit et votre tolérance au risque en fonction de votre propre situation financière. Pour plus d’informations, veuillez consulter nos conditions d’utilisation et divulgation des risques.