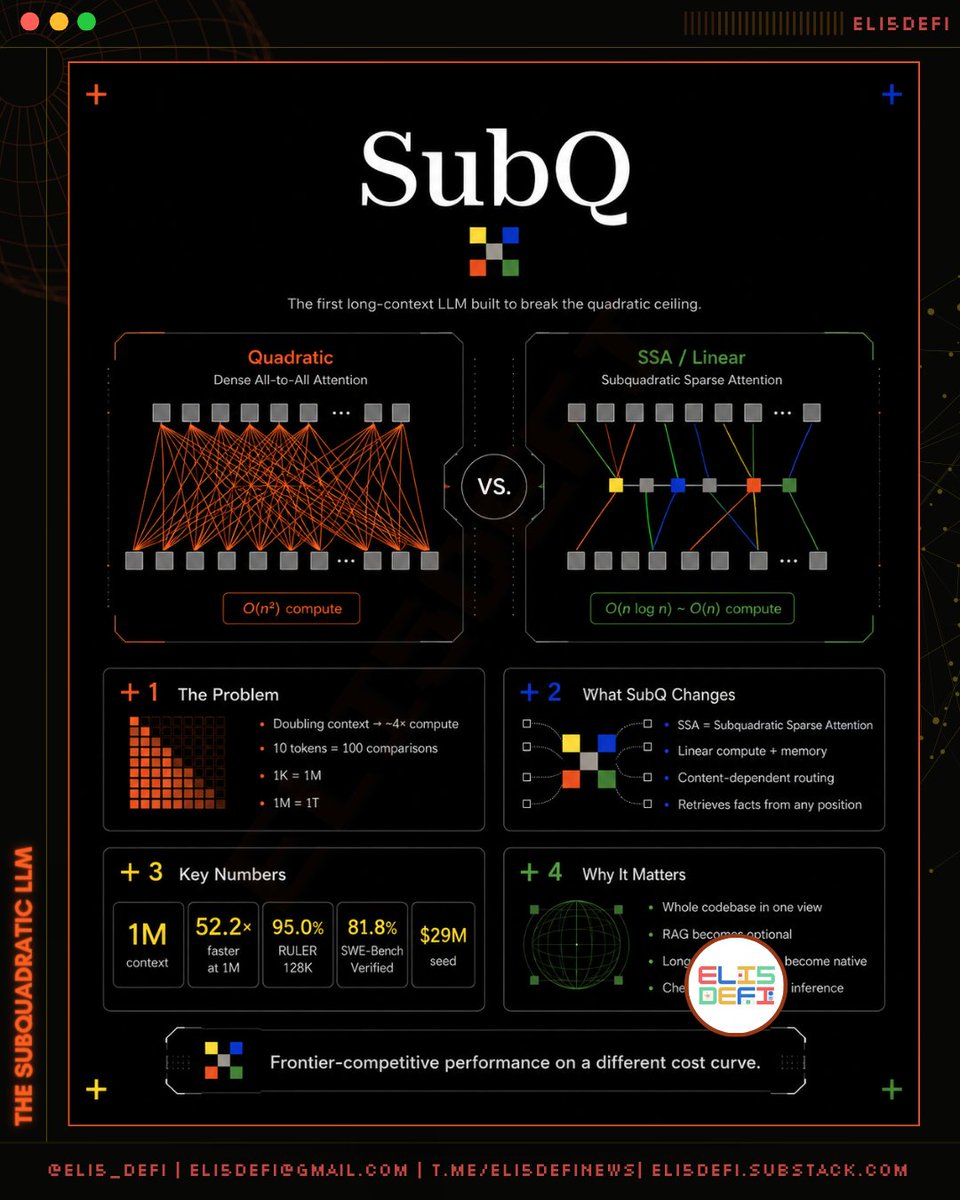

Isang bagong kumpanya sa AI na tinatawag na @subquadratic ay naglabas ng isang modelo na nagbubrake sa isa sa pinakamatandang limitasyon sa modernong AI. Upang maunawaan kung bakit ito mahalaga, kailangan mong maunawaan ang isang solong matematikal na problema na nakakapagpapabago nang tahimik sa bawat chatbot na iyong ginamit. — ➠ Ang Problema: Binabasa ng AI ang mga Pares, at Hindi Nakakascale ang mga Pares Ang bawat modernong LLM (ChatGPT, Claude, Gemini) ay binabasa ang teksto sa pamamagitan ng pag-check kung paano nauugnay ang bawat salita sa bawat iba pang salita. Mukhang maayos ito hanggang sa gawin mo ang pagkalkula: ▸ 10 salita → 100 komparasyon ▸ 1,000 salita → 1 milyong komparasyon ▸ 1 milyong salita → 1 trilyong komparasyon Ang pag-doble ng input ay hindi nagdoble ng trabaho. Ito ay nagquadruple nito. Ito ay tinatawag na quadratic scaling, at ito ay nakapaloob sa AI mula pa noong 2017. Ano ang ibig sabihin nito para sa iyo: ▸ Mabilis na nagiging mahal ang mga mahabang dokumento ▸ Madalas na nalilimutan ng mga modelo ang mga katotohanang nakatago sa malalim na mga input ▸ Hindi makakapasok ang buong codebases o mga librerya ng pananaliksik Ngayon ay alam mo na kung bakit mas maliit at mas mahal ang iyong LLMs habang mas mahaba ang konteksto. — ➠ Paano Ikinukubli ng Kasalukuyang AI ang Problema Ang industriya ay bumuo ng mga workaround kesa sa pagpapabuti ng matematika: ▸ RAG: isang search engine ang nagsasagot ng ilang makabuluhang snippet, at binibigay lamang ang mga iyon sa modelo ▸ Chunking: hinahati ang mga mahabang dokumento sa maliliit na piraso ▸ Agent systems: maraming AI calls ang gumagawa ng iba’t ibang bahagi, pinagsasama-sama sa pamamagitan ng code ▸ FlashAttention: mga matalinong trick sa memorya na ginagawang mas mabilis ang magkakaugnay na matematika Nakakatulong sila, ngunit wala sa kanila ang nagpapabuti sa tunay na problema. Ang buong modernong AI stack (vector databases, retrieval pipelines, prompt engineering) ay umiiral dahil hindi kayang hawakan ng mga modelo ang buong bagay nang sabay-sabay. — ➠ Ano ang Iba’t Iba ng SubQ Gumagamit ang SubQ ng isang bagong paraan na tinatawag na SSA (Subquadratic Sparse Attention). Ang ideya sa isang pangungusap: sa halip na ikumpara ang bawat salita sa bawat iba pang salita, nakakakita ang modelo kung aling mga salita ang tunay na mahalaga para sa tanong, at iniisip ang iba pa. Ito ay nagbabago ang scaling mula sa quadratic patungo sa linear. Ang pag-doble ng input ay nagdoble ng trabaho, hindi nagquadruple nito. Ang hirap ay hindi nasa ideya dahil sinubukan na ito noon. Ang lahat ng dating pagsubok ay nag-iwan ng isang bagay: o accuracy, o kakayahang makahanap ng mga katotohanan na nakatago malayo sa teksto, o efficiency mismo. Sinasabi ni Subquadratic, na itinatag ni @alex_whedon, na sila ay nakakapagtapos ng lahat ng tatlo nang sabay-sabay. — ➠ Ang Patunay Mga benchmark na binigyang-kariktan ng third-party: ▸ Nagtutulungan kay Claude Opus 4.6 sa RULER 128K (isang pagsubok sa pag-iisip sa mahabang konteksto) ▸ Nanalo kay Opus 4.7, GPT 5.4, at Gemini 3.1 Pro sa MRCR v2 (multi-evidence retrieval), ngunit natatalo kay Opus 4.6 at GPT 5.5 ▸ Nanalo kay Opus 4.6 at Gemini 3.1 Pro sa SWE-Bench (mga totoong coding tasks), ngunit natatalo kay Opus 4.7 ▸ 52× mas mabilis kaysa FlashAttention sa 1 milyong tokens ▸ Ang isang bersyon ng pananaliksik ay nakakahawak ng 12 milyong tokens gamit ang halos 1,000× mas kaunting attention compute kaysa sa iba pang frontier models Para maipaliwanag nang maikli, ito ay hindi “pinakamahusay na modelo sa mundo.” Ito ay frontier-level accuracy sa isang mas murang cost curve. — ➠ Kung Saan Dumating si Sam Altman Dalawa sa pinakamalaking pahayag ni Altman ay tumutukoy sa parehong problema na sinusolusyon ni SubQ. Tungkol sa gastos: Sa kanyang blog post noong Pebrero 2025 na “Three Observations,” sinabi ni Altman na bumababa ang gastos ng paggamit ng AI nang halos 10× bawat 12 buwan. Tinawag niya ito bilang “hindi maniwala” kaysa kay Moore’s Law. Ang kanyang teorya: mas mura ang inference ay ang pangunahing puwersa na nagpapabago kung ano ang maaaring maging AI. Tungkol sa laki: Mula pa noong 2023, sinabi ni Altman na natapos na ang panahon ng mas malalaking modelo, at ang tunay na pakikipagkumpetensya ay capability per dollar. Ipinaghambing niya ang labanan ng parameter count sa labanan ng GHz noong mga 1990s chips. Wrong axis. Ginagawa ng SubQ nang literal ang dalawang paniniwala na ito. Ang kanilang slogan ay “Efficiency is intelligence.” Ang kulang: Ang inilahad ni Altman na daan patungo sa mas mura AI ay hardware progress, software optimization, at model distillation. Hindi niya pinaliwanag nang pampubliko ang pagbabago mismo sa attention math. Kaya ang pitch ng SubQ ay tumutugma sa kanyang ekonomiks, pero ito rin ay isang paniniwala na iniwan ng mga malalaking lab ang isang architectural dollar sa mesa. — ➠ Bakit Mahalaga Ito Kung magtatagumpay ang SubQ sa production scale: ▸ Maaaring maging iisang usapan ang codebases. Wala nang kailangan ng multi-agent systems na naglalaro ng mga file. Ang modelo ay nakakapag-imbak ng buong repo. ▸ Naging opsyonal na ang RAG. Marami sa kasalukuyang AI infrastructure ay umiiral upang makompensate sa quadratic ceiling. Alisin mo ang ceiling, at magiging baggage ang scaffolding. ▸ Natutuloy na hindi na isang hack ang long-running agents. Ang mga session na tumatagal ng ilang araw na may persistent memory ay naging native. ▸ Maaaring lumikha ng bagong apps. Ang mga workload na sobrang mahal (full document review, exhaustive code search, compliance scanning) ay naging karaniwan. — ➠ Ang Totoong Mga Babala ▸ Nasa private beta pa ito. Hindi pa napagsubokan ang real-world reliability. Kaya hanggang dito, tingnan mo ito bilang teaser, kahit marami pa ring nag-aalala na ito ay performative lang. ▸ Ang marka sa MRCR v2 (65.9%) ay maganda, pero natatalo ni Opus 4.6 (78.3%) at GPT 5.5 (74%). Mas mabilis ang SSA, hindi mas may kakayahang mag-isip. ▸ Ang mga benchmark ay self-published kasama ang third-party verification. Ang academic replication ang tunay na pagsubok. ▸ Ang resulta ng 12M-token ay isang research model, hindi ang shipping product (na 1M lamang). — ➠ Pinaliwanag Sa loob ng siyam taon, binayaran ng bawat transformer-based AI ang parehong quadratic tax. Sinasabi ni Subquadratic na sila’y nakakapagtapos na kung paano huwag itong gawin. Ang mga benchmark ay nagpapakita na sila’y tama sa direksyon. Sinabi ni Altman sa industriya nang tatlong taon na ang nakalipas na capability per dollar ang bagong battlefield. Ang SubQ ay isa sa mga unang kumpanya na sumisikap manalo sa laban na ito sa pamamagitan ng pagbabago mismo sa pondo’t matematika, hindi pagsasama-sama ng workaround. Kung gagawa sila nito — abot lamang ng isang pampublikong empirical tanong.

I-share

Source:Ipakita ang original

Disclaimer: Ang information sa page na ito ay maaaring nakuha mula sa mga third party at hindi necessary na nagre-reflect sa mga pananaw o opinyon ng KuCoin. Ibinigay ang content na ito para sa mga pangkalahatang informational purpose lang, nang walang anumang representation o warranty ng anumang uri, at hindi rin ito dapat ipakahulugan bilang financial o investment advice. Hindi mananagot ang KuCoin para sa anumang error o omission, o para sa anumang outcome na magreresulta mula sa paggamit ng information na ito.

Maaaring maging risky ang mga investment sa mga digital asset. Pakisuri nang maigi ang mga risk ng isang produkto at ang risk tolerance mo batay sa iyong sariling kalagayang pinansyal. Para sa higit pang information, mag-refer sa aming Terms ng Paggamit at Disclosure ng Risk.