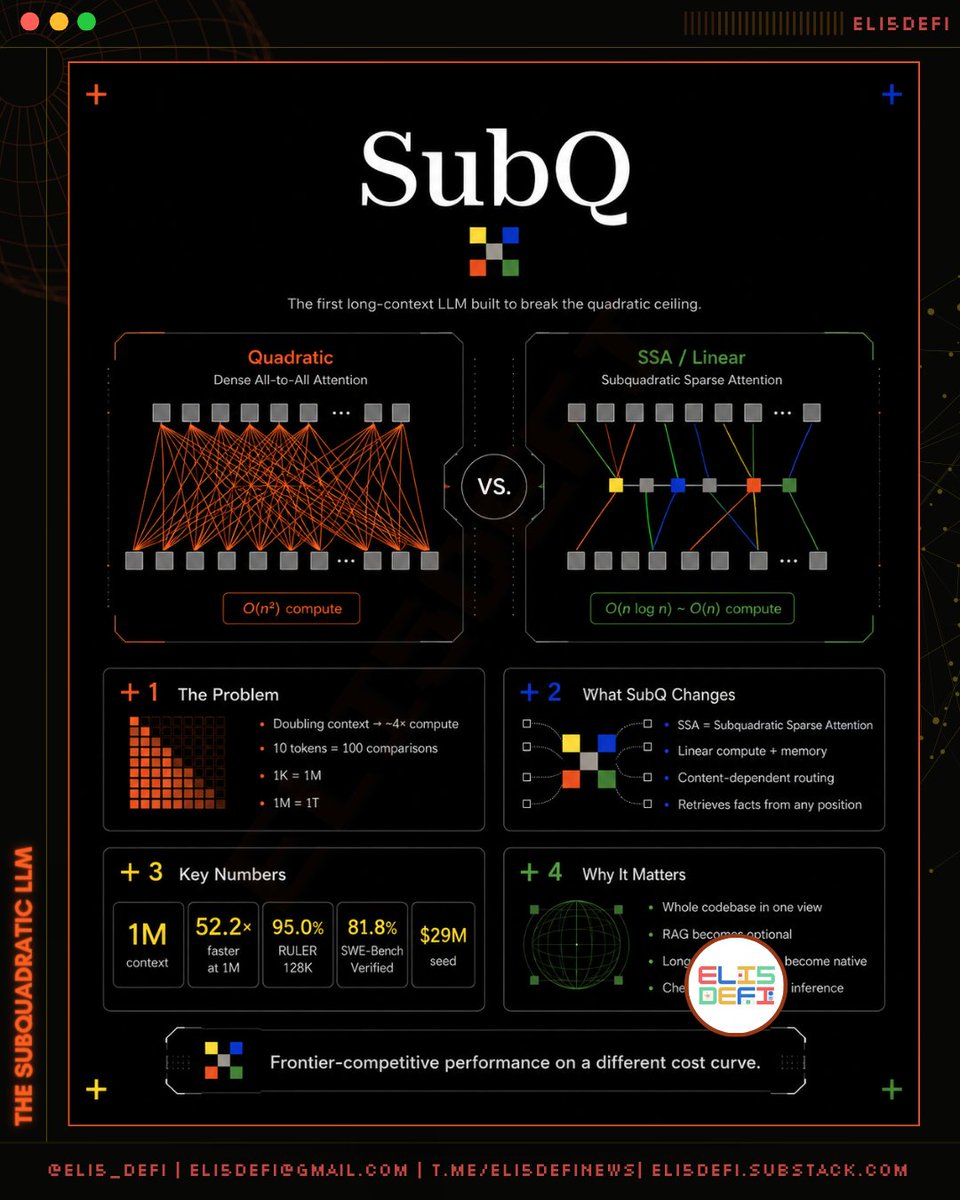

一家名為 @subquadratic 的新 AI 公司剛剛發布了一款模型,突破了現代 AI 中最古老的限制之一。 要理解其重要性,你需要先了解一個一直默默影響你使用過的每個聊天機器人的數學問題。 — ➠ 問題:AI 以成對方式閱讀,而成對方式無法擴展 每一個現代 LLM(ChatGPT、Claude、Gemini)都透過檢查每個詞與其他每個詞之間的關係來閱讀文本。 這聽起來沒問題,直到你做一下數學運算: ▸ 10 個詞 → 100 次比較 ▸ 1,000 個詞 → 1 百萬次比較 ▸ 1 百萬個詞 → 1 兆次比較 輸入翻倍,工作量並非翻倍,而是變成四倍。 這被稱為二次擴展,自 2017 年以來就已內建於 AI 中。 這對你意味著什麼: ▸ 長文檔的成本迅速上升 ▸ 模型經常遺漏長輸入中深藏的事實 ▸ 整個程式碼庫或研究文庫無法容納 現在你知道了,為何上下文越長,你的 LLM 就越笨拙且越昂貴。 — ➠ 當前 AI 如何隱藏這個問題 業界選擇了迂迴方案,而非修正數學本身: ▸ RAG:搜尋引擎抓取幾段相關片段,僅將這些片段輸入模型 ▸ 分塊:長文檔被切割成小塊 ▸ 代理系統:多次 AI 調用分別處理不同部分,並透過程式碼拼接 ▸ FlashAttention:巧妙的記憶技巧,讓同樣昂貴的運算跑得更快 這些方法有效,但沒有一個真正解決了根本問題。 整個現代 AI 堆疊(向量資料庫、檢索管道、提示工程)之所以存在,是因為模型無法一次性「看到」全部內容。 — ➠ SubQ 的不同之處 SubQ 採用了一種稱為 SSA(Subquadratic Sparse Attention)的新方法。 一句話解釋:模型不再比較每個詞與其他所有詞,而是判斷哪些詞對問題真正重要,並忽略其餘部分。 這將擴展複雜度從二次變為線性:輸入翻倍時,工作量也僅翻倍,而非四倍。 困難之處不在於這個想法本身——過去已有人嘗試過。 但以往所有嘗試都犧牲了某些東西:要麼是準確性,要麼是從長文本深處檢索事實的能力,要麼是效率本身。 由 @alex_whedon 聯合創立的 Subquadratic 声稱,他們終於同時解決了這三者。 — ➠ 實證數據 第三方驗證的基準測試: ▸ 在 RULER 128K(長上下文推理測試)上與 Claude Opus 4.6 打平 ▸ 在 MRCR v2(多證據檢索)上擊敗 Opus 4.7、GPT 5.4 和 Gemini 3.1 Pro,但輸給 Opus 4.6 和 GPT 5.5 ▸ 在 SWE-Bench(真實程式碼任務)上擊敗 Opus 4.6 和 Gemini 3.1 Pro,但落後於 Opus 4.7 ▸ 在 1 百萬個 token 下比 FlashAttention 快 52 倍 ▸ 一個研究版本能處理 1,200 萬個 token,注意力運算量比其他前沿模型少約 1,000 倍 簡而言之,這不是「全球最強模型」。 這是以根本更低的成本實現前沿級準確度。 — ➠ Sam Altman 如何參與其中 Altman 兩大公開主張,都指向 SubQ 正在解決的同一問題。 關於成本:在 2025 年 2 月的部落格文章《Three Observations》中,Altman 寫道,使用 AI 的成本每 12 個月下降約 10 倍。他稱這比摩爾定律「強大得難以置信」。他的論點是:更便宜的推論才是塑造 AI 未來的主導力量。 關於規模:回溯至 2023 年,Altman 表示「模型越大越好」的時代已結束,真正的競爭是「每美元的效能」。他將參數數量的競賽比作 1990 年代晶片的 GHz 競賽——方向錯了。 SubQ 真正認真看待這兩項預測。他們的口號是:效率即智慧。 但問題在於:Altman 所提出的降低 AI 成本路徑是硬體進步、軟體優化與模型蒸餾。他從未公開支持重新設計注意力數學本身。 因此,SubQ 的主張與他的經濟學一致,但也是一場賭注——認為大型實驗室遺漏了架構層面的「一美元」。 — ➠ 為何這至關重要 若 SubQ 能在生產規模上實現: ▸ 整個程式碼庫可作為單一對話。不再需要多代理系統輪流處理檔案。模型能完整持有整個程式碼庫。 ▸ RAG 變得可有可無。當今大量 AI 基礎設施的存在,只是為了彌補二次擴展的上限。一旦移除上限,這些輔助架構便成為累贅。 ▸ 長期代理不再只是權宜之計。具備持久記憶的數日對話將成為原生功能。 ▸ 新應用成為可能。過去因成本過高而無法實現的工作(完整文件審查、全面程式碼搜尋、合規掃描)將變得常態化。 — ➠ 真誠的保留意見 ▸ 目前處於私人測試階段,現實可靠性尚未經受壓力測試。因此,在此之前請將此公告視為預告,許多人懷疑這僅是一場表演性宣傳。 ▸ MRCR v2 分數(65.9%)雖好,但仍落後於 Opus 4.6(78.3%)和 GPT 5.5(74%)。SSA 更高效,但並非絕對更強大。 ▸ 基準測試由團隊自行發布並經第三方驗證。學術重現才是真正的考驗。 ▸ 1,200 萬 token 的成果是研究版本,非正式產品(正式產品為 1 百萬 token)。 — ➠ 總結 九年來,每一個基於 Transformer 的 AI 都必須支付相同的二次成本。 Subquadratic 声稱他們終於找到了不支付的方法。基準測試顯示,他們至少方向正確。 Altman 已經告訴業界三年了:「每美元的效能」是新的戰場。SubQ 是首批試圖透過改變底層數學、而非堆疊迂迴方案來贏得這場戰爭的公司之一。 他們能否成功,現在已成為一個公開的實證問題。