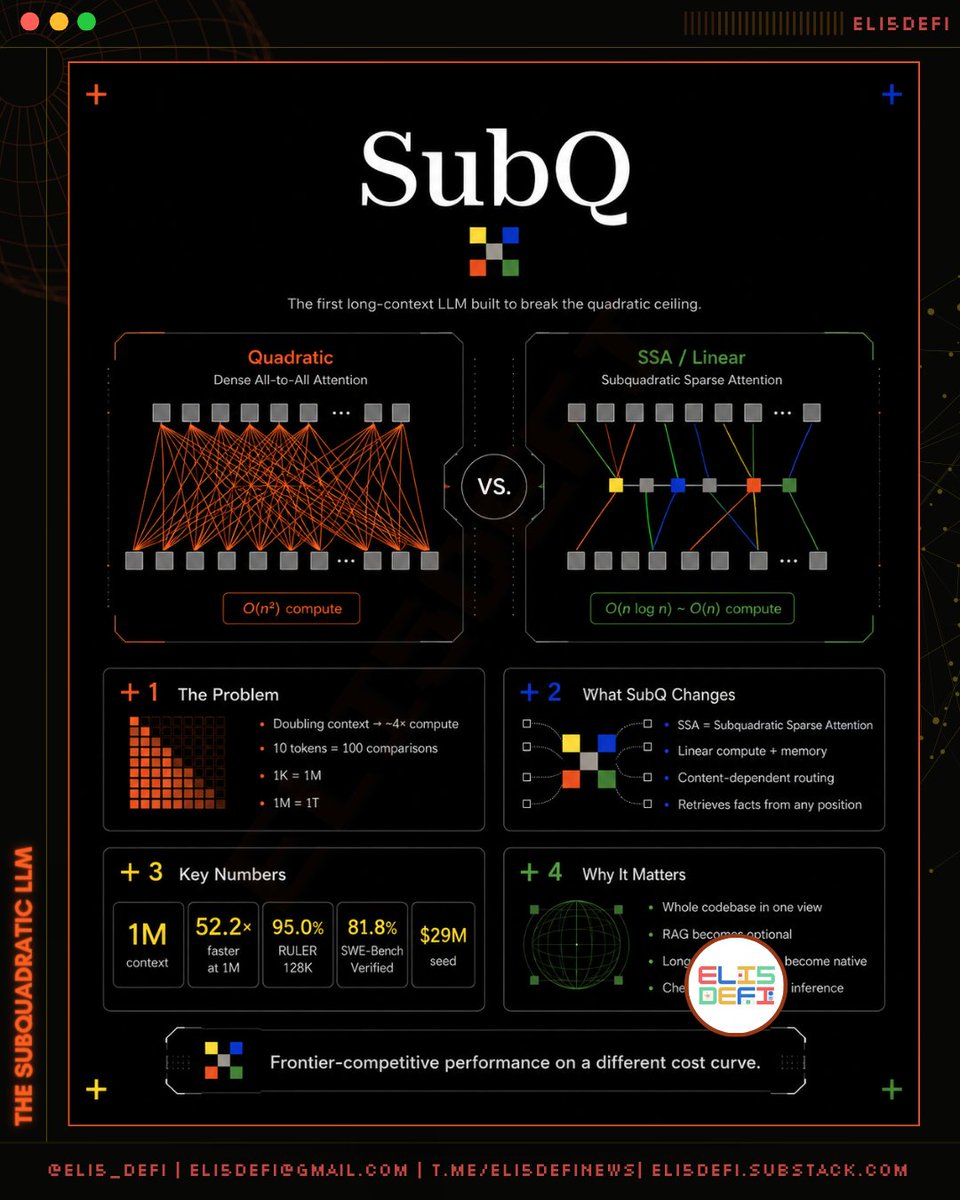

Новая ИИ-компания @subquadratic выпустила модель, которая преодолевает одно из самых давних ограничений современного ИИ. Чтобы понять, почему это важно, вам нужно разобраться в одной математической задаче, которая тихо формирует каждый чат-бот, который вы когда-либо использовали. — ➠ Проблема: ИИ читает парами, а пары не масштабируются Каждая современная LLM (ChatGPT, Claude, Gemini) читает текст, проверяя, как каждое слово связано с каждым другим словом. Это звучит нормально, пока вы не посчитаете: ▸ 10 слов → 100 сравнений ▸ 1 000 слов → 1 миллион сравнений ▸ 1 миллион слов → 1 триллион сравнений Удвоение входных данных не удваивает нагрузку — оно увеличивает её в четыре раза. Это называется квадратичным масштабированием, и оно заложено в ИИ с 2017 года. Что это значит для вас: ▸ Длинные документы быстро становятся дорогими ▸ Модели часто пропускают факты, спрятанные глубоко в длинных входах ▸ Целые кодовые базы или научные библиотеки не помещаются Теперь вы знаете, почему чем длиннее контекст, тем глупее и дороже становятся ваши LLM. — ➠ Как современный ИИ скрывает проблему Отрасль создала обходные пути, вместо того чтобы исправить математику: ▸ RAG: поисковик извлекает несколько релевантных фрагментов и передаёт только их модели ▸ Чанкинг: длинные документы разрезаются на маленькие кусочки ▸ Агентные системы: несколько вызовов ИИ обрабатывают разные части, склеенные кодом ▸ FlashAttention: умные трюки с памятью, позволяющие выполнить ту же дорогую математику быстрее Эти методы работают, но ни один из них не решает настоящую проблему. Вся современная ИИ-инфраструктура (векторные базы данных, пайплайны поиска, проектирование промптов) существует потому, что модели не могут просто «увидеть» всё целиком. — ➠ Что делает SubQ иначе SubQ использует новый подход под названием SSA (Subquadratic Sparse Attention). Суть в одном предложении: вместо того чтобы сравнивать каждое слово с каждым другим, модель определяет, какие слова действительно важны для вопроса, и игнорирует остальные. Это меняет масштабирование с квадратичного на линейное: удвоение входных данных теперь удваивает нагрузку, а не увеличивает её в четыре раза. Сложность не в самой идее — люди уже пробовали это раньше. Каждая предыдущая попытка жертвовала чем-то: либо точностью, либо способностью находить факты, спрятанные далеко в тексте, либо эффективностью. Subquadratic, основанная @alex_whedon, утверждает, что им впервые удалось решить все три проблемы одновременно. — ➠ Доказательства Верифицированные сторонними организациями тесты: ▸ Равенство с Claude Opus 4.6 на RULER 128K (тест на рассуждение с длинным контекстом) ▸ Превосходит Opus 4.7, GPT 5.4 и Gemini 3.1 Pro на MRCR v2 (многодоказательный поиск), но уступает Opus 4.6 и GPT 5.5 ▸ Превосходит Opus 4.6 и Gemini 3.1 Pro на SWE-Bench (реальные задачи программирования), но отстаёт от Opus 4.7 ▸ На 52× быстрее FlashAttention при 1 миллионе токенов ▸ Исследовательская версия обрабатывает 12 миллионов токенов с примерно в 1000× меньшими вычислениями внимания, чем другие передовые модели Коротко: это не «лучшая модель в мире». Это передовая точность при фундаментально более низкой стоимости. — ➠ Где появляется Сэм Альтман Два самых громких публичных утверждения Альтмана указывают на ту же самую проблему, которую решает SubQ. О стоимости: В своём февральском посте 2025 года «Three Observations» Альтман написал, что стоимость использования ИИ падает примерно в 10 раз каждые 12 месяцев. Он назвал это «невероятно более сильным», чем закон Мура. Его тезис: более дешёвый вывод — доминирующая сила, определяющая то, чем может стать ИИ. О размере: С 2023 года Альтман говорил, что эра всё больших и больших моделей закончилась, и настоящая конкуренция — это возможности за доллар. Он сравнил гонку параметров с гонкой тактовых частот в чипах 1990-х. Неправильная ось. SubQ буквально принимает обе эти ставки. Их слоган: «Эффективность — это интеллект». Подвох: Путь Альтмана к более дешёвому ИИ — это прогресс в оборудовании, оптимизация ПО и дистилляция моделей. Он никогда публично не поддерживал переосмысление математики внимания. Таким образом, позиция SubQ согласуется с его экономикой, но также предполагает, что крупные лаборатории оставили на столе архитектурный доллар. — ➠ Почему это важно Если SubQ справится с масштабированием в продакшене: ▸ Кодовые базы как единый диалог. Больше не нужно использовать агентные системы для переключения между файлами. Модель держит весь репозиторий целиком. ▸ RAG становится необязательным. Многие современные ИИ-инфраструктуры существуют только для компенсации квадратичного потолка. Уберите потолок — и леса поддержки превратятся в балласт. ▸ Долгосрочные агенты перестанут быть хаком. Сессии продолжительностью в дни с постоянной памятью станут нативными. ▸ Появятся новые приложения. Ранее слишком дорогие задачи (полный анализ документов, исчерпывающий поиск кода, проверка соответствия) станут обычными. — ➠ Честные оговорки ▸ Находится в закрытом бета-тестировании. Надёжность в реальных условиях ещё не проверена. Пока что воспринимайте анонс как анонс-трейлер — многие считают его лишь показухой. ▸ Результат MRCR v2 (65,9%) хорош, но уступает Opus 4.6 (78,3%) и GPT 5.5 (74%). SSA эффективнее, но не строго мощнее. ▸ Тесты опубликованы самими авторами с внешней верификацией. Реальный тест — воспроизведение академическим сообществом. ▸ Результат с 12 млн токенов — исследовательская версия; продукт для выпуска работает с 1 млн токенов. — ➠ Вывод Девять лет каждая трансформерная модель платила один и тот же квадратичный налог. Subquadratic утверждает, что наконец-то поняла, как его избежать. Бенчмарки показывают, что они по крайней мере движутся в правильном направлении. Альтман уже три года говорит отрасли: новая арена борьбы — возможности за доллар. SubQ — одна из первых компаний, пытающихся выиграть эту борьбу, изменив фундаментальную математику вместо того, чтобы накладывать обходные пути. Теперь вопрос в том, удастся ли им это — открытый эмпирический вопрос.

Поделиться

Источник:Показать оригинал

Отказ от ответственности: Информация на этой странице может быть получена от третьих лиц и не обязательно отражает взгляды или мнения KuCoin. Данный контент предоставляется исключительно в общих информационных целях, без каких-либо заверений или гарантий, а также не может быть истолкован как финансовый или инвестиционный совет. KuCoin не несет ответственности за ошибки или упущения, а также за любые результаты, полученные в результате использования этой информации.

Инвестиции в цифровые активы могут быть рискованными. Пожалуйста, тщательно оценивайте риски, связанные с продуктом, и свою устойчивость к риску, исходя из собственных финансовых обстоятельств. Для получения более подробной информации, пожалуйста, ознакомьтесь с нашими Условиями использования и Уведомлением о риске.