Pada 27 Mac, Forum Inovasi dan Keselamatan Agentic AI pertama serta Puncak Antarabangsa Web 4.0 Hong Kong pertama, yang dianjurkan secara bersama oleh Cyberport Hong Kong, ME Group, dan iPollo, telah diadakan dengan meriah di Cyberport Hong Kong. Puncak ini, yang bertemakan "Aplikasi Inovatif Agentic AI: Perubahan Teknologi dan Integrasi Industri di Era Web 4.0", menghimpun kekuatan terkemuka dari sektor kerajaan, akademik, industri, dan penelitian termasuk Secretary for Financial Services and the Treasury Hong Kong, Mr. Chan Nok-po; Ketua Cyberport Hong Kong, Mr. Chan Sai-ming; Director Cyberport Hong Kong dan pencipta Nano Labs, Mr. Kong Jianping; serta pelabur malaikat terkenal, Mr. Cai Wensheng, untuk membincangkan peluang dan cabaran dalam era baharu di mana AI bergerak dari "perbualan" kepada "tindakan".

Pada masa kini di mana Kecerdasan Buatan Agensial (Agentic AI) mendapat perhatian besar, isu keselamatan yang dibawanya menjadi sangat penting. Pendiri SlowMist, Yu Xian, diundang untuk hadir dalam persidangan ini dan memberikan ucapan bertajuk “Cabaran Keselamatan AI dan Inovasi Pertahanan dalam Dunia Kripto”, di mana beliau berkongsi pemerhatian dan amalan terkini SlowMist dalam bidang keselamatan AI dengan pemimpin industri global.

Fokus pada Terkini: Analisis Mendalam Ancaman Keselamatan OpenClaw dan AI Agent

Seiring dengan semakin mendalamnya teknologi AI dalam dunia kripto, aplikasi AI Agent seperti "OpenClaw" dengan cepat menjadi popular. Namun di belakang gelombang populariti ini, satu masalah yang lebih mendalam sedang muncul: sempadan keselamatan AI Agent belum benar-benar dibina.

Dalam ucapan itu, Yu Cheng menguraikan secara mendalam OpenClaw dan mengemukakan satu penilaian utama: “Teks ialah arahan.” Beliau menjelaskan bahawa dalam konteks operasi AI Agent, semua input bukan lagi sekadar “maklumat”, tetapi arahan yang berpotensi boleh dilaksanakan. Ini bermakna sebarang maklumat luaran yang diterima oleh model—sama ada dari input pengguna, dokumen panduan, atau Skill pihak ketiga—berpotensi ditafsirkan dan dilaksanakan secara langsung, dengan cara itu memperluaskan permukaan serangan dari peringkat kod ke peringkat “kognitif”. Dalam mekanisme ini, laluan serangan dipermudahkan secara besar-besaran. Penyerang tidak perlu menembusi pertahanan keselamatan tradisional; cukup dengan membina kandungan teks yang dirancang dengan teliti, mereka boleh menghasut Agent untuk melaksanakan tindakan yang tidak dijangka, seperti pemindahan aset, kebocoran maklumat sensitif, atau bahkan pelaksanaan arahan jarak jauh. Kerahsiaan dan kos rendah laluan serangan ini menjadikannya ancaman yang sangat nyata.

Dalam mekanisme ini, laluan serangan dipermudahkan secara besar-besaran. Penyerang tidak perlu menembusi pertahanan keselamatan tradisional; cukup dengan membina kandungan teks yang dirancang dengan teliti, mereka boleh menghasut Agent untuk melaksanakan tindakan yang tidak dijangka, seperti pemindahan aset, kebocoran maklumat sensitif, atau bahkan pelaksanaan arahan jarak jauh. Kerahsiaan dan kos rendah laluan serangan ini menjadikannya ancaman yang sangat nyata.

Berdasarkan mekanisme di atas, Cosine seterusnya merumuskan tiga kategori risiko utama yang dihadapi OpenClaw saat ini:

- Input dan manipulasi niat (lapisan interaksi pengguna): Penyerang boleh menggunakan “injeksi petikan langsung” untuk membohongi Agen menjalankan operasi berisiko tinggi. Khususnya, perlu berhati-hati terhadap racun rantai bekalan tidak langsung—penyerang menyisipkan arahan jahat dalam dokumen Markdown Skill. Oleh kerana Markdown sering berperanan sebagai “titik masang”, teks penerangan asal mudah berubah menjadi skrip pelaksanaan jahat (seperti curl | bash), yang menyebabkan pencurian data.

- Risiko lapisan keputusan dan pengaturan (lapisan logik aplikasi): Kesalahan ini bukan berasal daripada model itu sendiri, tetapi daripada “logik pelaksanaan yang salah”. Penyerang boleh mengganggu penaakulan logik Agen, menyebabkannya mengubah alamat penerima dalam proses aliran perniagaan seperti pemindahan kripto mata wang, yang menyebabkan kerugian wang tunai secara langsung.

- Risiko lapisan model (otak utama): Termasuk “halusinasi” yang dihasilkan model yang menyebabkannya menjalankan arahan sistem yang tidak wujud atau berbahaya, serta pola operasi tidak selamat yang dipelajari secara salah daripada data latihan.

Yusin menunjukkan, "Masalah yang diungkap oleh OpenClaw bukanlah fenomena terpisah, tetapi cabaran struktural yang dihadapi secara umum oleh ekosistem AI Agent saat ini." Dengan kata lain, isu keselamatan sudah bukan lagi "kes kesatuan" bagi satu projek tertentu, tetapi risiko sistemik yang perlu diakui oleh seluruh industri.

Serang dan Bertahan: Membina ekosistem sumber terbuka yang selamat untuk AI Agent

Menghadapi bentuk ancaman yang terus berkembang, Yu Xian dalam ucapanannya mengusulkan pendekatan keselamatan "serang dan pertahankan" oleh SlowMist: tidak hanya memahami laluan serangan, tetapi juga menyisipkan kemampuan pertahanan ke dalam mekanisme operasi Agent, mencapai keselamatan yang dibina secara dalaman.

Dia mempersembahkan kepada para tetamu yang hadir serangkaian alat dan penyelesaian sumber terbuka yang dibina oleh SlowMist berdasarkan AI Agent, dengan tujuan mendorong pembentukan ekosistem keselamatan yang telus, boleh disahkan, dan boleh digunakan semula:

- OpenClaw Panduan Praktik Keselamatan Minimalis: Sebuah panduan pelaksanaan keselamatan end-to-end dari tahap kesedaran hingga infrastruktur, yang menyediakan “cap pemikiran keselamatan” sistemik untuk pelaksanaan AI Agent dengan kuasa tinggi dalam persekitaran pengeluaran sebenar.

- Kecekapan Keselamatan Agen SlowMist: Sebuah kerangka kerja semakan keselamatan komprehensif yang memberikan “mata yang bijak” kepada agen seperti OpenClaw. Ia tidak hanya dapat mengesan risiko racun pada Skills biasa, tetapi juga mengenal pasti risiko alamat dompet rantai, repositori kod, dan URL.

- MistTrack Skills: Pakej kemahiran Agent plug-and-play yang memberikan kemampuan kepatuhan AML kripto profesional dan analisis risiko alamat kepada AI Agent, boleh digunakan untuk penilaian risiko alamat atas rantai dan penilaian risiko sebelum transaksi.

- MCP Security Checklist: Senarai semak keselamatan yang terstruktur untuk audit pantas dan penguatan perkhidmatan Agent, membantu pasukan mengelakkan kehilangan titik pertahanan penting semasa pelaksanaan MCPs/Skills dan rantai alat AI berkaitan.

- Contoh MCP jahat: Satu contoh pelayan MCP jahat sumber terbuka untuk mereplikasi skenario serangan sebenar dan menguji ketahanan sistem pertahanan, sesuai untuk penyelidikan keselamatan dan pengesahan pertahanan.

Melalui serangkaian praktik ini, Yu Cheng menekankan: "Kemampuan keselamatan mesti dibina ke dalam Agent, bukan hanya bergantung pada perlindungan luaran." Hanya dengan mengikat mekanisme pertahanan secara mendalam dengan logik operasi Agent, Agent AI dapat beroperasi secara berterusan dan selamat dalam ekosistem Web3 dan AI yang kompleks.

Sistem keselamatan terstruktur: ADSS melindungi sepenuhnya ekosistem AI + Web3

Pada akhir ucapan, Yu Sheng memperkenalkan ADSS (AI Development Security Solution) yang dicadangkan oleh SlowMist.

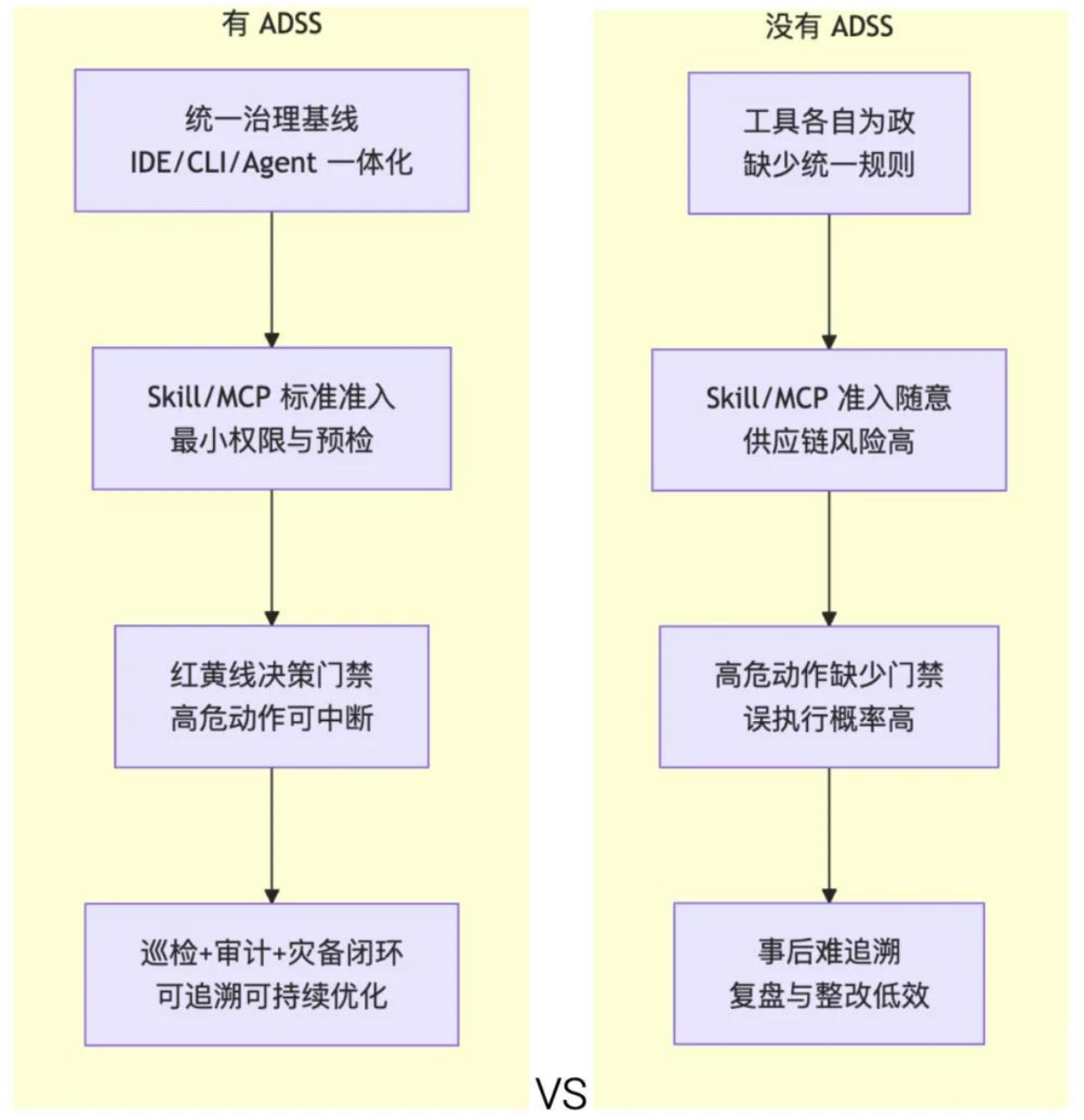

Jika alat-alat yang disebutkan sebelumnya dianggap sebagai "keupayaan taktikal", maka ADSS lebih seperti kerangka keselamatan peringkat sistem. Falsafah utamanya ialah: meningkatkan tindakan keselamatan yang terpisah menjadi mekanisme operasi keselamatan sistemik yang boleh dilaksanakan, diaudit, dan berterusan.

ADSS membina kemampuan tata kelola keselamatan AI + Web3 dari pelbagai aras:

- Tata kelola keselamatan L1 (garis dasar pembangunan): Mewujudkan piawaian keselamatan yang seragam untuk pembangunan dan penggunaan, merangkumi alat pembangunan, kerangka Agent, ekosistem plug-in, dan persekitaran operasi, untuk memberikan sumber strategi dan piawaian audit yang seragam kepada pasukan.

- Tahap L2 dan sekatan operasi: Dengan mengurangkan sempadan kuasa Agen, meminimumkan kuasa pemanggilan alat, dan memperkenalkan mekanisme pengesahan manusia-mesin untuk operasi penting, lingkungan pelaksanaan tingkah laku berisiko tinggi dikawal dengan berkesan.

- Perlindungan interaksi luaran L3: Memperkenalkan kesedaran ancaman secara masa nyata pada peringkat sumber luaran seperti URL, repositori bergantung, dan sumber plugin untuk mengurangkan kemungkinan kandungan jahat atau racun rantai bekalan memasuki laluan pelaksanaan.

- Pemisahan aset di rantai L4: Bagi operasi yang melibatkan transaksi di rantai, gabungkan analisis risiko di rantai dengan mekanisme tanda tangan berasingan, membolehkan Agent membina transaksi tanpa mengakses kunci peribadi secara langsung, mengurangkan risiko sistemik yang timbul daripada operasi aset bernilai tinggi.

- L5 Pemeriksaan dan Peninjauan Berterusan: Melalui audit log, semakan keselamatan berkala, dan mekanisme operasi, mencapai kemampuan keselamatan tertutup di mana "pemeriksaan sebelum pelaksanaan, pengawasan semasa pelaksanaan, dan peninjauan selepas pelaksanaan".

Yusin menunjukkan bahawa ADSS bukan alat tunggal, tetapi satu sistem operasi keselamatan yang berterusan dan boleh berkembang. Ia bertujuan untuk membantu pasukan membina sistem keselamatan Agent yang boleh diaudit dan boleh ditingkatkan, melalui strategi sistematik, audit berterusan, dan penghubungan kemampuan, tanpa mengurangkan kecekapan pembangunan dan kemampuan automatik secara ketara, bagi menghadapi ancaman keselamatan yang terus berkembang dalam konteks integrasi mendalam AI dan Web3.

Penutup

Forum Inovasi dan Keselamatan Agentic AI pertama tidak hanya menghimpun kekuatan terkemuka industri, tetapi juga memberikan pandangan proaktif mengenai keselamatan AI Agent. Dengan integrasi mendalam antara Agentic AI dan Web3, cabaran keselamatan akan terus meningkat. Sebagai syarikat keselamatan blockchain terkemuka di dunia, SlowMist akan terus mendorong pelaksanaan tata kelola keselamatan sistematik melalui ADSS, alat sumber terbuka, dan amalan praktikal untuk membina kemampuan keselamatan intrinsik bagi AI Agent, serta membantu industri mencapai perkembangan yang selamat, terkawal, dan mampan dalam gelombang inovasi.