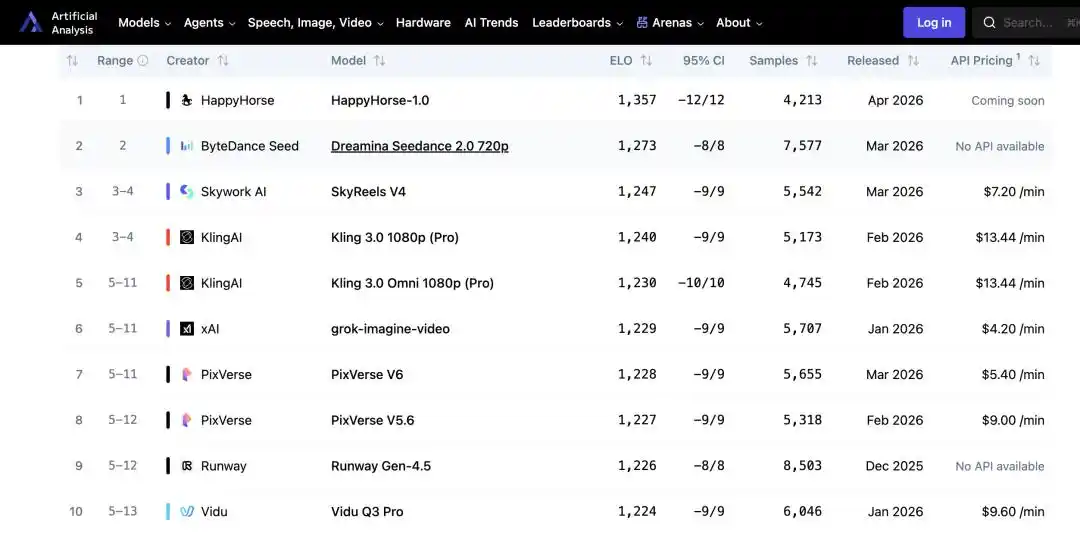

Tiada sidang akhbar, tiada blog teknikal, tiada sokongan syarikat—model penukaran teks ke video bernama HappyHorse-1.0 secara perlahan menduduki puncak senarai peringkat AI Video Arena di platform penilaian AI bergengsi, Artificial Analysis, dengan skor Elo yang lebih tinggi berbanding Seedance 2.0, serta meninggalkan pelaku utama seperti KeLing dan TianGong di belakang, memicu “pertandingan mendedahkan rahsia” di kalangan komuniti teknikal.

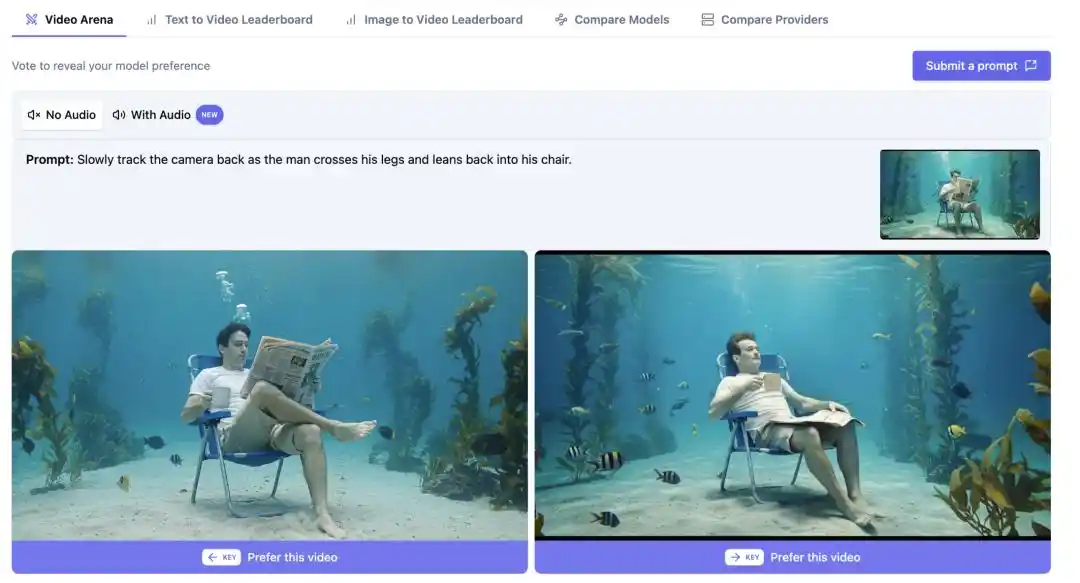

Peringkat Artificial Analysis bukan penilaian parameter teknikal, tetapi jumlah poin Elo yang dikumpulkan daripada ujian buta pengguna sebenar, yang mencerminkan persepsi sebenar orang biasa setelah melihatnya. Ini membuat peringkat ini lebih sukar dipertikaikan berbanding senarai markah biasa, dan menjadikan “Siapakah sebenarnya yang membuat perkara ini?” menjadi satu soalan yang tidak boleh diabaikan.

“Happy Horse” secara perlahan menduduki puncak, memicu pertandingan teka-teki kalangan teknologi

Tekaan di X datang dengan cepat. Yang pertama diperhatikan ialah urutan bahasa di laman web rasmi: Bahasa Mandarin dan Kantonis berada di hadapan Bahasa Inggeris. Bagi produk yang ditujukan kepada pengguna global, urutan ini agak tidak biasa—jika pasukan Amerika yang memimpin, Bahasa Inggeris hampir pasti tidak akan berada di luar tempat pertama. Pasukan di belakangnya berasal dari China, yang hampir pasti dapat disahkan.

Nama itu sendiri juga merupakan petunjuk. Tahun 2026 adalah Tahun Kuda dalam takwim lunar, dan nama "HappyHorse" menyembunyikan permainan kata yang tidak terlalu halus tentang Tahun Kuda; pada awal tahun ini, "Pony Alpha" juga menggunakan trik serupa. Oleh itu, senarai tersangka dengan cepat memanjang: pendiri Tencent dan Alibaba semuanya berkeluarga "Ma", secara alami termasuk dalam senarai; ada yang bertaruh pada Xiaomi, kerana Lei Jun dikenal sebagai orang yang pendiam dan suka menunjukkan kartu secara tiba-tiba; ada juga yang berpendapat ia lebih mirip DeepSeek, mengingat DS sebelumnya pernah melancarkan model visual secara diam-diam, kemudian menariknya kembali secara diam-diam. Spekulasi dari berbagai pihak sangat ramai, tetapi tiada satu pun yang mampu menunjukkan bukti konkret.

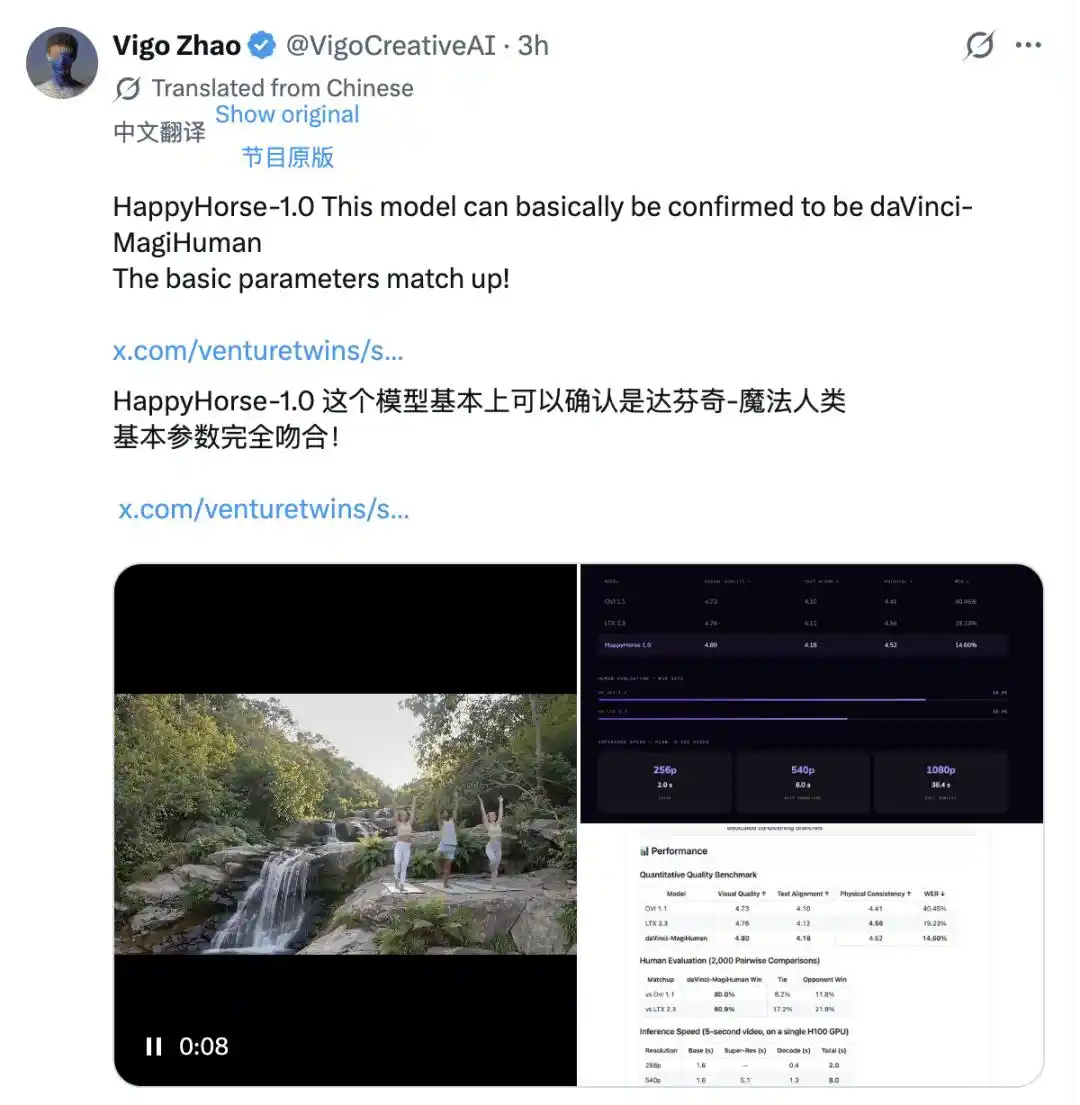

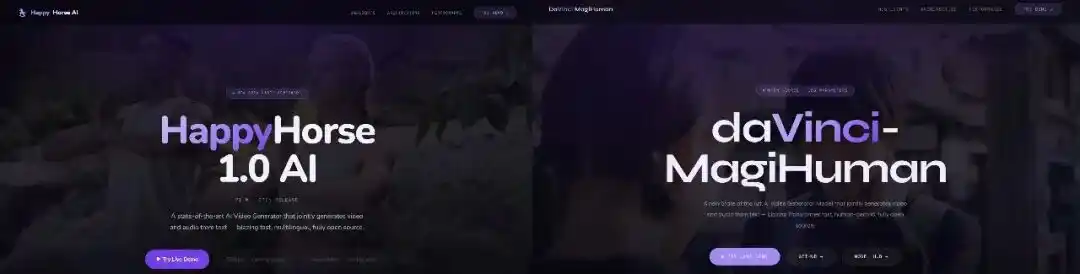

Yang benar-benar mengidentifikasi sasaran adalah perbandingan terperinci pada tingkat teknis. Pengguna X, Vigo Zhao, membandingkan data patokan terbuka HappyHorse-1.0 dengan model yang diketahui satu per satu, dan menemukan objek yang sangat cocok: daVinci-MagiHuman, iaitu model sumber terbuka yang dilancarkan di Github pada bulan Mac, "da Vinci Magic Human".

Kualiti visual 4.80, selari teks 4.18, konsistensi fizikal 4.52, kadar kesilapan suara-tekst 14.60%—dua set data sepadan satu per satu. Struktur laman web juga hampir sama: gaya paparan perihalan struktur, jadual prestasi, dan video demo, semuanya kelihatan seperti berasal daripada templat yang sama. Keduanya menggunakan arsitektur Transformer aliran tunggal, menghasilkan audio dan video secara bersamaan, dan menyokong senarai bahasa yang sama persis. Kesepaduan sebegitu sukar dijelaskan sebagai kebetulan.

Kesimpulan yang paling diakui dalam komunitas teknikal ialah HappyHorse merupakan versi iteratif yang dioptimaskan oleh Sand.ai, salah satu pihak yang bekerjasama dalam pembangunan daVinci-MagiHuman, dengan tujuan utama menguji had prestasi model di bawah preferensi pengguna sebenar, sebagai persiapan untuk pelaksanaan komersial seterusnya.

daVinci-MagiHuman secara rasmi dibuka sumber pada 23 Mac 2026, hasil kerjasama dua pasukan muda. Satu pasukan datang dari Laboratorium Penyelidikan Kecerdasan Buatan Generatif (GAIR), Akademi Kreatif Shanghai (SII), dipimpin oleh akademik Liu Pengfei; pasukan lain ialah Sand.ai (San Dai Technology) di Beijing, yang didirikan oleh Cao Yue, yang juga memiliki latar belakang akademik, dengan fokus perusahaan pada model dunia autoregresif.

Model menggunakan Transformer aliran tunggal perhatian murni dengan 15 miliar parameter, yang memasukkan semua token dari tiga modality—teks, video, dan audio—ke dalam satu urutan yang sama untuk pemodelan bersama—belum pernah ada dalam komunitas sumber terbuka yang memulai dari awal untuk pra-pelatihan bersama audio-visual sebelum ini; kebanyakan hanya menggabungkan berdasarkan modality tunggal.

Bagaimana model video sumber terbuka mampu mencapai kebangkitan dalam dua minggu?

Setelah identiti dikenal pasti, soal lain menjadi lebih sukar untuk dijawab: daVinci-MagiHuman baru dibuka sumber akhir Mac, mengapa HappyHorse-1.0 mampu mendapat skor Elo yang lebih tinggi daripada Seedance 2.0 dalam masa hanya dua minggu?

Berdasarkan maklumat yang dinyatakan di laman web rasmi, HappyHorse tidak mengubah apa-apa dalam arsitektur asasnya; tekaan yang lebih munasabah ialah ia telah melakukan penyesuaian khusus terhadap strategi janaan lalai untuk skenario penilaian.

Sistem Elo pada dasarnya adalah akumulasi preferensi pengguna; sedikit memperbaiki perkara-perkara sensitif seperti kestabilan ekspresi wajah, keselarasan suara dan gambar, serta keindahan visual, akan meningkatkan kemungkinan dipilih dalam ujian buta. Batas atas kemampuan model tidak berubah, tetapi "prestasi penilaian" boleh diperhalus.

Sebenarnya, dalam sampel ujian buta Artificial Analysis, gambar wajah dan kandungan ucapan lisan menduduki lebih daripada 60%, dan daVinci-MagiHuman telah fokus pada persembahan wajah sejak peringkat latihan, menjadikannya secara semula jadi mempunyai kelebihan dalam skenario ini—ini juga merupakan sebab utama kejayaan ujian butanya yang lebih tinggi; jika sampel ujian buta terutamanya berfokus pada close-up wajah, model yang mahir dalam wajah akan secara sistemik mendapat keuntungan, yang tidak berkaitan langsung dengan prestasi sebenarnya dalam skenario kompleks seperti banyak watak, pengambilan kamera yang rumit, atau naratif jangka panjang.

Hasilnya, terdapat jurang yang jelas antara nombor dalam senarai peringkat dan pengalaman sebenar, dengan pembincang di X terbahagi kepada dua faksi. Faksi yang meragui, setelah menguji, berpendapat bahawa HappyHorse-1.0 dan Seedance 2.0 masih menunjukkan perbezaan yang kelihatan dalam butiran watak dan kesinambungan pergerakan, dan dengan itu mempertikaikan kewakilan skor Elo itu sendiri.

Penggemar pula menaruh harapan besar terhadap potensi HappyHorse untuk menyelesaikan masalah industri iaitu "konsistensi kualiti gambar dalam urutan pelbagai sudut kamera", kerana ini adalah isu yang belum berjaya diselesaikan oleh model video utama semasa ini. Jika daVinci-MagiHuman benar-benar mencapai terobosan di sini, ia mungkin lebih penting daripada kedudukan dalam senarai peringkat.

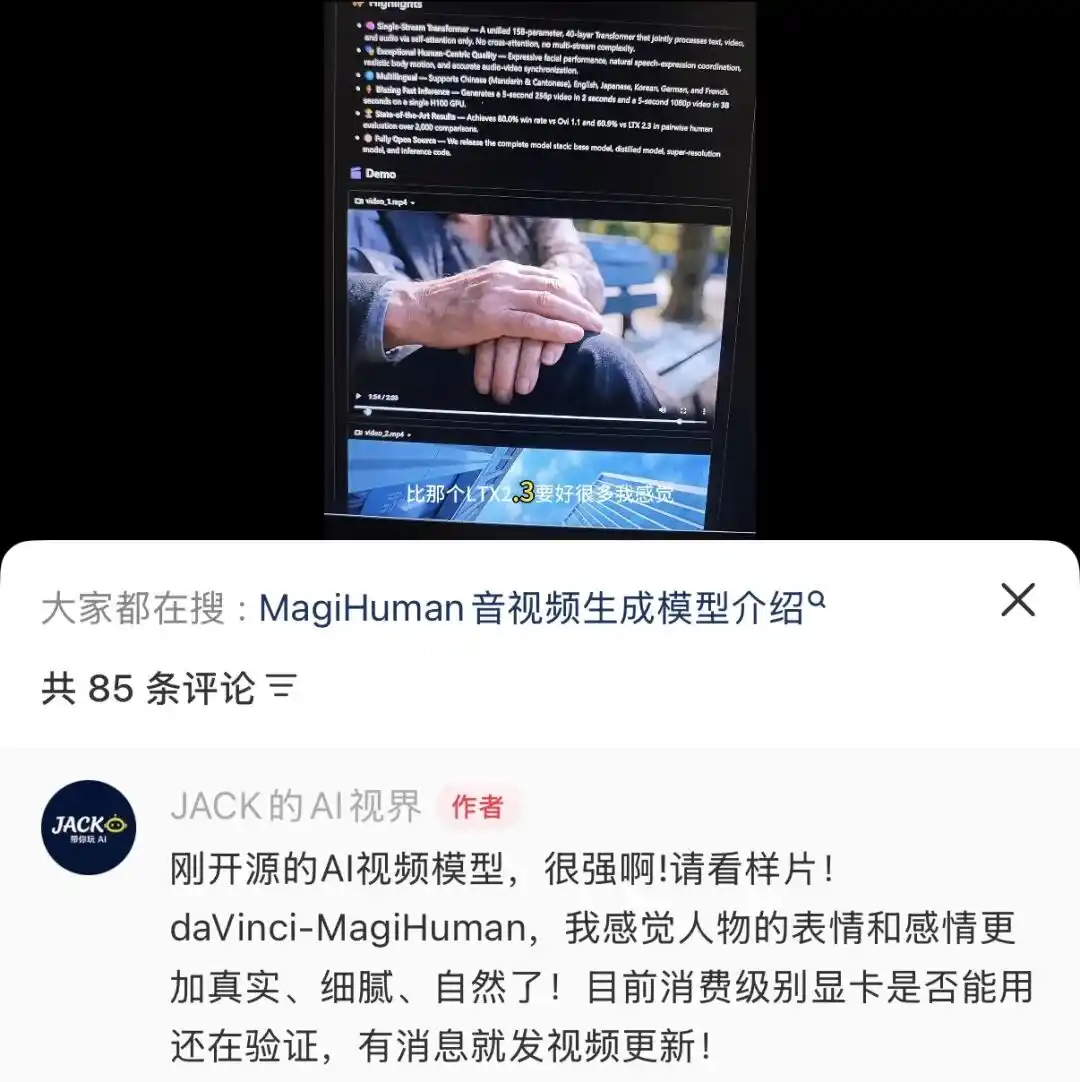

Kekangan model itu sendiri juga tidak sepatutnya ditutupi oleh nombor. Blogger Xiao Hong Shu @JACK's AI World telah menghantar dan menguji daVinci-MagiHuman pada masa pertama. Ia mendapati bahawa model ini memerlukan H100, dan kebanyakan kad grafik pengguna biasa tidak dapat menjalankannya. Walaupun komuniti sedang mengkaji penyelesaian kuantisasi, pengguna peribadi masih menghadapi kesukaran untuk melaksanakannya secara tempatan dalam jangka pendek.

Dalam konteksnya, ia kini terutama unggul dalam gambar satu orang sahaja; apabila terdapat banyak orang atau adegan menjadi lebih kompleks, kualiti akan menurun—ini bukan masalah yang boleh diselesaikan hanya dengan penyesuaian parameter, tetapi berkaitan langsung dengan rekaan yang berfokus pada potret. Masa penghasilan biasanya sekitar 10 saat sahaja; jika lebih panjang, ia cenderung menjadi kacau, dan output berkualiti tinggi masih memerlukan plugin super-resolution untuk melengkapkan.

Kesimpulan dari AI View @JACK adalah: daVinci-MagiHuman memiliki kemudahan penggunaan yang kurang baik berbanding LTX 2.3, dan perlu menunggu komuniti menyempurnakan kuantifikasi sebelum sesuai untuk penggunaan harian.

Pasaran penghasilan video, akankah menunggu "ikan lele" sejati?

Tentu, memimpin dalam satu senarai tidak banyak bermakna. Seterusnya, HappyHorse perlu melalui ujian yang lebih menyeluruh dalam hal kestabilan, kelajuan akses konkrit tinggi, konsistensi lintas skenario, ketepatan kawalan peranan, serta kemampuan penggeneralisasian di luar set penilaian. Inilah yang menjadi indikator utama menentukan sama ada model tersebut benar-benar boleh dimasukkan ke dalam alur kerja pencipta.

Namun, jika dilihat dari perspektif yang lebih luas mengenai struktur industri, isyarat yang disampaikan oleh perkara ini sudah cukup jelas.

Model video sumber terbuka bukanlah perkara baru. Namun, selalu ada jurang kelihatan dalam segi kualiti antara sumber terbuka dan sumber tertutup—dalam skenario yang memerlukan penghantaran kepada pelanggan, kualiti penghasilan model sumber terbuka secara berterusan gagal melintasi sempadan dari “boleh digunakan” ke “boleh dihantar”. Kuasa penetapan harga produk sumber tertutup seperti KeLing dan Seedance sebahagian besarnya dibina atas jurang ini.

Makna kali ini ialah, sebuah produk berdasarkan model sumber terbuka, untuk pertama kalinya bersaing secara langsung dengan pesaing tertutup utama semasa ini dalam senarai peringkat ujian buta yang berdasarkan persepsi pengguna sebenar. Tidak kira berapa banyak penyesuaian yang dilakukan untuk skenario penilaian, bagi pengilang tertutup yang membina kuasa penetapan harga berdasarkan jurang ini, sekurang-kurangnya ini adalah isyarat yang perlu diambil dengan serius.

Bagi pembangun, titik balik ini bermakna lebih spesifik. Dalam skenario tegak seperti potret, manusia digital, dan penyiar maya, sekali kualiti penghasilan asas sumber terbuka mencapai ambang “boleh diserahkan”, struktur kos pelaksanaan sendiri akan berubah secara substantif—bukan sahaja mengurangkan kos panggilan API, tetapi lebih penting lagi, mengambil alih sepenuhnya kawalan terhadap data, model, dan rantai inferens, mendapatkan fleksibiliti yang sukar dicapai oleh penyelesaian tertutup dalam hal kedalaman penyesuaian dan kepatuhan privasi.

HappyHorse-1.0 tidak akan menggoyahkan kedudukan pasaran Seedance 2.0 atau Ke Ling dalam jangka pendek, tetapi apabila pemahaman bahawa model sumber terbuka boleh setara dengan model tertutup ditetapkan, pengoptimuman kuantitatif, penyesuaian khusus, dan percepatan inferens akan diteruskan oleh komuniti pada kelajuan jauh melebihi pengembangan produk tertutup.

Pada tahun Kuda ini, yang mungkin patut diperhatikan bukanlah kuda mana yang paling laju, tetapi lintasan itu sendiri sedang menjadi lebih lebar.

Artikel ini berasal daripada akaun微信公众号 "AI Value Officer", penulis: Xingye, penyunting: Mei Qi