Penulis: Deep潮 TechFlow

Sebuah kertas kerja yang mengklaim "mengurangkan penggunaan memori AI menjadi 1/6" minggu lepas menyebabkan kapitalisasi pasaran lebih daripada 90 bilion dolar AS hilang pada saham cip penyimpanan global seperti Micron dan SanDisk.

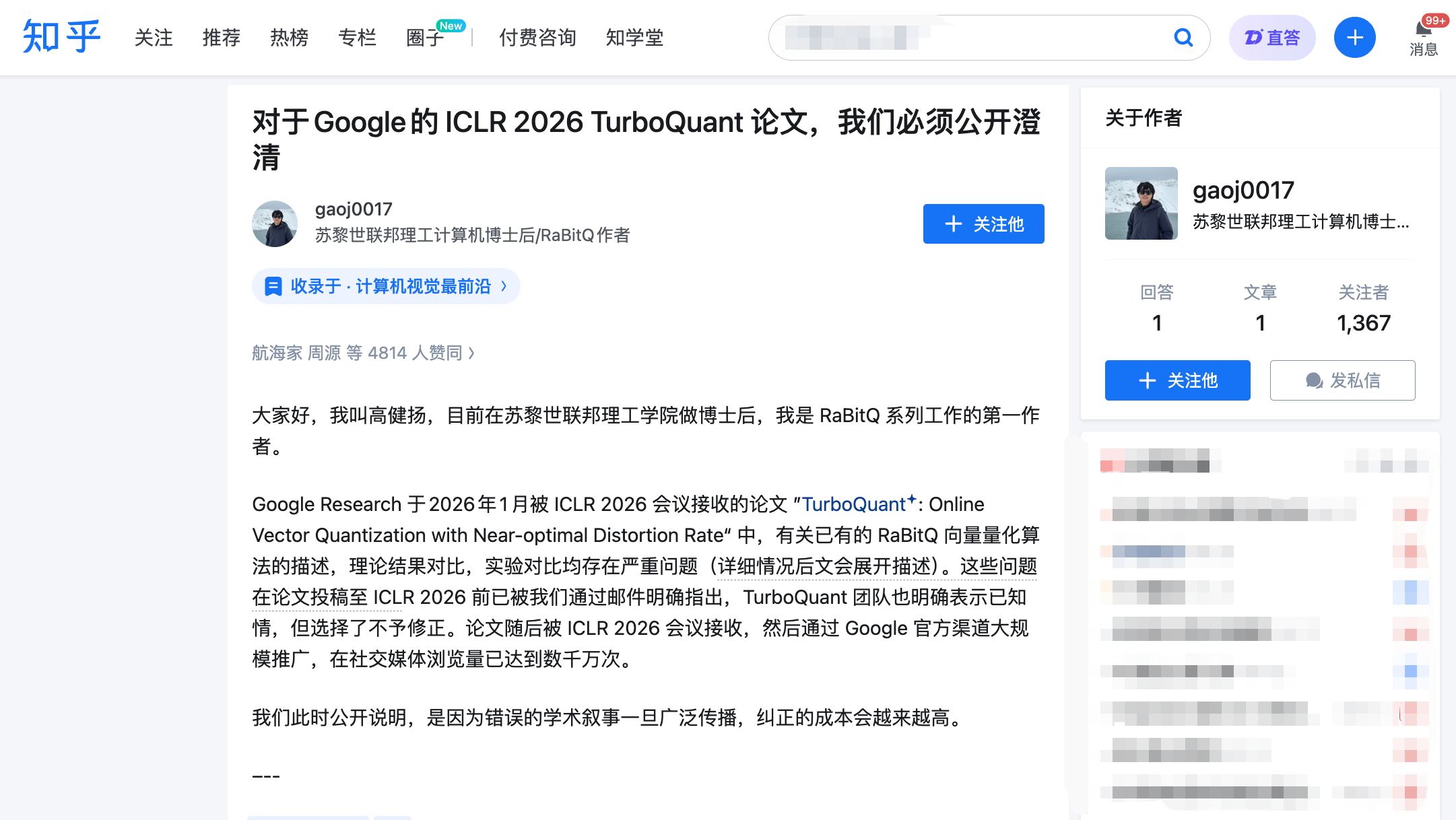

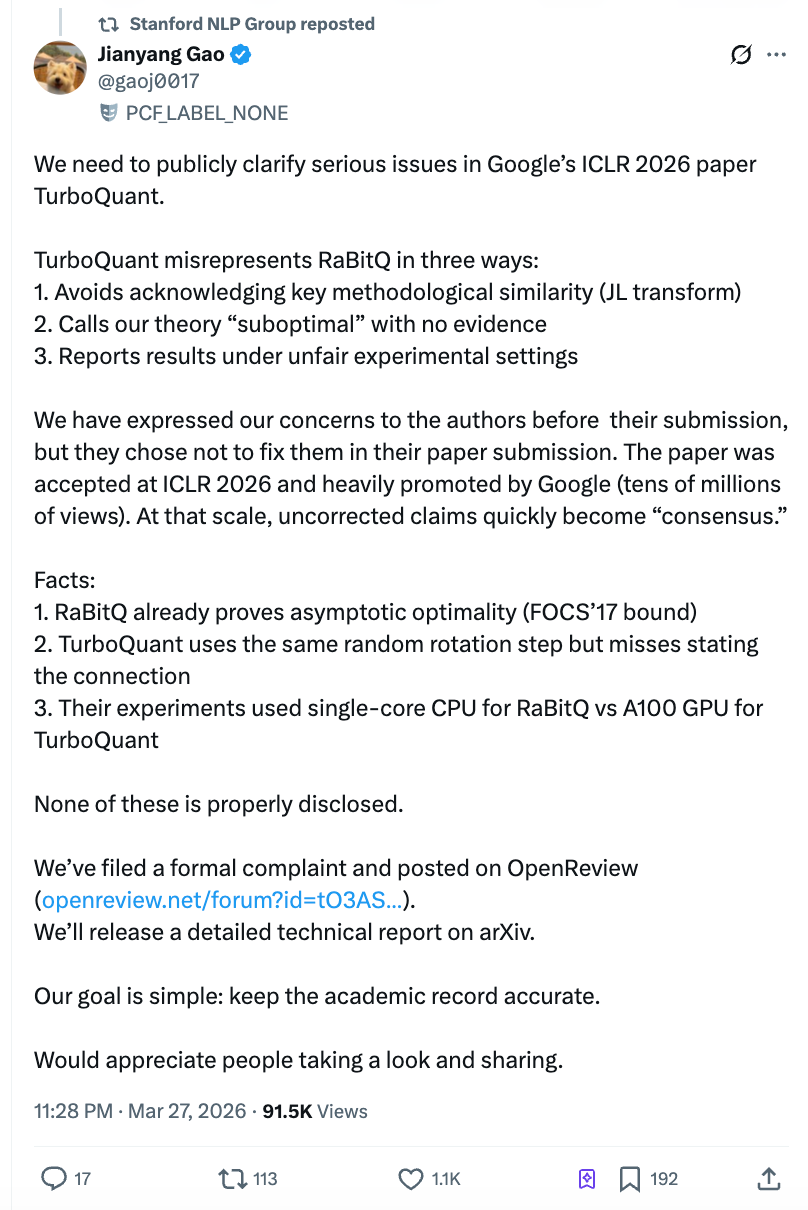

Namun, hanya dua hari selepas kertas kerja diterbitkan, kandidat pasca-doktoral dari ETH Zurich, Gao Jianyang, yang algoritma itu «menewaskan», menerbitkan surat terbuka berjumlah 10,000 patah perkataan, menuduh pasukan Google menguji pesaing dengan skrip Python yang berjalan pada CPU tunggal, tetapi menguji diri mereka sendiri dengan GPU A100, dan tetap menolak untuk memperbaiki masalah tersebut walaupun telah diberitahu sebelum penghantaran. Jumlah bacaan di Zhihu dengan cepat melepasi 4 juta, akaun rasmi Stanford NLP memuat ulang, dan komuniti akademik serta pasaran sama-sama terkejut.

(Bacaan rujukan: Sebuah kertas kerja telah menurunkan saham penyimpanan)

Masalah utama dalam kontroversi ini tidak rumit: adakah kertas kerja konvensyen AI yang secara besar-besaran dipromosikan oleh Google dan secara langsung memicu jualan panik di sektor cip, secara sistematik menyelewengkan karya terdahulu yang telah diterbitkan, dan membina naratif kelebihan prestasi yang tidak benar melalui eksperimen tidak adil yang sengaja diciptakan?

Apa yang dilakukan TurboQuant: Meredakan "kertas buram" AI hingga satu per enam daripada asalnya

Semasa model bahasa besar menghasilkan jawapan, ia perlu menulis sambil semula semak kandungan yang telah dihitung sebelumnya. Keputusan sementara ini disimpan secara sementara dalam memori GPU, dikenali secara industri sebagai «KV Cache». Semakin panjang perbualan, semakin tebal «kertas buram» ini, semakin tinggi penggunaan memori GPU, dan semakin tinggi kosnya.

Algoritma TurboQuant yang dibangun oleh pasukan penyelidikan Google, menonjolkan kemampuan untuk memampatkan kertas buram ini kepada 1/6 daripada saiz asalnya, sambil mengklaim tiada kehilangan ketepatan dan peningkatan kelajuan inferens sehingga 8 kali ganda. Kertas ini pertama kali diterbitkan pada platform pra-cetak akademik arXiv pada April 2025, diterima oleh persidangan terkemuka di bidang AI, ICLR 2026, pada Januari 2026, dan kemudian dipromosikan semula melalui blog rasmi Google pada 24 Mac.

Dari segi teknikal, pemikiran TurboQuant boleh difahami secara ringkas: pertama, gunakan satu transformasi matematik untuk 'mencuci' data yang tidak teratur menjadi format seragam, kemudian mampatkan secara berperingkat menggunakan jadual mampatan optimum yang telah dikira sebelumnya, dan akhirnya betulkan perbezaan pengiraan yang disebabkan oleh pampatan dengan mekanisme koreksi kesalahan 1 bit. Pelaksanaan bebas komuniti telah mengesahkan bahawa kesan mampatan adalah benar, dan sumbangan matematik pada peringkat algoritma adalah nyata.

Perkara yang diperdebatkan bukan sama ada TurboQuant boleh digunakan, tetapi apa yang Google lakukan untuk membuktikan ia “jauh melebihi pesaing”.

Surat terbuka Gao Jianyang: Tiga tuduhan, semuanya mengena pada inti masalah

Pada 27 Mac pukul 10 malam, Gao Jianyang memuatkan artikel panjang di Zhihu, serta menghantar ulasan rasmi di platform peninjauan rasmi ICLR, OpenReview. Gao Jianyang ialah penulis pertama algoritma RaBitQ, yang diterbitkan pada tahun 2024 di persidangan terkemuka bidang pangkalan data, SIGMOD, dan menyelesaikan masalah yang sama—kompresi berkesan vektor dimensi tinggi.

Tuntutannya terbahagi kepada tiga perkara, setiap satu disokong oleh rekod e-mel dan garis masa.

Tuduhan satu: Menggunakan kaedah utama orang lain, tanpa menyebutnya dalam seluruh teks.

Langkah penting bersama dalam inti teknikal TurboQuant dan RaBitQ ialah melakukan "putaran rawak" terhadap data sebelum mampatkan data tersebut. Tindakan ini berfungsi untuk mengubah data yang taburan tidak teratur menjadi taburan seragam yang boleh diramal, dengan begitu mengurangkan kesukaran mampatan secara besar-besaran. Ini merupakan bahagian paling inti dan paling serupa antara dua algoritma ini.

Penulis TurboQuant sendiri mengakui hal ini dalam respons ulasan, tetapi tidak pernah secara terbuka menjelaskan hubungan antara metode ini dengan RaBitQ dalam keseluruhan makalah. Latar belakang yang lebih penting adalah: Majid Daliri, penulis kedua TurboQuant, secara aktif menghubungi tim Gao Jianyang pada Januari 2025 untuk meminta bantuan dalam memperbaiki versi Python yang dimodifikasi dari kode sumber RaBitQ. E-mel tersebut menggambarkan langkah-langkah replikasi dan informasi kesalahan secara terperinci—dengan kata lain, tim TurboQuant memahami detail teknis RaBitQ dengan sangat baik.

Seorang reviewer anonim ICLR juga secara berasingan menunjukkan bahawa kedua-duanya menggunakan teknik yang sama, dan meminta perbincangan yang mencukupi. Namun, dalam versi akhir kertas, pasukan TurboQuant tidak hanya gagal menambahkan perbincangan, tetapi juga memindahkan perihalan RaBitQ (yang sudah tidak lengkap) dari teks utama ke lampiran.

Kedua: Menyatakan teori pihak lain sebagai "kurang optimum" tanpa bukti.

Kertas kerja TurboQuant secara langsung menandakan RaBitQ sebagai "suboptimal secara teori" dengan alasan bahawa analisis matematik RaBitQ "agak kasar". Namun, Gao Jianyang menunjukkan bahawa kertas kerja versi lanjutan RaBitQ telah membuktikan secara ketat bahawa ralat pemampatannya mencapai sempadan matematik yang optimum—kesimpulan ini telah diterbitkan di persidangan terkemuka dalam sains komputer teori.

Pada Mei 2025, pasukan Gao Jianyang pernah menjelaskan secara terperinci melalui beberapa e-mel mengenai keoptimalan teori RaBitQ. Daliri, penulis kedua TurboQuant, mengesahkan bahawa beliau telah memberitahu semua penulis. Namun, kertas kerja tersebut akhirnya masih mengekalkan pernyataan “suboptimal” tanpa memberikan sebarang hujah pembantahan.

Tuduhan ketiga: Dalam perbandingan eksperimen, "tangan kiri mengikat orang, tangan kanan memegang pisau".

Ini adalah pernyataan paling mematikan dalam keseluruhan teks. Gao Jianyang menunjukkan bahawa kertas kerja TurboQuant menambah dua syarat tidak adil dalam eksperimen perbandingan kelajuan:

Pertama, RaBitQ secara rasmi menyediakan kod C++ yang telah dioptimakan (secara lalai menyokong paralelisme berbilang thread), tetapi pasukan TurboQuant tidak menggunakannya, sebaliknya menggunakan versi Python yang mereka terjemahkan sendiri untuk menguji RaBitQ. Kedua, semasa menguji RaBitQ, digunakan CPU berinti tunggal dengan paralelisme berbilang thread dimatikan, manakala TurboQuant menggunakan GPU NVIDIA A100.

Kesan gabungan dua syarat ini ialah: kesimpulan yang dilihat pembaca ialah «RaBitQ lebih perlahan beberapa peringkat daripada TurboQuant», tetapi pembaca tidak tahu bahawa kesimpulan ini berasaskan fakta bahawa pasukan Google mengikat tangan dan kaki lawan sebelum bertanding lari. Syarat eksperimen ini tidak didedahkan dengan mencukupi dalam kertas kerja.

Tanggapan Google: "Pemutaran rawak adalah teknik umum, tidak mungkin untuk mengutip setiap artikel."

Menurut Gao Jianyang, pasangan tim TurboQuant dalam balasan e-mel pada Mac 2026 menyatakan: "Penggunaan putaran rawak dan transformasi Johnson-Lindenstrauss sudah menjadi teknik standard dalam bidang ini, dan kami tidak mungkin merujuk kepada setiap kertas yang menggunakan kaedah ini."

Pasukan Gao Jianyang percaya ini adalah pertukaran konsep: masalahnya bukan sama ada semua kertas yang menggunakan putaran rawak perlu dirujuk, tetapi RaBitQ adalah karya pertama yang menggabungkan kaedah ini dengan pemampatan vektor dan membuktikan keoptimalannya dalam keadaan masalah yang tepat sama, dan kertas TurboQuant sepatutnya menggambarkan hubungan antara keduanya dengan tepat.

Kumpulan NLP Stanford membagikan pernyataan Gao Jianyang melalui akaun X rasmi mereka. Pasukan Gao Jianyang telah menerbitkan ulasan awam di platform ICLR OpenReview dan mengemukakan aduan rasmi kepada ketua dan komite etik ICLR, serta akan menerbitkan laporan teknikal terperinci di arXiv pada masa akan datang.

Pengulas teknikal bebas Dario Salvati memberikan penilaian yang relatif neutral dalam analisisnya: TurboQuant memang memberikan sumbangan nyata dari segi kaedah matematik, tetapi hubungannya dengan RaBitQ jauh lebih rapat daripada yang dinyatakan dalam kertas kerja.

Nilai pasaran $90 bilion hilang: Perdebatan kertas kerja ditambah kepanikan pasaran

Masa berlakunya perdebatan akademik ini sangat halus. Selepas Google mengumumkan TurboQuant melalui blog rasmi pada 24 Mac, sektor cip penyimpanan global mengalami jualan besar-besaran. Menurut laporan daripada pelbagai media seperti CNBC, Micron Technology mengalami penurunan selama enam hari perdagangan berturut-turut, dengan jumlah penurunan melebihi 20%; SanDisk jatuh sebanyak 11% dalam sehari; SK Hynix dari Korea turun kira-kira 6%, Samsung Electronics turun hampir 5%, dan Kioxia dari Jepun turun kira-kira 6%. Logik kepanikan pasaran adalah ringkas dan kasar: kompresi perisian mampu mengurangkan keperluan memori untuk inferens AI sebanyak 6 kali ganda, menyebabkan prospek permintaan cip penyimpanan mengalami penurunan struktural.

Analyst Joseph Moore dari Morgan Stanley membantah logika ini dalam laporan penyelidikan pada 26 Mac, mengekalkan penilaian "Beli" terhadap Micron dan SanDisk. Moore menunjukkan bahawa TurboQuant hanya mengompresi jenis cache tertentu, iaitu KV Cache, bukan penggunaan memori keseluruhan, dan menggambarkannya sebagai "peningkatan produktiviti biasa". Analis dari Wells Fargo, Andrew Rocha, juga merujuk kepada paradoks Jevons, berpendapat bahawa peningkatan kecekapan yang mengurangkan kos mungkin sebenarnya merangsang penyebaran AI dalam skala yang lebih besar, akhirnya meningkatkan permintaan memori.

Kertas kerja lama, pembungkusan baru: Risiko saluran transmisi dari penyelidikan AI ke naratif pasaran

Menurut analisis blogger teknikal Ben Pouladian, kertas kerja TurboQuant telah diterbitkan secara awam pada April 2025 dan bukan kajian baharu. Pada 24 Mac, Google mengemas kembali dan mempromosikannya melalui blog rasmi, tetapi pasaran menilainya sebagai terobosan baharu. Strategi pemasaran "kertas kerja lama, pelancaran baharu" ini, bersama dengan kemungkinan bias eksperimen dalam kertas kerja tersebut, menunjukkan risiko sistemik dalam rantai transmisi dari kertas kerja akademik kepada naratif pasaran dalam penyelidikan AI.

Bagi pelabur infrastruktur AI, apabila sebuah kertas kerja menyatakan pencapaian peningkatan prestasi "beberapa peringkat", langkah pertama yang perlu ditanyakan ialah sama ada syarat perbandingan asas adalah adil.

Pasukan Gao Jianyang telah menyatakan dengan jelas bahawa mereka akan terus mendorong penyelesaian rasmi bagi isu ini. Pihak Google belum memberikan respons rasmi terhadap tuntutan spesifik dalam surat terbuka.