Tiga puluh hari yang gila ini, sebelas model besar, seperti pertunjukan kembang api yang ribut.

Penulis artikel, sumber: 0x9999in1, ME News

TL;DR

- Tiga puluh hari penuh persaingan sengit: 26 Mac hingga 24 April, melancarkan 11 model besar penting secara global, purata satu setiap 2.7 hari. Pasaran menghadapi "kelesuan parameter" yang serius.

- “Pembedahan penurunan berat badan” untuk Parameter Big Eater: Jumlah parameter V4-Pro mencapai 1.6T, tetapi hanya 49B yang diaktifkan. Melalui reka bentuk semula arsitektur CSA+HCA, FLOPs turun ke 27% dalam konteks 1M, dan cache KV turun ke 10% yang sangat menakutkan.

- Pemisahan kesenjangan teknologi alkimia: Memperkenalkan paradigma pasca-pelatihan pertama “pembelajaran penguatan bebas terlebih dahulu, kemudian distilasi maya secara langsung”, V4-Pro-Max mendekati batas tertinggi tertutup dalam inferensi dan tugas Agen.

- Suara yang dibayar dengan emas dan perak: GPT-5.5 hanya mendorong NVIDIA naik 4.2% dalam sehari sebelum mencapai puncak, manakala V4, dengan sumber terbuka sepenuhnya dari MIT, benar-benar memicu kenaikan berterusan pada rantai kekuatan komputasi tempatan di China dan Hong Kong.

- Logik permainan mendalam: Model tertutup menjual "cukai", model terbuka besar menjual "besi". Kehadiran V4 membuat buku catatan kekuatan komputasi pelaburan perusahaan secara privat di seluruh dunia akhirnya seimbang.

April yang penuh gejolak dewa-dewa, bersama kelesuan estetik pasaran

Gila. Semuanya gila.

Jika anda adalah seorang pemerhati yang memantau bidang AI, tiga puluh hari yang lalu kemungkinan besar akan membuat anda merasa tidak selesa secara fisiologi. Dari 26 Mac 2026 hingga 24 April, dalam masa kurang daripada sebulan, sekurang-kurangnya 11 model besar yang mempunyai kesan ketara telah dilancarkan ke pasaran secara global.

Senarai yang kelihatan seperti senarai hidangan: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance DouBao 2.5 Pro, Tencent HunYuan 3.0, Kimi K2.6 Plus.

Serta, pada 23 April pada waktu pagi, DeepSeek V4 yang dilancarkan secara senyap seperti sebuah bom dalam.

Secara purata, satu model baru dilancarkan setiap 2.7 hari. Ini adalah kelajuan yang bahkan pengurus dana tidak sempat membaca siaran persnya. Pelabur baru sahaja mendengar “melebihi parameter” dari syarikat A, dan “menghancurkan markah” dari syarikat B sudah sampai di meja mereka. Pasar sebenarnya sudah menjadi tidak peka. Apa yang disebut “pengganasan Benchmark” kini, dalam konteks persaingan yang sangat ketat, semakin menyerupai permainan nombor yang hanya untuk kesenangan sendiri.

Tetapi wang itu bijak. Atau, grafik kandil tidak pernah berbohong.

Semasa menganalisis kembali k-line aset AI AS-Cina-Hong Kong selama 30 hari ini, anda akan menemui satu realiti yang sangat kejam: Dalam "perang para dewa" ini, hanya dua titik yang mampu meninggalkan kesan berterusan di chart.

Pertama, pada 8 April, OpenAI di seberang lautan melancarkan GPT-5.5. Raja yang tak terbantahkan ini secara langsung mendorong NVIDIA naik 4.2% dalam sehari. Kemudian? Tidak ada lagi, ia mencapai puncak dalam sehari, manfaat telah habis. Semua orang menyedari bahawa raja sumber tertutup yang paling hebat sekalipun sukar untuk menggerakkan gunung modal global yang berat itu seperti dua tahun lalu.

Nod kedua, iaitu 23 hingga 24 April. Versi pra-terbit DeepSeek V4 dilancarkan. Tiada acara pelancaran yang megah, tiada promosi yang menggemparkan. Bobot terus dipasang di Hugging Face dan ModelScope, dengan lesen MIT.

Hasilnya? Ia mendorong rantai pengiraan China-Hong Kong keluar dari lonjakan berterusan.

Kenapa? Mengapa model open source berjaya melakukan perkara yang tidak dapat dilakukan oleh pelbagai pemain tertutup?

Untuk menjawab soalan ini, kita perlu bertindak seperti seorang pencerita, menjauhkan diri daripada kertas pers yang membosankan, membuka tudung enjin DeepSeek V4, dan melihat apa sebenarnya yang dipasang di dalamnya.

Menganalisis V4: Tidak lagi mempercayai estetika kekerasan parameter

Model besar. Sangat memakan biaya. Hal ini sudah diketahui semua orang.

Dalam setahun terakhir, pembuat model besar mengalami "fobia kekurangan kekuatan". Anda buat satu triliun, saya buat dua triliun. Semua orang percaya bahawa sekiranya kekuatan cukup besar, kecerdasan yang muncul akan menyelesaikan semua masalah. Tetapi ini membawa kepada kos pengiraan yang sangat menakutkan. Bekalan bijirin tuan tanah pun tidak mencukupi untuk dibakar.

DeepSeek V4 kali ini memperkenalkan dua model MoE (Mixture of Experts): V4-Pro dan V4-Flash. Mari kita lihat beberapa data inti terlebih dahulu.

V4-Pro: Jumlah parameter 1.6T (1.6 trilion), tetapi parameter yang diaktifkan setiap token hanya 49B (49 bilion).

V4-Flash: Parameter jumlah 284B (284 bilion), parameter yang diaktifkan hanya 13B (13 bilion).

Faham ke? Ini adalah pendekatan yang sangat terkawal, “menggerakkan seribu dengan empat ons”. Inti arsitektur MoE ialah tidak perlu memicu semua amaran setiap masa. Untuk tugas yang ringan seperti membunuh ayam, hantar beberapa pakar membunuh ayam; untuk tugas yang berat seperti membunuh naga, keluarkan pedang pembunuh naga. Dasar 1.6 bilion memastikan ia “telah melihat dunia dan berpengetahuan luas”; pengaktifan 490 bilion memastikan ia “bertindak pantas dan lincah”.

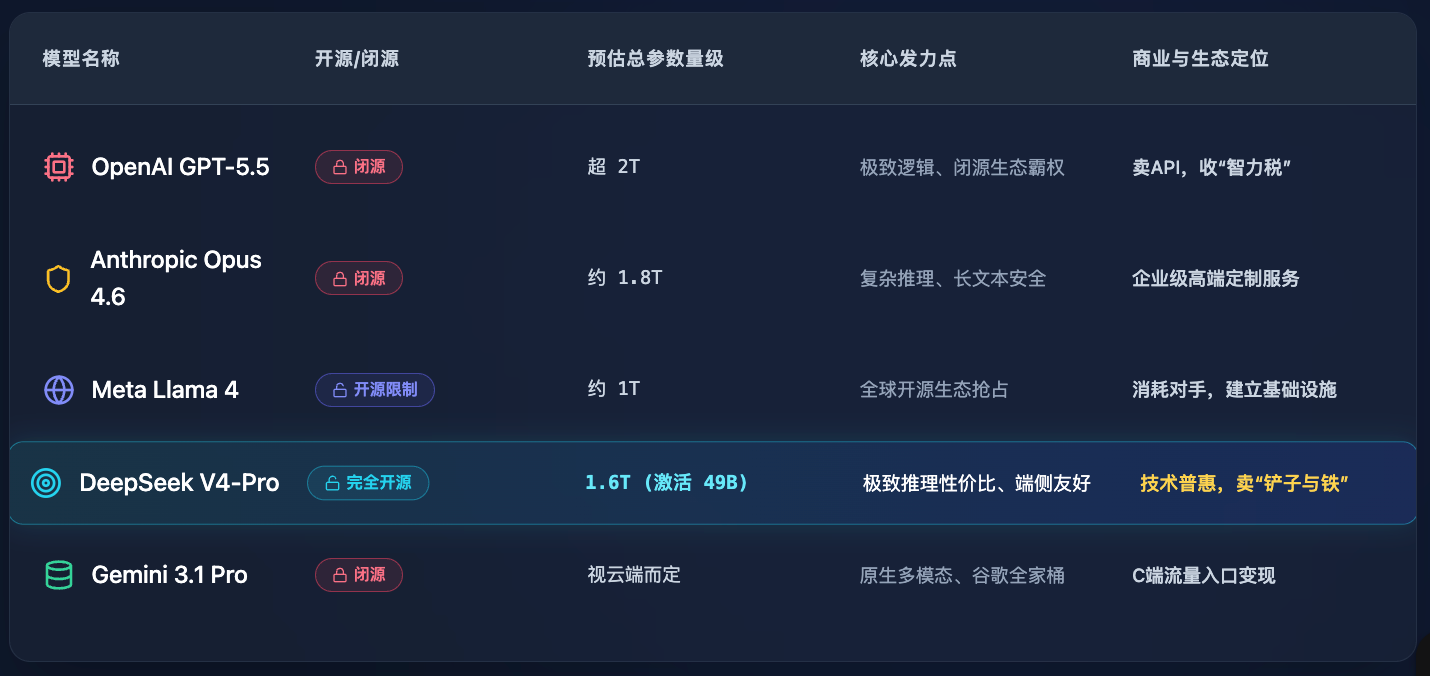

Untuk memahami perbezaan ini dengan lebih jelas, kami menyediakan jadual yang membandingkan lintasan utama di pasaran semasa (data adalah anggaran dan pengiraan awam pasaran):

Dari jadual, boleh dilihat bahawa V4-Pro tidak semata-mata mengejar melebihi GPT-5.5 dari segi jumlah parameter, tetapi ia mengarahkan semua usaha kepada “bagaimana membuat raksasa ini makan sedikit dan berlari pantas”.

Tetapi ini masih belum cukup. Yang membuat ahli terkesima ialah pemusnahan tanpa belas kasihan terhadap “pembunuh VRAM”.

Hari kematian Memory Assassin: Tiga alat pengupas arsitektur

Apakah yang dimaksud dengan "penyamun VRAM"? Ia adalah "konteks panjang (Long Context)".

Sekarang semua pihak mempromosikan sokongan konteks 1M (satu juta) token mereka. Mendengarnya memang menarik—seluruh buku "Tiga Kerajaan" boleh dimasukkan, dan ia akan membacanya dalam beberapa saat. Tetapi apakah harganya? Dalam inferens, teks panjang menghasilkan cache KV yang sangat besar (penggunaan memori GPU untuk menyimpan maklumat sejarah). Ini seperti setiap kali anda membaca satu halaman buku, anda perlu menyalin kandungan halaman sebelumnya ke papan hitam besar dan meletakkannya di hadapan anda. Apabila anda sampai kepada jutaan kata pertama, papan hitam itu begitu banyak sehingga tidak muat di ruang pusat data Zhongguancun.

Memori, lebih mahal daripada kuasa pengiraan. Ini adalah peraturan tersirat dalam industri AI.

Bagaimana DeepSeek V4 menyelesaikan masalah ini? Mereka langsung melakukan "pembedahan" pada mekanisme perhatian dasar. Ini adalah pisau pertama, sekaligus paling tajam, dalam peningkatan arsitektur mereka: mekanisme perhatian hibrida (CSA + HCA).

CSA (Compressed Sparse Attention) ditambah HCA (Heavy Compressed Attention), kedengarannya seperti bahasa火星, tetapi dalam bahasa biasa bermaksud: ia tidak lagi menghafal secara membabi buta, tetapi belajar untuk "menandai poin penting" dan "membuat nota ringkas".

Kesan ini sangat ketara: dalam konteks 1M, FLOPs (jumlah operasi titik terapung) untuk inferensi satu token V4-Pro hanyalah 27% daripada generasi sebelumnya V3.2! Lebih menakutkan lagi, cache KV hanyalah 10% daripada V3.2!

Apakah konsep ini? Ia seolah-olah tugas teks panjang sejuta perkataan yang sebelumnya memerlukan 10 pelayan teratas untuk menjalankannya sepenuhnya, kini dapat diselesaikan dengan mudah oleh hanya satu pelayan. Kos pengiraan secara langsung berkurang menjadi satu persepuluh. Ini adalah peningkatan yang menggugat seluruh peraturan.

Masih ada dua pisau.

Pisau kedua dipanggil "manifold Hyperconnection (mHC)". Model besar sebelum ini menggunakan "sambungan residu tradisional" untuk penghantaran maklumat antara lapisan, seperti menggunakan paip besi lama yang berkarat untuk mengalirkan air — tekanan tinggi akan menyebabkan kebocoran. Menghadapi data latihan awal sebanyak 32T token, paip lama tidak mampu menanggungnya. mHC seolah-olah menggantikannya dengan rangkaian gentian optik, meningkatkan ketabahan penyebaran isyarat antara lapisan. Tiada kehilangan paket, tiada penyimpangan.

Pisau ketiga, tukar minyak enjin. Tinggalkan tradisi, ganti dengan optimizer Muon. Alat ini berfungsi untuk mempercepat konvergensi. Sementara orang lain memerlukan tujuh puluh sembilan hari untuk meramu satu rencana pil, ia mungkin sudah siap dalam dua puluh hari. Masa adalah wang, masa enjin adalah dolar.

Tiga tebakan ini mengatasi penyakit kaya raya pada model besar secara menyeluruh.

Rahsia dalam perapian penyulingan: Dari perjuangan masing-masing hingga semua metode menyatu menjadi satu

Orang dalam industri model besar tahu bahawa pra-pelatihan hanya mengubah “buta huruf” menjadi “orang yang tahu banyak perkara tetapi tidak boleh berbicara”. Yang benar-benar menjadikannya seorang ahli hebat ialah pasca-pelatihan (Post-training).

DeepSeek V4 dalam latihan selepas, menggunakan strategi "dua peringkat" yang sangat ketat.

Dahulu, orang-orang melatih MoE seperti sekelompok guru mengajar seorang pelajar, mudah berkelahi. V4 buat macam mana?

Fasa pertama: "Bertindak sendiri-sendiri". Ia menggunakan pembelajaran penguatan SFT (penyempurnaan yang diawasi) dan GRPO (pengoptimuman strategi relatif kumpulan) untuk memisahkan dan melatih secara berasingan setiap "rangkaian pakar" dalam model. Pakar pengaturcaraan akan berlatih menulis kod setiap hari, manakala pakar matematik akan terus menyelesaikan soalan matematik. Tidak ada kaitan antara satu sama lain, tiada gangguan. Ini dipanggil menarik ke tahap maksimum kemampuan titik tunggal.

Tahap kedua: “Sepuluh ribu cara kembali kepada satu sumber”. Melalui teknik distilasi dalam talian, pakar-pakar yang telah menguasai seni bela diri luar biasa ini digabungkan menjadi satu model yang seragam. Tanpa pembaziran tenaga, tanpa lag.

Mari kita lihat dua "senjata utama" yang mereka paksa keluar.

Pertama ialah mod V4-Pro-Max. Ini adalah mod dengan kekuatan inferens tertinggi. Ia seakan-akan membuka kunci genetik. Menurut pengakuan mereka (dan segera disahkan oleh komuniti), dalam ujian piawai pengkodean, V4-Pro telah mencapai tahap teratas, manakala dalam tugas inferens kompleks dan Agent (agen), jurangnya dengan model tertutup terkini (seperti GPT-5.5, Opus 4.6) telah berkurang secara ketara.

Kedua ialah V4-Flash-Max. Ini lebih menarik. Ia adalah makhluk kecil dengan saiz hanya 284B, tetapi selepas diberi anggaran pemikiran yang mencukupi, prestasi penalarannya boleh mendekati Pro. Apa yang ini tunjukkan? Ia menunjukkan bahawa "kualiti algoritma" mulai mengatasi "ukuran parameter". Selagi anda memberinya masa yang mencukupi untuk berfikir, otak kecil pun mampu menyelesaikan masalah besar. Tentu saja, dalam hal simpanan pengetahuan murni dan tugas Agent multi-langkah yang sangat kompleks, ia masih terhad oleh ukuran parameter (kerana perutnya hanya sebesar itu), tetapi ini sudah lebih daripada mencukupi untuk kebanyakan aplikasi harian perusahaan.

Akhirnya, penyimpanan bobot digunakan dengan sangat bijak menggunakan penyimpanan presisi campuran FP4+FP8. Mempertahankan ketepatan sambil menghemat memori GPU. Setiap aspek memancarkan daya tarik ilmuwan sains yang hemat.

Untuk membandingkan dengan lebih jelas peningkatan kecekapan kejuruteraan yang dibawa oleh latihan selepas ini, mari kita sediakan jadual perbandingan indikator ketat:

Penghidu modal: Mengapa V4 menyalaikan rantai pengiraan China dan Hong Kong?

Sampai di sini, penguraian teknikal hampir selesai. Tetapi kami belum menjawab soal utama yang diajukan di awal:

Mengapa GPT-5.5 tidak mampu membuat sektor pengiraan terus bergembira, tetapi DeepSeek V4 berjaya?

Ini memerlukan kita untuk keluar dari kod dan melihat permainan ini dari sudut pandang modal dan perniagaan.

GPT-5.5 sangat kuat, tak terkalahkan kuatnya. Tetapi ia adalah sumber tertutup. Apa maksud sumber tertutup? Ia bermaksud OpenAI adalah "lubang hitam" yang besar. Jika anda ingin menggunakan keupayaannya, anda perlu membeli API-nya. Ini adalah model "pengutipan cukai". Keuntungan mengalir ke Silicon Valley, dan permintaan komputasi terpusat di pusat data awan Microsoft. Bagi pembuat peranti keras global, pusat komputasi tempatan, dan agen server setiap negara, selain memandang ke atas, mereka tidak mendapat sebahagian besar. GPT-5.5 sekuat apa pun, itu adalah perayaan orang lain. NVIDIA naik sedikit kerana orang percaya OpenAI akan membeli lebih banyak kad lagi.

Tetapi DeepSeek V4 berbeza.

Ia adalah sumber terbuka. Dan ia dilisensikan di bawah lesen MIT yang sangat permissive. Lesen MIT adalah pemberian paling murah hati di kalangan sumber terbuka, bermakna syarikat komersial boleh menggunakannya, memodifikasinya, dan menjualnya secara percuma tanpa kebimbangan risiko undang-undang.

Yang lebih mematikan, kami sebelumnya telah menghabiskan banyak ruang untuk membuktikan bahawa V4 mengurangkan kos inferens model dan penggunaan memori GPU hingga ke pergelangan kaki.

Menggabungkan kedua perkara ini, anda akan mendapat kesimpulan yang membuat pasaran modal gila: titik kritikal untuk pelaksanaan persendirian telah tiba.

Dahulu, apabila syarikat ingin mengendalikan model besar lebih daripada 1T sendiri, sekali lihat senarai harga peranti, mereka diam-diam menutupnya dan berpaling untuk membeli API. Sekarang, V4 memberitahu semua orang: anda hanya memerlukan sedikit mesin untuk menjalankan otak super di tempat yang hampir setara dengan GPT-4 atau bahkan menantang tahap GPT-5.5. Data tidak perlu keluar dari negeri, tidak perlu keluar dari negara, benar-benar selamat.

Kerana semua orang kini boleh menjalankannya secara tempatan, apakah yang akan berlaku seterusnya?

Beli mesin! Beli pelayan! Beli modul cahaya! Bina pusat komputasi pintar!

Perusahaan tertutup menjual cukai intelek, manakala perusahaan sumber terbuka pada dasarnya sedang mempromosikan produk kepada pembuat peranti keras seluruh industri. DeepSeek V4 ialah orang yang melepaskan api permulaan itu. Semakin mudah digunakan dan semakin terbuka sumbernya, permintaan akan kapasiti pengiraan tempatan di tempat seperti China, Hong Kong, dan Taiwan akan meledak. Perusahaan-perusahaan yang membuat pemasangan pelayan, pendinginan cecair, dan pengurusan pusat data akhirnya melihat keuntungan nyata dari pelaksanaan berskala besar.

Inilah sebabnya rantai pengiraan Tiongkok-Hong Kong melonjak berterusan segera selepas V4 dilancarkan pada 23 April. Modal bukan membayar untuk perasaan, tetapi modal sedang menempatkan diri awal untuk “gelombang pelaksanaan persendirian di ribuan industri” yang akan datang.

Ini, adalah strategi perniagaan asas yang terbuka.

Penutup: Pasang surut dan batu karang

Tiga puluh hari yang gila ini, sebelas model besar, seperti pertunjukan kembang api yang ribut.

Raksasa-raksasa saling mengayunkan dana dalam arena parameter, berusaha menghancurkan lawan dengan pukulan kuat kekuatan pengiraan. Tetapi setelah keributan berlalu, yang sering kali bertahan dan mengubah lanskap industri bukanlah yang paling berisik.

Kehadiran DeepSeek V4 seperti seorang pembunuh bayaran yang tenang. Ia tidak berlumba dengan anda untuk melihat siapa yang menghabiskan lebih banyak wang, tetapi hanya menyerang titik lemah paling kritikal: memotong penggunaan memori GPU yang tidak perlu, menurunkan rintangan pelaksanaan, dan menjadikan permainan tinggi menjadi permainan rakyat.

Dalam pertempuran AI yang dikenal sebagai "Ragnarok" ini, era pengumpulan parameter secara sembarangan sedang berakhir dengan cepat. Medan pertempuran masa depan akan menjadi milik mereka yang dapat menemukan keseimbangan sempurna antara "kinerja ekstrem" dan "kecekapan kejuruteraan".

Arus populariti akan surut, dan selepas surut, baru kita tahu siapa yang berenang tanpa pakaian, dan siapa yang merupakan karang yang tak tergoyahkan.

V4 telah menghantar senjata kepada semua orang. Seterusnya, lihat bagaimana para pangeran berbeza akan mendirikan kem di tanah baru ini.

Setelah memahami lapisan ini, ketika anda mendengar keriuhan yang sering menyebut “pelancaran mengejutkan” atau “mendefinisikan semula”, mungkin anda akan menjadi lebih tenang dan kurang cemas.

Setelah semua, seindah apa pun sihirnya, akhirnya ia harus berakhir di buku kira-kira, dihitung seimbang beberapa syiling kecil.

Sumber rujukan:

- Pratinjau Siri DeepSeek V4, Pelancaran Rasmi, DeepSeek Team, GitHub/ModelScope/HuggingFace. (2026).

- Gerakan AI April: Menganalisis Kitaran Model Besar 30 Hari, ME News Market Observer. (2026).

- Hukum Penskalaan dan Perubahan Paradigma Selepas Latihan, Jurnal Ekonomi Kecerdasan Buatan. (2026).

- Laporan Denyut Pasar Rantaian Bekalan Komputasi Global (April 2026), Analitik Data Kewangan Pan-Asia. (2026).