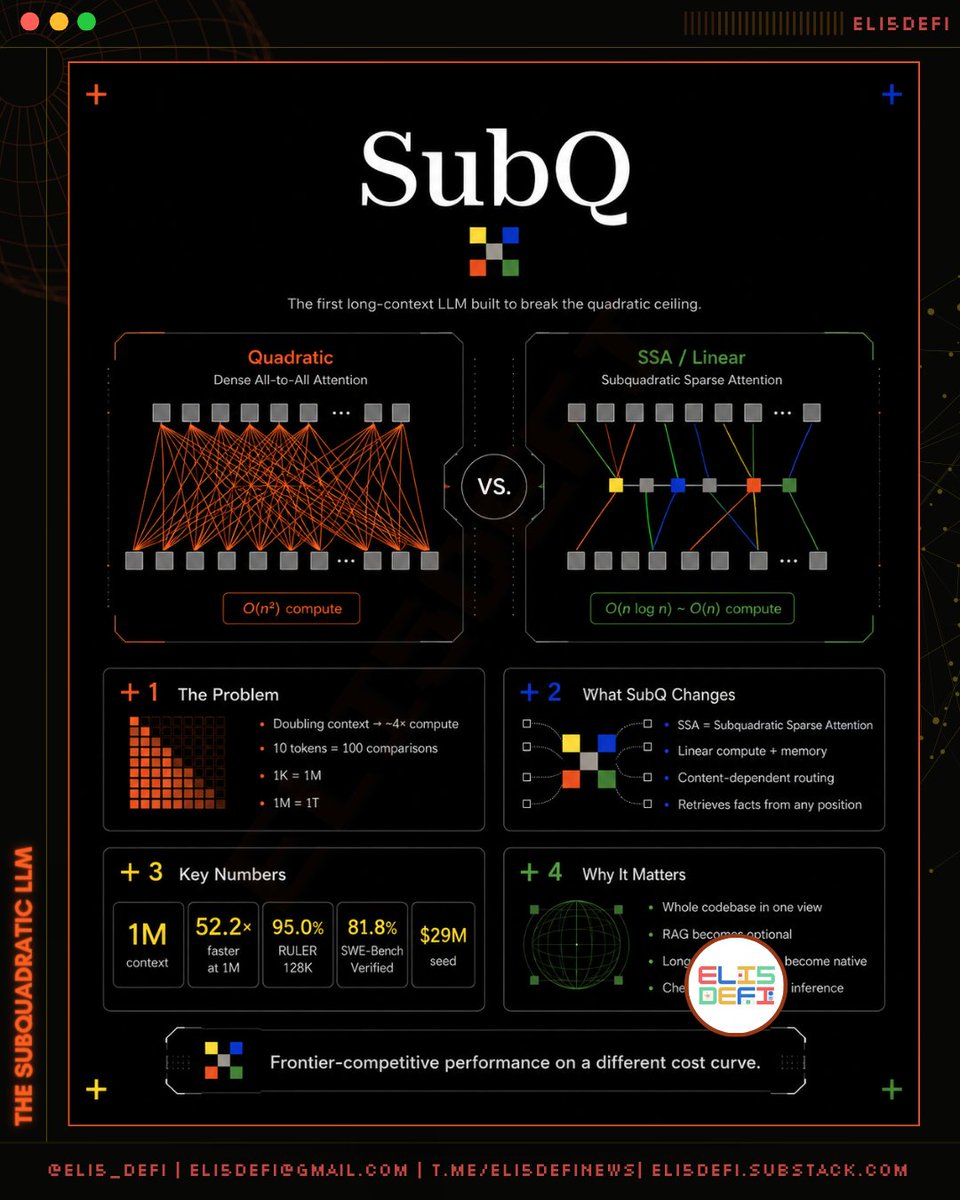

Sebuah perusahaan AI baru bernama @subquadratic baru saja merilis model yang memecahkan salah satu batasan tertua dalam AI modern. Untuk memahami mengapa hal ini penting, Anda perlu memahami satu masalah matematika yang secara diam-diam membentuk setiap chatbot yang pernah Anda gunakan. - ➠ Masalahnya: AI Membaca dalam Pasangan, dan Pasangan Tidak Bisa Diskalakan Setiap LLM modern (ChatGPT, Claude, Gemini) membaca teks dengan memeriksa bagaimana setiap kata berhubungan dengan setiap kata lainnya. Itu terdengar wajar sampai Anda melakukan perhitungannya: ▸ 10 kata → 100 perbandingan ▸ 1.000 kata → 1 juta perbandingan ▸ 1 juta kata → 1 triliun perbandingan Menggandakan input tidak menggandakan pekerjaan. Ia mengkuadratkan pekerjaannya. Ini disebut skala kuadratik, dan telah tertanam dalam AI sejak 2017. Apa artinya bagi Anda: ▸ Dokumen panjang menjadi mahal dengan cepat ▸ Model sering melewatkan fakta yang tersembunyi jauh di dalam input panjang ▸ Seluruh basis kode atau perpustakaan penelitian tidak muat Sekarang Anda tahu mengapa, semakin panjang konteksnya, semakin bodoh dan mahal LLM Anda menjadi. - ➠ Bagaimana AI Saat Ini Menyembunyikan Masalah Ini Industri membangun solusi sementara alih-alih memperbaiki matematikanya: ▸ RAG: mesin pencari mengambil beberapa potongan relevan, lalu hanya memberikan itu ke model ▸ Chunking: dokumen panjang dipotong menjadi potongan-potongan kecil ▸ Sistem agen: beberapa panggilan AI menangani bagian-bagian berbeda, disatukan dengan kode ▸ FlashAttention: trik memori cerdas yang membuat perhitungan mahal yang sama berjalan lebih cepat Semua ini berfungsi, tetapi tidak ada yang memperbaiki masalah sebenarnya. Seluruh tumpukan AI modern (database vektor, pipeline pencarian, teknik prompt) ada karena model tidak bisa menampung seluruhnya dalam pandangan sekilas. — ➠ Apa yang Dilakukan SubQ Secara Berbeda SubQ menggunakan pendekatan baru yang disebut SSA (Subquadratic Sparse Attention). Idenya dalam satu kalimat: alih-alih membandingkan setiap kata dengan setiap kata lainnya, model menentukan kata-kata mana yang benar-benar penting untuk pertanyaan tersebut, dan mengabaikan sisanya. Ini mengubah skala dari kuadratik menjadi linier. Menggandakan input sekarang menggandakan pekerjaan, bukan mengkuadratkannya. Bagian sulitnya bukan ide itu, karena orang sudah pernah mencoba ini sebelumnya. Setiap upaya sebelumnya mengorbankan sesuatu: akurasi, kemampuan menemukan fakta yang tersembunyi jauh di dalam teks, atau efisiensi itu sendiri. Subquadratic, yang didirikan oleh @alex_whedon, mengklaim mereka akhirnya berhasil memecahkan ketiganya sekaligus. — ➠ Bukti Nyata Benchmarks yang diverifikasi pihak ketiga: ▸ Setara dengan Claude Opus 4.6 pada RULER 128K (tes penalaran konteks panjang) ▸ Mengalahkan Opus 4.7, GPT 5.4, dan Gemini 3.1 Pro pada MRCR v2 (retrieval multi-bukti), tetapi kalah dari Opus 4.6 dan GPT 5.5 ▸ Mengalahkan Opus 4.6 dan Gemini 3.1 Pro pada SWE-Bench (tugas pemrograman nyata), tertinggal dari Opus 4.7 ▸ 52× lebih cepat daripada FlashAttention pada 1 juta token ▸ Versi penelitian mampu menangani 12 juta token dengan sekitar 1.000× lebih sedikit komputasi perhatian dibandingkan model frontier lainnya Dengan ringkas, ini bukan "model terbaik di dunia." Ini adalah akurasi tingkat frontier dengan kurva biaya yang secara fundamental lebih murah. — ➠ Di Mana Sam Altman Masuk Dua klaim terbesar Altman secara publik menunjuk pada masalah yang sama yang sedang dipecahkan SubQ. Tentang biaya: Dalam posting blog Februari 2025-nya "Three Observations", Altman menulis bahwa biaya penggunaan AI turun sekitar 10× setiap 12 bulan. Ia menyebut ini "jauh lebih kuat" daripada Hukum Moore. Tesisnya: inferensi yang lebih murah adalah kekuatan dominan yang membentuk apa yang bisa menjadi AI. Tentang ukuran: Kembali ke 2023, Altman mengatakan era model yang semakin besar telah berakhir, dan persaingan sebenarnya adalah kemampuan per dolar. Ia membandingkan perlombaan jumlah parameter dengan perlombaan GHz pada chip tahun 1990-an. Sumbu yang salah. SubQ mengambil kedua taruhan ini secara harfiah. Tagline mereka adalah "Efisiensi adalah kecerdasan." Namun kendalanya: Jalur yang dinyatakan Altman menuju AI yang lebih murah adalah kemajuan perangkat keras, optimasi perangkat lunak, dan distilasi model. Ia belum secara publik mendukung desain ulang matematika perhatian itu sendiri. Jadi argumen SubQ selaras dengan ekonominya, tetapi juga merupakan taruhan bahwa laboratorium besar meninggalkan satu dolar arsitektural di meja. — ➠ Mengapa Ini Penting Jika SubQ berhasil dalam skala produksi: ▸ Basis kode sebagai satu percakapan tunggal. Tidak perlu lagi sistem agen multi yang mengelola file. Model menampung seluruh repositori. ▸ RAG menjadi opsional. Banyak infrastruktur AI saat ini ada untuk mengompensasi batas kuadratik. Hilangkan batasnya, dan kerangka pendukungnya menjadi beban. ▸ Agen jangka panjang berhenti menjadi trik. Sesi berhari-hari dengan memori persisten menjadi fitur bawaan. ▸ Aplikasi baru menjadi mungkin. Beban kerja yang terlalu mahal (tinjauan dokumen penuh, pencarian kode ekstensif, pemindaian kepatuhan) menjadi rutin. — ➠ Catatan Jujur ▸ Masih dalam beta privat. Keandalan dunia nyata belum diuji tekanan. Jadi sampai saat itu, anggap pengumuman ini sebagai teaser, bahkan banyak yang khawatir ini hanya tindakan performans. ▸ Skor MRCR v2 (65,9%) bagus tetapi masih kalah dari Opus 4.6 (78,3%) dan GPT 5.5 (74%). SSA lebih efisien, bukan secara ketat lebih mampu. ▸ Benchmarks dipublikasikan sendiri dengan verifikasi pihak ketiga. Replikasi akademis adalah ujian sejati. ▸ Hasil 12 juta token adalah model penelitian, bukan produk utama (yang 1 juta). — ➠ Kesimpulan Selama sembilan tahun, setiap AI berbasis transformer membayar pajak kuadratik yang sama. Subquadratic mengklaim mereka akhirnya menemukan cara untuk tidak membayarnya. Benchmarks menunjukkan mereka setidaknya berada di jalur yang benar. Altman telah memberi tahu industri selama tiga tahun bahwa kemampuan per dolar adalah medan pertempuran baru. SubQ adalah salah satu perusahaan pertama yang mencoba memenangkan pertarungan ini dengan mengubah matematika dasarnya, bukan menumpuk solusi sementara. Apakah mereka berhasil sekarang menjadi pertanyaan empiris publik.

Bagikan

Sumber:Tampilkan versi asli

Penafian: Informasi pada halaman ini mungkin telah diperoleh dari pihak ketiga dan tidak mencerminkan pandangan atau opini KuCoin. Konten ini disediakan hanya untuk tujuan informasi umum, tanpa representasi atau jaminan apa pun, dan tidak dapat ditafsirkan sebagai saran keuangan atau investasi. KuCoin tidak bertanggung jawab terhadap segala kesalahan atau kelalaian, atau hasil apa pun yang keluar dari penggunaan informasi ini.

Berinvestasi di aset digital dapat berisiko. Harap mengevaluasi risiko produk dan toleransi risiko Anda secara cermat berdasarkan situasi keuangan Anda sendiri. Untuk informasi lebih lanjut, silakan lihat Ketentuan Penggunaan dan Pengungkapan Risiko.