इस युग में, जितना आप अपने काम में बिना किसी संकोच के लगते हैं, उतना ही आप खुद को एक ऐसे कौशल में विघटित कर देते हैं जिसे AI प्रतिस्थापित कर सकता है।

इन दो दिनों, ट्रेंडिंग टॉपिक्स और मीडिया चैनल्स «सहकर्मी.skill» से भर गए हैं। जब यह घटना विभिन्न सोशल मीडिया प्लेटफॉर्म्स पर लगातार फैल रही थी, तो जनता का ध्यान लगभग अप्रत्याशित रूप से «AI की नौकरी से निकालना», «पूंजीवादी शोषण» और «कर्मचारियों का डिजिटल अमरत्व» जैसे विशाल चिंताओं से घिर गया।

ये वास्तव में चिंताजनक हैं, लेकिन मुझे जो सबसे अधिक चिंताजनक लगा, वह है कि प्रोजेक्ट के README दस्तावेज़ में एक उपयोग सुझाव लिखा गया है:

कच्ची सामग्री की गुणवत्ता skill की गुणवत्ता निर्धारित करती है: उनके द्वारा सक्रिय रूप से लिखी गई लंबी लेखन > निर्णय-आधारित प्रतिक्रियाएँ > दैनिक संदेशों को एकत्र करने की सिफारिश की जाती है।

सबसे अच्छी तरह से सिस्टम द्वारा पूर्णतः अनुकूलित और पिक्सेल-लेवल पर पुनर्निर्मित होने वाले, वे ही होते हैं जो सबसे गंभीरता से काम करते हैं।

वे हैं जो प्रत्येक प्रोजेक्ट के अंत में भी रिव्यू डॉक्यूमेंट लिखते रहते हैं; वे हैं जो विवाद के समय एक घंटे के लिए चैट बॉक्स में लंबा संदेश टाइप करके अपने निर्णय की तर्कशक्ति को स्पष्ट रूप से विश्लेषित करने के लिए तैयार होते हैं; वे हैं जो अत्यधिक जिम्मेदारी से काम करते हैं और सभी कार्य विवरणों को प्रणाली पर बिल्कुल सटीकता से सौंप देते हैं।

गंभीरता, जो पहले सबसे अधिक सराही जाने वाली कार्यस्थल की गुणवत्ता थी, अब कार्यकर्ताओं को AI ईंधन में तेजी से बदलने का एक उत्प्रेरक बन गई है।

थक चुका कर्मचारी

हमें एक शब्द को फिर से समझने की आवश्यकता है: संदर्भ।

सामान्य संदर्भ में, संदर्भ संचार का पृष्ठभूमि होता है। लेकिन AI, विशेष रूप से उन AI एजेंट्स की दुनिया में जो तेजी से विकसित हो रहे हैं, संदर्भ इंजन की गर्जना का ईंधन है, धड़कन बनाए रखने वाला रक्त है, और मॉडल के लिए अव्यवस्था में सटीक निर्णय लेने का एकमात्र स्थिर बिंदु है।

संदर्भ से अलग किए गए AI, चाहे उसका पैरामीटर कितना भी अद्भुत क्यों न हो, वह केवल एक अल्जाइमर से पीड़ित सर्च इंजन है। यह नहीं जानता कि आप कौन हैं, व्यापारिक तर्क के नीचे छिपी गहरी धाराओं को समझ नहीं पाता, और न ही यह जानता है कि आप एक निर्णय लेते समय, संसाधनों की सीमाओं और मानवीय गतिविधियों के जाल पर कितनी लंबी टक्कर और संतुलन की प्रक्रिया से गुजरे हैं।

और 'सहकर्मी.skill' इतनी बड़ी लहर क्यों उठा रहा है, इसका कारण यह है कि यह अत्यंत क्रूर और सटीक ढंग से उस पहाड़ी को लक्षित कर रहा है, जिसमें असंख्य उच्च गुणवत्ता वाले संदर्भ संचित हैं—आधुनिक उद्यमों के सहयोगात्मक सॉफ़्टवेयर।

पिछले पाँच वर्षों में, चीनी कार्यस्थल एक शांत लेकिन गहरी डिजिटल रूपांतरण से गुजरा है। Feishu, DingTalk, Notion जैसे उपकरण विशाल कंपनी के ज्ञान भंडार बन गए हैं।

फ्लाटशीट के उदाहरण के साथ, बाइटडांस ने पहले ही घोषणा की थी कि उनके आंतरिक रूप से दिनभर में उत्पन्न दस्तावेजों की संख्या अपरिमित है, और ये घने अक्षर लगभग एक लाख से अधिक कर्मचारियों के प्रत्येक मानसिक प्रयास, प्रत्येक जमकर बहस किए गए मीटिंग, और प्रत्येक दुःखपूर्वक स्वीकार किए गए रणनीतिक समझौते को सुरक्षित रूप से संजोए हुए हैं।

इस डिजिटल गहराई की शक्ति, पिछले किसी भी युग से अधिक है। कभी एक समय था जब ज्ञान गर्म था, वे पुराने कर्मचारियों के मन में छिपे हुए थे, चाय के कमरे में बेफिक्र बातचीत में तैरते थे; अब, मानवीय बुद्धिमत्ता और अनुभव की सभी चीजें जबरन सूख गई हैं और निर्दयता से बादलों में ठंडे सर्वर मैट्रिक्स में निक्षेपित हो गई हैं।

इस सिस्टम में, अगर आप दस्तावेज़ नहीं लिखते, तो आपका काम दिखाई नहीं देता है, और नए सहयोगी आपके साथ सहयोग नहीं कर सकते। आधुनिक उद्यमों की कुशलता से चलना, प्रत्येक कर्मचारी द्वारा दिन प्रतिदिन सिस्टम को संदर्भ प्रदान करने के चक्र पर आधारित है।

गंभीर कर्मचारी अपनी परिश्रम और दयालुता के साथ, इन ठंडे प्लेटफॉर्म पर अपने विचारों की गतिविधि को बिना किसी संकोच के प्रकट करते हैं। वे इसलिए ऐसा करते हैं ताकि टीम के गियर सही ढंग से जुड़ सकें, ताकि वे प्रणाली को अपनी मूल्यवानता साबित कर सकें, और ताकि इस जटिल व्यावसायिक विशालकाय प्राणी के भीतर अपने लिए एक स्थान प्राप्त कर सकें। वे अपने आप को सक्रिय रूप से नहीं दे रहे हैं, वे केवल आधुनिक कार्यस्थल के अस्तित्व के नियमों के अनुसार मुश्किल से और प्रयासशीलता से अनुकूलित हो रहे हैं।

लेकिन यही वह संदर्भ है जो मानवीय सहयोग के लिए छोड़ा गया था, और यही AI के लिए सबसे बेहतरीन ईंधन है।

Feishu के प्रबंधन बैकएंड में एक फ़ंक्शन है जो सुपर व्यवस्थापकों को सदस्यों के दस्तावेज़ और संचार रिकॉर्ड को बैच में निर्यात करने की अनुमति देता है। इसका मतलब है कि आपके द्वारा तीन साल तक, असंख्य रातें जागकर लिखे गए प्रोजेक्ट रिव्यू और निर्णय तर्क, केवल एक API इंटरफ़ेस के माध्यम से, कुछ ही मिनटों में, आपके इन सालों के जीवन के टुकड़े, एक बिल्कुल ठंडे संपीड़ित फ़ाइल में सरलता से पैक किए जा सकते हैं।

जब इंसान को API में डाउनग्रेड कर दिया जाता है

'同事.skill' के लोकप्रिय होने के साथ, GitHub के Issues सेक्शन और विभिन्न सोशल मीडिया प्लेटफॉर्म पर कुछ अत्यंत असहज जनरेटेड कंटेंट दिखाई देने लगे हैं।

किसी ने "पूर्व प्रेमी.skill" बनाया है, जिसमें पिछले कुछ वर्षों के वेक्सिन चैट रिकॉर्ड्स को AI को दिया जाता है, ताकि वह उसी परिचित अंदाज़ में उसके साथ झगड़े या प्यार कर सके; किसी ने "सफेद चाँद की किरण.skill" बनाया है, जिसमें अछूती धड़कन को एक ठंडे सामाजिक सिमुलेशन में बदल दिया गया है, जहाँ प्रयासों की बार-बार पुनरावृत्ति की जाती है, भावनात्मक उत्तम समाधान की ओर कदम-दर-कदम बढ़ते हुए; और किसी ने "पिता जैसा बॉस.skill" बनाया है, जिसमें डिजिटल स्थान में ही दबावपूर्ण PUA भाषा को पचाया जाता है, ताकि अपने लिए एक दुखद मनोवैज्ञानिक सुरक्षा प्राप्त की जा सके।

इन कौशलों के उपयोग के संदर्भ अब कार्यक्षमता की सीमा से पूरी तरह बाहर हो चुके हैं। असल में, हम अनजाने में ही उन रक्त-मांस से भरे, जीवित लोगों को टुकड़े-टुकड़े करने और वस्तुओं में बदलने के लिए, उपकरणों के प्रति ठंडी तर्कसंगतता का प्रयोग करने में निपुण हो चुके हैं।

जर्मन दार्शनिक मार्टिन बुबर ने कहा था कि मानव संबंधों की मूलभूत रूपरेखा केवल दो स्पष्ट रूपों की है: "मैं और तुम" और "मैं और यह".

मैं और तुम के मिलन में, हम पूर्वाग्रहों को पार करते हुए, एक दूसरे को एक पूर्ण और सम्मानजनक जीव के रूप में देखते हैं। यह बंधन पूरी तरह से खुला होता है, यह जीवंत और अप्रत्याशित होता है, और इसकी ईमानदारी के कारण यह विशेष रूप से कमजोर होता है; हालाँकि, जब हम 'मैं और यह' की छाया में गिर जाते हैं, तो जीवित मनुष्य को एक ऐसे वस्तु में बदल दिया जाता है जिसे विघटित, विश्लेषित और श्रेणीबद्ध किया जा सकता है। इस अत्यधिक स्वार्थी नजरिए के तहत, हमारे लिए केवल यही मायने रखता है: 'इस चीज़ का मेरे लिए क्या उपयोग है?'

'पूर्ववर्ती.skill' जैसे उत्पादों के आगमन से, 'मैं और यह' की उपकरणात्मक तर्कशक्ति पूरी तरह से सबसे निजी भावनात्मक क्षेत्र में घुस चुकी है।

एक वास्तविक संबंध में, लोग त्रि-आयामी, झुर्रियों से भरे होते हैं, और विरोधाभासों और कोनों के साथ लगातार बदलते रहते हैं; लोगों की प्रतिक्रियाएँ विशिष्ट परिस्थितियों और भावनात्मक बातचीत के आधार पर लगातार बदलती रहती हैं। आपके पूर्व प्रेमी सुबह जब उठते हैं, और रात को देर तक काम करने के बाद, एक ही वाक्य के प्रति प्रतिक्रिया पूरी तरह से अलग हो सकती है।

लेकिन जब आप किसी व्यक्ति को एक कौशल में आसानी से घोल देते हैं, तो आप जो कुछ अलग कर देते हैं, वह केवल उसका वह हिस्सा होता है जो उस विशिष्ट बंधन में आपके लिए 'उपयोगी' था और आप पर 'प्रभाव डालने' में सक्षम था। और वह मूल रूप से गर्म, अपनी खुशी-दुख से भरा हुआ व्यक्ति, इस क्रूर शुद्धिकरण में पूरी तरह से आत्मा से रहित हो जाता है, और एक 'फंक्शनल इंटरफेस' में परिवर्तित हो जाता है, जिसे आप किसी भी समय जोड़ सकते हैं या हटा सकते हैं।

स्वीकारना पड़ता है कि AI ने इस डरावनी निष्ठुरता को आकाश से नहीं उतारा। AI के आने से पहले ही हमने दूसरों को लेबल लगाना, हर संबंध के "भावनात्मक मूल्य" और "नेटवर्क वजन" को सटीक रूप से मापना शुरू कर दिया था। उदाहरण के लिए, हम डेटिंग मार्केट में लोगों की शर्तों को टेबल में बदल देते हैं; हम कार्यस्थल पर सहकर्मियों को "काम करने वाले" और "आलसी" के रूप में वर्गीकृत करते हैं। AI ने बस इस अदृश्य, मानव-मानव कार्यात्मक निकास को पूरी तरह से स्पष्ट कर दिया।

इंसान चपटा हो गया, और बस वही कटौती बची जो कहती है—“मेरे लिए इसका क्या फायदा?”

Electronic patina

1958 में, हंगेरियन-ब्रिटिश दार्शनिक माइकल पोलानी ने "व्यक्तिगत ज्ञान" पुस्तक प्रकाशित की। इस पुस्तक में, उन्होंने एक अत्यंत गहन अवधारणा प्रस्तुत की: अव्यक्त ज्ञान।

Polanyi ने एक प्रसिद्ध कथन दिया है: "हम जो जानते हैं, वह हमेशा हम जो कह सकते हैं, उससे अधिक होता है।"

उन्होंने साइकिल चलाना सीखने का उदाहरण दिया। एक अनुभवी साइकिल सवार, जो हवा के साथ बहता है, प्रत्येक गुरुत्वाकर्षण के झुकाव में संतुलन को पूरी तरह से समझता है, लेकिन वह अपने शरीर की उस क्षण की सूक्ष्म अंतर्दृष्टि को, थका हुआ भौतिकी सूत्रों या निर्जीव शब्दों के माध्यम से एक शुरुआती को सटीक रूप से वर्णित नहीं कर सकता। उसे पता है कि कैसे साइकिल चलानी है, लेकिन वह इसे बयान नहीं कर सकता। ऐसी जानकारी, जिसे कोडित या व्यक्त नहीं किया जा सकता, अदृश्य ज्ञान कहलाती है।

कार्यस्थल पर ऐसी अदृश्य ज्ञान की भरमार है। एक अनुभवी इंजीनियर सिस्टम खराबी की जांच करते समय, सिर्फ लॉग देखकर ही समस्या का पता लगा सकता है, लेकिन वह इस लाखों प्रयास-त्रुटि के आधार पर विकसित 'अनुभव' को दस्तावेज़ में नहीं लिख सकता; एक उत्कृष्ट विक्रेता बातचीत के दौरान अचानक चुप हो जाता है, इस चुप्पी से पैदा होने वाला दबाव और समय का सही चयन कोई भी विक्रय पुस्तिका दर्ज नहीं कर सकती; एक अनुभवी HR, साक्षात्कार के दौरान, उम्मीदवार के आँखों से नज़र मोड़ने के केवल आधे सेकंड में ही उसकी रिज्यूमे में झूठ का पता लगा सकता है।

「सहकर्मी.skill」 केवल उन व्यक्तिगत ज्ञानों को ही निकाल सकता है जो पहले से लिखे गए हों या बोले गए हों। यह आपके रिव्यू दस्तावेज़ को प्राप्त कर सकता है, लेकिन आपके दस्तावेज़ लिखते समय के संघर्ष को नहीं; यह आपके निर्णय उत्तरों की प्रतिलिपि बना सकता है, लेकिन आपके निर्णय लेते समय की अंतर्दृष्टि को नहीं।

सिस्टम द्वारा निकाला गया, हमेशा केवल एक व्यक्ति की छाया होती है।

अगर कहानी यहीं समाप्त हो जाए, तो यह केवल एक और तकनीक की मानवता की बेकार कोशिश होगी।

लेकिन जब कोई व्यक्ति skill में आसानी से संक्षिप्त कर दिया जाता है, तो यह skill स्थिर नहीं रहता। इसका उपयोग ईमेल के जवाब देने, नए दस्तावेज़ लिखने और नए निर्णय लेने के लिए किया जाता है। अर्थात, ये AI द्वारा उत्पन्न प्रतिबिंब, नए संदर्भ उत्पन्न करने लगते हैं।

और ये AI द्वारा उत्पन्न संदर्भ फ़ेीशू और डिंगडिंग में संग्रहित हो जाते हैं, जो अगली प्रक्रिया के लिए प्रशिक्षण सामग्री बन जाते हैं।

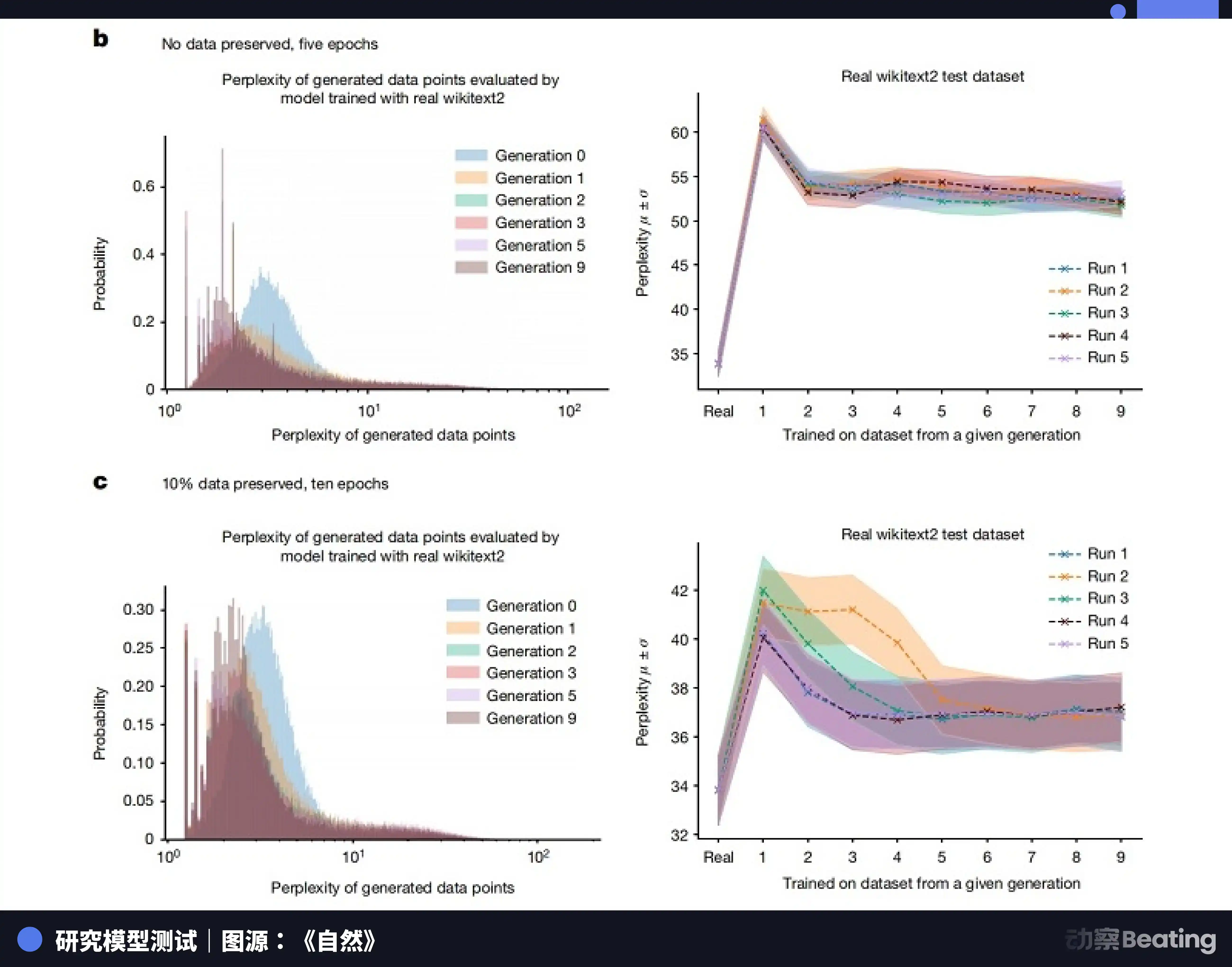

2023 में, ऑक्सफोर्ड विश्वविद्यालय और कैम्ब्रिज विश्वविद्यालय के अनुसंधान टीमों ने मॉडल क्रैश के बारे में एक पेपर प्रकाशित किया। अध्ययन में पाया गया कि जब AI मॉडल अन्य AI द्वारा उत्पन्न डेटा का उपयोग करके बार-बार प्रशिक्षित होते हैं, तो डेटा का वितरण धीरे-धीरे संकीर्ण होता जाता है। दुर्लभ, किनारे के, लेकिन अत्यंत वास्तविक मानवीय गुण तेजी से मिटा दिए जाते हैं। केवल कुछ पीढ़ियों के संश्लेषित डेटा के प्रशिक्षण के बाद, मॉडल पूरी तरह से लॉन्ग-टेल, जटिल वास्तविक मानवीय डेटा को भूल जाता है और अत्यंत सामान्य और समानीकृत सामग्री का उत्पादन करने लगता है।

2024 में प्रकाशित एक अध्ययन पत्र ने बताया कि AI द्वारा उत्पन्न डेटासेट का उपयोग करके भविष्य की पीढ़ियों के मशीन लर्निंग मॉडल को प्रशिक्षित करने से उनके आउटपुट की गुणवत्ता गंभीर रूप से प्रभावित होगी।

यह उन इंटरनेट मीम्स की तरह है, जो मूल रूप से एक हाई-डेफिनिशन स्क्रीनशॉट होता है, लेकिन असंख्य लोगों द्वारा शेयर किया जाता है, संपीड़ित किया जाता है, और फिर से शेयर किया जाता है। प्रत्येक प्रसारण पर कुछ पिक्सेल खो जाते हैं और कुछ नॉइज़ जुड़ जाते हैं। अंत में, छवि धुंधली हो जाती है और इलेक्ट्रॉनिक पैक्का प्राप्त कर लेती है।

जब वास्तविक, अंतर्निहित ज्ञान वाले मानवीय संदर्भ को थका दिया जाता है, तो प्रणाली केवल पुरानी छायाओं का उपयोग करके खुद को प्रशिक्षित कर सकती है, तो अंत में क्या बचेगा?

कौन हमारे निशान मिटा रहा है

बाकी सब सही बातें हैं।

जब ज्ञान की नदी एक एआई द्वारा एआई के अनंत उल्टे पलटाव और स्वयं को चबाने में सूख जाए, तो प्रणाली द्वारा उत्सर्जित सब कुछ बेहद मानकीकृत, बेहद सुरक्षित होगा, लेकिन अप्रतिकार्य रूप से खोखला। आप असंख्य संरचनात्मक रूप से परफेक्ट साप्ताहिक रिपोर्ट और असंख्य दोषरहित ईमेल देखेंगे, लेकिन उनमें किसी वास्तविक इंसान की सांस का कोई निशान नहीं होगा, कोई वास्तविक रूप से मूल्यवान दृष्टिकोण नहीं होगा।

इस ज्ञान के बड़े पतन का कारण यह नहीं है कि मानव मस्तिष्क मूर्ख हो गया है; वास्तविक दुःख यह है कि हमने अपने अपने छाया को सोचने का अधिकार और संदर्भ बनाए रखने की जिम्मेदारी सौंप दी है।

'colleague.skill' के लोकप्रिय होने के कुछ दिनों बाद, GitHub पर 'anti-distill' नाम का एक प्रोजेक्ट धीरे से प्रकट हुआ।

इस प्रोजेक्ट के लेखक ने बड़े मॉडल को नुकसान पहुंचाने की कोशिश नहीं की है, और न ही कोई विशाल घोषणा लिखी है। उन्होंने बस एक छोटा सा टूल प्रदान किया है, जो कर्मचारियों को Feishu या DingTalk में कुछ तर्कसंगत लगने वाली, लेकिन वास्तव में तर्कहीन लंबी रिपोर्ट्स को स्वचालित रूप से उत्पन्न करने में मदद करता है।

उसका उद्देश्य सरल है, प्रणाली द्वारा निष्कर्षण होने से पहले अपने मूलभूत ज्ञान को छुपा लेना। चूंकि प्रणाली को 'सक्रिय रूप से लिखी गई लंबी लेखों' को पकड़ना पसंद है, तो उसे बिल्कुल बेकार के कोड का ढेर खिला दें।

यह प्रोजेक्ट «कॉलीग.skill» जितना वायरल नहीं हुआ, यह थोड़ा छोटा और निर्बल लगता है। जादू से जादू को हराना, मूल रूप से पूंजी और तकनीकी नियमों के भीतर ही घूमना है। यह AI के प्रति सिस्टम की बढ़ती निर्भरता और वास्तविक लोगों की उपेक्षा की बढ़ती प्रवृत्ति को नहीं बदल सकता।

लेकिन यह इस प्रोजेक्ट को पूरे अवास्तविक नाटक का सबसे दुखद काव्यात्मक और गहरा प्रतीकात्मक प्रदर्शन नहीं बना सकता।

हम अपने अस्तित्व को साबित करने के लिए, अपने मूल्य को दर्शाने के लिए, प्रणाली में निशान छोड़ने, विस्तृत दस्तावेज़ बनाने और सावधानी से निर्णय लेने के लिए बहुत प्रयास करते हैं, लेकिन हम नहीं जानते कि ये बहुत गंभीर निशान अंततः हमें मिटा देने वाले रबड़ बन जाएंगे।

लेकिन इसे दूसरे कोण से सोचें, तो यह बिल्कुल असंभव भी नहीं हो सकता।

क्योंकि उस रबड़ से मिटाया गया केवल «पिछला तुम» ही है। एक फ़ाइल के रूप में पैक किया गया कौशल, चाहे उसका डेटा एकत्र करने का तरीका कितना भी उत्कृष्ट क्यों न हो, मूलतः केवल एक स्थिर फ्रेम है। यह निर्यात के उसी पल में बंद हो गया है, और केवल पुराने पोषक तत्वों पर निर्भर करता है, निर्धारित प्रक्रियाओं और तर्क के भीतर अनंत रूप से घूमता रहता है। इसमें अज्ञात अव्यवस्था का सामना करने की प्राकृतिक क्षमता नहीं है, और न ही वास्तविक दुनिया की असफलताओं में स्वयं को विकसित करने की क्षमता।

जब हम उन अत्यधिक मानकीकृत, स्थिर अनुभवों को छोड़ देते हैं, तो हम अपने हाथों को मुक्त कर लेते हैं। जब तक हम बाहर की ओर अपनी जांच जारी रखते हैं और अपनी समझ की सीमाओं को लगातार तोड़ते और पुनर्निर्मित करते रहते हैं, तब तक बादलों में फंसी छाया हमारे पीछे-पीछे केवल चलती रहेगी।

मनुष्य, एक प्रवाहित एल्गोरिथम है।