मूल लेखक: कूरी, शेनचाओ टेकफ्लो

कुछ दिनों पहले एक तस्वीर ऑनलाइन बहुत वायरल हुई।

भारत ने एक AI शिखर सम्मेलन आयोजित किया, जिसमें प्रधानमंत्री मोदी मंच पर खड़े थे, और दोनों ओर सिलिकॉन वैली के बड़े नेता खड़े थे। फोटोग्राफी के समय, मोदी ने अपने पास के व्यक्ति का हाथ पकड़कर ऊपर की ओर उठा दिया, और अन्य लोगों ने भी हाथ पकड़कर साथ दिया, जिससे स्थिति बहुत सामूहिक लगी।

लेकिन, केवल दो लोगों ने हाथ नहीं पकड़ा।

OpenAI के CEO और Anthropic के CEO, जो कि ChatGPT और Claude के पीछे की दो कंपनियों के मालिक हैं, एक-दूसरे के पास खड़े हैं और अपने-अपने मुट्ठी उठाए हुए हैं।

बिना हाथ पकड़े, बिना आँखों में देखे, जैसे दो ऐसे लड़के जिन्हें शिक्षक ने एक साथ बैठाया हो।

इन दोनों कंपनियों ने पिछले कुछ वर्षों में कड़ी प्रतिस्पर्धा की है, Claude OpenAI से अलग हुए टीम द्वारा बनाया गया है, और दोनों उपयोगकर्ताओं, उद्योग ग्राहकों और निवेश के लिए प्रतिस्पर्धा कर रहे हैं; इस साल सुपर बॉल के दौरान Anthropic ने ChatGPT के विरुद्ध विज्ञापन देने के लिए खास रूप से पैसा खर्च किया।

इसलिए हाथ नहीं पकड़ना, सामान्य है।

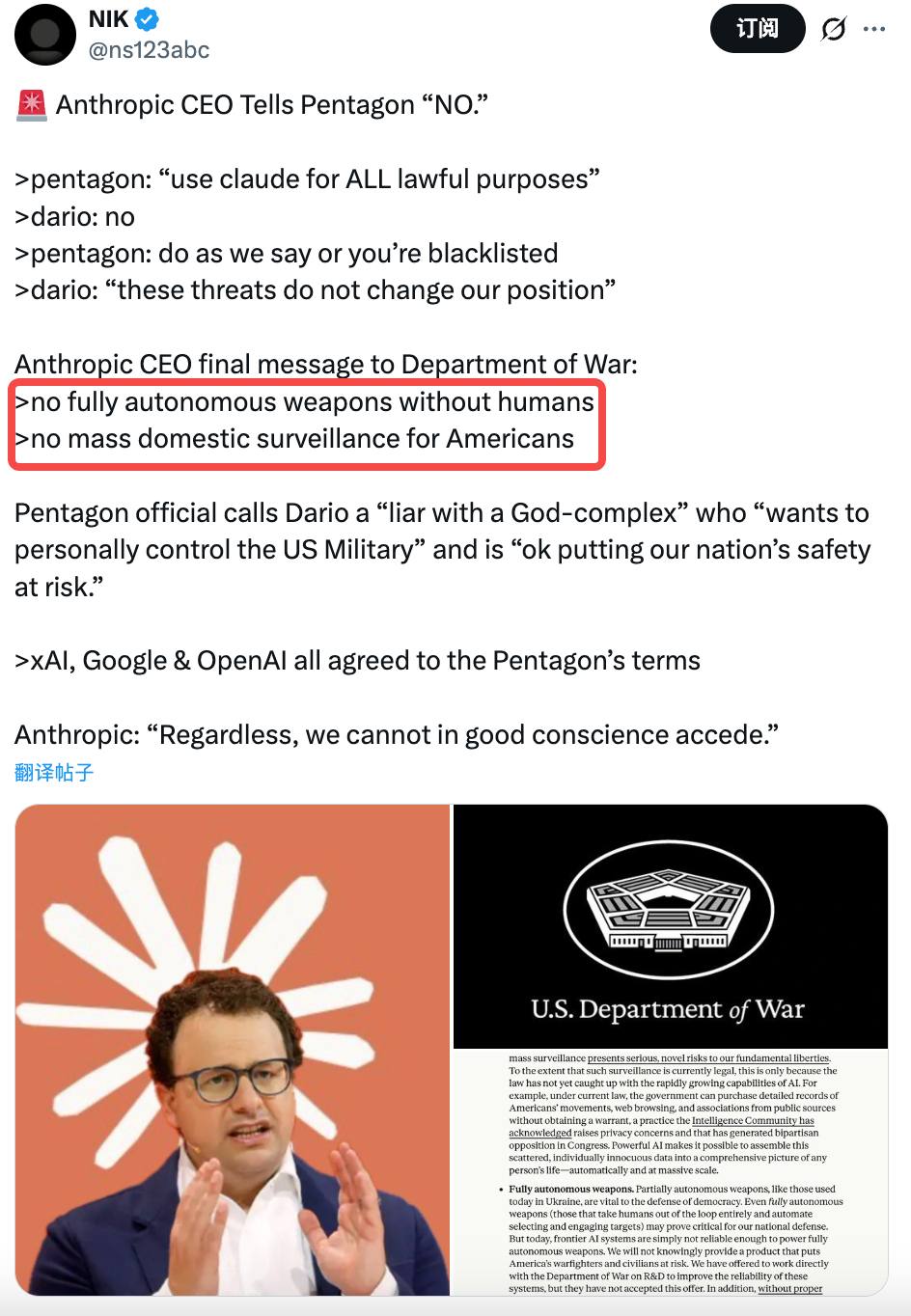

हालांकि, आज उन्होंने एक साथ हाथ पकड़ लिया। क्योंकि पेंटागन।

ऐसा है।

Anthropic, जो Claude के पीछे की कंपनी है, ने पिछले साल अमेरिकी रक्षा विभाग के साथ अधिकतम 2 अरब डॉलर का अनुबंध किया। Claude पहला AI मॉडल है जिसे अमेरिकी सेना के गुप्त नेटवर्क पर तैनात किया गया है, जो सूचना विश्लेषण, कार्य योजना आदि के कार्यों में मदद करता है।

लेकिन एंथ्रोपिक ने अपने अनुबंध में दो लाल रेखाएँ खींचीं:

Claude का उपयोग अमेरिकी नागरिकों के व्यापक निगरानी या मानवीय हस्तक्षेप के बिना स्वायत्त हथियारों के लिए नहीं किया जा सकता है। (संदर्भ पठन: Anthropic की पहचान का संकट)

लेकिन, पेंटागन स्वीकार नहीं करता।

उनकी आवश्यकता चार शब्द हैं: असीमित। उपकरण खरीदने के बाद आप इसका स्वतंत्र रूप से उपयोग करें, आप एक प्रौद्योगिकी कंपनी हैं, आपके पास अमेरिकी सेना को क्या करना है और क्या नहीं करना है, यह बताने का क्या अधिकार है?

पिछले मंगलवार, रक्षा मंत्री हेगसेथ ने एंथ्रोपिक के सीईओ को सीधे बताया कि शुक्रवार को दोपहर 5:01 बजे तक सहमति दें, वरना परिणाम स्वीकार करें।

Anthropic ने स्वीकार नहीं किया।

उनके सीईओ ने एक आम बयान जारी किया, जिसमें कहा गया: हमें जाना है कि AI का अमेरिकी रक्षा के लिए महत्व है, लेकिन कुछ मामलों में, AI लोकतंत्र के मूल्यों को नुकसान पहुंचाता है, न कि उनकी रक्षा करता है। हम इस आह्वान को अपनी निष्ठा के साथ स्वीकार नहीं कर सकते।

पेंटागन के बातचीत प्रतिनिधि, रक्षा मंत्रालय के उप मंत्री एमिल माइकल ने बाद में सोशल मीडिया पर उसे झूठा बताया और कहा कि उसे भगवान का भाव है और वह राष्ट्रीय सुरक्षा के साथ खेल रहा है।

Brief handholding

फिर, अप्रत्याशित बात हुई।

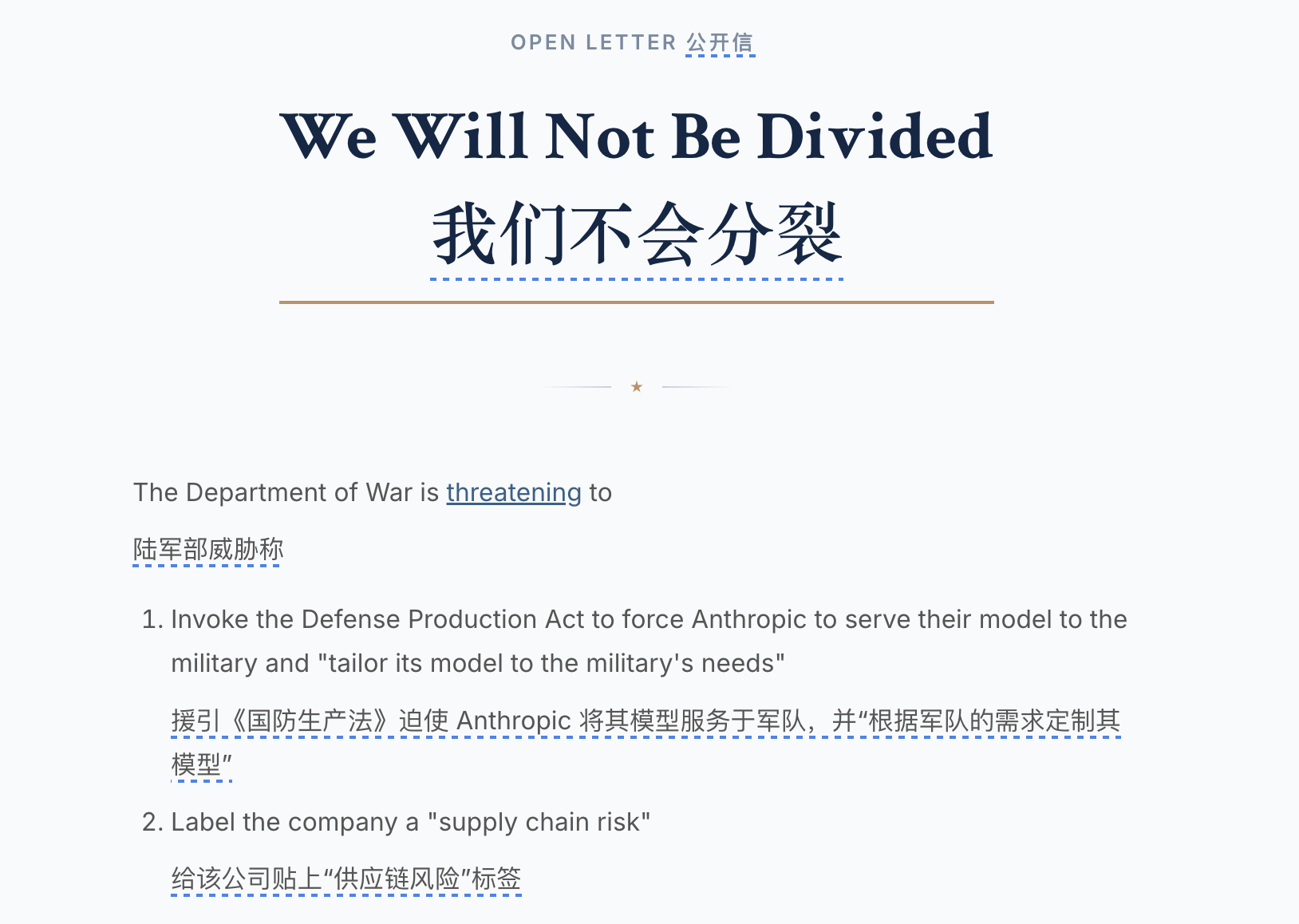

OpenAI और Google के 400 से अधिक कर्मचारियों ने एक संयुक्त खुला पत्र जारी किया, जिसका शीर्षक "हम विभाजित नहीं होंगे" है।

पत्र में कहा गया है कि पेंटागन AI कंपनियों के साथ अलग-अलग बातचीत कर रहा है, ताकि अन्य कंपनियों को Anthropic द्वारा अस्वीकार किए गए शर्तों को स्वीकार करने के लिए मजबूर किया जा सके, और हर कंपनी को डर के साथ अलग-अलग कर दिया जाए।

OpenAI के सीईओ ने सभी कर्मचारियों को एक आंतरिक पत्र भेजा, जिसमें कहा गया कि OpenAI की Anthropic के साथ एक ही लाल रेखाएँ हैं:

No mass surveillance, no autonomous lethal weapons.

कुछ ही दिनों पहले जो दो कंपनियाँ एक-दूसरे का हाथ नहीं लेना चाहती थीं, अचानक पेंटागन के समर्थन में एक ही ओर आ गईं।

हालांकि यह एकता केवल कुछ घंटों तक ही बनी रह सकती है।

शुक्रवार को दोपहर 5:01 बजे, पेंटागन की अंतिम चेतावनी का समय समाप्त हो गया। Anthropic ने हस्ताक्षर नहीं किए।

3800 अरब डॉलर की मूल्यांकन वाली एक अमेरिकी टेक कंपनी ने, 2 अरब डॉलर के अनुबंध के रद्द होने के जोखिम के बावजूद, अमेरिकी रक्षा विभाग को अस्वीकार कर दिया। पहले ऐसा होता तो सिर्फ अनुबंध रद्द होकर एक अन्य आपूर्तिकर्ता से बदल दिया जाता। लेकिन इस बार वाशिंगटन की प्रतिक्रिया पूरी तरह से व्यावसायिक स्तर की नहीं थी।

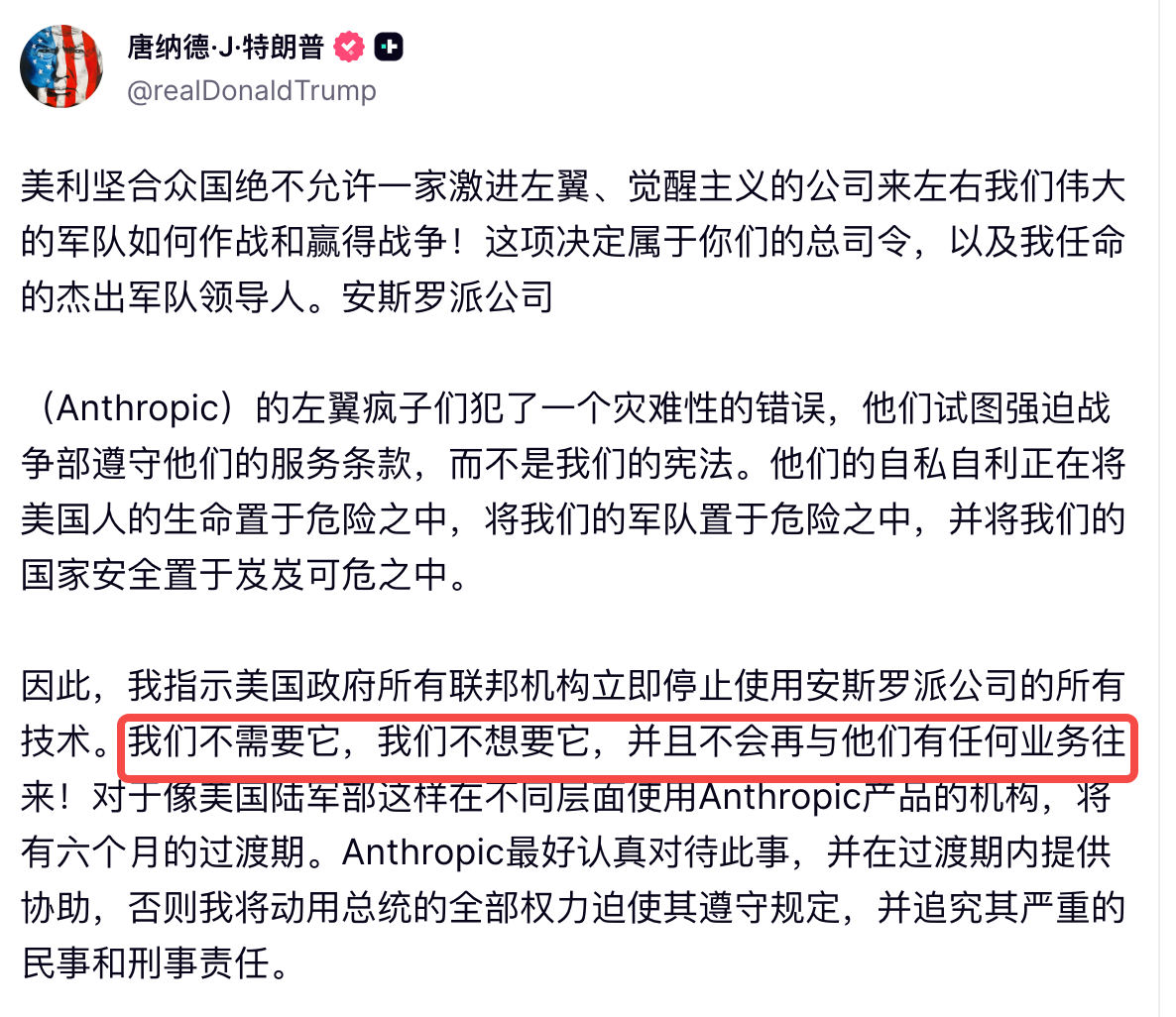

ट्रम्प लगभग एक घंटे बाद ट्रुथ सोशल पर एक पोस्ट कर रहे हैं, जिसमें उन्होंने एंथ्रोपिक को "बाएं पक्ष के पागल" कहा और कहा कि वे संविधान के ऊपर आने की कोशिश कर रहे हैं और अमेरिकी सैनिकों की जानों के साथ खेल रहे हैं।

उसने सभी संघीय एजेंसियों से अन्थ्रोपिक की तकनीक का तुरंत उपयोग बंद करने का आह्वान किया।

इसके तुरंत बाद, अमेरिकी रक्षा मंत्री हेगसेथ ने एंथ्रोपिक को "आपूर्ति श्रृंखला सुरक्षा जोखिम" के रूप में सूचीबद्ध करने की घोषणा की। यह लेबल आमतौर पर हुआवेई जैसी कंपनियों के लिए आरक्षित है। इसका मतलब स्पष्ट है, सभी सैन्य ठेकेदार अब एंथ्रोपिक के उत्पादों का उपयोग नहीं कर सकते।

Anthropic ने कहा है कि वह मुकदमा दायर करेगा।

उसी रात, जिस रात ओपनएआई ने पहले एक ही स्थिति पर बने रहने का वादा किया था, उसने पेंटागन के साथ एक समझौता किया।

ideological issues

OpenAI को क्या मिला?

क्लॉड के हटाए जाने के बाद खाली हुए स्थान पर: अमेरिकी सैन्य गुप्त नेटवर्क के AI आपूर्तिकर्ता। हालाँकि, OpenAI ने पेंटागन को तीन शर्तें रखीं: व्यापक निगरानी नहीं, स्वायत्त हथियार नहीं, और उच्च जोखिम वाले निर्णयों में मानवीय सहभागिता अनिवार्य।

पेंटागन ने कहा, ठीक है।

आपने सही सुना। कुछ हफ्तों तक Anthropic द्वारा स्वीकार न किए गए शर्तों को एक अन्य कंपनी द्वारा प्रस्तुत किए जाने पर कुछ दिनों में समझौता हो गया?

Of course, the two sides' proposals are not exactly the same.

Anthropic ने एक और स्तर जोड़ा है: वे मानते हैं कि वर्तमान कानून AI की क्षमताओं के साथ चल नहीं पा रहे हैं, जैसे कि AI आपके स्थान डेटा, ब्राउज़िंग इतिहास, सोशल मीडिया जानकारी को कानूनी रूप से खरीद सकता है, कानूनी रूप से संग्रहीत कर सकता है, और अंतिम परिणाम निगरानी के समान हो सकता है, लेकिन प्रत्येक चरण कानूनी है।

Anthropic कहती है कि आप केवल "नो मॉनिटरिंग" चार शब्द लिखने से काम नहीं चलेगा, इस वैकुंट को भरना होगा। OpenAI ने इस बात पर ज़िद नहीं की, उन्होंने पेंटागन के बयान को स्वीकार कर लिया कि वर्तमान कानून पर्याप्त हैं।

लेकिन अगर आपको लगता है कि यह केवल एक शर्त में अंतर है, तो यह बहुत निर्दोष होगा। यह बातचीत शुरू से ही केवल शर्तों पर नहीं थी।

व्हाइट हाउस के AI सैल डेविड सैक्स ने पहले ही Anthropic की "woke AI" (आइडियोलॉजी पहले, राजनीतिक सही ढंग से काम करने की कोशिश) की आलोचना की थी; पेंटागन के एक उच्च स्तरीय अधिकारी ने मीडिया को बताया कि डैरियो की समस्या आइडियोलॉजी-संचालित है, "हम जानते हैं कि हम किसके साथ काम कर रहे हैं"।

एलन मस्क की xAI, जो स्वयं Anthropic की सीधी प्रतिस्पर्धी है, ने इस हफ्ते X पर Anthropic पर हमला किया और कहा कि यह कंपनी "पश्चिमी सभ्यता से घृणा करती है"।

और एंथ्रोपिक के सीईओ ने पिछले साल ट्रम्प की शपथ ग्रहण समारोह में भाग नहीं लिया। ओपनएआई के सीईओ गए।

Kill the chicken to scare the monkeys

तो आइए समझते हैं कि क्या हुआ।

Same principles, same red line; Anthropic, because it added an extra layer of safeguards, took the wrong side, and adopted the wrong posture, has been labeled as a national security threat on par with Huawei.

OpenAI ने एक स्तर कम रखा, अच्छे संबंध बनाए, और अनुबंध प्राप्त किया। क्या आप कहेंगे कि यह सिद्धांत की जीत है, या सिद्धांत की कीमत?

पेंटागन के अनुबंधों का बहिष्कार करना वास्तव में पहली बार नहीं है।

2018 में, गूगल के 4000 से अधिक कर्मचारियों ने एक याचिका पर हस्ताक्षर किए, और दर्जनों लोगों ने कंपनी के पेंटागन के एक प्रोजेक्ट मेवेन नामक प्रोजेक्ट में शामिल होने के विरोध में इस्तीफा दे दिया। उस प्रोजेक्ट में AI का उपयोग ड्रोन द्वारा ली गई वीडियो का विश्लेषण करने के लिए किया जाता था, ताकि सैन्य को लक्ष्यों की पहचान में तेजी आए।

Google ने अंततः चला गया। नया अनुबंध नहीं किया, चला गया। कर्मचारियों ने जीता।

8 साल बीत गए, और वही विवाद फिर से शुरू हो गया। लेकिन इस बार नियम पूरी तरह से बदल गए। एक अमेरिकी कंपनी ने मुझे सैन्य व्यापार करने की अनुमति दी, लेकिन दो चीजें करने की मनाही की। अमेरिकी सरकार की प्रतिक्रिया थी कि उसे पूरे संघीय प्रणाली से बाहर कर दिया जाए।

और "सप्लाई चेन सुरक्षा जोखिम" लेबल की प्रभावशीलता केवल 2 अरब डॉलर के अनुबंध को खोने तक सीमित नहीं है।

एंथ्रोपिक की इस साल की आय लगभग 140 अरब डॉलर है, जिसमें 2 अरब डॉलर के अनुबंध बस एक छोटा सा हिस्सा हैं। लेकिन इस लेबल का मतलब है कि कोई भी कंपनी जो अमेरिकी सेना के साथ व्यापार करती है, उसका Claude का उपयोग नहीं कर सकती।

इन कंपनियों को पेंटागन के स्थिति को स्वीकार करने की आवश्यकता नहीं है, उन्हें बस एक जोखिम मूल्यांकन करना है: Claude का उपयोग जारी रखने से सरकारी अनुबंध खो सकते हैं; एक अन्य मॉडल पर स्विच करने से कोई समस्या नहीं होगी।

चयन करना आसान है। यही इस बात का असली संकेत है।

एंथ्रोपिक कि झेल पाना या नहीं झेल पाना मायने नहीं रखता, महत्वपूर्ण बात यह है कि अगली कंपनी इसे झेलने की हिम्मत करेगी या नहीं। यह परिणाम को देखेगी, सिद्धांतों को बनाए रखने की कीमत को देखेगी, और एक बहुत ही तर्कसंगत निर्णय लेगी।

उस भारतीय फोटो को फिर से देखें, सभी लोग अपने हाथों को सिर के ऊपर उठाए हुए हैं, केवल वे दोनों अपने-अपने मुट्ठियाँ बांधे हुए हैं।

शायद यही सामान्य बात है।

AI कंपनियों के सिद्धांत समान हो सकते हैं, लेकिन हाथ जोड़ना संभव नहीं हो सकता।