ये पागलपन भरे तीस दिन, ग्यारह बड़े मॉडल, एक शोर भरी आतिशबाजी की तरह हैं।

लेखक, स्रोत: 0x9999in1, ME News

TL;DR

- अत्यधिक प्रतिस्पर्धा के तीस दिन: 26 मार्च से 24 अप्रैल तक, 11 प्रमुख मॉडल वैश्विक रूप से लॉन्च किए गए, औसतन प्रति 2.7 दिन पर एक। बाजार को गंभीर "पैरामीटर थकान" का सामना करना पड़ रहा है।

- पैरामीटर ग्रीड़ का “वजन कम करने का ऑपरेशन”: V4-Pro के कुल पैरामीटर 1.6T हैं, लेकिन केवल 49B सक्रिय हैं। CSA+HCA आर्किटेक्चर के पुनर्निर्माण के माध्यम से, 1M कॉन्टेक्स्ट के तहत FLOPs 27% तक कम हो गए हैं और KV कैश 10% तक अत्यंत डरावने ढंग से कम हो गया है।

- अलग-अलग शिक्षा और ऑनलाइन डिस्टिलेशन के साथ एक नया ट्रेनिंग पैटर्न: V4-Pro-Max ने निष्कर्षण और एजेंट कार्यों में बंद स्रोत की सीमा को छू लिया।

- असली सोना और चांदी के मत: GPT-5.5 के बाद निवेशकों ने न्वाइडिया को एक दिन में केवल 4.2% की बढ़ोतरी के साथ शीर्ष पर देखा, जबकि V4, MIT द्वारा पूरी तरह से ओपन सोर्स होने के कारण, मध्य और हांगकांग के स्थानीय कैलकुलेशन चेन को लगातार तेजी से बढ़ाने के लिए पूरी तरह से प्रेरित किया।

- गहरी खेल की तर्कशास्त्र: बंद स्रोत मॉडल "कर" बेचते हैं, ओपन सोर्स बड़े मॉडल "लोहा" बेचते हैं। V4 के आगमन से, वैश्विक उद्योग स्तरीय निजी स्थापना के कैलकुलेशन लेजर अंततः संतुलित हो गए।

April के देवताओं की तेज़ दौड़, बाजार की सौंदर्य थकान के साथ

Crazy. Everyone is crazy.

अगर आप एक ऐसे निरीक्षक हैं जो AI के क्षेत्र पर नजर रखता है, तो पिछले तीस दिन आपको शारीरिक असुविधा महसूस होने की संभावना है। 2026 की 26 मार्च से 24 अप्रैल तक, केवल एक महीने से कम के समय में, विश्वभर में कम से कम 11 प्रभावशाली मॉडल्स बाजार में उतारे गए।

सूची इतनी लंबी है जैसे किसी ने खाने का ऑर्डर दे रहा हो: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, 月之暗面 Kimi K2.6, Alibaba Qwen3-Next, ByteDance DouBao 2.5 Pro, Tencent HunYuan 3.0, Kimi K2.6 Plus.

और 23 अप्रैल की रात को, एक गहरे पानी के बम की तरह चुपचाप लॉन्च किया गया DeepSeek V4।

औसतन, हर 2.7 दिन में एक नया मॉडल जारी हो रहा है। यह उस गति से है जिससे फंड मैनेजर भी प्रेस रिलीज पढ़ने में असमर्थ हैं। निवेशक अभी तक A कंपनी के "पैरामीटर सुपीरियरिटी" को सुन रहे होते हैं, कि B कंपनी का "परफॉर्मेंस ड्रैगन" पहले ही उनके मेज पर पहुँच चुका होता है। बाजार वास्तव में बेहोश हो चुका है। उच्च स्तरीय प्रतिस्पर्धा के इस समय, "बेंचमार्क (बेंचमार्क)" का स्कोरिंग करना अधिकतर एक स्वयं के लिए डिजिटल खेल की तरह लगता है।

लेकिन पैसा बुद्धिमान होता है। या फिर, कैंडलस्टिक्स कभी झूठ नहीं बोलते।

इन 30 दिनों के चीन-अमेरिका-हांगकांग AI संपत्ति कैंडलस्टिक को देखें, आप एक अत्यंत क्रूर सच्चाई देखेंगे: इस "देवताओं के युद्ध" में, जो दो नोड्स ही बाजार पर स्थायी निशान छोड़ पाए हैं।

पहली बात, 8 अप्रैल को दूर समंदर पार OpenAI ने GPT-5.5 जारी किया। यह निर्विवाद सम्राट सीधे ही NVIDIA के शेयरों में एक ही दिन में 4.2% की तेज़ उछाल ले आया। और फिर? कुछ भी नहीं हुआ, उसी दिन शिखर दिख गया, सारी सकारात्मक खबरें निकल चुकी थीं। लोगों ने पाया कि अब कितना भी महान बंद-स्रोत सम्राट हो, उसके लिए दो साल पहले की तरह इतनी आसानी से वैश्विक पूंजी के उस भारी पहाड़ को फिर से हिला पाना बहुत मुश्किल है।

दूसरा नोड, जो 23 से 24 अप्रैल तक है। DeepSeek V4 प्रीव्यू जारी। कोई शानदार लॉन्च इवेंट नहीं, कोई शक्तिशाली प्रचार वीडियो नहीं। वेट्स सीधे Hugging Face और ModelScope पर MIT लाइसेंस के तहत अपलोड किए गए।

परिणाम? इसने चीन-हांगकांग कैलकुलेशन चेन को लगातार उछाल पर ले जाया।

क्यों? क्यों एक ओपन सोर्स मॉडल ने वह काम किया जो कई बंद स्रोत विशेषज्ञों ने नहीं किया?

इस सवाल का जवाब देने के लिए, हमें एक कथाकार की तरह काम करना होगा, थकान वाली प्रेस रिलीज़ को छोड़कर, DeepSeek V4 के इंजन कवर को खोलकर, देखना होगा कि अंदर क्या शैतान बैठा है।

V4 का विश्लेषण: पैरामीटर्स के बल के सौंदर्य पर अब भरोसा नहीं

बड़े मॉडल। बहुत पैसा खर्च होता है। यह बात सबको पता है।

पिछले वर्ष, बड़े मॉडल निर्माताओं ने "बल की कमी का डर" महसूस किया। आप ट्रिलियन करते हैं, तो मैं दो ट्रिलियन करूंगा। सभी को लगता था कि जब तक बल पर्याप्त होगा, तब तक उभरने वाली बुद्धिमत्ता सभी समस्याओं का समाधान कर देगी। लेकिन इसके साथ ही अत्यंत भयानक कैलकुलेशन लागत आई। जमींदार के घर का अतिरिक्त अनाज भी जलने के लिए पर्याप्त नहीं रहा।

DeepSeek V4 ने इस बार दो MoE (मिश्रित विशेषज्ञ) मॉडल लॉन्च किए हैं: V4-Pro और V4-Flash। आइए पहले कुछ मुख्य डेटा देखते हैं।

V4-Pro: कुल पैरामीटर 1.6T (1.6 खरब), लेकिन प्रति टोकन सक्रिय पैरामीटर केवल 49B (490 अरब)।

V4-Flash: कुल पैरामीटर 284B (2840 अरब), सक्रिय पैरामीटर केवल 13B (130 अरब)।

समझ गए? यह एक अत्यंत संयमित "चार औंस के साथ हजारों पाउंड को हिला देना" है। MoE आर्किटेक्चर की मूल बात यह है कि हर बार सभी चेतावनियाँ नहीं बजानी पड़तीं। एक चिकन को मारने का काम हो तो कुछ चिकन मारने के विशेषज्ञों को भेजें; एक ड्रैगन को मारने का काम हो तो ड्रैगन स्लेयर स्वर्ड को बुलाएं। 1.6 ट्रिलियन का बेस, इसे "अनुभवी और ज्ञानवान" बनाता है; 490 बिलियन की सक्रियता, इसे "तेज़ प्रतिक्रिया और सुचारु" बनाती है।

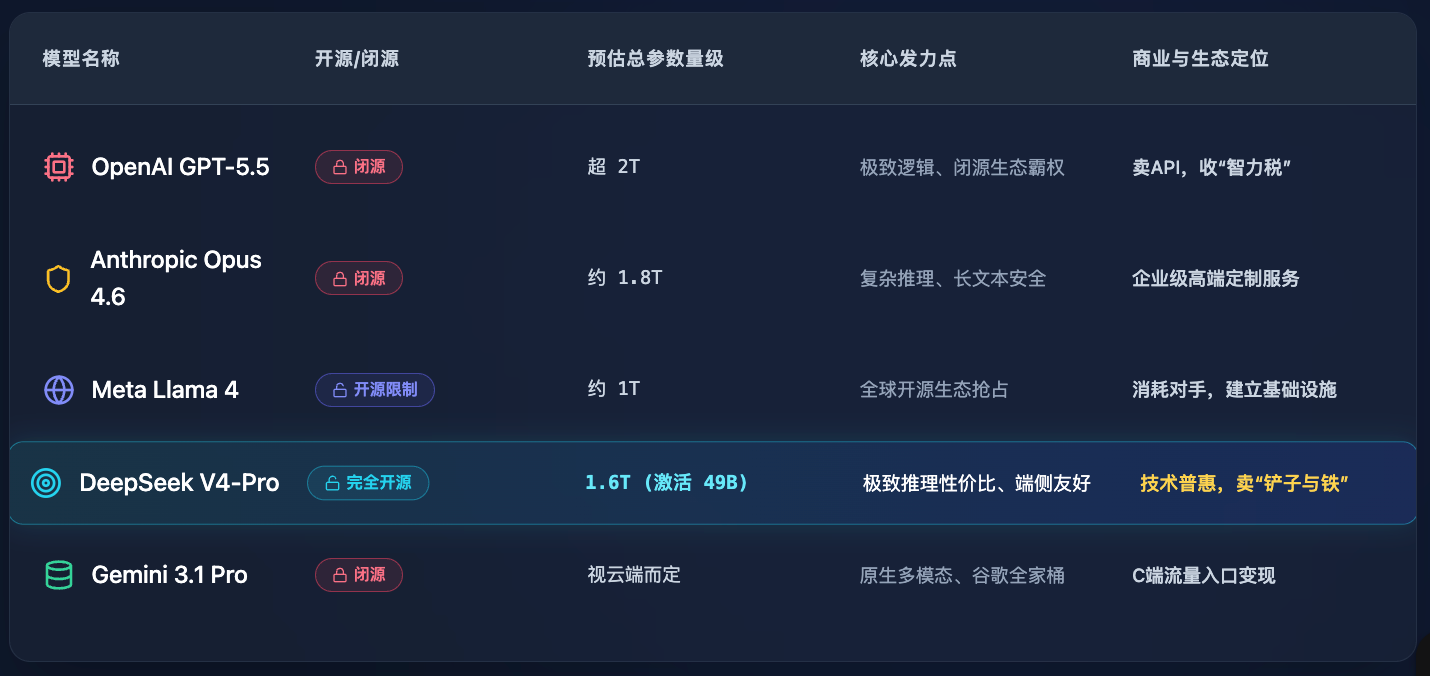

इस अंतर को अधिक स्पष्ट रूप से समझने के लिए, हम वर्तमान बाजार में प्रमुख दृष्टिकोणों की तुलना करते हुए एक तालिका बनाते हैं (डेटा बाजार के सार्वजनिक अनुमान और गणना हैं):

टेबल देखकर पता चलता है कि V4-Pro ने GPT-5.5 के कुल पैरामीटर्स में बस ऊपर जाने का पीछा नहीं किया है, लेकिन इसने पूरी ऊर्जा इस बात पर लगाई है कि "इस विशालकाय को कम खाने और तेज़ दौड़ने के लिए कैसे तैयार किया जाए।"

लेकिन यह पर्याप्त नहीं है। वास्तविक रूप से जानकार लोगों को हैरान कर देने वाली बात यह है कि यह “वीडियो मेमोरी एसासिन” का निर्मम विनाश कर रहा है।

GPU किलर का अंत: आर्किटेक्चर के तीन खुरचने वाले चाकू

विस्तृत संदर्भ (Long Context) को ही "विस्मृति अभियंता" कहा जाता है।

अब सभी अपने 1M (एक लाख) टोकन के कॉन्टेक्स्ट को सपोर्ट करने का दावा कर रहे हैं। यह सुनने में बहुत अच्छा लगता है, एक पूरी किताब “त्रिकाल” को अंदर भर दें, और यह कुछ सेकंड में पढ़ लेगा। लेकिन इसकी कीमत क्या है? लंबे टेक्स्ट के इन्फरेंस के दौरान, KV कैश (इन्फरेंस के दौरान पिछली जानकारी को स्टोर करने के लिए GPU मेमोरी का उपयोग) बहुत बड़ा हो जाता है। यह ऐसा है जैसे आप प्रत्येक पृष्ठ पढ़ते समय, पिछले पृष्ठ की सारी सामग्री को एक बड़ी काली सारणी पर कॉपी करके सामने रख दें। जब आप पहले लाखवें शब्द तक पहुँचते हैं, तो काली सारणियों की संख्या इतनी हो जाती है कि Zhongguancun का सर्वर रूम भी उन्हें समेट नहीं पाता।

मेमोरी, कैलकुलेशन पावर से महंगी है। यह AI उद्योग का एक अनलिखित नियम है।

DeepSeek V4 इस स्थिति को कैसे हल करता है? उन्होंने सीधे नींव के ध्यान तंत्र पर "शल्य चिकित्सा" की है। यही उनके आर्किटेक्चर अपग्रेड की पहली और सबसे कठोर चाकू है: मिश्रित ध्यान तंत्र (CSA + HCA)।

CSA (Compressed Sparse Attention) और HCA (Heavy Compressed Attention) को सुनकर लगता है जैसे मंगल भाषा हो, लेकिन सरल शब्दों में: यह अब याद करने की बजाय “महत्वपूर्ण बिंदुओं पर ध्यान देना” और “अति संक्षिप्त नोट्स बनाना” सीख गया है।

प्रभाव अत्यंत शक्तिशाली है: 1M कॉन्टेक्स्ट के तहत, V4-Pro का एक टोकन निष्पादन FLOPs (फ्लोटिंग पॉइंट ऑपरेशन्स) केवल पिछली पीढ़ी V3.2 का 27% है! और अधिक डरावनी बात यह है कि KV कैश केवल V3.2 का 10% है!

यह क्या अवधारणा है? यह इतना है कि जिस मिलियन शब्दों के लंबे टेक्स्ट कार्य को पूरा करने के लिए पहले 10 शीर्ष सर्वर की आवश्यकता होती थी, अब एक ही सर्वर आसानी से इसे पूरा कर लेता है। कैलकुलेशन लागत सीधे 10% हो गई है। यह मेज़ उलटने वाला अनुकूलन है।

और दो चाकू।

दूसरा उपकरण, "मैनिफोल्ड कंस्ट्रेंटेड हाइपरकनेक्शन (mHC)" कहलाता है। पिछले बड़े मॉडलों में, स्तरों के बीच जानकारी के संचरण के लिए "पारंपरिक रेजिड्यूअल कनेक्शन" का उपयोग किया जाता था, जो एक पुरानी, जंग लगी लोहे की पाइपलाइन की तरह है जो पानी के दबाव के साथ आसानी से रिस जाती है। 32T टोकन के विशाल प्री-ट्रेनिंग डेटा के सामने, पुरानी पाइपलाइन सहन नहीं कर पाती। mHC एक ऑप्टिकल नेटवर्क में बदलने के समान है, जो स्तरों के बीच सिग्नल प्रसार की स्थिरता को बढ़ाता है। कोई पैकेट खोया नहीं जाता, कोई विचलन नहीं होता।

तीसरा कदम, इंजन का ऑयल बदलें। पारंपरिक विधि को छोड़कर Muon ऑप्टिमाइज़र का उपयोग करें। इसका काम है अभिसरण को तेज करना। दूसरे लोगों को एक बार दवा बनाने में सात-सात चौवन दिन लगते हैं, लेकिन इसके साथ शायद सिर्फ बीस दिन में तैयार हो जाए। समय पैसा है, मशीन समय डॉलर है।

इन तीन कटों से, V4 ने बड़े मॉडल की "अमीरी की बीमारी" को पूरी तरह से ठीक कर दिया।

दान भांड में रहस्य: एकल लड़ाई से सभी विधियों का एकत्रीकरण

बड़े मॉडल के अंदर सब जानते हैं कि प्री-ट्रेनिंग केवल एक “अनपढ़” को “बहुत सारी जानकारी रखने वाला लेकिन बोलने में असमर्थ बेवकूफ” बनाती है। वास्तव में इसे एक अद्भुत महान बनाने के लिए, पोस्ट-ट्रेनिंग (Post-training) की आवश्यकता होती है।

DeepSeek V4 ने पोस्ट-ट्रेनिंग पर एक अत्यंत कठोर "दो चरणों की रणनीति" अपनाई।

पहले लोग MoE को ट्रेन करते थे, जैसे कि कई शिक्षक एक छात्र को पढ़ा रहे हों, जिससे आसानी से झगड़ा हो जाता था। V4 कैसे करता है?

प्रारंभिक चरण: "अलग-अलग लड़ाई।" यह SFT (सुपरवाइज्ड फाइन-ट्यूनिंग) और GRPO (ग्रुप रिलेटिव पॉलिसी ऑप्टिमाइजेशन) रीइनफोर्समेंट लर्निंग का उपयोग करके मॉडल के विभिन्न "एक्सपर्ट नेटवर्क्स" को अलग-अलग तरीके से प्रशिक्षित करता है। कोडिंग के एक्सपर्ट दिनभर कोडिंग प्रैक्टिस करते हैं, और गणित के एक्सपर्ट दिनभर गणित के प्रश्न हल करते हैं। ये दोनों पूरी तरह से अलग हैं, एक-दूसरे से अछूते। इसे एकल-बिंदु क्षमता को अधिकतम तक ले जाना कहते हैं।

दूसरा चरण: “सभी विधियाँ एकत्रित होती हैं।” ऑनलाइन डिस्टिलेशन तकनीक के माध्यम से, इन पहले से ही अद्भुत कला में निपुण विशेषज्ञों को एक समाहित, एकीकृत मॉडल में एकजुट किया जाता है। आंतरिक व्यर्थ का व्यय नहीं, कोई ठहराव नहीं।

चलिए उनके द्वारा निकाले गए दो "बड़े हथियार" को देखते हैं।

पहला V4-Pro-Max मोड है। यह सर्वोच्च निष्कर्षण शक्ति मोड है। यह जीन लॉक को खोलने के समान है। उनका दावा है (जिसे जल्द ही समुदाय द्वारा सत्यापित किया गया), कि कोडिंग बेंचमार्क पर V4-Pro पहले से ही शीर्ष स्तर पर पहुंच चुका है, और जटिल निष्कर्षण और एजेंट (एजेंट) कार्यों पर, अग्रणी बंद मॉडल (जैसे GPT-5.5, Opus 4.6) के साथ अंतर काफी कम हो गया है।

दूसरा है V4-Flash-Max। यह और भी दिलचस्प है। यह एक केवल 284B का छोटा सा एजेंट है, लेकिन "पर्याप्त विचार बजट" देने के बाद, इसका निष्कर्ष निकालने का प्रदर्शन Pro के करीब पहुँच जाता है। इसका क्या मतलब है? इसका मतलब है कि "एल्गोरिथम की गुणवत्ता" अब "पैरामीटर के आकार" पर वर्चस्व पा रही है। जब तक आप इसे सोचने के लिए पर्याप्त समय दें, तब तक छोटा मस्तिष्क भी बड़ी समस्याओं को हल कर सकता है। निश्चित रूप से, शुद्ध ज्ञान के भंडार और अत्यधिक जटिल बहु-चरणीय Agent कार्यों में, यह पैरामीटर साइज़ से प्रतिबंधित है (क्योंकि पेट इतना ही बड़ा है), लेकिन अधिकांश उद्यम स्तरीय दैनिक अनुप्रयोगों के लिए, यह प्रदर्शन अतिरिक्त है।

अंत में, वेट को अत्यंत बुद्धिमानी से FP4+FP8 मिश्रित सटीकता संग्रहण का उपयोग करके संग्रहित किया गया है। यह सटीकता को बनाए रखता है और वीडियो मेमोरी भी बचाता है। हर जगह एक गणितज्ञ की सूक्ष्मता का आकर्षण झलकता है।

इस प्रशिक्षण के बाद के इंजीनियरिंग दक्षता में सुधार की तुलना को और स्पष्ट करने के लिए, हम एक कठोर सूचकांक तुलना तालिका लाते हैं:

कैपिटल की नाक: V4 ने मध्य-चीन की कैलकुलेशन चेन को क्यों जला दिया?

अब तक तकनीकी विश्लेषण लगभग पूरा हो गया है। लेकिन हमने अभी तक शुरुआती प्रश्न का जवाब नहीं दिया है:

क्यों GPT-5.5 ने कैलकुलेशन सेक्टर को लगातार उत्साहित नहीं किया, जबकि DeepSeek V4 ने किया?

इसके लिए हमें कोड से बाहर निकलकर इस खेल को पूंजी और व्यापार की दृष्टि से देखना होगा।

GPT-5.5 बहुत शक्तिशाली है, अजेय रूप से शक्तिशाली। लेकिन यह बंद स्रोत है। बंद स्रोत का क्या अर्थ है? इसका अर्थ है कि OpenAI एक विशाल "काला छिद्र" है। अगर आप इसकी क्षमताओं का उपयोग करना चाहते हैं, तो आपको इसका API खरीदना होगा। यह एक "कर संग्रह" मॉडल है। लाभ सिलिकॉन वैली की ओर बहता है, और कैलकुलेशन की मांग माइक्रोसॉफ्ट के क्लाउड डेटासेंटर पर केंद्रित होती है। वैश्विक हार्डवेयर निर्माताओं, स्थानीय कैलकुलेशन सेंटरों और विभिन्न देशों के सर्वर एजेंटों के लिए, इसके अलावा कुछ भी प्राप्त नहीं होता—बस ऊपर देखना पड़ता है। GPT-5.5 जितना भी शक्तिशाली हो, वह किसी और का महोत्सव है। NVIDIA का स्टॉक बढ़ता है, क्योंकि लोग मानते हैं कि OpenAI को और अधिक कार्ड्स खरीदने की आवश्यकता होगी।

लेकिन DeepSeek V4 अलग है।

यह ओपन सोर्स है। और यह अत्यंत विस्तृत MIT लाइसेंस है। MIT अनुबंध ओपन सोर्स समुदाय का सबसे उदार उपहार है, जिसका अर्थ है कि व्यावसायिक कंपनियाँ इसे मुफ्त में ले सकती हैं, इसे बदल सकती हैं और बेच सकती हैं, बिना किसी कानूनी जोखिम के।

अधिक घातक बात यह है कि हमने पहले बड़ी मात्रा में तर्क दिया था कि V4 ने मॉडल की निष्कर्षण लागत और VRAM उपयोग को टखने तक कम कर दिया है।

इन दोनों बिंदुओं को जोड़कर, आप एक ऐसा निष्कर्ष निकालते हैं जो कैपिटल मार्केट्स को पागल कर देगा: प्राइवेट डिप्लॉयमेंट का क्रिटिकल मास पॉइंट, वास्तव में आ गया है।

पिछले समय में, जब कोई कंपनी 1T से अधिक के मॉडल को स्वयं डिप्लॉय करना चाहती थी, तो वह हार्डवेयर की कीमत सूची देखकर चुपचाप बंद कर देती थी और API खरीदने के लिए मुड़ जाती थी। अब, V4 सभी को बताता है: आपको केवल कुछ ही मशीनों की आवश्यकता है, ताकि आप स्थानीय रूप से GPT-4 के बहुत करीब, यहां तक कि GPT-5.5 के स्तर तक पहुंचने वाला एक सुपरब्रेन चला सकें। डेटा न तो प्रांत के बाहर जाएगा और न ही विदेश में, पूरी तरह सुरक्षित।

अब जब सभी लोग अपने स्थानीय रूप से चला सकते हैं, तो आगे क्या होगा?

खरीदें मशीन! खरीदें सर्वर! खरीदें ऑप्टिकल मॉड्यूल! बनाएं स्मार्ट कंप्यूटिंग सेंटर!

बंद सोर्स बड़ी कंपनियाँ बुद्धिमत्ता कर बेचती हैं, जबकि ओपन सोर्स बड़ी कंपनियाँ मूल रूप से पूरे उद्योग के हार्डवेयर निर्माताओं के लिए "उत्पाद बेच रही हैं"। DeepSeek V4 वह व्यक्ति है जिसने आग का बीज फेंका। जितना अच्छा और ओपन सोर्स होगा, उतना ही चीन, हांगकांग, ताइवान आदि स्थानीय कैलकुलेशन की मांग विस्फोटक रूप से बढ़ेगी। सर्वर असेंबली, लिक्विड कूलिंग, और डेटा सेंटर ऑपरेशन करने वाली कंपनियों को अब बड़े पैमाने पर लागू करने का वास्तविक मुनाफा दिखाई दे रहा है।

इसीलिए 23 अप्रैल को V4 के लॉन्च के तुरंत बाद, चीन-हांगकांग कैलकुलेशन पावर चेन ने लगातार उछाल दिया। पूंजी भावनाओं के लिए नहीं, बल्कि आगामी “हजारों उद्योगों में निजी स्थापना की भीड़” के लिए पहले से ही स्थिति बना रही है।

यही नींव का व्यावसायिक षड्यंत्र है।

अंतिम शब्द: ज्वार की वापसी और चट्टानें

ये पागलपन भरे तीस दिन, ग्यारह बड़े मॉडल, एक शोर भरी आतिशबाजी की तरह हैं।

दिग्गज अपने पैरामीटर के मैदान में एक दूसरे को ओशन से लहराते हुए, कैलकुलेशन की भारी पकड़ से अपने प्रतिद्वंद्वी को जमीन पर गिराने की कोशिश कर रहे हैं। लेकिन शोर के बाद, वास्तव में उद्योग के भूगोल को बदलने में सक्षम होने वाला, अक्सर सबसे शोर मचाने वाला नहीं होता।

डीपसीक V4 के आगमन से एक शांत असासिन की तरह लगता है। यह आपसे यह नहीं तुलना करता कि कौन अधिक पैसा खर्च करता है, बल्कि यह केवल सबसे अधिक दर्दनाक कमजोर बिंदु पर हमला करता है: अनावश्यक वीएमएम को हटाना, डिप्लॉयमेंट की सीमा को समान करना, और उच्च स्तरीय खेल को सामान्य लोगों के लिए बदलना।

इस "रगनारोक" नामक AI युद्ध में, पैरामीटर्स को अंधाधुंध जमा करने का युग तेजी से समाप्त हो रहा है। भविष्य का मैदान उन लोगों का होगा जो "अत्यधिक प्रदर्शन" और "इंजीनियरिंग दक्षता" के बीच बेहतरीन संतुलन पा सकेंगे।

जब तूफान चला जाएगा, तब ही पता चलेगा कि कौन नंगा तैर रहा था और कौन अटूट पत्थर था।

V4 ने सभी को हथियार बांट दिए हैं। अब, देखिए कि प्रत्येक राजा इस नए महाद्वीप पर कैसे अपना कैंप लगाता है।

इस स्तर को समझने के बाद, जब आप उन “शानदार लॉन्च” या “पुनर्परिभाषित करने” जैसे शोर-शराबे को सुनेंगे, तो शायद आप थोड़ा अधिक शांत और कम चिंतित महसूस करेंगे।

After all, no matter how dazzling the magic, it ultimately comes down to the ledger, balancing out those few coins.

स्रोत का उल्लेख:

- DeepSeek V4 सीरीज़ प्रीव्यू आधिकारिक रिलीज़, DeepSeek टीम, GitHub/ModelScope/HuggingFace. (2026).

- अप्रैल AI रैली: 30-दिन के बड़े मॉडल चक्र का विश्लेषण, ME News मार्केट ऑब्जर्वर। (2026)।

- स्केलिंग कानून और पोस्ट-ट्रेनिंग परिवर्तन, कृत्रिम बुद्धिमत्ता आर्थिकता पत्रिका। (2026)।

- ग्लोबल कंप्यूट सप्लाई चेन मार्केट पल्स रिपोर्ट (अप्रैल 2026), पैन-एशियन फाइनेंशियल डेटा एनालिटिक्स। (2026)।