L'IA a-t-elle sauvé une entreprise de toilettes ?

L'entreprise japonaise de toilettes intelligentes haut de gamme TOTO a vu son cours d'action bondir ces derniers mois à cause de l'IA, non pas parce que ses toilettes se vendent mieux, mais parce que TOTO dispose d'une activité cachée : des disques électrostatiques en céramique de haute pureté, utilisés comme consommables essentiels pour fixer les wafers lors de la fabrication de puces. TOTO a atteint une précision de 1/80e du diamètre d'un cheveu et une pureté inégalée dans l'industrie.

Au moment où la demande pour les puces de stockage explose et que les fournisseurs en amont étendent follement leur production, cette activité est devenue un besoin absolu. Cela a poussé des banques d'investissement comme Goldman Sachs à revoir à la hausse la notation des actions de TOTO, pour une raison simple : les commandes de chambres électrostatiques sont déjà planifiées jusqu'en 2027. Cette activité représente désormais plus de 40 % du bénéfice opérationnel de TOTO.

Lorsqu'une entreprise de toilettes devient une action liée à l'IA, on comprend à quel point le secteur du stockage de l'IA est actuellement en plein essor. Derrière la flambée des cours des actions des acteurs majeurs du stockage comme Samsung, SK Hynix, Micron et SanDisk, se cache un déséquilibre sans précédent entre l'offre et la demande sur les puces de stockage mondiales, le plus grave en quatre décennies.

Dans cet article, nous allons passer en revue cette « super-cyclette » du stockage, et échanger en profondeur avec des experts de Samsung et des investisseurs de Wall Street : pourquoi cette cyclette est différente des précédentes, pourquoi le stockage est si crucial pour l'industrie de l'IA, comment des géants de l'IA comme Google cherchent à réduire leur dépendance au stockage, et pendant combien de temps cette pénurie durera-t-elle, et comment cela vous affectera-t-il, vous et moi ?

01 Augmentation de plus de 1800 % : HBM, « plus cher que l'or »

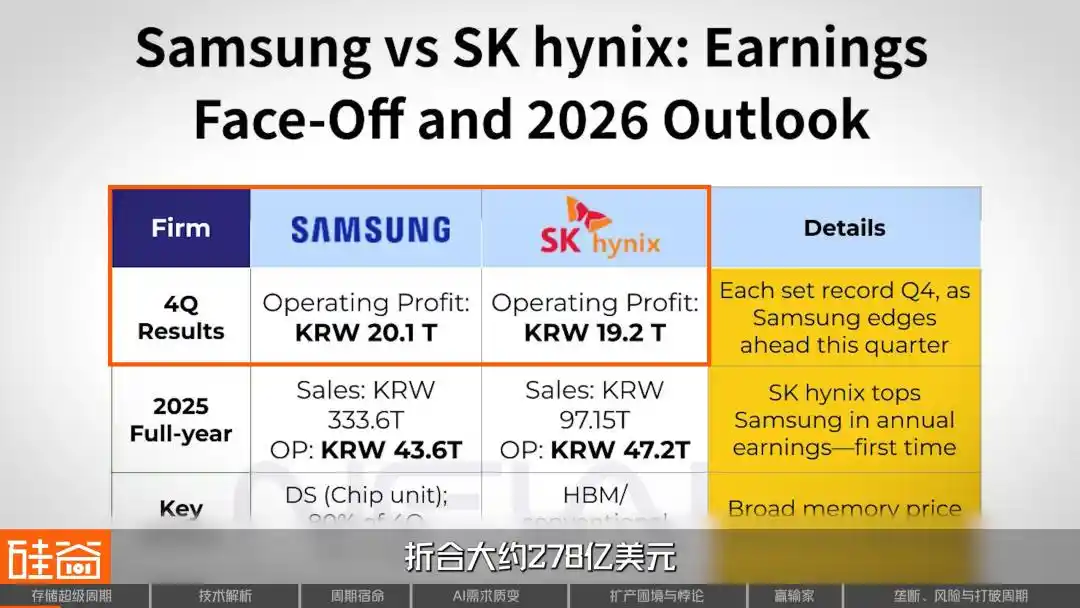

À la fin de janvier 2026, les deux géants coréens du stockage, Samsung Electronics et SK Hynix, ont publié simultanément leurs résultats du quatrième trimestre de l'année précédente. À quel point ces chiffres sont-ils extravagants ? Le bénéfice opérationnel combiné des deux entreprises a atteint près de 40 billions de wons coréens, soit environ 27,8 milliards de dollars américains, équivalent à un bénéfice net quotidien de 300 millions de dollars. Dans ce contexte de bénéfices historiques, la prime de fin d'année de SK Hynix a atteint en moyenne 640 000 yuans chinois par employé, battant ainsi le record de l'entreprise.

Le produit central qui pousse tout cela à son apogée est la puce HBM (High Bandwidth Memory). Une puce HBM de la taille d'un ongle coûte entre 400 et 500 dollars, soit plus cher que son poids en or. Seules trois entreprises dans le monde sont capables de produire cette puce : SK Hynix en détient environ 60 %, les deux autres parts étant réparties entre Samsung et Micron, à 20 % chacune.

Mais HBM n'est qu'une partie de l'iceberg ; ce qui a vraiment mis l'ensemble de l'industrie en alerte, c'est la crise généralisée, du haut de gamme au bas de gamme, du DRAM au NAND.

De la fin de l'année 2024 à décembre 2025, le prix moyen spot du DDR5 (16 Go) est passé de 4,6 dollars à 28 dollars, soit une hausse de plus de 500 % ; le DDR4 plus ancien a grimpé de 3,2 dollars à plus de 62 dollars, affichant une augmentation cumulée de près de 1 800 % ; les modules de mémoire serveur de 64 Go utilisés dans les centres de données ont augmenté de 255 dollars à 700 dollars en seulement six mois l'année dernière, soit une hausse d'environ 175 %.

La capacité de SK Hynix pour 2026 est déjà entièrement vendue, et Samsung a augmenté de 100 %, soit doublé, le prix d'approvisionnement du NAND flash pour le premier trimestre 2026.

Candice Hu

Responsable du marketing des produits de stockage Samsung

Nous constatons actuellement que le prix spot du DRAM a dépassé le pic atteint pendant la période cloud de 2016 à 2018. La pénurie actuelle signifie que toute la production de 2026 est déjà vendue, et il est très probable que celle de 2027 le soit également. Les prix que nous proposons à des fournisseurs de GPU très importants pour nos SSD sont tout simplement extravagants, ayant doublé en une semaine.

Dans le même temps, un signal plus marquant est apparu. SanDisk a déclaré à Wall Street lors du CES début 2026 qu'elle signait de nouveaux accords à long terme (LTA) avec ses clients, et que ces derniers devaient verser un acompte non remboursable en cas de résiliation. Cela n'avait jamais été vu dans l'histoire de l'industrie du stockage depuis des décennies.

Rob Li

Managing Partner at Amont Partners, New York

Les accords à long terme (LTA) n'ont pas été inexistants historiquement, mais au cours des dernières décennies, les LTA n'ont jamais eu aucune force exécutoire. Si le marché entre dans une période baissière et que le client déclare qu'il ne reconnaît plus cet accord, si le client le rejette, vous n'avez absolument aucun recours contre lui.

Et cette fois-ci, le ton a changé. Les fournisseurs de stockage puissants ont établi de nouvelles règles.

Rob Li

Managing Partner at Amont Partners, New York

SanDisk a indiqué à Wall Street ou au marché que les LTA qu'ils signent actuellement avec leurs clients sont très différents de ceux du passé. Ceux-ci ont une valeur légale, et les clients doivent leur verser un acompte à l'avance ; si vous versez un acompte et que vous décidez ensuite de vous retirer sans payer au prix convenu, votre acompte ne vous sera pas remboursé.

La conclusion de Rob est que si SanDisk peut accomplir cela, les trois autres géants — SK Hynix, Samsung et Micron — n'ont aucune raison de ne pas y parvenir. Dans ce cas, le supercycle entier pourrait très bien se prolonger jusqu'en 2027.

02 Analyse complète de la chaîne industrielle : comment fonctionne le secteur du stockage ?

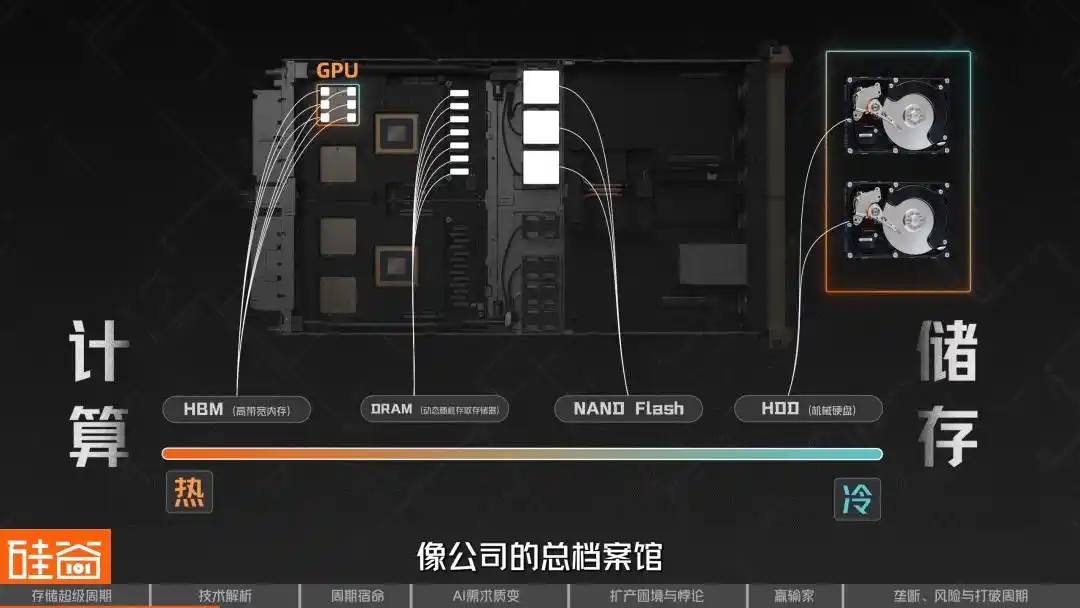

Pour l'industrie du stockage, nous pouvons effectuer une distinction entre chaud et froid : plus il est proche du calcul, plus il est chaud ; plus il est orienté vers des fonctions de stockage pures, plus il est froid.

Ainsi, le plus « chaud » est le DRAM (mémoire vive dynamique), le stockage le plus proche du calcul, que l'on peut comprendre comme la « mémoire d'exploitation » des ordinateurs et des téléphones portables : lorsque le processeur fonctionne, les données doivent d'abord être chargées dans le DRAM pour être traitées. Son avantage est une vitesse extrêmement rapide, mais il perd les données en cas de coupure d'alimentation, ce qui en fait une « mémoire à court terme ».

Parmi ceux-ci, le HBM (High Bandwidth Memory) est une forme spéciale d'évolution du DRAM. Il empile verticalement plusieurs couches de puces DRAM à l'aide de la technologie TSV (Through-Silicon Via), puis les integre sur la même sous-plaque que le GPU grâce à un emballage avancé, ce qui augmente considérablement la bande passante.

C’est pourquoi tous les puces de pointe utilisées pour l’entraînement de l’IA, qu’il s’agisse des GPU de NVIDIA ou des TPU de Google, dépendent du HBM, le produit le plus brillant et le plus rare de cette super-cyclique.

Au sein de la famille DRAM, les types de produits sont en réalité très variés. On trouve notamment le GDDR (utilisé pour les cartes graphiques), le Low-Power DDR (LPDDR, utilisé dans les téléphones et les ordinateurs portables), etc. Chaque application correspond à un produit spécifique. Une puce DRAM ne peut pas s'adapter à tous les appareils : le HBM utilisé pour les GPU NVIDIA et le LPDDR présent dans votre téléphone sont tous deux des DRAM, mais ils diffèrent totalement en termes de procédé de fabrication, de méthode de封装 et de performances.

De l'autre côté, « froid », on trouve le NAND. Si la DRAM est la mémoire à court terme, le NAND Flash est la mémoire à long terme. Il conserve les données même en l'absence d'alimentation et constitue le cœur des disques durs à état solide (SSD), du stockage des téléphones et des clés USB. Les photos que vous stockez sur votre téléphone et les jeux installés sur votre ordinateur reposent tous sur le NAND.

Le rôle du NAND évolue rapidement à l'ère de l'IA. Autrefois, il n'était qu'un simple « entrepôt » chargé de stocker les données à long terme, mais aujourd'hui, le NAND passe du rôle d'entrepôt en arrière-plan à celui de réserve d'armes en première ligne.

En allant encore plus « froid », on trouve les disques durs traditionnels HDD, qui lisent et écrivent des données grâce à la rotation de disques magnétiques : ils sont lents, mais peu coûteux et offrent une grande capacité, étant principalement utilisés aujourd'hui pour le stockage à froid et l'archivage dans les centres de données.

Au fur et à mesure que les besoins en mémoire pour l'inférence IA deviennent de plus en plus fins, le système ressemble de plus en plus à un entrepôt à niveaux. Les données les plus urgentes sont placées dans l'HBM, comme des objets à portée de main ; les données fréquemment utilisées mais moins critiques sont stockées dans le DRAM, comme dans un tiroir de bureau ; les données moins utilisées, réservées en cas de besoin, sont conservées sur le NAND/SSD, comme dans un casier de bureau ; quant aux grandes quantités de données accumulées à long terme et nécessitant un accès partagé par plusieurs utilisateurs, elles sont stockées dans un entrepôt centralisé en arrière-plan, comme l'archives principales de l'entreprise.

Rob Li

Managing Partner at Amont Partners, New York

L'IA favorise davantage les éléments chauds, et elle est également nécessaire pour le stockage. J'ai utilisé l'IA pour créer de nombreuses images et vidéos ; selon les réglementations de différents pays, ces éléments ne peuvent pas être supprimés et doivent être conservés, ce qui a certainement considérablement augmenté la demande de stockage. Mais sa première manifestation la plus directe est certainement liée au calcul : plus une entité est proche du calcul, plus ses bénéfices à court terme seront évidents.

Ensuite, passons en revue les acteurs de toute la chaîne de valeur du stockage.

En amont, les matériaux et les wafers de silicium, comme SUMCO au Japon, qui est l'un des principaux fournisseurs mondiaux de wafers de silicium pour les semi-conducteurs. Dans la phase de fabrication, les fabricants d'équipements clés incluent ASML, leader mondial des photolithographes, ainsi que Tokyo Electron, qui couvre plusieurs étapes telles que le revêtement, le développement, le dépôt, la gravure et le nettoyage.

Dans le même temps, au niveau de la conception des puces avant la fabrication, des entreprises telles que Cadence et Synopsys, spécialisées dans les outils EDA, la vérification et les IP de conception, sont tout aussi indispensables ; tandis que des fournisseurs d’IP d’interface comme Rambus jouent un rôle clé dans les architectures de mémoire haute vitesse telles que HBM. Bien qu’elles soient moins visibles que les GPU, elles constituent un besoin essentiel dans cette super-croissance pilotée par l’IA.

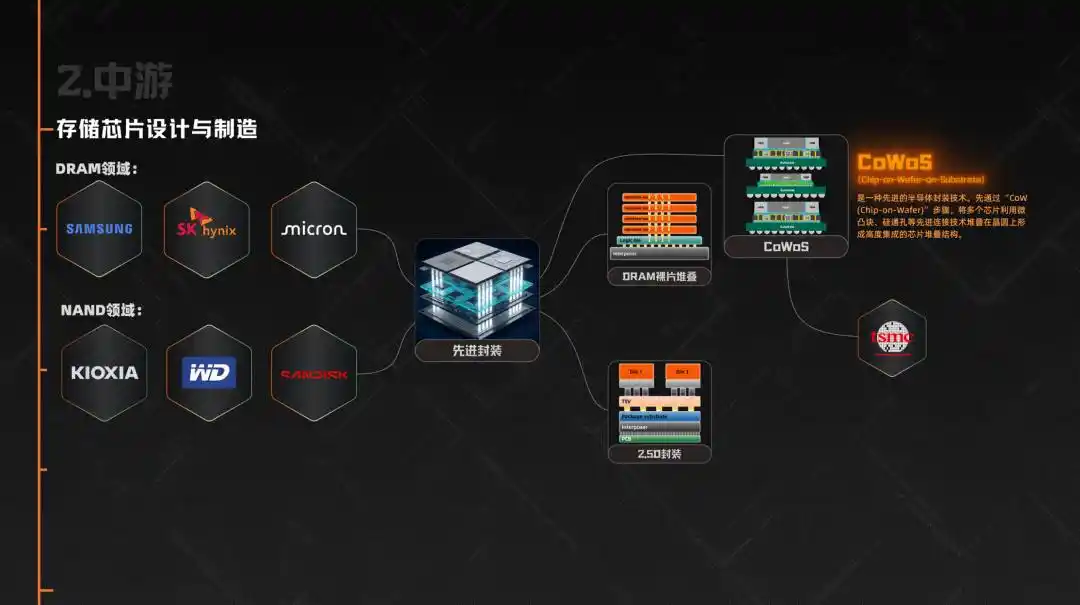

La chaîne intermédiaire concerne la conception et la fabrication de puces de stockage. Dans le domaine DRAM, Samsung, SK Hynix et Micron représentent ensemble 95 % du marché mondial. Dans le domaine NAND, en plus de ces trois entreprises, on trouve Kioxia, Western Digital et SanDisk.

Ensuite vient l'étape particulièrement cruciale dans ce cycle : le packaging avancé. Car le HBM ne se limite pas à la fabrication simple de DRAM ; il faut d'abord empiler plusieurs couches de puces DRAM (die), puis les intégrer, via un packaging 2.5D, à un GPU ou à un autre accélérateur AI. C'est précisément pour cette raison que la technologie de packaging semi-conducteur CoWoS est devenue l'un des goulets d'étranglement les plus critiques de la chaîne d'approvisionnement des puces AI, limitant directement la livraison réelle de HBM, dont la capacité de production est principalement assurée par TSMC.

Les applications finales incluent les centres de données et les fournisseurs de cloud, tels que Microsoft, Google, Amazon et ByteDance, qui sont actuellement les principaux financeurs, suivis par les fabricants de téléphones (Apple, Samsung, Xiaomi, OPPO), les fabricants d’ordinateurs (Lenovo, Dell, HP), les constructeurs automobiles (Tesla, Li Auto, NIO), ainsi que les consoles de jeux et les équipements industriels.

Ainsi, vous pouvez voir que, bien que la chaîne entière soit très longue, le véritable pouvoir de fixation des prix est fortement concentré chez les trois acteurs du milieu : Samsung, SK Hynix et Micron. Ce sont eux qui décident quels produits fabriquer, à qui les vendre et à quel prix. Et dans ce marché où l’offre est bien inférieure à la demande, leur pouvoir de négociation est sans précédent.

03 Pourquoi les fluctuations brutales sont-elles inévitables : le cycle naturel de l'industrie du stockage

Le secteur du stockage présente également une caractéristique majeure : sa cyclicité. Historiquement, il oscille constamment entre « fortes hausses » et « effondrements majeurs ». Ce phénomène s'explique par deux facteurs : un aspect physique et un aspect économique.

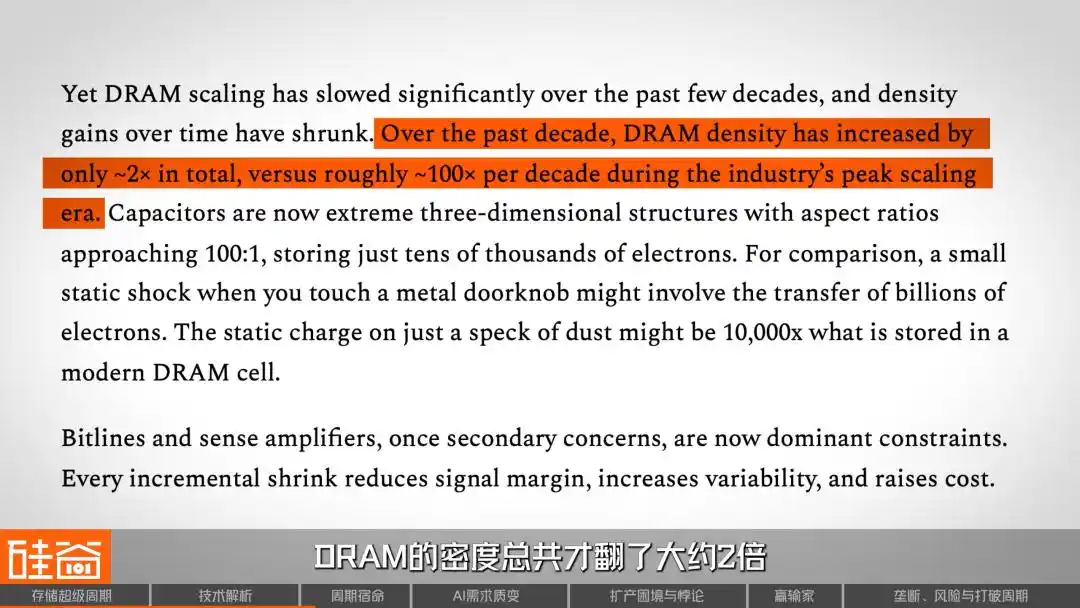

Commençons par la physique. La DRAM, qui correspond à la « mémoire vive » dans les téléphones et les ordinateurs, stocke des données en retenant des charges électriques. Pendant des décennies, les ingénieurs ont réduit et multiplié les unités de stockage pour augmenter la densité. À son apogée, la densité de la DRAM a doublé tous les dix ans.

Mais ce n'est plus le cas aujourd'hui : selon le rapport de SemiAnalysis, la densité DRAM n'a augmenté que d'environ deux fois au cours de la dernière décennie, contre cent fois tous les dix ans auparavant ; le rétrécissement s'est considérablement ralenti. Cela signifie que la baisse des coûts des puces de mémoire ne repose plus sur une progression technologique « automatique » comme avant, mais dépend davantage des fluctuations de la capacité de production et des dynamiques d'offre et de demande.

Parlons maintenant d'économie. La fabrication de puces de stockage est l'une des industries les plus intensives en capital au monde ; construire une usine de wafers avancée coûte souvent plusieurs milliards, voire des dizaines de milliards de dollars, et prend deux à trois ans. Ces investissements constituent des coûts irrécupérables, de sorte que même en cas de faible demande, les fabricants ont tendance à continuer la production, car arrêter la fabrication entraînerait des pertes encore plus importantes.

Ce qui est encore plus critique, c’est que le modèle de l’industrie du stockage est « construire d’abord, vendre ensuite », ce qui diffère complètement de la logique de TSMC, qui « reçoit d’abord les commandes, puis étend la production ». Les fabricants de stockage doivent deviner eux-mêmes la demande future, en investissant dans la capacité deux à trois ans à l’avance. S’ils devinent juste, tout le monde est content ; s’ils se trompent, c’est une catastrophe.

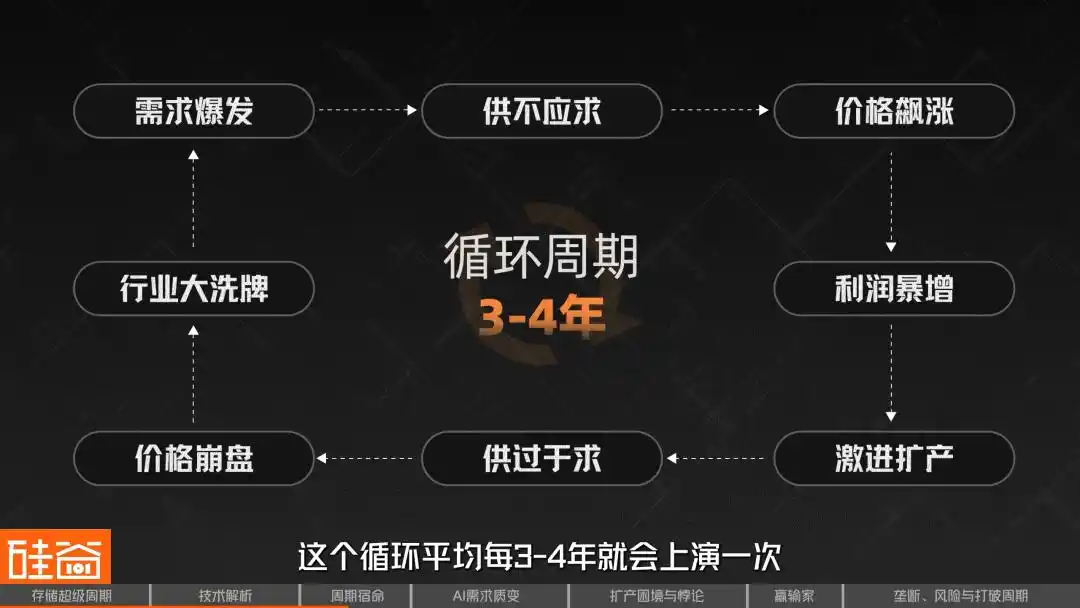

Cette contradiction structurelle a créé un cycle classique qui se répète inlassablement dans l'industrie du stockage : explosion de la demande → pénurie d'offre → hausse des prix → profits exponentiels → expansion agressive → excédent d'offre → effondrement des prix → restructuration majeure du secteur. Au cours des trente dernières années, ce cycle s'est produit tous les 3 à 4 ans sans exception.

Le résultat est que les fournisseurs mondiaux de DRAM, qui étaient plus de vingt au cours des années 1990, ont été réduits à seulement trois géants et à des poursuivants comme ChangXin en Chine. À chaque cycle, certains ont été éliminés, comme Infineon en Allemagne, qui a fait faillite, ou Elpida au Japon, qui s'est retiré. Ces leçons sanglantes ont fait entrer toute l'industrie dans une profonde crainte face au mot « cycle ».

Au cours des dernières décennies de l'histoire du secteur du stockage, quatre cycles se sont produits.

La première fois, c'était en 1993, au début de l'ère Windows PC. La popularisation des interfaces graphiques a entraîné une explosion de la demande en mémoire, tandis que la capacité de production était gravement insuffisante, provoquant une flambée des prix. Résultat : environ 50 nouvelles usines ont été construites en un seul coup à l'échelle mondiale ; après le surcapacité, les prix ont chuté brutalement, éliminant de nombreux acteurs.

La deuxième fois, c'était en 2010, à l'ère des smartphones et du cloud computing. L'iPhone et Android ont provoqué une croissance exponentielle, faisant passer la DRAM des serveurs de quelques Go à plusieurs dizaines de Go. Mais la standardisation a accéléré la marchandisation, rendant difficile la différenciation pour les fournisseurs, ce qui a rendu ce cycle plus court que prévu.

La troisième fois, c'était entre 2017 et 2018. Les fournisseurs de cloud ont modernisé leurs centres de données en intégrant davantage de DRAM dans chaque serveur, et comme la mémoire des serveurs est plus chère et plus rentable que celle destinée au grand public, les marges brutes des trois grands acteurs ont atteint des niveaux historiques. Toutefois, cette rentabilité élevée a stimulé une expansion de la production ; dès que la demande a dépassé son pic, l'industrie a de nouveau plongé dans une phase baissière à la fin de l'année 2018.

La quatrième vague s'est produite entre 2020 et 2021, une prospérité inattendue stimulée par la pandémie. Le télétravail et l'augmentation exponentielle de l'utilisation du cloud ont créé une demande artificielle due à des commandes en double par panique ; après le reflux, les stocks ont été excessivement accumulés, suivis d'un effondrement douloureux entre 2022 et 2023. Depuis lors, la capacité de production a été fortement réduite, mais cette période conservatrice a posé les bases de la pénurie actuelle. En 2025, la capacité industrielle globale est de nouveau gravement insuffisante.

Quelle est donc la leçon fondamentale que l'histoire nous enseigne ? Les prétendus super-cycles passés n'ont jamais duré plus de deux ans ; ils ont toujours suivi le même schéma : « profits élevés → expansion folle → excédent → effondrement ». Cela constitue une loi inébranlable des quarante dernières années. Après tant de cycles, les investisseurs et les professionnels ont développé un réflexe conditionné profondément ancré : plus la hausse est forte, plus l'effondrement est rapide.

Mais cette fois-ci, de plus en plus de preuves suggèrent que les modèles historiques pourraient être rompus.

04 Pourquoi cette fois est différente : la transformation qualitative de la demande de l'entraînement à l'inférence

4.1 Commençons par une intuition la plus simple

Avant d'aborder des modèles complexes d'offre et de demande, commençons par une logique simple. Chaque jour, vous ouvrez ChatGPT ou Gemini, téléchargez des fichiers, sauvegardez vos conversations et faites en sorte que l'IA retienne vos préférences ; vous ne le réalisez peut-être pas, mais chaque interaction consomme des ressources de stockage. Il ne s'agit pas seulement du calcul côté serveur, mais aussi d'une quantité massive de mémoire et de mémoire flash.

La plupart des utilisateurs d'IA n'ont pas de fidélité pour le moment : ils choisissent celui dont le modèle est le plus efficace ou le moins cher. Mais imaginez un jour où votre assistant IA vous comprend vraiment, se souvient de vos habitudes de travail, de vos préférences d'expression et des détails d'un projet discuté il y a trois mois… Alors, changeriez-vous encore facilement de plateforme ?

Cette « rétention mémorielle » est l'arme centrale que les entreprises de grands modèles utilisent pour construire leur avantage concurrentiel, et l'infrastructure matérielle qui soutient cette rétention est le stockage : un stockage massif et multistratifié.

Il existe une autre logique tout aussi intuitive : les modèles vidéo deviennent de plus en plus puissants, et la génération vidéo par l’IA approche de la praticité. Or, les données vidéo représentent des dizaines, voire des centaines de fois plus de données que le texte, ce qui entraînera une augmentation exponentielle de la demande en stockage.

Rob Li

Managing Partner at Amont Partners, New York

La mémoire est comme une petite ardoise. Avant, nous calculions 1+1=2, donc vous n'aviez pas besoin d'une grande ardoise, une ardoise normale suffisait. Mais avec l'ère de l'IA, les calculs sont désormais bien plus intenses et complexes, comportant de nombreuses étapes. Si j'étais une petite ardoise, et que vous deviez écrire, effacer, réécrire, et réeffacer à nouveau pour 100 étapes de calcul, vous devriez effacer 100 fois, ce qui vous prendrait beaucoup de temps. C'est pourquoi nous devons maintenant créer une ardoise énorme, sur laquelle je peux écrire d'un coup les 100 étapes du calcul, puis les effacer d'un seul coup, ce qui me fait gagner du temps.

Ainsi, un tableau de plus en plus grand, telle est la demande de stockage à l'ère de l'IA.

4.2 De l'entraînement à l'inférence : les besoins en stockage connaissent une transformation qualitative

Au début de l'IA générative, les ressources informatiques et les fonds ont été principalement dédiés à l'entraînement des modèles ; le système de stockage durant cette phase avait pour principal rôle de fournir efficacement des données à des milliers de GPU et d'effectuer régulièrement des points de contrôle du modèle pour éviter la perte de l'entraînement en cas d'interruption.

Mais aujourd'hui, l'inférence devient rapidement le champ de bataille principal, et les besoins en stockage de l'inférence sont beaucoup plus complexes que ceux de l'entraînement.

Il faut charger le modèle depuis le niveau de stockage vers le niveau mémoire : les poids actifs résident principalement dans l'HBM, tandis que certains états et caches restent en DRAM ; lorsque le KV Cache (cache clé-valeur) ne peut plus tenir dans la mémoire supérieure, une partie est déchargée sur le SSD/NAND et récupérée au besoin ; les connaissances externes nécessaires aux requêtes RAG sont généralement stockées dans un stockage partagé ou un data lake plus en arrière-plan, et récupérées en temps réel par le système de recherche.

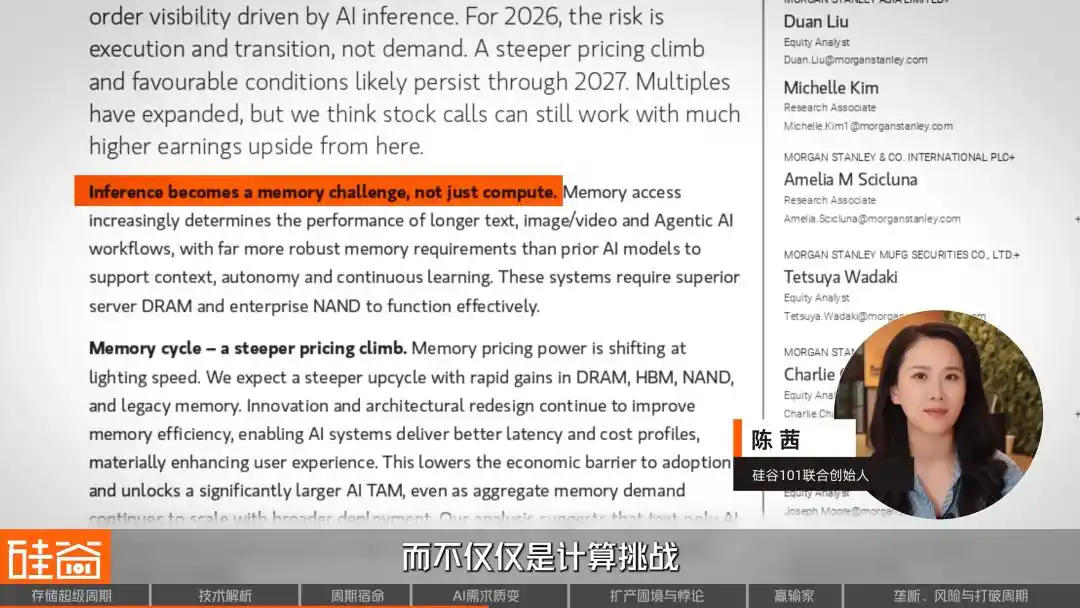

Le plus grand facteur variable est l'émergence des agents IA. Dans son dernier rapport d'analyse, Morgan Stanley indique que 2026 sera l'année où l'IA passera de l'expérimentation à l'infrastructure centrale, avec des agents plus fiables, dotés d'une meilleure mémoire, présentant moins d'hallucinations et capables d'apprendre en continu. Le rapport affirme : « Le raisonnement devient un défi de mémoire, et non plus uniquement un défi de calcul ».

Mais pour que les agents fonctionnent, il faut maintenir plusieurs niveaux de mémoire : mémoire de travail à court terme (conversation en cours), mémoire à long terme (historique utilisateur entre les sessions), base de connaissances pré-entraînée, enregistrements d'appels d'outils… Chaque niveau nécessite un support de stockage adapté : des « données chaudes » en HBM, aux « données tièdes » en DRAM, jusqu'aux « données froides » sur SSD NAND.

La tendance est donc claire : la prochaine vague d'avancées en IA ne viendra pas de capacités de raisonnement plus puissantes, mais d'une meilleure gestion du contexte. Un assistant IA capable de se souvenir de tout est bien plus utile qu'un modèle plus grand mais incapable de se souvenir de quoi que ce soit. Que cela signifie-t-il pour le stockage ?

4.3 Faisons le calcul : combien de stockage l’IA va-t-elle consommer ?

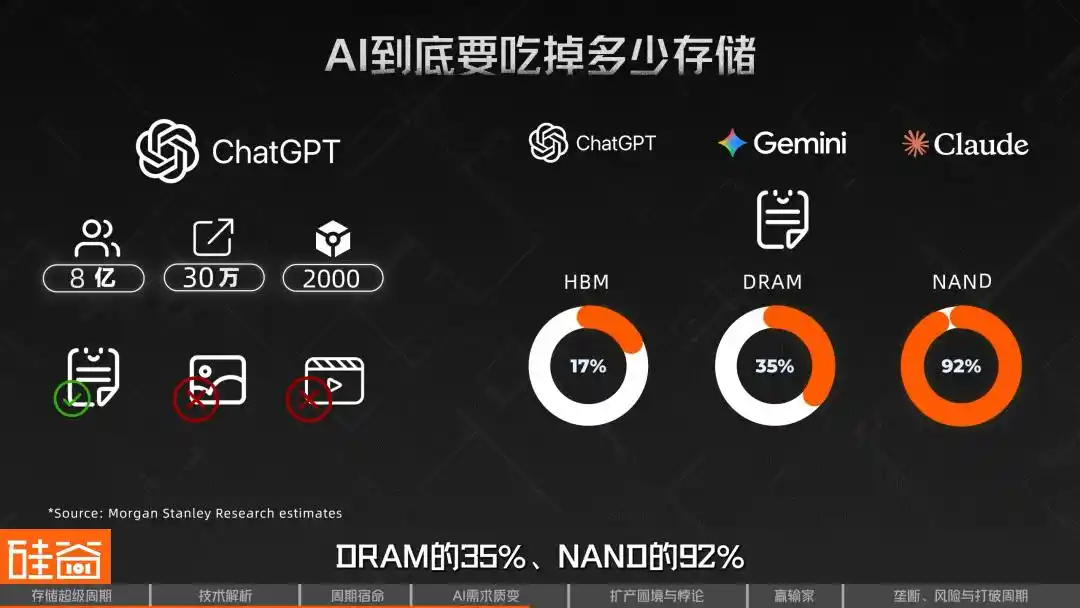

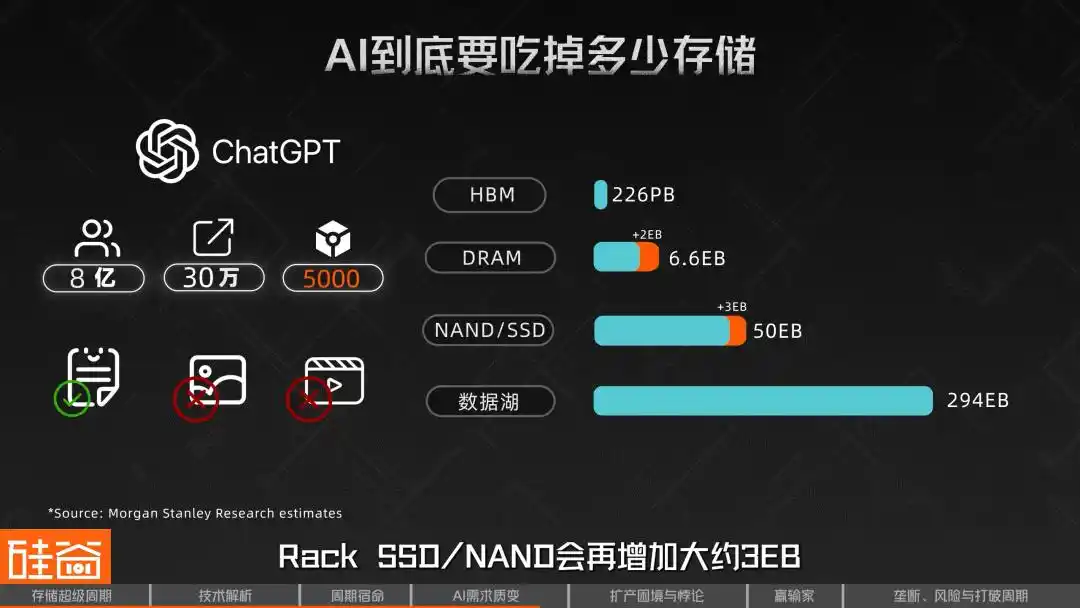

Morgan Stanley a effectué un calcul détaillé en couches. En se basant sur un modèle de taille similaire à ChatGPT, ils supposent environ 800 millions d'utilisateurs actifs hebdomadaires, un pic de 300 000 requêtes par seconde, 2 000 tokens d'entrée par requête, et ne prennent en compte que le texte, en excluant les images et les vidéos. Selon cette analyse détaillée, un tel système nécessiterait environ 226 PB de HBM, 4,6 EB de DRAM, environ 47 EB de NAND/SSD et un data lake d'environ 294 EB.

Ces chiffres signifient que si trois modèles de cette taille existent dans le monde, comme ChatGPT + Gemini + Claude, la demande purement textuelle en inférence représentera 17 % de l'offre mondiale de HBM, 35 % de celle de DRAM et 92 % de celle de NAND en 2026. Cela ne prend même pas en compte les besoins multimodaux tels que les images et les vidéos.

Plus important encore, cette estimation est très sensible à la longueur du contexte. L'analyse de sensibilité de Morgan Stanley montre que si la taille d'entrée est augmentée de 2 000 tokens à 5 000 tokens par requête, avec tous les autres paramètres inchangés, la demande en DRAM pour chaque modèle augmente d'environ 2 EB, et la demande en SSD/NAND par baie augmente d'environ 3 EB. Autrement dit, à mesure que des contextes plus longs et des chaînes de réflexion plus étendues deviendront la norme, la pression sur le stockage s'amplifiera rapidement.

SemiAnalysis appelle cela la « loi de Parkinson de la mémoire » : chaque fois que la capacité HBM augmente, les développeurs construisent immédiatement des modèles plus grands pour la remplir. Les techniques précédemment utilisées pour compresser les modèles sont relâchées dès qu'un nouvel espace devient disponible, jusqu'à ce que l'on heurte à nouveau une limite, ce qui signifie que le stockage sera toujours le prochain goulot d'étranglement.

C'est aussi pourquoi certains acteurs du secteur estiment que les fabricants de mémoires ont probablement sous-estimé la demande générée par l'augmentation massive des tokens des grands modèles linguistiques.

Rob Li

Managing Partner at Amont Partners, New York

Les cycles précédents pouvaient durer environ un an et demi à deux ans, mais ce cycle pourrait durer beaucoup plus longtemps, ou plutôt, lorsqu'une industrie cyclique devient une industrie à croissance structurelle, elle n'est plus cyclique.

Un autre facteur déterminant de ce cycle est l'expansion de la capacité de production. La question est : pourquoi cette expansion est-elle si difficile ?

05 Plus on augmente la production, plus on connaît pénurie : les défis et enjeux du HBM-DRAM

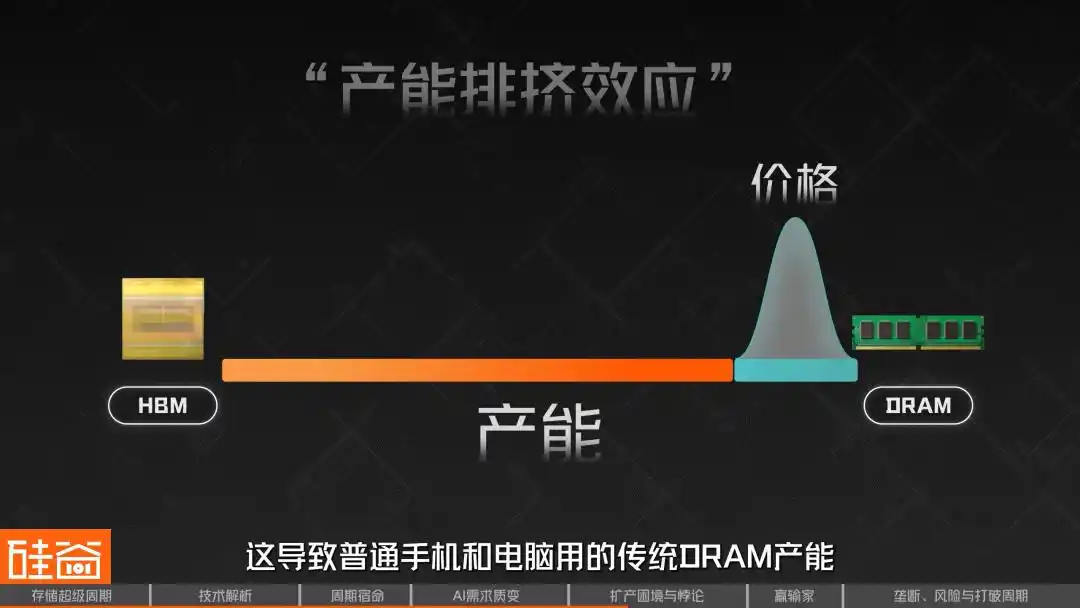

Comprendre cette super-cyclique repose également sur une clé essentielle : comprendre un phénomène qui semble contradictoire — la production à grande échelle de HBM n'a pas atténué la pénurie de DRAM, mais l'a au contraire aggravée.

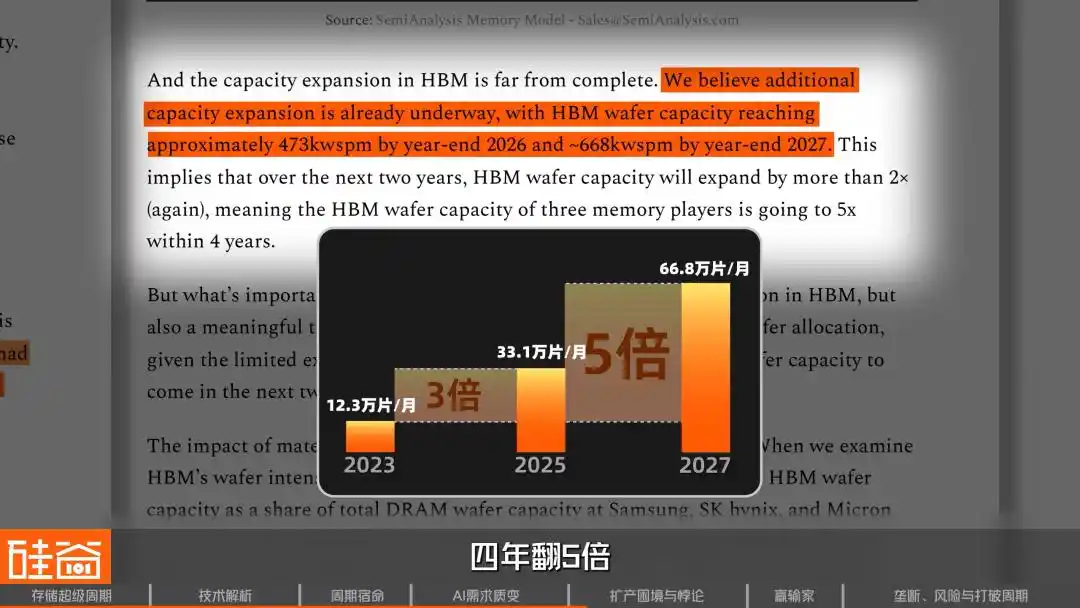

Les données de suivi de SemiAnalysis indiquent qu'à la fin de 2023, les trois principaux fabricants de stockage avaient alloué environ 123 000 wafers par mois à la production HBM. Ce chiffre est passé à 331 000 wafers par mois à la fin de 2025, soit une augmentation d'environ trois fois en deux ans. Il est prévu qu'il atteigne 668 000 wafers par mois à la fin de 2027, soit une multiplication par cinq en quatre ans.

Pourquoi la DRAM reste-t-elle en pénurie malgré une telle expansion ? La clé réside dans le fait que la production de HBM consomme une grande partie de la capacité de DRAM standard, avec une efficacité extrêmement faible.

HBM est une architecture extrêmement gourmande en wafers. Un wafer utilisé pour une pile HBM3E de 12 couches produit environ un tiers de la capacité de stockage d'un wafer DRAM classique ; pour HBM4, ce ratio pourrait se détériorer encore davantage pour atteindre un quart.

Candice Hu

Responsable du marketing des produits de stockage Samsung

Par rapport à la DRAM traditionnelle, la production de HBM sur la même plaquette ne permet d'obtenir qu'un tiers de la production de DRAM classique.

Cela signifie que pour chaque gigaoctet supplémentaire de HBM produit par les fabricants, le marché perd la possibilité de produire 3 à 4 Go de DRAM classique.

Pourquoi l'efficacité est-elle si faible ? Parce que la complexité de fabrication du HBM dépasse largement celle du DRAM classique : des étapes comme les TSV (via en silicium), l'ajustement de l'épaisseur des wafers et le traitement de la face arrière introduisent des pertes de rendement supplémentaires. Lors de l'empilement de 8 ou 12 couches, la moindre die défectueuse peut rendre tout l'empilement inutilisable.

Tous ces problèmes combinés font du HBM un produit « à échelle inverse » : plus on en produit, plus on consomme de capacité.

Cela a engendré le « dilemme HBM-DRAM », connu dans l'industrie sous le nom d'« effet de déplacement de capacité ». Étant donné que les HBM offrent des marges plus élevées et sont réservées en masse par les géants de l'IA, les fabricants privilégient l'affectation de leurs wafers limités aux lignes de production HBM. Cela a fortement réduit la capacité de production de DRAM traditionnel utilisé dans les téléphones et ordinateurs ordinaires, provoquant une hausse des prix spectaculaire.

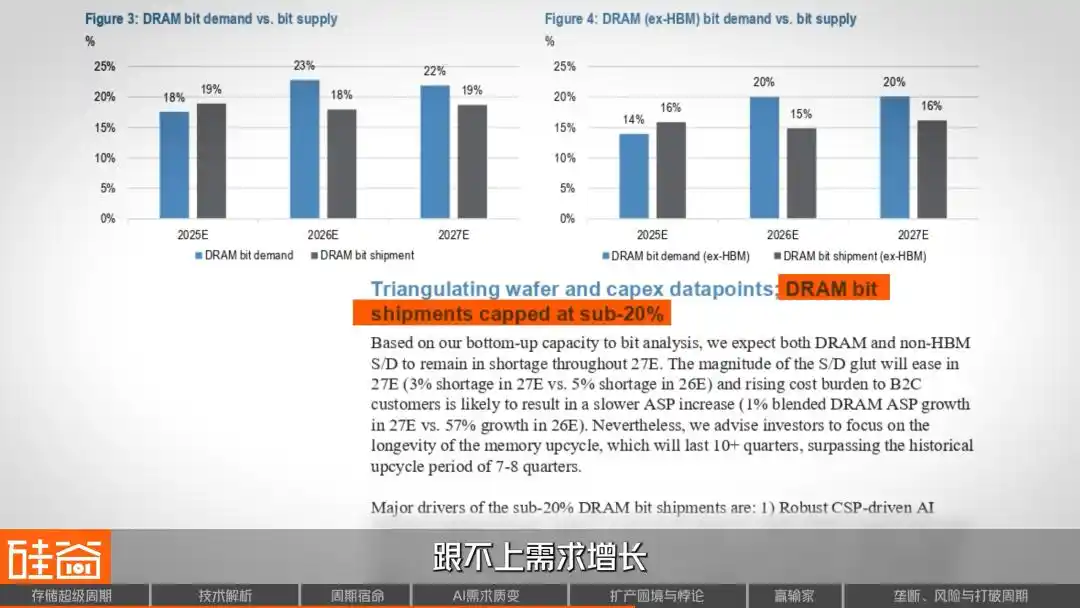

Le modèle d'offre et de demande issu du rapport de recherche de J.P.Morgan aboutit à une conclusion similaire : la croissance de l'offre de DRAM sera limitée à moins de 20 % au cours des deux prochaines années, ne suivant pas la croissance de la demande.

Ainsi, un phénomène surprenant est apparu : bien que le processus DRAM classique soit plus simple que celui du HBM, en raison de contraintes de capacité et d'une flambée des prix, sa marge bénéficiaire a atteint, au quatrième trimestre 2025, un niveau équivalent, voire supérieur, à celui du HBM. En effet, les prix du HBM sont généralement fixés à long terme par contrat, tandis que les prix spot du DRAM classique réagissent rapidement aux tensions d'offre et de demande. Cela pose un dilemme aux fabricants : faut-il continuer à augmenter massivement la production de HBM, ou bien réserver une partie de la capacité à la production de DRAM classique, tout aussi rentable ?

06 Les trois montagnes à surmonter pour l'expansion : pénurie de salles propres, prudence des fournisseurs d'équipements et friction de processus

La demande est déjà folle, et les contraintes de l'offre sont encore plus étouffantes.

Premier goulot d'étranglement : ressources de production insuffisantes, telles que les salles blanches. La fabrication de puces nécessite des salles blanches, mais après la pandémie, les fabricants de mémoire ayant adopté une approche prudente en raison du creux du cycle, leurs investissements ont été réduits, entraînant une grave pénurie de salles blanches en 2025 et 2026.

Candice Hu

Responsable du marketing des produits de stockage Samsung

Parce que la production de puces exige des conditions environnementales extrêmement strictes, ce qui nous préoccupe davantage, c’est la quantité suffisante de clean rooms et la disponibilité énergétique. Nous pourrions produire suffisamment de puces, mais sans une alimentation électrique suffisante pour les faire fonctionner.

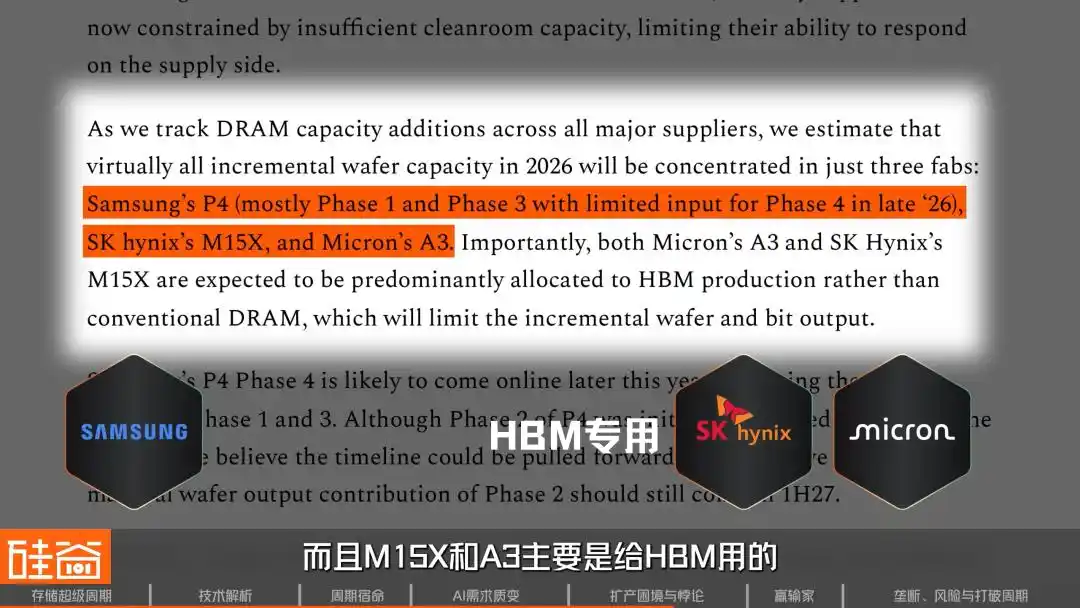

La suivi de SemiAnalysis montre que presque toute la nouvelle capacité de fabrication de wafers en 2026 sera concentrée sur trois usines : P4 de Samsung, M15X de SK Hynix et A3 de Micron. De plus, M15X et A3 sont principalement dédiées à la production de HBM, avec une contribution limitée au DRAM classique.

Quelles sont les nouvelles capacités réellement significatives ? La fabrique de SK Hynix à Yongin ne sera opérationnelle qu'à partir de février 2027 au plus tôt ; celle de Micron en Idaho cible le milieu de l'année 2027. Autrement dit, au cours des douze à dix-huit prochains mois, l'offre ne connaîtra pratiquement aucune augmentation.

Deuxième goulot d'étranglement : les fournisseurs d'équipements en amont refusent d'augmenter leur production.

Rob Li

Managing Partner at Amont Partners, New York

De nombreux fabricants d’équipements, notamment au Japon, comme le grand fournisseur Tokyo Electron, ne souhaitent pas augmenter leur capacité de production et restent prudents. Au cours des dernières décennies, ils ont traversé de nombreux cycles ; étendre la capacité prend plusieurs années, et lorsque cette capacité sera disponible, le cycle de l’IA pourrait déjà être terminé. Ils préfèrent donc ne pas augmenter leur production : au lieu de chercher à gagner 500 dollars, ils se contentent de gagner 100 dollars, ce qui leur permet de mener une vie agréable.

Source de l'image : TEL

C'est un exemple typique de l'effet tonneau : même si les fabricants de stockage ont les moyens et la volonté d'augmenter leur production, les goulets d'étranglement dans l'approvisionnement des équipements en amont ralentiront considérablement la mise en service de la capacité.

Troisième goulot d'étranglement : la friction liée à la migration des nœuds avancés. Pour maximiser la production de bits de mémoire dans un contexte de capacité de wafer limitée, les trois principaux fabricants accélèrent leur transition vers les nœuds avancés 1b (le nœud de production le plus avancé actuel) et 1c (le prochain nœud qui entrera bientôt en production de masse), car une technologie plus avancée permet une gravure plus fine des circuits : sur une même taille de wafer, le nœud 1c permet de produire davantage de puces de mémoire que le nœud 1b.

Mais le transfert de cette chaîne de production exige d'arrêter les machines pour un réajustement et une installation qui peuvent durer plusieurs semaines, voire plusieurs mois, entraînant inévitablement des fluctuations du taux de rendement et une perte de capacité sur plusieurs trimestres. À l'heure critique de l'explosion de la demande en IA en 2026, cette solution est trop lente pour répondre aux besoins immédiats.

Candice Hu

Responsable du marketing des produits de stockage Samsung

De la décision initiale d'augmenter la capacité à la construction d'un Fab (usine de fabrication de semi-conducteurs), puis jusqu'à ce que la chaîne de montage puisse produire des puces DRAM ou NAND, il faut trois ans. À ce stade, apparaît un type de puce difficile à produire, l'HBM : comme je l'ai mentionné, par rapport au DRAM traditionnel, l'HBM dispose d'un tiers de la capacité de production. J'attendais initialement deux à trois ans pour augmenter la capacité, mais maintenant, la production ne peut plus que diminuer d'un tiers. Ainsi, l'offre et la demande restent tendues dans ce cycle.

Le manque de ressources de production telles que les salles blanches, l'absence de relance de la capacité par les équipementiers, et les frictions liées au transfert vers des nœuds avancés — ces trois goulots d'étranglement combinés expliquent pourquoi, malgré la hausse fulgurante des puces de stockage que tout le monde reconnaît, l'offre reste impuissante.

07 Répartition des profits de la chaîne de valeur : qui profite du festin, qui subit l'hiver

La flambée des prix des puces de stockage n'est bien sûr pas sans coût ; elle répartit à nouveau les bénéfices de toute la chaîne industrielle électronique.

Premier bénéficiaire de cette chaîne de profit : outre les profits astronomiques des deux géants coréens, les fabricants chinois de stockage connaissent également une forte croissance. Biwin Storage prévoit une augmentation de 427 % à 520 % de son profit en 2025 par rapport à l'année précédente, tandis que Demingli prévoit une croissance de 85 % à 128 %.

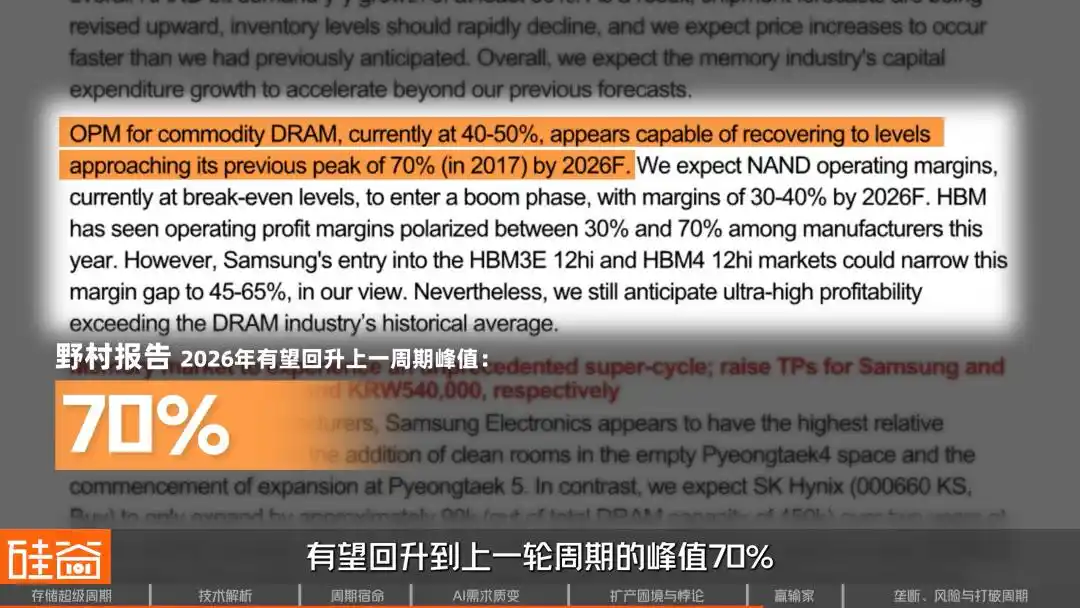

En ce qui concerne les marges brutes du secteur, Nomura estime que les marges des fabricants de DRAM génériques devraient remonter à 70 %, le pic de la précédente cycle, au cours de l'exercice 2026. J.P.Morgan est plus optimiste, estimant que d'ici 2027, la marge opérationnelle pourrait dépasser 80 %, voire dépasser le pic de la précédente vague.

Les perdants de cette chaîne d'approvisionnement sont les fabricants de matériel. Morgan Stanley a estimé qu'une hausse de 10 % des prix des puces de stockage réduit la marge brute des OEM de 45 à 150 points de base.

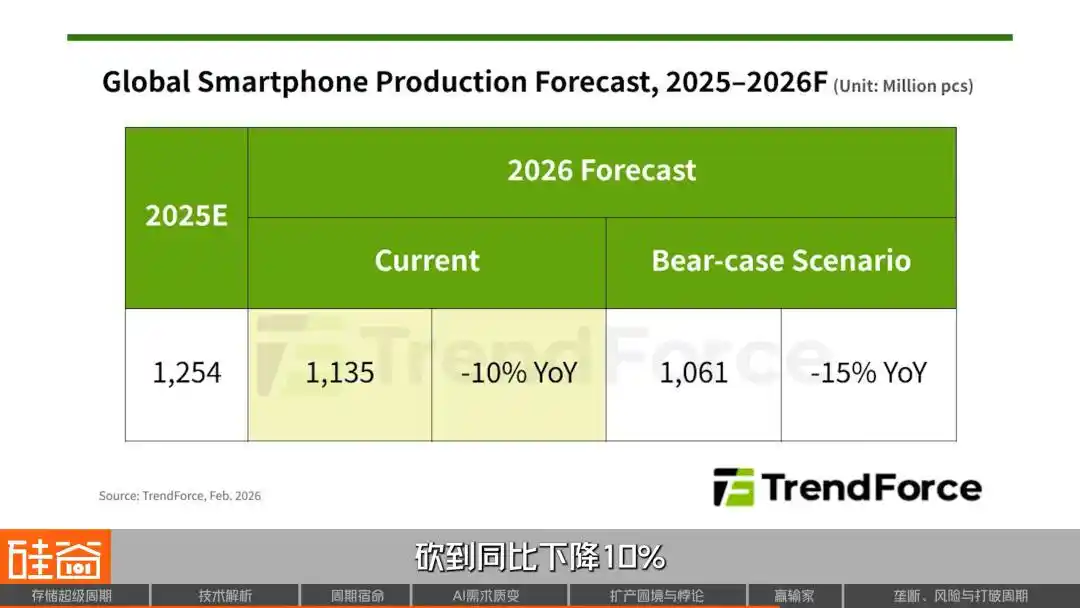

Le marché des téléphones portables est le premier touché : les prévisions de livraison de Xiaomi et d'OPPO ont été réduites de plus de 20 %, tandis que celles de vivo ont été abaissées d'environ 15 %. TrendForce a directement réduit sa prévision de la production mondiale totale de smartphones en 2026 à une baisse de 10 % en glissement annuel. Meizu a annoncé l'annulation du lancement du Meizu 22 Air, car les coûts sont devenus insoutenables. Le PDG de Nothing, Philip Pei, a déclaré sur les réseaux sociaux : « Les petites entreprises doivent chercher d'autres voies. »

Le marché des PC est tout aussi sévère : certains modèles de Lenovo ont vu leurs prix augmenter de 500 à 1500 yuans, tandis que Dell et HP ont clairement annoncé des hausses de prix, principalement dues à la répercussion des coûts des composants de stockage. Le CFO de Dell, Clark, a déclaré : « Je n'ai jamais vu des coûts augmenter aussi rapidement », et le PDG de HP envisage même « de réduire la quantité de mémoire utilisée dans ses produits ».

L'industrie automobile n'a pas été épargnée : le vice-président de la chaîne d'approvisionnement de Li Auto a averti publiquement que le taux de satisfaction des stockages automobiles pourrait être inférieur à 50 % en 2026. Li Bin de NIO a déclaré : « La pression coûts la plus importante cette année provient de la mémoire ». Lei Jun a reconnu en direct : « Seule la mémoire automobile entraînera une augmentation des coûts de plusieurs milliers de yuans. »

Candice Hu

Responsable du marketing des produits de stockage Samsung

Les fabricants de PC et de téléphones mobiles, même s’ils ont une réputation forte, n’ont actuellement pas beaucoup de pouvoir de tarification chez nous ; ils ne sont plus aussi recherchés, car leurs marges sont inférieures à celles des fournisseurs de cloud. Par exemple, nous avons récemment appris qu’une entreprise automobile nationale, en raison d’un manque de mémoire, pourrait supprimer le système de divertissement arrière de ses véhicules.

Rob Li

Managing Partner at Amont Partners, New York

Les téléphones et les PC devront certainement baisser d'au moins 5 % cette année, voire davantage, mais personne ne s'en souciera. Car ces trois géants, en particulier Micron, affirment qu'ils ne font plus cela, et que le marché pourrait tomber à zéro, cela ne les concerne pas.

De l'autre côté de la demande, les fournisseurs de cloud (Microsoft, Google, Amazon AWS) montrent une incroyable insensibilité aux prix.

Candice Hu

Responsable du marketing des produits de stockage Samsung

Les fournisseurs de cloud ont un coût marginal de 0 pour leurs ressources et leur logiciel. Leur argent et leur narration sont liés à leur cours boursier, ce qui les rend extrêmement insensibles aux prix — ils ne se soucient pas vraiment du coût exact de la mémoire.

Pour les fournisseurs de cloud, même si les marchés des téléphones et des PC venaient à disparaître, les fabricants de stockage n'en seraient pas affectés, car les perspectives des centres de données AI sont trop attrayantes. La question finale est donc : jusqu'à quand cette super-cyclique pourra-t-elle durer ? Cette fois-ci, est-ce vraiment différent ?

08 2026: What's next?

Aujourd'hui, le paysage concurrentiel de la chaîne de valeur du stockage reste stable. Actuellement, le marché des HBM suit une répartition d'environ « 6 : 2 : 2 », avec SK Hynix en tête, suivie par Samsung et Micron, chacune occupant sa part de marché. Certains investisseurs estiment toutefois que, dans ce marché vendeur où la demande largement dépasse l'offre, discuter des parts de marché n'a pas vraiment de sens.

Rob Li

Managing Partner at Amont Partners, New York

Puisque les trois géants sont tous limités en capacité de production, celui qui obtiendra plus de part de marché dépend simplement de qui pourra augmenter sa capacité, qui pourra vendre davantage, et qui pourra offrir une offre supplémentaire. Mais cela a peu à voir avec la qualité de la technologie, car le marché actuel connaît une demande bien supérieure à l'offre. À ce stade, discuter de la part de marché — par exemple, que SK Hynix en détient la moitié, soit plus que les deux autres — n'a aucun sens, car aucune des trois entreprises ne peut augmenter sa capacité.

La réalité est donc que les trois géants du stockage ont déjà épuisé leurs stocks ; celui qui parvient à libérer un peu plus de capacité en obtient une part plus importante. Toutefois, il est intéressant de noter que les grands fabricants de stockage ne cherchent peut-être pas à établir un monopole.

Candice Hu

Responsable du marketing des produits de stockage Samsung

Je pense qu'aucun acteur du stockage ne souhaite monopoliser le marché ; Samsung craint le monopole, et nos clients ne souhaitent pas non plus que nous le fassions. Dès lors qu'il y a une pénurie, comme actuellement, attribuer 100 % de la part de marché à un seul fournisseur de mémoire représente une pression énorme pour les acteurs du stockage. Ainsi, briser le monopole est précisément ce que les acteurs du stockage souhaitent voir.

Les gens pensent généralement que le monopole équivaut à une prime élevée, mais dans un secteur comme le stockage, caractérisé par des fluctuations de cycle extrêmes, une part de marché de 100 % signifie un risque de demande de 100 % : dès qu’un client annule une commande, l’entreprise se retrouve dans une position très vulnérable. Ainsi, les fabricants de stockage préfèrent au contraire maintenir un équilibre entre trois concurrents.

Alors, combien de temps cette période va-t-elle durer ?

Candice Hu

Responsable du marketing des produits de stockage Samsung

En 2026, il y aura une vente à 100 %, et l'écart entre l'offre et la demande atteindra 30 %, voire 50 %. En 2027, la pénurie persistera, et un véritable rétablissement ne sera probablement pas observé avant 2028 ; il s'agit donc d'une pénurie qui durera les deux à trois prochaines années.

En parallèle, la demande ne montre aucun signe de ralentissement. Ensuite, l'explosion de l'inférence IA et des agents, suivie de la demande pour les robots et l'IA physique, entraînera également un saut exponentiel de la capacité et du débit de stockage.

SemiAnalysis estime que l'offre totale de DRAM en 2026 restera encore d'environ 7 % inférieure à la demande. Sur le segment HBM, le déficit entre l'offre et la demande continuera de s'élargir jusqu'en 2027. En ce qui concerne les nouvelles capacités d'offre, une véritable augmentation significative de la production ne devrait apparaître que progressivement à partir du second semestre 2027. Selon les estimations de Nomura Securities, l'augmentation réelle de la production ne sera même visible qu'en 2028.

Mais une question plus importante mérite d’être soulignée : cette industrie va-t-elle désormais mettre fin à ses cycles ? Du point de vue de Wall Street, Rob offre dans l’interview une réflexion profonde :

Rob Li

Managing Partner at Amont Partners, New York

Ce cycle pourrait durer un très long moment, ou bien il transforme une industrie cyclique en une industrie à croissance structurelle, auquel cas ce n'est plus un cycle. Si une transformation majeure se produit actuellement dans l'industrie, passant d'une industrie cyclique à une industrie non cyclique, devenue une industrie à croissance structurellement stable, alors la perception globale du marché à son égard pourrait subir un changement qualitatif.

Pour les industries cycliques, un multiple de 10 fois les bénéfices est déjà considéré comme élevé, mais si elles deviennent des industries à croissance structurelle et que cette croissance se prolonge pendant de nombreuses années, leurs multiples cours/bénéfice pourraient doubler.

Où en sommes-nous exactement dans cette super-cyclique actuelle ?

L'axe horizontal de ce graphique représente une chronologie basée sur les cinq cycles précédents, avec le creux de chaque cycle comme point zéro ; l'axe vertical indique la hausse des transactions du marché. On peut observer que chaque cycle traverse quatre phases : pessimisme, scepticisme, optimisme et euphorie, avant de revenir au pessimisme. La courbe rouge actuelle nous place déjà dans la phase d'« optimisme », avec une hausse bien supérieure à celle de n'importe quel cycle précédent.

Cela correspond à ce que Rob vient de dire : cette transformation de la manière de penser. Et si l'IA venait vraiment à briser ce cycle ? Cela signifierait que même sans croissance des bénéfices, une simple réévaluation de la valorisation, passant d'une action cyclique à une action de croissance, pourrait faire doubler le cours de l'action. Personne ne dirait que la vente de téléphones par Apple relevait, au cours des 20 dernières années, d'un secteur cyclique. Si le stockage pouvait atteindre ce stade, ce serait une transformation paradigmatique de l'ensemble du cadre d'investissement dans le secteur des semi-conducteurs.

Cependant, la demande dans le secteur du stockage présente également une certaine incertitude ; les variables côté demande ne proviennent pas uniquement du niveau macroéconomique, mais la technologie elle-même peut réécrire la relation entre l'offre et la demande.

Par exemple, fin mars, Google a lancé un nouvel algorithme appelé TurboQuant, prétendument un algorithme efficace de compression de mémoire par IA. Après son lancement, il a immédiatement fait sensation dans le milieu technologique de la Silicon Valley et a provoqué un effondrement généralisé du secteur du stockage.

Mais rapidement, des voix du secteur ont contesté en affirmant que ce krach était une erreur. Tout d'abord, cet article a été publié il y a un an et présente déjà certaines controverses académiques. De plus, cet algorithme n'a été validé jusqu'à présent que sur de petits modèles comme Gemma et Mistral ; aucun test n'a été effectué sur des modèles de plus de 70B, sur des architectures MoE ou dans des scénarios à contexte de millions de tokens — les cas où la demande mémoire de l'IA explose réellement. Des experts techniques ont également précisé que, techniquement, TurboQuant ne compresse que le KV Cache présent dans la mémoire GPU pendant l'inférence — l'une des trois principales sources de demande mémoire de l'IA — mais n'a aucun impact sur l'entraînement.

En tout cas, cet article et cet algorithme ont été violemment critiqués. Mais c’est intéressant : le simple fait qu’un ancien article controversé ait pu déclencher un effondrement aussi brutal sur les marchés financiers ne suggère-t-il pas quelque chose ? Ne signifie-t-il pas que la confiance du marché dans le secteur du stockage est devenue extrêmement fragile ? Rappelons qu’avant ce krach, SanDisk avait déjà augmenté de 200 % depuis 2026, et Micron de plus de 80 %.

Des institutions vendeuses à découvert ont directement souligné que SanDisk, avec une capitalisation boursière de 92 milliards de dollars et un bénéfice net attendu de seulement 6 milliards de dollars pour 2026, a une valorisation difficile à justifier. Micron fait face à des interrogations similaires : malgré la réalisation de ses meilleurs résultats historiques, ses dépenses en capital de 20 milliards de dollars pour l'exercice fiscal 2026 représentent une augmentation de 68 % en glissement annuel, ce qui constitue un pari audacieux sur une croissance continue de la demande en mémoire.

Au fond, l'article sur TurboQuant n'était qu'une mèche ; le véritable baril de poudre, c'était la surévaluation extrême accumulée au cours des deux dernières années, et tout signe indiquant une demande potentiellement moindre suffit à déclencher une panique.

Ces progrès au niveau algorithmique constituent précisément le risque le plus difficile à intégrer à l'avance dans le récit du « super-cycle », et Rob a également donné une alerte finale sur ce risque.

Rob Li

Managing Partner at Amont Partners, New York

Les inquiétudes concernant l'industrie du stockage persisteront jusqu'à ce que l'on découvre que cette activité devienne une entreprise « type Apple » à croissance stable et continue. La première préoccupation est que l'IA échoue, ce qui entraînerait la chute de tous, car la majeure partie de la croissance actuelle provient de l'IA. Si un jour l'IA s'avère inefficace et que l'on réalise qu'elle n'a aucune utilité, alors tout ce que vous avez prédit comme avenir deviendra du vent, réduit à zéro.

Ainsi, les prévisions optimistes actuelles concernant le « super-cycle » reposent toutes sur une condition : la demande en IA est réelle et durable. Si un jour une bulle éclate dans le secteur de l’IA, l’industrie du stockage ne pourra pas rester à l’écart. Cette épée de Damoclès restera suspendue jusqu’à ce que le secteur prouve réellement qu’il est devenu une activité à croissance stable, à la manière d’Apple.

SemiAnalysis définit ce cycle comme une « pénurie une fois tous les quarante ans ». Mais la direction plus précieuse pourrait être : l'industrie des puces de stockage se trouve à un carrefour, où elle pourrait, comme au cours des quarante dernières années, glisser vers un nouveau creux après un pic de prix ; ou bien, sous l'impulsion de la demande structurelle de l'IA, briser véritablement le cycle et devenir une industrie à croissance continue.

Au moins jusqu’en 2026, la réponse semble pencher vers ce dernier scénario. La capacité de production des trois principaux fabricants de stockage est entièrement vendue, les commandes des fournisseurs de matériel en amont s’étendent jusqu’en 2027, les clients commencent à verser des acomptes et à signer des contrats à long terme juridiquement contraignants, et même une entreprise japonaise fabricante de toilettes en a vu son destin modifié.

Mais l'histoire n'a jamais manqué de moqueries sur l'idée que « cette fois, c'est différent ». La seule certitude est que, quels que soient les résultats de cette tentative de briser le cycle, elle a déjà redéfini de manière irréversible la carte des pouvoirs dans l'industrie technologique mondiale. Dans ce jeu de la faim pour les puces de stockage, celui qui contrôle l'offre détient la parole dans l'ère de l'IA.