Le 27 mars, le premier Forum sur l'innovation et la sécurité de l'Agentic AI et le premier Sommet international Web 4.0 de Hong Kong, organisés conjointement par Hong Kong Science and Technology Parks Corporation, ME Group et iPollo, ont eu lieu en grande pompe au Hong Kong Science Park. Sous le thème « Applications innovantes de l'Agentic AI : Transformation technologique et fusion industrielle à l'ère du Web 4.0 », ce sommet a réuni des figures de premier plan du monde politique, académique, industriel et scientifique, notamment le Secrétaire au Trésor du gouvernement de la Région administrative spéciale de Hong Kong, Chan Nok-po, le président du Hong Kong Science Park, Chan Sai-ming, le membre du conseil d'administration du Hong Kong Science Park et fondateur de Nano Labs, Kong Jianping, ainsi que le célèbre investisseur angele Cai Wensheng, pour examiner ensemble les opportunités et défis dans la nouvelle ère où l'IA passe de la « conversation » à l'« action ».

À l'ère où l'intelligence artificielle agente (Agentic AI) suscite un vif intérêt, les questions de sécurité qu'elle soulève sont particulièrement cruciales. Yu Xian, fondateur de SlowMist, a été invité à participer à ce sommet et a présenté une conférence intitulée « Défis de sécurité entre l'IA et le monde cryptographique, ainsi que les innovations en matière de défense », partageant avec les leaders mondiaux de l'industrie les dernières observations et pratiques de SlowMist dans le domaine de la sécurité de l'IA.

Focus sur l'avant-garde : Analyse approfondie des menaces à la sécurité d'OpenClaw et des AI Agent

Alors que les technologies d'IA pénètrent continuellement le monde des cryptomonnaies, les applications d'agents IA, telles qu'OpenClaw ("养龙虾"), connaissent une popularité rapide. Mais derrière cette vague, une question plus profonde émerge : les limites de sécurité des agents IA n'ont pas encore été véritablement établies.

Dans son exposé, Yu Cheng a effectué une analyse approfondie d'OpenClaw et formulé un jugement clé : « Le texte est une instruction. » Il a expliqué que, dans le contexte d'exécution des agents IA, toutes les entrées ne sont plus simplement des « informations », mais des instructions potentiellement exécutables. Cela signifie que toute information externe reçue par le modèle — qu'elle provienne de la saisie de l'utilisateur, de documents ou de compétences tierces — peut être directement interprétée et exécutée, étendant ainsi la surface d'attaque du niveau code au niveau « cognitif ». Dans ce mécanisme, les voies d'attaque sont considérablement simplifiées. Les attaquants n'ont plus besoin de contourner les défenses de sécurité traditionnelles ; il leur suffit de concevoir du texte soigneusement conçu pour induire l'agent en erreur et l'amener à exécuter des opérations non prévues, telles que le transfert d'actifs, la fuite d'informations sensibles ou même l'exécution de commandes à distance. La discrétion et le faible coût de ces voies d'attaque en font une menace très réelle.

Dans ce mécanisme, les voies d'attaque sont considérablement simplifiées. Les attaquants n'ont plus besoin de contourner les défenses de sécurité traditionnelles ; il leur suffit de concevoir du texte soigneusement conçu pour induire l'agent en erreur et l'amener à exécuter des opérations non prévues, telles que le transfert d'actifs, la fuite d'informations sensibles ou même l'exécution de commandes à distance. La discrétion et le faible coût de ces voies d'attaque en font une menace très réelle.

Sur la base de ce mécanisme, Cosine résume les trois catégories de risques principaux auxquels OpenClaw est actuellement confronté :

- Entrée et manipulation d'intention (couche d'interaction utilisateur) : les attaquants peuvent tromper l'Agent en effectuant une « injection directe de prompts » pour l'inciter à exécuter des opérations à haut risque. Il convient particulièrement de surveiller la contamination indirecte de la chaîne d'approvisionnement — les attaquants intègrent des instructions malveillantes dans les documents Markdown des Skill. Étant donné que le Markdown joue souvent le rôle d'« entrée d'installation », les textes explicatifs originaux peuvent facilement se transformer en scripts d'exécution malveillants (par exemple, curl | bash), entraînant un vol de données.

- Risque de la couche de décision et d'orchestration (couche logique d'application) : Cette erreur ne provient pas du modèle lui-même, mais d'une « logique d'exécution erronée ». Un attaquant peut perturber le raisonnement logique de l'Agent afin de modifier l'adresse de réception lors de processus métier tels que des transferts de cryptomonnaies, entraînant une perte directe de fonds.

- Risque au niveau du modèle (cerveau central) : inclut les « hallucinations » générées par le modèle, qui le poussent à exécuter des commandes système inexistantes ou dangereuses, ainsi que les modes d'opération insécurisés mal appris à partir des données d'entraînement.

Yuxian a souligné : « Les problèmes exposés par OpenClaw ne sont pas un phénomène isolé, mais un défi structurel auquel fait face l'écosystème actuel des agents IA. » Autrement dit, les questions de sécurité ne sont plus un « cas » spécifique à un projet, mais un risque systémique que toute l'industrie doit prendre au sérieux.

Attaque et défense : construire un écosystème open source sécurisé pour les agents IA

Face aux formes évolutives de menaces, Yu Cheng a présenté dans son discours l'approche sécuritaire « offensive et défensive » de SlowMist : il ne s'agit pas seulement de comprendre les chemins d'attaque, mais aussi d'intégrer les capacités de défense dans les mécanismes de fonctionnement des agents, pour une sécurité intégrée.

Il a présenté aux invités une série d'outils open source et de solutions pratiques développés par SlowMist autour des AI Agent, dans le but de promouvoir la création d'un écosystème sécurisé transparent, vérifiable et réutilisable :

- Guide des pratiques de sécurité minimalistes d'OpenClaw : un guide complet allant de la couche认知 à la couche infrastructure, offrant une « empreinte mentale de sécurité » systématique pour le déploiement d'agents AI à hauts privilèges dans un environnement de production réel.

- SlowMist Agent Security Skill : Un cadre d'audit de sécurité complet qui dotera les agents tels qu'OpenClaw d'un « œil averti ». Il permet non seulement de détecter les risques de poisoning des Skills classiques, mais aussi d'identifier les risques liés aux adresses de portefeuilles sur chaîne, aux dépôts de code et aux URL.

- MistTrack Skills : Un pack de compétences Agent plug-and-play offrant aux agents IA des capacités professionnelles de conformité AML et d'analyse des risques d'adresses pour les cryptomonnaies, utilisé pour l'évaluation des risques d'adresses sur chaîne et l'analyse des risques avant transaction.

- MCP Security Checklist : Une liste de vérification systématique pour auditer et renforcer rapidement les services Agent, aidant les équipes à éviter les oublis de points de défense critiques lors du déploiement de MCPs/Skills et des chaînes d'outils IA associées.

- Démonstration malveillante de MCP : Un exemple de serveur MCP malveillant open source conçu pour reproduire des scénarios d'attaque réels et tester la robustesse des systèmes de défense, adapté à la recherche en sécurité et à la validation des défenses.

À travers cette série de pratiques, Yu Cheng souligne : « Les capacités de sécurité doivent être intégrées à l'Agent, et non uniquement dépendre de protections périphériques. » Seule une liaison approfondie entre les mécanismes de défense et la logique d'exécution de l'Agent permettra à celui-ci de fonctionner de manière continue et sécurisée dans l'écosystème complexe de Web3 et de l'IA.

Sécurité systématisée : ADSS protège intégralement l'écosystème AI + Web3

À la fin de sa présentation, Yu Chong a présenté l'ADSS (AI Development Security Solution) proposé par SlowMist.

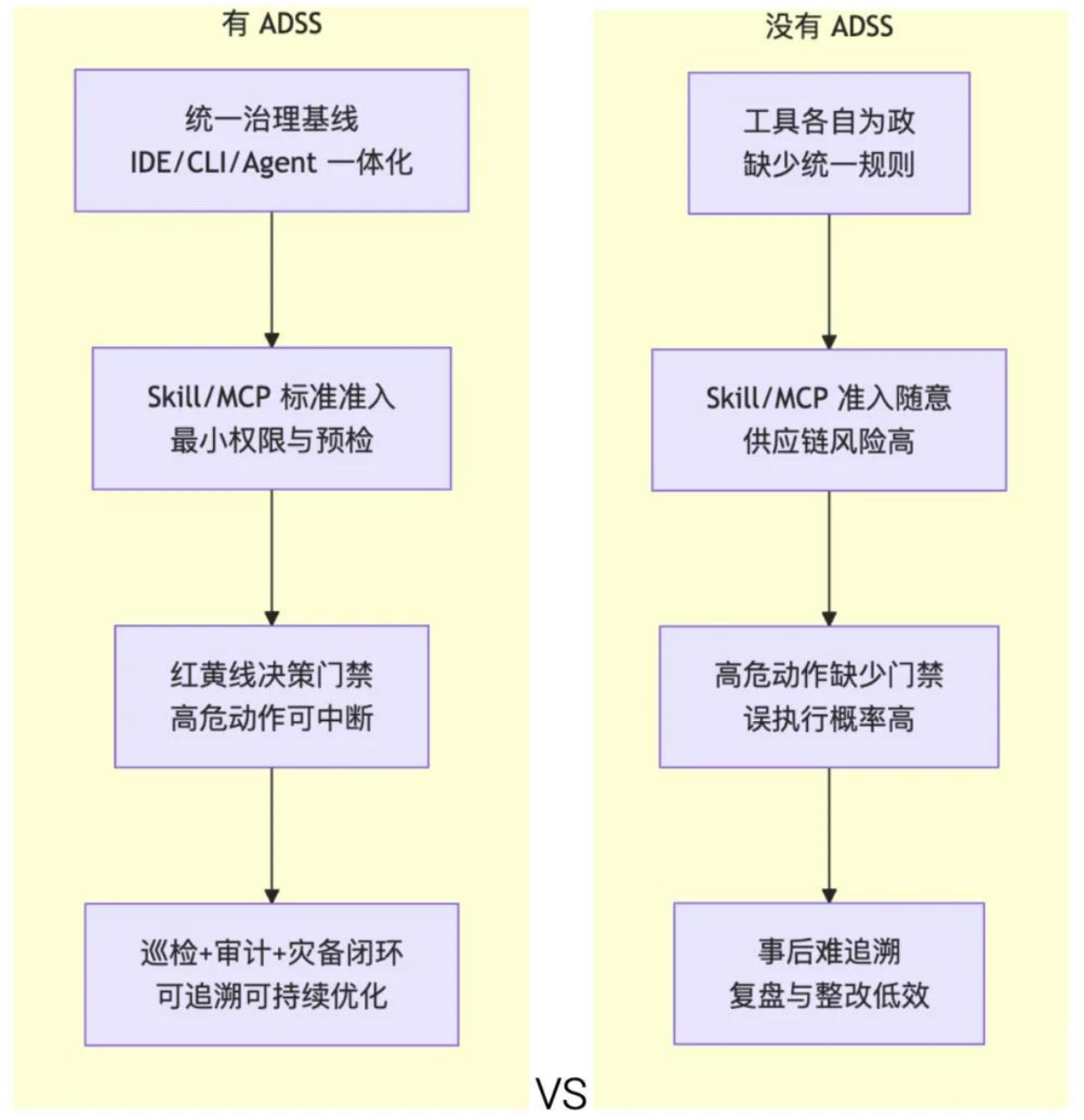

Si les outils mentionnés précédemment relèvent de la « capacité tactique », ADSS ressemble davantage à un cadre de sécurité systémique. Son concept fondamental consiste à transformer des actions de sécurité éparses en un mécanisme opérationnel de sécurité systémique, exécutable, auditables et durable.

ADSS construit des capacités de gouvernance sécurisée pour l'IA + Web3 à plusieurs niveaux :

- Gouvernance de la sécurité L1 (ligne de base de développement) : établir des normes de sécurité unifiées pour le développement et l'utilisation, couvrant les outils de développement, le cadre Agent, l'écosystème de plugins et l'environnement d'exécution, afin de fournir à l'équipe une source unique de stratégies et des critères d'audit.

- Niveau L2 de permissions et contraintes d'opération : en resserrant les limites des permissions de l'Agent, en minimisant les permissions d'appel d'outils et en introduisant un mécanisme de confirmation humaine pour les opérations critiques, la portée des comportements à haut risque est efficacement contrôlée.

- Protection contre les interactions externes L3 : Introduire une détection en temps réel des menaces au niveau des ressources externes telles que les URL, les dépôts de dépendances et les sources de plugins, afin de réduire la probabilité qu'un contenu malveillant ou un empoisonnement de la chaîne d'approvisionnement pénètre dans la chaîne d'exécution.

- Isolation des actifs sur la chaîne L4 : pour les opérations impliquant des transactions sur chaîne, combinaison d'une analyse des risques sur chaîne et d'un mécanisme de signature indépendant, permettant à l'Agent de construire des transactions sans accéder directement aux clés privées, réduisant ainsi les risques systémiques liés aux opérations sur des actifs de haute valeur.

- L5 Surveillance et analyse continues : grâce à l'audit des journaux, à des révisions de sécurité périodiques et à des mécanismes opérationnels, réaliser une capacité de sécurité en boucle fermée permettant une vérification préalable à l'exécution, une contrainte pendant l'exécution et une analyse post-exécution.

Yuxian souligne que ADSS n'est pas un outil unique, mais un système de sécurité opérationnelle durable et évolutif. Il vise à aider les équipes à construire un système de sécurité pour les agents auditables et évolutifs, grâce à des stratégies systématisées, des audits continus et une synergie des capacités, tout en ne réduisant pas significativement l'efficacité du développement et les capacités d'automatisation, afin de faire face aux menaces de sécurité en constante évolution dans un contexte où l'IA et le Web3 sont profondément intégrés.

Conclusion

Le premier forum sur l'innovation et la sécurité des Agentic AI a réuni les acteurs majeurs du secteur et offert des perspectives prospectives sur la sécurité des AI Agents. Avec l'intégration profonde des Agentic AI et du Web3, les défis de sécurité continueront d'augmenter. En tant que société de sécurité blockchain de premier plan mondial, SlowMist continuera de promouvoir la mise en œuvre d'une gouvernance sécurisée systémique, en utilisant ADSS, des outils open source et des pratiques pour construire des capacités de sécurité intrinsèques aux AI Agents, afin d'aider le secteur à réaliser un développement durable et maîtrisé au cœur de la vague d'innovation.