Alors que tout le monde se bat pour les couches de modèles, une équipe détenant la norme ouverte pour l'inférence lance officiellement son attention sur les nouvelles infrastructures d'IA, accompagnée du plus prestigieux groupe d'investisseurs en seed round de la Silicon Valley.

Auteur de l'article, source : Machine Heart

Le 5 mai, RadixArk, une startup d'infrastructure IA, a annoncé la levée d'un financement de série A de 100 millions de dollars, avec une valorisation post-financement de 400 millions de dollars. Que ce soit en termes de montant, de valorisation ou de阵容 d'investisseurs, il s'agit de la plus importante mise en avant jusqu'à présent dans le secteur de l'infrastructure IA en 2026.

Ce tour est mené par Accel, en partenariat avec Spark Capital. Les investisseurs institutionnels incluent NVentures, filiale de NVIDIA, AMD, MediaTek, Databricks, ainsi que Salience Capital, HOF Capital, Walden Catalyst, A&E Investment, LDVP et WTT Fubon Family, parmi les principaux acteurs du secteur. Pratiquement tous les acteurs clés des composants matériels et des couches système, du GPU au CPU, en passant par les puces edge et les plateformes de données, sont présents.

En dehors du cercle des principales institutions, plusieurs chefs de file technologiques mondiaux, issus de contextes tels qu'Intel, Broadcom, OpenAI, xAI et PyTorch, ont également participé à ce tour de financement en tant qu'investisseurs天使.

Le regroupement du PDG d’un des trois géants du matériel, du fondateur d’un laboratoire de modèles de pointe et du créateur de PyTorch dans un seul tour de graine est extrêmement rare dans l’histoire de l’infrastructure IA. Les investisseurs familiarisés avec ce domaine affirment directement : il s’agit d’un pari sur « le futur standard de fait de l’infrastructure ».

Le meilleur moteur de raisonnement au monde, entre leurs mains

L'histoire de RadixArk doit commencer par un projet open source appelé SGLang.

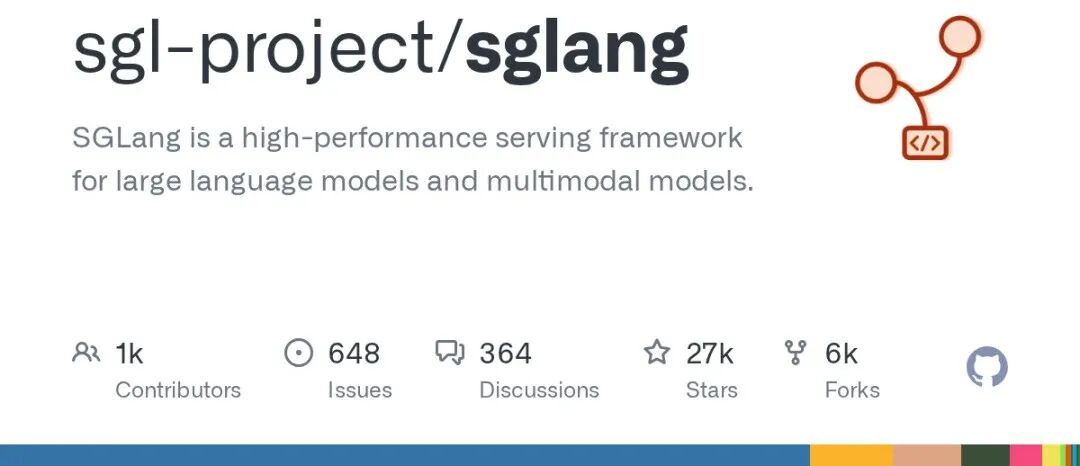

Depuis sa création en 2023, SGLang est devenu l'une des normes factuelles pour l'inférence de modèles de grande taille open source, avec un rythme d'itération incroyable en seulement deux ans. Il a accumulé plus de 27K étoiles sur GitHub et est déployé sur plus de 400K GPU. Des milliers de billions de tokens de trafic de production circulent quotidiennement sur SGLang, avec pour utilisateurs Google, Microsoft, NVIDIA, Oracle, AMD, LinkedIn, xAI et Thinking Machines Lab.

Au cours des deux dernières années, les architectures de modèles ont subi des changements majeurs, notamment l'adoption de MoE, de contextes longs, de modèles de raisonnement et de fusion multimodale. À chaque refonte d'architecture, SGLang a assuré une compatibilité Day-0 — grâce à un mécanisme pionnier qui permet de prendre en charge les modèles open source dès leur publication, avec des performances proches des limites physiques des machines. Un commentaire souvent cité par les investisseurs est que la vitesse d'itération de SGLang, alliée à une discipline technique rigoureuse, est absolument parmi les meilleures dans les projets open source.

Derrière cette discipline fondamentale se trouve une équipe fondatrice possédant une profonde expertise en systèmes et algorithmes.

La PDG Ying Sheng a obtenu sa licence à la classe ACM de l'Université Jiaotong de Shanghai et son doctorat à l'Université de Stanford. Elle est la fondatrice de LMSYS Org et l'une des principales créatrices de SGLang. Pendant son doctorat, elle a effectué des recherches en tant que chercheuse visitante au Sky Lab de l'UC Berkeley, puis a travaillé chez Databricks et xAI, où elle a dirigé l'équipe d'inférence de xAI. Ses travaux sur la raréfaction de l'attention et la réutilisation du cache KV attirent une grande attention dans le secteur ; le mécanisme RadixAttention de SGLang en est l'un des exemples emblématiques.

Le CTO Zhu Banghua a obtenu sa licence en génie électronique à l'Université Tsinghua et son doctorat à l'UC Berkeley, sous la direction des pionniers de l'apprentissage automatique Michael I. Jordan et Jiantao Jiao. Pendant son doctorat, il a cofondé Nexusflow, ultérieurement acquise par NVIDIA, où il a occupé le poste de Principal Research Scientist. Il a travaillé sur des projets allant de la mise en place complète de systèmes d'entraînement industriels à l'optimisation des systèmes sous-jacents et à l'accumulation d'expériences à long terme sur l'entraînement à grande échelle au sein de NVIDIA.

Un responsable technique d'un fabricant de matériel clé a évalué que c'est l'équipe de fondateurs la plus valorisée dans le domaine de l'infrastructure IA en 2026 : d'un côté, un entrepreneur chercheur maîtrisant la norme事实 du raisonnement open source, de l'autre, un expert en algorithmes de grands modèles issu du cœur de la recherche d'un fabricant de GPU.

Détenir le moteur d'inférence SGLang, capable de traiter des trillions de tokens par jour, est déjà un point de départ idéal pour une startup dans l'infrastructure IA. Mais cette équipe ne se contente pas de cette seule carte.

Jour 0 : Maîtriser l'apprentissage par renforcement DeepSeek V4

Outre le moteur d'inférence, RadixArk a également réalisé des progrès du côté de l'entraînement.

En novembre 2025, l'équipe a open-sourcé le cadre d'apprentissage par renforcement Miles, axé sur la stabilité et l'efficacité de l'entraînement RL à grande échelle, et il est désormais utilisé par plus de 20 équipes pour l'entraînement par renforcement de modèles MoE.

Entre 2025 et 2026, la concurrence autour des capacités de raisonnement, d'utilisation d'outils et d'agentivité s'intensifie massivement, et chaque progrès nécessite un système capable de supporter un RL distribué à très grande échelle. Les observateurs du secteur soulignent un point douloureux souvent mentionné mais longtemps insoluble : ce qui rend les équipes de grands modèles les plus malheureuses aujourd'hui dépasse largement toute optimisation ponctuelle. Les frottements aux frontières de la chaîne complète — du entraînement au RL, puis à l'inférence en production — sont chacun presque optimaux isolément, mais lorsqu'ils sont assemblés, ils entraînent une perte d'efficacité à chaque étape.

La combinaison de Miles et SGLang tente de combler le fossé d'efficacité actuel que les équipes de grands modèles rencontrent sur la chaîne complète « entraînement-RL-inférence ».

La capacité du nouveau modèle Day-0 est une illustration directe de la compétence technique de l'équipe Infra.

Le 25 avril, DeepSeek-V4, d'architecture complexe, a été lancé. Le même jour, SGLang et Miles ont réussi à prendre en charge simultanément l'inférence et l'entraînement RL de DeepSeek-V4. Cela a été rendu possible grâce à des optimisations systèmes fondamentales de l'équipe, notamment le cache de préfixes ShadowRadix conçu pour l'attention hybride, le Flash Compressor permettant la compression en une seule opération sur puce, ainsi que Lightning TopK, qui réduit la latence Top-K à 15 microsecondes, en établissant une chaîne RL complète allant de l'inférence FP8 à l'entraînement BF16.

Endossement par la consensus full-stack :

Les géants entrent en masse : de quoi ont-ils vraiment peur ?

NVIDIA, AMD, MediaTek, Broadcom, Intel — il est presque impensable dans l'industrie que ces entreprises clés du niveau matériel apparaissent toutes ensemble à un round seed. En réalité, les fabricants de matériel comprennent mieux que quiconque que la puissance de calcul reste coûteuse et rare, et qu'il n'est plus possible de compter uniquement sur l'accumulation de matériel. Un système d'inférence open source véritablement découplé du matériel, capable d'exploiter au maximum les performances des puces sur des plateformes hétérogènes, constitue leur demande la plus urgente.

La participation simultanée de Databricks, du créateur de PyTorch et des figures de premier plan d'OpenAI / Thinking Machines / xAI indique une forte attente en matière d'infrastructure intégrée « entraînement-inférence ». Chaque nom de ce panel d'investisseurs initiaux représente une perspective de pari extrêmement précise :

- Chen Liwu, PDG d'Intel, une figure de proue du secteur des semi-conducteurs avec plusieurs décennies d'expérience.

- John Schulman est le cofondateur de OpenAI, le cofondateur de Thinking Machines Lab et l'un des pionniers de l'apprentissage par renforcement.

- Soumith Chintala — cofondateur de PyTorch, gardien des frameworks d'apprentissage profond mondiaux.

- Igor Babuschkin, ancien cofondateur de xAI, a personnellement conçu les systèmes d'entraînement et les plateformes matérielles les plus complexes du secteur.

- Lilian Weng, cofondatrice de Thinking Machines Lab, possède une expertise de première main sur la mise en œuvre industrielle des systèmes d'IA.

Lorsque ces individus, capables de lever des fonds seuls dans n'importe quelle circonstance, choisissent de figurer ensemble sur la même table de capitalisation, c'est un pari audacieux sur l'avenir.

Infrastructure pour tous : ne laissez plus à quelques-uns le monopole de la construction de l'IA

La vision de RadixArk peut être résumée en une phrase : faire de l'infrastructure IA un bien public aussi répandu, fiable et non monopolisé que l'électricité. Cela semble être un manifeste idéaliste, mais en pratique, ils sont en train de transformer cette phrase en réalité :

- milieu académique

Il y a trois ans, un doctorant travaillant sur l'optimisation de l'inférence LLM n'avait généralement que deux options : l'API d'OpenAI, facturée au token et sans accès à aucune structure interne, ou un code open source ancien dont le README indiquait « fonctionne sur un seul GPU », éloigné des scénarios distribués réels décrits dans les articles de recherche par des années de développement.

SGLang brise ce dilemme — débit journalier industriel, code entièrement ouvert ; les équipes de recherche systèmes de Stanford, Berkeley, CMU et UW l'utilisent par défaut comme référence. Pour les chercheurs en agents, le cache de préfixe RadixAttention organise les préfixes partagés sous forme d'arbre, ne calculant les paires KV identiques qu'une seule fois : des expériences qui prenaient deux jours peuvent désormais être exécutées en une demi-journée, et citer SGLang dans les articles locaux est devenu presque une pratique standard.

- Start-up

Un groupe d'ingénieurs ayant quitté de grandes entreprises, porteurs d'une compréhension approfondie d'un scénario vertical, ont lancé leur propre startup. Ils n'avaient ni budget informatique d'un million de dollars, ni équipe Infra dédiée, seulement une intuition forte pour leur produit.

Auparavant, la création de pipelines d’inférence prêts pour la production et la maintenance de la compatibilité multi-hardware représentaient une charge technique trop lourde pour les entreprises en phase de seed round, consommant une grande partie du temps à réinventer la roue. Désormais, elles peuvent directement déployer des services d’inférence aux performances proches des pointes en s’appuyant sur SGLang, et entraîner des modèles spécifiques à leur domaine avec Miles — l’infrastructure n’est plus un goulot d’étranglement ; le temps et l’argent économisés peuvent désormais être entièrement consacrés à ce qu’elles veulent véritablement construire.

- Géant technologique

Pourquoi des géants possédant les infrastructures internes les plus puissantes au monde, comme Google, Microsoft et NVIDIA, figurent-ils sur la liste des utilisateurs de SGLang ? La réponse réside dans la structure des investisseurs de ce cycle : cinq fabricants de matériel clés — NVIDIA, AMD, MediaTek, Broadcom et Intel — ont tous participé. Ils savent mieux que quiconque ce qu’un système d’inférence open source, indépendant du matériel et non verrouillé par un concurrent, représente pour l’écosystème dans son ensemble. Utiliser un système open source maintenu collectivement par la communauté et soutenu par plusieurs fabricants de matériel constitue en soi une stratégie d’infrastructure d’un niveau supérieur.

L'énoncé officiel de RadixArk n'est pas sensationnel, mais suffisamment tranchant :

La prochaine génération d'IA ne devrait pas être limitée par l'accès à des infrastructures privées. Plus d'équipes devraient pouvoir posséder leurs propres modèles, leurs propres systèmes, leur propre avenir.

Ce financement de semence de 100 millions de dollars vise à transformer cette phrase en réalité technique : faire de SGLang la norme de production au jour 0 pour tout nouveau modèle ; transformer Miles en infrastructure fondamentale pour l'entraînement à grande échelle et le RL ; puis, sur la base d'un noyau open source, construire une plateforme hébergée offrant des capacités d'infrastructure de premier plan, sans verrouillage des modèles ni emprisonnement des clients.

La vision de RadixArk n'a jamais été de remplacer qui que ce soit. Elle vise à permettre à un laboratoire universitaire, à un petit studio de trois personnes, à une startup venant de lever un financement amorce, et à un géant d'une capitalisation boursière de plusieurs billions de dollars — de se trouver sur la même ligne de départ en matière d'infrastructure.

Si Anthropic en 2023, Mistral en 2024 et Thinking Machines Lab en 2025 ont chacun effectué un pari directionnel sur la couche des modèles d'IA, alors RadixArk en 2026 parie sur quelque chose de plus fondamental et de plus durable : rendre le droit de construire les IA de pointe véritablement accessible à un nombre suffisamment grand de personnes.

Après le financement conclu, l'équipe a lancé une initiative de retour à la communauté open source : en vous inscrivant sur la plateforme et en partageant le tweet, vous obtiendrez des crédits d'utilisation gratuits une fois la plateforme RadixArk officiellement lancée. Pour cette équipe issue de la communauté open source, il s'agit d'une reconnaissance concrète, sous forme de puissance de calcul, envers ceux qui ont soutenu SGLang jusqu'à aujourd'hui.

- Lien : platform.radixark.com