Deux cerfs-volants dansant au cœur d'un ouragan

Auteur de l'article original : 0xsmac

Traduit par SpecialistXBT

Note de l'éditeur : Cet article examine avec acuité l'apparente prospérité actuelle des marchés prédictifs. L'auteur souligne avec pertinence que les marchés prédictifs actuels s'engouffrent dans un piège similaire à celui qui a touché BlackBerry et Yahoo, celui des "optima locaux". Bien que le modèle d'options binaires adopté par les marchés prédictifs dominants ait généré un trafic important à court terme, il est confronté à des problèmes structurels tels que la faible liquidité et l'inefficacité du capital. L'article propose une évolution vers un modèle de contrats à terme perpétuels, offrant ainsi une réflexion approfondie et constructive sur la réalisation d'un véritable "marché de tout".

Pourquoi les entreprises se retrouvent-elles à poursuivre des objectifs erronés ? Pouvons-nous réparer les marchés prédictifs avant qu'il ne soit trop tard ?

« Le succès ressemble à une boisson alcoolisée puissante, qui enivre. Il n'est pas facile de maîtriser la célébrité et les compliments qui s'ensuivent. Ils corrompent votre esprit, vous faisant croire que tout le monde vous admire, que tout le monde désire votre présence, que chacun pense constamment à vous. » — Ajith Kumar

« Le rugissement de la foule est toujours la plus belle musique. » — Vin Scully

Les premières réussites sont grisantes. Elles le sont d'autant plus lorsque tout le monde vous dit que vous ne réussirez pas. Foutaises, les détracteurs ! Tu avais raison, eux avaient tort !

Mais les premiers succès recèlent un danger particulier : vous pourriez gagner les mauvaises récompenses. Bien que l'on plaisante souvent en disant « jouer au jeu idiot, gagner le mauvais prix », dans la réalité, les jeux auxquels nous participons évoluent souvent en temps réel. Ainsi, les facteurs qui vous ont permis de remporter une victoire au premier stade risquent justement, une fois le jeu entré dans sa phase mature, de devenir des obstacles empêchant l'obtention de récompenses plus importantes.

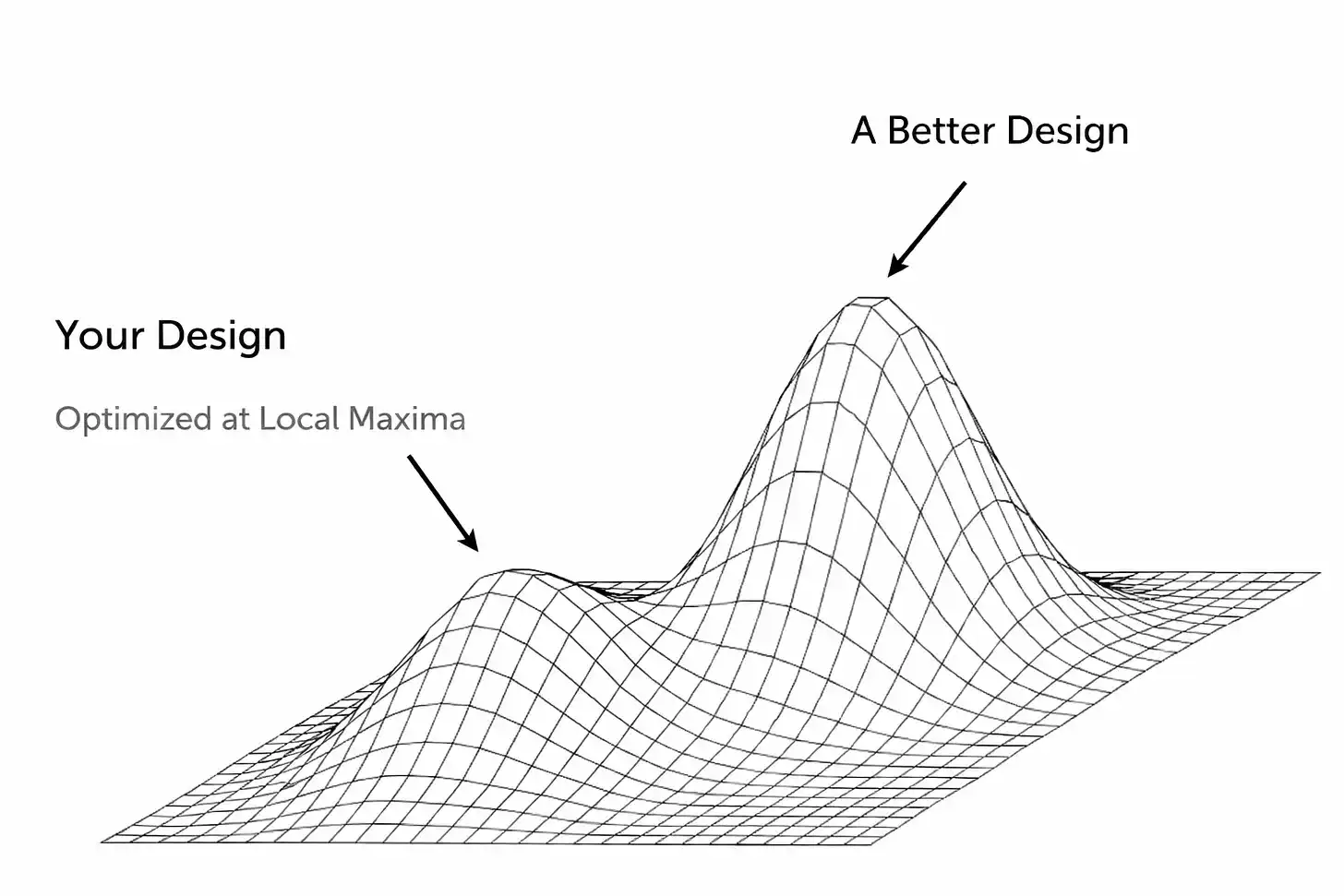

Une forme de telle issue est que l'entreprise entre par erreur dans un "optimum local" sans s'en rendre compte. Le sentiment de victoire est si agréable qu'il vous fait non seulement perdre votre direction, mais il vous empêche même d'avoir une conscience de soi claire, vous empêchant de voir la réalité de la situation dans laquelle vous vous trouvez.

Dans de nombreux cas, cela peut n'être qu'un mirage, une illusion soutenue par des facteurs externes (comme une prospérité économique entraînant une abondance de revenus disponibles chez les consommateurs). Ou alors, le produit ou le service que vous avez conçu fonctionne effectivement bien, mais uniquement dans un cadre ou sous des conditions spécifiques, sans pouvoir être étendu à un marché plus vaste.

Le conflit fondamental ici est que pour poursuivre le grand prix ultime (c'est-à-dire la solution optimale globale), vous devez descendre du pic actuel. Cela nécessite une grande humilité. Cela signifie prendre des décisions difficiles : abandonner une fonction centrale, refaire entièrement le stack technique, ou même détruire vous-même un modèle que vous croyiez efficace. Ce qui rend tout cela encore plus difficile, c'est...

La plupart du temps, vous devez prendre cette décision précisément au moment où les gens (surtout les investisseurs et les médias) vous disent à quel point vous êtes excellent ! Beaucoup de ceux qui affirmaient auparavant que vous aviez tort se précipitent maintenant pour confirmer votre succès. C'est une situation extrêmement dangereuse, car elle nourrit l'arrogance justement au moment où vous avez le plus besoin d'entreprendre des changements radicaux.

C'est exactement la situation dans laquelle se trouvent aujourd'hui les marchés prédictifs. Dans leur forme actuelle, ils ne pourront jamais connaître une adoption à grande échelle. Je ne veux pas perdre de temps ici à débattre s'ils ont déjà atteint ce stade ou non (après tout, il existe un énorme fossé entre le simple fait de savoir qu'une chose existe et le fait d'en avoir réellement besoin pour l'utiliser). Peut-être ne partagez-vous pas cette hypothèse et préparez-vous à fermer cette page ou à lire le reste avec hostilité. C'est votre droit. Mais je tiens à expliquer à nouveau pourquoi ce modèle est actuellement défaillant, et à décrire ce que je crois qu'une telle plateforme devrait être.

Je ne veux pas me montrer trop technophile, et je ne vais pas répéter le "Dilemme de l'innovateur", mais les cas classiques en la matière sont Kodak et Blockbuster. Ces entreprises (ainsi que beaucoup d'autres) ont connu un énorme succès, ce qui a généré une inertie face au changement. Nous connaissons tous la fin de l'histoire, mais se contenter de hausser les épaules en disant "il fallait faire mieux" n'est pas constructif. Alors, quels sont exactement les facteurs qui ont conduit à ces résultats ? Apercevons-nous des signes de ce phénomène dans les marchés prédictifs d'aujourd'hui ?

Parfois, les obstacles résident au niveau technique. Les start-up construisent souvent leurs produits d'une manière subjective et spécifique, qui peut fonctionner efficacement au stade initial (ce qui, pour une jeune entreprise, est déjà un exploit en soi !), mais qui devient rapidement un frein rigide pour l'architecture future. Continuer à évoluer après une première phase d'expansion ou ajuster le design du produit implique alors de remettre en question certains composants centraux qui semblaient efficaces. Naturellement, les équipes ont tendance à résoudre les problèmes par des correctifs progressifs, ce qui conduit rapidement à un produit devenu une sorte de patchwork. Cela ne fait que reporter l'inévitable confrontation avec la dure réalité : ce qui est vraiment nécessaire, c'est une refonte totale ou une réinvention du produit.

Cela s'est déjà produit dans les premiers réseaux sociaux. Friendster, l'un des pionniers des réseaux sociaux en 2002, permettait à des millions d'utilisateurs de se connecter en ligne via des « amis d'amis ». Mais des problèmes sont survenus lorsqu'une fonction particulière (afficher les amis jusqu'à trois degrés de séparation) a entraîné l'effondrement de la plateforme, submergée par la charge de calcul exponentielle des connexions.

L'équipe a refusé de réduire cette fonctionnalité, préférant se concentrer sur de nouvelles idées et des partenariats spectaculaires, même si les utilisateurs existants menaçaient de migrer vers MySpace. Friendster a atteint un pic de popularité local, mais n'a pas réussi à franchir ce seuil, en raison de défauts structurels dans son architecture centrale, que l'équipe refusait d'admettre, d'analyser et de réparer. (Par ailleurs, MySpace a lui aussi fini piégé dans sa propre forme de "maximum local" : il s'appuyait sur une expérience utilisateur unique, à savoir des profils hautement personnalisables, et se concentrait sur les communautés musicales et culturelles. La plateforme était principalement alimentée par la publicité, et a fini par devenir excessivement dépendante de son modèle de portail publicitaire, alors que Facebook arrivait sur le marché avec un réseau plus propre, plus rapide, et basé sur l'identité "réelle". Facebook a attiré une partie des premiers utilisateurs de MySpace, mais a surtout séduit la prochaine vague importante d'utilisateurs de réseaux sociaux.)

Il n'est pas surprenant que ce genre de comportement persiste. Nous sommes tous humains. Obtenir un certain succès apparent, surtout en tant que start-up, dont le taux d'échec est extrêmement élevé, entraîne naturellement une inflation de l'estime de soi. Les fondateurs et les investisseurs commencent à croire aux performances qu'ils vantent, et parient davantage sur la formule qui les a amenés jusqu'ici, même si des signaux d'alerte s'allument de plus en plus clairement. Il est facile d'ignorer de nouvelles informations, voire de refuser d'admettre que la réalité actuelle diffère de celle du passé. Le cerveau humain est ainsi fait : avec suffisamment de motivation, nous sommes capables de justifier bien des choses.

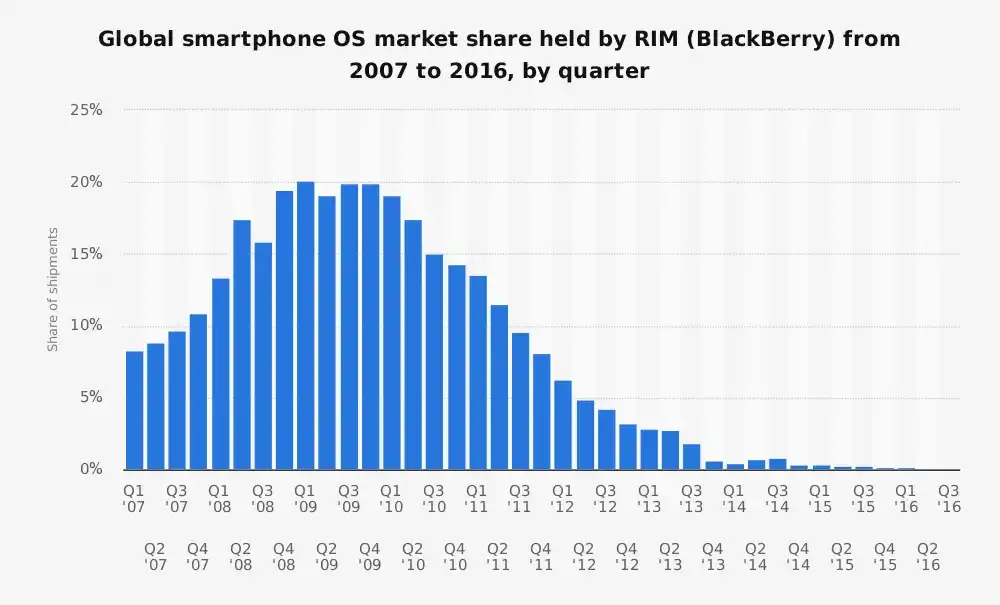

Le « Research In Motion » qui stagne

Avant l'apparition de l'iPhone, le BlackBerry de Research In Motion (RIM) était roi des smartphones, détenant plus de 40 % du marché des smartphones aux États-Unis. Il s'appuyait sur une idée spécifique du smartphone : un meilleur PDA (Personal Digital Assistant, ou assistant numérique personnel), optimisé pour les utilisateurs d'entreprise, conçu notamment pour l'accès à l'e-mail, une autonomie prolongée de la batterie et un clavier physique réputé. Cependant...

Les affaires humaines changent rapidement, aussi vite que la foudre.

Un point sous-estimé aujourd'hui est le fait que BlackBerry s'est très bien comporté en matière de service client. C'est pourquoi, lorsque le monde a changé autour d'eux, RIM n'a pas réussi à s'adapter.

Comme tout le monde le sait, son équipe dirigeante a d'abord sous-estimé l'iPhone.

« Ce n'est pas sécurisé. La batterie se décharge très rapidement, et le clavier numérique est mauvais. » — Larry Conlee, directeur des opérations de RIM

Ils devinrent rapidement très défensifs.

Le fait que RIM considère avec arrogance que ce nouveau téléphone ne séduirait jamais sa clientèle d'entreprise n'est pas entièrement infondé. Cependant, cela ignore complètement la révolution marquée par le passage des smartphones d'outils de messagerie sécurisée vers des dispositifs universels accessibles à tous. Cette entreprise a accumulé une dette technique et une dette de plateforme, symptômes fréquents chez les entreprises ayant connu un succès précoce. Leur système d'exploitation et leur infrastructure étaient optimisés pour la messagerie sécurisée et l'autonomie de la batterie. Quand ils ont fini par accepter la réalité, il était trop tard.

Il existe une idée selon laquelle les entreprises se trouvant dans une telle situation (où plus le succès initial est grand, plus l'évolution devient difficile — ce qui est d'ailleurs l'une des raisons pour lesquelles Zuckerberg est considéré comme le « GOAT », le meilleur de tous les temps) devraient adopter une approche presque schizophrène : un groupe se consacre à tirer parti du succès actuel, tandis qu'un autre groupe se consacre à le bouleverser. Apple pourrait être l'exemple type de cette stratégie, en laissant l'iPhone éroder progressivement le marché de l'iPod, puis en laissant l'iPad éroder celui des Mac. Mais si cela était facile, tout le monde s'en serait inspiré.

Yahoo!

Cela pourrait être une « opportunité manquée » à la hauteur de Mount Rushmore. Jadis, Yahoo! était la page d'accueil d'Internet pour des centaines de millions de personnes. C'était la porte d'entrée vers Internet (voire même pourrait-on dire l'application universelle originale) : actualités, courrier électronique, finance, jeux, tout y était. La recherche n'était qu'une fonction parmi d'autres, au point que Yahoo! n'utilisait même pas sa propre technologie de recherche au début des années 2000 (il avait confié la recherche à un moteur tiers, et utilisait même brièvement Google).

Aujourd'hui, il est bien connu que sa direction a renoncé à plusieurs occasions de renforcer ses capacités de recherche, notamment celle d'acquérir Google pour 50 milliards de dollars en 2002. En y regardant de plus près, cela semblait évident, mais Yahoo n'a pas compris ce que Google savait : la recherche est la base de l'expérience numérique. Qui possède la recherche possède le trafic internet, et donc les revenus publicitaires. Yahoo s'est trop appuyé sur la force de sa marque et sur la publicité d'affichage, tout en sous-estimant de façon catastrophique l'importante évolution vers une navigation centrée sur la recherche, puis vers les réseaux sociaux, qui offraient ensuite des flux de contenus personnalisés.

Tu te souviens de ce type ?

Pardonnez-moi d'utiliser un lieu commun, mais dans un marché spéculatif, « quand l'eau monte, les bateaux flottent ». Le secteur des cryptomonnaies en a fait l'expérience (voir par exemple Opensea et de nombreux autres cas). Il est difficile de déterminer si votre start-up possède une véritable traction ou si elle profite simplement d'une vague d'élan insoutenable. Cela devient encore plus flou lorsque ces périodes coïncident avec une augmentation des investissements de capital-risque et des comportements de consommation spéculatifs, masquant ainsi les problèmes fondamentaux sous-jacents. La montée et la chute rapide et absurde de WeWork illustre bien ce phénomène : un accès facile au capital a entraîné une expansion massive, dissimulant un modèle économique complètement défaillant.

En enlevant tous les emballages de marque et les grands discours, le modèle économique fondamental de WeWork est très simple :

Loueur longue durée d'un espace de bureau → Dépenser pour la décoration → Relouer à court terme avec une prime.

Si vous n'êtes pas familier avec cette histoire, vous pourriez penser : "Eh bien, cela ressemble beaucoup à un courtier immobilier." C'est exactement ce que c'est. Un arbitrage immobilier déguisé en plateforme logicielle.

Mais WeWork n'avait pas nécessairement pour objectif de construire une entreprise durable. Ce qu'elle optimisait, c'était quelque chose de tout à fait différent : une croissance explosive et une histoire de valorisation. Cela a fonctionné un certain temps grâce à la forte personnalité d'Adam Neumann, capable de vendre un rêve. Les investisseurs y ont cru aveuglément, favorisant ainsi un type particulier de croissance entièrement déconnecté de la réalité (dans le cas de WeWork, cela signifiait ouvrir un maximum de bureaux dans un maximum de villes, sans se préoccuper de la rentabilité, c'est-à-dire la « croissance fulgurante », la signature de très grands contrats de location à long terme, et le rejet de l'idée fondamentale de la rentabilité unitaire, en affirmant que « les pertes pourraient être surmontées par la croissance »). Beaucoup d'observateurs extérieurs (des analystes) avaient percé à jour la vérité : il s'agissait d'une entreprise immobilière inversant les risques, avec une clientèle instable, et un modèle économique qui intégrait structurellement des pertes.

La plupart des analyses ci-dessus sont des analyses a posteriori de sociétés ayant échoué. Elles relèvent, en quelque sorte, du « je le savais depuis le début ». Cependant, elles reflètent trois types d'insights distincts sur l'échec : une société échoue parce qu'elle n'arrive pas à progresser techniquement, parce qu'elle n'identifie pas ou n'adapte pas sa réponse à la concurrence, ou parce qu'elle n'arrive pas à ajuster son modèle économique.

Je crois que nous assistons maintenant à la même scène se dérouler sur les marchés prédictifs.

L'engagement de prévision du marché

Les perspectives théoriques de la prévision des marchés sont séduisantes :

L'intelligence du groupe = Meilleures informations = Transformation de la spéculation en sagesse collective = Marché infini

Mais les plateformes leaders d'aujourd'hui ont atteint un pic local. Elles ont mis au point un modèle capable de générer une certaine traction et un volume d'échanges, mais cette conception ne peut pas réaliser pleinement la véritable vision d'« une prédiction possible pour toutes choses, accompagnée d'une liquidité suffisante ».

À première vue, les deux plateformes ont montré des signes de succès, personne ne mettant cela en doute. Kalshi a rapporté que le volume annuel d'échange de l'industrie atteindrait environ 30 milliards de dollars cette année (nous reviendrons plus en détail sur la part d'augmentation organique dans ce chiffre). L'industrie connaît actuellement une nouvelle vague d'intérêt croissant en 2024-2025, particulièrement grâce à l'émergence du récit autour de la finance sur les chaînes de blocs (« on-chain finance ») et à la gamification du trading, qui s'inscrivent pleinement dans l'esprit de l'époque. Le marketing intensif de Polymarket et Kalshi pourrait également y être pour quelque chose (dans certains cas, un marketing agressif s'avère effectivement efficace).

Mais si nous épluchons l'oignon et creusons un peu plus profondément, nous découvrons certains signaux d'alerte suggérant que la croissance et la PMF (Product-Market Fit) pourraient ne pas être aussi solides qu'elles n'en ont l'air. L'éléphant dans la pièce est la liquidité.

Pour que ces marchés fonctionnent, ils ont besoin d'une liquidité importante, c'est-à-dire d'un grand nombre de personnes prêtes à parier d'un côté du marché, de manière à ce que les prix aient un sens et révèlent une découverte de prix réelle.

En dehors de quelques marchés très médiatisés, Kalshi et Polymarket peinent tous les deux sur ce point.

Les volumes d'échange importants se concentrent autour d'événements majeurs (élection présidentielle américaine, décisions très attendues de la Réserve fédérale), mais la plupart des marchés présentent des étalements d'offres (bid-ask spreads) très étroits et peu d'activité. Dans de nombreux cas, les market-makers ne souhaitent même pas effectuer des transactions (un des fondateurs de Kalshi a récemment reconnu que ses market-makers internes ne réalisaient même pas de bénéfices).

Cela montre que ces plateformes n'ont pas encore résolu le problème crucial de l'élargissement et de la profondeur du marché. Elles restent bloquées à un niveau donné : elles se portent assez bien sur une dizaine de marchés populaires, mais la vision d'un marché de « tout » représenté par la longue traîne reste à réaliser.

Pour cacher ces problèmes, les deux entreprises ont recours à des incitations et à des comportements non durables (ça vous rappelle quelque chose ?), ce qui est un signe typique d'une recherche de solutions optimales locales et d'une croissance naturelle insuffisante. (Petite parenthèse à ce sujet : dans cette dynamique de marché particulière, j'ai l'impression que la plupart des gens pensent que ces deux entreprises sont les seuls acteurs majeurs en concurrence.)

Je ne pense pas que cela soit nécessairement important à ce stade, mais si ces deux équipes y croient fermement, alors le fait que l'une d'elles soit perçue comme « menant » dans cette supposée « course à deux chevaux » constituerait une menace existentielle pour l'autre entreprise. C'est une position particulièrement instable, à mon avis fondée sur une hypothèse erronée.

Polymarket a lancé un programme de récompenses pour la liquidité, tentant de réduire l'écart de prix (théoriquement, si vous placez des ordres autour du prix courant, vous recevez des récompenses). Cela aide à rendre le livre d'ordres plus dense et améliore effectivement l'expérience des traders en réduisant partiellement le slippage. Mais il s'agit tout de même d'une subvention. De même, Kalshi a mis en place un programme d'incentifs à volume, qui consiste en fait à offrir un remboursement en argent aux utilisateurs selon leur volume de trading. Ils dépensent de l'argent pour inciter les gens à utiliser leur produit.

Je sens déjà parmi vous quelqu'un crier à pleins poumons : « Uber a aussi subventionné longtemps ! ». Oui, les incitations en soi ne sont pas mauvaises. Mais cela ne signifie pas pour autant qu'elles soient bonnes ! (Je trouve aussi très amusant que les gens aiment toujours pointer du doigt les exceptions à la règle, au lieu d'observer la pile de cadavres.) Surtout en tenant compte de la dynamique actuelle des marchés prédictifs, cela risque très vite de devenir une roue à hamster impossible à arrêter avant qu'il ne soit trop tard.

Un autre fait que nous devons connaître est que, une proportion assez importante du volume d'échanges est artificielle. Je ne pense pas utile de passer son temps à débattre du pourcentage exact, mais il est évident que ces volumes artificiels donnent l'impression d'une liquidité plus forte, alors qu'en réalité, seuls quelques participants opèrent fréquemment dans le but de réaliser des profits ou de créer un faux sentiment d'activité boursière. Cela signifie que la demande naturelle est en réalité plus faible qu'elle n'y paraît.

« Fixation du prix par le dernier négociateur »

Dans un marché sain et bien fonctionnel, vous devriez pouvoir placer des paris à des cotes proches du marché actuel sans que les variations de prix ne soient trop importantes. Or, ce n’est pas le cas aujourd’hui sur ces plateformes. Même des ordres de taille modérée affectent significativement les cotes, ce qui indique clairement un manque de volume. Ces marchés reflètent souvent uniquement les actions des derniers traders, ce qui constitue précisément le cœur du problème de liquidité que j’ai mentionné précédemment. Cette situation montre que, bien qu’un petit groupe d’utilisateurs actifs entretienne une partie de ces marchés, ceux-ci restent globalement peu fiables et mal liquides.

Mais pourquoi est-ce ainsi ?

La structure de marché basée uniquement sur des transactions binaires ne peut pas rivaliser avec celle des contrats perpétuels. C'est une approche lourde qui fragmente la liquidité, et même si ces équipes tentent de résoudre ce problème par des solutions de contournement, celles-ci restent au mieux maladroites. Dans de nombreux marchés de ce type, on rencontre également une structure étrange comportant une option intitulée « autres », représentant des facteurs inconnus, mais cela introduit le problème de devoir séparer les nouveaux concurrents de cette catégorie pour les intégrer à des marchés indépendants.

La nature binaire signifie également que vous ne pouvez pas offrir un levier réel selon les attentes des utilisateurs, ce qui implique à son tour que vous ne pouvez pas générer un volume de trading aussi valorisant que celui des contrats perpétuels. J'ai vu sur Twitter des gens débattre à ce sujet, mais je reste tout de même choqué qu'ils ne parviennent pas à comprendre que miser 100 dollars sur un événement ayant 1 cent de chance de se produire sur un marché de prédictions est très différent d'ouvrir une position de 100 dollars avec un levier de 100 fois sur un échange de contrats perpétuels.

Le secret peu connu ici est qu'afin de résoudre ce problème fondamental, vous devez redéfinir les protocoles sous-jacents pour permettre la généralisation et traiter les événements dynamiques comme des citoyens de premier ordre. Vous devez créer une expérience similaire à celle des contrats à terme perpétuels, ce qui signifie que vous devez résoudre le risque de saut (jump risk) présent dans les marchés à résultats binaires. Cela est évident pour toute personne utilisant activement les échanges de contrats perpétuels et les marchés prédictifs — et c'est précisément ces utilisateurs que vous devez attirer, sans que les équipes concernées s'en rendent compte.

Résoudre le risque de saut signifie redéfinir le système pour garantir que les prix des actifs évoluent de manière continue, c'est-à-dire qu'ils ne passent pas arbitrairement d'une probabilité de 45 % à 100 %, par exemple. Nous avons déjà vu à quel point ces événements sont fréquemment et ouvertement manipulés par le biais de pratiques de marché non réglementées ou de marchés boursiers, mais c'est un autre sujet que je ne souhaite pas aborder pour l'instant. Arrêtez de commettre des crimes.

Si vous ne résolvez pas cette limitation fondamentale, vous ne pourrez jamais introduire le levier nécessaire pour rendre votre produit attractif pour les utilisateurs (ceux qui apportent une véritable valeur à votre plateforme). Ce levier dépend d'une volatilité continue des prix, permettant de fermer en toute sécurité les positions avant que les pertes ne dépassent la garantie, évitant ainsi des fluctuations soudaines (par exemple, un bond instantané de 45 % à 100 %) qui videraient entièrement un côté de l'ordre. Sans cela, vous ne pourrez pas effectuer de mises en garantie supplémentaires ou de liquidations à temps, et la plateforme finira inévitablement par faire faillite.

Un autre facteur fondamental expliquant pourquoi ces marchés ne fonctionnent pas dans leur structure actuelle est l'absence d'un mécanisme d'hedging natif multi-résultats. D'abord, dans l'état actuel des choses, il n'existe pas de moyen naturel d'hedging, car ces marchés se résolvent sur un choix binaire OUI/NON, et l'« actif sous-jacent » est lui-même le résultat. À l'inverse, si je prends une position longue sur un contrat perpétuel BTC, je peux couvrir mon risque en prenant une position courte sur BTC ailleurs. Cette notion n'existe pas dans la structure actuelle des marchés prédictifs, et c'est pourquoi, si les market-makers doivent supporter directement le risque événementiel, il est extrêmement difficile de fournir une liquidité (ou un levier) conséquente. Cela confirme à nouveau pourquoi je considère comme naïf l'argument selon lequel « les marchés prédictifs sont matures et en phase de croissance rapide ».

Les marchés prédictifs se résolvent finalement (c'est-à-dire qu'ils se ferment effectivement au moment de la résolution), contrairement aux contrats à terme perpétuels, qui restent ouverts. Une conception similaire à celle des contrats perpétuels pourrait modifier les marchés prédictifs en incitant davantage au trading actif, rendant ainsi leur fonctionnement plus fluide et atténuant certains comportements fréquents qui rendent ces marchés peu attrayants (beaucoup de participants se contentent de conserver leurs positions jusqu'à la résolution, plutôt que de trader activement les probabilités). De plus, les résultats des marchés prédictifs sont des événements ponctuels et discrets, tandis que les oracles, bien qu'ils posent aussi des problèmes, fournissent au moins des données régulièrement mises à jour. Cela rend d'ailleurs le problème des oracles dans les marchés prédictifs encore plus critique.

Derrière ces questions de conception se trouve le problème de l'efficacité du capital, mais cela est déjà bien compris actuellement. Personnellement, je pense que générer un rendement stable à partir des fonds déjà déposés ne constitue pas un changement significatif, surtout en considérant que les échanges (exchanges) offriront de toute façon ce type de rendement. Quel est donc le compromis ici ? Si chaque transaction est entièrement payée à l'avance, cela est évidemment bénéfique pour éliminer le risque de contrepoids (counterparty risk) ! Et cela attire aussi une certaine catégorie d'utilisateurs.

Cependant, cela s'avère catastrophique pour un éventail plus large d'utilisateurs que vous pourriez souhaiter attirer. D'un point de vue capital, ce modèle est extrêmement inefficace et entraîne une augmentation significative des coûts d'engagement. Ce problème est particulièrement critique lorsque ces marchés nécessitent différents types d'utilisateurs pour fonctionner à grande échelle, car ces distinctions impliquent une expérience réduite pour chaque groupe d'utilisateurs. Les courtiers en liquidité (market makers) ont besoin de volumes de capital importants pour fournir de la liquidité, tandis que les investisseurs particuliers font face à des coûts d'opportunité élevés.

Il y a certainement davantage de détails à creuser, notamment concernant les approches possibles pour résoudre certains de ces défis fondamentaux. Un système de marge plus complexe et dynamique s'avérera nécessaire, en particulier en tenant compte de facteurs tels que la "proximité de l'événement" (le risque étant le plus élevé lorsque la résolution de l'événement approche et que les cotes se rapprochent de 50/50). Il sera également nécessaire d'introduire des concepts tels que l'atténuation de levier en fonction de la proximité de la résolution, et des niveaux hiérarchisés de liquidation dès les premières étapes pourraient également s'avérer utiles.

Emprunter le modèle de courtage du secteur financier traditionnel pour permettre un apport de garantie immédiat constitue une autre étape dans la bonne direction. Cela libérera des fonds, les rendant ainsi plus efficacement utilisables, et permettra de passer des ordres simultanés à travers les marchés, avec une mise à jour du livre d'ordres après chaque transaction. Il semble logique d'introduire d'abord ces mécanismes sur les marchés scalaires, avant de les étendre aux marchés binaires.

Le point principal est qu'il existe encore beaucoup d'espace de conception inexploré, en partie parce que les gens pensent que les modèles actuels sont déjà la forme finale. Je ne vois tout simplement pas assez de personnes prêtes à reconnaître d'abord l'existence de ces contraintes. Ce n'est peut-être pas surprenant, mais ceux qui s'en rendent compte sont souvent exactement les types d'utilisateurs que ces plateformes devraient chercher à attirer (à savoir les traders de contrats à terme perpétuels).

Mais ce que j'ai observé, c'est que les critiques des marchés de prédictions sont souvent balayées d'un revers de main par leurs partisans, qui nous disent simplement d'aller regarder le volume et la croissance de ces deux plateformes (des chiffres absolument authentiques et organiques, hein ?). J'espère que les marchés de prédictions continueront de se développer, j'espère qu'ils seront acceptés par le grand public, et personnellement, je crois que le fait de pouvoir échanger sur tout est une bonne chose. La plupart de mes frustrations proviennent d'une idée largement répandue selon laquelle la version actuelle est la meilleure possible, or je ne partage pas cette opinion.

«Lien vers l'article original」

Cliquez ici pour en savoir plus sur les postes à pourvoir chez BlockBeats.

Rejoignez la communauté officielle de Lüdòng BlockBeats :

Groupe d'abonnement Telegram :https://t.me/theblockbeats

Groupe de discussion Telegram :https://t.me/BlockBeats_App

Compte officiel Twitter :https://twitter.com/BlockBeatsAsia