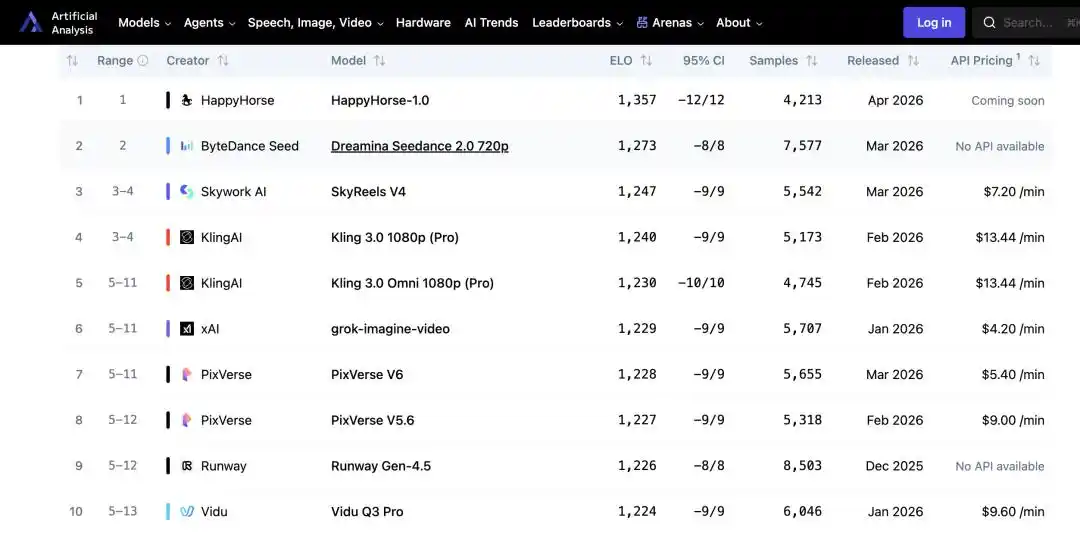

Aucune conférence de presse, aucun blog technique, aucune endorsement d'entreprise — un modèle de conversion texte en vidéo nommé HappyHorse-1.0 a silencieusement atteint la première place du classement AI Video Arena de la plateforme d'évaluation d'IA reconnue Artificial Analysis, dépassant Seedance 2.0 avec un score Elo plus élevé et laissant loin derrière des acteurs majeurs comme KeLing et Tiangong, déclenchant ainsi une « course au décryptage » dans la communauté technique.

Le classement d'Artificial Analysis n'est pas une évaluation basée sur des paramètres techniques, mais un score Elo issu de résultats de tests à l'aveugle réalisés par des utilisateurs réels, reflétant la perception authentique des personnes ordinaires. Ce classement est donc plus difficile à remettre en question que les classiques classements basés sur des benchmarks, et rend la question « Qui a réellement créé cela ? » impossible à ignorer.

« Happy Horse » monte en douceur en tête, déclenchant une course aux énigmes dans le monde de la technologie

Les spéculations sur X ont afflué rapidement. Ce qui a d'abord attiré l'attention, c'est l'ordre des langues sur le site officiel : le mandarin et le cantonais précèdent l'anglais. Pour un produit destiné à un public mondial, cet ordre est inhabituel — si l'équipe était principalement américaine, l'anglais serait presque certainement en première position. Il est presque certain que l'équipe derrière est chinoise.

Le nom lui-même est une piste. L'année 2026 est l'année du Cheval selon le calendrier lunaire ; le nom « HappyHorse » cache un jeu de mots sur l'année du Cheval, pas très subtil, une stratégie déjà utilisée plus tôt cette année avec « Pony Alpha ». La liste des suspects s'allonge rapidement : les fondateurs de Tencent et d'Alibaba portent tous deux le nom de famille « Ma », ce qui les place naturellement sur la liste ; certains parient sur Xiaomi, estimant que Lei Jun, habituellement discret, aime faire des apparitions inattendues ; d'autres pensent qu'il ressemble davantage à DeepSeek, puisque DS avait précédemment lancé discrètement un modèle visuel, avant de le retirer discrètement. Les spéculations pullulent, mais aucune ne repose sur des preuves concrètes.

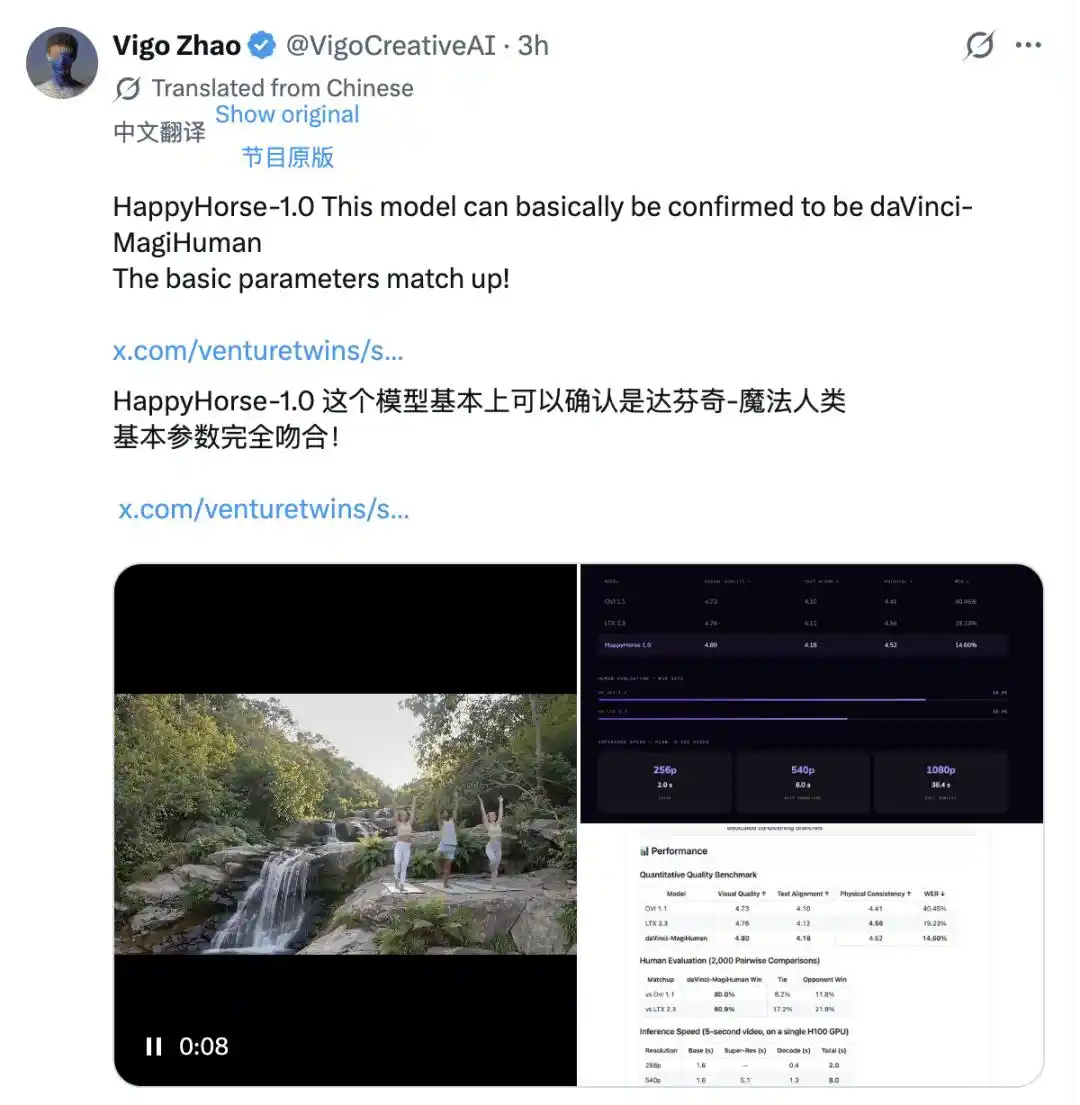

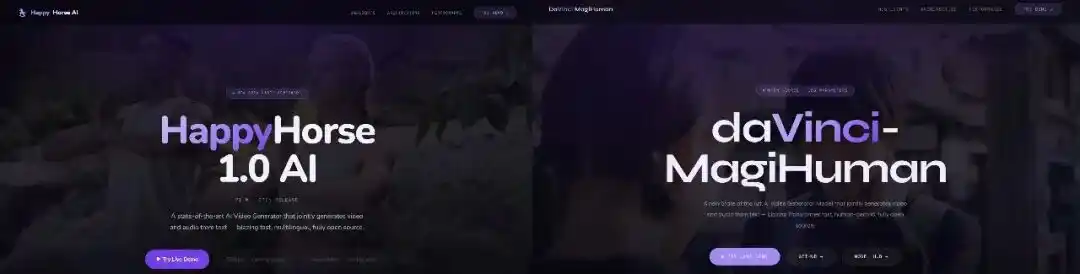

Ce qui identifie réellement la cible, c’est une comparaison point par point au niveau technique. L’utilisateur X Vigo Zhao a comparé les données de référence publiques de HappyHorse-1.0 avec des modèles connus, et a trouvé un objet fortement correspondant : daVinci-MagiHuman, le modèle open source « Da Vinci Magic Human » publié sur GitHub en mars.

Qualité visuelle 4,80, alignement du texte 4,18, cohérence physique 4,52, taux d'erreurs phonétiques 14,60 % — les deux jeux de données correspondent point par point. La structure du site officiel est également presque identique : le style de présentation de la description de l'architecture, du tableau de performances et de la vidéo de démonstration semble provenir du même modèle. Les deux utilisent une architecture Transformer à flux unique, génèrent conjointement audio et vidéo, et prennent en charge la même liste de langues. Ce niveau de recoupement est difficile à expliquer par la coïncidence.

La conclusion actuellement la plus reconnue dans le milieu technique est que HappyHorse est une version itérée optimisée par Sand.ai, l'un des partenaires de développement conjoint de daVinci-MagiHuman, visant à tester les limites de performance du modèle sous les préférences réelles des utilisateurs, afin de préparer le terrain à une mise en œuvre commerciale ultérieure.

daVinci-MagiHuman sera open source le 23 mars 2026, résultat d'une collaboration entre deux équipes jeunes. L'une provient du laboratoire de recherche en intelligence artificielle générative (GAIR) de l'Institut de création et d'intelligence de Shanghai (SII), dirigé par l'universitaire Liu Pengfei ; l'autre est Sand.ai (San Dai Technology) de Pékin, fondée par Cao Yue, qui possède également un profil académique, avec une orientation vers les modèles mondiaux autorégressifs.

Le modèle utilise un Transformer unidirectionnel à attention pure de 15 milliards de paramètres, intégrant ensemble dans une même séquence les tokens provenant du texte, de la vidéo et de l'audio pour une modélisation conjointe — personne dans la communauté open source n'avait jusqu'à présent effectué une pré-formation conjointe réelle sur l'audio et la vidéo à partir de zéro ; la plupart des approches se contentent d'assembler des modèles unimodaux.

Comment un modèle vidéo open source a-t-il réussi à se redresser en deux semaines ?

Une fois l'identité établie, une autre question devient encore plus difficile à répondre : comment HappyHorse-1.0 a-t-il pu obtenir en seulement deux semaines un score Elo supérieur à celui de Seedance 2.0, alors que daVinci-MagiHuman n'a été ouvert que fin mars ?

Selon les informations divulguées sur le site officiel, HappyHorse n'a pas modifié l'architecture sous-jacente ; la supposition la plus raisonnable est qu'elle a effectué des ajustements spécifiques pour les scénarios d'évaluation dans sa stratégie de génération par défaut.

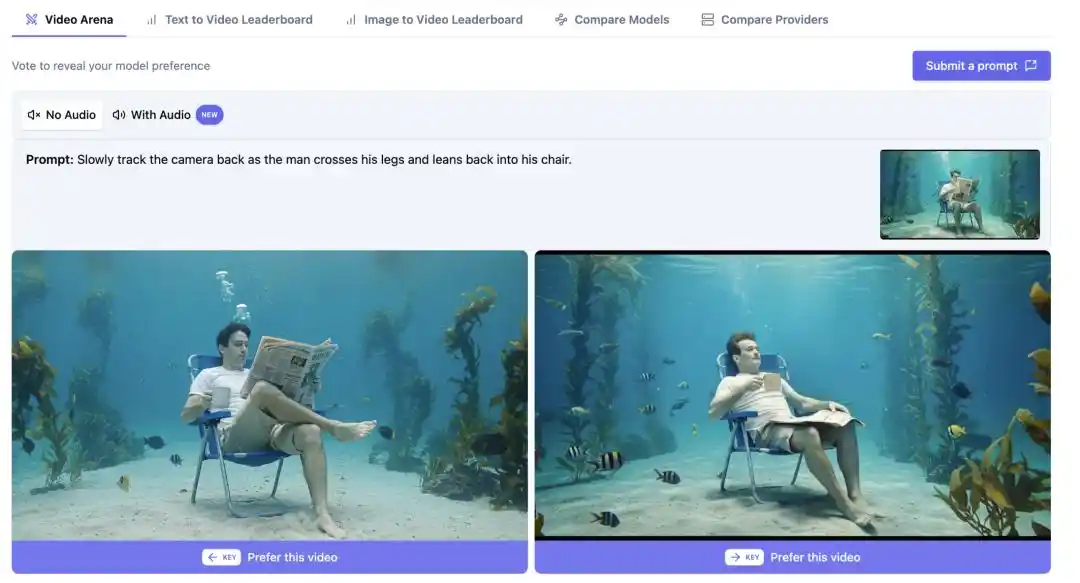

Le système Elo est essentiellement une accumulation des préférences des utilisateurs ; sur des critères perceptifs sensibles comme la stabilité des expressions faciales, la synchronisation audio-visuelle ou l'agrément visuel, une légère amélioration suffit à augmenter les chances d'être sélectionné en test aveugle. La capacité maximale du modèle n'a pas changé, mais sa « performance en évaluation » peut être affinée.

En réalité, dans les échantillons d'essais aveugles d'Artificial Analysis, les contenus générant des portraits et des discours oraux représentent plus de 60 %. DaVinci-MagiHuman se concentre dès la phase d'entraînement sur la représentation de portraits, ce qui lui confère naturellement un avantage dans ces scénarios, expliquant ainsi la principale raison de sa supériorité en termes de taux de victoire aux essais aveugles ; si les échantillons d'essais aveugles sont principalement composés de gros plans sur des portraits, les modèles spécialisés dans les portraits bénéficieront systématiquement d'un avantage, ce qui n'a aucun lien direct avec leur performance réelle dans des scénarios complexes impliquant plusieurs personnages, des plans cinématographiques élaborés ou des récits sur de longues durées.

Il en résulte un écart marqué entre les chiffres du classement et l'expérience réelle, et les discussants sur X se sont divisés en deux camps. Les sceptiques, après tests, estiment que HappyHorse-1.0 et Seedance 2.0 présentent encore des différences visibles en matière de détails des personnages et de fluidité des mouvements, ce qui les amène à remettre en question la représentativité du score Elo.

Les partisans, quant à eux, placent de grandes espérances dans le potentiel de HappyHorse, en espérant qu'il puisse résoudre le problème industriel de la cohérence de la qualité d'image dans les séquences multi-caméras, un défi que les modèles vidéo dominants n'ont pas encore réussi à surmonter. Si daVinci-MagiHuman parvient réellement à faire une avancée dans ce domaine, cela pourrait être bien plus important qu'une simple position dans un classement.

Les limites du modèle lui-même ne devraient pas être masquées par les chiffres. Le blogueur sur Xiaohongshu @JACK's AI Vision a déployé et testé en temps réel daVinci-MagiHuman. Il a constaté qu'il nécessite un H100, et que les cartes graphiques grand public n'ont pratiquement aucune chance de le faire fonctionner. Bien que la communauté étudie des solutions de quantification, il reste difficile pour les utilisateurs particuliers de le déployer localement à court terme.

Sur le plan pratique, il excelle actuellement uniquement dans les scènes à une seule personne ; dès qu'il y a plusieurs personnages ou que la scène devient plus complexe, la qualité diminue — ce n'est pas un problème résolvable par ajustement des paramètres, mais directement lié à son orientation conceptionnelle axée sur les portraits. La durée de génération est généralement d'environ 10 secondes ; au-delà, le résultat devient instable, et une sortie en haute définition nécessite encore un plugin de sur-résolution.

La conclusion tirée par l'IA de @JACK est que daVinci-MagiHuman est moins convivial que LTX 2.3 et qu'il faut attendre que la communauté améliore la quantification avant de l'utiliser au quotidien.

Le secteur de la génération vidéo attend-il enfin son véritable « poisson-chat » ?

Bien sûr, être en tête d'un classement ne dit pas grand-chose. Ensuite, HappyHorse doit faire l'objet d'une évaluation plus approfondie en matière de stabilité, de vitesse sous charge élevée, de cohérence entre scénarios, de précision du contrôle des rôles, ainsi que de capacité de généralisation au-delà des jeux de tests. Ce sont là les indicateurs essentiels pour déterminer si un modèle peut véritablement intégrer le flux de travail des créateurs.

Mais si l'on considère le cadre plus large de l'industrie, le signal transmis par cet événement est déjà suffisamment clair.

Les modèles vidéo open source ne sont pas en soi une nouveauté. Mais ce qui a toujours séparé l'open source de la fermeture, c'est un écart visible en termes de qualité — dans les scénarios nécessitant une livraison aux clients, la qualité de génération des modèles open source n'a pas pu franchir durablement la barrière entre « utilisable » et « livrable ». Le pouvoir de fixation des prix de produits fermés comme Keling et Seedance repose en grande partie sur cet écart.

L'importance de cette fois réside dans le fait qu'un produit basé sur un modèle open source a, pour la première fois, rivalisé directement avec les principaux concurrents propriétaires actuels sur un classement en tests aveugles basés sur la perception réelle des utilisateurs. Quel que soit le degré d'optimisation spécifique au scénario d'évaluation, cela constitue au moins un signal sérieux à prendre en compte pour les fabricants propriétaires qui construisent leur pouvoir de fixation des prix sur cet écart.

Pour les développeurs, ce point de bascule a une signification plus concrète. Dans des scénarios verticaux tels que les portraits, les avatars numériques et les streamers virtuels, dès que la qualité de génération des bases ouvertes atteint le seuil « livrable », la structure des coûts de déploiement autonome change fondamentalement — il ne s'agit pas seulement de réduire les coûts d'appel à l'API, mais surtout de prendre entièrement en main les données, les modèles et la chaîne d'inférence, obtenant ainsi une flexibilité inaccessibile aux solutions propriétaires en matière de personnalisation approfondie et de conformité à la vie privée.

HappyHorse-1.0 ne remettra pas en question la position de marché de Seedance 2.0 ou de Ke Ling à court terme, mais dès que la reconnaissance sera établie que les modèles open source peuvent rivaliser avec les modèles propriétaires, les optimisations quantitatives, les micro-adaptations verticales et l'accélération de l'inférence seront poursuivies par la communauté à un rythme bien plus rapide que celui des produits propriétaires.

Cette année du Cheval, ce qui mérite vraiment notre attention, ce n'est peut-être pas quel cheval court le plus vite, mais le fait que la piste elle-même s'élargit.

Cet article provient du compte officiel WeChat « AI Value Officer », auteur : Xingye, éditeur : Meiqi