Ces trente jours fous, onze grands modèles, c’était comme un feu d’artifice bruyant.

Auteur et source de l'article : 0x9999in1, ME News

TL;DR

- Trente jours de compétition extrême : du 26 mars au 24 avril, 11 grands modèles majeurs ont été lancés mondialement, soit un toutes les 2,7 jours en moyenne. Le marché fait face à une « fatigue des paramètres » sévère.

- La « chirurgie de perte de poids » du Paramètre Gourmand : V4-Pro possède un total de 1,6 T de paramètres, mais seul 49 B sont activés. Grâce à l'architecture CSA+HCA révisée, les FLOPs sont réduits à 27 % avec un contexte de 1 M, et le cache KV est abaissé à un niveau extrêmement impressionnant de 10 %.

- La séparation des générations de l'alchimie : première approche de post-entraînement « renforcement indépendant d'abord, puis distillation en ligne combinée », V4-Pro-Max approche les limites des modèles propriétaires en matière d'inférence et de tâches Agent.

- Votes cast in real money: GPT-5.5 only drove NVIDIA's single-day rise of 4.2% before peaking, while V4, fully open-sourced by MIT, has completely ignited sustained surges in the local computing power chains of China and Hong Kong.

- Logique de jeu profond : les modèles propriétaires vendent des « taxes », les grands modèles open source vendent du « fer ». L'apparition de V4 a enfin équilibré le livre de calcul pour le déploiement privé d'entreprise à l'échelle mondiale.

Avril de folie des dieux, face à la fatigue esthétique du marché

Fou. Tous fous.

Si vous êtes un observateur attentif au secteur de l'IA, les trente derniers jours ont probablement provoqué chez vous un malaise physiologique. Entre le 26 mars 2026 et le 24 avril, en moins d'un mois, au moins onze grands modèles ayant une influence significative ont été lancés sur le marché mondial.

La liste ressemble à un menu : Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

De plus, enregistré discrètement à minuit le 23 avril, comme une bombe sous-marine : DeepSeek V4.

En moyenne, un nouveau modèle est publié tous les 2,7 jours. C’est une vitesse à laquelle les gestionnaires de fonds n’ont même pas le temps de lire les communiqués. Les investisseurs viennent à peine d’entendre le « dépassement de paramètres » de la société A que le « score écrasant » de la société B leur est déjà déposé sur le bureau. Le marché est en réalité devenu insensible. Ce qu’on appelle le « classement des benchmarks » ressemble de plus en plus, dans un contexte de concurrence acharnée, à un jeu numérique autoreferentiel.

Mais l'argent est intelligent. Ou bien, les bougies ne mentent jamais.

En examinant les bougies des actifs IA en Chine, aux États-Unis et à Hong Kong sur les 30 derniers jours, vous découvrirez une réalité extrêmement impitoyable : dans cette « guerre des dieux », seuls deux points laissent une trace durable sur le graphique.

Le premier, c'est le 8 avril, OpenAI de l'autre côté de l'océan a lancé GPT-5.5. Ce roi indiscuté a directement poussé NVIDIA à bondir de 4,2 % en une seule journée. Ensuite ? Rien d'autre, le sommet a été atteint en une journée, les bons résultats ont été entièrement intégrés. Tout le monde a réalisé que même le plus grand roi du code fermé peine désormais à déplacer aussi facilement la lourde montagne du capital mondial comme il l'avait fait il y a deux ans.

Deuxième nœud : du 23 au 24 avril. Version préliminaire de DeepSeek V4 publiée. Pas de lancement spectaculaire, pas de vidéo promotionnelle époustouflante. Les poids sont directement hébergés sur Hugging Face et ModelScope, sous licence MIT.

Résultat ? Il a poussé la chaîne de puissance de calcul de la Chine et de Hong Kong à sortir d'une série de sauts à la hausse.

Pourquoi ? Pourquoi un modèle open source a-t-il réussi ce que de nombreux grands acteurs propriétaires n'ont pas pu accomplir ?

Pour répondre à cette question, nous devons adopter le ton d’un conteur, mettre de côté les communiqués de presse ennuyeux, ouvrir le capot de DeepSeek V4 et voir quel monstre se cache à l’intérieur.

Analyse V4 : Ne plus croire en l'esthétique de la force des paramètres

Les grands modèles. Très coûteux. Tout le monde le sait.

Au cours de la dernière année, les fabricants de grands modèles ont été frappés par une « peur du manque de puissance ». Vous en faites un billion, je fais deux billions. Tout le monde pensait que plus la puissance était grande, plus les intelligences émergentes pourraient résoudre tous les problèmes. Mais cela a entraîné des coûts de calcul extrêmement effrayants. Même les réserves du propriétaire terrien ne suffisent plus.

DeepSeek V4 lance cette fois deux modèles MoE (Mélange d'experts) : V4-Pro et V4-Flash. Commençons par quelques données clés.

V4-Pro : 1,6 T (1,6 billion) de paramètres totaux, mais seulement 49 G (49 milliards) de paramètres activés par token.

V4-Flash : paramètres totaux 284B (284 milliards), paramètres activés uniquement 13B (13 milliards).

Compris ? C’est une approche extrêmement retenue, mais efficace : une petite force déplace une grande masse. L’essence de l’architecture MoE réside dans le fait de ne pas déclencher toutes les alertes à chaque fois. Pour une tâche simple, mobilisez quelques experts spécialisés ; pour une mission complexe, faites appel à la lame du dragon. La base de 1,6 trillion garantit qu’elle « a vu du monde et possède une connaissance approfondie » ; les 490 milliards activés assurent qu’elle « réagit rapidement et agit avec agilité ».

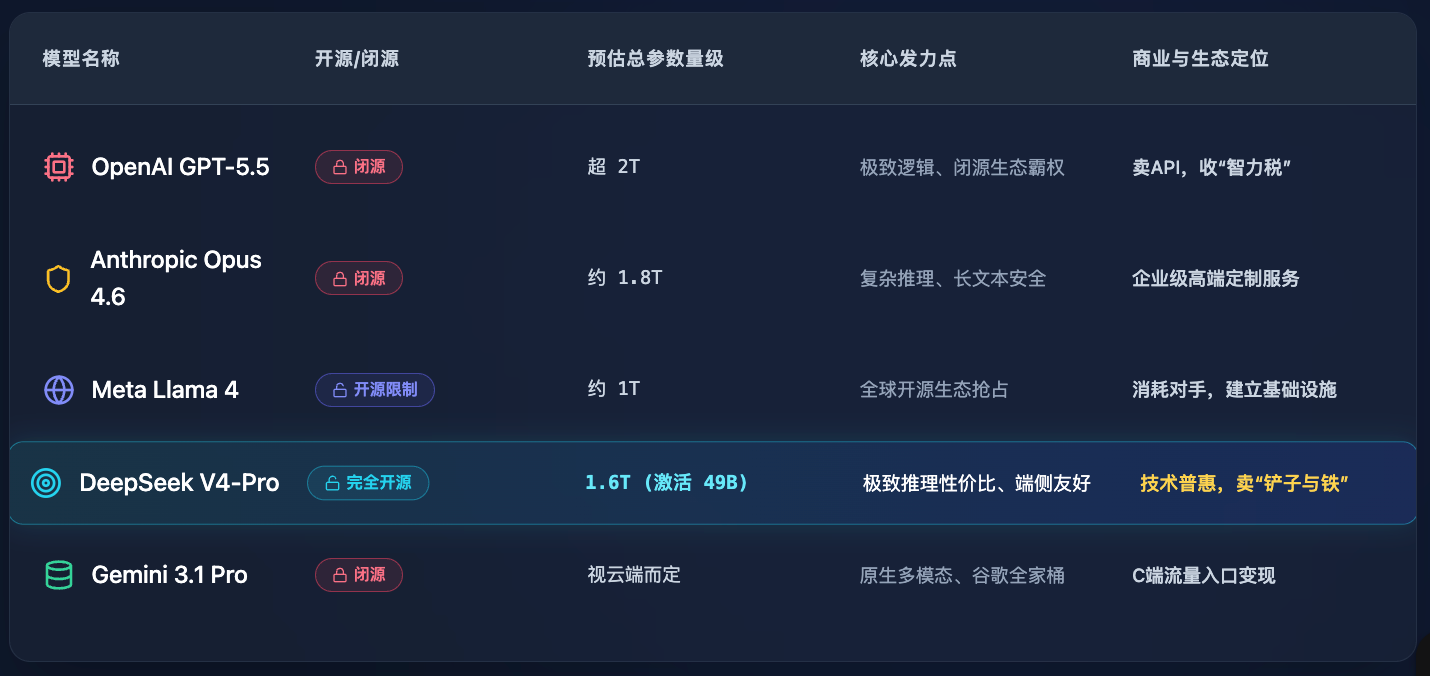

Pour mieux comprendre visuellement cet écart, nous dressons un tableau comparant les principales approches du marché actuel (les données sont des estimations et calculs publics du marché) :

En consultant le tableau, on constate que V4-Pro ne cherche pas systématiquement à surpasser GPT-5.5 en termes de paramètres totaux, mais qu'il concentre tous ses efforts sur la question de « comment faire en sorte que cette géante consomme moins et soit plus rapide ».

Mais ce n’est pas suffisant. Ce qui a fait retenir leur souffle aux experts, c’est son élimination implacable des « tueurs de VRAM ».

La fin du membre de la clique de la mémoire vidéo : trois lames de rasoir architecturales

Qu'est-ce qu'un "刺客 de mémoire vidéo" ? C'est le "long contexte".

Maintenant, chacun se vante de supporter 1M (un million) de tokens en contexte. Ça a l'air génial : tu y mets tout « Les Trois Royaumes » et il le lit en quelques secondes. Mais quel est le prix ? Lors de l'inférence, les longs textes génèrent un cache KV énorme (l'utilisation de la mémoire vidéo pour stocker les informations historiques). C'est comme si, à chaque page que tu lisais, tu devais recopier sur un grand tableau noir le contenu de la page précédente et le tenir devant toi. Quand tu arrives au millionième mot, tu as tellement de tableaux noirs qu'ils ne tiennent plus dans les datacenters de Zhongguancun.

La mémoire est plus chère que la puissance de calcul. C'est une règle implicite de l'industrie de l'IA.

Comment DeepSeek V4 résout-il ce problème ? Ils ont directement effectué une « chirurgie » sur le mécanisme d'attention de base. Voici leur première et plus radicale lame de mise à niveau architecturale : le mécanisme d'attention hybride (CSA + HCA).

CSA (Compressed Sparse Attention) associé à HCA (Heavy Compressed Attention) semble du jargon, mais en termes simples : il ne mémorise plus par cœur, il apprend à "souligner les points essentiels" et à "prendre des notes minimalistes".

L'effet est extrêmement puissant : avec un contexte de 1M, les FLOPs (opérations en virgule flottante) par token pour l'inférence de V4-Pro ne représentent que 27 % de ceux de la génération précédente V3.2 ! Encore plus impressionnant, le cache KV n'est que de 10 % de celui de V3.2 !

Quel est ce concept ? Un traitement de texte de un million de caractères qui nécessitait auparavant 10 serveurs haut de gamme pour être exécuté à pleine capacité est désormais réalisé en toute simplicité par un seul serveur. Le coût de calcul est directement divisé par dix. Il s'agit d'une optimisation révolutionnaire.

Il reste deux couteaux.

Le deuxième outil s'appelle « manifold-constrained hyperconnection (mHC) ». Dans les grands modèles précédents, la transmission d'information entre les couches utilisait des « connexions résiduelles traditionnelles », comme des tuyaux en fer rouillés et vétustes pour acheminer de l'eau : sous une pression élevée, ils fuient facilement. Face à des données d'entraînement préliminaire massives de 32T tokens, ces anciens tuyaux ne supportent plus la charge. mHC revient à remplacer ces tuyaux par un réseau à fibre optique, renforçant la stabilité de la propagation des signaux entre les couches. Pas de perte de paquets, pas de dérive.

Troisième couteau : changer l’huile du moteur. Abandonnez les méthodes traditionnelles et adoptez l’optimiseur Muon. Celui-ci accélère la convergence. Alors que les autres nécessitent sept fois sept jours pour cuire un lot de pilules, il pourrait les sortir du chaudron en vingt jours. Le temps, c’est de l’argent ; le temps de calcul, c’est de l’argent.

Ces trois coups de couteau ont complètement guéri les grands modèles de leur « maladie de la richesse ».

Le secret du four à élixir : De la fragmentation à l'unité de toutes les méthodes

Dans le domaine des grands modèles, tout le monde sait que la pré-formation transforme simplement un « analphabète » en un « individu qui connaît beaucoup de choses mais ne sait pas parler ». Ce qui le transforme véritablement en un maître absolu, c’est la post-formation (Post-training).

DeepSeek V4 a appliqué une stratégie extrêmement rigoureuse en deux phases lors de son post-entraînement.

Par le passé, les gens entraînaient les MoE comme une équipe d'enseignants entourant un seul élève, ce qui conduisait facilement à des conflits. Comment V4 procède-t-il ?

Phase 1: "Fighting alone." It uses SFT (supervised fine-tuning) and GRPO (group relative policy optimization) reinforcement learning to separate and individually train each "expert network" within the model. The expert in coding practices coding every day, while the expert in mathematics tackles math problems daily. Completely unrelated, no interference. This is called pushing individual capabilities to the extreme.

Phase 2 : « Toutes les méthodes reviennent à l'unité ». À l'aide de la technique de distillation en ligne, fusionner ces experts déjà maîtres de techniques suprêmes en un seul modèle cohérent et harmonieux. Pas de gaspillage interne, pas de ralentissements.

Voyons les deux « coups de maître » qu'ils ont forcé.

Premièrement, le mode V4-Pro-Max. Il s'agit du mode de puissance d'inférence la plus élevée. C'est comme déverrouiller une serrure génétique. Selon eux (et cela a rapidement été vérifié par la communauté), sur les tests de performance en codage, V4-Pro a déjà atteint un niveau de pointe, et l'écart avec les modèles propriétaires les plus avancés (comme GPT-5.5, Opus 4.6) se réduit considérablement sur les tâches complexes d'inférence et d'Agent.

Deuxièmement, V4-Flash-Max. C’est plus intéressant. C’est un petit modèle de seulement 284B, mais après avoir reçu un budget de réflexion suffisant, ses performances d’inférence atteignent presque celles du Pro. Que cela signifie-t-il ? Cela signifie que la « qualité de l’algorithme » commence à surpasser la « quantité de paramètres ». Pourvu qu’on lui accorde suffisamment de temps pour réfléchir, un petit cerveau peut résoudre de grands problèmes. Bien sûr, en ce qui concerne le stockage pur de connaissances et les tâches Agent extrêmement complexes à plusieurs étapes, il reste limité par sa taille de paramètres (après tout, son estomac n’est pas très grand), mais cela reste largement suffisant pour la plupart des applications quotidiennes d’entreprise.

Enfin, le stockage des poids utilise de manière extrêmement intelligente le stockage en précision mixte FP4+FP8, préservant la précision tout en économisant de la mémoire GPU. Tout transpire une séduction de type étudiant en sciences rigoureusement calculée.

Pour comparer plus clairement les gains d'efficacité technique apportés par ce post-entraînement, voici un tableau comparatif des indicateurs techniques :

L'odorat du capital : pourquoi V4 a enflammé la chaîne de puissance de calcul en Chine et à Hong Kong ?

En arrivant ici, l'analyse technique est presque terminée. Mais nous n'avons pas encore répondu à la question fondamentale posée au début :

Pourquoi GPT-5.5 n'a pas permis à la section de la puissance de calcul de continuer à s'enthousiasmer, tandis que DeepSeek V4 l'a fait ?

Cela exige que nous sortions du code et que nous envisagions ce jeu sous l'angle du capital et des affaires.

GPT-5.5 est puissant, invincible. Mais il est propriétaire. Que signifie propriétaire ? Cela signifie qu'OpenAI est un énorme « trou noir ». Si vous voulez utiliser ses capacités, vous devez acheter son API. C'est un modèle de « taxation ». Les bénéfices affluent vers la Silicon Valley, et la demande en puissance de calcul se concentre sur les centres de données cloud de Microsoft. Pour les fabricants d'équipements mondiaux, les centres de calcul locaux et les agents serveurs de chaque pays, il ne reste que de l'admiration, sans part du gâteau. Même si GPT-5.5 est aussi puissant, ce n'est qu'une fête pour les autres. NVIDIA augmente parce que tout le monde pense qu'OpenAI va acheter encore plus de cartes.

Mais DeepSeek V4 est différent.

C'est open source. Et sous une licence MIT extrêmement permissive. La licence MIT est le don le plus généreux du monde open source, ce qui signifie que les entreprises commerciales peuvent l'utiliser, la modifier et la vendre gratuitement, sans craindre de risques juridiques.

Ce qui est encore plus critique, c'est que nous avons consacré de nombreuses pages à démontrer que V4 a réduit les coûts d'inférence du modèle et l'occupation de la mémoire GPU jusqu'à la cheville.

En combinant ces deux points, vous arrivez à une conclusion qui fait frémir les marchés financiers : le point critique de déploiement privé est enfin atteint.

Par le passé, les entreprises souhaitant déployer elles-mêmes un modèle de plus de 1 To consultaient la liste des prix matériels, fermaient silencieusement le document et se tournaient vers l'achat d'API. Aujourd'hui, V4 annonce : vous n'avez besoin que de très peu de machines pour faire tourner localement un super-cerveau aussi proche que possible de GPT-4, voire capable de défier GPT-5.5. Vos données ne quittent pas votre province, ni votre pays — une sécurité absolue.

Puisque tout le monde peut maintenant l'exécuter localement, qu'est-ce qui va se passer ensuite ?

Achetez des machines ! Achetez des serveurs ! Achetez des modules optiques ! Construisez un centre de calcul intelligent !

Les grandes entreprises à code fermé vendent une taxe sur l’intelligence, tandis que les grandes entreprises à code ouvert vendent en réalité des produits aux fabricants d’équipements de toute l’industrie. DeepSeek V4 est celui qui a jeté la étincelle. Plus il est facile à utiliser et plus il est ouvert, plus la demande locale en puissance de calcul à Hong Kong, à Taïwan et ailleurs explose. Les entreprises qui assemblent des serveurs, qui développent le refroidissement liquide ou qui gèrent les centres de données voient enfin l’argent réel de son déploiement à grande échelle.

C’est pourquoi la chaîne de calcul de Chine continentale et de Hong Kong a connu une hausse continue dès le lancement de la V4 le 23 avril. Le capital ne paie pas pour des émotions, il se positionne en avance sur la prochaine « vague de déploiement privé dans des milliers d’industries ».

Cela, c'est le stratagème commercial fondamental.

Conclusion : La marée basse et les récifs

Ces trente jours fous, onze grands modèles, c’était comme un feu d’artifice bruyant.

Les géants s'agitent sur l'arène des paramètres, brandissant des océans de capital dans l'espoir d'écraser leurs concurrents avec la puissance de calcul. Mais après le vacarme, ce sont souvent ceux qui ne sont pas les plus bruyants qui restent pour transformer le paysage de l'industrie.

L'apparition de DeepSeek V4 ressemble à celle d'un assassin calme. Il ne se bat pas pour savoir qui dépense le plus d'argent ; il frappe uniquement au point le plus vulnérable : éliminer la mémoire vidéo inutile, abaisser les barrières de déploiement et transformer les compétitions haut de gamme en jeux accessibles à tous.

Dans cette guerre des IA appelée « Ragnarök », l'ère de l'accumulation aveugle de paramètres touche à sa fin. Le champ de bataille futur appartiendra à ceux qui trouveront l'équilibre parfait entre « performance extrême » et « efficacité ingénierie ».

Les vagues de la mode finissent toujours par se retirer ; une fois la marée basse, on voit qui nage à nu et qui est ce rocher inébranlable.

V4 a déjà distribué les armes à tout le monde. Maintenant, il ne reste plus qu'à voir comment les seigneurs féodaux établiront leurs camps sur cette nouvelle terre.

Une fois que vous avez compris cette couche, en écoutant ces annonces bruyantes qui prétendent être « révolutionnaires » ou « redéfinir tout », vous pourrez peut-être faire preuve de plus de sérénité et de moins d'anxiété.

After all, no matter how dazzling the magic, it ultimately comes down to the ledger, balancing out those few coins.

Source :

- Prévisualisation de la série DeepSeek V4, sortie officielle, DeepSeek Team, GitHub/ModelScope/HuggingFace. (2026).

- Le rallye de l'IA d'avril : Analyse du cycle de 30 jours des grands modèles, ME News Market Observer. (2026).

- Lois d'échelle et le changement de paradigme après l'entraînement, Journal of Artificial Intelligence Economics. (2026).

- Rapport de veille du marché de la chaîne d'approvisionnement en calcul global (avril 2026), Pan-Asia Financial Data Analytics. (2026).