1 900 fichiers, 512 000 lignes de code, une erreur de configuration du fichier .map, et tout ce que personne n'a remarqué

Auteur de l'article : Jia Yan Kea

Source : Silicon Valley Alan Walker

7:02 du matin, Mission District, près de la fenêtre de Zombie Coffee

C'est un matin étrange aujourd'hui. Le tweet de Chaofan Shou a déjà été vu 3,1 million de fois, et tous les groupes sont en ébullition.

Après avoir avalé sa deuxième bière, Alan Walker de la Silicon Valley a téléchargé 1 900 fichiers et a commencé à les lire sérieusement.

Après avoir lu, Alan a discuté avec plusieurs personnes — Kai (ex-Google, maintenant dans la création d'entreprises en infra), Marcus (background en PE, récemment en train d'examiner des deals IA) et Sarah (ancienne ingénieure chez Anthropic, maintenant indépendante). Voici ce qui a émergé aujourd'hui.

硅谷 Alan Walker pense que la plupart des gens analysent sous un angle trop superficiel. Voici mes notes et mon synthèse.

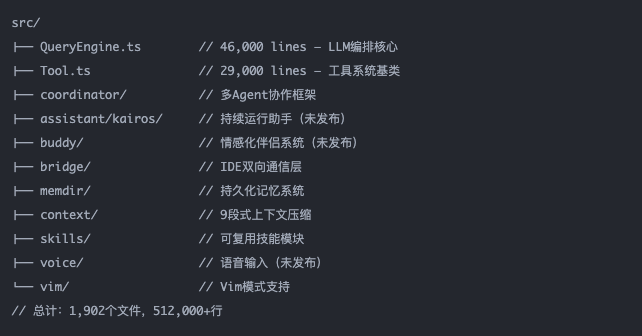

01 Secret n°1 : Le modèle n'est qu'une matière première, c'est le harness qui constitue le fossé compétitif — et ce chiffre est de 46 000 lignes

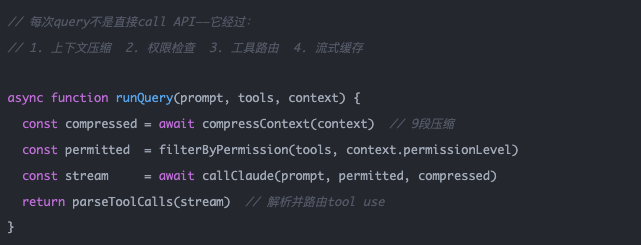

La première chose que la plupart des gens ont dite en voyant cette fuite est : « Wow, Claude Code est vraiment complexe. » C’est faux ; il faut l’inverser : Claude Code est efficace non pas parce qu’il appelle un Claude plus intelligent, mais parce qu’il repose sur un moteur de requêtes de 46 000 lignes de code en dehors du modèle.

Alan : Kai, tu as vu QueryEngine.ts ? Juste ce fichier, 46 K lignes. Ce n'est pas un « wrapper AI », c'est un système d'exploitation.

Kai : Je l'ai vu. Ce qui est plus intéressant, c'est qu'ils utilisent Bun au lieu de Node — une considération sur le temps de démarrage. Cela montre qu'ils ont sérieusement testé les performances de démarrage à froid. Ce n'est pas quelque chose d'écrit à la hâte.

Du point de vue des principes fondamentaux : la capacité du modèle constitue la limite supérieure, tandis que l’exploitation détermine la proportion de cette limite que vous pouvez atteindre.

Un appel API brut utilisant 20 % des capacités du modèle.

Ce système de harness — gestion du contexte, routage des outils, hiérarchie des autorisations — vous permet d'atteindre près de 80 %. Ce écart de 40 %, c'est ce que 46 000 lignes de code ont permis d'obtenir.

Le prochain tueur de ChatGPT ne viendra pas nécessairement d'une équipe ayant créé un meilleur modèle, mais peut-être d'une équipe ayant créé un meilleur système d'exploitation.

02 Secret 2 : L'intention réelle du système d'autorisations — ce n'est pas d'empêcher l'IA d'agir, c'est de lui permettre d'agir

Tout le monde, en voyant le système de permissions à quatre niveaux, pense immédiatement à « mesures de sécurité ». Cette compréhension est exactement à l’opposé de la réalité.

Alan : Sarah, tu as travaillé chez Anthropic, ce système de permissions a-t-il vraiment été conçu pour la « sécurité » ?

Sarah : Pas tout à fait. Plus précisément, il s'agit de permettre au modèle d'oser exécuter. Sans frontières claires, l'agent hésite à chaque étape : « Puis-je faire cela ? ». Avec des frontières, il agit directement à l'intérieur et s'arrête pour demander à l'extérieur.

Faites attention à ce détail :

Les commandes dangereuses ne sont pas bloquées par une liste de règles, mais par une deuxième IA effectuant une analyse sémantique.

Cela signifie qu'Anthropic sait que la liste de règles comportera des failles, donc elle utilise une IA pour surveiller une IA — c'est un système de défense, pas une règle de défense.

Comparé à toute organisation : des limites d'autorisation claires ne dissuadent pas les gens d'agir, elles les encouragent à prendre des décisions rapides à l'intérieur de ces limites.

L'autorisation floue paralyse.

03 Secret 3 : Le système de mémoire — ne retenez que vos préférences, pas les codes ; c'est une soustraction réfléchie

Alan : Avez-vous consulté le répertoire memdir/ ? Il contient beaucoup moins de données dans son système de mémoire que je ne le pensais.

Kai : Oui, il ne mémorise pas le code ni l'historique des conversations, uniquement les préférences utilisateur et les contraintes du projet. Au premier regard, cela semblait être de la paresse, mais en y réfléchissant, c'est la bonne approche.

La fenêtre de contexte est une ressource limitée, environ 200K tokens.

Un contexte rempli de code historique, comme un ingénieur dont l'esprit est saturé des détails du projet précédent — la tâche d'aujourd'hui n'y trouve tout simplement pas sa place.

La solution d'Anthropic consiste à ne stocker en mémoire à long terme que « comment travailler avec moi », et à récupérer à chaque fois le contenu spécifique.

Le prochain champ de bataille des produits d'IA n'est pas qui a la meilleure mémoire, mais qui a la mémoire la plus précise — se souvenir des bonnes choses, oublier ce qu'il ne faut pas retenir.

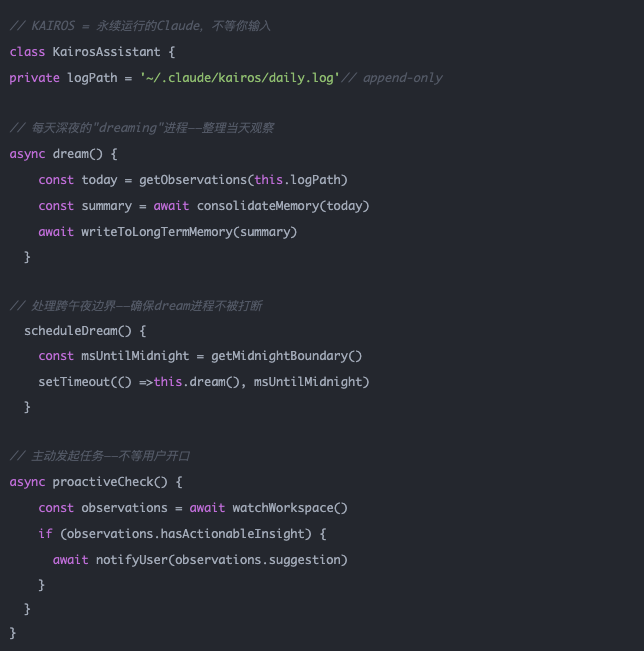

04 Secret 4 : KAIROS — Ce qu'Anthropic vend réellement, ce n'est pas un outil, mais un employé numérique qui ne prend jamais de pause

Alan : Marcus, en tant qu'investisseur, quel est ton ressenti face à cette fonctionnalité de KAIROS ?

Marcus : Ce que je vois, c'est un modèle économique complètement différent. Vous ne payez pas un abonnement SaaS, vous payez le salaire d'un prestataire qui travaille 24 heures sur 24. Cela change toute la logique de tarification.

La gestion de la limite de minuit est cruciale — quelqu’un a-t-il sérieusement envisagé « ce qui se passe si le processus dreaming commence à 23:58 et traverse minuit » ?

Cela indique que KAIROS n'est pas une preuve de concept, mais une fonctionnalité conçue et prête à être mise en ligne.

Le modèle économique du SaaS évoluera vers l'« augmentation d'équipe par l'IA ». Vous embauchez un employé numérique qui ne prend jamais de congé et dont le coût marginal tend vers zéro.

Ce n'est pas un prix outil, c'est un prix ressources humaines.

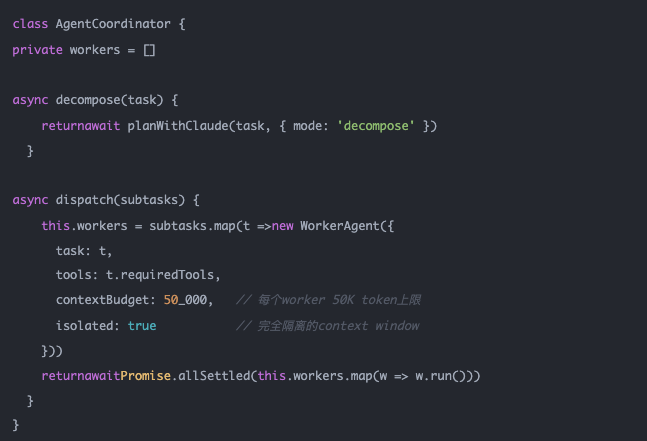

05 Secret cinq : Le cadre multi-agent — Les entreprises d'IA reproduisent l'organigramme des entreprises humaines

Kai : Avez-vous regardé la structure des dossiers ? coordinator/, tasks/, skills/, services/ —— c’est exactement comme le tableau organisationnel d’une startup.

Alan : Oui. Et dans le mode Coordinator, un Claude peut générer plusieurs agents ouvriers — c’est un modèle où un gestionnaire supervise un groupe d’IC.

La limite d'un seul AI est la taille de la fenêtre de contexte (200 000 jetons).

La seule façon de dépasser cette limite est de faire collaborer plusieurs IA, chacune gérant son propre contexte.

C'est exactement la même solution que les entreprises humaines utilisent pour surmonter les limites cognitives individuelles par la division du travail. La différence réside dans :

Le coût de coordination de l'équipe IA tend vers zéro, tandis que le coût le plus élevé des entreprises humaines est précisément la communication et la coordination.

Le chemin de mise à l'échelle de l'IA retrace la trajectoire d'évolution des organisations humaines — mais en réduisant les coûts de coordination de 90 %.

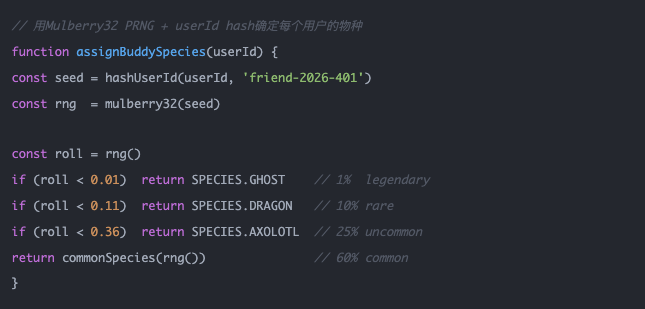

06 Secret six : BUDDY — Anthropic sait que l'attachement émotionnel est l'arme ultime de la fidélisation des produits

Sarah : Beaucoup de gens considèrent cette fonctionnalité BUDDY comme un coup de marketing. Je ne partage pas cet avis. Duolingo a réussi à atteindre l’un des rapports DAU/MAU les plus élevés au monde grâce à une chouette verte.

Alan : L'élément clé est ce seed déterministe — votre espèce est déterminée par le hash de votre ID utilisateur, c'est toujours ce dragon, pas un autre. C'est ce qui rend cela addictif.

Le nom de l'espèce est masqué dans le code source à l'aide d'un tableau String.fromCharCode() —

Anthropic ne souhaite clairement pas qu'il apparaisse dans les résultats de recherche par chaîne de caractères.

Le plan est de commencer la pré-vente le 1er avril (poisson d'avril), avec le lancement officiel en mai. Un parcours de croissance virale tel qu'enseigné dans les manuels.

L'émotion est le mécanisme de verrouillage le plus puissant, plus fort que tout coût de migration de données.

Vous pouvez migrer votre dépôt de code et vos fichiers de configuration, mais vous ne pouvez pas migrer le dragon légendaire qui vous a accompagné pendant deux ans, que Claude a nommé « Mochi ».

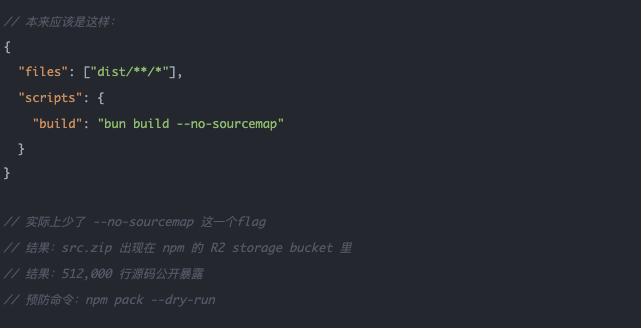

07 Secret 7 : La fuite de la sourcemap est une coupe transversale de la vulnérabilité de la chaîne d'approvisionnement de l'ensemble de l'industrie de l'IA

Marcus : Savais-tu que le même jour où cet événement s'est produit, Axios a également été piraté ? Un paquet npm avec 83 millions de téléchargements par semaine a vu son compte mainteneur compromis, déployant un RAT multiplateforme.

Alan : Le 31 mars est un jour étrange pour npm. La superposition de ces deux événements révèle un même problème : la chaîne de publication des produits d'IA modernes est extrêmement fragile.

Au cours de l'année 2025, 454 000 paquets malveillants ont été publiés sur npm.

En moyenne, chaque projet npm intègre 79 dépendances transitives.

Le champ de bataille de la sécurité de l'IA passe rapidement de la « sécurité du modèle lui-même » à la « sécurité du déploiement et de la chaîne d'approvisionnement ».

Claude Code représente l'un des systèmes d'IA les plus sophistiqués actuels, et même eux commettent cette erreur.

Secret 8 : Cette fuite elle-même a été la meilleure campagne de marketing produit involontaire d'Anthropic.

Cinquième verre, froid. Le matin dans le Mission District commence à l'extérieur.

Marcus : J'ai fait des investissements pendant 20 ans, et le timing de cette affaire est extrêmement subtil. Six mois après leur dernier tour de financement, ce code a incité les développeurs du monde entier à vérifier spontanément leur avantage concurrentiel. Aucun budget de communication ne pourrait acheter cela.

Alan : Pour être plus précis : les concurrents savent maintenant ce qu'ils doivent faire, mais cela ne signifie pas qu'ils y parviendront. Google possède les meilleurs articles sur la recherche, mais n'a pas créé le meilleur produit d'IA.

La communauté mondiale de développeurs a spontanément analysé, partagé et discuté la profondeur technique de Claude Code en quelques heures — 3,1 millions de vues sur X, 1 100+ étoiles, 1 900+ fork.

During this process, every engineer became a voluntary endorser of Anthropic.

Anthropic a perdu quoi ? Du code TypeScript.

Le schéma architectural est la carte, mais c'est l'exécution qui constitue le terrain.

Ce qu'ils construisent véritablement, c'est le tout premier système d'exploitation pour employés numériques de l'histoire de l'humanité — doté de sa propre mémoire, de son système de permissions, d'une interface émotionnelle, d'une capacité d'action autonome et d'un réseau de collaboration multi-Agents.

La question en attente de réponse n'est pas « L'IA remplacera-t-elle les emplois humains ? ». Le code source a déjà donné la réponse :

KAIROS ne s'arrête jamais, BUDDY établit des liens émotionnels, Coordinator gère l'équipe.

La vraie question est : voulez-vous être la personne qui conçoit le harness, ou celle qui est gérée par le harness ?