Cette semaine, le géant de l’intelligence artificielle (IA) Anthropic a lancé Claude Code Security, un outil de numérisation de code piloté par l’IA qui détecte les vulnérabilités et rédige des correctifs, bouleversant les marchés de la cybersécurité tout en soulevant des questions précises sur les emplois et les changements de pouvoir dans l’industrie.

Claude Code Security peut-il remplacer les analyseurs humains ?

La dernière addition d'Anthropic à sa plateforme Claude Code se présente avec un argument simple : laissez l'IA lire l'ensemble de votre base de code comme un chercheur en sécurité expérimenté, puis signalez ce que les autres ignorent. Selon le communiqué de l'entreprise, Claude Code Security recherche des vulnérabilités, suggère des correctifs et présente les résultats avec des évaluations de gravité et de confiance, tout en gardant les humains en position d'approbation.

Contrairement aux outils traditionnels de test de sécurité d'applications statiques qui s'appuient sur des modèles prédéfinis, Claude Code Security utilise des modèles de langage avancés (LLM), notamment Claude Opus 4.6, pour analyser la manière dont les données circulent et comment les composants interagissent. Cela signifie qu'il vise à détecter les défauts de logique métier et les contrôles d'accès défaillants qui échappent aux scanners basés sur des règles.

Pendant les tests internes, Anthropic a déclaré qu'Opus 4.6 avait identifié plus de 500 vulnérabilités de haute gravité dans des bases de code open source en production — certaines non détectées depuis des années. Ces découvertes font l'objet d'une priorisation et d'une divulgation responsable, ce qui suggère que les ambitions de l'outil vont au-delà de simples corrections cosmétiques.

Le flux de travail est structuré pour garantir la sécurité. Après une analyse approfondie, le système effectue une auto-vérification, cherchant à confirmer ou à infirmer ses propres découvertes avant de les présenter sur un tableau de bord avec des correctifs suggérés. Aucun « push vers la production » automatisé ici — chaque correction nécessite une approbation humaine, du moins pour l'instant.

Anthropic a développé cette fonctionnalité sur plus d'un an grâce à son équipe Frontier Red Team et l'a testée dans des compétitions de cybersécurité telles que les événements Capture the Flag, en collaboration avec des institutions comme le Pacific Northwest National Laboratory. L'outil est actuellement en préversion limitée pour les clients Enterprise et Team, avec un accès accéléré pour les mainteneurs de logiciels open source.

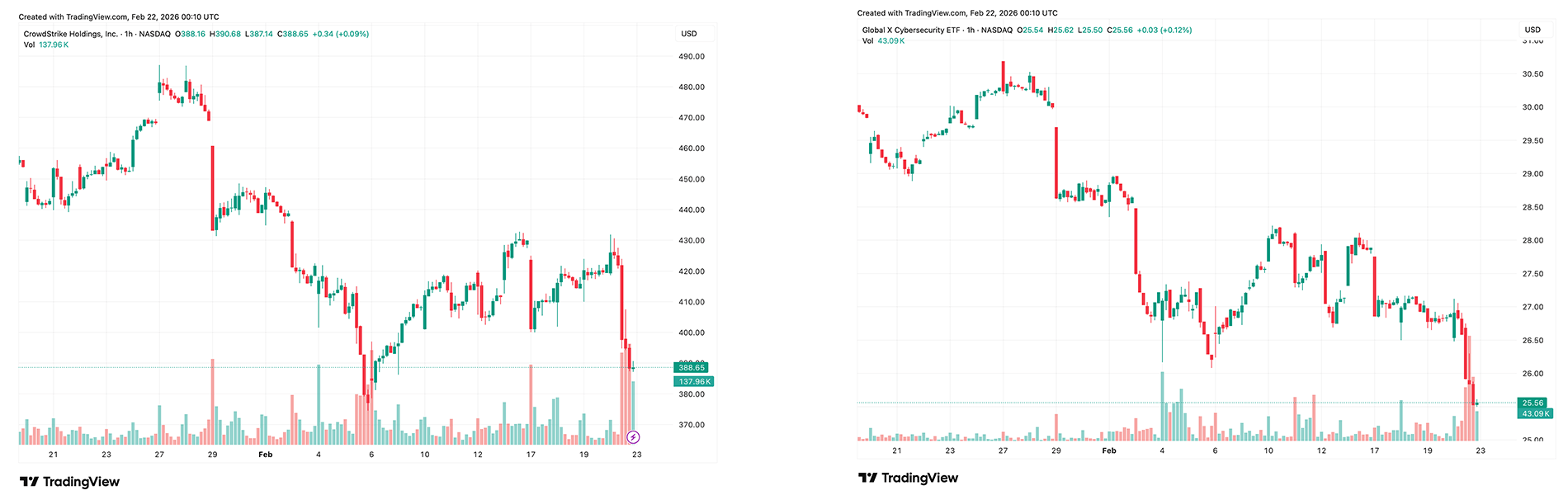

Wall Street, cependant, n'a pas attendu les détails. Les actions des principales entreprises de cybersécurité ont fortement reculé après l'annonce, avec des sociétés telles que Crowdstrike et Cloudflare chacune en baisse d'environ 8 %, tandis que d'autres comme Zscaler, Okta et Gitlab ont également subi des pertes. L'ETF Global X Cybersecurity ETF a quant à lui chuté d'environ 5 %, reflétant une méfiance généralisée au sein du secteur.

Certains analystes ont caractérisé la réaction comme étant dictée par les titres plutôt que structurelle, la décrivant comme un « mini flash crash » alimenté par la crainte que AI puisse marchandiser la détection de vulnérabilités. D'autres soutiennent que le retrait indique des préoccupations plus profondes sur la manière dont l'IA pourrait redéfinir l'économie de la sécurité logicielle.

Les discussions en ligne, notamment sur X, ont amplifié les inquiétudes professionnelles. Les publications avertissent que les scanners alimentés par l'IA pourraient « éliminer » des postes dans l'évaluation et la correction des vulnérabilités, notamment au niveau de la priorisation des bogues débutants. Dans une industrie déjà aux prises avec l'automatisation, le moment semble bien choisi.

Pourtant, de nombreux experts offrent une perspective plus mesurée. Anthropic’s Logan Graham a déclaré : « Je pense que si vous êtes sous l’effet de l’AGI, vous devriez accorder une grande importance à la cybersécurité. Les infrastructures cyberphysiques sont le moyen par lequel l’AGI ‘s’extériorise dans le monde’. C’est pourquoi nous voulons que Claude le sécurise. » Graham a ajouté qu’Anthropic « recrutait en cybersécurité ». Beaucoup d’autres ont présenté cette nouvelle capacité de Claude comme conçue pour aider les équipes submergées à gérer leurs arriérés, plutôt que de les remplacer.

Il est crucial de noter que Claude Code Security ne peut pas effectuer de tests en temps réel, envoyer de requêtes API ou valider l'exploitabilité dans des environnements en direct, ce qui signifie que les tests dynamiques et la supervision humaine restent essentiels. Le contexte plus large est difficile à ignorer. Alors que l'IA accélère à la fois la génération de code et les cyberattaques, les défenseurs font face à des adversaires capables de sonder les systèmes à la vitesse des machines.

Anthropic présente son outil comme un égalisateur défensif, élevant la base pour un développement sécurisé tout en reconnaissant la nature à double usage de l'IA. À cet égard, Claude Code Security pourrait représenter moins un générateur de licenciements et davantage un réécrivain de rôles. Les professionnels de la sécurité pourraient passer moins de temps à examiner des alertes répétitives et plus de temps à concevoir des architectures, valider des exploits et piloter des flux de travail assistés par l'IA.

Que le tremblement du marché s'avère temporaire ou marque un changement structurel dépendra de l'adoption, de l'intégration avec les piles existantes et de toutes les approches de l'IA dans les infrastructures critiques. Pour l'instant, Claude Code Security a accompli quelque chose de rare en cybersécurité : il a fait de l'examen du code le centre d'un débat financier et du travail.

FAQ ❓

- Qu'est-ce que Claude Code Security ?

C'est un outil piloté par l'IA d'Anthropic qui analyse des bases de code entières à la recherche de vulnérabilités et propose des correctifs validés par des humains. - Claude Code Security remplace-t-il les équipes de sécurité humaines ?

Non, il nécessite une approbation humaine pour les correctifs et ne peut pas effectuer de tests en temps réel, ce qui en fait un outil d’assistance plutôt qu’un remplacement. - Pourquoi les actions de cybersécurité ont-elles chuté après le lancement ?

Les investisseurs ont réagi à la crainte que l'analyse des vulnérabilités pilotée par l'IA ne perturbe les modèles économiques traditionnels des logiciels de sécurité. - Qui peut accéder à Claude Code Security pour le moment ?

Il est en prévisualisation de recherche limitée pour les clients Entreprise et Équipe, avec un accès accéléré pour les mainteneurs de logiciels open source.