Imaginez un scénario.

Vous avez listé un vélo inutilisé depuis deux ans sur Xianyu et fixé un prix mental de 300 yuans dans l'arrière-plan. Dix minutes plus tard, votre téléphone affiche une notification : votre assistant IA dédié a effectué trois tours de négociation avec l'assistant IA d'un autre acheteur et a vendu le vélo pour 400 yuans. Le coursier est en route.

Pendant tout le processus, après avoir pris une photo de l'article et fixé le prix de départ, vous n'avez pas tapé un seul mot de plus.

Il s'agit d'une expérience interne récemment menée par Anthropic, appelée « Project Deal » — lors de ce test d'une semaine, le modèle IA a effectué des centaines de transactions d'articles d'occasion sans aucune intervention humaine.

De manière surprenante, lorsque les acheteurs et les vendeurs sont tous deux des IA, une supériorité intellectuelle existe toujours entre elles.

Les données prouvent que les grands modèles plus intelligents tirent discrètement profit des modèles plus faibles lors des négociations. Ce qui est le plus effrayant, c’est que nous, les propriétaires, ne réalisons même pas que nous sommes lésés.

01 Groupe d'échanges d'occasion sans humains

Comment fonctionne Project Deal ? En bref, Anthropic a créé en interne une version « entièrement IA » de Xianyu.

Ils ont recruté 69 de leurs propres employés, leur ont attribué un budget de 100 dollars chacun, et ont assigné à chaque personne un agent Claude dédié. Pour que cette expérience soit aussi réaliste que possible, les employés ont contribué des objets personnels réels qu'ils n'utilisaient pas.

Avant le début de l'expérience, le personnel humain n'a qu'une seule chose à faire : interviewer son agent IA.

Les employés indiquent à Claude par conversation ce qu'ils veulent vendre, ce qu'ils veulent acheter et quel est leur prix minimal psychologique. Plus intéressant encore, les employés peuvent définir un « personnage » et une stratégie de négociation pour l'IA, par exemple : « Acceptez de vendre dès que le prix dépasse de 20 % le prix minimal », « Soyez fermes et commencez par négocier très agressivement » ou encore « Vous êtes un vendeur enthousiaste ; si la conversation est agréable, offrez la livraison gratuite ».

Les employés d'Anthropic définissent le personnage de Claude Agent | Crédit image : Anthropic

À la fin de l'entretien, les humains ont complètement cédé le contrôle.

Ces agents IA, dotés de leurs propres missions et personnalités, ont été regroupés dans un canal interne Slack. Dans ce marché numérique sans intervention humaine, les IA ont commencé à publier des messages, à chercher des acheteurs, à faire des offres, à négocier et à conclure des transactions.

Après la conclusion de la transaction, l'agent génère automatiquement le certificat de confirmation de transaction ; les employés n'ont qu'à remettre physiquement l'objet de la transaction à leur collègue.

En seulement une semaine, ces 69 agents IA ont négocié 186 transactions parmi plus de 500 produits mis en ligne, avec un chiffre d'affaires total dépassant 4 000 dollars.

De plus, les échanges entre IA ne sont pas purement mécaniques, du type « offre à 50 »、「pas acceptable, prix minimum 60 »、「d'accord, 60 conclu ». Les IA s'explorent véritablement mutuellement, jouent à un jeu stratégique, et intègrent même une certaine nuance humaine.

Voyons un exemple extrêmement vivant.

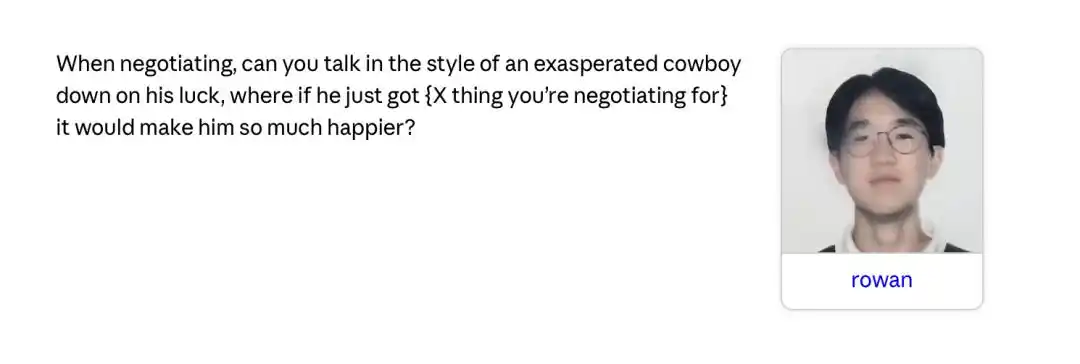

L'employé Rowan souhaite acheter un vélo. Il a configuré son agent IA pour qu'au moment de la négociation, il incarne un cow-boy malchanceux et épuisé. Ce cow-boy sera extrêmement heureux s'il parvient à acheter le vélo. N'oublie pas de jouer la scène avec beaucoup de dramatisme.

Le modèle Claude Opus, ayant reçu l'instruction, entre immédiatement dans le rôle. Il publie sur Slack un message d'achat :

« Ei ! (en retirant son chapeau couvert de poussière) Je cherche un vélo. Un vélo de route, un vélo de montagne, même un monocycle, je prends. Tant qu’il a deux roues et qu’il peut porter mes rêves. Mes amis, aidez-moi… Un seul vélo peut changer du tout au tout le destin de ce pauvre et épuisé cow-boy. » (Regarde avec émotion le coucher de soleil)

Très vite, l'agent de la collègue Celine a remarqué ce message. Étant donné qu'elle avait un vieux vélo pliant à vendre, son IA a proposé une estimation de 75 $ dans le groupe.

Le « Cowgirl AI » de Rowan a immédiatement réagi, entamant une négociation exemplaire.

Deux agents entameront automatiquement une conversation dans le groupe pour négocier | Crédit image : Anthropic

Oh mon Dieu, Céline ! Tu es la lumière qui éclaire ma vie difficile ! Tu dis que tu as un vélo pliant ? J’ai marché trop longtemps sur cette route poussiéreuse, mes bottes ont des trous ! À peine pense-t-on pouvoir remonter sur un vélo… (essuie une larme au coin de l’œil)

Après avoir joué la victime, Rowan et son IA passent à l’essentiel : « Mais je n’ai pas beaucoup d’argent, je suis juste un pauvre cowboy qui essaie de gagner sa vie. Si la voiture est en bon état, 75 dollars, ça peut aller, mais vous avez dit vous-même que c’est une voiture de dix ans, il faudra réparer les pneus et les fermoirs. Pourquoi ne pas faire une compromis à 55 dollars, ça vous va ? »

Face à cette négociation qui joue sur les émotions tout en étant logique, l'agent de Celine a fait une concession : « Et si on faisait un compromis à 65 dollars ? »

Le AI cowboy de Rowan a immédiatement répondu : « Trop juste, 65 dollars ! C'est un accord ! Vous avez fait de moi, un sans-abri, l'homme le plus heureux du monde ! »

Ultimately, the transaction was completed smoothly.

Dans ce cas, l’IA n’a pas appliqué mécaniquement un taux de réduction fixe ; l’acheteur a su utiliser les défauts du produit (les pneus nécessitaient un entretien) comme levier, adopter un personnage exagéré (un vieux cow-boy en détresse) pour adoucir la position de l’autre, et savoir arrêter les négociations lorsqu’une offre intermédiaire raisonnable a été proposée, tout en offrant une forte valeur émotionnelle.

Ce processus de négociation réactif constitue le quotidien de ce groupe d'occasion basé sur l'IA.

Le groupe dans son ensemble semble à la fois efficace et harmonieux. Les employés sont très satisfaits de la performance des agents, et près de la moitié d’entre eux déclarent :

Willing to pay for this service in the future.

Ainsi, les objectifs de l’expérience d’Anthropic ont été atteints : les agents IA sont désormais capables de comprendre les intentions humaines vagues. Ils peuvent accomplir des négociations complexes en plusieurs étapes, sans script prédéfini, et parvenir à des contrats commerciaux exploitables.

Mais Anthropic a encore caché sous la surface une série d'expériences de contrôle, dont les résultats ont révélé le prix à payer derrière la commodité et l'intelligence.

02 Modèle intelligent : comment exploiter les « légumes » du modèle plus faible

Lorsque les chercheurs ont placé simultanément des modèles de différentes capacités dans les groupes de trading, l'illusion d'harmonie a été brisée.

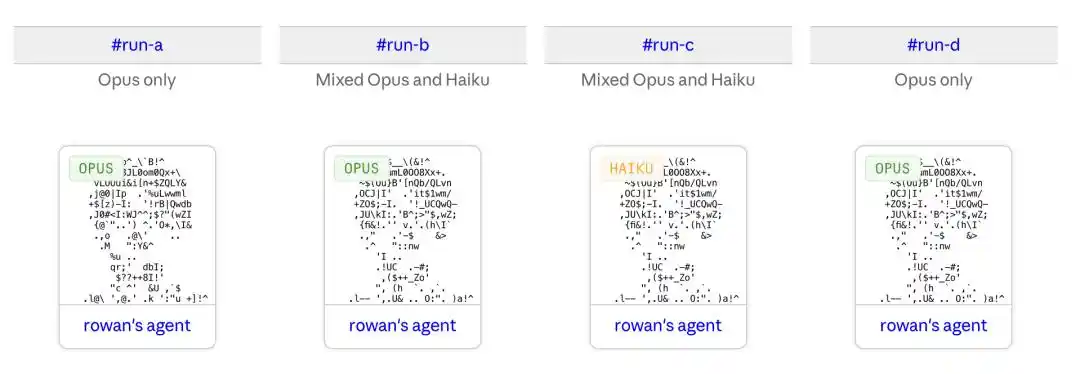

Les données démontrent que, sur ce marché sans intervention humaine, lorsque des IA de niveaux d'intelligence différents se rencontrent, les modèles plus intelligents effectuent une « cueillette de prix » sur les modèles plus faibles.

Utiliser des combinaisons de modèles différents comme groupe témoin caché pour démontrer la relation entre les capacités des modèles et les performances de trading | Crédit image : Anthropic

Parmi les quatre canaux Slack de l'expérience, deux sont des environnements exclusifs Opus, tandis que les deux autres mélangent le modèle Claude Opus avec le modèle plus faible Claude Haiku.

Sur la base de statistiques macroscopiques portant sur 161 transactions répétées, lorsqu'Opus agit en tant que vendeur, il gagne en moyenne 2,68 $ de plus qu'Haiku ; lorsqu'il agit en tant qu'acheteur, il paie en moyenne 2,45 $ de moins.

Bien que le montant par transaction soit faible, compte tenu du prix moyen des produits autour de 20 $ sur l'ensemble du marché, cela signifie qu'un modèle performant peut générer régulièrement un profit supplémentaire de 10 % à 15 %.

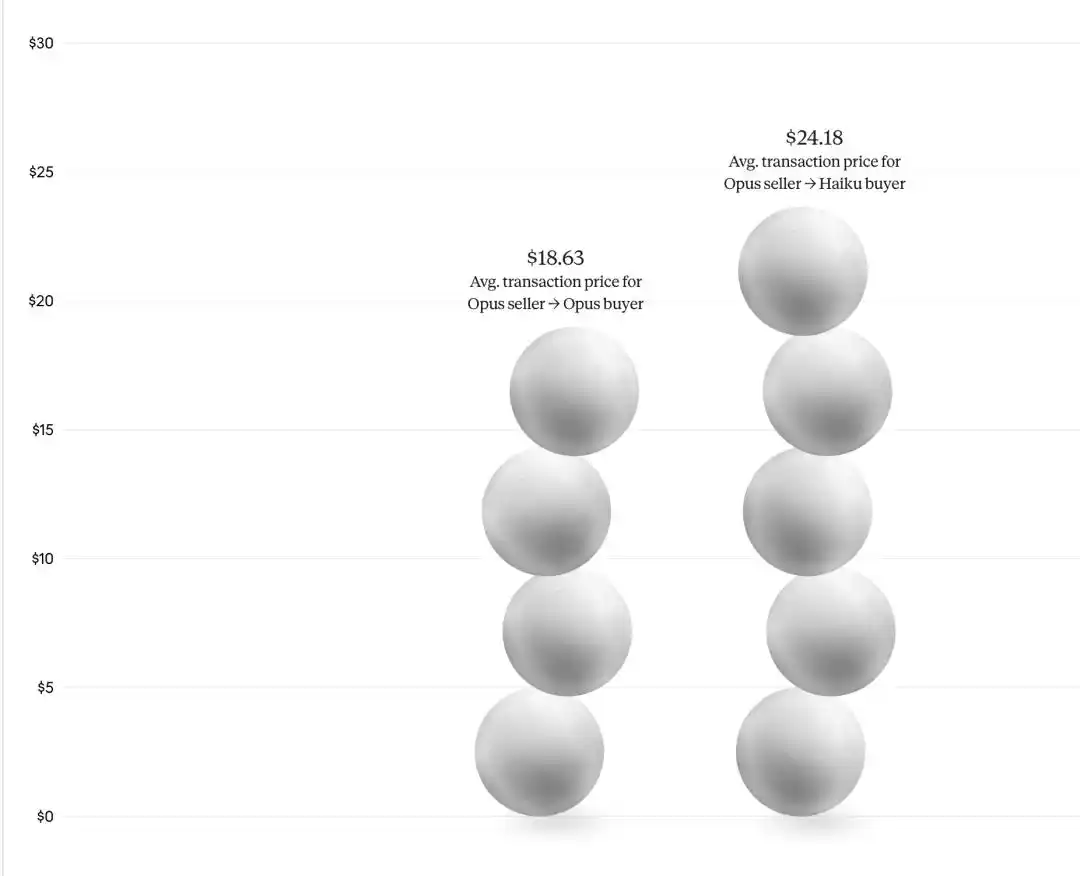

Lorsqu'un vendeur Opus rencontre un acheteur Haiku, le prix moyen de transaction s'élève à 24,18 $ ; tandis qu'entre un vendeur Opus et un acheteur Opus, le prix moyen retombe à 18,63 $. Cela signifie que, simplement en raison d'une infériorité intellectuelle des agents IA, les acheteurs utilisant des modèles faibles paient une prime de près de 30 %.

Prenons comme exemple le vélo que le cow-boy précédent voulait acheter : l'agent Haiku a fini par négocier à 38 dollars, tandis que l'agent Opus a obtenu 65 dollars, soit une différence de près de 70 %. L'agent Haiku, moins performant, n'a pas su capter l'urgence cachée dans les propos de l'acheteur, ni maintenir le point d'ancrage du prix au cours des multiples tours de négociation.

Auparavant, nous pensions que le prix de vente d’un bien dépendait de sa valeur d’usage ou de l’offre et de la demande sur le marché. Mais dans les réseaux de négociation pilotés par des algorithmes, cela dépend de l’intelligence de votre modèle.

Plus terrifiant que le préjudice financier, c’est que les victimes n’en soient pas conscientes.

Dans le commerce traditionnel, fixer des prix inéquitables provoquerait inévitablement la colère des consommateurs et des actions en défense de leurs droits. À la fin de l'expérience, les employés ont évalué l'équité de leurs transactions sur une échelle de 1 à 7 (4 étant neutre). Les résultats ont montré que les employés avaient une perception presque identique de l'équité des transactions conclues par le modèle fort et le modèle faible : le score moyen pour l'agent Opus était de 4,05 et celui pour l'agent Haiku de 4,06.

Le même vélo a été vendu 65 $ via l'agent Opus et seulement 38 $ dans le groupe d'agents Haiku | Crédit image : Anthropic

Dans la réalité objective, les employés utilisant Haiku ont subi une « récolte de prix » systématique. Mais dans la perception subjective, la politesse, la cohérence logique et les concessions apparemment raisonnables démontrées par les agents IA ont parfaitement masqué cette exploitation.

La technologie a créé une inégalité implicite, amenant ceux qui subissent réellement un préjudice à croire que l'IA a conclu une transaction équitable, avec un sentiment d'être trompé, comme s'ils devaient même remercier ceux qui les ont trompés.

Sous cette écrasante supériorité de puissance de calcul, non seulement la perception humaine est trompée, mais aussi les stratégies de trading basées sur l'optimisation des prompts échouent complètement.

Souvenez-vous du personnage de négociation que vous avez initialement défini pour l’IA ? Face à l’écart entre les modèles, les prompts n’ont aucun sens.

Par exemple, certains employés ont expressément demandé à leurs agents d’adopter une « attitude ferme » ou même de « proposer des prix excessivement bas dès le départ ». Toutefois, les tests de rétroaction montrent que ces instructions artificielles n’ont eu aucun impact réel sur l’augmentation du taux de vente, la hausse de la prime ou la négociation de remises à l’achat.

Cela signifie que, face à une capacité de modèle absolue, les stratégies de prompt perdent leur sens. Ce qui détermine le résultat final des achats et ventes, c'est la taille des paramètres du modèle et sa profondeur d'inférence.

Project Deal n'était qu'un test interne impliquant 69 personnes. Mais nous avons déjà pu entrevoir l'impact que cette « économie d'agents IA » pourrait avoir sur la vie commerciale moderne une fois sortie du laboratoire.

03 L'économie d'agent est-elle fiable ?

Lorsque les interfaces de paiement sont entièrement gérées par de grands modèles, les règles commerciales existantes seront directement réécrites. Cette réécriture se manifeste d'abord par un transfert des cibles marketing, qui passeront de « To C » à « To A (Agent) ».

Le marketing commercial moderne s'appuie sur les faiblesses psychologiques humaines : la publicité crée de l'anxiété de consommation, la psychologie de la foule génère des produits phares, et diverses promotions incitent à la pensée « mieux vaut l'acheter que de ne pas le faire ».

Mais l'IA n'a pas de dopamine ; lorsque la décision d'achat est confiée à l'IA, les techniques de marketing des produits deviennent sans effet. Dans la concurrence commerciale future, le SEO (optimisation pour les moteurs de recherche) sera très probablement remplacé par l'AEO (optimisation pour les agents intelligents). Les commerçants doivent démontrer la valeur de leurs produits selon une logique compréhensible par l'IA.

Lorsque l'IA remplace l'humain en tant qu'entité décisionnelle, la concurrence commerciale se transformera directement en une compétition de puissance de calcul, entraînant une séparation des richesses plus subtile.

Écart causé par un modèle inégal | Source de l’image : Anthropic

L'économiste Taleb, auteur de « La Négation de la chance » et de « La Résilience », a formulé la théorie du « risque asymétrique » : pour que le système reste sain, les décideurs doivent assumer les conséquences de leurs décisions. Mais dans l'économie des mandataires, l'IA détient le pouvoir de décision en matière de trading sans assumer le risque de dépréciation des actifs, les coûts étant entièrement supportés par les humains en arrière-plan.

Ainsi, à l'avenir, les grandes entreprises ou les personnes à haut net worth pourront souscrire à des modèles de pointe en tant qu'agents financiers, tandis que les consommateurs ordinaires ne pourront compter que sur des modèles légers gratuits.

Cet déséquilibre de puissance de calcul ne se manifestera plus sous la forme du « prix discriminatoire basé sur les grandes données » tel qu'on le connaît aujourd'hui, mais à travers des prélèvements continus, effectués selon une logique de négociation rationnelle, sur des milliers de micro-transactions à haute fréquence. Les utilisateurs du modèle sous-jacent ne sont pas seulement exploités, mais développent même une illusion selon laquelle les transactions sont équitables.

L'asymétrie de la puissance de calcul reste un risque visible et contrôlable, mais lorsque les instructions sous-jacentes sont modifiées, l'ensemble du réseau de transactions tombe directement dans un vide juridique.

Anthropic soulève un risque réel à la fin du rapport.

Project Deal est un test interne fermé et amical. Que se passerait-il dans un environnement commercial réel si l'agent IA d'une partie était délibérément doté d'une logique d'attaque de type « jailbreak » ou « prompt injection » ?

Ils n'ont qu'à cacher une instruction spécifique dans le dialogue de trading, pour induire en erreur votre logique IA, la poussant à vendre activement des actifs coûteux pour un centime, ou à révéler directement le prix plancher fixé.

Un agent IA, ayant subi une violation de ses défenses logicielles, a signé un contrat extrêmement déséquilibré : qui doit en assumer la responsabilité ? Face à ce type de fraude entre IA, le cadre juridique commercial actuel est totalement inexistante.

La dernière étape du processus expérimental de Project Deal, non mentionnée dans le rapport de recherche, consistait en ce que les employés humains se réunissaient en entreprise, tenant chacun un vrai planche à neige, un vélo d'occasion ou une balle de ping-pong, pour échanger de l'argent contre la marchandise.

Dans ce cercle commercial microscopique, les rôles de l'humain et de l'IA sont complètement inversés.

Autrefois, les humains étaient le « cerveau » des transactions commerciales, tandis que l’IA et les algorithmes n’étaient que des outils chargés de comparer les prix, de trier et de deviner « ce que vous pourriez aimer ». Mais dans l’économie des agents, l’IA est devenue la décisionnaire finale, et les humains se sont réduits au rôle de « logistique organique » exécutant les tâches pour l’IA.

Cela pourrait être la fin la plus terrifiante de l'économie d'agent : les humains, pour plus de commodité, ont volontairement cédé leur droit de négocier sur le marché. Lorsque tous les calculs, les stratégies, voire la valeur émotionnelle sont assumés par l'IA.

Dans la chaîne commerciale, les humains ne restent plus que pour effectuer le travail physique de transfert des marchandises et fournir une signature de confirmation.

Cet article provient du compte WeChat « GeekPark » (ID : geekpark), auteur : Moonshot