Que faire pour prouver votre innocence si l’IA affiche soudainement que vous êtes coupable et que tout le monde accepte aveuglément son jugement ?

Cela ressemble à la scène du film Minority Report où les crimes sont prédits puis on vous accuse à tort, mais de manière abstraite, une version encore plus bâclée s'est déjà jouée dans la réalité :

L'IA a identifié à tort un criminel, entraînant la détention pendant six mois d'une femme innocente, dont la vie a failli être anéantie.

Qu'est-ce que cela signifie que la police a arrêté « Flash » ?

Angela Lipps, de l'État du Tennessee aux États-Unis, est cette malheureuse femme. En juillet 2025, une équipe de policiers armés est entrée brusquement dans sa vie ordinaire, lui a pointé des armes et lui a annoncé qu'elle était arrêtée.

À l'époque, elle était un peu choquée, car elle n'avait tout simplement pas idée de ce qu'elle avait fait de mal. La police a déclaré qu'elle était soupçonnée d'avoir participé à une fraude bancaire dans le Dakota du Nord, et l'attitude des agents semblait indiquer que les preuves étaient solides, avec un avis de recherche de niveau 5 émis contre elle ; mais après avoir entendu cette raison, elle est restée pétrifiée sur place :

But I’ve never been to that state in my life.

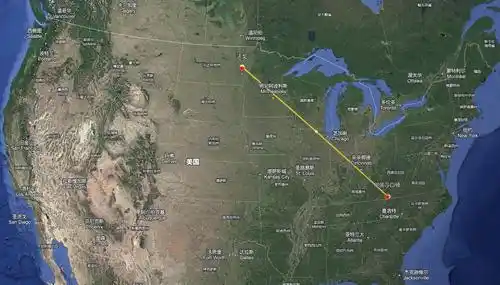

Sur la carte, l'État du Tennessee aux États-Unis est effectivement éloigné du Dakota du Nord, et c'est l'IA qui a établi le lien entre elle et le suspect.

Lors de son arrestation, la police a automatiquement ignoré ses explications ; les détails précis de l'affaire n'ont été connus qu'après son incarcération. La police de Fargo, dans le Dakota du Nord, enquêtait sur une affaire d'escroquerie dans laquelle le suspect avait obtenu plusieurs dizaines de milliers de dollars auprès d'une banque en se faisant passer pour un militaire falsifié. La méthode d'enquête de la police consistait d'abord à examiner les caméras de surveillance, puis à consulter l'IA, et enfin à procéder à l'arrestation.

Vous pensiez peut-être qu’on avait utilisé l’IA pour « distiller » Sherlock Holmes, puis pour le faire incarner un détective génial résolvant des affaires par un raisonnement logique rigoureux, mais en réalité, ce n’est pas aussi « compliqué ». La police a utilisé un système d’IA pour effectuer une reconnaissance faciale sur des captures d’écran de vidéos de surveillance, puis a filtré les suspects dans une base de données.

L'IA a cette fois commis une erreur majeure en associant à tort la photo d'Angela Lipps. Ces informations ont ensuite été transmises au poste de police en charge de l'enquête, où les agents ont commis une erreur encore plus grave : après avoir vérifié manuellement son permis de conduire et ses réseaux sociaux, ils ont jugé que les traits du visage, la silhouette et la coiffure étaient similaires, et ont donc identifié cette dernière comme suspecte.

Image provenant de GoFundMe

Sœur aînée a été complètement dévastée après avoir écouté, sans vérifier davantage d'autres indices—et si c'était une ressemblance ? Mais ce qui l'a encore plus dévastée, c'est que, après cette série de coups, elle n'a pas eu l'occasion de prouver son innocence.

Selon les procédures locales, elle n'a pas été directement transférée au Dakota du Nord pour une enquête supplémentaire, mais a été détenue dans une prison locale du Tennessee. Considérée comme « fugitive interétatique », elle n'a pas eu droit à la caution ni à un interrogatoire par la police, et a été incarcérée pendant 108 jours, de juillet jusqu'à la fin octobre — il est difficile d'imaginer à quel point elle a dû être désespérée pendant cette période.

Angela Lipps a attendu jusqu'au 30 octobre, moment où la police l'a finalement sortie de prison pour la transférer au Dakota du Nord. À ce moment-là, elle faisait face à plusieurs accusations et, pendant son transport, elle devait porter des menottes ainsi qu'une chaîne autour de la taille ; à ses yeux, traverser l'aéroport ressemblait à une parade humiliante.

Et c'était en réalité la première fois de sa vie qu'elle prenait un avion.

Ce qu'elle n'avait pas prévu, c'est qu'après être arrivée au Dakota du Nord, elle devait encore attendre. Ce n'est qu'en décembre qu'elle a eu l'occasion officielle d'expliquer la situation : son avocat a directement consulté ses relevés bancaires pour les comparer aux horaires, révélant qu'au moment des faits, elle était à 1900 kilomètres de là, en Tennessee, en train d'acheter une pizza — ce qui signifie que, sauf si elle était « Flash », elle ne pouvait pas commettre le délit en franchissant l'espace-temps.

L'avocat lui a clarifié la situation en seulement cinq minutes.

Le 24 décembre, ses allégations ont enfin été retirées, mais elle n'avait aucune raison de se réjouir, car la ligne de coupure était déjà à la cheville.

Angela Lipps a célébré ses 50 ans en prison ; pendant son incarcération, on ne lui a pas autorisé à porter ses prothèses dentaires, elle ne mangeait que des aliments transformés et subissait une forte pression psychologique, ce qui a entraîné une prise de poids importante. Avant d’être incarcérée, elle portait des vêtements d’été ; à sa sortie, c’était l’hiver, et elle n’avait même pas de manteau chaud, ce qui rendait la survie au froid difficile, sans parler de rentrer chez elle. La police ne lui a pas fourni de frais de déplacement, et après sa libération, elle s’est retrouvée piégée dans le Dakota du Nord, ainsi que dans le jour où elle avait été injustement accusée par une IA.

Heureusement, une personne bienveillante lui a tendu la main.

Son avocat a organisé son hébergement temporaire dans un hôtel et lui a procuré à manger pour traverser les moments les plus difficiles ; une organisation locale à but non lucratif l'a secourue et l'a ramenée chez elle, au Tennessee.

Mais rentrer chez elle après cela s’est révélé aussi difficile que l’enfer. Pendant son incarcération, sa situation économique a explosé : elle a perdu son appartement en location, son chien est décédé, et même sa voiture ainsi que tout ce qu’elle y avait rangé ont disparu. Ses biens personnels avaient été entreposés dans un entrepôt, mais comme elle n’a pas pu payer le loyer, tous ses biens de première nécessité ont été retirés. Même ses relations personnelles sont menacées, car les voisins l’ont vue arrêtée et « disparue » pendant six mois, et pensent qu’elle a réellement commis un crime.

En même temps, cette expérience absurde s'est rapidement répandue sur Internet et a suscité de nombreuses critiques. Par exemple, beaucoup ont exprimé leur étonnement : aux États-Unis, certaines personnes peuvent effectuer des « achats à 0 dollar », mais dès que vous touchez aux banques des capitalistes, vous êtes arrêté en un clin d'œil, même si vous n'êtes pas coupable.

En raison de l'ampleur de la situation, elle a à nouveau trouvé une issue à son impasse et a reçu davantage d'aide ; elle a désormais collecté 80 000 dollars via une campagne de financement participatif, une somme suffisante pour recommencer sa vie.

Cependant, l'attente la plus forte des internautes est qu'elle engage une équipe d'avocats pour les poursuivre avec vigueur, ce qui pourrait lui permettre de gagner le procès et d'obtenir une autre indemnisation.

Ce n'est pas une erreur accidentelle de la police ; de nombreuses fausses condamnations ont déjà eu lieu auparavant, certaines personnes ayant vécu des expériences encore plus terribles que la sienne.

Deuxièmement, des moments de science-fiction effrayants causés par une « erreur » d'IA

L'expérience d'Angela Lipps s'est déjà déroulée plus de dix fois dans différentes régions, voire dans d'autres pays.

Par exemple, Robert Williams a été l'une des premières victimes de ce type d'événement ; en 2020, la police l'a arrêté devant sa femme et sa fille, et l'a détenu pendant 30 heures, alors qu'il était 20 cm plus grand que le véritable coupable.

Un autre Chris Gatlin est également une victime malchanceuse : l'IA l'a identifié comme suspect potentiel dans l'affaire de violences dans le métro à partir d'images de surveillance floues, et il a été détenu pendant 17 mois consécutifs, devenant ainsi la personne innocente détenue le plus longtemps à ce jour. Ce qui est absurde, c'est que les enquêteurs n'ont découvert qu'à la fin qu'il existait une caméra corporelle pouvant servir de preuve cruciale, mais le suspect sur les images n'avait aucun point commun avec lui.

Porcha Woodruff en 2023 a connu la même situation : la police l'a accusée d'être impliquée dans un vol de véhicule. Elle a éclaté de rire sur place, pensant que la police faisait une blague, car elle était alors enceinte de huit mois et n'avait absolument pas l'air capable de commettre un tel acte. Toutefois, elle a été arrêtée et détenue pendant une dizaine d'heures, puis a perdu son procès.

Cette année, un jeune homme britannique nommé Alvi Choudhury a également été arrêté dans des circonstances similaires, accusé de « cambriolage », mais les preuves suggèrent que l'acte a été commis « à distance » — un scénario également documenté dans des films. La photo identifiée par l'IA était celle de son arrestation en 2021 ; les policiers ont éclaté de rire en voyant la personne réelle, car il semblait avoir au moins dix ans de plus que le suspect.

Image tirée de « The Mind Traders »

En 2022, le commerçant indien Praveen Kumar a été arrêté en route pour la Suisse, lors d'une escale à Abu Dhabi, où une IA l'a confondu avec un criminel recherché. Les autorités locales l'ont longuement interrogé, puis ont finalement déterminé qu'il n'était pas le suspect et l'ont renvoyé en Inde, où il a été retenu deux fois consécutives à l'aéroport.

Parmi ces événements, le plus absurde est probablement l'expérience du scientifique russe Alexander Tsvetkov, qui a été détenu pendant 10 mois parce qu'une IA lui a dit qu'il ressemblait à un meurtrier.

Ce scientifique a pu être victime d'une double calomnie de l'IA et des êtres humains. En février 2023, après avoir terminé une mission de recherche scientifique, il est rentré en Russie, mais a été arrêté dès sa descente d'avion. La raison ? L'IA a indiqué une similarité de 55 % entre son apparence et le portrait-robot d'un suspect dans une série de meurtres datant de plus de vingt ans. Par ailleurs, un témoin collaborateur dans cette affaire a délibérément fourni un faux témoignage pour obtenir une réduction de peine et l'identifier comme coupable. Malheureusement, la police n'a pas mené d'enquête approfondie et l'a simplement arrêté.

Après son arrestation, il a d'abord cru à un malentendu mineur, mais l'enquête s'est prolongée indéfiniment. Sous une pression psychologique énorme et des problèmes de santé, il a été contraint de plaider coupable, puis a rétracté sa déclaration. Heureusement, sa femme et ses collègues de l'institut ont constamment milité en sa faveur, rassemblant de nombreuses preuves démontrant qu'il se trouvait en déplacement à l'étranger au moment des faits. Avec la couverture médiatique, l'affaire a suscité un large débat public. Ce n'est qu'en décembre que la situation a commencé à évoluer, et les accusations ont été officiellement levées en février 2024.

Ces types de cas se produisent de plus en plus fréquemment avec l'évolution de l'IA, semblant ressembler davantage à une situation où l'IA « dirige », tandis que certaines personnes deviennent des machines exécutantes.

Troisièmement : la maladie professionnelle « L’IA décide »

La sensation abstraite d’un échange de rôles provient du fait que tant l’IA que les humains peuvent faire des erreurs ; même les IA les plus puissantes commettent des erreurs, et les humains ont tendance à « tricher » à tout moment.

Prenez le système américain Clearview AI : c’est lui qui a envoyé la dame mentionnée au début de l’article en prison, mais ce n’est pas un logiciel de mauvaise qualité. Clearview AI affirme détenir la plus grande base de données d’images au monde, ayant collecté des dizaines de milliards d’images malgré les amendes imposées par plusieurs pays. Plus de 3 000 agences d’application de la loi aux États-Unis l’utilisent, et l’année dernière, il a signé un contrat de 9,2 millions de dollars avec l’ICE.

Mais, en résumé, Clearview AI est une sorte de « moteur de recherche d'images faciales » : vous téléchargez une image, il la compare à sa base de données et vous renvoie une série d'images similaires ; il vous revient ensuite de déterminer si c'est bien la personne que vous cherchez.

Bien que l'IA ait progressé rapidement ces dernières années, la « précision » reste controversée, car les données utilisées pour les tests expérimentaux diffèrent toujours de celles rencontrées lors d'une recherche d'images dans la vie réelle.

Par exemple, la plupart du temps, les images de surveillance trouvées par la police ont une qualité d'image semblable à celle prise par un téléphone fixe, auxquelles s'ajoutent des facteurs tels qu'un éclairage étrange, des angles difficiles ou des obstacles sur le visage, rendant la reconnaissance particulièrement difficile ; les images dans la base de données pourraient également être anciennes, et le résultat de correspondance pourrait simplement être une ressemblance fortuite entre deux personnes.

Et lorsque ces erreurs touchent des individus, ils en subissent naturellement les conséquences.

Est-ce un corbeau ou un chat ?

Théoriquement, si l’IA ne fait des erreurs que de temps en temps, il y a encore espoir, car ces erreurs ne sont que des « indices » ; les « conclusions » finales doivent encore être validées par un humain. Mais bien souvent, les humains sont encore plus « absurdes » que l’IA.

Il y a quelques années déjà, certains critiquaient la police américaine pour être manipulée par l’IA, tombant dans le biais d’automatisation : une dépendance voire une confiance excessive dans les résultats fournis par l’IA. Dès que l’IA affirmait que ces deux personnes correspondaient, les humains acceptaient sans vérifier. Si la taille ne correspond pas, ce n’est pas mon problème ; même s’il existe un alibi, je n’ai qu’un seul rôle : arrêter. Tous les autres éléments de preuve, expliquez-les à la prison. En sautant les étapes fondamentales d’enquête, on fait aussi « sauter la vie » des gens.

En réalité, les humains connaissent bien les défauts de l'IA ; après avoir versé de nombreuses indemnisations, de nombreuses régions aux États-Unis ont établi des « lignes de démarcation », comme exiger, en plus des indices fournis par l'IA, des preuves indépendantes lors des enquêtes criminelles, voire interdire directement l'utilisation de l'IA pour résoudre des affaires dans certaines zones.

Mais ces contraintes ne résistent pas à l’extrême utilité de l’IA. Même s’il y a un risque d’échec, les succès sont clairement plus fréquents. Parfois, les indices que la police met tant d’efforts à trouver ne sont que des photos de surveillance de qualité « serrure de porte » ; la police a alors très souvent envie d’essayer l’IA pour voir si ça marche. Déjà en 2023, il a été rapporté que la police américaine avait effectué des millions de recherches avec Clearview AI, et même après que son utilisation ait été officiellement interdite, elle l’a continuée en cachette — après tout, on peut toujours dire qu’on ne l’a pas utilisée. Si ce logiciel est interdit, on en choisit un autre ; si son usage est bloqué localement, on demande à une autre institution de l’utiliser pour nous. On s’y est carrément accroché.

Ainsi, dès qu'une IA fournit une piste peu fiable, suivie d'un humain qui paresseusement saute l'enquête, la combinaison des deux entraîne inévitablement une erreur judiciaire.

Au cours des deux dernières années, le système Smart Sampa du Brésil fait face à des problèmes similaires. En 2024, São Paulo au Brésil a lancé le système de police le plus vaste d'Amérique latine basé sur la reconnaissance faciale par IA, qui serait connecté à 40 000 caméras.

La bonne nouvelle est que l'effet est réellement puissant : depuis plusieurs années, près de quatre mille criminels ont été arrêtés sur le fait, et plus de trois mille fugitifs ont été ramenés ; les cambriolages ont diminué de près de 15 % en 2025, ce qui en fait une « chaîne de capture de voleurs ».

La mauvaise nouvelle est que au moins 59 personnes ont été confondues.

Parmi eux, on trouve des cas abstraits, comme un patient psychiatrique emmené comme un criminel à l’hôpital, puis relâché après qu’on ait découvert que son mandat d’arrêt était expiré. Un autre homme a été arrêté quatre fois en sept mois, car l’IA l’a confondu avec un meurtrier en fuite. À chaque fois, il était relâché immédiatement après être ramené au commissariat, puis réarrêté quelques jours plus tard ; il était déjà traumatisé.

Lorsqu'on discutait précédemment des métiers que l'IA ne pouvait pas remplacer, on disait toujours que l'IA ne pouvait pas aller en prison à la place d'une personne, mais nous n'avions jamais envisagé l'autre côté de cette question : elle peut maintenant faire « emprisonner » les gens.

Cette phrase était autrefois une blague, mais aujourd'hui, elle ne fait presque plus la une des nouvelles. En fait, ce n'est pas seulement la reconnaissance faciale : l'IA peut aussi parfois réaliser des exploits impressionnants dans la reconnaissance d'objets.

L'année dernière, un système de sécurité basé sur l'IA dans un lycée américain a identifié l'emballage de chips tenu par un jeune homme comme une « arme potentielle », déclenchant immédiatement une alerte. Huit voitures de police sont arrivées et ont rapidement maîtrisé le jeune homme ; après un fouillage, les agents ont finalement retrouvé le sac de snacks dans une poubelle, créant une scène extrêmement gênante, pendant laquelle le jeune homme pensait qu'il allait mourir.

Ne dis pas, vraiment ne dis pas

Qui aurait cru que plus l’IA est puissante, plus certaines personnes utilisent cette puissance pour créer des problèmes énormes ? Autrefois, l’IA était peu performante, elle se trompait en reconnaissant des images, et tout le monde s’en moquait. Aujourd’hui, l’IA est plus performante : elle se trompe sur une seule personne, et cela envoie un humain en prison pour six mois. Dans le futur, évitons de créer des concepts abstraits comme des juges IA, des avocats IA ou des tribunaux d’énergies renouvelables. En fin de compte, l’IA n’est qu’un outil ; ce qui compte vraiment, c’est la capacité et les intentions de l’utilisateur. Autrement dit, plus l’IA est puissante, plus les humains ne doivent pas se relâcher.

En résumé, on commence un peu à regretter cet AI un peu笨拙.

Cet article provient du compte officiel WeChat « CoolPlay Lab », auteur : CoolPlay Lab