Comment les agents IA auto-apprenants se distinguent-ils des modèles traditionnels d'apprentissage automatique et des agents basés sur les LLM actuels ?

2026/05/02 07:21:02

Introduction

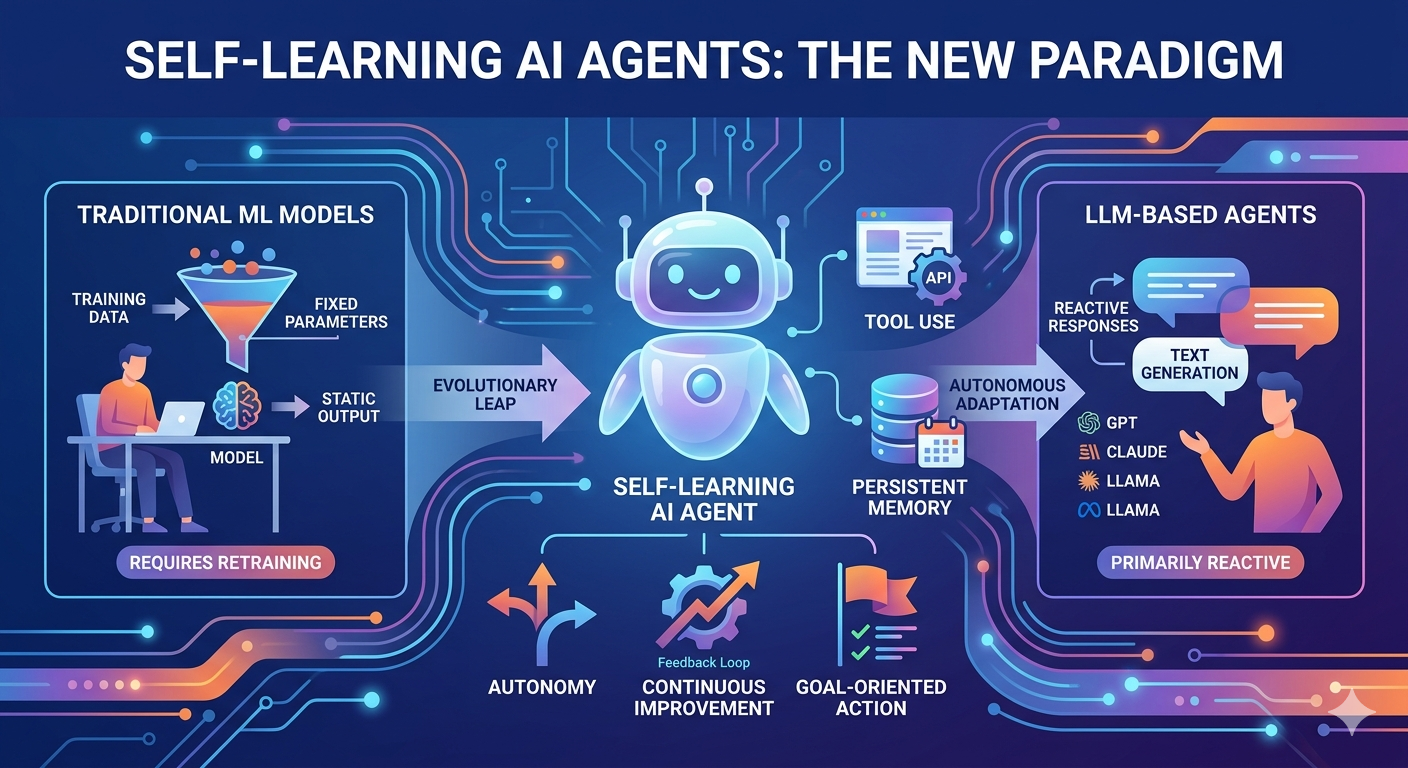

Le paysage de l'intelligence artificielle connaît une transformation profonde. Alors que les modèles d'apprentissage automatique traditionnels ont dominé la dernière décennie et que les grands modèles linguistiques ont capté l'attention du monde depuis 2022, un nouveau paradigme émerge qui modifie fondamentalement le fonctionnement des systèmes d'IA. Les agents d'IA auto-apprenants représentent le prochain saut évolutif, combinant autonomie, raisonnement adaptatif et amélioration continue d'une manière qui les distingue nettement de leurs prédécesseurs et des systèmes actuels basés sur des LLM. Comprendre ces différences est essentiel pour toute personne cherchant à naviguer dans l'écosystème d'IA en évolution rapide.

Qu'est-ce que les agents d'IA auto-apprenants ?

Les agents IA auto-apprenants sont des entités computationnelles autonomes capables de percevoir leur environnement, d'analyser des informations, de formuler des décisions et d'exécuter des actions pour atteindre des objectifs spécifiques. Contrairement aux systèmes d'IA classiques qui nécessitent une intervention humaine à chaque étape, ces agents autonomes peuvent recevoir un objectif de haut niveau et déterminer indépendamment comment l'accomplir. Ces agents combinent des capacités de perception, de raisonnement, d'apprentissage et d'action pour simuler un comportement intelligent auparavant observé uniquement dans les systèmes biologiques.

Les caractéristiques essentielles des agents d'IA auto-apprenants incluent l'autonomie, la réactivité, la proactivité et la capacité sociale. L'autonomie permet aux agents de fonctionner de manière indépendante sans intervention humaine continue. La réactivité leur permet de percevoir les changements environnementaux et d'y répondre de manière appropriée. La proactivité signifie qu'ils ne se contentent pas de réagir aux stimuli, mais poursuivent activement des objectifs grâce à la planification. La capacité sociale permet la collaboration avec d'autres agents dans des systèmes multi-agents afin d'accomplir des tâches complexes.

Selon les prédictions de Microsoft pour 2025 sur l'IA, les agents pilotés par l'IA gagnent en autonomie pour exécuter davantage de tâches, améliorant ainsi la qualité de vie dans de nombreux domaines. La distinction clé réside dans la manière dont ces agents gèrent les objectifs : tandis qu'un modèle de langage de grande taille nécessite un prompt détaillé et soigneusement élaboré pour produire une sortie de qualité, un agent d'IA n'a besoin que d'un objectif, et il réfléchit et exécute indépendamment les actions nécessaires.

Modèles d'apprentissage automatique traditionnels : structure et limites

Les modèles d'apprentissage automatique traditionnels représentent une approche fondamentalement différente de l'intelligence artificielle. Ces modèles sont généralement formés sur des jeux de données spécifiques pour effectuer des tâches étroites et bien définies, telles que la classification, la régression ou le regroupement. Une fois déployés, ils fonctionnent dans des paramètres fixes et ne peuvent pas modifier leur comportement en fonction de nouvelles expériences sans un re-entraînement explicite.

L'architecture des modèles d'ML traditionnels repose sur l'apprentissage statistique à partir de données historiques. Un modèle apprend des motifs pendant l'entraînement et applique ces motifs appris à de nouvelles entrées lors de l'inférence. Cette approche fonctionne exceptionnellement bien pour des tâches présentant des motifs clairs et des entrées cohérentes, telles que la détection de spam, la classification d'images ou les systèmes de recommandation. Toutefois, la nature statique de ces modèles crée des limites importantes dans des environnements dynamiques et imprévisibles.

Les modèles d'ML traditionnels nécessitent que des ingénieurs humains définissent les caractéristiques, sélectionnent les algorithmes et ajustent les hyperparamètres. Lorsque la distribution des données change ou que les exigences de la tâche changent, les modèles peuvent voir leur performance se dégrader et nécessiter un nouvel entraînement. Le processus d'apprentissage est essentiellement figé après le déploiement, ce qui signifie que ces systèmes ne peuvent pas s'améliorer grâce à l'expérience ni s'adapter à de nouvelles situations sans intervention explicite.

Les équipes de sécurité et de conformité utilisent couramment l'ML traditionnel pour la reconnaissance de motifs dans les données structurées, mais ces systèmes peinent face à des tâches exigeant une compréhension contextuelle ou un raisonnement en plusieurs étapes. Ils manquent de capacité à planifier, raisonner sur la causalité ou décomposer des problèmes complexes en sous-tâches plus petites et gérables.

Agents basés sur les LLM : capacités et contraintes actuelles

Les agents basés sur les modèles de langage à grande échelle actuels représentent une avancée majeure par rapport à l'apprentissage automatique traditionnel. Construits sur des modèles de langage à grande échelle comportant des milliards de paramètres, ces systèmes peuvent comprendre le langage naturel, générer un texte similaire à celui des humains et effectuer des tâches de raisonnement qui étaient auparavant impossibles pour l'IA. Des entreprises comme OpenAI, Anthropic et Google ont développé des modèles de plus en plus performants qui servent de fondement à de nombreuses applications d'IA aujourd'hui.

Les agents basés sur les LLM excellent dans la compréhension et la génération du langage naturel. Ils peuvent participer à des conversations significatives, résumer des documents, écrire du code et expliquer des concepts complexes. Le modèle o1 d'OpenAI, par exemple, démontre des capacités de raisonnement avancées qui lui permettent de résoudre des problèmes complexes en utilisant des étapes logiques similaires à l'analyse humaine avant de répondre à des questions difficiles.

Cependant, la plupart des agents basés sur les LLM actuels sont des systèmes fondamentalement réactifs. Ils répondent aux invites des utilisateurs, mais ne poursuivent pas activement des objectifs ni n'exécutent d'actions dans le monde. Lorsque vous interagissez avec un chatbot, le système génère une réponse en fonction de votre entrée et de ses données d'entraînement, mais il ne prend pas indépendamment d'étapes pour accomplir un objectif plus large sans guidance humaine continue.

Les limites des agents basés sur les LLM deviennent évidentes lorsque les tâches exigent un effort soutenu sur plusieurs étapes, une intégration avec des outils externes ou une adaptation en fonction des retours. Bien que ces modèles puissent raisonner sur des problèmes au sein d'une seule plateforme d'échange, ils manquent souvent de la capacité à maintenir un état entre les interactions, à exécuter des actions dans des systèmes externes ou à apprendre des résultats de leurs décisions.

Différences clés : Agents IA auto-apprenants vs ML traditionnel

Les différences entre les agents d'IA auto-apprenants et les modèles d'apprentissage automatique traditionnels portent sur l'architecture, les capacités et la philosophie opérationnelle. Comprendre ces distinctions éclaire pourquoi de nombreux experts considèrent les agents comme la prochaine frontière du développement de l'IA.

-

Apprentissage et adaptation

Les modèles d'ML traditionnels apprennent pendant une phase d'entraînement fixe, puis fonctionnent de manière statique. Un modèle de détection de fraude formé sur des données historiques de transactions appliquera les mêmes schémas indéfiniment, sauf s'il est reformaté. En revanche, les agents auto-apprenants peuvent apprendre en continu à partir de leurs interactions avec l'environnement. Ils observent les résultats de leurs actions, analysent ce qui a fonctionné et ce qui n'a pas fonctionné, et adaptent leurs stratégies en conséquence.

-

Autonomie et comportement orienté vers un objectif

Les modèles d'ML traditionnels sont des outils que les humains utilisent pour accomplir des tâches spécifiques. Ils ne poursuivent pas de buts de manière indépendante ; ils traitent simplement les entrées et produisent des sorties selon des modèles appris. Les agents autonomes sont des systèmes orientés vers un objectif qui peuvent recevoir des objectifs de haut niveau et déterminer le meilleur cours d'action pour les atteindre. Ils décomposent les objectifs complexes en sous-tâches, exécutent ces sous-tâches et ajustent leur approche en fonction de l'avancement.

-

Utilisation d'outils et interaction avec l'environnement

Les agents à apprentissage autonome peuvent interagir avec des outils externes, des API et des systèmes logiciels. Ils peuvent naviguer sur Internet, manipuler des fichiers, exécuter du code et interagir avec des bases de données. Les modèles d'ML traditionnels ne peuvent généralement pas faire cela ; ils sont limités aux entrées qu'ils reçoivent et aux sorties qu'ils génèrent au sein de leur propre graphe de calcul.

-

Compréhension contextuelle et planification

Alors que l'apprentissage automatique traditionnel excelle dans la reconnaissance de motifs dans les données structurées, les agents autonomes démontrent des capacités supérieures pour comprendre le contexte et planifier des solutions en plusieurs étapes. Un agent chargé de l'objectif d'organiser un voyage recherchera des destinations, comparera les prix, vérifiera la disponibilité et réservera les arrangements — des comportements impossibles pour un modèle de classification statique.

Différences clés : Agents IA auto-apprenants vs agents basés sur un LLM

La distinction entre les agents IA auto-apprenants et les agents basés sur les LLM actuels est subtile mais conséquente. Les deux peuvent utiliser des modèles de langage à grande échelle comme composants principaux, mais leurs architectures et modes de fonctionnement diffèrent considérablement.

-

Opération réactive vs proactive

Les agents basés sur les LLM les plus récents sont des systèmes réactifs qui génèrent des réponses à des invites. Un utilisateur pose une question et le modèle fournit une réponse. Les agents à apprentissage autonome, en revanche, peuvent agir de manière proactive. Étant donné un objectif, ils prennent l'initiative de recueillir des informations, d'établir des plans et d'exécuter des actions sans attendre une entrée humaine à chaque étape.

-

Gestion d'état et mémoire

Les LLM traditionnels traitent chaque conversation comme sans état, bien que certaines implémentations ajoutent des fenêtres de contexte. Les agents auto-apprenants intègrent des systèmes de mémoire sophistiqués qui conservent les informations entre les sessions, suivent les progrès vers les objectifs et permettent d'apprendre à partir des expériences passées. Cette mémoire persistante permet aux agents de s'appuyer sur les travaux antérieurs plutôt que de recommencer à zéro à chaque interaction.

-

Intégration d'outils et exécution d'actions

Les agents basés sur les LLM génèrent principalement du texte, même lorsque ce texte représente du code ou des commandes. Les agents à apprentissage autonome sont conçus pour exécuter réellement ces commandes et interagir avec des systèmes externes. L'Operator d'OpenAI et l'Computer Use de Claude représentent les premiers pas dans cette direction, permettant à l'IA de contrôler des navigateurs, des interfaces de ligne de commande et des applications logicielles.

-

Adaptation dynamique du flux de travail

Lorsqu'un agent basé sur un LLM rencontre un obstacle, il échoue généralement ou affiche un message d'erreur. Un agent auto-apprenant peut reconnaître lorsque sa première approche ne fonctionne pas, analyser pourquoi, et ajuster dynamiquement sa stratégie. Cette capacité à itérer et à s'adapter est essentielle pour gérer des tâches complexes du monde réel qui rarement se déroulent exactement comme prévu.

L'architecture des agents auto-apprenants

Comprendre ce qui distingue les agents d'apprentissage autonome nécessite d'examiner leur architecture sous-jacente. Ces systèmes combinent plusieurs composants qui travaillent ensemble pour permettre un comportement autonome et adaptatif.

-

Moteur de planification et de raisonnement

Au cœur d'un agent auto-apprenant se trouve un moteur de raisonnement, généralement alimenté par un modèle de langage à grande échelle, capable de décomposer des objectifs complexes en étapes actionnables. Ce moteur permet à l'agent de planifier, de raisonner sur la causalité et d'évaluer les résultats des actions potentielles. La recherche de Microsoft indique que les méthodes d'entraînement et les capacités des agents peuvent créer des effets synergiques, les modèles améliorés permettant des agents plus efficaces.

-

Systèmes de mémoire

Les agents auto-apprenants maintiennent plusieurs types de mémoire : une mémoire de travail à court terme pour les tâches actuelles, une mémoire à long terme pour les connaissances persistantes et une mémoire épisodique pour les expériences passées. Ces systèmes de mémoire permettent aux agents d'apprendre à partir des retours, de se souvenir des stratégies réussies et d'éviter de répéter les erreurs. La sophistication de ces systèmes de mémoire distingue les agents véritablement auto-apprenants des systèmes réactifs plus simples.

-

Utilisation d'outils et intégration d'API

Les agents sont dotés de la capacité d'appeler des outils externes, d'accéder à des bases de données, de naviguer sur le web et d'interagir avec des applications logicielles. Cette capacité d'utilisation d'outils étend la portée de l'agent au-delà de la simple génération de texte pour inclure des actions dans le monde réel. L'agent peut sélectionner les outils appropriés en fonction de la tâche, exécuter les appels d'outils et intégrer les résultats dans son raisonnement.

-

Commentaires et mécanismes d'apprentissage

Peut-être que la caractéristique la plus distinctive des agents auto-apprenants est leur capacité à apprendre de l'expérience. Lorsqu'un agent tente une tâche, il peut évaluer le résultat, identifier ce qui n'a pas fonctionné et modifier son approche pour les tentatives futures. Ce apprentissage peut se produire par divers mécanismes, notamment l'apprentissage par renforcement, la réflexion sur soi et le raffinement itératif.

Applications et implications du monde réel

Les capacités uniques des agents d'IA auto-apprenante permettent de nouveaux usages à travers les industries. Microsoft indique que près de 70 % des employés du Fortune 500 utilisent déjà les agents Microsoft 365 Copilot pour gérer des tâches quotidiennes répétitives telles que le filtrage des e-mails et la prise de notes lors des conférences Teams.

Dans la gestion de la chaîne d'approvisionnement, les agents peuvent prédire les changements de demande en inventaire à partir de données historiques et d'informations en temps réel, en ajustant les plans d'approvisionnement et de production pour éviter les ruptures de stock ou les surstocks. Dans le domaine de la santé, les agents peuvent analyser les cas de patients, fournir des suggestions diagnostiques et assister à la planification des traitements en traitant d'immenses quantités de littérature médicale et de dossiers patients.

Les implications vont au-delà des gains d'efficacité. Les agents auto-apprenants transforment la manière dont le travail intellectuel est effectué. Plutôt que les humains apprennent à utiliser des outils d'IA, le paradigme évolue vers des agents d'IA qui apprennent à aider les humains de manière plus efficace. Cela représente un changement fondamental dans la relation homme-IA, passant de l'homme qui opère des outils à l'homme qui supervise et collabore avec des agents autonomes.

Comment les organisations peuvent-elles se préparer à l'ère des agents ?

Les organisations cherchant à utiliser des agents d'IA auto-apprenants devraient commencer par identifier des cas d'utilisation à forte valeur ajoutée où les capacités des agents offrent des avantages significatifs par rapport aux approches traditionnelles. Les tâches impliquant des processus en plusieurs étapes, l'intégration de systèmes externes ou des environnements dynamiques sont des candidats idéaux pour le déploiement d'agents.

L'infrastructure technique doit évoluer pour soutenir le fonctionnement des agents. Cela inclut des intégrations API robustes, un accès sécurisé aux outils et des systèmes de surveillance capables de suivre les performances des agents et de détecter les problèmes. Les organisations doivent également établir des cadres de gouvernance qui définissent les limites appropriées de l'autonomie des agents tout en garantissant la conformité avec les réglementations en vigueur.

Investir dans la compréhension des agents à travers l'organisation devient essentiel à mesure que ces systèmes deviennent plus répandus. Les employés doivent comprendre comment les agents fonctionnent, comment fournir un accompagnement efficace, et comment évaluer et améliorer les résultats des agents. Ce changement exige non seulement un investissement technique, mais aussi une adaptation culturelle.

Conclusion

Les agents IA auto-apprenants représentent une avancée fondamentale des capacités de l'intelligence artificielle. Contrairement aux modèles d'apprentissage automatique traditionnels, qui sont statiques et spécifiques à une tâche, les agents peuvent s'adapter, planifier et exécuter des flux de travail complexes de manière autonome. Par rapport aux systèmes actuels basés sur les LLM, les agents ajoutent une opération proactive, une mémoire persistante et la capacité d'effectuer des actions dans le monde réel grâce à l'intégration d'outils.

La transition de l'IA réactive aux agents autonomes marque un changement de paradigme comparable au passage de l'IA étroite à la compréhension générale du langage. Les organisations qui comprennent ces différences et s'y préparent en conséquence seront les mieux placées pour exploiter le potentiel transformateur des agents auto-apprenants. L'ère des agents n'approche pas — elle est déjà là, en train de redéfinir la manière dont le travail est accompli et ce que l'IA peut accomplir.

FAQ

Quelle est la principale différence entre les agents IA et les modèles d'apprentissage automatique traditionnels ?

Les modèles traditionnels d'apprentissage automatique apprennent des motifs pendant l'entraînement et les appliquent de manière statique aux nouvelles entrées, nécessitant un réentraînement pour s'adapter. Les agents d'intelligence artificielle auto-apprenants peuvent apprendre en continu à partir de l'expérience, s'adapter à de nouvelles situations et fonctionner de manière autonome sans intervention humaine constante ni réentraînement.

Les agents d'IA auto-apprenants peuvent-ils remplacer les chatbots actuels basés sur les LLM ?

Les agents IA et les LLM remplissent des rôles différents et sont souvent complémentaires plutôt que concurrents. Les LLM excellent dans la compréhension et la génération du langage, tandis que les agents apportent de l'autonomie, des capacités d'action et un apprentissage adaptatif. De nombreux agents utilisent en réalité les LLM comme moteur de raisonnement tout en ajoutant des couches pour la planification, la mémoire et l'utilisation d'outils.

Les agents d'intelligence artificielle à apprentissage autonome nécessitent-ils plus de ressources informatiques que les modèles d'apprentissage automatique traditionnels ?

Les agents auto-apprenants nécessitent généralement plus de ressources informatiques en raison de leur complexité, de la gestion persistante d'état et de modèles sous-jacents souvent plus volumineux. Toutefois, les gains d'efficacité issus de l'opération autonome et de la réduction du besoin de supervision humaine peuvent compenser ces coûts dans de nombreuses applications.

Comment les agents à apprentissage autonome gèrent-ils les erreurs et les défaillances ?

Les agents autonomes peuvent reconnaître lorsque leur approche ne fonctionne pas, analyser les raisons de l'échec et ajuster dynamiquement leur stratégie. Cette capacité d'affinement itératif leur permet de gérer mieux que les systèmes statiques les situations imprévisibles, bien qu'une gestion robuste des erreurs et une supervision humaine restent importantes.

Les agents d'IA auto-apprenants sont-ils sûrs pour une utilisation professionnelle ?

Lorsqu'ils sont correctement conçus avec des garde-fous appropriés, les agents auto-apprenants peuvent être déployés en toute sécurité dans les environnements professionnels. Les organisations doivent établir des limites claires pour l'autonomie des agents, mettre en place des systèmes de surveillance et maintenir une supervision humaine pour les décisions critiques. L'essentiel est d'équilibrer les capacités des agents avec des cadres de gouvernance appropriés.

Avertissement : Pour votre confort, cette page a été traduite à l'aide de la technologie IA (GPT). Pour obtenir les informations à la source, consultez la version anglaise originale.