Nakabuhay ba ng isang kumpanya ng banyo ang AI?

Ang Japanese high-end smart toilet company na si TOTO, ang kanyang presyo sa mga stock ay tumaas sa nakaraang ilang buwan dahil sa AI, hindi dahil mas maraming benta ang mga toilet, kundi dahil mayroon itong lihim na negosyo: mataas na kalinisan na ceramic electrostatic chuck, isang mahalagang consumable gamit sa paggawa ng chip upang i-fix ang wafer, at sinasagot ng TOTO ang precision hanggang 1/80 ng kapal ng buhok, na may pinakamataas na kalinisan sa industriya.

Dahil sa pagtaas ng pangangailangan sa mga chip para sa pag-iimbak at ang pagsisikap ng mga supplier sa itaas na palawakin ang produksyon, naging kritikal na pangangailangan ang negosyong ito. Dahil dito, ang mga investment bank tulad ng Goldman Sachs ay nag-upgrade sa kanilang rating sa presyo ng TOTO—ang dahilan ay simple: ang mga order para sa electrostatic chucks ay naka-book na hanggang 2027. Ngayon, ang negosyong ito ay nagbibigay ng higit sa apat na porsyento ng net profit ng TOTO.

Kapag isang kumpanya ng banyo ay naging isang AI-related stock, makikita mo kung gaano karami ang kalupitan ng sector ng AI storage ngayon. Sa likod ng pagsabog ng presyo ng mga pangunahing player sa industriya ng storage tulad ng Samsung, SK Hynix, Micron, at SanDisk ay ang global na pagkakaroon ng pinakamalaking pagkakaiba sa supply at demand sa mga chip ng storage sa loob ng apat na dekada.

Sa artikulong ito, susuriin natin ang kasalukuyang “super cycle” ng storage, at sasamahan natin ang mga eksperto mula sa Samsung at mga investor mula sa Wall Street upang talakayin: Bakit iba ang cycle na ito kumpara sa mga nakaraan, bakit mahalaga ang storage sa industriya ng AI, paano nila tinatanggal ang kanilang pagkakasalalay sa storage ang mga malalaking kompanya sa AI tulad ng Google, at gaano katagal pa ito magtatagal at paano ito nakakaapekto sa atin?

01 Pagtaas ng higit sa 1800%: Ang HBM, mas mahal kaysa sa ginto

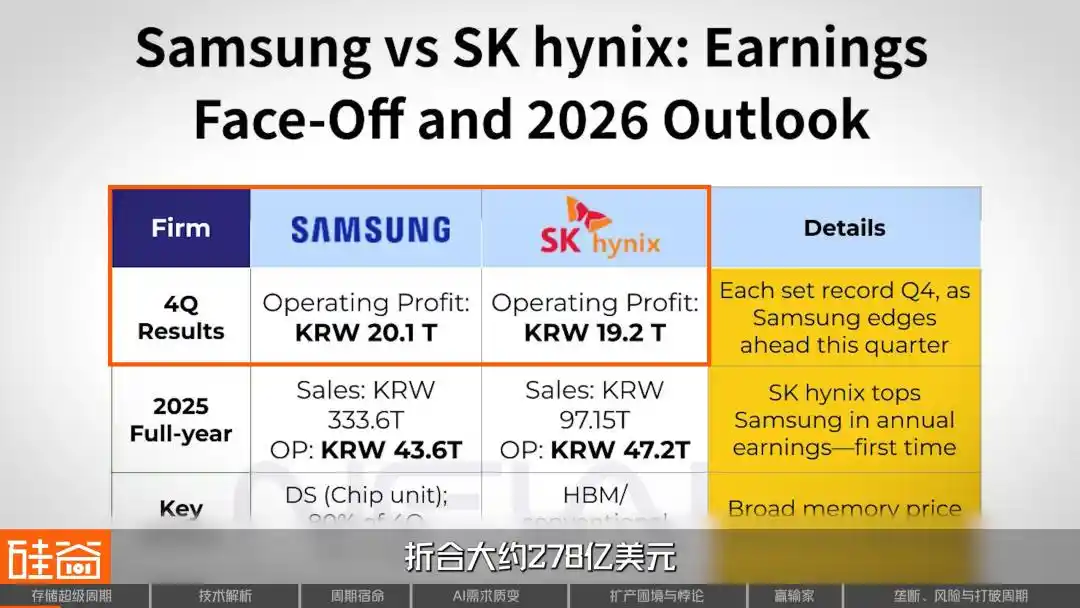

Sa huling buwan ng Enero 2026, parehong inilabas ng dalawang pangunahing kumpanya sa pag-iimbak ng Timog Korea, Samsung Electronics at SK Hynix, kanilang quarterly financial report para sa ikaapat na kuartal ng nakaraang taon. Gaano karami ang mga numero? Kasama, ang kanilang kabuuang operasyonal na kita ay malapit sa 40 trilyon na Korean won, o halos $27.8 bilyon, na katumbas ng $300 milyong kita araw-araw. Sa ganitong nakakatandaan na kita, ang year-end bonus ng SK Hynix ay umabot sa 640,000 yuan Tsino bawat empleyado, na nagtatapos ng kasaysayan ng kumpanya.

Ang pangunahang produkto na nagpapakita ng lahat ng ito ay ang HBM (High Bandwidth Memory) chip. Isang HBM na may laki ng kahit anong dulo ng daliri, nagkakahalaga ng $400 hanggang $500—mas mahal pa kaysa sa ginto na may parehong timbang. At sa buong mundo, mayroon lang tatlong kumpanya na makakagawa nito: si SK Hynix ay may higit sa 60%, habang ang Samsung at Micron ay may bawat 20%.

Ngunit ang HBM ay kahit na lang bahagi ng isipan, ang tunay na nagdulot ng pagkabahala sa buong industriya ay ang pagkabigo sa lahat ng antas, mula sa mataas hanggang sa mababang, mula sa DRAM hanggang sa NAND.

Mula sa huling bahagi ng 2024 hanggang Disyembre 2025, ang average na presyo sa spot ng DDR5 (16GB) ay tumataas mula sa $4.60 patungo sa $28, isang pagtaas ng higit sa 500%; ang mas lumang DDR4 naman ay tumalon mula sa $3.20 patungo sa higit sa $62, na may kabuuang pagtaas ng halos 1,800%; ang 64GB server memory module para sa data center, noong nakaraang kalahati ng taon, ay tumataas mula sa $255 patungo sa $700, isang pagtaas ng halos 175%.

Ang lahat ng kapasidad ni SK Hynix para sa 2026 ay naka-iskedyul na, habang tinataasan ng Samsung ang presyo ng supply ng NAND flash sa unang kuartal ng 2026 ng 100%, na nagdudulot ng pagdoble.

Candice Hu

Manager para sa Marketing ng Mga Produkto ng Storage ng Samsung

Kasalukuyang nakikita natin na ang spot price ng DRAM ay lumampas na sa pinakamataas na spot price noong panahon ng cloud noong 2016-2018. Ang ating kakulangan ay ang lahat ng produksyon para sa 2026 ay naka-book na na, at malamang ay parehong naka-book na ang 2027. Ang aming quote para sa SSD para sa mga pangunahing GPU provider ay napakalaking tumaas—nag-doble sa loob ng isang linggo.

Samantala, lumabas ang isang mas makabuluhang signal. Sinabi ng SanDisk sa CES noong simula ng 2026 sa Wall Street: sila ay nagpapakilos ng isang bagong uri ng mahabang panahong pagpapadala na kasunduan—LTA (long term agreement)—at ang mga kliyente ay kailangang magbigay ng advance payment, at hindi babalik ang pera kung sira ang kasunduan. Ito ay unang beses na nangyayari sa kasaysayan ng industriya ng pag-iimbak sa loob ng dekada-dekada.

Rob Li

New York Amont Partners Managing Partner

Hindi walang nakaraan ang Long-term agreement (LTA, matagalang kasunduan sa pagbibigay), ngunit sa mga nakaraang dekada, walang anumang epekto ang LTA. Kapag pumasok ang merkado sa isang pagbaba, sabihin ng kliyente na hindi nila ito aaminin, kung hindi ito aaminin ng kliyente, walang maaari mong gawin sa kanya.

At sa pagkakataong ito, nagbago ang tono. Ang mga malakas na tagapagbigay ng imbakan ang nagtatag ng mga bagong patakaran.

Rob Li

New York Amont Partners Managing Partner

Sinabi ng SanDisk sa Wall Street o sa merkado: Ang mga LTA na nilalagdaan namin ngayon sa mga kliyente ay magkakaiba nang malaki mula sa nakaraan. May bisa ito sa batas, at kailangan ng mga kliyente na magbigay ng advance payment sa amin; kung nagbigay ka ng advance payment at gusto mong umalis sa huli, hindi mo mababawi ang advance payment mo kung hindi mo ito binayad sa presyong ito.

Ang pagtataya ni Rob ay kung ang SanDisk ay makakagawa nito, walang dahilan kung bakit hindi makakagawa ang iba pang tatlong pangunahing kumpanya—SK Hynix, Samsung, at Micron. Sa ganitong sitwasyon, malamang na magpapatuloy ang buong super cycle hanggang 2027.

02 Buong pananaw ng产业链: Paano gumagana ang industriya ng pag-iimbak?

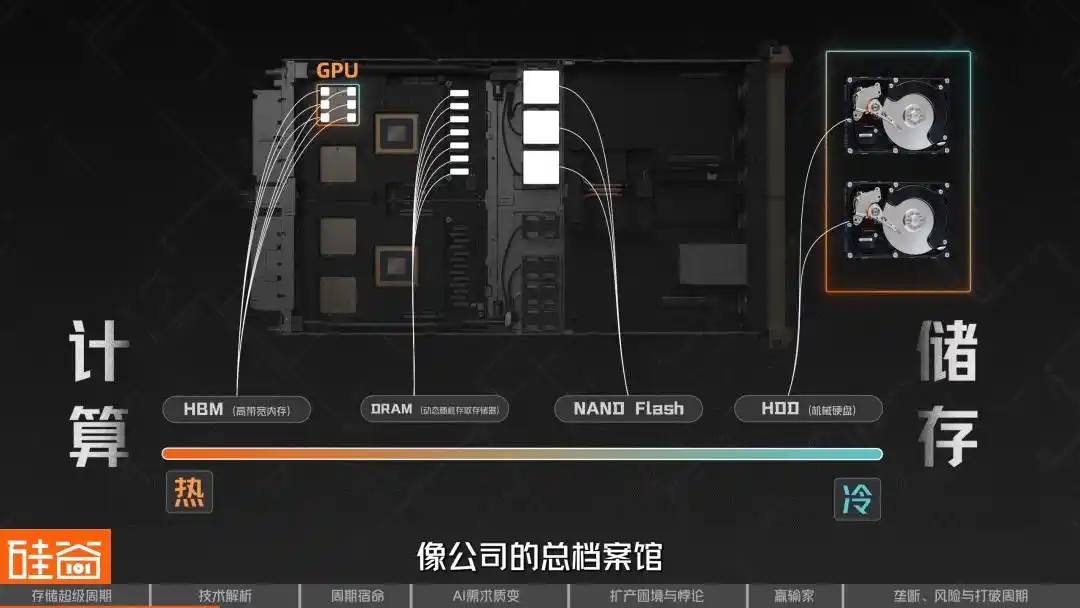

Sa industriya ng pag-iimbak, maaari nating hatiin ito sa mainit at malamig; mas mainit ito kapag mas malapit sa pagkalkula, at mas malamig ito kapag mas nakatuon sa pag-iimbak lamang.

Kaya ang pinakamainit ay ang DRAM (Dynamic Random-Access Memory), ang pinakamalapit na memorya sa computation, na maaaring maunawaan bilang ang “runtime memory” ng computer at mobile phone; habang gumagana ang chip, kailangan muna i-load ang data sa DRAM bago ito ma-process. Ang karakteristikanya ay sobrang mabilis, ngunit nawawala ang data kapag nawala ang kuryente, at ito ay isang “short-term memory”.

Sa pagkakasunod-sunod, ang HBM (High Bandwidth Memory) ay isang espesyal na evolusyon ng DRAM. Ipinagsasama nito ang maraming layer ng DRAM chip gamit ang teknolohiya ng Through-Silicon Via (TSV), at pinapalapit sa parehong base sa pamamagitan ng advanced packaging kasama ang GPU, na nagdudulot ng malaking pagtaas sa bandwidth.

Dito nagmumula ang pagkakaroon ng HBM sa lahat ng pinakamataas na chip para sa pag-train ng AI, kahit ito ay GPU ng NVIDIA o TPU ng Google—ito ang pinakamaliwanag at pinakakakulang na produkto sa siklo na ito.

Sa loob ng pamilya ng DRAM, mayroong malawak na uri. Kasama rito ang GDDR (para sa mga graphics card), Low-Power DDR (LPDDR para sa mga mobile phone at laptop), atbp.—ang iba’t ibang aplikasyon ay may sariling mga produkto. Hindi ibig sabihin na isang DRAM chip lang ang makakasagot sa lahat ng device; ang HBM na ginagamit sa NVIDIA GPU at ang LPDDR sa iyong mobile phone, bagaman parehong DRAM, ay may iba’t ibang proseso ng paggawa, paraan ng pagpapakete, at mga performance specs.

Sa kabilang dulo ng “malamig” ay ang NAND. Kung ang DRAM ay ang maikling memorya, ang NAND Flash ay ang matagal na memorya. Hindi ito nagkakaroon ng pagkawala ng data kahit walang kuryente, at ito ang pangunahing bahagi ng ating araw-araw na solid-state drive (SSD), storage ng mobile phone, at U-disk. Ang mga litrato na iyong iniiwasan sa mobile phone at mga laro na iyong i-install sa computer, lahat ay nasa NAND.

Ang papel ng NAND ay patuloy na umuunlad sa panahon ng AI. Noong una, ito ay simpleng “imbakan” na responsable sa pangmatagalang pag-iimbak ng data, ngunit ngayon ang NAND ay umuunlad mula sa likod na imbakan patungo sa harap na imbakan ng mga armas.

Sa mas malamig na direksyon, nandito ang tradisyonal na mechanical hard disk drive (HDD), na gumagamit ng pag-ikot ng disk para basahin at isulat ang data—mabagal ngunit murang may malaking kapasidad, at kasalukuyang ginagamit pangunahin sa cold storage at archival sa data centers.

Dahil sa pagtaas ng kahilingan sa mga antas ng imbakan para sa AI inference, ito ay nagsisimula nang mukhang isang sistemang imbakan na may mga antas. Ang mga data na pinakamadaming kailangan ay nasa HBM, parang nakalagay sa tabi; ang karaniwang data ngunit hindi gaanong kailangan ay nasa DRAM, parang nasa lalagyan ng mesa; ang mas malalim at pambansang data ay nasa NAND/SSD, parang nasa kabinet ng opisina; at ang mga malaking datos na nakalikom sa matagal at kailangan ng maraming tao para gamitin ay nasa likod na malaking shared storage, parang pangkalahatang arkibo ng kumpanya.

Rob Li

New York Amont Partners Managing Partner

Mas nakakatulong ang AI sa mga mainit na bagay, at kailangan din ito para sa pag-iimbak. Gumawa ako ng maraming imahe at video gamit ang AI, at batay sa mga batas ng iba’t ibang bansa, hindi ito maaaring tanggalin—kailangan itong panatilihin, kaya't malaki ang epekto nito sa pagtaas ng pangangailangan para sa pag-iimbak. Ngunit ang pinakadirektang epekto nito sa unang hakbang ay siguradong kaugnay sa pagkalkula; mas malapit ang isang tao sa pagkalkula, mas malinaw ang kanyang panahon-kabuuang kita.

Susunod, ipapaliwanag natin ang mga kalahok sa buong产业链 ng pag-iimbak.

Ang pinakamataas na antas ay ang mga materyales at wafer, tulad ng SUMCO mula sa Japan, na isa sa mga pinakamahalagang tagapagbigay ng semiconductor wafer sa buong mundo. Sa proseso ng paggawa, ang mga pangunahing tagapagbigay ng kagamitan ay kasama ang ASML, ang lider sa lithography machines, at ang Tokyo Electron, na nakakapag-ugnay sa mga proseso tulad ng coating at developing, deposition, etching, at cleaning.

Samantay, sa antas ng disenyo ng chip bago ang paggawa, ang mga kumpanya tulad ng Cadence at Synopsys na nag-aalok ng EDA, pag-verify, at design IP ay parehong mahalaga; habang ang mga kumpanya ng interface IP tulad ng Rambus ay naglalaro ng mahalagang papel sa mga mataas na bilis na arkitektura ng memorya tulad ng HBM—kahit na hindi sila gaanong nakikita kaysa sa GPU, sila ay mga super kailangan sa kamakailang super cycle na dinudulot ng AI.

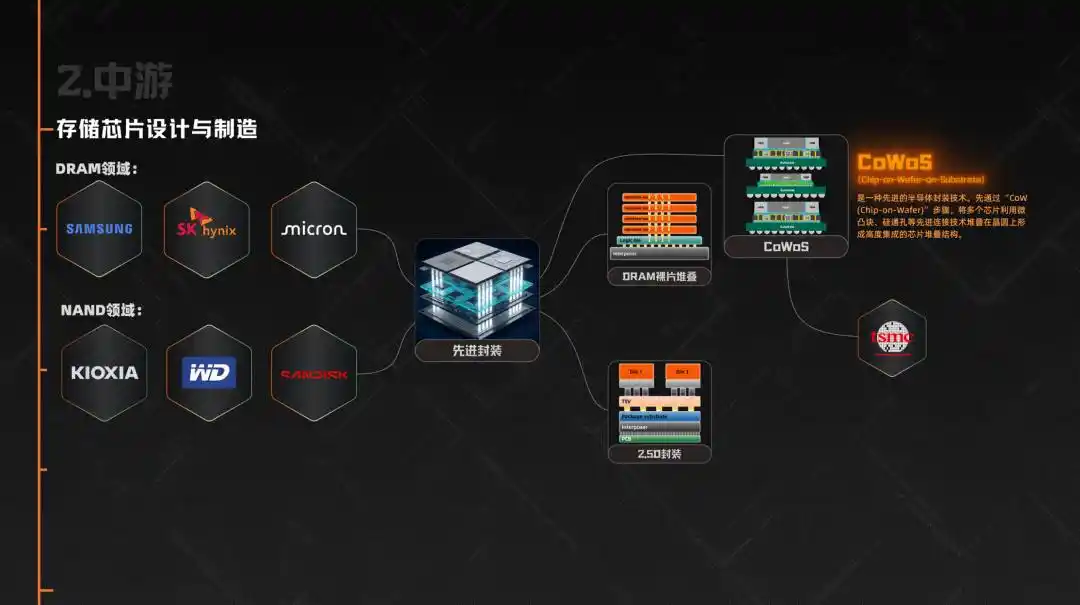

Ang midstream ay ang disenyo at paggawa ng memorya chip. Sa larangan ng DRAM, ang Samsung, SK Hynix, at Micron ay nagtataglay ng 95% ng global na market share. Sa larangan ng NAND, kasama sa mga ito ang Kioxia, Western Digital, at SanDisk.

Ang sumusunod ay ang mahalagang bahagi sa siklo na ito—ang advanced packaging. Dahil hindi lamang nagtatapos ang HBM sa paggawa ng DRAM, kailangan muna itong i-stack ang maraming layer ng DRAM die, at pagkatapos ay i-integrate sa GPU o iba pang AI accelerator gamit ang 2.5D packaging. Dahil dito, ang CoWoS, isang teknolohiya sa semiconductor packaging, ay naging isa sa pinakamahalagang bottleneck sa supply chain ng AI chip, na direktang naglimita sa aktwal na paglabas ng HBM, at ang kapasidad ng CoWoS ay pangunahing binibigay ng TSMC.

Ang mga terminal application ay kinabibilangan ng mga data center at cloud providers, tulad ng Microsoft, Google, Amazon, at ByteDance, na kasalukuyang ang pinakamalaking mga sponsor; susunod ay ang mga manufacturer ng mobile phone (Apple, Samsung, Xiaomi, OPPO), mga manufacturer ng PC (Lenovo, Dell, HP), mga manufacturer ng kotse (Tesla, Li Auto, NIO), pati na rin ang mga game console at industrial equipment.

Kaya makikita mo na, bagaman ang buong chain ay napakahaba, ang tunay na kapangyarihan sa pagtatakda ng presyo ay malalim na nakatuon sa tatlong gitnang kumpanya: Samsung, SK Hynix, at Micron. Sila ang nagdedesisyon kung anong produkto ang gagawin, kinsa ang sasakupin, at sa anong presyo ito ibebenta. At sa kasalukuyang merkado kung saan ang suplay ay mas maliit kaysa sa pangangailangan, ang kanilang kakayahan sa negosasyon ay walang katulad.

03 Bakit laging may malaking pagtaas at pagbaba: Ang natural na siklo ng industriya ng pag-iimbak

May isa pang malaking katangian sa industriya ng pag-iimbak, na ang siklikalidad. Batay sa kasaysayan, laging umuulit ito sa pagitan ng “malaking pagtaas” at “malaking pagbaba.” May dalawang dahilan sa likod nito, isa ay pisika, at isa ay ekonomiya.

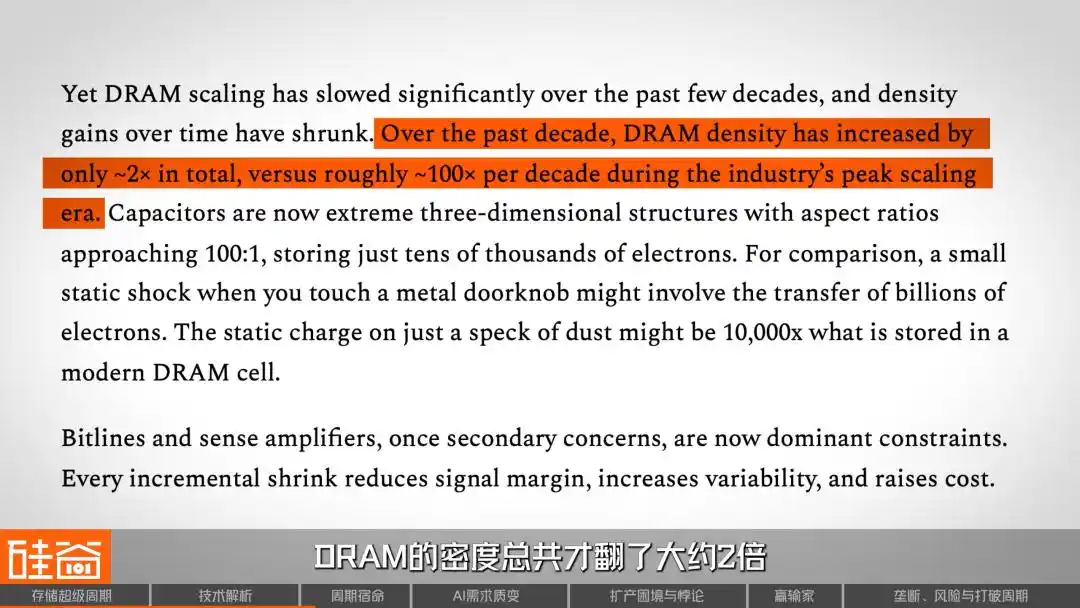

Una, ang pisika. Ang DRAM, o ang “memory sa pagpapatakbo” sa mga cellphone at computer, ay nagtatago ng data sa pamamagitan ng pag-iimbak ng karga. Sa loob ng ilang dekada, ang mga inhinyero ay patuloy na ginagawang mas maliit at mas marami ang bawat unit ng pag-iimbak upang pataasin ang densidad. Sa kanyang pinakamataas na punto, ang densidad ng DRAM ay nakakadoble ng 100 beses bawat sampung taon.

Ngayon naman, ayon sa ulat ng SemiAnalysis, ang densidad ng DRAM ay tumaas lamang ng halos 2 beses sa nakaraang sampung taon, habang dati ay 100 beses bawat sampung taon—nagkakaroon na ng malaking pagbagsak sa pag-scaled. Ibig sabihin nito, ang pagbaba ng gastos sa mga chip ng memorya ay hindi na “awtomatikong” nangyayari dahil sa teknolohikal na pag-unlad tulad noon, kundi mas maraming naka-ugnay sa pagtaas o pagbaba ng kapasidad at sa paglalaban ng suplay at demand.

Tungkol naman sa ekonomiks, ang paggawa ng memory chip ay isa sa mga pinakamataas na kapital-density na industriya sa buong mundo; ang pagtatayo ng isang modernong fab ay maaaring magkakahalaga ng milyon-milyon hanggang daan-daang milyon dolyar, at kumukuha ng dalawa o tatlong taon para makumpleto. Ang mga pondo na ito ay naging sunk cost, kaya kahit na mababa ang demand, mas pipiliin ng mga prodyuser na patuloy na magproduksyon dahil mas malaki ang pagkawala kung hindi sila gumagana.

Mas masama pa, ang modelo ng industriya ng pag-iimbak ay “gawin muna, biliin pagkatapos,” na lubos na iba sa lohika ng TSMC na “kunin ang order muna, pagkatapos ay palawakin ang produksyon.” Kailangan ng mga producer ng pag-iimbak na mag-antos kung gaano karami ang hinaharap na pangangailangan at magplano ng kapasidad nang dalawa o tatlong taon na ang nakalipas. Kung tama ang pag-antos, masaya lahat; kung mali, isang kalamidad.

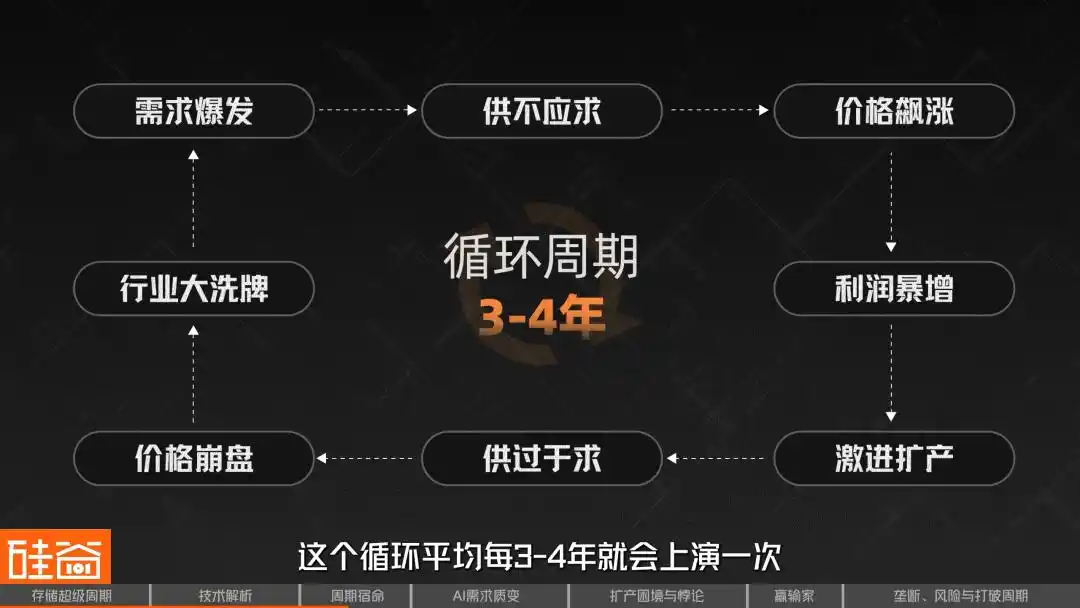

Ang structural na kontradiksyong ito ay naglikha ng klasikong siklo na paulit-ulit na nangyayari sa industriya ng pag-iimbak: pag-usbong ng demand → kakulangan sa suplay → pagtaas ng presyo → pagtaas ng kita → agresibong pagpapalawak ng produksyon → sobrang suplay → pagbaba ng presyo → malaking pagbabago sa industriya. Sa nakaraang 30 taon, ang siklo na ito ay nangyayari tuwing 3 hanggang 4 taon, at hindi nagkakamali.

Bilang resulta, mula sa higit sa 20 mga supplier ng DRAM sa buong mundo noong dekada 1990, natira na lang ang tatlong malalaking kompanya at ang mga tagapagpabilis tulad ng ChangXin sa China. Sa bawat siklo, may mga nagkawala—tulad ng bankruptcy ng Germany na Qimonda at ang pagtatanggal ng Japan na Elpida. Ang mga dugo't luha na aral na ito ay nagbigay ng malalim na paggalang sa buong industriya sa salitang “siklo.”

Sa kasaysayan ng industriya ng pag-iimbak sa nakalipas na ilang dekada, mayroong apat na siklo.

Ang unang beses ay noong 1993, sa simula ng Windows PC. Ang pagkakaroon ng graphical interface ay nagdulot ng malaking pagtaas sa pangangailangan sa memorya, samantalang ang supply ay may malubhang kakulangan sa kapasidad, na nagresulta sa pagtaas ng presyo. Bilang tugon, itinayo ng buong mundo ang halos 50 bagong pabrika, ngunit matapos ang sobrang kapasidad, bumagsak ang presyo, at maraming mga player ang natalo.

Ikalawang pagkakataon ay noong 2010, ang panahon ng smartphone at cloud computing. Ang iPhone at Android ay nagdulot ng malaking paglago, at ang server DRAM ay tumalon mula sa maraming GB hanggang sa mga sampu't maraming GB. Ngunit ang pagpapabilis ng standardisasyon ay nagdulot ng mas mabilis na komoditizasyon, kaya't mahirap para sa mga supplier na makabuo ng pagkakaiba, at resulta nito, ang siklo na ito ay mas maikli kaysa sa inaasahan.

Ikatlong pagtaas ay nangyari mula 2017 hanggang 2018. Ang mga cloud provider ay nag-upgrade sa kanilang data centers, naglalagay ng higit pang DRAM sa bawat server, at dahil mas mahal at mas kita ang server memory kumpara sa consumer-grade, ang gross margin ng tatlong pangunahing kumpanya ay tumama sa kanilang pinakamataas na antas sa kasaysayan. Ngunit ang mataas na kita ay nagpalakas ng pagpapalawak ng produksyon, at pagkatapos makarating sa peak na demand, bumalik ang industriya sa pagbaba noong huling bahagi ng 2018.

Ang ikaapat ay noong 2020 hanggang 2021, ang hindi inaasahang pag-unlad na dulot ng pandemya. Ang pagtatrabaho mula sa bahay at ang biglaang pagtaas ng paggamit sa cloud ay nagdulot ng masidhing pagdu-duplicate ng order na naglikha ng pekeng demand; pagkatapos ng pagbaba, malaki ang timbangan ng inventory, at sumunod ang malubhang pagbaba noong 2022 hanggang 2023. Mula noon, ang kakayahan sa produksyon ay malaki ang bawasan, ngunit ang panahong ito ay nagtanim ng mga puno para sa kasalukuyang kakulangan. Pumasok na tayo sa 2025, at ang buong industriya ay muli ay malubhang kulang sa kakayahan sa produksyon.

Ano kaya ang pangunahing aral na ibinigay ng kasaysayan? Ang mga tinatawag na super cycle sa nakaraan ay hindi kailanman nagtrabaho nang higit sa dalawang taon; lahat ay “mataas na kita → pagsisikap na palawakin ang produksyon nang walang hanggan → sobra → pagbagsak”—ito ang patuloy na batas sa nakalipas na apat na dekada. Pagkatapos ng maraming siklo, mayroon ang mga investor at propesyonal ang isang malalim na nakapaloob na tugon: mas mabilis ang pagtaas, mas mabilis ang pagbagsak.

Ngunit sa pagkakataong ito, patuloy na lumalala ang mga ebidensya na maaaring sirain ang mga nakaraang pattern.

04 Bakit iba ito ngayon: Ang kwalitatibong pagbabago sa pangangailangan mula sa pagtuturo hanggang sa pagpapagana

4.1 Magsimula muna sa isang pinakasimpleng intuisyon

Bago nating pag-usapan ang mga kumplikadong modelo ng suplay at demand, unang mabuo natin ang pinakasimpleng lohika. Bawat araw, binubuksan mo ang ChatGPT o Gemini, i-upload ang iyong mga file, i-save ang mga usapan, at pinapayagan ang AI na tandaan ang iyong mga preferensya—hindi mo maaaring maunawaan na bawat interaksyon ay nagkakahalaga ng mga yunit ng storage. Hindi lamang ito pagkalkula sa server side, kundi pati na rin ang malaking dami ng memorya at flash memory.

Kasalukuyan, ang karamihan sa mga gumagamit ng AI ay walang katapatan—sino ang may mabuting modelo at mas mura, siya ang gagamitin. Ngunit isipin mo kung isang araw ay talagang “naiintindihan” na ng iyong AI assistant ang iyo, tandaan ang iyong mga gawain, mga paboritong paraan ng pagsasalita, at mga detalye ng proyekto na pinag-usapan mo noong tatlong buwan ang nakalipas—magkakaroon pa ba kayo ng pag-iisip na palitan ang platform?

Ang "pagkakadikit ng memorya" na ito ay ang pangunahing sandata ng mga kumpanya ng malalaking modelo sa pagbuo ng kanilang paligid, at ang mga imprastruktura sa hardware na sumusuporta sa pagkakadakit na ito ay ang pag-iimbak, ang malawak at maraming antas na pag-iimbak.

May isa pang lohikal na pag-iisip na magkakasabay: patuloy na lumalakas ang mga video model, at ang AI-generated video ay malapit na sa pagiging praktikal. At ang dami ng video data ay ilang sampu hanggang daan-daang beses ang laki ng text data, kaya ang pangangailangan sa storage ay magkakaroon ng eksponensyal na pagtaas.

Rob Li

New York Amont Partners Managing Partner

Ang memorya ay parang isang maliit na panyo, dati ay kalkulatin natin ang 1+1=2, kaya hindi mo kailangan ng isang malaking panyo, sapat na ang isang karaniwang panyo. Ngunit nang dumating ang panahon ng AI, ang intensity at kumplikado ng kalkulasyon ay naging mataas at may maraming hakbang. Kung ako ay isang maliit na panyo, bawat beses mong isusulat at iiwanan, sasagutin mo muli at iiwanan muli, kung may 100 hakbang na kalkulasyon, kailangan mong mag-erase 100 beses, at ito ay magkakalat ng iyong oras. Kaya ngayon kailangan nating gumawa ng isang napakalaking panyo, kung saan maaari kong isulat ang lahat ng 100 hakbang ng kalkulasyon nang iisa lang, at pagkatapos ay i-erase nang iisa lang, upang maiiwasan ang pagkalat ng aking oras.

Kaya, isang lalong lumalaking board, iyon ang pangangailangan sa storage sa panahon ng AI.

4.2 Mula sa pagtuturo hanggang sa pag-iisip: Nagkaroon ng qualitative change sa pangangailangan sa storage

Sa maagang yugto ng generative AI, ang computing power at pera ay inilagay sa pag-train ng model, at ang pangunahing gawain ng storage system sa pag-train ay ang epektibong pagpapadala ng data sa libu-libong GPU at ang paggawa ng regular na model checkpoint upang maiwasan ang pagkabigo sa proseso ng pag-train.

Ngayon, ang inference ay mabilis na naging pangunahing harapan, at ang pattern ng pangangailangan sa storage para sa inference ay mas kumplikado kaysa sa training.

Kailangan nito na i-load ang modelo mula sa storage layer patungo sa memory layer: ang active weights ay pangunahing nasa HBM, habang ang ilang estado at cache ay naiiwan sa DRAM; kapag hindi na kasya ang KV Cache (key-value cache) sa mas mataas na memory, ang ilan ay i-unload sa SSD/NAND at ibabalik kapag kailangan; samantala, ang panlabas na kaalaman na ginagamit ng RAG query, karaniwang naka-store sa mas likod na shared storage o data lake, na tinatawag ng retrieval system sa real-time.

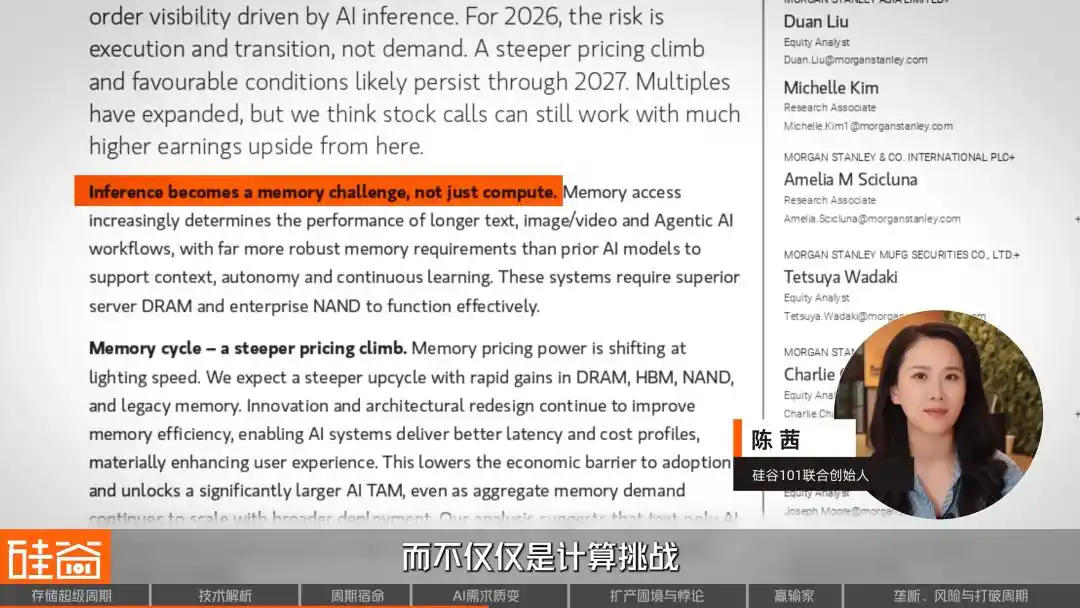

Ang mas malaking variable ay ang pag-usbong ng AI Agent. Sa kanilang pinakabagong research report, sinabi ng Morgan Stanley na ang 2026 ay ang taon kung kailan magiging bahagi ng pangunahing imprastruktura ang AI mula sa pagsubok, kung saan mas tiyak, may mas mabuting memorya, at mas kaunting hallucination ang mga agent na ito, at nakakapag-aral nang patuloy. Isinulat sa研究报告 na: “Ang pag-iisip ay naging isang hamon sa memorya, hindi lamang sa hamon sa computation.”

Ngunit upang magsagawa ang mga agent, kailangan nilang panatilihin ang maraming antas ng memorya: maikling panahon na trabaho na memorya (kasalukuyang talakayan), mahabang panahon na memorya (kasaysayan ng user sa pagitan ng mga sesyon), pre-trained na base ng kaalaman, mga tala ng pagtawag sa mga kasangkapan... at bawat antas ay nangangailangan ng iba’t ibang antas ng pag-iimbak: mula sa “mainit na data” sa HBM, hanggang sa “mainom na data” sa DRAM, at sa “malamig na data” sa NAND SSD.

Kaya ang trend ay malinaw: ang susunod na pag-unlad sa AI ay hindi galing sa mas malakas na kakayahan sa pag-iisip, kundi sa mas mahusay na pagtrato sa konteksto. Mas kapaki-pakinabang ang isang AI assistant na nakakababala ng lahat kaysa sa isang mas malaking modelo na walang alam. Ano ang ibig sabihin nito para sa pag-iimbak?

4.3 Kalkulahin: Gaano karaming storage ang kakainin ng AI?

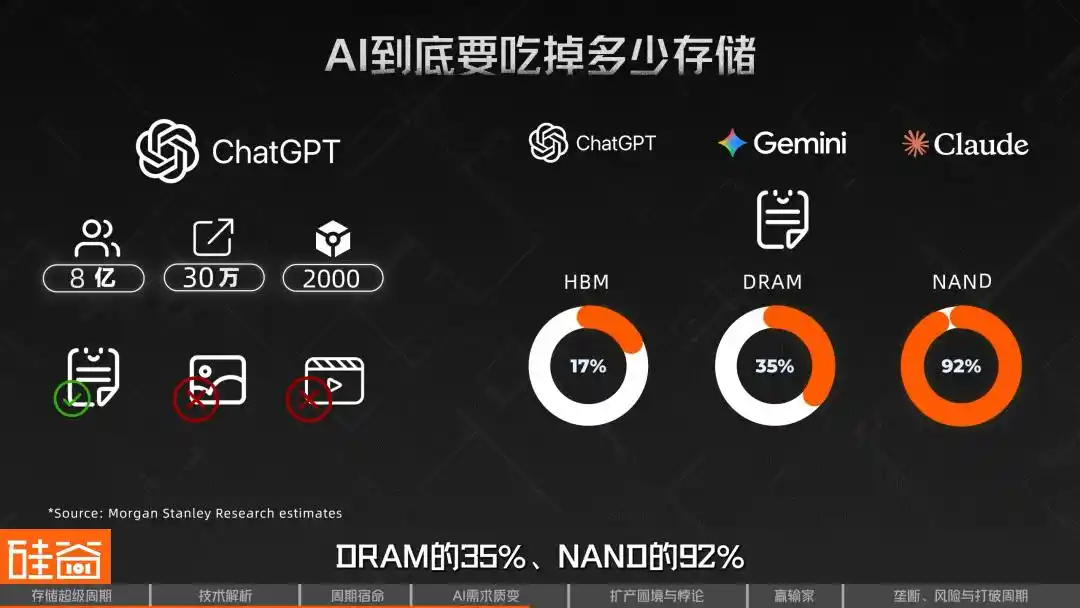

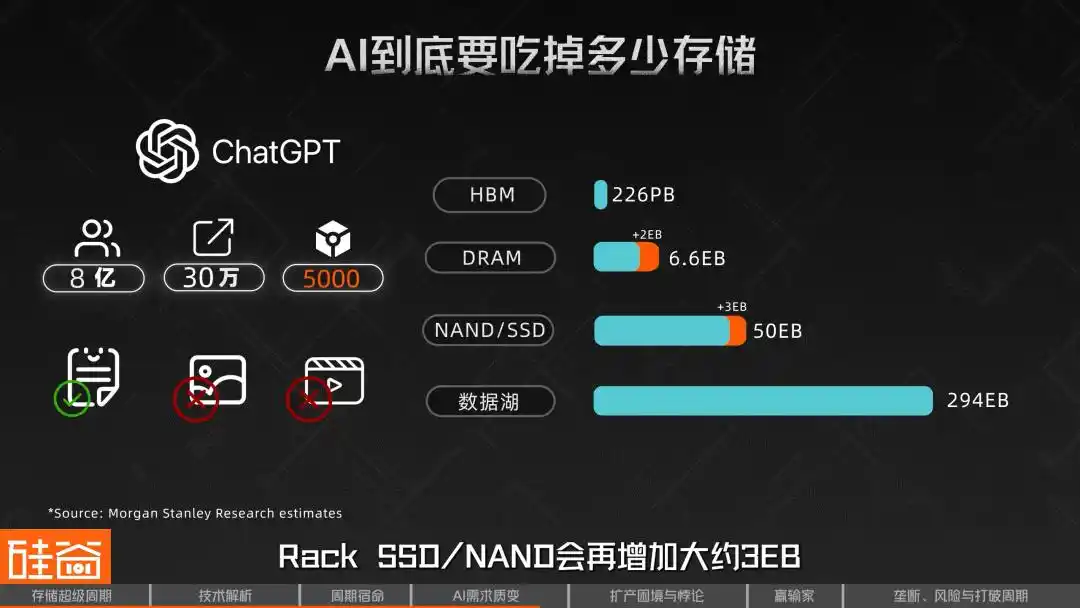

Ginawa ng Morgan Stanley isang detalyadong pagkalkula sa pamamagitan ng mga antas. Ginamit nila ang isang modelo na may laki katulad ng ChatGPT bilang batayan, na may higit sa 800 milyong aktibong gumagamit sa isang linggo, peak na 300,000 na kahilingan bawat segundo, 2,000 input token bawat kahilingan, at ipinagpalagay na tanging teksto ang isasaayos, habang ang mga larawan at video ay hindi isinasama. Ayon sa detalyadong pagkakahati-hati ng mga resulta batay sa mga ito, ang ganitong sistema ay tumutugma sa halos 226 PB ng HBM, 4.6 EB ng DRAM, humigit-kumulang 47 EB ng NAND/SSD, at 294 EB ng data lake.

Ang mga numero na ito ay nangangahulugan na kung mayroong tatlong modelo ng ganitong laki sa buong mundo, tulad ng ChatGPT + Gemini + Claude, ang kailangan para sa pure text inference lamang ay magiging 17% ng global na supply ng HBM, 35% ng DRAM, at 92% ng NAND noong 2026. At hindi pa kasama ang mga pangangailangan sa multi-modal tulad ng mga imahe at video.

Mas mahalaga pa, ang sistema ng pagkalkula na ito ay napakasensitibo sa haba ng konteksto. Ipinaliwanag ng sensitivity analysis ng Morgan Stanley na kung itataas ang input mula sa 2,000 token bawat beses patungo sa 5,000 token, habang nananatiling pareho ang iba pang mga kondisyon, dadagdagan pa ng halos 2 EB ang DRAM na pangangailangan para sa bawat modelo, at ng halos 3 EB ang Rack SSD/NAND. Ibig sabihin, habang mas mahahaba ang konteksto at mas mahahaba ang chain of thought na naging karaniwan, mabilis na lalaki ang presyur sa storage.

Tinatawag ng SemiAnalysis ito bilang "Memory Parkinson's Law": Bawat pagtaas ng kapasidad ng HBM, agad na gumagawa ang mga developer ng mas malalaking model upang punuin ito. Ang mga teknik na dating ginamit upang i-compress ang mga model, ay binabale-wala agad kapag may bagong puwang, hanggang sa muli itong makarating sa pader—ibig sabihin: ang storage ay laging ang susunod na bottleneck.

Ito ang dahilan kung bakit may mga tinig sa industriya na naniniwala na ang mga tagagawa ng memorya ay maaaring nagkamali sa pagtataya ng pangangailangan dulot ng pagtaas ng mga token ng malalaking modelo sa wika.

Rob Li

New York Amont Partners Managing Partner

Ang dating cycle ay maaaring magtagal ng isang taon at kalahati hanggang dalawang taon lamang, ngunit ang cycle na ito ay maaaring magtagal nang higit pa, o kaya naman, kapag isang industriyang may cycle ay naging industriyang may structural growth, hindi na ito isang cycle.

Ang isa pang desisyon sa siklo na ito ay ang pagpapalawak ng suplay sa kapasidad, ang tanong ay, bakit ito ay ganito kahirap na palawakin?

05 Habang lumalawak ang produksyon, mas nagiging kakaunti: Ang hamon at paglalaban sa HBM-DRAM

Upang maunawaan ang super cycle na ito, may isang pangunahing lihim na dapat maintindihan: ang malawakang pagpapalawak ng produksyon ng HBM ay hindi nagpapalakas ng kakulangan sa DRAM, kundi nagpapalala nito.

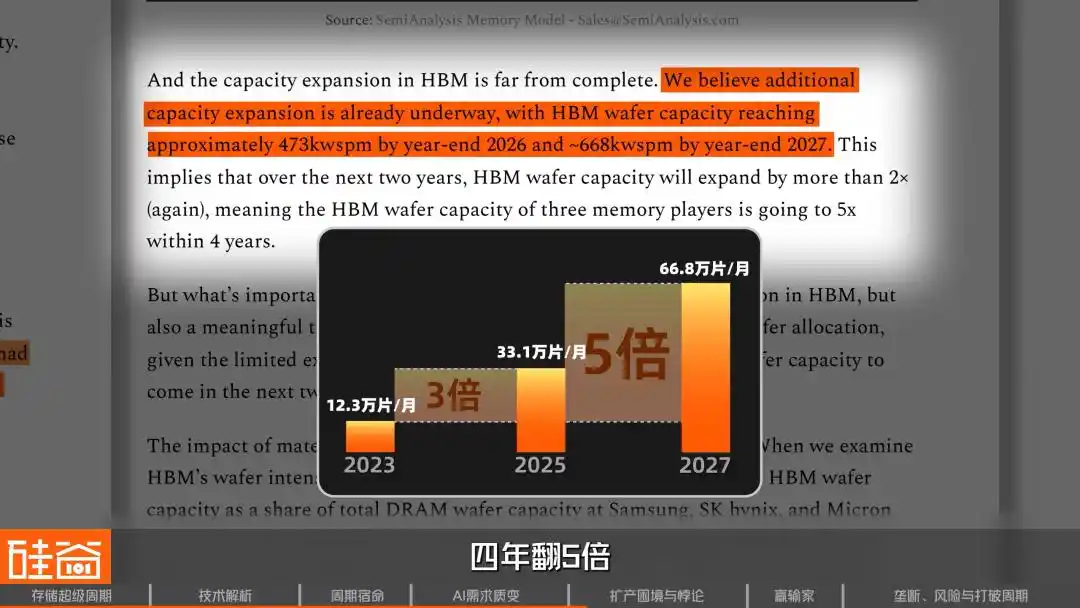

Ayon sa pagsubaybay ng SemiAnalysis, noong dulo ng 2023, ang mga kahon na nagmamay-ari ng tatlong pangunahing tagapagbigay ng imbakan ay nag-alok ng halos 123,000 na wafers bawat buwan para sa HBM. Tumaas ito sa 331,000 na wafers bawat buwan noong dulo ng 2025, na lumawak ng halos 3 beses sa loob ng dalawang taon. Inaasahan na tataas pa ito sa 668,000 na wafers bawat buwan noong dulo ng 2027, na magiging limang beses na pagtaas sa loob ng apat na taon.

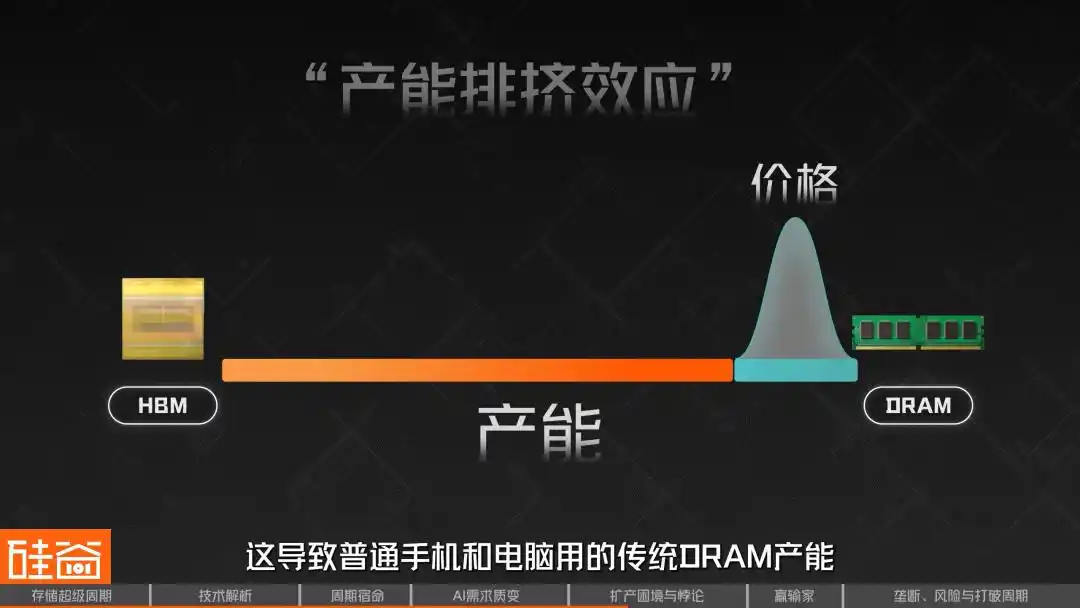

Bakit pa rin kumukulang ang DRAM kahit na napakalaking paglago? Ang susi ay ang paggamit ng malaking kapasidad ng karaniwang DRAM para sa paggawa ng HBM, at ang epekto nito ay napakababa.

Ang HBM ay isang arkitektura na napakadaming nag-aabot sa wafer. Ang isang wafer na ginagamit para sa HBM3E 12-layer stack ay may bit output (o ang kakayahang produksyon ng kapasidad ng memorya) na lamang nang humigit-kumulang isang-katlo ng karaniwang DRAM wafer, at sa HBM4, maaaring mas masama ang ratio hanggang isang-kapat.

Candice Hu

Manager para sa Marketing ng Mga Produkto ng Storage ng Samsung

Kumpara sa tradisyonal na DRAM, ang produksyon ng HBM ay nagbibigay ng tanging isang-katlo lamang ng yield sa isang wafer kaysa sa karaniwang DRAM.

Ibig sabihin nito, para sa bawat karagdagang 1GB ng HBM na produced ng manufacturer, nawawala ang pagkakataon na mag-produce ng 3-4GB ng karaniwang DRAM.

Bakit ganito kahina ang efficiency? Dahil ang paggawa ng HBM ay mas kumplikado kaysa sa karaniwang DRAM, tulad ng TSV (through-silicon via), pagpapalapad ng wafer, at back-end processing, na lahat ay nagdudulot ng karagdagang pagkawala ng yield. Kapag nagagawa ang 8 o 12-layer stack, kung may isang masamang die, maaaring mawala na ang buong stack.

Ang lahat ng mga problema na ito ay nagiging sanhi na ang HBM ay isang produkto na “reverse scaling”—ang mas marami itong ginagawa, mas malaki ang pagkakasunod sa kapasidad.

Nagdudulot ito ng “HBM-DRAM dilemma,” na kilala sa industriya bilang “capacity crowding effect.” Dahil mas mataas ang kita mula sa HBM at nakareserba na ito ng mga malalaking AI company, mas pipiliin ng mga manufacturer na i-allocate ang kanilang limitadong wafers sa HBM production lines. Nagresulta ito sa malaking pagbaba ng产能 para sa tradisyonal na DRAM na ginagamit sa karaniwang mga mobile phone at computer, na nagdulot ng matinding pagtaas ng presyo.

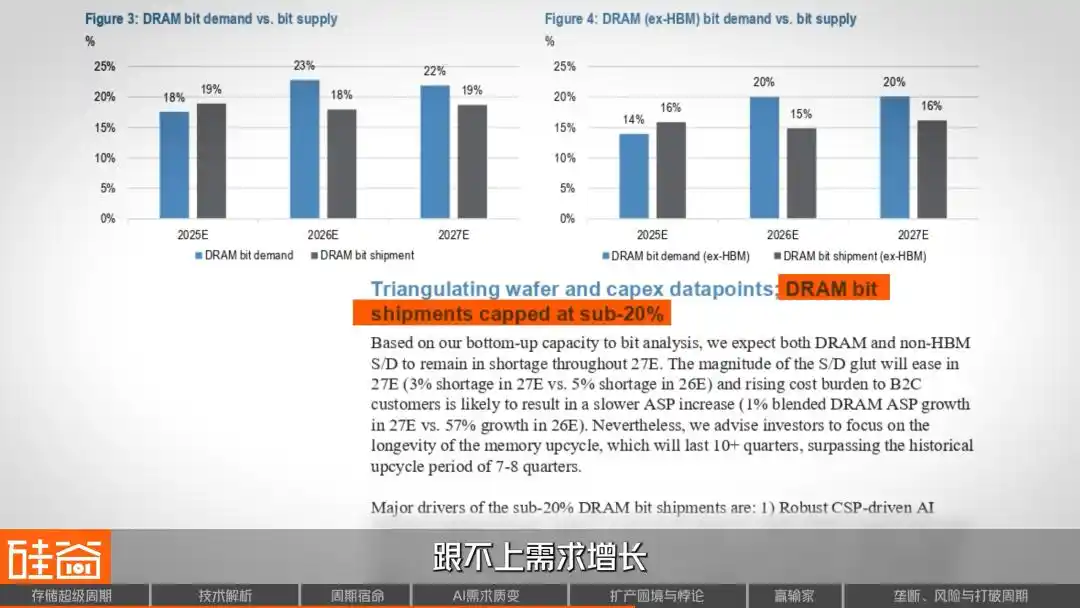

Ang modelo ng suplay at demand mula sa research report ng J.P. Morgan ay nagmumungkahi rin ng katulad na konklusyon: ang paglago ng suplay ng DRAM ay magiging limitado sa ilalim ng 20% sa susunod na dalawang taon at hindi makakasabay sa paglago ng demand.

Kaya umusbong muli ang isang nakakagulat na pangyayari: bagaman ang karaniwang proseso ng DRAM ay mas simpleng kaysa sa HBM, dahil sa limitadong kapasidad at tumaas na presyo, ang profit margin nito ay naging katumbas o kahit higit pa sa HBM noong ikalawang kuartal ng 2025. Dahil ang HBM ay karaniwang nakabukod sa mahabang panahong kontrata, habang ang presyo ng karaniwang DRAM sa spot market ay maaaring agad na makapagpapakita ng kakulangan sa suplay at demand. Ito ang nagbibigay ng problema sa mga manufacturer: dapat ba nilang patuloy na palawakin ang HBM, o iwanan ang ilang bahagi ng kanilang kapasidad para sa karaniwang DRAM na may parehong malaking kita?

06 Ang tatlong malalaking hadlang sa pagpapalawak ng produksyon: kakulangan ng cleanroom, konservatismo ng mga supplier ng kagamitan, at pagkakaroon ng friction sa proseso

Sapat na ang demand, ngunit ang mga limitasyon sa supply ay mas nakakapagod.

Unang bottleneck: Kulang ang mga production resource tulad ng cleanroom. Kailangan ng cleanroom ang paggawa ng chip, ngunit matapos ang pandemya, dahil sa pagbaba ng cycle, ang mga manufacturer ng memorya ay nagpasya na maging mapagbantay, kaya bumaba ang kanilang pag-invest, na nagresulta sa malaking kakulangan ng cleanroom noong 2025 at 2026.

Candice Hu

Manager para sa Marketing ng Mga Produkto ng Storage ng Samsung

Dahil sa sobrang mataas na mga kinakailangan sa kapaligiran para sa paggawa ng chip, mas naghahanap kami kung sapat ba ang clean room, at kung sapat ba ang kuryente. Dahil baka sapat na ang aming paggawa ng chip, ngunit kulang ang power upang sila ay magsagawa.

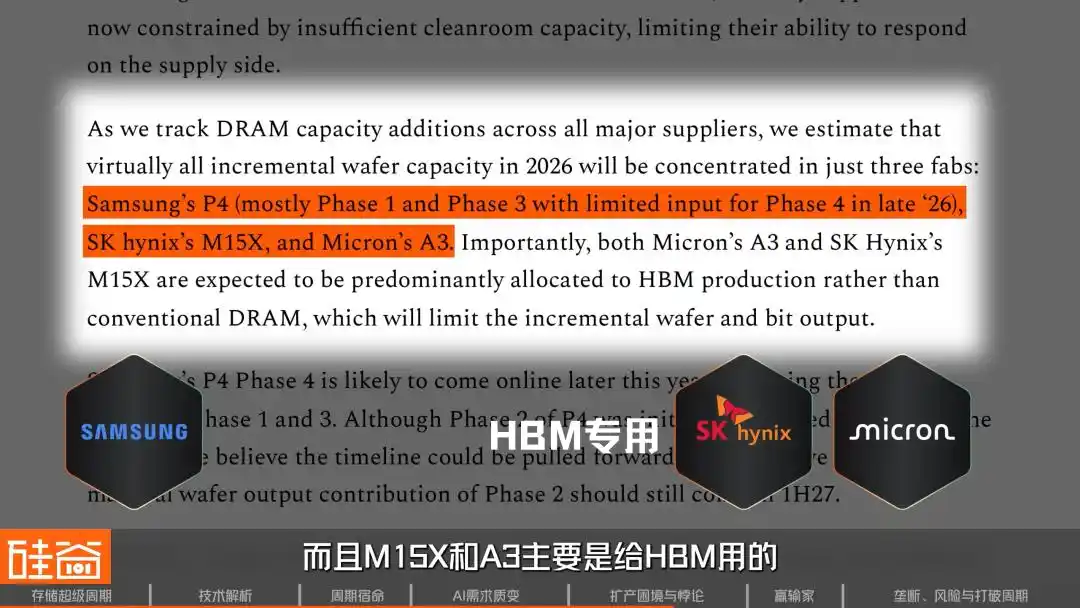

Ayon sa pagsubaybay ng SemiAnalysis, ang halos lahat ng bagong kapasidad sa wafer noong 2026 ay nakatuon sa tatlong pabrika: ang P4 ng Samsung, ang M15X ng SK Hynix, at ang A3 ng Micron. At ang M15X at A3 ay pangunahing para sa HBM, at may limitadong kontribusyon sa karaniwang DRAM.

Ano naman ang totoong makabuluhang dagdag na kapasidad? Ang pabrika ni SK Hynix sa Yongin ay maaaring magsimula noong Pebrero 2027 lamang; ang pabrika ni Micron sa Idaho ay nakatarget sa gitna ng 2027. Ibig sabihin, sa susunod na higit sa isang taon, wala namang dagdag na suplay.

Ikalawang bottleneck: Hindi gustong mag-expand ang mga supplier ng upstream equipment.

Rob Li

New York Amont Partners Managing Partner

Maraming tagapag-provide ng kagamitan, tulad ng maraming supplier sa Japan, tulad ng malaking Tokyo Electron, na ayaw magpapalawak ng produksyon at sobrang konservatibo. Dahil sa mga nakaraang dekada, napagdaanan na nito ang maraming siklo, at ang pagpapalawak ng kapasidad ay kailangan din ng ilang taon; kapag nagsimula na ang pagpapalawak, baka nangyari na ang AI cycle. Kaya mas pipili sila na huwag magpapalawak—hindi nila hihingin ang 500 piso, kundi 100 piso lamang, at masaya pa rin sila sa kanilang maliit na buhay.

Sanggunian ng imahe: TEL

Ito ay isang klasikong “effect ng barrel na may mga pahalang na lamesa,” kahit na may pera at determinasyon ang mga tagagawa ng storage, ang kakulangan sa suplay ng mga kagamitan sa itaas ay magdudulot ng malaking pagbagsak sa bilis ng pagpapataas ng kapasidad.

Ikatlong hadlang: Ang friction sa paglipat ng sarili ng advanced node. Upang makapagproduksyon ng higit pang memorya bit sa ilalim ng limitadong kapasidad ng wafer, ang mga pangunahing manufacturer ay nagpapabilis sa paglipat patungo sa advanced node na 1b (kasalukuyang pinakamataas na production node) at 1c (susunod na node na papasok sa malawakang produksyon), dahil ang mas advanced na proseso ay nangangahulugan ng mas maliit na pag-etch ng circuit; sa parehong laki ng wafer, ang node na 1c ay makakapag-cut ng higit pang memorya chip kaysa sa 1b.

Ngunit ang proseso ng paglipat ng produksyon ay kailangang itigil ang mga makina, na nagdudulot ng maraming linggo hanggang maraming buwan ng pag-realign at pag-install, na nagdudulot din ng pagkakaiba-iba sa yield at pagkawala ng kapasidad sa ilang kuartal. Sa panahon ng pagtaas ng pangangailangan sa AI noong 2026, ang solusyong ito ay masyadong maghuhuli.

Candice Hu

Manager para sa Marketing ng Mga Produkto ng Storage ng Samsung

Mula sa pagpapasya na dagdagan ang kapasidad hanggang sa pagbuo ng isang Fab (semiconductor manufacturing plant), at pagkatapos ay sa pagkakaroon ng back-end na makapag-produce ng DRAM o NAND chips, kailangan ng tatlong taon. Sa panahong ito, lumabas ang HBM, isang mahirap gawing chip—tulad ng aking nabanggit, ang HBM ay may 1/3 na kapasidad kumpara sa conventional DRAM. Kaya kung kailangan mong hintayin ang dalawa hanggang tatlong taon para umabot sa dagdag na kapasidad, ngayon ay bawasan pa nito ang output ng 1/3, kaya ang supply at demand ay patuloy na nakakaranas ng kakulangan sa cycle na ito.

Kakulangan ng mga mapagkukunan sa produksyon tulad ng clean room, pagtigil ng mga tagagawa ng kagamitan sa pagpapalawak, at mga hamon sa paglipat sa mga advanced node—tatlong hadlang na nagkakasama, kaya kahit alam ng lahat na tumataas nang palabas ang mga chip ng memorya, ang suplay ay walang paraan na makatulong.

07 Muling pagkakabahagi ng kita sa chain: Sino ang nagsasadya, sino ang nasa tagtuyot

Ang pagsabog ng presyo ng mga chip ng imbakan ay hindi walang gastos—ito ay nagre-reallocate ng kita sa buong industriya ng elektroniko.

Una sa mga pangunahing tagapagtagumpay sa chuva ng kita, maliban sa mga astronomikal na kita ng dalawang pangunahing kumpanya sa Korea, ang mga lokal na manufacturer ng storage sa China ay nagsimulang umabot din: inaasahan ng Biwin Storage na tumaas ang kanilang kita ng 427% hanggang 520% noong 2025, habang inaasahan ng Demingli na tumaas ng 85% hanggang 128%.

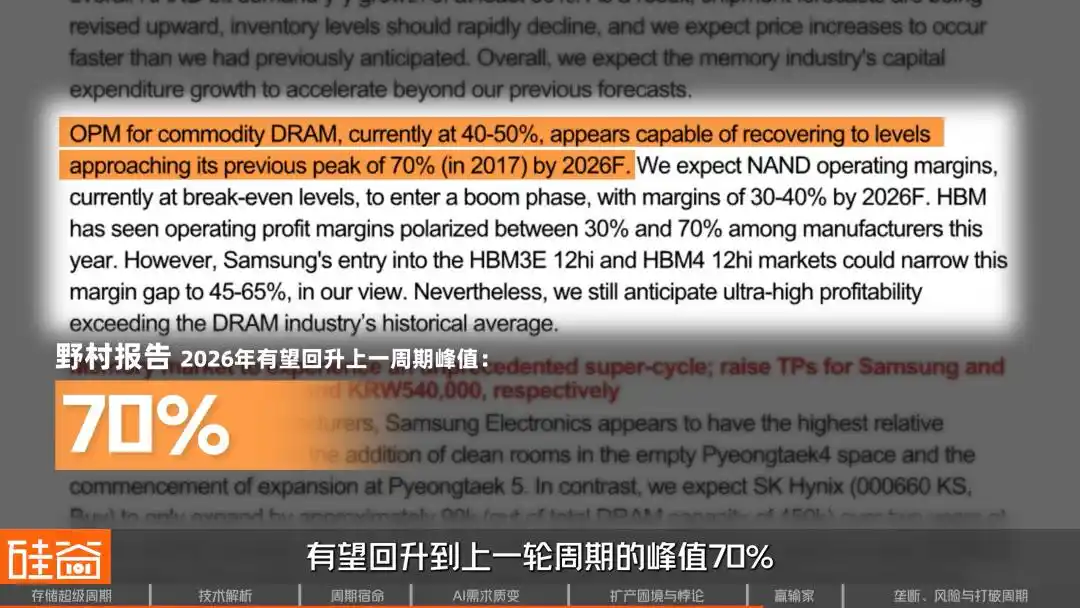

Tungkol sa margin ng industriya, ang pananaw ng Nomura ay ang fiscal year 2026, kung saan ang margin ng mga manufacturer ng DRAM ay maaaring umabot muli sa peak na 70% ng nakaraang cycle. Samantala, mas agresibo ang J.P.Morgan, na nagsasabi na hanggang 2027, ang operating margin ay maaaring lalampas sa 80%, kahit na higit pa sa peak ng nakaraang cycle.

Ang mga tagapagproseso ng hardware ang mga tagalugi sa chain na ito. Ipinagkalkula ng Morgan Stanley na bawat 10% pagtaas ng presyo ng memorya chip, bumababa ang gross profit margin ng hardware OEM ng 45 hanggang 150 basis points.

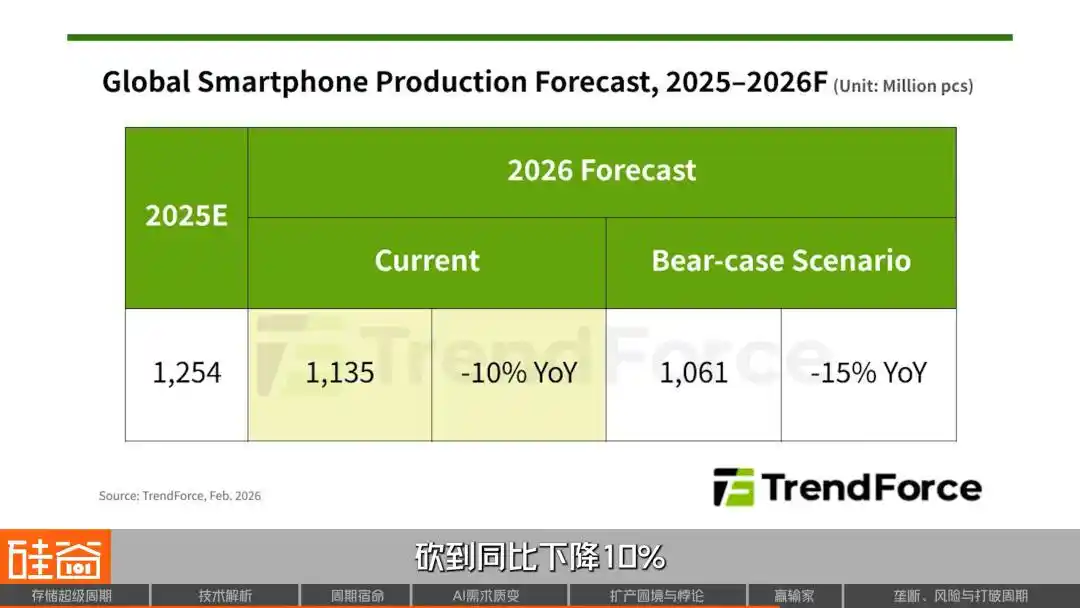

Ang unang nasasaktan sa mobile market ay ang mga pagpapalabas ni Xiaomi at OPPO na bawasan ng higit sa 20%, habang ang vivo ay bawasan ng halos 15%. Direktang bawasan ng TrendForce ang pangkalahatang pagpapalabas ng smartphone sa buong mundo noong 2026 sa pagbaba ng 10% kumpara sa nakaraang taon. Ang Meizu ay nagpahayag na ipapalabas ang Meizu 22Air dahil hindi na kayang tanggapin ang gastos. Ang CEO ng Nothing, Pei Yu, ay nag-comment sa social media: "Kailangan ng mga maliit na kumpanya na hanapin ang iba pang mga daan."

Sama rin ang sitwasyon sa PC market; itinataas ng Lenovo ang presyo ng ilang modelo ng ₱500 hanggang ₱1,500, habang nagpalabas na ng pahayag ang Dell at HP tungkol sa pagtaas ng presyo, na pangunahing dulot ng pagtaas ng gastos sa storage. Direktang sinabi ng COO ng Dell, Clark, na “hindi pa nakakakita ng ganitong bilis ng pagtaas ng gastos,” habang isinasaalang-alang na ng CEO ng HP ang “pagsusulit sa dami ng memorya sa mga produkto.”

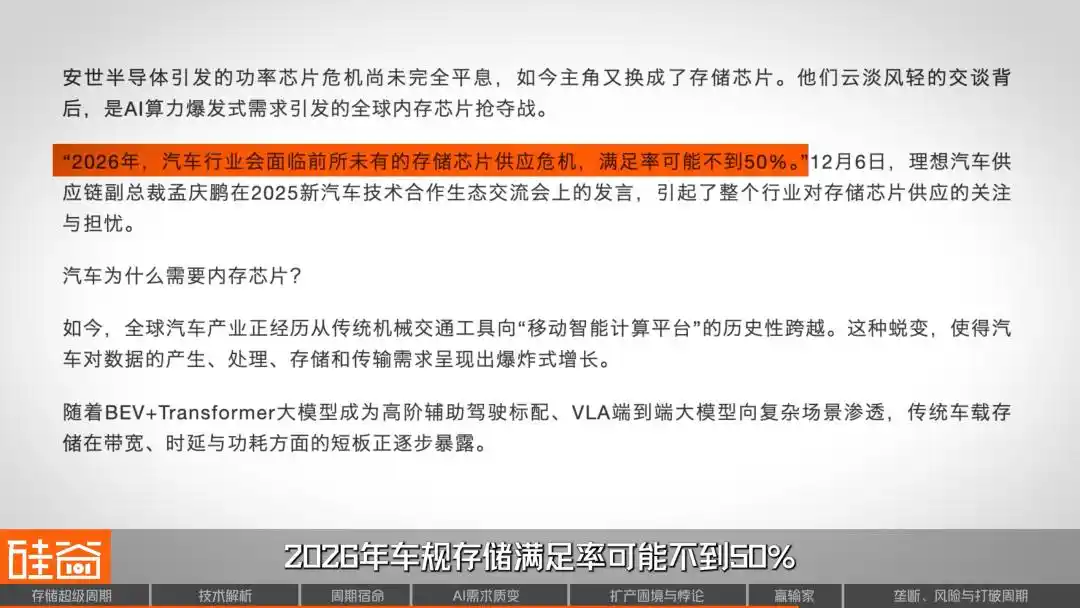

Hindi nakaligtas ang industriya ng kotse; ang vice president ng supply chain ng Li Xiang ay nagbaba ng pahiwatig na maaaring mas mababa sa 50% ang pagkakasya ng storage na sumusunod sa mga pamantayan ng kotse noong 2026. Sabi ni Li Bin ng NIO, “Ang pinakamalaking presyur sa gastos taon na ito ay ang memorya.” Tinanggap ni Lei Jun sa livestream na “kung magmumula sa memorya para sa kotse lamang, tataas ang gastos ng ilang libo.”

Candice Hu

Manager para sa Marketing ng Mga Produkto ng Storage ng Samsung

Ang mga manufacturer ng PC at mobile phone ay kasalukuyang nasa aming side, kahit gaano pa kalaking pangalan, wala silang malaking pricing influence; hindi na sila sobrang hinahanap dahil mas mababa ang margin nila kumpara sa mga cloud provider. Halimbawa, isang lokal na automaker, narinig naming dahil sa kakulangan ng memorya, maaaring i-remove nila ang rear-seat entertainment system.

Rob Li

New York Amont Partners Managing Partner

Siguradong bababa ng hindi bababa sa 5 puntos ang mobile at PC sa taong ito, posibleng higit pa, ngunit walang magmamalasakit sa bagay na ito. Dahil sa kanilang tatlo (mga bumerong), lalo na ang Micron, sinabi nila na wala na silang gagawin sa bagay na ito, kahit maging zero na ang merkado ay walang problema.

Sa kabilang dulo ng pangangailangan, ang mga cloud provider (Microsoft, Google, Amazon AWS) ay nagpapakita ng nakakagulat na kawalan ng pagkakaroon ng sensitibidad sa presyo.

Candice Hu

Manager para sa Marketing ng Mga Produkto ng Storage ng Samsung

Ngayon, ang marginal cost ng mga cloud provider, ang kanilang software ay 0. Ang kanilang pera at narrative ay may kaugnayan sa presyo ng kanilang stock, kaya sila ay napakasang-ayon sa price insensitive—hindi sila lubos na nag-aalala kung magkano ang presyo ng memory.

Para sa mga cloud provider, kahit anong mangyari sa merkado ng mga mobile at PC, ang mga manufacturer ng storage ay hindi nag-aalala dahil sobrang nakakaakit ng mga prospekto ng AI data center. Kaya ang huling tanong ay, gaano katagal pa ito magpapatuloy? O talagang iba ito ngayon?

Agosto 2026: Ano ang susunod?

Sa kasalukuyan, ang kompetitibong landscape ng buong supply chain ng storage ay patuloy na matatag. Ang HBM ay kasalukuyang may estruktura na “6:2:2,” kung saan si SK Hynix ang may pinakamalaking bahagi, samantalang si Samsung at Micron ay may sariling mga market. Mayroon ding mga investor na naniniwala na sa kasalukuyang seller’s market kung saan ang suplay ay maliit kumpara sa pangangailangan, ang pag-uusap tungkol sa kung sino ang may mas malaking bahagi ay walang malaking kahalagahan.

Rob Li

New York Amont Partners Managing Partner

Dahil limitado ang produksyon ng tatlong malalaking kompanya, ang nagtatagumpay sa pagkuha ng market share ay ang makakapagpalawak ng produksyon—ang may karagdagang suplay ang makakakuha ng market share. Ngunit ang pagkakaiba sa teknolohiya ay hindi malaking salik dito, dahil ang kasalukuyang merkado ay may malaking kakulangan sa suplay kumpara sa pangangailangan. Kaya't walang kwenta ang pag-uusap tungkol sa market share, tulad ng sabi na ang market share ng Hynix ay kalahati, na mas malaki kaysa sa dalawang iba pa, dahil hindi makapagpalawak ng produksyon ang tatlo sa kanilang lahat.

Kaya ang katotohanan ay, ang mga pangunahing manufacturer ng storage ay nagsale na lahat; sino man ang makakapagpalabas ng mas maraming kapasidad, siya ang makakakain ng mas maraming karne. Ngunit interesante ay, ang mga malalaking kumpanya ng storage ay maaaring hindi maghahanap ng “monopolyo”.

Candice Hu

Manager para sa Marketing ng Mga Produkto ng Storage ng Samsung

Naniniwala ako na walang supplier na nais magmonopolyo, takot ang Samsung sa monopolyo, at hindi rin namin gusto ng aming mga kliyente na magmonopolyo kami. Kapag may kakulangan, tulad ng ngayon, kung ibinibigay ng mga kliyente ang 100% na market share sa anumang memory supplier, napakalaking presyon iyon para sa mga supplier ng storage. Kaya, ang pagbubukas ng monopolyo ay mas gusto naming makita ng mga supplier ng storage.

Karaniwan ay isinasaalang-alang ng mga tao ang monopolyo bilang katumbas ng mataas na premium, ngunit sa industriya ng pag-iimbak na may malaking pagkakaiba sa siklo, ang 100% na bahagi ng merkado ay nangangahulugan ng 100% na panganib sa pangangailangan—kapag tinanggal ng mga kliyente ang kanilang order, maging malabo ang posisyon. Kaya, mas gusto ng mga manufacturer ng pag-iimbak na panatilihin ang balanseng kompetisyon sa tatlo.

Gaano kalalim ang siklo na ito?

Candice Hu

Manager para sa Marketing ng Mga Produkto ng Storage ng Samsung

Ang taong 2026 ay 100% na ipapagbili, at ang pagkakaiba sa pagitan ng suplay at demand ay umabot sa 30%, kahit 50%. Parehong kulang sa taong 2027, at posibleng magkakaroon ng tunay na pagbabago sa taong 2028, kaya ito ay isang kakulangan na magpapatuloy sa mga sumusunod na dalawa o tatlong taon.

Sambil naka-aksyon ang demand sa kabilang panig, walang tanda ng pagpapabagal. Susunod, ang paglago ng AI inference at agent, kasunod ng demand para sa robot at physical AI, ay magdudulot pa ng eksponensyal na pagtaas sa demand para sa throughput at kapasidad ng storage.

Sa SemiAnalysis, ang kabuuang suplay ng DRAM sa taong 2026 ay magiging mas mababa ng humigit-kumulang 7% kaysa sa pangangailangan. Sa larangan ng HBM, ang kakulangan sa suplay at pangangailangan ay magpapatuloy na lumalawak hanggang 2027. Tungkol sa karagdagang suplay, ang tunay na makabuluhang kapasidad ay mas malamang na lumabas sa huling kalahati ng 2027. Kung susundin ang pagsusuri ng Nomura Securities, ang tunay na dagdag sa produksyon ay maaaring hindi makikita hanggang 2028.

Ngunit mas mahalaga ang mas malaking tanong: Maaari ba bang wakasan na ng industriyang ito ang kanyang siklo? Mula sa pananaw ng Wall Street, ibinigay ni Rob sa interbyu ang isang malalim na pag-iisip:

Rob Li

New York Amont Partners Managing Partner

Ang cycle na ito ay maaaring magtagal nang mahaba, o maaari itong baguhin ang isang siklikal na industriya sa isang industriya na may structural growth—kaya na hindi na ito isang cycle. Kung may malaking pagbabago sa industriya ngayon, at mula sa isang siklikal na industriya ito ay naging non-cyclical, isang industriya na may matatag at structural na paglago, maaaring magkaroon ng qualitative na pagbabago ang buong merkado sa pananaw nito sa industriyang ito.

Sa mga industriyang siklikal, ang isang P/E ratio na 10 ay itinuturing na mataas na, ngunit kung magiging industriyang may struktural na paglago at magpapatuloy sa maraming taon, maaaring mag-doble pa ang kanilang P/E ratio.

Ano nga ba ang ating posisyon sa kasalukuyang super cycle na ito?

Ang horizontal axis ng larawang ito ay isang timeline na batay sa nakaraang limang cycle, kung saan ang bawat low point ng bawat cycle ay zero, habang ang vertical axis ay ang pagtaas ng market trading. Makikita mo na ang bawat cycle ay dumadaan sa apat na yugto: pagkabigo, pagdududa, pagkakaroon ng pag-asa, at pagkamadali, at bumabalik muli sa pagkabigo. Sa kasalukuyang red line, nasa yugto na tayo ng “pagkakaroon ng pag-asa” at mas malaki ang pagtaas kaysa sa anumang nakaraang cycle.

Ito ay tumutugma sa sinabi ni Rob kanina—kung ang ganitong pagbabago sa pag-iisip ay totoo, at kung talagang binago ng AI ang ganitong siklo? Ito ay nangangahulugan na kahit hindi tumataas ang kita, ang pagbabawas lamang ng pagpapahalaga mula sa “cyclical stock” patungo sa “growth stock” ay maaaring magdulot ng pagdoble ng presyo ng stock. Tulad ng walang sasabihin na ang Apple ay isang siklikal na industriya sa pagbebenta ng mga cellphone sa nakalipas na 20 taon. Kung maaari rin ng storage na makarating dito, ito ay magiging isang paradigm shift sa buong framework ng pag-invest sa semiconductor.

Gayunpaman, ang demand sa industriya ng pag-iimbak ay may kakaibang kahihinatnan; ang mga variable sa demand side ay hindi lamang nagmumula sa makro antas, kundi maaari ring baguhin ng teknolohiya mismo ang ugnayan ng suplay at demand.

Halimbawa, noong huling bahagi ng Marso, inilabas ng Google ang isang bagong algoritmo na tinatawag na TurboQuant, na itinuturing na isang epektibong AI memory compression algorithm. Pagkatapos ng paglalabas, agad itong naging sensasyon sa tech community ng Silicon Valley at nagdulot ng pagsabog sa lahat ng sektor ng storage.

Ngunit mabilis na may mga tinig sa industriya ang tumutol na ang pagbaba na ito ay isang pagkakamali. Una, ang papel na ito ay nailathala noong isang taon ang nakalipas at mayroon itong ilang kontrobersya sa akademiko. Bukod dito, ang algorithm na ito ay pinagsubok lamang sa mga maliit na modelo tulad ng Gemma at Mistral, at wala pang pagsubok sa mga modelo na higit sa 70B, MoE architecture, at mga konteksto ng milyon-milyon na token—mga sitwasyon kung saan talagang umuusbong ang pangangailangan sa memorya ng AI. May mga teknikal na eksperto ring nagsabi na teknikal lamang ang TurboQuant na pinapaliit ay ang KV Cache sa GPU memory sa panahon ng inference, na isa sa tatlong pangunahing pinagmumulan ng pangangailangan sa memorya ng AI, ngunit hindi ito nakakaapekto sa proseso ng pagtuturo.

Sa lahat ng pagkakataon, ang papel at algoritmong ito ay pinagbantaan ng maraming kritika. Ngunit kakaiba ito: ang isang kontrobersyal na lumang papel ay nakapagdulot ng ganitong malaking pagbaba sa merkado ng kapital—ito ba ay nagpapakita ng ilang bagay? Kaya ba ito nangangahulugan na ang tiwala ng merkado sa sektor ng pag-iimbak ay naging sobrang mahina? Dapat tandaan na bago ang pagbaba na ito, tumataas na ang SanDisk ng 200% mula pa noong 2026, at ang Micron ay tumataas nang higit sa 80%.

May mga institusyonal na short seller na direktang nagpahiwatig na mahirap patunayan ang pagbabayad ng Flash Memory na may market cap na $92 bilyon, na may inaasahang net profit lamang ng $6 bilyon noong 2026. Parehong binabale-wala ang Micron: bagaman ito ay nakamit ang pinakamahusay na performance sa kasaysayan, ang $20 bilyon na capital expenditure para sa fiscal year 2026 ay tumataas ng 68% kumpara sa nakaraan—ito ay isang malaking taya na patuloy na magkakaroon ng pagtaas sa pangangailangan sa memory.

Sa huli, ang papel ng TurboQuant ay isang pambubulag lamang; ang tunay na pabrika ay ang extremong pagpapahalaga na nakumpuni sa nakaraang dalawang taon, at ang anumang signal na “posibleng hindi sapat ang demand” ay sapat upang mag-trigger ng panic selling.

Ang mga pag-unlad sa algoritmo na ito ay ang pinakamahirap na panganib na maipre-price sa kuwento ng “super cycle,” at malinaw na binigyan ni Rob ng huling babala sa panganib.

Rob Li

New York Amont Partners Managing Partner

Ang mga pag-aalala sa industriya ng pag-iimbak ay magpapatuloy hanggang sa matuklasan na ang produkto ay naging isang matatag at umuunlad na negosyo na katulad ng Apple. Ang unang pag-aalala ay ang pagbagsak ng AI, kung saan lahat ay mabubulok, dahil ang pangunahing pagdami ay galing sa AI; kung isang araw ay hindi na gumagana ang AI at natutuklasan ng lahat na walang kwenta ang AI, ang lahat ng iyong sinasabi tungkol sa kinabukasan ay magiging walang laman at magiging 0.

Kaya ang kasalukuyang optimismo tungkol sa “super cycle” ay nakabatay sa isang priyoridad: ang pangangailangan sa AI ay totoo at mapanatili. Kung isang araw ay magsisimula ang bubble ng AI, mahirap para sa industriya ng storage na maging buong ligtas. Ang liwanag ni Damocles ay mananatiling nakasabit doon hanggang sa patotohanan ng industriya na ito ay naging isang tiyak na paglago na negosyo na “Apple-like”.

Ipinapakilala ng SemiAnalysis ang siklo na ito bilang "kakulangan na nangyayari isa sa bawat apatnapu't taon." Ngunit mas mahalagang direksyon ay: ang industriya ng memorya ay nasa isang krusada, kung saan maaari itong maging muli sa isang bagong yugto ng pagbaba pagkatapos ng price peak, tulad ng nangyari sa nakaraang apatnapu't taon; o, sa ilalim ng struktural na pangangailangan ng AI, maaari itong talagang sirain ang siklo at maging isang industriya na patuloy na lumalago.

Sa mga taong 2026, ang sagot ay tila nagpapahiwatig sa huli. Ang lahat ng kapasidad ng tatlong pangunahing tagapagbigay ng imbakan ay nakaabot na, ang mga order sa mga tagapagbigay ng kagamitan sa itaas ay naka-iskedyul hanggang 2027, ang mga kliyente ay nagsisimula na magbigay ng down payment at pagsasagawa ng mga mahabang panahon na kontrata na may legal na obligasyon, at kahit isang Hapones na kumpanya na gumagawa ng banyo, ay nagbago ang kanyang kapalaran dahil dito.

Ngunit ang kasaysayan ay laging may mga pagtatawa sa “ito ay iba na.” Ang tanging tiyak ay: anuman ang resulta ng pagbabreak sa siklo na ito, ito ay nagsagawa ng hindi mababago na pagbabago sa mapa ng kapangyarihan sa pandaigdigang industriya ng teknolohiya. Sa larong gutom sa mga chip ng pag-iimbak, ang nagtataglay ng suplay ang may kontrol sa pagsasalita sa panahon ng AI.