Ang model ay ang utak ng OpenClaw at direktang nakakaapekto sa paggamit.

May-akda ng artikulo: Zhang Haining

Pinagkunan ng teksto: Henry Notes

Kahit na subukan ko ang iba’t ibang paraan ng pag-install at pag-deploy ng OpenClaw—tulad ng physical machine, cloud server, virtual machine, container, mga model mula sa loob at labas ng bansa, at iba pa—ang pinakakomprehensibong pagsusuri ay nagpapakita na kumplikado ito at may maraming mga bagay na dapat isaalang-alang. Layunin kong isulat ang isang pagsasama-samang artikulo. Ang artikulong ito ay isang prequel, at una nating pag-uusapan ang isang napakahalagang bahagi: ang pagpili ng model.

Ang modelo ay ang utak ng OpenClaw, na direktang nakakaapekto sa paggamit. Kasalukuyang may pagkakasundo na mas malakas ang antas ng katalinuhan ng mga modelo sa labas ng bansa kaysa sa loob ng bansa, ngunit kailangan ng scientific internet access ang mga modelo sa labas ng bansa, mas mahal sila, at kailangan ng mga paraan ng pagbabayad sa labas ng bansa; maaaring ma-block ang iyong account kung hindi mo ito sinusunod nang maayos. Kahit na may mga intermediate station na nag-aalok ng mas murang serbisyo, dahil ito ay bahagi ng gray market, mayroon pa ring hindi matatawag na panganib. Kaya, ang mga gumagamit na naghahanap ng matatag na serbisyo ay karaniwang pumipili ng mga lokal na modelo.

Ipinapahambing ng artikulong ito ang paggamit at presyo ng iba’t ibang modelong lokal, at nagbibigay ng ilang rekomendasyon para sa pagmumuni-muni.

Ang OpenClaw, ang open-source AI Agent framework, ay naging sobrang sikat sa loob ng bansa at habang nagdala ng revolusyon sa produktibidad, nagdala rin ito ng nakakalulungkot na taksil.

Ang mode ng paggana ng OpenClaw ay iba sa tradisyonal na browser o dialog-based AI ng app. Pagkatapos magbigay ng isang utos, ang tool ay awtomatikong magtatawag ng dekada o higit pa sa mga pagtawag sa model, basahin ang mga file, lumikha ng code, at i-debug ang pagpapatakbo, na kumikita ng Token sa buong proseso.

Isang intermediate-level full-stack development task, kung saan ang pagtawag sa model ay maaaring magtagal sa pagitan ng 10~40 rounds; kung gagamitin ang flagship model na sumusuporta sa 200K context, ang gastos per task ay madaling makakarating sa ilang dosenang yuan.

📊 Totoong pagkalkula ng gastos

Halimbawa ng isang katamtamang kumplikadong gawain: Ang OpenClaw ay nagtatrabaho sa higit sa 30 round ng talakayan, kada round ay may average na 20,000 Token na input at 2,000 Token na output, gamit ang pangunahing model (halos 0.005 yuan bawat libo na input Token, 0.02 yuan bawat libo na output Token):

Ang gastos sa isang task ≈ 30 × (20,000 × 0.005 ÷ 1000 + 2,000 × 0.02 ÷ 1000) = 30 × (0.1 + 0.04) = 4.2 yuan

Ang mga developer na may malalim na kaalaman ay nakakatapos ng 5 hanggang 10 gawain araw-araw, na maaaring magkost ng 630 hanggang 1,260 yuan bawat buwan. Ito ay batay sa paggamit ng mid-range model; kung gagamitin ang flagship model, tataas pa ang gastos ng dalawang beses.

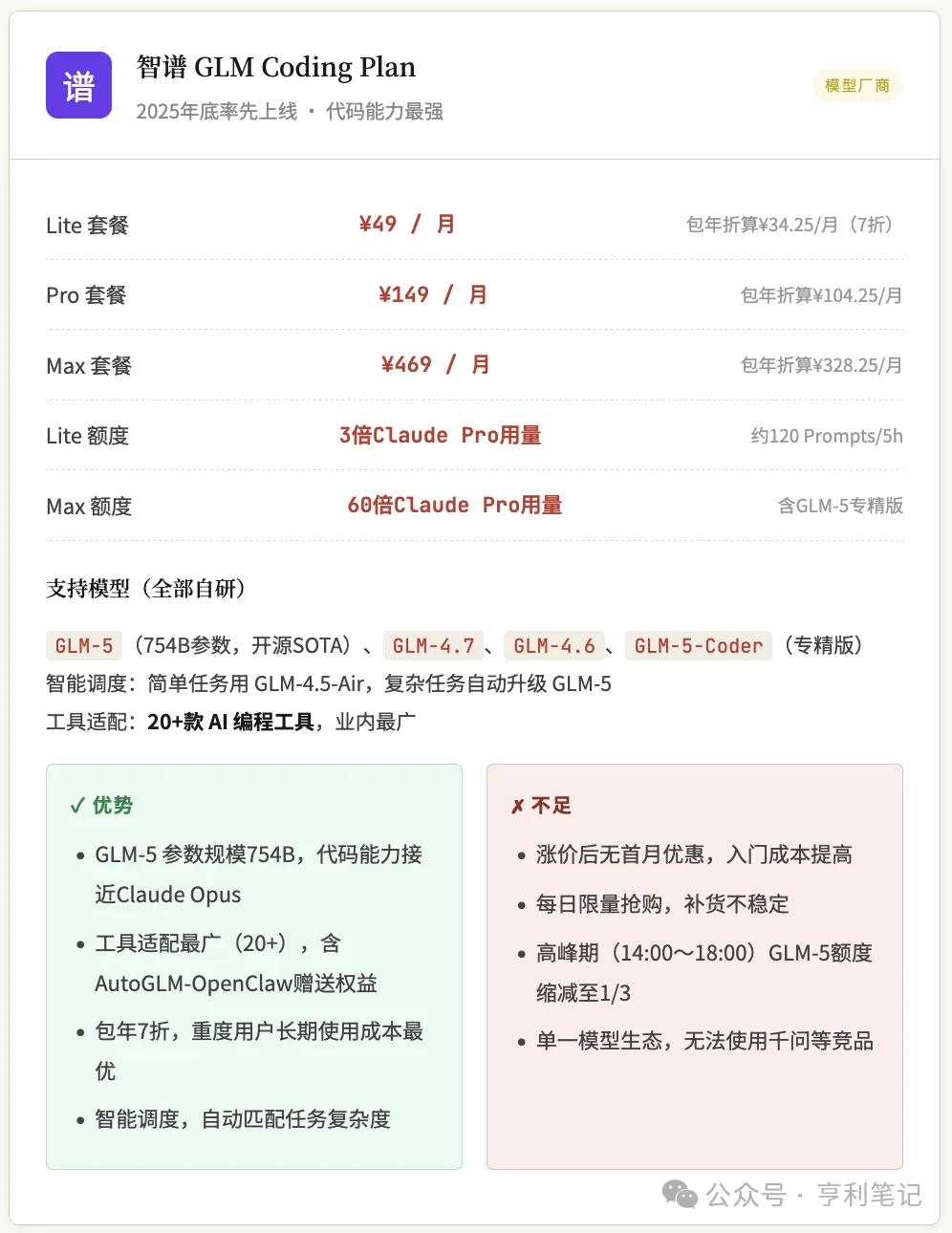

Sa ilalim ng ganitong konteksto, ang mga pangunahing lokal na cloud provider at mga kumpanya ng malalaking modelo ay pumasok nang malakas sa pagitan ng late 2025 hanggang Marso 2026, at ipinakilala ang mga subscription plan na "Coding Plan" na nag-aalok ng fixed monthly fee sa halip na pagkalkula batay sa Token. Ang simula ng digmaang presyo ay ang GLM Coding Plan na ipinakilala nang una ng Zhipu AI sa late 2025, sumunod ang Alibaba Cloud’s Bailian na pumasok nang malakas sa pamamagitan ng napakababang presyo ng "7.9 yuan sa unang buwan", at natapos ng Tencent Cloud ang huling piraso ng puzzle noong Marso 5, 2026.

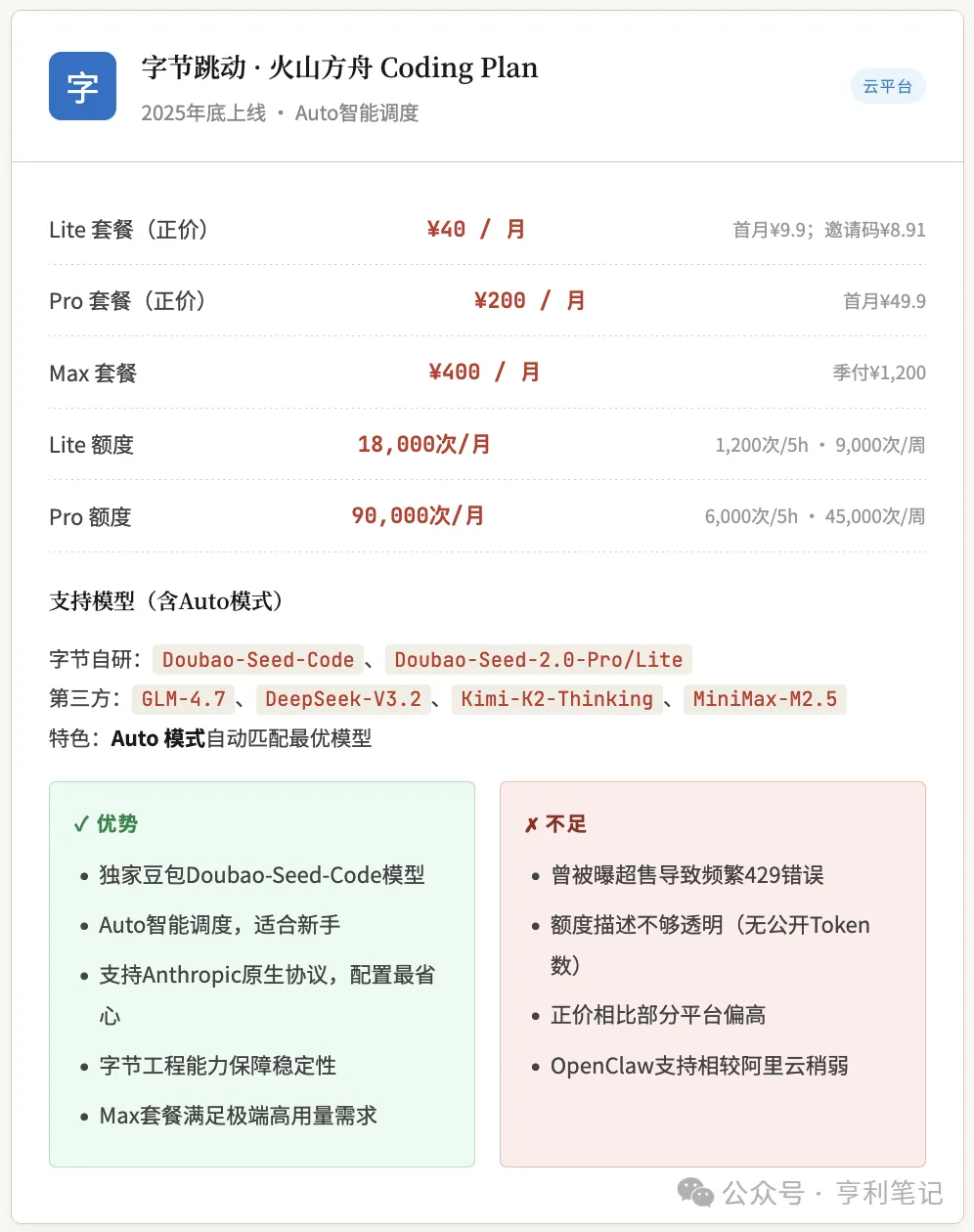

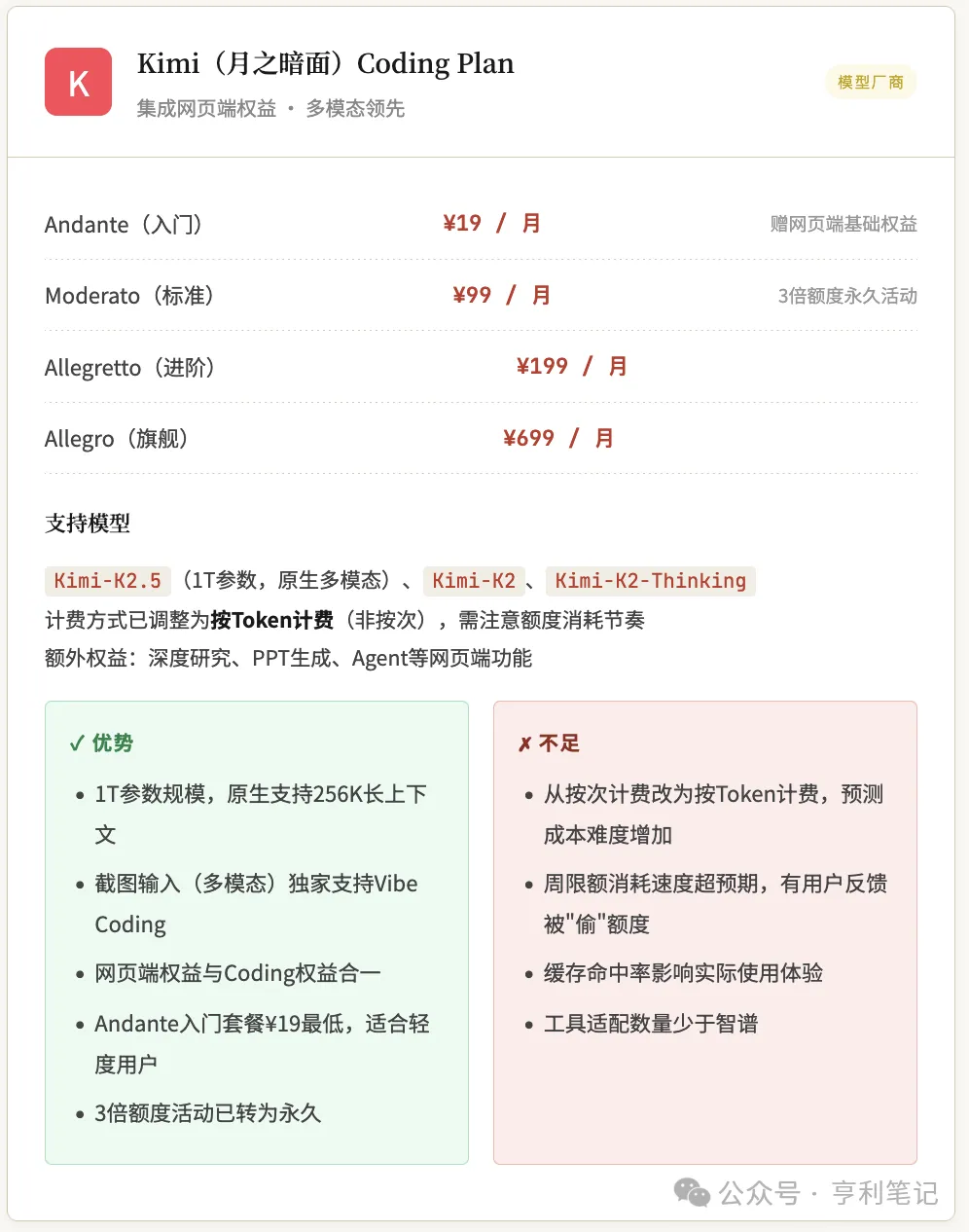

Ang artikulong ito ay sistematikong isasalin ang Coding Plan ng mga pangunahing six platform sa bansa, na hinahati sa dalawang pangunahing linya: mga cloud provider (Alibaba Cloud BAILIAN, ByteDance Huoshan Fangzhou, Tencent Cloud) at mga manufacturer ng model (Zhipu GLM, Kimi Yue Zhi Anmian, MiniMax), upang magbigay ng reperensya para sa mga gumagamit ng OpenClaw.

Kailangan ng OpenClaw ang pagbili ng Coding Plan. Oo, pareho ang gamit nito tulad ng mga programmer na gumagamit ng Cursor, Trae at iba pang IDE, dahil ang OpenClaw at ang Cursor ay parehong mga agent. Kung hindi mo binibili ang Coding Plan (karaniwang tinatawag na API sa abroad), ang iyong pera ay gagamitin lamang para sa pag-access sa malalaking modelo sa browser.

(Hindi kasali sa sakop ng artikulong ito ang mga modelong mula sa labas ng bansa)

Cloud provider

Mga pangunahing cloud provider: Ang labanan sa model supermarket

Ang pangunahang lohika ng cloud provider roadmap ay ang "pagpapagsama ng platform": ang pagpapakasama ng maraming open-source malalaking modelo tulad ng Qwen, GLM, Kimi, at MiniMax sa isang pakete lamang, kung saan ang mga developer ay maaaring magpalit nang libre gamit ang isang API key, nang hindi kailangang mag-recharge sa iba't ibang platform. Ang mga paketeng ito ay binabase sa "bilang ng request" at hindi sa Prompts, kaya ang mga numero ay tila mas malaki, ngunit kailangang iugnay sa tunay na pagsasalin.

Ang mga detalye ng tatlong cloud provider ay sumusunod:

Mga tagapagbigay ng malalaking modelo

Tatlong pangunahing tagapagbigay ng modelo: Ang espesyalisasyon sa pagkakaroon ng malalim na pag-unawa

Sa pagkakaiba sa "model supermarket" ng cloud provider, ang model manufacturer-based Coding Plan ay sumusunod sa "specialty store" approach: nag-aalok lamang ng kanilang sariling model, ngunit may malalim na pag-optimize, at mas tumpak na disenyo ng model capability at quota. Karaniwan ang paggamit ng "Prompts" bilang yunit ng pagkalkula, kung saan 1 Prompt ≈ 15 model calls (batay sa pagtataya ni MiniMax), kaya ang mga numero ay tila mas maliit, ngunit mas maraming kausap na maaaring isama sa bawat isa.

Talaan ng paghahambing ng pangunahing datos ng bawat platform

Tandaan: Ang presyo ay batay sa opisyal na presyo hanggang sa huling araw ng Marso 2026, at ang discount sa unang buwan ay eksklusibo para sa mga bagong user; mangyaring sundin ang pahina ng pag-order. Ang rating ng pagkakatugma ng OpenClaw ay batay sa kahalagahan ng opisyal na dokumentasyon at mga feedback mula sa komunidad.

Guide sa Pag-iwas sa Mga Panganib

Paglilinaw sa Sistema ng Pagbabayad: Ang Katotohanan sa Likod ng Mga Numero

Ang pinakamalaking hadlang sa impormasyon sa merkado ay ang paggamit ng iba't ibang yunit ng pagsukat sa bawat platform, kaya walang kwenta ang direkting paghahambing ng mga numero. Ipinapaliwanag ng seksyong ito ang tatlong pangunahing puntos sa pagkalkula upang tulungan ka na gawin ang totoong pagpapasya bago bumili.

Hindi magkakatugma ang mga yunit ng pagsukat

Kasalukuyang mayroong dalawang sistema sa merkado: ang mga cloud provider (Alibaba Cloud, Volcano, Tencent) ay gumagamit ng "request per call"; habang ang mga model provider (Zhipu, MiniMax) ay gumagamit ng "Prompts". Ang mahalagang konbersyon ay: 1 Prompt ≈ 15 model calls.

Ang pagbabayad ay batay sa bilang ng mga round ng interaksyon na isinimula ng user; isang tanong, anuman ang bilang ng pagtawag sa model sa background, ay nagkakahalaga lamang ng isang credit. Ang pagbabayad batay sa bilang ay tradisyonal na modelo ng cloud provider, batay sa bilang ng API calls; kung isang tanong ng user ay nagpapagana ng maraming pagtawag sa model, babayaran mo ang bawat isa. Mas kaaya-aya para sa mga Agent tulad ng OpenClaw na nagtatayo ng maraming pagtawag sa background ang unang paraan, dahil mas maipaplanong ang gastos; samantalang ang pangalawa ay tumpak na batay sa aktwal na bilang ng mga kahilingan, at madaling magdulot ng hindi inaasahang taksil dahil sa mga panloob na pagtawag.

Ang dalawang paraan ay angkop para sa mga maliit na gumagamit ng OpenClaw, dahil hindi ito nakabatay sa token, kundi sa bilang lamang, at may buwanang limitasyon, kaya wala nang anxiety sa token ang mga user.

2. Halimbawa ng pagkalkula

Ang Alibaba Cloud BAILIAN Pro plan ay nag-aalok ng 90,000 na kahilingan kada buwan, na katumbas ng humigit-kumulang 6,000 na Prompts.

Ang GLM Lite plan ni ZhiPu ay nagbibigay ng halos 120 Prompts bawat 5 na oras, katumbas ng halos 1,800 na mga hiling.

Kaya ang "90,000" at "120" ay hindi direktang ma-compare na mga numero.

3. Ang sliding window/5 hours ang totoong bottleneck

Halos lahat ng platform ay may limitasyon na "5-hour quota," at ang bilang na ito ang susi sa pagkakaroon ng patuloy na malakas na paggamit, hindi ang kabuuang quota sa buwan. Ang 5-hour window ay may rolling replenishment mechanism (hindi fixed natural time period): Kung nag-start ka ng 14:00 at nawala ang quota mo ng 15:00, kailangan mong hintayin hanggang 19:00 para mabawi ang unang quota. Madaling makarating sa limitasyon kung mag-develop ka nang 2–3 oras nang patuloy sa peak hours ng hapon.

4. Mga nakatagong patakaran sa pagbawas ng timbang ng GLM-5 ng Zhipu

Ang智谱 GLM Coding Plan ay may eksklusibong patakaran: Sa peak hours (UTC+8 14:00~18:00), ang tunay na available na paggamit ng GLM-5 ay tanging 1/3 ng non-peak hours. Walang ganitong patakaran sa ibang platform, kaya maging mabuting makinig sa iyong pangunahing oras ng paggamit kapag bumibili.

5. Hindi suportado ang refund at pag-cancellation

Lahat ng mga platform na ito ay malinaw na ipinapahiwatig na walang refund o cancellation pagkatapos ng pag-subscribe; siguraduhing i-confirm ang iyong pangangailangan bago bumili. I-rekomenda na ang mga bagong user ay subukan muna ang mura na package para sa unang buwan at huwag bumili agad ng taunang plan.

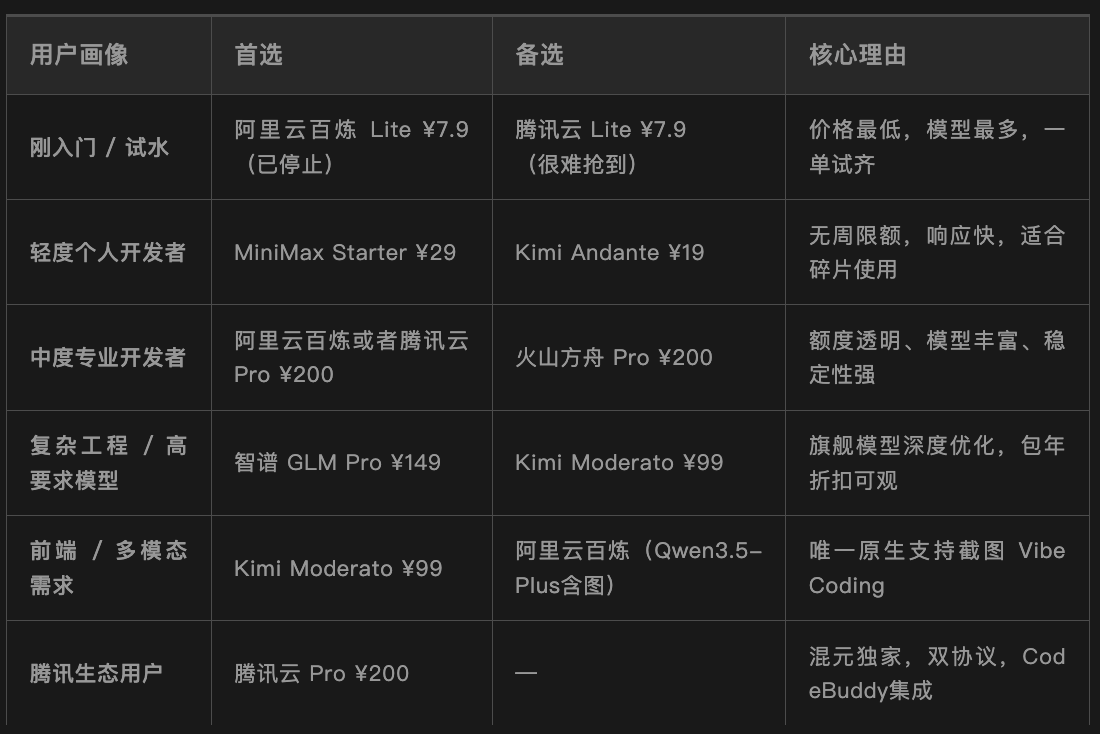

Gabay sa Paggawa ng Pagpili para sa Mga Gumagamit ng OpenClaw

Ang OpenClaw, bilang isang autonomous agent framework, ay may espesyal na mga pangangailangan sa Coding Plan na higit pa sa karaniwang IDE plugin: kakayahang tumanggap ng mataas na concurrency, matatag na pagtrato sa mahabang konteksto, at native na pagkakasundo sa Anthropic protocol (dahil ang OpenClaw ay disenyo na batay sa Claude protocol). Nakalista sa ibaba ang mga konkretong rekomendasyon ayon sa mga escenario ng paggamit.

🌱 Para sa mga nagsisimula

Rekomendasyon: Alibaba Cloud BAILIAN Lite - unang buwan ay ¥7.9 (nabawasan na), o Tencent Cloud - unang buwan ay 7.9 yuan

Unang pagkakataon na makakasali sa Coding Plan, nais kong subukan ang buong proseso ng OpenClaw sa pinakamababang gastos. Ang pagkakaiba-iba ng mga modelo ni Bailian (8) ay nagbibigay-daan sa iyo na subukan ang Qwen, GLM-5, at Kimi sa isang pakete lamang, na tumutulong sa mabilis na pagbuo ng intuitibong paghuhusga. Sa Alibaba Cloud, ang tanging available na pakete ay 200 yuan/buwan para sa Pro, samantalang sa Tencent Cloud, mayroon pa ring Lite na paketeng 7.9 yuan at 40 yuan; gayunpaman, ayon sa mga real na user, ang supply ay natutupad agad, kaya posibleng mas madaling makakuha ng 200 yuan/buwan na pakete.

💼 Daily Developer

Rekomendasyon: MiniMax Plus ¥49/bawat buwan

Mayroong mga nakatakdang programming task araw-araw, ngunit hindi ito patuloy na mataas na paggamit. Ang mabilis na response ni MiniMax (101 tokens/s) + ang Starter plan na walang lingguhang limitasyon, ang pinakamainam para sa mga piraso ngunit madalas na development rhythm.

⚡Matinding tuloy-tuloy

Rekomendasyon: Tencent Cloud o Alibaba Cloud Pro ¥200/buwan

Higit sa 6 na oras araw-araw na patuloy na pag-unlad, kailangan ng pagtrato sa malalaking codebase at kumplikadong Agent workflow. Ang 90,000 na monthly quota at 6,000 na quota bawat 5 oras ng Tencent/Bailian Pro ay ang pinakamainam na solusyon sa kombinasyon ng value-for-money at stability sa mga cloud platform.

🎨 Frontend/Multimodal

Rekomendasyon: Kimi Moderato ¥99/bawat buwan

Kailangan ng madalas na i-upload ang mga screenshot ng design at mga sketch ng UI para sa AI na analisahin at lumikha ng code. Ang Kimi-K2.5 ay ang tanging original package sa market ng Coding Plan na sumusuporta sa multi-modal input mula sa screenshot, angkop para sa frontend at Vibe Coding scenarios.

🔬 Komplikadong inhinyeriya

Rekomendasyon: ZhiPu GLM Pro ¥149/buwan

Ang mga escenario na nangangailangan ng pinakamataas na kakayahan ng modelo, tulad ng pagtrato sa malalaking monolithic projects, komplikadong pag-schedule ng Agent, at mataas na konkurensya sa automated testing. Ang laki ng parameter na 754B ng GLM-5 ay ang pinakamalaki sa mga open-source model sa bansa, at ang kakayahan nito sa coding ay malapit sa Claude Opus, habang ang matagalang gastos ay maaaring bawasan pa sa pamamagitan ng 70% discount sa taunang package.

Summary

Trading strategy

Ang merkado ng Domestic Coding Plan noong 2026 ay nasa gitna ng malakas na pakikidigma. Ang direktaing benepisyaryo ng pakikidigma sa presyo ay ang mga developer at gumagamit: maaari mong subukan ang maraming top-tier na modelo para sa mas mababa sa P10 sa unang buwan, na dati ay hindi isipin noong isang taon ang nakalipas.

Gayunpaman, ang pagbaba ng mga takip ng package ay hindi nangangahulugan na bumaba ang hirap ng pagpili: ang mga pagkakaiba sa yunit ng pagsukat, mga sembliyong patakaran sa limitasyon, at ang trend ng pagtaas ng presyo, ay lahat ng mga variable na kailangang mabuting isipin.

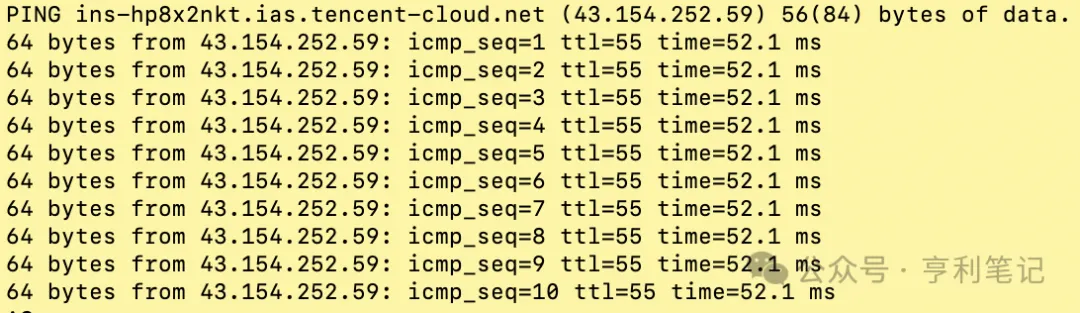

Isang mahalagang punto ay ang pagtingin kung aling serbisyo ng malaking modelo ang mas mabilis na i-access ng iyong OpenClaw machine. Ang pinakasimpleng paraan ay gamitin ang command na ping sa OpenClaw machine upang tingnan ang network latency at packet loss.

Halimbawa, ito ay pagsubok sa network mula sa OpenClaw host patungo sa Tencent Cloud endpoint, tandaan kung may packet loss sa icmp_seq at kung ang latency na time ay maliit:

$ ping api.lkeap.cloud.tencent.com

Batay sa nakaraang pagsusuri, isinummary namin ang sumusunod:

📌 Huling paalala

Ang datos sa artikulong ito ay hanggang sa huling araw ng Marso 2026. Dahil sa madalas na pagbabago sa polisiya ng presyo ng iba’t ibang platform (tulad ng pagtaas ng presyo ng Zhipu at ang paghinto sa bagong pagbili ng Alibaba Cloud BAILIAN Lite), mangyaring sundin ang pinakabagong pormal na pahayag ng bawat platform bago bumili. Ang lahat ng mga package ay hindi makakatanggap ng refund. I-rekomenda namin na magsimula sa mura na package para sa unang buwan para masubok ang compatibility ng tool at iyong paggamit bago gumawa ng matagalang plano.

Sa susunod, pag-uusapan natin ang iba’t ibang pagkakataong dapat isaalang-alang sa pag-deploy ng OpenClaw.