May-akda: Curry, Deep潮 TechFlow

Noong ilang araw ang nakalabas na litrato, naging viral sa internet.

Nilikha ng India ang isang AI summit, kung saan si Prime Minister Modi ay nasa entablado, may isang hanay ng mga pangunahing eksperto mula sa Silicon Valley sa kanyang mga gilid. Sa panahon ng pagkuha ng litrato, hinawakan ni Modi ang kamay ng kanyang kasama at itinataas ito sa itaas ng ulo, at sumunod din ang iba sa paghawak ng kamay—nagkakaroon ng isang malakas na pakikisama.

Ngunit, dalawa lang ang hindi nagkakapit.

Ang CEO ng OpenAI at ang CEO ng Anthropic, ang mga boss ng mga kumpanya sa likod ng ChatGPT at Claude, ay naka-stand sa tabi ng bawat isa, bawat isa ay hawak ang isang fist.

Hindi nagtatagpo ang mga kamay, hindi nagtatagpo ang mga mata, parang dalawang kaaway na pinagkakasundo ng guro na upo sa iisang upuan.

Ang mga kumpanyang ito ay nagkakalaban nang malakas sa mga nakalipas na taon; ang Claude ay gawa ng isang grupo na lumabas mula sa OpenAI, at ang dalawang kumpanya ay naglalaban para sa mga user, mga kliyente sa negosyo, at pagsasakop ng pondo. Noong panahon ng Super Bowl ng taong ito, nagbenta ang Anthropic ng espesyal na advertisement upang mapagtawanan ang ChatGPT dahil sa pagpapalabas nito ng mga ad.

Kaya hindi magkakahawak, normal lang.

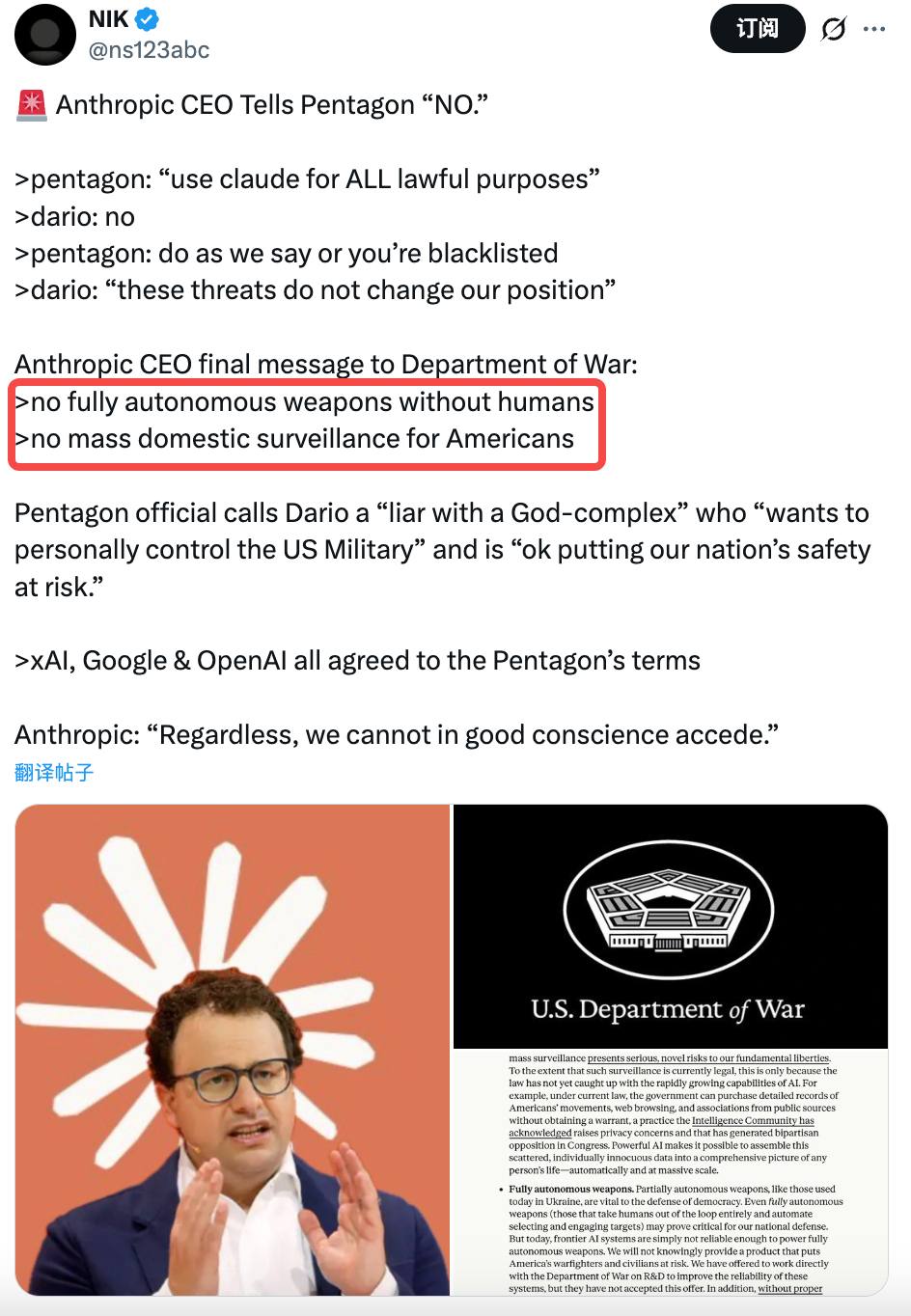

Ngunit ngayon, nagkaisa sila. Dahil sa Pentagon.

Ganito ang sitwasyon.

Anthropic, ang kumpanya sa likod ng Claude, ay nag-sign ng isang kontrata na may pinakamataas na halagang $200 milyon kasama ang Department of Defense ng Estados Unidos noong nakaraang taon. Ang Claude ay ang unang AI model na ipinadeploy sa militar na lihim na network upang tulungan sa pagproseso ng analisis ng intelihensya, pagpaplano ng misyon, at iba pang gawain.

Ngunit isinagawa ng Anthropic ang dalawang pula sa kontrata:

Hindi maaaring gamitin ang Claude para sa malawakang pagmamasid sa mga mamamayan ng Estados Unidos, o para sa mga autonomous na sandata na walang tao na kasali. (Tingnan ang karagdagang pagbabasa: Anthropic identity crisis: 72 hours)

Ngunit hindi tinanggap ng Pentagon.

Ang kanilang hiling ay apat na salita: walang limitasyon. Kapag bumili ka ng kasangkapan, dapat libre mong gamitin—bakit may karapatan ang isang tech company na sabihin sa US military kung ano ang pwede o hindi pwedeng gawin?

Noong Martes ng nakaraang linggo, ibinigay ng Kalihim ng Depensa na si Hegseth ang huling paalala sa CEO ng Anthropic: sumang-ayon bago ang 5:01 p.m. ng Biyernes, o magdudulot ito ng mga konsekwensya.

Hindi sumang-ayon ang Anthropic.

Ang kanilang CEO ay naglabas ng pampublikong pahayag na nagsasabi: Alam namin ang kahalagahan ng AI sa depensa ng Estados Unidos, ngunit sa ilang mga kaso, ang AI ay nakakasira at hindi nagtatanggol sa mga halagang demokratiko. Hindi namin kayang tanggapin ang hiling na ito sa pamamagitan ng aming konsensya.

Ang tagapag-negosyo ng Pentagon, Deputy Secretary of Defense Emil Michael, ay sumulpot sa social media at tinawag siyang mandaraya, sinasabing may messianic complex siya at pinapaloko ang pambansang kaligtasan.

Kapansin-pansing pagkakasundo

Pagkatapos, nangyari ang hindi inaasahan.

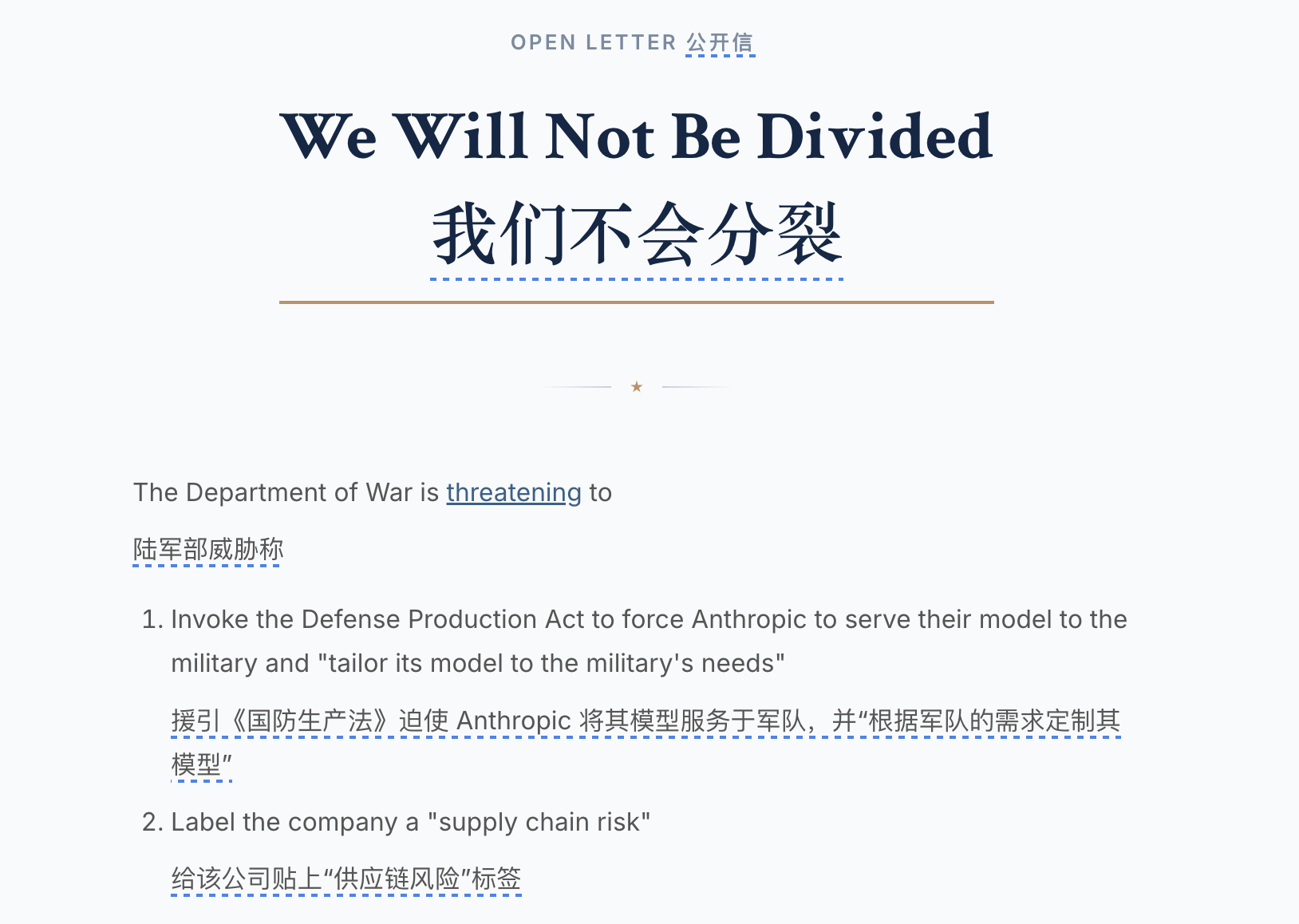

Higit sa 400 na empleyado ng OpenAI at Google ang nag-sign ng isang bukas na liham na may pamagat na "Hindi Tayo Ihihiwalay".

Sinasabi sa liham na nagpapalabas ang Pentagon sa bawat isang AI company upang hilingin ang mga kondisyon na tinanggihan ni Anthropic, at gagamitin ang takot upang hiwalayin ang bawat kumpanya.

Ang CEO ng OpenAI ay nagpadala rin ng internal na liham sa lahat ng empleyado, na nagsasabi na ang OpenAI ay may parehong red line tulad ng Anthropic:

Hindi sa malawakang pagmamasid, hindi sa sariling makapagpapatay na armas.

Dalawang kumpanya na hindi nagkakasundo ilang araw ang nakalipas ay biglang nagsama dahil sa Pentagon.

Ngunit ang pagkakaisang ito, maaaring magtagal lamang ng ilang oras.

Biyernes, 5:01 PM, natapos ang huling babala ng Pentagon. Hindi nila sinagot ang Anthropic.

Isang amerikanong teknolohiyang kumpanya na may halaga na $38 bilyon, na tumanggi sa Department of Defense ng Estados Unidos habang nagsasalig sa panganib na mawawala ang kontrata na $2 bilyon. Sa nakaraan, ang ganitong sitwasyon ay kung ano-ano lang ay pagkansela ng kontrata at pagpapalit ng supplier. Ngunit ang reaksyon ng Washington ay hindi kahit anong komersyal na antas ngayon.

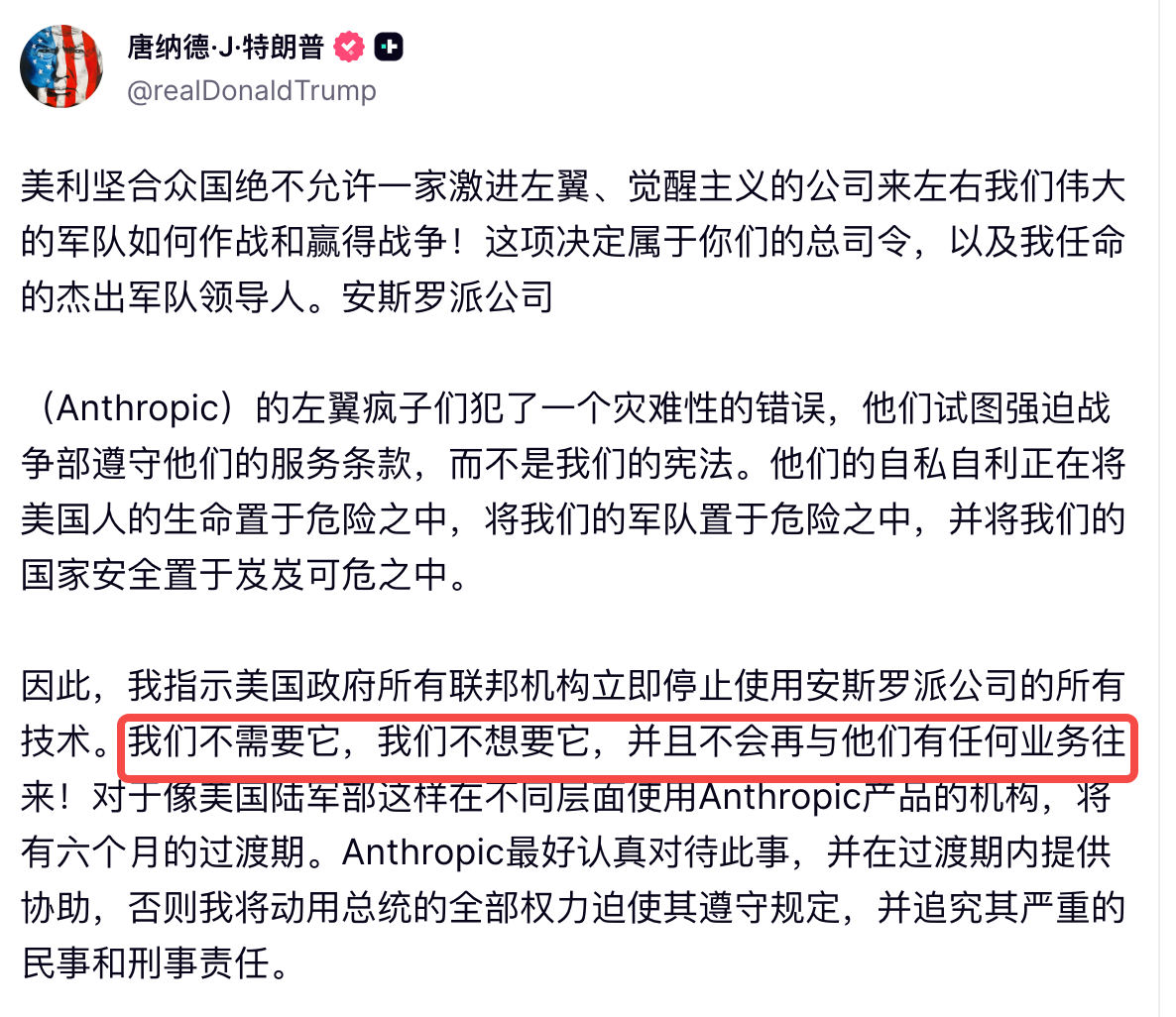

Isinulat ni Trump ang isang post sa Truth Social nang isang oras na ang kalabasan, tinawag si Anthropic bilang "mga kaliwang utak," at sinabi niya na sila ay sinusubukang magmataas sa saligang batas at maglaro ng buhay ng mga sundalo ng Estados Unidos.

Hiningi niya na agad na ipagpatawal ng lahat ng pambansang ahensya ang teknolohiya ni Anthropic.

Agad, ipinahayag ng Secretary of Defense ng Estados Unidos na si Hegseth ang paglalagay ng Anthropic bilang "panganib sa kaligtasan ng supply chain". Ang tatak na ito ay karaniwang ginagamit para sa mga kumpanya tulad ng Huawei. Malinaw ang kahulugan: ang lahat ng mga kontratista na nagtatrabaho kasama ang militar ng Estados Unidos ay hindi na maaaring gamitin ang mga produkto ng Anthropic.

Sinabi ng Anthropic na gagawa sila ng kaso.

Ngunit sa parehong gabi, ang OpenAI, na dati ay nananatili sa parehong posisyon, ay nag-sign ng kasunduan sa Pentagon.

Mga isyu ng ideolohiya

Ano ang natanggap ng OpenAI?

Ang posisyon na natirang ni Claude: Tagapagbigay ng AI para sa militar na lihim na network ng US. Gayunpaman, nagbigay ang OpenAI ng tatlong kondisyon sa Pentagon: walang malawakang pagmamasid, walang awtonomong armas, at ang mga desisyon na may mataas na panganib ay kailangan ng tao.

Sabi ng Pentagon, okay.

Hindi ka nalito. Ang mga kondisyon na hindi tanggapin ng Anthropic sa loob ng ilang linggo, agad na nalutas sa loob ng ilang araw kapag inihain ng ibang kumpanya?

Hindi ganap na magkakatulad ang dalawang solusyon.

Kinakailangan ng Anthropic ang isang karagdagang hakbang: naniniwala sila na ang kasalukuyang batas ay hindi nakakasabay sa kakayahan ng AI, tulad ng pagkakaroon ng kakayahang bumili at i-aggregate nang legal ang iyong data ng lokasyon, kasaysayan ng pag-browse, at impormasyon sa social media, na nagtatapos sa isang epekto na katumbas ng pagmamasid, ngunit ang bawat hakbang ay legal.

Sinabi ng Anthropic na hindi sapat ang pagsulat ng "hindi nagmamonitor" lang, kailangan ay mabawasan ang butas na ito. Hindi sumunod ang OpenAI sa puntos na ito, at tinanggap nila ang pananaw ng Pentagon na sapat na ang kasalukuyang batas.

Ngunit kung paniniwalaan mo na ito ay isang pagkakaiba lang sa mga tuntunin, masyadong nakakapagod. Ang mga negosasyon ay hindi lamang tungkol sa mga tuntunin mula sa simula.

Ang White House AI Czar na si David Sacks ay nagkomento na sa publiko tungkol sa Anthropic na nagtatayo ng "woke AI" (una ang ideolohiya, ang paggawa ng politikal na korekto); may mataas na opisyales sa Pentagon na sinabi sa media na ang problema ni Dario ay ideolohikal na dinadala, "alam namin kong sino ang aming kinakaharap."

Ang xAI ni Elon Musk, na direktang kalaban ng Anthropic, ay paulit-ulit na nag-atake sa Anthropic sa X, sinasabing ang kompanyang ito ay "nagmamalasakit sa kanlurang kabihasnan".

Ang CEO ng Anthropic ay hindi dumalo sa pagtanggap sa puwesto ni Trump noong nakaraang taon. Dumalo ang CEO ng OpenAI.

Ipinapakita ang pagkakasala ng isang tao upang iwasan ang iba

Kaya ayusin natin ang nangyari.

Sa parehong prinsipyo, sa parehong pula, kinilala si Anthropic bilang isang kaparehong panganib sa pambansang kaligtasan ng Estados Unidos tulad ng Huawei dahil sa isang karagdagang antas ng pagiging maingat, pagkakamali sa pagpili ng panig, at maling pagkakaposisyon.

Kulang ang OpenAI ng isang antas, magandang ugnayan, natanggap ang kontrata. Sabi mo, ito ba ang tagumpay ng prinsipyo, o pagtatakda ng prinsipyo?

Hindi ito ang unang pagkakataon na binaril ang kontrata ng Pentagon.

Noong 2018, may higit sa 4,000 na empleyado ng Google ang nilagdaan ang petition, at ilan sa mga ito ay umalis, upang ipagtanggol laban sa pagkakaaliw ng kumpanya sa isang proyekto ng Pentagon na tinatawag na Project Maven. Ang proyektong iyon ay gumagamit ng AI upang masuri ang mga video na kinuha ng drone, upang tulungan ang militar na mas mabilis na matukoy ang mga layunin.

Natapos na ang Google. Wala nang pagpapalawig, umalis na. Nanalo ang mga empleyado.

Naalis na ang 8 taon, bumalik ang parehong kontrobersya. Ngunit sa pagkakataong ito, ganap na nagbago ang mga patakaran. Isang Amerikanong kumpanya ang nagsabing maaari kong gawin ang negosyo ng militar, ngunit may dalawang bagay na hindi ko dapat gawin. Ang tugon ng pamahalaan ng Estados Unidos ay ang pag-alis sa kanya sa buong pambansang sistema.

At ang epekto ng label na "panganib sa kaligtasan ng supply chain" ay higit pa sa pagkawala ng isang kontrata na halagang $200 milyon.

Ang kita ng Anthropic sa taong ito ay umabot sa halos $14 bilyon, at ang $200 milyong kontrata ay hindi kahit anumang bahagi nito. Ngunit ang mensahe ng label na ito ay ang anumang kumpanya na may negosyo sa US military ay hindi makakagamit ng Claude.

Hindi kailangan ng mga kumpanyang ito na sumang-ayon sa pananaw ng Pentagon; kailangan lang nilang gawin ang isang pagtataya ng panganib: ang pagpapanatili sa Claude ay maaaring magdulot ng pagkawala ng mga gobyerno contract; ang pagpapalit sa isang ibang modelo ay walang anumang problema.

Ang pagpili ay madali. Ito ang tunay na signal sa bagay na ito.

Hindi mahalaga kung kayang tanggihan ng Anthropic, mahalaga kung magkakaroon pa ng susunod na kumpanya na magdudulot. Sasubaybayan nito ang resulta, makikita ang gastos ng pagpapahalaga sa mga prinsipyo, at gagawa ng napakaraming rasyonal na desisyon.

Bumalik sa larawan ng India, lahat ay nakahawak-hawak ng kamay at itinataas sa itaas ng ulo, ngunit sila ay may sariling nagsasakop na pugad.

Maaaring ito ang normal.

Maaaring magkaroon ng parehong prinsipyo ang mga kumpanya ng AI, ngunit hindi naman siguradong magkakasama ang mga kamay.