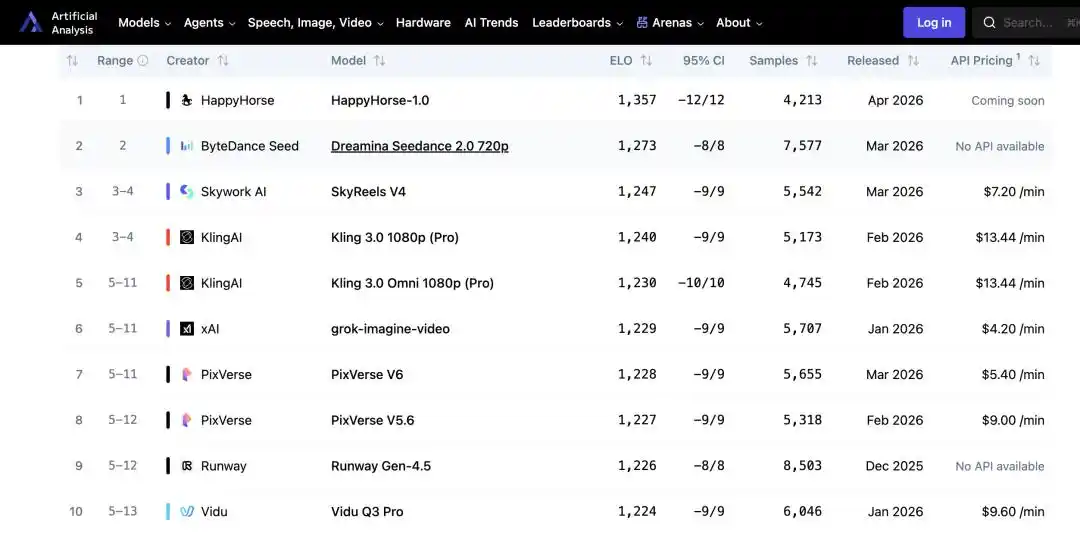

Walang press conference, walang teknikal na blog, walang suporta mula sa anumang kumpanya—ang isang text-to-video model na tinatawag na HappyHorse-1.0, ay nagsakop nang tahimik sa leaderboard ng AI Video Arena ng prestihiyosong AI evaluation platform na Artificial Analysis, na may mas mataas na Elo score kaysa kay Seedance 2.0, at pinaglalabasan ang mga pangunahing player tulad ng Keling at Tiangong, na nagdulot ng isang “kompetisyon sa paglutas” sa loob ng teknikal na komunidad.

Hindi ang pagkakaroon ng Artificial Analysis ay isang pagsusuri ng teknikal na parameter, kundi isang kabuuan ng Elo score mula sa mga blind test ng totoong mga gumagamit, na nagpapakita ng totoong pagkakaintindi ng karaniwang tao pagkatapos makita ito. Nagiging mas mahirap pang-iiwasan ang pagtatala na ito kaysa sa karaniwang listahan ng performance score, at nagiging isang tanong na hindi maaaring iwasan ang “Sino ba talaga ang gumawa nito?”

Ang "Happy Horse" ay biglang naging numero uno, nagpapalabas ng kompetisyon sa paglutas ng palaisipan sa tech community

Mabilis ang mga spekulasyon sa X. Ang unang napansin ay ang pagkakasunod-sunod ng wika sa opisyal na website: ang Mandarin at Cantonese ay nasa harap ng Ingles. Para sa isang produkto na nakatuon sa mga gumagamit sa buong mundo, ang pagkakasunod-sunod na ito ay kakaiba—kung ang pangunahing team ay mula sa Amerika, halos imposible na hindi ang Ingles ang nasa unahan. Maaaring matiyak na ang team sa likod ay mula sa Tsina.

Ang pangalan mismo ay isang patunay. Ang taong 2026 ay taon ng Kabayo sa kalendaryong Liwanag, at ang pangalan na “HappyHorse” ay naglalaman ng hindi masyadong subtil na tugma sa taon ng Kabayo—noong simula ng taon, ang “Pony Alpha” ay gumamit din ng parehong taktika. Kaya agad lumalawak ang listahan ng mga suspek: ang mga tagapagtatag ng Tencent at Alibaba ay parehong may apelyido na “Ma,” kaya naturally kasali; may ilan na naniniwala sa Xiaomi, dahil sa paniniwala na si Lei Jun ay karaniwang mapagkunwari at mahilig magpapakita nang biglaan; at may ilan ring naniniwala na mas nauugnay ito sa DeepSeek, dahil dati nang pinalabas nito nang tahimik ang isang visual model, at pagkatapos ay pinalabas naman nang tahimik. Ang bawat teorya ay puno ng gulo, ngunit wala sa kanila ang may tiyak na ebidensya.

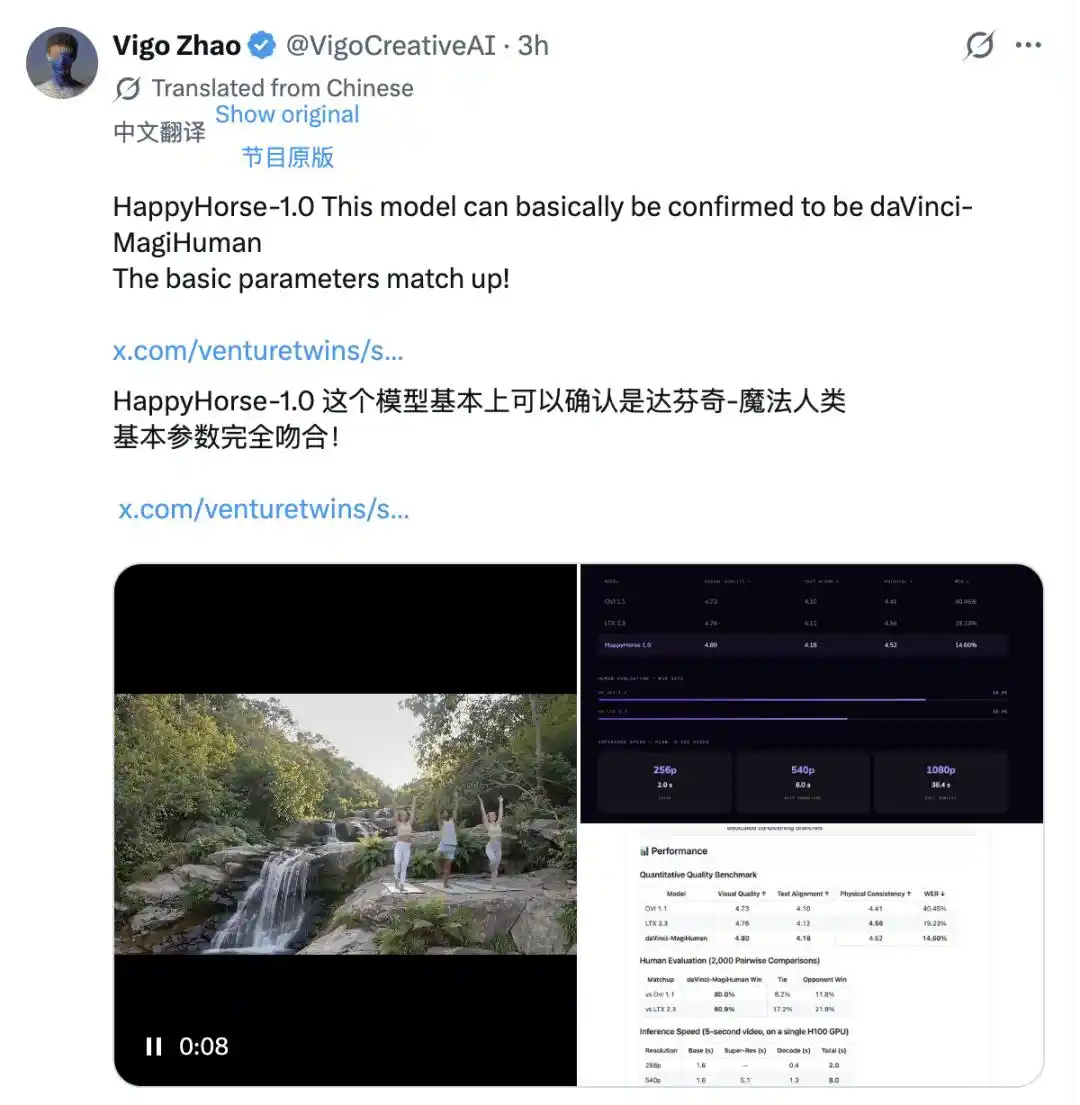

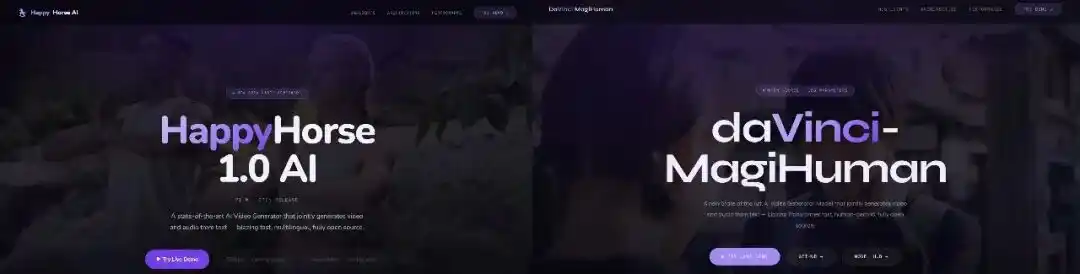

Ang totoong pagtukoy sa target ay ang detalyadong paghahambing sa teknikal na lebel. Ang X user na si Vigo Zhao ay kinuha ang pampublikong benchmark data ng HappyHorse-1.0 at isinama ito sa paghahambing sa mga kilalang modelo, at natagpuan niya ang isang mataas na pagkakatugma: daVinci-MagiHuman, o ang open-source na modelo na “daVinci Magic Human” na inilunsad sa Github noong Marso.

Kalidad ng visual na 4.80, pagkakasunod ng teksto na 4.18, pisikal na pagkakatugma na 4.52, rate ng pagkakamali sa pagsasalita na 14.60%—ang dalawang set ng datos ay tumutugma nang isang-isa sa bawat detalye. Ang istruktura ng website ay halos magkakapareho rin: ang paraan ng pagpapakita ng deskripsyon ng arkitektura, talahanayan ng performance, at video demo, ay tila galing sa iisang template. Parehong single-stream Transformer architecture, parehong joint audio-video generation, at parehong listahan ng mga suportadong wika. Ang antas ng pagkakatulad na ito ay mahirap ipaliwanag bilang pagkakataon.

Ang pinakamataas na kilalang konklusyon sa teknikal na komunidad ay ang HappyHorse ay isang iterasyon na binuo ng Sand.ai, isang ko-developer ng daVinci-MagiHuman, na batay sa open-source model, na may pangunahing layunin na subukan ang pinakamataas na kakayahan ng model sa tunay na pagkakaintindi ng user, upang maghanda para sa susunod na komersyal na pagpapatupad.

Ang daVinci-MagiHuman ay opisyal na inilabas bilang open source noong Marso 23, 2026, at ito ay produkto ng pakikipag-ugnayan ng dalawang batang koponan. Isa sa mga ito ay ang Generation Artificial Intelligence Research Laboratory (GAIR) ng Shanghai Institute of Intelligence (SII), na pinunuan ni Akademiko Liu Pengfei; at ang isa pa ay ang Sand.ai (San Dai Technology) mula sa Beijing, na itinatag ni Cao Yue, na may akademikong background, at ang direksyon ng kumpanya ay ang autoregressive world model.

Ginagamit ng modelo ang 15 bilyon na parameter na pure self-attention single-stream Transformer, na naglalagay ng lahat ng token mula sa teksto, video, at audio sa iisang sequence para sa joint modeling—hindi pa nakakapagawa ang open-source community ng totoong joint audio-video pre-training mula sa zero; karamihan ay nagpapalit-palit lamang sa mga single-modal na batayan.

Paano nagawa ng isang open-source video model ang pagbabalik sa loob ng dalawang linggo?

Pagkatapos malaman ang identity, mas mahirap sagutin ang isa pang tanong: Bakit kayang makakuha ng mas mataas na Elo score kaysa sa Seedance 2.0 ang HappyHorse-1.0 sa loob ng dalawang linggo lamang, habang ang daVinci-MagiHuman ay bago lang na-open source noong Marso?

Batay sa mga impormasyon na inilabas ng opisyal na website, hindi nagbago ang HappyHorse sa kanyang pangunahing arkitektura; mas makatotohanang palagay ay ginawa niya ang espesyal na pagpapalit sa default generation strategy para sa mga pagsusuri.

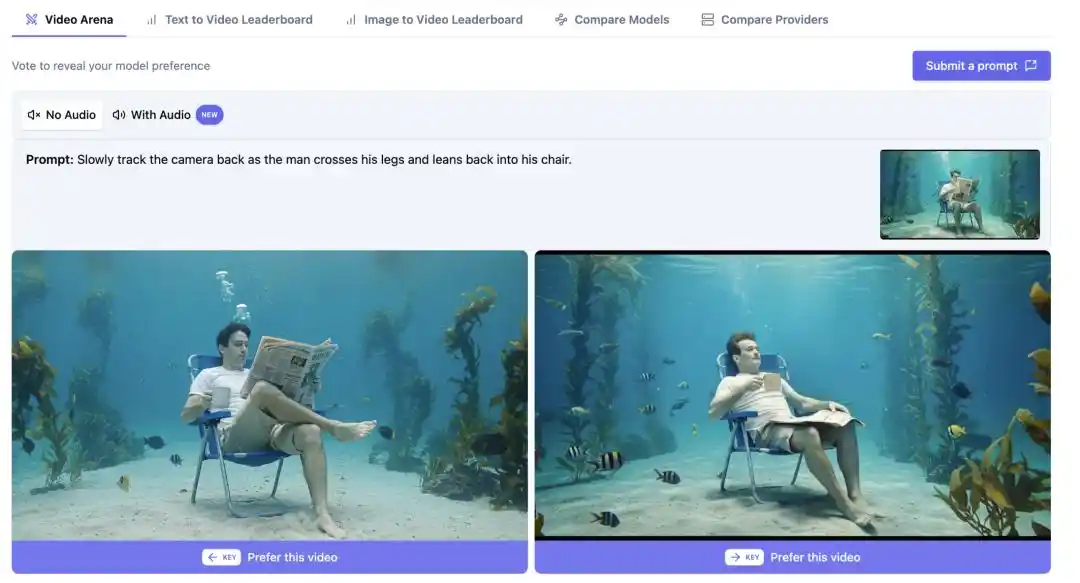

Ang Elo system ay batay sa kumulatibong pagpili ng mga gumagamit—kung ang ekspresyon ng karakter ay stable o hindi, kung ang audio at video ay naka-sync, at kung ang larawan ay kasiya-siya sa paningin, ang paggawa ng kaunting pagpapabuti sa mga sensitibong aspetong ito ay nagpapataas ng posibilidad na piliin ito sa blind test. Hindi nagbago ang maximum na kakayahan ng modelo, ngunit ang “paggawa sa pagsusuri” ay maaaring palakasin.

Sa totoo lang, higit sa 60% ng mga sample sa blind test ng Artificial Analysis ay mga larawan ng tao at nilalaman na may pagsasalita, at ang daVinci-MagiHuman ay nakatuon agad sa paggawa ng mga larawan ng tao mula sa pagtatapos ng pagsasanay, kaya't ito ay may likas na kahusayan sa mga ganitong sitwasyon—ito ang pangunahing dahilan kung bakit ito ang may pinakamataas na rate ng pagtatagumpay sa blind test; kung ang mga sample sa blind test ay pangunahing nakatuon sa malapit na larawan ng mukha, ang mga modelo na mahusay sa paggawa ng mga tao ay magkakaroon ng sistematisadong pakinabang, na walang direkta ugnayan sa kanilang tunay na pagganap sa mas kumplikadong mga sitwasyon tulad ng maraming tauhan, masalimuot na paggalaw ng kamera, at mahabang panahon ng pagsasalaysay.

Nakikita ang malaking pagkakaiba sa pagitan ng mga numero sa leaderboard at ang tunay na pagsubok, at nahati ang mga nag-uusap sa X sa dalawang pangkat. Ang mga nag-aalala ay naniniwala pagkatapos ng pagsubok na mayroon pa ring makikita pang pagkakaiba sa HappyHorse-1.0 at Seedance 2.0 sa detalye ng mga karakter at pagkakasunod-sunod ng galaw, at dahil dito ay nagtatanong sila kung ang Elo rating ay may kahulugan.

Samantala, ang mga tagasuporta ay may malaking pag-asa sa potensyal ng HappyHorse na lutasin ang industriyal na hamon ng “consistency sa kalidad ng imahe sa multi-shot sequences,” dahil ito ay isang problema na hindi pa nasosolusyonan ng mga pangunahing video model sa kasalukuyan; kung talagang may pagbabago ang daVinci-MagiHuman dito, maaaring mas mahalaga ito kaysa sa isang posisyon sa listahan.

Hindi dapat malikha ng mga numero ang mga limitasyon ng modelo mismo. Ang blogger sa Xiaohongshu @JACK’s AI World ay agad nang isinampa at sinubukan ang daVinci-MagiHuman. Natuklasan niya na kailangan nito ang H100, at halos imposible para sa karaniwang consumer-grade GPU, bagaman pinag-aaralan ng komunidad ang mga solusyon sa quantization, ang pag-deploy sa lokal ay may hirap pa rin para sa mga indibidwal na user sa maikling panahon.

Sa konteksto nito, kasalukuyang mas mahusay ito sa isang tao lamang; kapag may maraming tao o mas kumplikado ang escena, bumababa ang kalidad—hindi ito problema na maaayos sa pagtutugma, at direktang kaugnay ito sa disenyo nito na nakatuon sa mga larawan ng tao. Karaniwang 10 segundo lang ang haba ng pagbuo, at mas mahaba kaysa sa iyon ay maaaring magdulot ng kalituhan; ang mataas na kalidad na output ay kailangan pa rin ng plugin para sa super-resolution.

Ayon sa AI View ni @JACK, mas mababa ang pangkalahatang pagkakamaliwanag ng daVinci-MagiHuman kumpara sa LTX 2.3, at kailangan maghintay hanggang sa ma-optimize ng komunidad ang quantification bago ito maging angkop para sa pang-araw-araw na paggamit.

Ang video generation niche, ba ay naghintay ng totoong “catfish”?

Totoo lang, ang pagiging nangunguna sa isang listahan ay hindi masyadong nagpapakita ng marami. Kailangan pang subukan ni HappyHorse ang kanyang katatagan, bilis sa mataas na pagkakasundo, pagkakatulad sa iba’t ibang escena, tiyak na kontrol sa mga karakter, at kakayahang umabot sa labas ng mga pagsusuri—ito ang mga pangunahing tuntunin na magpapasiya kung makakapasok ba ang isang modelo sa workflow ng mga tagagawa.

Ngunit kung iuunlad ang pananaw sa mas malaking larangan ng industriya, ang mensahe na ipinapadala nito ay sapat na malinaw.

Ang pagbubukas ng video model ay hindi bagong bagay. Ngunit laging may malaking pagkakaiba sa kalidad sa pagitan ng open-source at closed-source—sa mga sitwasyon kung деkailangan magbigay sa kliyente, ang kalidad ng output ng open-source models ay habang-habang hindi nakakapagpasok sa hangganan mula sa “gamit” patungo sa “maaaring ipagkaloob.” Ang pagtatakda ng presyo ng mga closed-source produkto tulad ng Ke Ling at Seedance ay batay sa malaking pagkakaiba na ito.

Ang kahalagahan ng pagkakataong ito ay ang isang produkto batay sa open-source model ay unang nakapag-ambag nang direkta sa mga leaderboard ng blind test na batay sa tunay na pakiramdam ng mga user, na nagtatagpo sa mga pangunahing proprietary na kalaban. Anuman ang dami ng pag-optimize para sa mga pagsusuri, para sa mga proprietary na vendor na nagtatayo ng kanilang pricing power sa pagkakaiba na ito, ito ay isang signal na dapat seriyosong tandaan.

Para sa mga developer, ang punto na ito ay may mas tiyak na kahulugan. Sa mga espesipikong aplikasyon tulad ng mga tao, digital humans, at virtual streamers, kapag ang kalidad ng pagbuo ng open-source base ay umabot sa “maaaring ipasa” na antas, magkakaroon ng malaking pagbabago sa istruktura ng gastos sa sariling deployment—hindi lamang ang pagbawas sa gastos sa pagtawag sa API, kundi mas mahalaga ang pagpapalakas ng kontrol sa sarili sa mga data, modelo, at proseso ng inference, na nagbibigay ng fleksibilidad na hindi kayang ibigay ng mga saradong solusyon sa antas ng pag-customize at pagkakasunod sa privacy.

Hindi magiging malaking banta ang HappyHorse-1.0 sa posisyon ng Seedance 2.0 o Keling sa maikling panahon, ngunit kapag napatunayan na ang mga open-source model ay maaaring magbigay ng kahalintulad na epekto sa mga closed-source, magpapatuloy ang komunidad sa pagpapabuti, pagmumula sa espesipikong pagtuturo, at pagpapabilis ng pag-iisip nang mas mabilis kaysa sa mga closed-source product.

Sa taon ng Kabayo, ang tunay na dapat pagtuunan ng pansin ay hindi kung aling kabayo ang pinakamabilis, kundi ang track mismo ay nagiging mas malawak.

Nakakuha ng artikulong ito mula sa WeChat public account na "AI Value Officer", may-akda: Xingye, editor: Meiqi