May-akda: Chen Junda

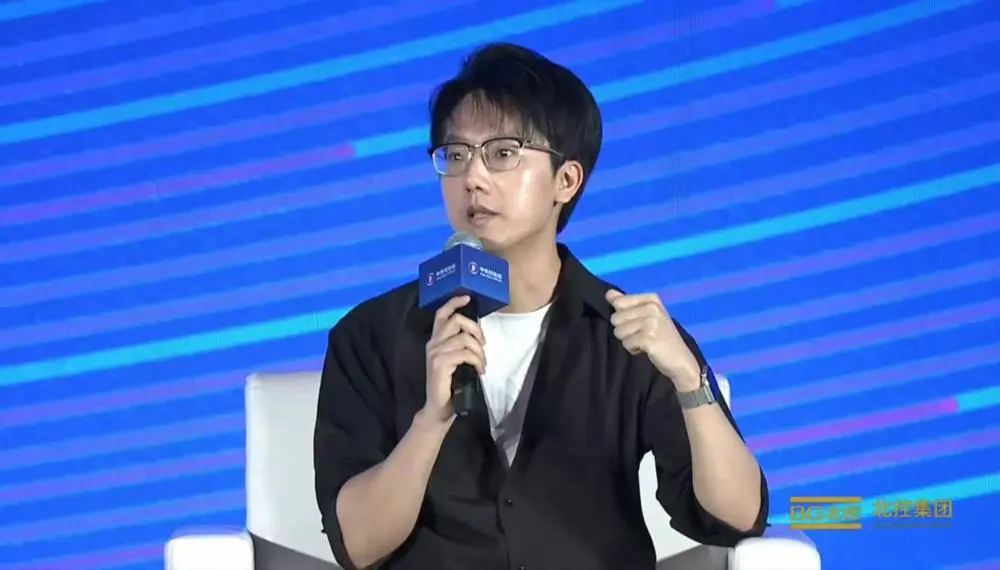

Ikinahayag ng Zhixidong sa Marso 27, ngayon, sa Zhongguancun Forum, si Zhang Peng, CEO ng Zhipu, si Yang Zhilin, CEO ng Moonshot (na nagsilbing tagapag主持), si Luo Fuli, head ng MiMo large model ng Xiaomi, si Xia Lixue, CEO ng Wuwen Xinqiong, at si Dr. Huang Chao, assistant professor sa University of Hong Kong, ay nagkita nang magkasama sa isang malalim na talakayan tungkol sa hinaharap ng open-source large models at agents.

Sinimulan ang talakayan sa pinakamalakas na OpenClaw sa kasalukuyan, at sang-ayon ang mga bisita na ang mga agent ay nagpapagsimula na talaga ng “paggawa” ng malalaking modelo. Ang OpenClaw ay nagpapalawak sa hangganan ng kakayahan ng malalaking modelo, ngunit nagtataglay din ng mas mataas na hiling sa mga modelo; ang Zhizhi ay nag-aaral ng mga kakayahan tulad ng mahabang pagpaplano at self-debugging, habang ang koponan ni Luo Fuli ay mas nakatuon sa pagbaba ng gastos at pagpapabilis ng bilis sa pamamagitan ng pag-innoBato sa arkitektura, kahit na makamit ang self-evolution ng modelo.

Kailangan ding sumunod ang imprastruktura sa ritmo ng mga agent. Naniniwala si Xia Lixue na ang kasalukuyang mga sistema ng computing power at software architecture ay para sa mga tao, hindi para sa mga agent—totoo namang pinipigilan ng kakayahan ng tao sa paggawa ng mga aksyon ang espasyo para sa pag-unlad ng mga Agent. Kaya kailangan nating lumikha ng Agentic Infra.

Sa pananaw ng maraming bisita, ang open source ay isa sa pangunahing pwersa na nagpapalago sa mga malalaking modelo at mga agent. Si Assistant Professor Huang Chao ng University of Hong Kong ay naniniwala na ang pag-unlad ng open source ecosystem ay susi sa paglipat ng mga agent mula sa “pagsayaw” patungo sa tunay na “manggagawa”—tanging sa pamamagitan ng kolaborasyon ng komunidad ang maaaring ilipat ang software, data, at teknolohiya sa isang agent-native na anyo, at sa huli ay bumuo ng isang mapagkakatiwalaang pandaigdigang AI ecosystem.

Bukod dito, pinag-usapan din ng ilang guest ang pagtaas ng presyo ng malalaking modelo, ang pagpapalaki ng paggamit ng token, at ang mga pangunahing salita para sa AI sa susunod na 12 buwan. Narito ang mga pangunahing pananaw mula sa panel discussion:

1. Zhang Peng: Pagkatapos lumaki ang modelo, tumataas din ang gastos sa pagpapatakbo; ang pagtaas ng presyo ni Zhipu ay isang pagbabalik sa tamang komersyal na halaga, at ang matagalang pakikisalo sa mababang presyo ay hindi nakakatulong sa pag-unlad ng industriya.

2. Zhang Peng: Ang paglago ng mga bagong teknolohiya tulad ng mga agent ay nagdulot ng 10-fold na pagtaas sa paggamit ng token, ngunit ang tunay na pangangailangan ay maaaring tumaas ng 100-fold, at mayroon pa ring malaking pangangailangan na hindi pa natutugunan, kaya ang computing power ay patuloy na isang mahalagang isyu sa susunod na 12 buwan.

3. Luo Fuli: Mula sa pananaw ng mga tagapaglikha ng pangunahing malaking modelo, nagtataguyod ang OpenClaw ng mababang antas ng pangunahing malaking modelo at itinataas ang mataas na antas. Ang pagkumpleto ng gawain ng mga lokal na bukas na modelo + OpenClaw ay naging halos katulad na ng Claude.

4. Luo Fuli: Binigyan ng tapang at tiwala ni DeepSeek ang mga lokal na manufacturer ng malalaking modelo. Ang ilang inobasyon sa istruktura ng modelo na tila “kompromiso para sa efficiency” ay nagdulot ng tunay na pagbabago, na nagpapahintulot sa industriya na makamit ang pinakamataas na antas ng inteligensya sa ilalim ng limitadong computing power.

5. Luo Fuli: Ang pinakamahalagang bagay sa paglalakbay ng AGI sa susunod na taon ay ang “self-evolution.” Ang self-evolution ay nagpapahintulot sa malalaking modelo na mag-explora tulad ng mga lider na siyentipiko, at ito ang tanging paraan upang “likhain ang bagong bagay.” Nakatulong na si Xiaomi sa pamamagitan ng Claude Code+ ng mga lider na modelo upang pataasin ang efisyensiya ng pananaliksik ng 10 beses.

6. Xia Lixue: Kapag dumating ang panahon ng AGI, ang lahat ng imprastruktura ay dapat maging isang agent, na may kakayahang magmaneho nang sarili sa buong imprastruktura, at i-iterate ang imprastruktura batay sa pangangailangan ng mga AI na kliyente upang makamit ang sariling pag-unlad at sariling pag-itera.

7. Xia Lixue: Ang OpenClaw ay nag-ignite sa paggamit ng token. Ang kasalukuyang bilis ng pagkonsumo ng token ay parang noong unang panahon ng 3G, kung saan ang buwanang quota ng data sa mobile ay lamang 100MB.

8. Huang Chao: Sa hinaharap, maraming software ay hindi na para sa mga tao; ang software, data, at teknolohiya ay magiging Agent-Native sa anyo nito, at ang mga tao ay maaaring kailanganin lamang gamitin ang mga “GUI na nagpapaligaya sa kanila.”

Narito ang buong transkripsyon ng panel discussion:

01. Ang OpenClaw ay isang “scaffold”, at ang pagkawala ng token sa malalaking modelo ay nasa panahon pa rin ng 3G

Yang Zhilin: Malugod kong inanyayahan ang mga bisita naming mahalaga ngayon; ang ilan sa mga bisita ay mula sa layer ng model, layer ng computing power, hanggang sa layer ng agent. Ang pangunahing keyword ngayon ay open source, at ang agent.

Unang tanong: Tungkol sa kasalukuyang pinakapopular na OpenClaw, ano ang pinakamalikhaing o nakakaimpresyon mong punto sa paggamit ng OpenClaw o mga katulad nito sa araw-araw? Paano mo pinapahalagahan ang pag-unlad ng OpenClaw at mga kaugnay na Agent mula sa teknikal na pananaw?

Zhang Peng: Mula pa noong maagang panahon, nagsimula na akong maglaro ng OpenClaw, noong tawag pa ito sa Clawbot. Ako mismo ang nag-eksperimento, dahil programmer din ako, kaya mayroon akong sariling karanasan sa paglalaro ng mga bagay na ito.

Ang pinakamalaking pagbabago o kagulayan na dinala ni OpenClaw sa lahat ay ang katotohanan na hindi na ito eksklusibo para sa mga programmer o mga geek. Maaari rin ng karaniwang tao na gamitin nang mas madali ang kakayahan ng mga pinakamataas na modelo, lalo na sa aspeto ng pag-program at mga agent.

Kaya sa pagkakasundo ko hanggang sa ngayon sa pag-uusap ko sa inyo, mas gusto kong tawagin ang OpenClaw bilang “scaffold”. Ito ay nagbibigay ng isang posibilidad, nagtatayo ng isang matibay, madali, ngunit maluwag na scaffold sa ibabaw ng modelo. Maaari ninyong gamitin ang maraming nakakagiliw na tampok na ibinibigay ng mga pangunahing modelo ayon sa inyong sariling kagustuhan.

Nakita ko na ang aking mga ideya ay maaaring limitado dahil sa kakulangan sa paggawa ng code o kakulangan sa iba pang kaugnay na kasanayan, ngayon may OpenClaw na, maaari ko na ito tapusin sa pamamagitan ng napakasimpleng pakikipag-ugnayan.

Ang OpenClaw ay nagdala ng malaking epekto sa akin, o kaya ay nagbigay sa akin ng bagong pag-unawa sa bagay na ito.

Xia Lixue: Sa totoo lang, hindi ako nakakatugon nang maayos nung unang ginamit ko ang OpenClaw, dahil nakakadisipasyon ako sa paraan ng pakikipag-usap sa malalaking modelo; pagkatapos gamitin, naniniwala ako na mabagal ang reaksyon ng OpenClaw.

Ngunit pagkatapos ay nalaman ko ang isang problema: ito ay may malaking pagkakaiba sa dating chatbot, dahil ito ay isang “tao” na makakatulong sa aking paggawa ng malalaking gawain. Nagsimula akong magbigay ng mas kumplikadong mga gawain, at nalaman kong talagang maaari itong gawin nang mabuti.

Nagdala ito ng malaking pagkakataon sa akin. Mula sa pagkakasimula ng modelong nagsasalita batay sa token, hanggang sa maging isang agent, maging isang alimango, na makakatulong sa iyo na matapos ang mga gawain, nagbigay ito ng malaking pagtaas sa pangkalahatang imahehan ng AI.

Samantala, naging mataas din ang paghingi nito sa kakayahan ng buong sistema. Ito ang dahilan kung bakit naramdaman kong medyo nagkakaroon ng pagka-stuck ang OpenClaw nang unang beses kong gamitin. Bilang isang tagapagbigay ng infrastruktura, nakikita ko na dinala ng OpenClaw ang mas maraming pagkakataon at hamon sa malalaking sistema at ekosistema sa likod ng AI.

Ang lahat ng mga yaman na aming makakamit ay hindi sapat upang suportahan ang ganitong mabilis na paglago. Halimbawa, sa aming kumpanya, mula sa huling araw ng Enero, halos doble ang paggamit ng token namin bawat dalawang linggo, at ngayon ay tumataas na nang 10 beses.

Huling beses kong nakita ang bilis na ito ay nang gamitin ko ang 3G phone at kinonsumo ang aking data. May pakiramdam akong ang kasalukuyang paggamit ng token ay parang panahon noon kung saan mayroon akong 100MB lang ng mobile data bawat buwan.

Sa ganitong sitwasyon, kailangan nating mas mabuting mapagbuti at maisama ang lahat ng aming mga yaman upang makapagamit ng kakayahan ng AI ng OpenClaw ang bawat tao, hindi lamang sa larangan ng AI kundi sa buong lipunan.

Bilang isang player sa infrastraktura, sobrang excited at nakakaramdam ako sa panahong ito. Naniniwala ako na mayroon pa ring maraming espasyo para sa pagpapabuti na dapat pa nating pag-aralan at subukan.

02. OpenClaw ay itinataas ang limitasyon ng lokal na modelo, malaking kahalagahan ang pagbuo sa interactive mode

Lo Fuli: Ako mismo ang itinuturing na isang napakasikat at makapagbabago pangyayari ang OpenClaw sa proseso ng pag-unlad ng agent framework.

Sa totoo lang, ang unang pagpipilian ng lahat ng mga taong nagsasagawa ng napakalalim na coding sa paligid ko ay ang Claude Code. Ngunit naniniwala akong ang mga gumagamit ng OpenClaw ay makakaramdam na maraming disenyo nito sa Agent framework ay mas maunlad kaysa sa Claude Code. Marami ng bagong update sa Claude Code ngayon na nagpapalapit sa OpenClaw.

Ang aking sariling karanasan sa paggamit ng OpenClaw ay ang pagdudulot nito ng higit pang pagkakataon para sa aking imahinasyon na palawakin nang anumang oras at sa anumang lugar. Ang Claude Code ay nagsimula lamang sa pagpapalawak ng aking mga ideya sa aking mesa, ngunit ang OpenClaw ay maaaring palawakin ang aking mga ideya nang anumang oras at sa anumang lugar.

Ang dalawang pangunahing halaga na dinala ng OpenClaw ay ang sumusunod. Ang una ay ang pagiging open-source nito. Ang pagiging open-source ay napakatulong sa pagpapalalim ng pakikilahok ng buong komunidad, pagpapahalaga at pagpapabilis sa pag-unlad ng framework na ito, na isang mahalagang kondisyon.

Ang isang malaking halaga ng mga AI framework tulad ng OpenClaw ay ang pagtaas ng hangganan ng mga modelo na nasa malapit na antas sa mga saradong modelo, ngunit hindi pa lubos na nakasabay.

Sa karamihan ng mga skenaryo, makikita mo na ang pagkumpleto ng gawain nito (lokal na open-source model + OpenClaw) ay malapit na sa pinakabagong model ng Claude. Samantala, nagsisiguro ito nang mabuti sa minimum—sa pamamagitan ng isang sistema ng Harness, o sa pamamagitan ng iba’t ibang disenyo tulad ng kanilang Skills system, upang masiguro ang kumpletong pagkakatotoo at akurasyon ng gawain.

Sa pananaw ng mga developer mula sa mga tagapagbigay ng base large model, pinapanatili ng OpenClaw ang minimum na antas ng base large model at itinataas ang maximum.

Bukod dito, naniniwala ako na ang isa pang halaga nito para sa buong komunidad ay ang pagpapalit ng kamalayan ng mga tao na ang Agent layer ay may malaking potensyal na espasyo para sa imahinasyon, maliban sa malalaking modelo.

Kamakailan ay napanood ko rin na sa komunidad, pati na ang mga tao na hindi researcher ay nagsisimulang makilahok sa pagbabago ng AGI, at mas maraming tao ang nagsisimulang makilala ang mas malalakas na agent framework tulad ng Harness at Scaffold. Ang mga tao na ito ay gumagamit ng mga tool na ito upang palitan ang ilang bahagi ng kanilang trabaho, samantalang nagpapalaya rin sila ng kanilang oras upang makalagay sa mas malikhaing mga bagay.

Huang Chao: Sa tingin ko, mula sa pananaw ng interaksyon, ang dahilan kung bakit nagging sikat ang OpenClaw ay ang pagbibigay nito ng mas “totoong tao” na karanasan. Kung kahit mayroon na tayong dalawang taon sa paggawa ng Agent, ang mga dating Agent tulad ng Cursor at Claude Code ay nagbigay ng mas malaking “sensasyon ng kasangkapan.” Ngunit ang OpenClaw ay unang beses na nagbigay ng “embed na instant messaging” na paraan, na nagbibigay sa iyo ng mas malapit na pakiramdam sa iyong pangarap na “personal na JARVIS.” Sa tingin ko, ito ay isang pagbubukas sa interaksyon.

Isa pang punto, ang aral na ibinigay nito sa buong komunidad ay: ang simplengunit epektibong framework tulad ng Agent Loop ay muli pang ipinatotohanang maaaring gawin. Samantala, ito ay nagpapakilala sa atin ng muli ang isang tanong: kailangan ba natin ng isang super agent na may kakayahang gawin lahat, o kaya ay isang mas mabuting “maliit na alaga,” tulad ng isang lightweight na operating system o scaffolding?

Ang ideya na dinala ni OpenClaw ay ang paggamit ng isang "maliit na sistema" o "lobster operating system" at ang kanyang ecosystem upang palakasin ang pagkakaroon ng mentalidad na "maglaro," na magiging pambuksan ng lahat ng mga kasangkapan sa buong ecosystem.

Kasabay ng paglitaw ng mga kakayahan tulad ng Skills at Harness, mas maraming tao ang makakapag-disenyo ng mga aplikasyon para sa mga sistema tulad ng OpenClaw upang bigyan ng kapangyarihan ang iba’t ibang industriya. Naniniwala ako na ang punto na ito ay natural na malalalim na ugnay sa buong open-source ecosystem. Sa pananaw ko, ang dalawang punto na ito ang aming pinakamalaking aral.

03. Ang bagong modelo ng GLM ay disenyo para sa "paggawa", at ang pagtaas ng presyo ay pagbabalik sa normal na komersyal na halaga

Yang Zhilin: Gusto kong tanungin ang Zhang Peng. Nakikita ko na ang Zhipu ay naglabas ng bagong GLM-5 Turbo model, at nauunawaan kong may malaking pagpapalakas sa kakayahan ng Agent. Maaari mo bang ipaliwanag kung ano ang mga pagkakaiba ng bagong model na ito sa iba pang mga model? Bukod dito, napapansin namin na may pagtaas ng presyo—ano ang mga signal ng merkado na ito ay nagpapahiwatig?

Zhang Peng: Ito ay isang magandang tanong. Talagang nag-update kami nang may pagkakataon sa loob ng dalawang araw, at ito ay isang bahagi ng aming buong roadmap, ngunit isinampa namin ito nang maaga.

Ang pangunahing layunin ay mula sa dating “simpleng usapan” patungo sa “totoong paggawa” — ito rin ang karaniwang nadarama ng lahat ngayon: ang malalaking modelo ay hindi na lamang kayang kumausap, kundi talagang makakatulong sa paggawa.

Ngunit ang kakayahan na nakapalibot sa “paggawa” ay napakataas. Kailangan ng modelo na magplano ng sarili nito para sa mahabang panahon, magpakita ng maraming pagsubok at pagkakamali, i-compact ang konteksto, i-debug, at maaaring kailanganin ring harapin ang maraming modalidad ng impormasyon. Kaya, ang mga kinakailangang kakayahan nito sa modelo ay iba sa tradisyonal na pangkalahatang modelo na nakatuon sa pakikipag-usap. Ang GLM-5 Turbo ay espesyal na pinahusay sa mga aspetong ito, lalo na sa iyong nabanggit—upang gawin itong magtrabaho at magpatuloy sa pagpapatakbo ng pitong pito na oras, paano ito makakapag-loop nang walang paghinto—dito kami nagawa ang maraming trabaho.

Kasama rin dito ang malaking pagmamalasakit sa pagkawala ng token. Ang paggamit ng isang matalinong modelo para sa mga kumplikadong gawain ay nagdudulot ng malaking pagkawala ng token. Maaaring hindi makaramdam nang husto ang karaniwang tao, ngunit kapag tumingin sa kanilang taksil, makikita nilang mabilis na bumababa ang pera. Kaya, nagawa namin ang pagpapabuti sa aspetong ito—kapag nakakaroon ng kumplikadong gawain, ang modelo ay makakagamit ng mas epektibong paggamit ng token. Sa kabuuan, ang arkitektura ng modelo ay patuloy na isang pangkalahatang arkitektura na may maraming gawain, ngunit may pinalakas na pagkakatangi sa kakayahan.

Ang pagtaas ng presyo ay maaaring maipaliwanag nang madali. Nangyari na ang pagtatanong ng isang simpleng tanong at pagkuha ng isang simpleng sagot. Ang likod na proseso ay napakalalim. Maraming gawain ang nangangailangan ng pagsulat ng code at pakikipag-ugnayan sa mga paaalala ng infrastraktura, at patuloy na pag-debug at pagkorekta ng mga error, na nagdudulot ng malaking paggamit. Ang bilang ng token na kailangan upang matapos ang isang kumplikadong gawain ay maaaring sampu o daan beses ang dami kaysa sa pagbibigay ng sagot sa isang simpleng tanong.

Kaya kailangan ng pagtaas sa presyo, at lumaki rin ang modelo, kaya tumataas ang gastos sa pagpapatakbo. Ibinabalik namin ito sa tamang komersyal na halaga, dahil ang pagpapalaganap ng mababang presyo sa matagalang panahon ay hindi nakakatulong sa pag-unlad ng buong industriya. Ito rin ang paraan namin upang mabuo ang isang positibong siklo sa komersyalisasyon, patuloy na mapabuti ang kakayahan ng modelo, at magbigay ng mas magandang serbisyo sa inyong lahat.

04. Upang makabuo ng mas epektibong token factory, ang imprastruktura mismo ay dapat ding maging Agent

Yang Zhilin: Sa kasalukuyan, dumarami ang mga open-source model at umuunlad na ang kanilang ecosystem, kung saan ang iba’t ibang model ay maaaring magbigay ng karagdagang halaga sa mga user sa iba’t ibang computing platforms. Kasabay ng pagtaas ng paggamit ng token, ang malalaking model ay nagsisimulang lumipat mula sa panahon ng pagtuturo patungo sa panahon ng inference. Gusto kong tanungin Li Xue, ano ang ibig sabihin ng panahon ng inference sa pananaw ng infrastraktura para sa Wuwen?

Xia Lixue: Kami ay isang infrastructure provider na ipinanganak sa panahon ng AI, at kasalukuyang nagbibigay suporta sa Zhizhang, Kimi, Mimo, at iba pa, upang makatulong sa mga tao na gamitin nang mas epektibo ang token factory. Kasama rin namin ang maraming unibersidad at siyentipikong institusyon.

Kaya patuloy naming isipin ang isang bagay: Ano ang mga imprastruktura na kailangan sa panahon ng AGI? At paano natin maipapatupad at masusuri ito sa bawat hakbang. Nandito na ang aming sapat na paghahanda para sa mga isyu na kailangang lutasin sa maikling, katamtaman, at mahabang panahon.

Ang pinakatuwid na problema ngayon ay ang napag-usapan ng lahat kanina—ang biglaang pagtaas ng bilang ng mga token na dinala ng Open, na nagtataguyod ng mas mataas na pangangailangan para sa pagpapabuti ng sistemang efficiency. Kasama rito ang pag-adjust ng presyo, na isa rin sa mga paraan ng pagtugon sa pangangailangang ito.

Lagi naming sinasagot ang problema sa pamamagitan ng pagpapagana ng software at hardware. Halimbawa, isinama namin ang lahat ng uri ng computing chip, at pinagsama namin ang labing-isang iba’t ibang chip sa bansa at dobleng mga cluster ng computing power. Sa paraang ito, nasosolusyunan ang kakulangan sa computing resources sa AI system; kapag kulang ang resources, ang pinakamabuting paraan ay gamitin ang lahat ng available na resources, at gamitin ang bawat computing power nang may epektibong layunin upang makamit ang pinakamataas na efficiency.

Kaya sa hakbang na ito, ang aming layunin ay paunlarin ang isang mas epektibong token factory. Marami kaming ginawang pagpapabuti, kabilang ang pag-optimize ng mga modelo at mga yunit sa hardware tulad ng VRAM at iba pang mga mapagkukunan, at sinusuri namin kung ang mga pinakabagong istruktura ng modelo at hardware ay maaaring magdulot ng mas malalim na interaksyon. Ngunit ang paglutas sa kasalukuyang problema sa efficiency ay nagtatag lamang ng isang standard na token factory.

Sa panahon ng Agent, naniniwala kami na ito ay hindi sapat. Dahil mas katulad ng isang tao ang Agent, maaari mong ibigay sa kanya ang isang gawain. Tiyak akong naniniwala na ang maraming imprastruktura sa panahon ng cloud computing ay disenyo para sa pagpapagana ng isang programa o para sa mga inhinyero na tao, hindi para sa AI. Katulad nito, gumawa tayo ng isang imprastruktura na may interface para sa tao, at pagkatapos ay idinagdag ang isang layer para i-connect ang Agent—ang paraang ito ay talagang naglalagay ng limitasyon sa kakayahan ng Agent gamit ang mga gawain ng tao.

Halimbawa, ang Agent ay kayang mag-isip at magmula ng mga gawain sa antas ng millisecond, ngunit ang mga pangunahing kakayahan tulad ng K8s (kubernetes) ay hindi pa handa para dito, dahil ang mga tao ay karaniwang nagmumula ng mga gawain sa antas ng minuto. Kaya kailangan natin ng mas malalim na kakayahan, at tinatawag natin ito bilang “Agentic Infra,” o ang “inteligenteng token factory”—ito ang ginagawa ng Wuwen Xinqiong.

Sa mas mahabang paningin, nang dumating ang totoong panahon ng AGI, naniniwala kami na kahit ang infrastraktura mismo ay dapat maging isang agent. Ang aming binuo na pabrika ay dapat ding makapag-ebolusyon at makapag-itera sa sarili nito, at makabuo ng isang awtonomong organisasyon. Ito ay katumbas ng isang CEO, na ang sarili nito ay isang Agent, maaaring OpenClaw, na magpapamahala sa buong infrastraktura, at sumasagot sa mga pangangailangan ng AI na mga kliyente sa pamamagitan ng paghingi at pag-itera sa infrastraktura. Sa paraang ito, mas mabuting makakapag-couple ang AI sa isa’t isa. Kami ay nagpapagawa rin ng ilang pag-aaral, tulad ng pagpapabuti ng komunikasyon sa pagitan ng mga Agent at pagbuo ng kakayahang Cache to Cache.

Kaya ang aming patuloy na isinasaalang-alang ay ang pag-unlad ng imprastruktura at AI ay hindi dapat isang hiwalay na estado—kung saan ako lang ay sumasagot sa isang kahilingan at nagpapatupad nito—kundi dapat magkaroon ng napakaraming magagandang kimikal na reaksyon. Ito ang totoong pagkakaisa ng software at hardware, ng algorithm at imprastruktura, at ang misyon na palaging nais ng Wuwen Xinqiong na maisabuhay. Salamat.

05. Ang pagpapalit para sa efisensiya ay may kahalagahan din; binigyan ng lakas at tiwala ni DeepSeek ang lokal na tim

Yang Zhilin: Susunod na tanong ko kay Fuli. Recent na nagbigay ang Xiaomi ng malaking kontribusyon sa komunidad sa pamamagitan ng paglalabas ng bagong model at pag-open source ng teknolohiya sa likod nito. Gusto kong tanungin ka, sa paggawa ng malalaking model, ano ang iyong tingin ay ang mga natatanging kakayahan ng Xiaomi?

Luo Fuli: Sa tingin ko, maaari nating unang iwasan ang paksa kung ano ang mga natatanging kakayahan ni Xiaomi; mas gusto kong pag-usapan ang pangkabuuang kahusayan ng mga tim sa China sa paggawa ng malalaking modelo. Sa tingin ko, may mas malawak na halaga ang paksa na ito.

Noong halos dalawang taon ang nakalipas, ang mga koponan ng base model sa Tsina ay nagsimula na ng magkaroon ng napakagandang paglagos—paano namin malilipas ang mga limitasyon ng mababang computing power, lalo na sa ilang mga kondisyon kung saan ang NVLink interconnect bandwidth ay limitado, at gawin ang mga inobasyon sa istruktura ng modelo na tila “kompromiso para sa efficiency,” tulad ng DeepSeek V2, V3 series, at ang MoE, MLA, atbp.

Ngunit pagkatapos ay nakita namin na ang mga inobasyong ito ay nagdulot ng isang pagbabago: paano makamit ang pinakamataas na antas ng pag-iisip sa ilalim ng isang tiyak na halaga ng computing power. Ito ang nagbigay ng tapang at tiwala sa lahat ng mga lokal na team ng base model sa bansa. Bagaman ngayon ay hindi na natin kinakailangan ang mga limitasyong ito, lalo na sa mga lokal na chip, lalo na sa mga chip para sa inference at training, ito ang mga limitasyong ito ang nagbigay-daan sa aming mga bagong pag-aaral tungkol sa mas mataas na efficiency sa training at mas mababang gastos sa inference.

Tulad ng mga istruktura na kahit na lumabas noong nakaraan tulad ng Hybrid Sparse at Linear Attention, tulad ng NSA ni DeepSeek at KSA ni Kimi, mayroon din si Xiaomi ang HySparse na nakatuon sa susunod na henerasyon. Lahat ng ito ay mga inobasyon sa istruktura ng modelo na iba sa henerasyon ng MoE, na disenyo para sa panahon ng Agent.

Bakit ko iniisip na mahalaga ang structural innovation? Sa totoo lang, kung gagamitin ninyo nang talagang serio ang OpenClaw, makikita ninyo na mas magiging madali at mas matalino ito habang ginagamit. Isang pangunahing kondisyon ay ang haba ng konteksto sa pag-iisip. Ang mahabang konteksto ay isang paksa na pinag-uusapan natin nang matagal, ngunit mayroon ba talagang modelong maaaring mag-perform nang mahusay, malakas ang performance, at mababa ang gastos sa pag-iisip sa mahabang konteksto?

Sa katotohanan, maraming modelo ay hindi nagkakaroon ng kakayahang magtrabaho sa 1M o 10M na konteksto, kundi dahil mahal at mabagal ang pagrerepresenta sa 1M, 10M. Tanging kapag bumaba ang gastos at tumaas ang bilis, maaaring isauli sa modelo ang mga gawain na may tunay na mataas na produktibong halaga, at maaaring maisagawa ang mas kumplikadong mga gawain sa ganitong mahabang konteksto, kahit na makamit ang sariling iterasyon ng modelo.

Ang tinatawag na self-iteration ng model ay ang kakayahang ito na mag-evolve sa sarili sa isang komplikadong kapaligiran gamit ang napakahabang konteksto. Ang pag-unlad na ito ay maaaring tumutok sa sariling Agent framework, o sa mga parameter ng model—dahil naniniwala ako na ang konteksto mismo ay isang anyo ng pag-unlad ng mga parameter. Kaya, kung paano mag-implement ng isang arkitektura na may mahabang konteksto, at kung paano magagawa ang epektibong pagpapatakbo ng mahabang konteksto sa panahon ng inference, ay isang komprehensibong kompetisyon.

Bukod sa pre-training phase na nagpapahusay ng arkitektura para sa long-context-efficient—ito ay isang problema na sinimulan namin ng isang taon na ang nakalipas. Ngayon, upang makamit ang tiyak na pagiging stable at mataas na performance sa mga matagal na gawain, ito ang aming inaayos na inobatibong paraan sa post-training phase.

Nag-iisip kami kung paano magbuo ng mas epektibong mga algoritmo sa pagkatuto, kung paano makakuha ng mga teksto na may tunay na mahabang pagkakaugnay sa mga konteksto ng 1M, 10M, at 100M, at kung paano i-combine ang trajectory data na nagmumula sa mga kumplikadong kaligiran. Ito ang ginagawa namin sa post-training.

Ngunit sa mas mahabang panahon, dahil sa mabilis na pag-unlad ng malalaking modelo kasama ang suporta ng Agent framework, tulad ng sinabi ni Li Xue, ang pangangailangan sa pag-iisip ay tumataas ng halos sampung beses sa nakaraang panahon. Magkakaroon ba ng pagtaas na 100 beses sa kabuuang paggamit ng token sa taong ito?

Nagkakaroon na ng ibang antas ng kompetisyon dito—ang computing power, o mga inference chip, at kahit pa sa ibaba pa sa enerhiya. Kaya naniniwala ako na kung magkakaisa tayong mag-isip tungkol dito, mas marami akong matututuhan mula sa inyo. Salamat.

06. Mayroong tatlong pangunahing module ang Agent, at ang paglago ng maraming Agent ay magdudulot ng malaking epekto

Yang Zhilin: Sangat insightfull na pagbabahagi. Ngayon, gustong tanungin ko si Huang Chao, ikaw ay nag-develop ng mga malaking epekto na Agent project tulad ng Nanobot at may maraming tagasunod sa komunidad. Gusto kong tanungin ka, mula sa pananaw ng Harness o aplikasyon ng Agent, ano ang mga teknikal na direksyon na itinuturing mong mahalaga at dapat pansinin ng lahat?

Huang Chao: Naniniwala ako na kung isasalin ang teknolohiya ng Agent, ang mga pangunahing module ay ang Planning, Memory, at Tool Use.

Una sa Planning. Ang pangunahing problema ngayon ay sa mga mahabang gawain o napakakomplikadong konteksto, tulad ng 500 na hakbang o higit pa, maraming model ay hindi makakagawa ng mabuting plano. Naniniwala ako na sa pamamagitan ng kalikasan, ang mga model ay maaaring walang ganitong implisitong kaalaman, lalo na sa ilang napakakomplikadong vertical na mga larangan. Kaya, sa hinaharap, kailangan posibleng i-solidify ang lahat ng kaalaman sa mga komplikadong gawain sa loob ng model—ito ay maaaring isang direksyon.

Totoo, ang Skill at Harness ay nagpapabawas sa ilang mga pagkakamali na dulot ng Planning, dahil ito ay nagbibigay ng mataas na kalidad na Skill, na sa pamamagitan nito ay pinapadala ang modelo upang matupad ang ilang mas mahihirap na gawain.

Ulitin ang Memory. Ang pakiramdam sa Memory ay parang laging may problema sa pag-compress ng impormasyon at paghahanap nito nang hindi tama. Lalo na sa mga mahabang gawain at kompleks na sitwasyon, lalong dumarami ang presyon sa Memory. Ngayon, ang mga proyekto tulad ng OpenClaw ay gumagamit pa rin ng pinakasimpleng uri ng Memory na nasa anyo ng Markdown na batay sa file system, na ginagamit sa pamamagitan ng pagbabahagi ng mga file. Sa hinaharap, maaaring magtungo ang Memory sa isang layered na disenyo, at kailangan din itong gawing mas pangkalahatan.

Seryoso lang, mahirap gawing generiko ang kasalukuyang mekanismo ng Memory—dahil ang mga escenario ng Coding, Deep Research, at multi-modal ay may malaking pagkakaiba sa kanilang mga modalidad ng data; kung paano magagawa ang maayos na paghahanap at pag-index sa mga Memory na ito habang nananatiling epektibo, palaging isang kompromiso.

Bukod dito, kasalungat ng pagbaba ng mga hadlang para sa paglikha ng Agent ng OpenClaw, maaaring mayroon na higit sa isang “crab” sa hinaharap. Nakikita ko na mayroon din ang Kimi sa mechanismong Agent Swarm, at sa hinaharap, bawat tao ay maaaring magkaroon ng “isang grupo ng crabs”.

Mas malaki ang pagtaas ng konteksto kapag isang grupo ng mga krustaseo ang kasali kaysa sa isang krustaseo lamang, at malaki ang presyon nito sa Memory. Sa kasalukuyan, wala pa ring mabuting mekanismo para pamahalaan ang konteksto na dulot ng “grupo ng mga krustaseo,” lalo na sa mga sitwasyon tulad ng komplikadong coding at mga pagkakatuklas sa siyensya—maging sa modelo kaysa sa buong arkitektura ng Agent, malaki ang presyon.

Tungkol pa sa Tool Use, o ang Skill. Ang problema ngayon sa Skill ay katulad ng problema noong MCP—noong panahon ng MCP, may mga isyu sa kalidad at panganib sa seguridad. Ngayon, pareho ang sitwasyon sa Skill: bagaman marami ang Skill, kaunti lang ang mataas na kalidad, at ang mga mababang kalidad na Skill ay nakakaapekto sa akurasye ng Agent sa pagpapatupad ng mga gawain. Mayroon din pang mga panganib mula sa masamang pagpapalit. Kaya, batay sa Tool Use, kailangan ng komunidad na palakasin ang buong ekosistema ng Skill, at kahit na gawing posible na mag-evolve ang Skill sa proseso ng pagpapatupad at lumikha ng sariling mga bagong Skill.

Sa kabuuan, mula sa Planning, Memory hanggang sa Tool Use, ang mga ito ay ang ilang mga pangunahing problema ng kasalukuyang Agent, at maaaring mga direksyon para sa hinaharap.

07. Mga keyword sa susunod na 12 buwan: ekosistema, sustainable token, self-evolving at computing power

Yang Zhilin: Makikita ninyo na ang dalawang bisita ay nagdiskutong mula sa iba’t ibang pananaw tungkol sa isang karaniwang problema—habang tumataas ang kumplikadong kalikasan ng mga gawain, tumataas din ang konteksto. Mula sa antas ng modelo, maaaring palakasin ang orihinal na haba ng konteksto, habang mula sa antas ng Agent Harness, ang mga mekanismo tulad ng Planning, Memory, at Multi-Agent ay maaari ring suportahan ang mas kumplikadong mga gawain sa ilalim ng tiyak na kakayahan ng modelo. Naniniwala ako na ang dalawang direksyong ito ay magiging sanhi ng higit pang kimikal na reaksyon sa susunod, na magpapalakas pa higit pa sa kakayahan ng pagkumpleto ng gawain.

Sa huling bahagi, isang bukas na pananaw. Mangyaring gamitin ang isang salita upang ilarawan ang trend sa pag-unlad ng malalaking modelo sa susunod na 12 buwan at ang inyong mga pangarap. Unang-una, mula kay Huang Chao.

Huang Chao: Ang 12 buwan sa larangan ng AI ay tila malayo—hindi alam kung paano ito magiging pagkatapos ng 12 buwan.

Yang ZhiLin: Dito ay isinulat ang limang taon, ngunit binago ko ito.

Huang Chao: Oo, haha. Ang isang salita na isipin ko ay “ekosistema.” Ngayon, ang OpenClaw ay nagpapakilos sa lahat, ngunit sa hinaharap, dapat talagang maging “manggagawa” ang Agent, hindi lang para sa paglalaro o pagkakaroon ng bagong kasiyahan. Dapat itong maging matatag sa hinaharap—maging kasangkapan para sa paggawa at totoong kasamang manggagawa.

Kailangan ng pagsisikap ng buong ekosistema, lalo na ang open source; pagkatapos i-open source ang teknikal na pag-aaral at ang teknolohiya ng modelo, kailangan ng buong komunidad na magtutulungan—ano man ang pagpapabuti ng modelo, ang pagpapabuti ng platform ng Skill, o ang iba’t ibang mga kasangkapan, kailangan nilang mas mabuting i-design para sa lobster.

Isang malinaw na trend ay ang susunod na software ay patuloy pa bang para sa tao? Naniniwala ako na sa hinaharap, maraming software ay hindi na direktang para sa tao—dahil ang tao ay nangangailangan ng GUI, habang ang hinaharap ay maaaring native sa Agent. Kakaibang bagay ay ang tao ay gagamit lamang ng mga GUI na nagdadala ng kasiyahan. At ngayon, ang buong ecosystem ay umiiwas mula sa GUI at MCP patungo sa CLI pattern. Kailangan ng ecosystem na gawing Agent Native ang mga software system, data, at iba’t ibang teknolohiya, upang mas mapalawak ang pag-unlad.

Ro Fuli: Ang pagpapaliit ng tanong sa isang taon ay lubos na may kahulugan. Kung limang taon, batay sa aking depinisyon ng AGI, naniniwala akong naitagpuan na ito. Kaya kung isasalaysay ko ang pinakamahalagang bagay sa paglalakbay ng AGI sa susunod na taon sa isang pangungusap, ito ay ang “self-evolution.”

Ang salitang ito ay tila mahirap maintindihan, at marami nang binanggit ito noong nakaraang taon. Ngunit sa nakalipas na panahon, may mas malalim kong pag-unawa, o mas praktikal at mas maaari pang gawing epektibo ang paraan ng “self-evolution.” Dahil sa pagkakaroon ng makapangyarihang modelo, sa ilalim ng Chat paradigm ay hindi natin napapakita ang pinakamataas na potensyal ng pre-trained model, ngunit ang Agent framework ang nag-activate nito. Nang pinayagan natin ang modelo na gawin ang mas mahabang mga gawain, natuklasan natin na ito ay makakatuto at makakae-ebolusyon nang sarili nito.

Isang simpleng pagsubok ay: magdagdag ng isang verifiable na kondisyon sa umiiral na Agent framework, at magtakda ng isang Loop upang ang modelo ay maaaring paulit-ulit na i-iterate at i-optimize ang layunin, at makikita mo na ito ay patuloy na nagbibigay ng mas magagandang solusyon. Ang self-evolution na ito ay kasalukuyang kayang magtrabaho nang ilang araw, bagaman nakadepende ito sa kahirapan ng gawain.

Halimbawa, sa ilang scientific research, tulad ng pag-aaral ng mas mahusay na model structure, dahil mayroong mga pamantayan sa pag-e-evaluate ng model structure, tulad ng mas mababang PPL. Sa mga deterministikong gawain na ito, natuklasan namin na kaya nito nang mag-isa na i-optimize at i-execute ang dalawa o tatlong araw.

Kaya mula sa aking pananaw, ang self-evolution ay ang tanging lugar kung saan maaaring “likhain ang bagong bagay.” Hindi ito nagpapalit sa kasalukuyang produktibidad ng tao, kundi tulad ng mga pinakamahusay na siyentipiko, ito ay nag-aaral ng mga bagay na hindi pa nabubuhay sa mundo. Isang taon na ang nakalipas, isipin ko na ang timeline na ito ay maaaring magtagal ng tatlo hanggang limang taon, ngunit sa kasalukuyan, naniniwala ako na dapat itong maikli sa isang hanggang dalawang taon. Maaaring mabilis nating gamitin ang malalaking modelo na may isang makapangyarihang framework ng self-evolving Agent upang maabot ang eksponensyal na pagpapabilis sa agham.

Kahit recent, natuklasan ko na ang workflow ng mga kasamahan ko sa grupo na nag-aaral ng malalaking modelo ay mataas na hindi tiyak at mataas na malikhaing, ngunit sa pamamagitan ng Claude Code kasama ang pinakamahusay na modelo, tumaas ang aming efficiency sa pag-aaral ng halos sampung beses. Malaki ang aking inaasahan na ang ganitong paraan ay magkakaroon ng epekto sa mas malawak na mga disiplina at larangan, kaya naniniwala ako na ang “self-evolution” ay napakahalaga.

Xia Lixue: Ang aking keyword ay "sustainable token." Nakikita kong ang buong pag-unlad ng AI ay nasa isang mahabang, patuloy na proseso, at nais naming magkaroon ito ng matagal na buhay. Sa pananaw ng imprastruktura, malaking problema ang limitadong yaman.

Tulad noong panahon ng pagpapaliwanag tungkol sa mapanatiling pag-unlad, bilang isang token factory, kaya namin ba magbigay nang patuloy, matatag, at malawak na mga token upang makatulong sa mga pinakamahusay na modelo na maglingkod sa mas maraming downstream services—ito ang isang mahalagang isyu na aming nakikita.

Kailangan nating palawakin ang ating pananaw sa buong ecosystem—mula sa enerhiya hanggang sa computing power, pati na ang token, at huli ang aplikasyon, upang makabuo ng mapagkakatiwalaang ekonomikong pag-unlad. Hindi lang namin gagamitin ang lahat ng computing power sa bansa, kundi isasaliksik din namin ang mga kakayahan na ito sa ibang bansa, upang maipagsasama at maiintegrase ang mga mapagkukunan sa buong mundo.

Naniniwala rin ako na ang “mapagkukunan” ay tunay na nagtatayo ng Chinese-style token economy. Noong nakaraan, sinasabi natin ang “Made in China,” na nagpapalit ng mura at makapangyarihang paggawa ng China sa mga magandang produkto na ipinapalabas sa buong mundo.

Ang ating gagawin ngayon ay “AI Made in China”—ang pagpapalit nang patuloy sa mga kalamangan ng China sa enerhiya at iba pa, sa pamamagitan ng token factory, upang maging mataas na kalidad na token na ipapalabas sa buong mundo, maging ang token factory ng mundo. Ito ang gusto kong makita taon na ito—ang halaga na dala ng China sa mundo sa pamamagitan ng artificial intelligence.

Zhang Peng: I'll keep it brief. Habang lahat ay tumitingin sa mga bituin, ako ay magiging praktikal. Ang aking pangunahing salita ay "computational power."

Kanina ay sinabi rin na ang lahat ng teknolohiya at framework ng agent ay nagpataas ng inyong kagalingan at produktibidad ng sampung beses, ngunit ang kondisyon ay dapat kayang gamitin ninyo nang totoo. Hindi maaaring magbigay ka lang ng isang tanong at hayaan itong mag-isip nang mahaba nang walang sagot—iyan ay hindi maaaring gawin. Dahil dito, maraming pag-unlad sa pananaliksik at maraming gustong gawin ay nahihirapan.

Nakalimutan ko na kung ano ang sinabi ng isang akademiko sa Zhongguancun Forum noong dalawang taon ang nakalipas: “Wala kang card, wala kang damdamin; pag-usapan ang card, nasasaktan ang damdamin.” Sa tingin ko, nasa punto na naman tayo ngayon, ngunit iba ang kalagayan. Ngayon ay nasa phase ng inference na tayo, at ang pangangailangan ay talagang bumabagsak—sampu o daan-daang beses ang pagtaas. Sinabi mo lang na tumataas ang paggamit ng sampung beses, ngunit maaaring isang daang beses ang pangangailangan? At mayroon pa ring malaking pangangailangan na hindi natutugunan—ano ang gagawin natin? Maaari nating isipin nang magkakasama ang mga solusyon.