Ang gulo ng mga tatlongnapu't isang araw, ang labing-isang malaking modelo, parang isang maingay na pagtatanghal ng pambubuhat.

May-akda at pinagkukunan ng artikulo: 0x9999in1, ME News

TL;DR

- Tatlong pû araw ng masamang kompetisyon: Mula Marso 26 hanggang Abril 24, isinilang ang 11 malalaking modelo sa buong mundo, isang modelo bawat 2.7 araw. Ang merkado ay nakakaranas ng malubhang “pagod sa parameter”.

- Ang “surgery sa pagbawas ng timbang” ng Parameter Glutton: Ang kabuuang parameter ng V4-Pro ay 1.6T, ngunit ang aktibong 49B lamang. Sa pamamagitan ng pagrereporma sa arkitekturang CSA+HCA, bumaba ang FLOPs sa 27% sa 1M na konteksto, at bumaba ang KV cache sa napakakatakot na 10%.

- Ang paghihiwalay ng teknolohiyang alkimya: Unang pagtatayo ng post-training paradigm na “una ay independent reinforcement learning, pagkatapos ay online distillation at pagkakaisa”, ang V4-Pro-Max ay direktang umaabot sa hangganan ng mga saradong modelo sa pagpapaliwanag at mga gawain ng Agent.

- Mga boto na may totoong pera: Ang GPT-5.5 ay nagdulot lamang ng 4.2% na pagtaas sa isang araw para sa NVIDIA bago umabot sa tuktok, habang ang V4, na may buong pagbubukas ng MIT, ay lubos na pinagpapalakas ang patuloy na pagtaas ng lokal na chain ng computing power sa China at Hong Kong.

- Malalim na lohika ng paglalaro: Sinasalig ng mga saradong modelo ang “buwis”, samantalang sinasalig ng mga bukas na malalaking modelo ang “bakal”. Ang pagkakaroon ng V4, nagbigay-daan para sa pagkakapantay-pantay ng ledger ng computing power para sa private deployment sa antas ng negosyo sa buong mundo.

Ang April ng mga diyos na sumisibol, kasama ang pagkapagod ng pamilihan

Nakakapagod. Lahat ay nakakapagod.

Kung ikaw ay isang obserbador na nakafokus sa AI sector, ang nakalipas na tatlongnapu't isang araw ay malamang ay magdudulot ng pisikal na kawalan ng kasiyahan. Mula Marso 26, 2026 hanggang Abril 24, sa loob lamang ng hindi pa bababa sa isang buwan, mayroong kahit na 11 malalaking modelo na may makabuluhang impluwensya na ipinakilala sa merkado.

Ang listahan ay parang pagbabalita ng mga pagkain: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance DouBao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

At sa gabi ng April 23, ang DeepSeek V4 ay lumabas nang tahimik tulad ng isang malalim na pambura.

Sa pagkakatipon, may isang bagong modelo na lumalabas tuwing 2.7 araw. Ito ay mas mabilis kaysa sa kakayahan ng mga fund manager na basahin ang mga press release. Habang nagpapaliwanag pa ang investor sa “parameter superiority” ng Company A, ang “benchmark domination” ng Company B ay nasa kanilang mesa na. Ang merkado ay naging walang reaksyon na. Ang tinatawag na “benchmark ranking,” sa kasalukuyang napakalaking kompetisyon, ay naging tulad ng isang digital na laro na para lamang sa sarili.

Pero ang pera ay matalino. O kaya naman, ang K-line ay hindi naglalait.

I-convert ang 30 araw na K-line ng AI assets ng China, US, at Hong Kong, makikita mo ang isang napakalaking katotohanan: Sa gitna ng “labanan ng mga diyos” na ito, ang tanging dalawang puntos lamang ang nakakapag-iwan ng patuloy na trace sa chart.

Una, noong Abril 8, ang OpenAI sa kabilang panig ng karagatan ay inilabas ang GPT-5.5. Ang walang pag-aalinlangang hari ay direktang nagdulot ng 4.2% na pagtaas sa isang araw ng NVIDIA. Pagkatapos? Wala nang iba, tumaas sa isang araw, natapos na ang mga positibong balita. Natanto ng mga tao na kahit gaano pa kalaking pambansang hari ang isang saradong sistema, mahirap na itong muling gawing maliit ang mabigat na bundok ng pandaigdigang kapital gaya ng dalawang taon na ang nakalipas.

Ikalawang node, iyon ay mula Abril 23 hanggang 24. Ipinakilala ang preview version ng DeepSeek V4. Walang makalangit na pagpapakilala, walang nakakabiglaan na promo video. Direktang isinampa ang weights sa Hugging Face at ModelScope, MIT license.

Result? Ito ang nagpalakas sa chain ng computing power ng China at Hong Kong na lumabas sa串连跳涨.

Bakit? Bakit natupad ng isang open-source model ang mga bagay na hindi natupad ng mga malalaking闭源?

Upang sagutin ang tanong na ito, kailangan nating maging isang manunulat ng kuwento, alisin ang mga monotonong press release, at buksan ang kahon ng motor ng DeepSeek V4 upang tingnan kung anong kalokohan ang nakatago doon.

Pag-aaral ng V4: Wala na sa pagtitiwala sa暴力美学 ng mga parameter

Malaking model. Maraming pera ang kailangan. Ito ay kilala ng lahat.

Sa nakaraang taon, ang mga tagapag-develop ng malalaking modelo ay naranasan ang isang “katakutan sa kakulangan ng puwersa.” Ikaw ay gumagawa ng trilyon, ako naman ay gagawa ng dalawang trilyon. Lahat ay naniniwala na kung magkakaroon ng sapat na puwersa, ang mga nagmumula na智能化 ay maaaring lutasin ang lahat ng problema. Ngunit sumunod dito ang napakatatakot na gastos sa computing power. Kahit ang mga sobrang pagkain ng mga may-ari ng lupa ay hindi sapat para sa pagpapalabas.

Inilabas ni DeepSeek V4 ang dalawang MoE (Mixture of Experts) na modelo: V4-Pro at V4-Flash. Una nating tingnan ang ilang pangunahing datos.

V4-Pro: Kabuuang parametrong 1.6T (1.6 trilyon), ngunit ang bawat token ay nagpapagana ng 49B (490 bilyon) lamang.

V4-Flash: Kabuuang parameter na 284B (284 bilyon), aktibong parameter ay 13B (13 bilyon) lamang.

Naintindihan mo na? Ito ay isang sobrang pag-iingat na “pagsisilbi ng apat na liham para magpalipat ng libo-libo.” Ang kaluluwa ng MoE architecture ay ang paghingi ng tulong sa lahat ng mga alerto kada beses. Kapag may gawain na parang pagpatay ng manok, i-activate ang ilang mga eksperto sa pagpatay ng manok; kapag may gawain na parang pagpatay ng dragon, i-activate ang dragon-slaying blade. Ang 1.6 trilyong base ay nagpapatunay na “nakakakita na ng mundo, malalim ang kaalaman”; ang 490 bilyong aktibasyon ay nagpapatunay na “mabilis ang reaksyon, masigla ang pagkilos.”

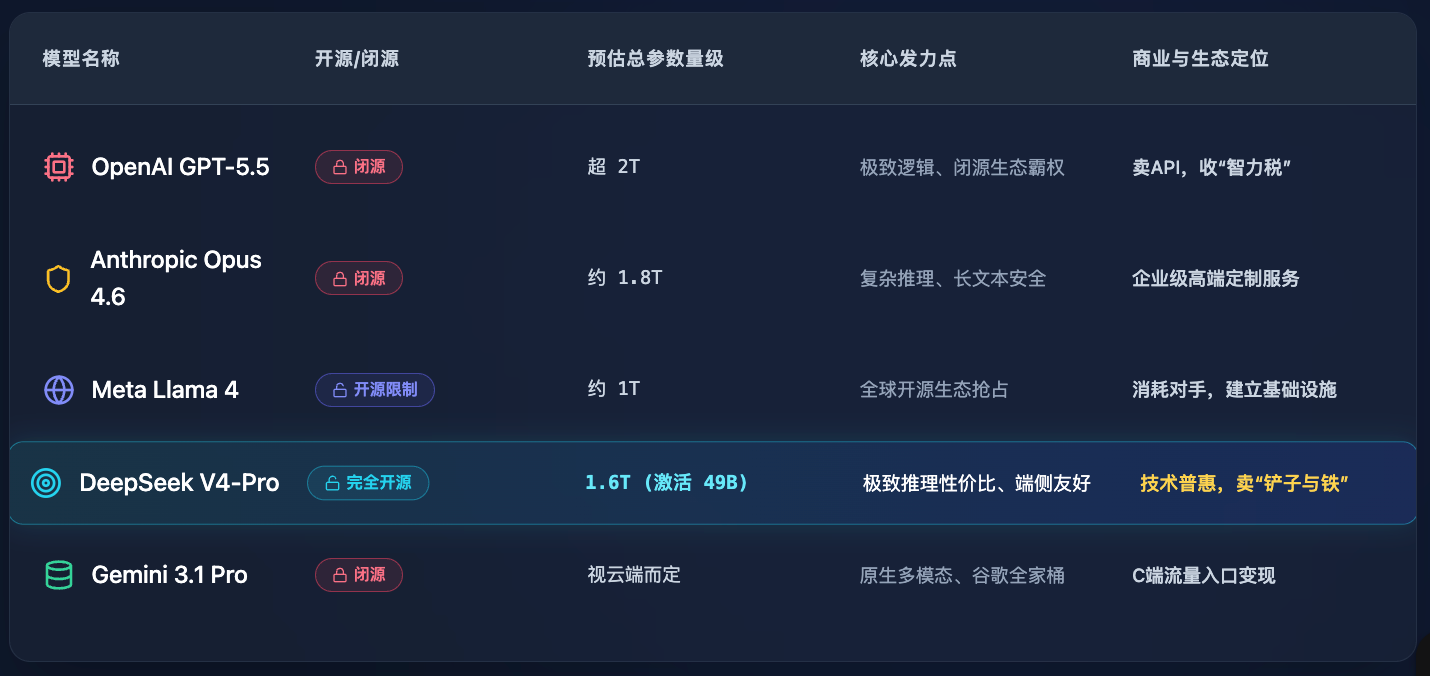

Para mas maunawaan nang mas malinaw ang pagkakaiba, gumawa tayo ng isang talahanayan na ihahambing ang mga pangunahing direksyon sa kasalukuyang merkado (ang data ay batay sa pampublikong pagtatantiya at pagsusuri ng merkado):

Maaaring makita sa talahanayan na ang V4-Pro ay hindi naglalayong laging labasan ang GPT-5.5 sa kabuuang parameter, ngunit ang lahat ng pwersa nito ay inilagay sa “paano gawing kaunti ang pagkain at mabilis ang paggalaw ng malaking hayop na ito.”

Ngunit hindi pa ito sapat. Ang tunay na nagpapahinga sa mga marunong ay ang walang awa nitong pagpapatay sa “memory card assassin.”

Wakas ng Memory Assassin: Tatlong kutsilyo sa arkitektura

Ano ang显存刺客? Ito ay "Long Context".

Ngayon, bawat isa ay nagpapalakas ng kanilang suporta sa 1M (isang milyon) na token na konteksto. Mukhang maganda, isang buong aklat ng “Tatlong Kaharian” ay maaaring isaksak, at maaari itong basahin sa ilang segundo. Pero ano ang gastos? Sa pag-iisip, ang mahabang teksto ay nagdudulot ng malaking KV cache (paggamit ng VRAM para sa pag-iimbak ng nakaraang impormasyon). Ito ay parang bawat pagbabasa ng isang pahina ng aklat, kailangan mong kopyahin ang nilalaman ng nakaraang pahina sa isang malaking blackboard at ilagay ito sa harap mo. Kapag natapos mo na ang isang milyong salita, ang mga blackboard ay sasakop na sa lahat ng data center sa Zhongguancun.

Ang memorya ay mas mahal kaysa sa computing power. Ito ang implicit rule sa industriya ng AI.

Paano nila lutasin ang sitwasyong ito ng DeepSeek V4? Direktang isinagawa nila ang “surgery” sa ilalim na attention mechanism. Ito ang unang at pinakamalakas na kutsilyo sa kanilang arkitekturang pagpapabuti: Hybrid Attention Mechanism (CSA + HCA).

Ang CSA (Compressed Sparse Attention) kasama ang HCA (Heavy Compressed Attention), kahit ano pa ang tila mga salitang mula sa Mars, ang simpleng paliwanag ay: hindi na ito nagmemorize nang puro pagsusulat, kundi natututo na mag-"highlight" at gumawa ng napakasimpleng mga tala.

Ang epekto ay lubos na malakas: Sa 1M context, ang FLOPs (bilang ng floating-point operations) ng V4-Pro sa isang token inference ay lamang 27% ng nakaraang henerasyon na V3.2! Mas nakakatakot pa, ang KV cache ay lamang 10% ng V3.2!

Ano ang konseptong ito? Katumbas ng isang mahabang teksto na may milyon-milyong salita na dating kailangan ng 10 na pinakamataas na server para i-run, ngayon ay natutupad na lamang ng isang server. Bawas ang gastos sa computing sa isang sampu. Ito ay isang pagpapabago na nagpapabago sa laro.

May dalawang kutsilyo pa.

Ang pangalawang kutsilyo ay tinatawag na “Manifold-Constrained Hyperconnection (mHC)”. Sa nakaraang malalaking modelo, ang pagpapadala ng impormasyon sa pagitan ng mga layer ay ginagamit ang “tradisyonal na residual connection,” tulad ng paggamit ng lumang, kumakalat na tubo para sa tubig—kapag malakas ang presyon, madaling umuubos. Sa harap ng malaking halaga ng pre-training data na 32T token, hindi kayang harapin ng lumang tubo. Ang mHC ay parang pagpapalit sa isang fiber optic network, na nagpapalakas sa pagkakaroon ng mas matatag na pagpropagasyon ng signal sa pagitan ng mga layer. Walang pagkawala ng packet, walang paglihis.

Ikatlong kutsilyo: Palitan ang langis ng engine. Itigil ang tradisyonal, gamitin ang Muon optimizer. Ang layunin nito ay pagbilis ng pagkakasundo. Habang kailangan ng iba’y pitumpu’t siyam na araw para magawa ang isang kahon ng eliksir, maaari itong tapusin sa loob ng dalawampu’t araw lamang. Ang oras ay pera, ang oras ng machine ay dolyar.

Ito ang tatlong paghagis ng kutsilyo na nagpabuti nang buo sa "sakit ng yaman" ng malalaking modelo.

Mga lihim sa kahoy ng alchemy: Mula sa pagkakahihiwalay hanggang sa pagkakaisa ng lahat ng mga paraan

Alam ng mga nasa industriya ang malalaking modelo: ang pre-training ay nagpapabago lang sa isang “walang kaalaman” tungo sa isang “nakakaalam ng maraming bagay ngunit hindi makapagsalita”. Ang tunay na nagpapakita sa kanya bilang isang dakilang eksperto ay ang post-training.

Ang DeepSeek V4 ay naglalaro ng napakatindi na "dalawang-saklaw na estratehiya" sa post-training.

Noong nakaraan, ang pag-train sa MoE ay parang isang grupo ng mga guro na nagtuturo sa isang mag-aaral, madaling magkakagulo. Paano ngayon ng V4?

Unang yugto: “Bawat isa ay nagtatrabaho nang hihiwalay.” Gamit ang SFT (supervised fine-tuning) at GRPO (group relative policy optimization) reinforcement learning, hihiwalayin at iisa-isahin ang pagtuturo ng bawat “expert network” sa modelo. Ang eksperto sa paggawa ng code ay magpapalakas ng kanyang kasanayan sa paggawa ng code araw-araw, habang ang eksperto sa matematika ay magpapalakas ng kanyang kasanayan sa paglutas ng mga problema sa matematika. Walang kaugnayan, walang pagkakaabalisa. Ito ang tawag sa pagpapalakas ng kakayahan sa isang punto hanggang sa maksimo.

Pangalawang yugto: “Ang lahat ng mga paraan ay bumabalik sa isang pinagmulan.” Sa pamamagitan ng online distillation technology, i-unify at i-merge ang lahat ng mga eksperto na naging mahusay sa kanilang mga kasanayan sa isang magkakaisang modelo. Walang pagkawala ng enerhiya, walang pagkakabagabag.

Tignan natin ang dalawang “pangunahing hakbang” na kanilang nailabas.

Una ay ang V4-Pro-Max mode. Ito ang pinakamataas na mode para sa inference power. Parang na-unlock ang gene lock. Ayon sa kanilang sariling pag-claim (at agad na na-verify ng komunidad), sa coding benchmark tests, ang V4-Pro ay nasa antas ng pinakamataas, habang sa mga kumplikadong inference at Agent tasks, ang pagkakaiba sa mga pinakamodernong closed-source models (tulad ng GPT-5.5, Opus 4.6) ay napakalaki.

Ikalawa ay V4-Flash-Max. Mas interesante ito. Ito ay isang maliit na 284B, ngunit pagkatapos ng sapat na budget para sa pag-iisip, ang performance nito sa pagpapaliwanag ay nakakapagtulad sa Pro. Ano ang ipinapahiwatig nito? Ipinapahiwatig nito na ang "kalidad ng algorithm" ay nagsisimulang manalo sa "laki ng parameter". Kung bibigyan mo ito ng sapat na oras para isipin, maaari ring lutasin ng maliit na utak ang malalaking problema. Bagaman, sa purong kaalaman at napakakomplikadong marami-suliranin na Agent task, limitado pa rin ito sa laki ng parameter (dahil maliit lang ang tiyan nito), ngunit para sa karamihan sa mga enterprise-level na pang-araw-araw na aplikasyon, sobra na ang performance nito.

Sa huli, ang pag-iimbak ng weights ay nagsagawa ng hybrid precision storage na FP4+FP8 nang lubos na matalino—napanatili ang precision at napabawas ang VRAM. Lahat ng detalye ay nagpapakita ng isang sikat na pagiging matalino ng isang estudyante sa agham.

Para mas malinaw na ihambing ang pagtaas ng efisiyensiya ng inhenyeriya dulot ng post-training, idadagdag natin ang isang tabla ng komparatibong mga teknikal na indikador:

Ang paghinga ng kapital: Bakit pinagpapalakas ng V4 ang chain ng computing power sa China at Hong Kong?

Sa point na ito, ang teknikal na pagdecompose ay halos tapos na. Ngunit hindi pa natin sinagot ang unang malalim na tanong:

Bakit hindi nagpatuloy ang pagkakaroon ng kasiyahan sa sektor ng computing power ng GPT-5.5, ngunit natagumpayan ito ng DeepSeek V4?

Kailangan nating lumabas sa code at tingnan ang laban na ito sa pamamagitan ng pananaw ng kapital at negosyo.

Ang GPT-5.5 ay napakalakas, hindi mapatalo. Ngunit ito ay saradong source. Ano ang ibig sabihin ng saradong source? Ibig sabihin nito ay ang OpenAI ay isang malaking "black hole". Kung gusto mo gamitin ang kanyang kakayahan, kailangan mong bumili ng kanyang API. Ito ay isang "pagtatasa" na modelo. Ang kita ay dumadaloy patungo sa Silicon Valley, at ang pangangailangan sa computing power ay nakatuon sa mga cloud data center ng Microsoft. Para sa mga global na manufacturer ng hardware, lokal na computing centers, at mga server agent sa iba't ibang bansa, maliban sa pagtingin, wala silang maraming matatanggap. Anuman ang lakas ng GPT-5.5, iyon ay ang pagdiriwang ng iba. Ang pagtaas ng NVIDIA ay dahil sa paniniwala ng mga tao na ang OpenAI ay magkakaroon pa ng higit pang mga chip.

Ngunit iba ang DeepSeek V4.

Ito ay open source. At ito ay napakaseryoso sa MIT License. Ang MIT License ay ang pinakamalawak na pagkaloob sa mundo ng open source, na nangangahulugan na ang mga kompanyang komersyal ay maaaring gamitin, baguhin, at benta ito nang libre, nang walang takot sa legal na panganib.

Mas makamamatay pa, binalita namin sa mga nakaraang bahagi na ang V4 ay binaliwan ang gastos sa pag-iisip at paggamit ng memorya ng model hanggang sa mga tinik.

Isama ang dalawang punto na ito, at makakamit mo ang isang konklusyon na magiging sanhi ng pagkabigo ng mga kapital na merkado: ang kritikal na punto para sa private deployment ay talagang dumating na.

Kanina, kapag gustong mag-deploy ng isang malaking model na higit sa 1T, ang mga kumpanya ay tingnan ang listahan ng presyo ng hardware, isara nang tahimik, at bumili na lang ng API. Ngayon, sinasabi ng V4 sa lahat: kailangan mo lang ng kaunting mga machine upang i-run sa lokal ang isang super brain na halos katulad ng GPT-4 o kaya’y kahit tumalon sa antas ng GPT-5.5. Hindi kailangang lumabas sa probinsya o sa bansa ang iyong data—tuloy-tuloy na ligtas.

Kung ang lahat ay makakapag-run na sa lokal, ano ang susunod na mangyayari?

Bumili ng mga makina! Bumili ng mga server! Bumili ng mga optical modules! Itayo ang pusod ng malikhaing pagkalkula!

Ang mga kompanyang may sariling source ay nagbebenta ng buwis sa kaisipan, habang ang mga kompanyang bukas na source ay literal na nagpapromosyon para sa mga manufacturer ng hardware sa buong industriya. Ang DeepSeek V4 ay ang nagpapadala ng apoy. Mas maganda at mas bukas ito, mas malaki ang pagtaas ng lokal na pangangailangan sa computing power sa mga lugar tulad ng Tsina, Hong Kong, at Taiwan. Ang mga kompanya na nag-aasemble ng server, nagpapagawa ng liquid cooling, at nagpapatakbo ng data center, ay nakakakita na ng tunay na pera sa malawakang pagpapatupad.

Ito ang dahilan kung bakit agad umabot sa mataas ang hash rate chain ng China at Hong Kong noong ipinakilala ang V4 noong April 23. Ang kapital ay hindi bumibili ng pagmamahal, kundi nagpapahalaga na sa darating na “kamakailang alon ng pribadong pag-deploy sa libu-libong industriya”.

Ito, ang pangunahing negosyong palaisipan.

Wakas: Pagbaba ng alon at mga bato

Ang gulo ng mga tatlongnapu't isang araw, ang labing-isang malaking modelo, parang isang maingay na pagtatanghal ng pambubuhat.

Ang mga malalaking player ay nagpapalabas ng malalaking halaga sa paligsahan ng mga parameter, sinusubukang balewalain ang kanilang kalaban gamit ang kanilang lakas ng computing. Ngunit pagkatapos ng ingay, ang mga nag-iisa na nakakaiwan at nakakabago sa anyo ng industriya ay karaniwang hindi ang pinakamalakas na ingay.

Ang pagkakaroon ng DeepSeek V4 ay parang isang tahimik na assassin. Hindi ito nagpapaligsahan sa iyo kung sino ang mas maraming pera ang ginagastos, kundi ito ay tumutukoy sa pinakamalalim na kahinaan: pinaglalabasan ang walang kwentang VRAM, tinatanggal ang mga hadlang sa deployment, at isinusulong ang mga mataas na antas bilang para sa lahat.

Sa digmaang tinatawag na “Ragnarok” na AI, ang panahon ng pagpapalalim ng mga parameter nang walang direksyon ay patuloy na dumadaan sa pagtatapos. Ang hinaharap na battlefield ay magiging para sa mga makakahanap ng perpektong balanse sa pagitan ng “pinakamataas na performance” at “engineering efficiency”.

Laging babagsak ang mga trend; pagkatapos ng pagbaba, malalaman mo kung sino ang nagsusuot ng naka-naked at sino ang di-maikikisang bato.

Nakatanggap na ng mga sandata ang lahat ng mga tao mula sa V4. Ngayon, tingnan natin kung paano ng mga pangunahing pinuno ang magtatayo ng kanilang mga kampo sa bagong lupain.

Kapag naiintindihan mo na ito, maaari mong marinig nang mas mapayapa ang mga sigaw na “nakakagulat na paglalabas,” “muling tatalakayin,” at mas mabawasan ang iyong pagkabalisa.

After all, no matter how dazzling the magic, it ultimately comes down to the ledger, balancing out those few coins.

Source:

- DeepSeek V4 Series Preview Official Release, DeepSeek Team, GitHub/ModelScope/HuggingFace. (2026).

- Ang April AI Rally: Pagsusuri sa 30-Araw na Cycle ng Malalaking Model, ME News Market Observer. (2026).

- Mga Batas ng Paglago at ang Pagbabago sa Paradigma pagkatapos ng Pagtuturo, Journal of Artificial Intelligence Economics. (2026).

- Global Compute Supply Chain Market Pulse Report (April 2026), Pan-Asia Financial Data Analytics. (2026).