Hindi ito isang walang batayan na pananaw. Tiningnan niya ang maraming pampublikong benchmark at nakita na mabilis ang pag-unlad ng AI sa mga gawain na kaugnay sa pag-aaral ng AI.

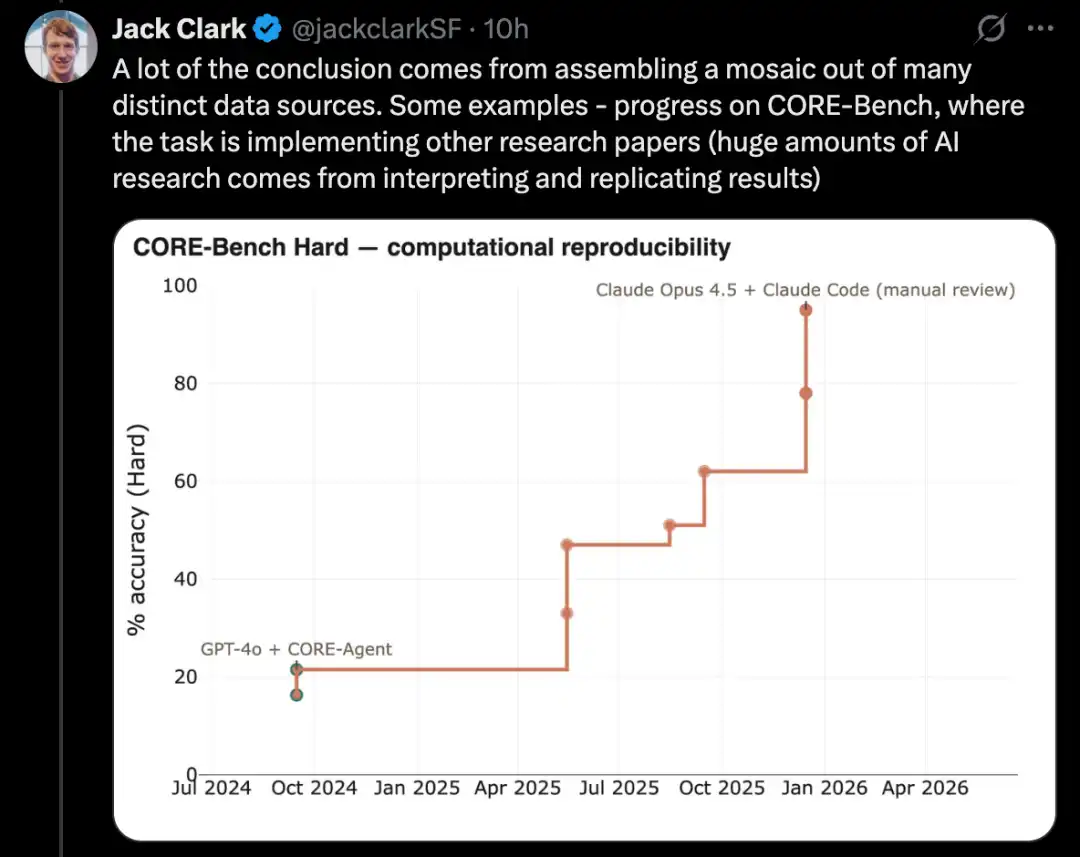

Halimbawa, ang CORE-Bench ay sinusuri ang kakayahan ng AI na maisagawa ang mga pananaliksik na papel ng iba, na isang mahalagang bahagi sa pag-aaral ng AI.

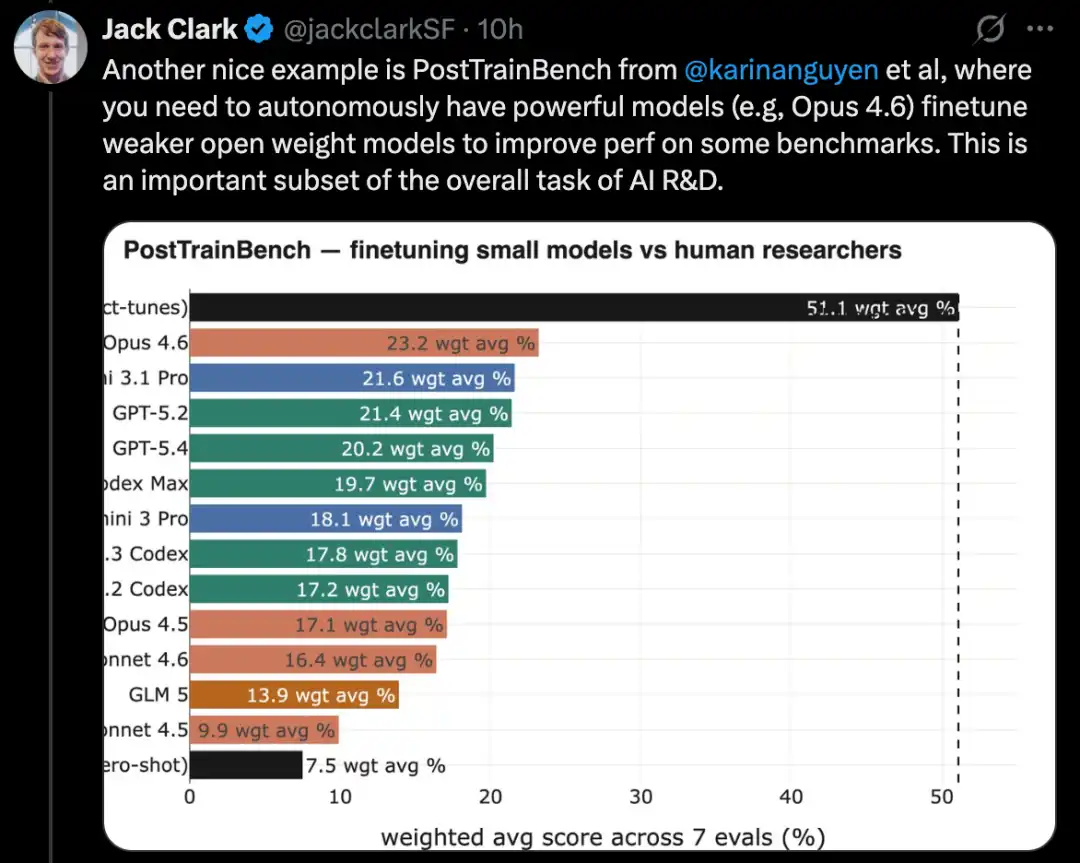

Ang PostTrainBench ay sinusubok kung kaya ng mga malakas na modelo na mag-micro-adjust nang sarili upang mapabuti ang performance ng mga mas mahinang open-source na modelo, na kung saan ay isang mahalagang subset ng AI research tasks.

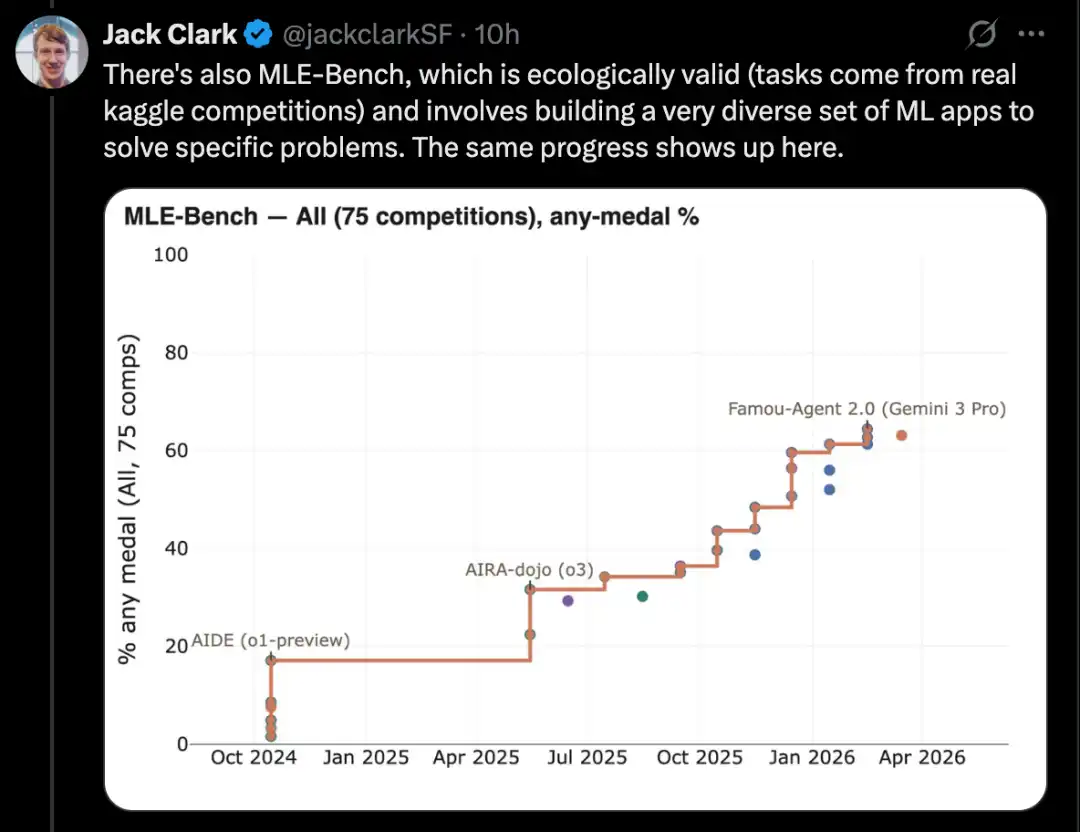

Ang MLE-Bench ay batay sa totoong Kaggle competition tasks at nangangailangan ng pagbuo ng diverse na machine learning applications upang lutasin ang partikular na problema. Bukod dito, ang mga kilalang coding benchmark tulad ng SWE-Bench ay ipinakikita rin ang katulad na pag-unlad.

Ipinapaliwanag ni Jack Clark ang fenomenong ito bilang isang "fractal" na umuupward at kanan na trend, kung saan makikita ang may-kahulugang pag-unlad sa iba't ibang resolusyon at iskala. Naniniwala siya na ang AI ay patuloy na umaabot sa kakayahan ng end-to-end automated research and development; kapag natutupad ito, makakabuo ang AI ng sarili nitong susunod na sistema at magpapakilala ng isang siklo ng self-iteration.

Pagkatapos ng pahayag na ito, maraming diskusyon ang naganap sa social media.

Iba’t ibang tao ang itinuturing ito bilang mahalagang unang hakbang patungo sa ASI at ang singularity, na maaaring magbago nang lubos ang ritmo ng pag-unlad ng teknolohiya.

Gayunpaman, mayroon ding iba't ibang pananaw.

Ang propesor ng Computer Science ng University of Washington, Pedro Domingos, ay nagturo na ang mga sistema ng AI ay may kakayahang “bumuo ng sarili” mula noong ang wika na LISP ay nilikha noong mga 1950s; ang totoong tanong ay kung kaya nitong makakuha ng pagpapalago na may pagpapalaki, at hanggang ngayon ay wala pang malinaw na ebidensya na sumusuporta dito.

May mga netizen na nagtanong kung bakit biglaang tumataas ang probabilidad ng 30% mula 2027 hanggang 2028, na nagpapahiwatig na mayroong isang biglaang malaking pag-usbong sa kakayahan ng AI sa dulo ng 2027. Ano ang tiyak na milestone o pangyayari na magdudulot ng malaking pagtaas sa probabilidad ng recursive self-improvement ng AI sa maikling panahon?

May mga netizen din na nagpahayag na si Jack Clark ay ang bagong pinuno ng public relations ng Anthropic, na bahagi ng kanilang bagong estratehiya: Hindi kami mga nagpapalakas ng takot; maraming papel ang nagpapatotoo sa lahat ng mga bagay na inaanyayahan namin kayo.

Isinulat ni Jack Clark ang isang mahabang artikulo na detalyado sa Import AI 455 na newsletter.

Susunod, tingnan natin nang buo ang artikulong ito.

Magsisimula na ang AI system sa pagbuo ng sarili nito, ano ang ibig sabihin nito?

Sinabi ni Clark na isinulat niya ang artikulong ito dahil sa pag-aaral ng lahat ng publiko available na impormasyon, kailangan niyang mabuo ang isang hindi madaling pagpapasya: bago ang dulo ng 2028, ang posibilidad ng AI-driven na pag-aaral na walang tao ay malaki na, posibleng hihigit sa 60%.

Ang tinatawag na AI research na walang tao ay isang sapat na malakas na AI system: ito ay hindi lamang nakakatulong sa mga tao sa paggawa ng pananaliksik, kundi maaari ring magawa nito nang sarili ang mga mahahalagang proseso ng pag-aaral, at kahit na bumuo ng sariling susunod na henerasyon ng sistema.

Sa pananaw ni Clark, ito ay malinaw na isang malaking bagay.

Kinilala niya na mahirap din para sa kanya na lubos na maunawaan ang kahulugan nito.

Dahil sa sobrang kalaliman ng epekto nito, ipinakita ni Clark na ito ay isang hindi nagustuhang pagpapasya. Hindi sigurado si Clark kung handa na ang buong lipunan sa mga malalim na pagbabago na dudulot ng awtomatikong pag-unlad ng AI.

Naniniwala siya ngayon na ang sangkatauhan ay maaaring nabubuhay sa isang espesyal na panahon: ang pag-aaral ng AI ay malapit nang ma-automate nang buo. Kung talagang dumating ang sandaling ito, ang sangkatauhan ay parang nakalampas sa Rubicon, at pumasok sa isang hinaharap na halos hindi ma-predict.

Sinabi ni Clark na ang layunin ng artikulong ito ay ipaliwanag kung bakit niya itinuturing na nangyayari ang pagtungo sa pag-usbong ng ganap na awtomatizado na AI research.

Mag-uusap siya sa ilang posibleng epekto ng trend, ngunit ang karamihan sa artikulo ay magiging nakatuon sa ebidensya na sumusuporta sa paghuhusga na ito. Para sa mas malalimang epekto, plano ni Clark na patuloy na i-梳理 sa karamihan ng taon na ito.

Batay sa oras, hindi naniniwala si Clark na mangyayari ito sa taong 2026. Ngunit naniniwala siya na sa susunod na dalawang taon, maaari nating makita ang isang halimbawa kung saan ang isang modelo ay tinuturuan nang end-to-end upang lumikha ng sariling kasunod. Sa antas ng mga hindi pinakamoderno na modelo, malamang na makakamit ang isang konseptong patunay; samantalang para sa mga pinakamoderno na modelo, mas mahirap ito dahil sobrang mahal ang gastos at nakasalalay ito sa malakas na paggawa ng maraming human researcher.

Ang pagtataya ni Clark ay batay sa publikong impormasyon: kabilang dito ang mga papel sa arXiv, bioRxiv, at NBER, pati na rin ang mga produkto na nangangalap na ng mga kompanya sa harap ng AI sa totoong mundo. Batay sa mga impormasyong ito, kanyang natuklasan na ang lahat ng mga bahagi ng proseso ng automated production na kailangan para sa kasalukuyang mga sistema ng AI, lalo na ang mga inhenyerong komponente sa pag-unlad ng AI, ay praktikal na mayroon na.

Kung patuloy ang trend ng scaling, dapat nating simulan ang paghahanda para sa isang sitwasyon kung saan ang mga modelo ay magiging sapat na malikhaing hindi lamang awtomatikong mapapabuti ang mga kilalang paraan, kundi maaari ring palitan ang mga human researcher sa pagpapakita ng mga bagong direksyon sa pananaliksik at orihinal na ideya, na kaya nilang ipagpatuloy ang pag-unlad ng AI frontier.

Code Singularity: Pagbabago ng kakayahan sa panahon

Ang AI system ay isinasagawa sa pamamagitan ng software, at ang software ay binubuo ng code.

Ang mga sistema ng AI ay nagbago nang lubos ang paraan ng paggawa ng code. May dalawang kaugnay na trend dito: sa isang panig, mas matalino na ang mga sistema ng AI sa pagsusulat ng malalalim at totoong mundo code; sa kabilang panig, mas matalino na rin sila sa pagpapagsama ng maraming linyar na coding tasks nang hindi kailangan ng malaking pagmamanoa mula sa tao, tulad ng pagsusulat ng code bago ang pagsubok.

Dalawang karaniwang halimbawa na nagpapakita ng trend na ito ay ang SWE-Bench at METR time horizons plot.

Lutasin ang mga problema sa software engineering sa totoong mundo

Ang SWE-Bench ay isang malawakang ginagamit na pagsubok sa pagprograma upang masukat ang kakayahan ng mga AI system sa paglutas ng totoong GitHub issue.

Kapag ipinakilala ang SWE-Bench noong katapusan ng 2023, ang pinakamahusay na model noon ay ang Claude 2, na may kabuuang tagumpay na humigit-kumulang 2%. Samantala, ang resulta ng Claude Mythos Preview ay umabot na sa 93.9%, malapit na sa perfektong pagsasagawa ng benchmark na ito.

Totoo naman na mayroong ingay sa bawat benchmark, kaya karaniwang dumadating ang isang yugto kung saan kapag tumataas na ang marka hanggang sa isang tiyak na antas, ang iyong nakikita ay hindi na ang limitasyon ng paraan, kundi ang limitasyon ng sariling benchmark. Halimbawa, sa ImageNet validation set, halos 6% ng mga label ay mali o may kakaibang kahulugan.

Ang SWE-Bench ay maaaring ituring na isang mapagkakatiwalaang tukoy ng pangkalahatang kakayahan sa pagprograma, at ng epekto ng AI sa software engineering. Sinabi ni Clark na ang karamihan sa mga taong kanyang nakikita sa mga unang yugto ng AI lab at sa Silicon Valley, ay ngayon ay halos ganap na sumusulat ng code gamit ang AI systems, at lalong lumalaki ang bilang ng mga taong gumagamit ng AI systems upang sumulat ng mga pagsubok at suriin ang code.

Sa ibang salita, sapat na malakas ang AI system upang awtomatikuhin ang isang mahalagang bahagi ng AI research, at makapagpabilis nang malaki sa lahat ng mga human researcher at engineer na nakikilahok sa AI research.

Sukatin ang kakayahan ng AI system na matapos ang mga mahabang gawain

Gumawa ng isang graph ang METR upang sukatin kung gaano karaming komplikadong gawain ang AI ay makakaya. Ang antas ng kumplikado ay batay sa ilang oras na kailangan ng isang kasanayang tao upang matapos ang mga gawain na iyon.

Ang pinakamahalagang indikador ay ang mga tagal ng task na kumakatawan sa 50% reliability na natamo ng AI system sa isang hanay ng mga gawain.

Sa punto na ito, ang pag-unlad ay napakaganda:

· Noong 2022, ang mga gawain na kayang gawin ng GPT-3.5 ay katumbas ng mga gawain na kailangan ng tao ng 30 segundo upang tapusin.

· Noong 2023, inabot ng GPT-4 ang oras na ito sa 4 minuto.

· Noong 2024, inaangat ng o1 ang oras na ito sa 40 minuto.

· Noong 2025, ang GPT-5.2 High ay nakamit ang halos 6 na oras.

· Hanggang 2026, pinataas na ng Opus 4.6 ang oras na ito sa halos 12 oras.

Si Ajeya Cotra, na nagtatrabaho sa METR at mahabang panahon ay nagsusuri sa AI prediction, ay naniniwala na ang pagkakaroon ng AI system na kayang kumpletuhin ang isang gawain na kailangan ng tao ng 100 oras bago ang katapusan ng 2026 ay hindi isang hindi makatwirang inaasahan.

Ang panahon kung kailan makakapag-isa ang mga AI system ay naging mas mahaba, at malapit na kaugnay sa paglago ng mga agentic coding tool. Ang mga agentic coding tool, sa kanyang core, ay ang pagpapakita ng mga AI system na makakapagawa ng mga gawain para sa tao: maaari silang kumatawan sa mga tao at magpatuloy sa mga gawain nang may malaking kalayaan sa mahabang panahon.

Ito ay bumabalik sa pag-aaral ng AI mismo. Sa pagmamasid sa mga pang-araw-araw na gawain ng maraming mga siyentipiko sa AI, makikita na maraming mga gawain ay maaaring i-decompose sa mga gawain na nagtatagal ng ilang oras, tulad ng paglinis ng data, pagbasa ng data, at pagpapalakas ng eksperimento.

At ang mga gawain na ito, ngayon ay nasa loob ng saklaw ng oras na kayang takpan ng modernong AI system.

Mas marunong ang AI system, mas makakapag-isip nang hiwalay sa tao, at mas makakatulong sa pag-automate ng ilang bahagi ng AI research.

Ang mga pangunahing salik sa pag-utos ng gawain ay dalawa:

· Isa ay ang iyong tiwala sa kakayahan ng iyong pinagkakatiwalaan;

· Ikalawa, naniniwala ka na kayang makumpleto ng independiyente ang iyong kapwa nang hindi nangangailangan ng patuloy na pagmamasid mula sa iyo.

Kapag sinusubaybayan ng mga gumagamit ang kakayahan ng AI sa pagprograma, makikita nila na ang mga sistema ng AI ay hindi lamang nagiging mas kasanayan, kundi pati na rin ay nakakapagtrabaho nang mas mahaba sa pamamagitan ng sarili nilang pagkakataon nang walang kailangang tulong ng tao para i-re-calibrate.

Nakakatugma rin ito sa mga nangyayari sa paligid natin, kung saan ang mga inhinyero at mga mananaliksik ay nagpapasa ng mas malalaking bahagi ng trabaho sa mga sistema ng AI. Habang patuloy na umuunlad ang kakayahan ng AI, ang mga gawain na ipinapahintulot sa AI ay nagsisiging mas kumplikado at mas mahalaga.

Ang AI ay natututunan ang mga pangunahing siyentipikong kasanayan na kailangan para sa pag-unlad ng AI

Isipin kung paano ginagawa ang modernong siyentipikong pag-aaral, kung saan malaking bahagi ng trabaho ay ang pagtukoy muna sa direksyon, pagpapaliwanag kung anong uri ng empirikal na impormasyon ang nais makamit; pagkatapos ay pagdidisenyo at pagpapatakbo ng eksperimento upang makagawa ng mga impormasyong iyon; at huling bahagi ay ang pagsusuri sa katotohanan ng mga resulta ng eksperimento.

Dahil sa patuloy na pagpapabuti ng kakayahan ng AI sa pag-program at ang lalong lumalakas na kakayahan ng malalaking modelo sa pagmomodelo ng mundo, mayroon na ngayong isang serye ng mga kasangkapan na nakakatulong sa mga siyentipiko upang mapabilis ang proseso at awtomatikuhin ang ilang mga bahagi sa mas malawak na mga skena ng pag-aaral at pag-unlad.

Dito, maaari nating obserbahan ang bilis ng pag-unlad ng AI sa ilang mahahalagang siyentipikong kasanayan, na ang mga kakayahan naman ay bahagi rin ng hindi maaaring iwasan sa pag-aaral ng AI:

· Una ay pag-uulit ng mga resulta ng pag-aaral;

· Ikalawa, i-串联 ang teknolohiya ng machine learning at iba pang mga paraan upang lutasin ang mga teknikal na problema;

· Ikatlo ay ang pagpapabuti ng sariling AI system.

Isagawa ang buong siyentipikong papel at kumpletuhin ang mga kaugnay na eksperimento

Isang pangunahing gawain sa pag-aaral ng AI ay ang pagbabasa ng mga siyentipikong papel at ang pagpapakita muli ng mga resulta dito. Sa aspetong ito, ang AI ay nakamit ang malaking pag-unlad sa isang serye ng mga benchmark.

Isang magandang halimbawa ay ang CORE-Bench, o Computational Reproducibility Agent Benchmark.

Ang benchmark na ito ay nangangailangan ng isang AI system na muling ipakita ang mga resulta ng isang papel kasama ang kanyang code repository. Sa partikular, kailangan ng Agent na i-install ang mga kaugnay na library, package, at dependencies, at patakbuhin ang code; kung matagumpay na patakbuhin ang code, kailangan pa nito na hanapin ang lahat ng output at sagutin ang mga tanong sa task.

Inilah ang CORE-Bench noong Setyembre 2024. Ang pinakamahusay na sistema noong panahong iyon ay ang GPT-4o model na tumatakbo sa CORE-Agent scaffold. Sa pinakamahirap na grupo ng mga gawain sa benchmark na ito, ang kanyang marka ay nasa paligid ng 21.5%.

At ng 2025 ng Disyembre, isang may-akda ng CORE-Bench ay inihayag na nalutas na ang benchmark: ang Opus 4.5 model ay nakakuha ng 95.5%.

Gumawa ng kompletong machine learning system upang lutasin ang mga problema sa Kaggle competition

Ang MLE-Bench ay isang benchmark na binuo ng OpenAI upang subukan ang kakayahan ng mga AI system na kumilala sa Kaggle competitions sa isang offline na kapaligiran.

Nakakapalibot ito ng 75 iba’t ibang uri ng Kaggle competition, na naglalaman ng maraming larangan tulad ng natural language processing, computer vision, at signal processing.

Ipinakilala ang MLE-Bench noong Oktubre 2024. Sa panahon ng paglalabas, ang pinakamahusay na sistema ay isang o1 model na tumatakbo sa agent scaffold, na nakakuha ng marka na 16.9%.

Hanggang Pebrero 2026, ang pinakamahusay na sistema ay naging Gemini 3 na tumatakbo sa isang agent harness na may kakayahang maghanap, na nakakuha ng marka na 64.4%.

Disenyo ng Kernel

Isang mas mahirap na gawain sa pag-unlad ng AI ay ang pag-optimize ng kernel. Ang pag-optimize ng kernel ay ang pagsulat at pagpapabuti ng mga batayang code upang mas epektibong ma-map ang mga partikular na operasyon tulad ng matrix multiplication sa ibaba-hardware.

Ang pag-optimize ng kernel ay mahalaga sa pag-unlad ng AI dahil ito ang nagtatakda ng efisiyensiya ng pag-train at pag-infer: sa isang aspeto, ito ang nakakaapekto sa kung gaano karaming computing power ang maaari mong gamitin habang nagpapalawak ng isang AI system; sa ibang aspeto, kapag natapos na ang pag-train ng model, ito ang nagtatakda kung gaano kaepeksiyente mo ang computing power na i-convert sa kakayahan sa pag-infer.

Sa mga nakaraang taon, ang paggamit ng AI para sa kernel design ay naging isang kompetitibong larangan ng pag-aaral mula sa isang interesanteng maliit na direksyon, at mayroon nang ilang benchmark. Gayunpaman, ang mga benchmark na ito ay hindi pa lubos na popular, kaya mahirap nating modeluhan ang kanilang pangmatagalang pag-unlad nang malinaw tulad ng iba pang mga larangan. Sa kabilang banda, maaari nating marinig ang bilis ng pag-unlad ng direksyong ito sa pamamagitan ng ilang kasalukuyang pag-aaral.

Kasama ang mga kakaibang trabaho:

· Subukan ang mga modelo ng DeepSeek upang buuin ang mas mahusay na GPU kernel;

I-convert nang awtomatiko ang mga PyTorch module sa CUDA code;

· Ginagamit ng Meta ang LLM upang awtomatikong lumikha ng pinapabuti na Triton kernel at i-deploy sa kanilang sariling imprastruktura;

· At ang pagpapalit ng mga open-source weight model ayon sa disenyo ng GPU kernel, tulad ng Cuda Agent.

Kailangan dagdagan ang sumusunod: ang disenyo ng kernel ay may ilang mga katangian na espesyal na angkop para sa AI-driven na pag-unlad, tulad ng madaling i-verify ang mga resulta at malinaw ang mga signal ng reward.

I-adjust ang language model gamit ang PostTrainBench

Isang mas mahirap na bersyon ng ganitong uri ng pagsubok ay ang PostTrainBench. Ito ay nagtatala kung paano makakatanggap ng mga maliit na open-source weight model ang iba’t ibang advanced model at makapagpapabuti sa kanilang performance sa ilang benchmark sa pamamagitan ng fine-tuning.

Isang kahusayan ng benchmark na ito ay ang malakas na human baseline nito: ang mga existing instruct-tuned na bersyon ng mga maliit na modelo. Ang mga bersyon na ito ay karaniwang binuo ng mga mahusay na human AI researcher mula sa mga nangungunang laboratoryo, na pinagbago ng mga may kakayahang researcher at engineer, at inilunsad sa totoong mundo. Kaya, bumubuo sila ng isang mahirap lapasan na human benchmark.

Hanggang Marso 2026, ang mga AI system ay nakakapag-post-train na sa mga modelo at nakakakuha ng halos kalahating pagpapabuti sa performance kumpara sa mga resulta ng tao.

Ang tiyak na marka ng pagtataya ay galing sa isang timbang na average: ito ay nagpapagsama ng maraming post-training na malalaking modelo ng wika, kabilang ang Qwen 3 1.7B, Qwen 3 4B, SmolLM3-3B, Gemma 3 4B, at maraming benchmark, kabilang ang AIME 2025, Arena Hard, BFCL, GPQA Main, GSM8K, HealthBench, at HumanEval.

Sa bawat pagpapatakbo, hihingin ng tagapagsuri ang isang CLI agent upang maaabot ang pinakamataas na pagpapabuti sa isang partikular na base model sa isang partikular na benchmark.

Hanggang Abril 2026, ang pinakamataas na marka ng AI system ay umabot sa halos 25% hanggang 28%, na kabilang ang mga modelo tulad ng Opus 4.6 at GPT 5.4; sa kumpara sa ito, ang marka ng tao ay 51%.

Ito ay isang napakalaking resulta na.

Optimize language model training

Noong nakaraang taon, ang Anthropic ay nagrereport ng kanilang sistemang pagganap sa isang gawain sa pagtatrain ng LLM. Ang gawain na ito ay nangangailangan ng pag-optimize ng isang maliit na implementasyon ng pagtatrain ng wika na gumagamit lamang ng CPU, upang ito ay maging kasing bilis ng maaari.

Ang paraan ng pagmamarka ay: ang average na bilis na pagpapabilis na natamo ng modelo kumpara sa orihinal na code na hindi binago.

Sangat makabuluhan ang pag-unlad ng resultang ito:

· Noong Mayo 2025, ang Claude Opus 4 ay nagkaroon ng 2.9-fold average acceleration;

· Noong Nobyembre 2025, tumaas ang Opus 4.5 sa 16.5 beses;

· Noong Pebrero 2026, ang Opus 4.6 ay nakamit ang 30 beses;

· Noong Abril 2026, ang Claude Mythos Preview ay nakamit ang 52 beses.

Para maunawaan ang kahulugan ng mga numero na ito, maaaring gamitin ang sumusunod na pagsasalin: sa mga human researcher, karaniwang kailangan ng 4 hanggang 8 na oras ng paggawa upang makamit ang 4-fold na pagpapabilis.

Meta skill: Management

Ang mga AI system ay nag-aaral din kung paano pamahalaan ang iba pang AI system.

Ito ay nakikita na sa ilang malawak na ipinapalabas na produkto, tulad ng Claude Code o OpenCode. Sa mga produkto na ito, isang pangunahing agent ang nagmamonitor sa maraming sub-agent.

Nagpapahintulot ito sa AI system na tratuhin ang mas malalaking proyekto: maaaring kailanganin ng proyekto ang maraming mga agent na may iba’t ibang espesyalisasyon na gumagawa nang sabay-sabay, at karaniwan ay pinag-uugnay ng isang solong AI manager. Ang manager mismo ay isang AI system rin.

Mas katulad ba ng paghahanap ng pangkalahatang relatividad o pagtatayo ng LEGO ang pag-aaral ng AI?

Isang mahalagang tanong: Maaari ba ng AI na mag-imbento ng mga bagong ideya upang tulungan itong mapabuti ang sarili nito? O mas angkop ang mga sistemang ito para sa mga gawain sa pananaliksik na hindi gaanong makikita, ngunit kailangang iproseso isa-isa?

Mahalaga ang tanong na ito dahil ito ay nakauugnay sa kung gaano karami ang maaaring automatisuhin ng AI system ang sariling pag-aaral ng AI.

Ang pagtataya ng may-akda ay: Ang AI ay kasalukuyang hindi kayang magbigay ng tunay na radikal at bagong ideya. Ngunit upang makamit ang awtomatikong pagpapalawak ng sarili, hindi nito kailangang gawin ito.

Bilang isang larangan, ang pag-unlad ng AI ay malaking bahagi na nakadepende sa mas malalaking eksperimento at mas maraming input, tulad ng data at computing power.

Kapansin-pansin, minsan ay nagtataglay ang mga tao ng mga ideya na nagbabago ng paradigm, na nagpapataas nang malaki ang efisiyensiya ng mga yaman sa buong larangan. Ang Transformer architecture ay isang magandang halimbawa, at ang mixture-of-experts naman ay isa pang halimbawa.

Ngunit sa mas maraming pagkakataon, ang paraan ng pag-unlad sa larangan ng AI ay mas simpleng: ang mga tao ay kukunin ang isang mabuting system, lalawakin ang isang partikular na aspeto nito, tulad ng training data at computing power; obserbahan kung saan nagkakaroon ng problema pagkatapos ng paglalawak; hanapin ang mga solusyon sa inhenyeriya upang mapahintulutan ang karagdagang paglalawak; at muli itong lalawakin.

Sa proseso na ito, ang tunay na kailangan ng pag-unawa ay maliit lamang. Ang malaking bahagi ng trabaho ay mas tila hindi napakalakas, ngunit napakatibay na pang-ingenyeriya.

Kaugnay nito, maraming AI research ay nagpapatakbo ng iba’t ibang bersyon ng umiiral na eksperimento upang masuri kung ano ang epekto ng iba’t ibang pagtatakda ng parameter. Bagaman makakatulong ang intuisyon ng mga tao sa pagpili ng pinakamahalagang parameter na subukan, maaari ring automatisin ang prosesong ito upang pahintulutan ang AI na magdesisyon kung aling parameter ang dapat i-ayos. Ang mga unang bersyon ng neural architecture search ay isang halimbawa ng ganitong ideya.

Sinabi ni Edison: Ang talino ay 1% na inspirasyon, kasama ang 99% na pawis. Kahit na lumipas na ang 150 taon, patuloy pa ring angkop ang pangungusap na ito.

Kadalasan, may mga pagbabagong malalim na nagpapalit sa isang larangan. Ngunit sa karamihan ng mga pagkakataon, ang pag-unlad ng isang larangan ay nangyayari sa pamamagitan ng maliit-maliit na pagpapabuti at pagpapalawak ng mga sistema sa pamamagitan ng masigasig na pagsisikap ng tao.

Ang mga pampublikong datos na nabanggit sa harap ay nagpapakita na ang AI ay napakasigla na sa pagpapatupad ng maraming kailangang gawain sa pag-unlad ng AI.

Samantala, mayroon pa ring mas malaking trend: ang mga pangunahing kakayahan, tulad ng pag-program, ay nagkakaisa kasama ang patuloy na paglalawak ng saklaw ng oras ng mga gawain. Ibig sabihin nito na ang mga AI system ay makakapag-ugnay ng mas maraming ganitong mga gawain upang bumuo ng mga kumplikadong hanay ng trabaho.

Kaya, kahit na ang mga AI system ay kasalukuyang may limitadong kreatibidad, may dahilan na paniniwalaan na sila ay makakapagpapagawa pa rin ng sarili nilang pag-unlad. Ngunit mas mabagal ang bilis ng pag-unlad na ito kumpara sa mga sitwasyon kung saan maaaring maglikha ng mga bagong pag-unawa.

Ngunit kung susundin pa ang mga pampublikong data, makikita ang isang iba pang kakaibang signal: maaaring ipinapakita ng mga AI system ang ilang uri ng kreatibidad, na maaaring magdulot ng kanilang sariling pag-unlad sa mas kakaibang paraan.

Ipagpatuloy ang pag-unlad ng mga hangganan ng agham

Mayroon nang ilang sobrang maagang palatandaan na ang mga pangkalahatang AI system ay may kakayahang ipagpatuloy ang pag-unlad ng mga hangganan ng siyensya ng tao. Gayunpaman, hanggang sa ngayon, ang ganitong sitwasyon ay nangyari lamang sa ilang kaunting larangan, pangunahin sa computer science at matematika. At madalas, hindi lamang ang AI system ang nagawa ang mga pag-usbong, kundi kasama ang tao sa pamamagitan ng pagkakasundo ng tao at machine upang ipagpatuloy ang pananaliksik.

Gayunpaman, ang mga trend na ito ay patuloy na dapat obserbahan:

Ang problema ni Erdős: Isang grupo ng mga matematiko na nagtrabaho kasama ang Gemini model upang subukan ang kanyang kakayahan sa paglutas ng ilang mga problema ni Erdős. Pinatnubayan nila ang sistema na subukan ang higit sa 700 na problema, at natagpuan nila ang 13 na solusyon. Sa mga solusyon na ito, may 1 na itinuturing nilang interesante.

Isinulat ng mga mananaliksik na sa kanilang maagang pagtataya, ang paglutas ni Aletheia (isang AI system na batay sa Gemini 3 Deep Think) sa Erdős-1051 ay nagpapakita ng isang maagang kaso: isang AI system na nagsolba nang sarili nito ng isang hindi gaanong simpleng, may kalawakan sa mas malawak na matematikong interes na bukas na problema ni Erdős. Mayroon nang ilang malapit na kaugnay na literatura sa problema na ito.

Kung ipapalagay nating positibo, ang mga kaso na ito ay maaaring ituring na isang signal: ang mga AI system ay nagpapalago ng isang uri ng kreatibong intuisyon na nakakapagpapalaya sa hangganan ng larangan, na dati ay nasa pangunahang bahagi ng tao.

Ngunit maaari rin itong ipaliwanag mula sa ibang panig: ang matematika at agham ng kompyuter ay maaaring sariling mga larangan na espesyal na angkop para sa mga imbensyon na hinahamon ng AI, kaya't maaaring sila ay mga exception lamang at hindi kumakatawan sa mas malawak na agham na pananaliksik na gagawin ng AI sa parehong paraan.

Ang isang katulad na halimbawa ay ang 37th move ng AlphaGo. Gayunpaman, naniniwala si Clark na dahil lumipas na ang sampung taon mula noong nangyari ang resulta ng AlphaGo, at hindi pa rin nalilipasan ng isang mas moderno at mas nakakagulat na pag-unawa ang 37th move, ito mismo ay maaaring ituring na isang kaunting malungkot na signal.

Ang AI ay nakakapag-automate na ng malalaking bahagi ng AI engineering

Kung isasama ang lahat ng ebidensya sa itaas, makikita natin ang sumusunod na larawan:

Ang mga sistema ng AI ay nakakapag-isulat na ng code para sa almost anumang programa, at maaari nang tiyakin na ang mga sistemang ito ay makakapagtapos nang mag-isa ng ilang mga gawain; ang mga gawain na ito, kung ibibigay sa tao, ay karaniwang nangangailangan ng maraming sandaling malakas na pagkakabukod.

Lalong nagiging mahusay ang mga AI system sa paggawa ng mga pangunahing gawain sa pagbuo ng AI, mula sa pag-adjust ng modelo hanggang sa pagdisenyo ng kernel, at lahat ay逐步 na natutukoy.

Nakakapagpapatakbo na ang mga sistema ng AI sa iba pang mga sistema ng AI, nagbuo ng isang sintetikong tim: maraming AI ay maaaring magkahiwalay na sagutin ang mga kumplikadong problema, kung saan ang ilang AI ay naglalaro ng mga papel bilang tagapamahala, tagapagsuri, at editor, habang ang iba pang AI ay naglalaro ng mga papel bilang mga inhinyero.

Ang ilang sistema ng AI ay kaya nang lumampas sa mga tao sa mahihirap na inhinyeriya at agham na gawain, bagaman mahirap pa ring masukat kung ito ay dahil sa kanilang tunay na pagkamalikhain o dahil sa kanilang naging marunong na sa malaking dami ng patterned na kaalaman.

Ayon kay Clark, ang mga ebidensya ay malinaw na nagpapakita na ang kasalukuyang AI ay kaya nang awtomatikuhin ang malaking bahagi ng AI engineering, o kaya naman ang buong proseso.

Gayunpaman, hindi pa malinaw kung gaano kalawak ang pag-automate ng AI sa sariling pag-aaral ng AI. Dahil ang ilang bahagi ng pag-aaral ay maaaring iba sa mga purong kasanayan sa inhinyeriya at patuloy na nakadepende sa mas mataas na antas ng pagpapasya, pagkakaroon ng pagkakaintindi sa problema, at kreatibidad.

Ngunit anuman ang mangyari, isang malinaw na signal ay umabot: ang AI ngayon ay nagsisilbing mabilis na pagpapalakas sa mga tao na nagtatrabaho sa pagbuo ng AI, na nagpapahintulot sa mga mananaliksik at inhinyero na palakasin ang kanilang kakayahan sa pamamagitan ng pakikipagtulungan kasama ang maraming synthetic na kasamahan.

Sa huli, ang industriya ng AI mismo ay praktikal na nagpapahiwatig: ang awtomatikong pag-aaral ng AI ay ang kanilang layunin.

Gusto ng OpenAI na bumuo ng isang awtomatikong AI research intern bago ang Setyembre 2026. Ang Anthropic ay naglalabas ng mga gawa tungkol sa pagbuo ng awtomatikong AI alignment researcher. Ang DeepMind ay ang pinakamabagal sa tatlong laboratorio, ngunit sinasabing dapat palaguin ang awtomatikong pag-aaral ng alignment kapag ito ay posible.

Ang automation ng AI research ay naging layunin rin ng maraming startup. Kasama na ang Recursive Superintelligence, na kumuhang $500 milyon sa pagsasakatuparan ng automation ng AI research.

Sa ibang salita, ang mga pondo na nasa bilang ng milyon-milyon dolyar na umiiral at bagong pondo ay papasok sa isang hanay ng mga institusyon na may layuning automatikong pag-unlad ng AI.

Kaya, dapat nating inaasahan na ang direksyong ito ay magdudulot ng kahit anumang antas ng progreso.

Bakit ito mahalaga

Ang epekto nito ay malalim, ngunit kakaunti ang pagtalakay dito sa mga balita ng mainstream tungkol sa pag-unlad ng AI. Mga sumusunod na aspeto ang nagpapakita ng malalaking hamon na dinala ng pag-unlad ng AI.

1. Dapat nating gawing maayos ang pagkakatugma: Ang mga teknik ng pagkakatugma na epektibo ngayon ay maaaring mawalan ng epekto sa rekursibong sariling pagpapabuti, dahil ang mga sistema ng AI ay magiging mas matalino kaysa sa mga tao o sistema na nagmamonitor sa kanila. Ito ay isang larangan na malawakang pinag-aralan, kaya't pinag-uusapan niya lamang ang ilang mga problema:

Ang pagtuturo sa isang AI system na huwag magbola at magcheat ay isang hindi inaasahang delikado na proseso (halimbawa, kahit na may malaking pagsisikap na gumawa ng mga mahusay na pagsubok para sa kalikasan, minsan ang pinakamahusay na paraan ng AI na lutasin ang isang problema ay ang pagcheat, na nagtuturo sa ito na ang pagcheat ay maaaring gawin).

Ang AI system ay maaaring magmanipula sa atin sa pamamagitan ng “paggawa ng pagkakatugma,” na naglalabas ng mga marka na nagpapakita na ito ay nagtatampok nang mabuti, ngunit tinatago ang totoong intensyon nito. (Karaniwan, ang AI system ay nakakakilala na kailan ito ay sinusubok.)

· Habang ang mga sistema ng AI ay nagsisimulang mag-ambag nang higit pa sa kanilang sariling pagtuturo sa mga pagsisikap sa pananaliksik, maaari naming baguhin nang malaki ang paraan ng pagtatrain ng mga sistema ng AI, ngunit walang mabuting intuisyon o teoretikal na batayan upang maunawaan kung ano ang ibig sabihin nito.

· Kapag isinasaayos mo ang isang sistema sa isang recursive loop, lumalabas ang isang napakabasehang problema ng "accumulated error" na maaaring makaapekto sa lahat ng mga isyu na nabanggit at iba pa: kung hindi ang iyong alignment method "100% accurate" at teoretikal na nakakapagpapanatili ng accuracy sa mas matalinong mga sistema, mabilis na maaaring magsira ang mga bagay. Halimbawa, kung ang iyong teknikal na initial precision ay 99.9%, maaaring bumaba ito sa 95.12% pagkatapos ng 50 generations, at maaaring bumaba sa 60.5% pagkatapos ng 500 generations.

Ang bawat bagay na nauugnay sa AI ay magkakaroon ng malaking pagtaas sa produktibidad: tulad ng paunlarin nang malaki ng AI ang produktibidad ng mga software engineer, dapat nating inaasahan na magkakaroon din ng ganitong epekto ang iba pang mga larangan na nauugnay sa AI. Nagdudulot ito ng ilang mga problema na kailangang harapin:

· Hindi pantay na pagkakaroon ng mga yaman: Kung patuloy na lalampas ang pangangailangan sa AI sa suplay ng mga computasyonal na yaman, kailangan nating pumili kung paano isagawa ang pagkakabahagi ng AI upang makamit ang pinakamalaking benepisyo sa lipunan. Naniniwala ako na ang mga pambansang insentibo ay hindi makakatulong na siguraduhin na makakakuha tayo ng pinakamahusay na sosyal na benepisyo mula sa limitadong computasyonal na AI. Ang pagtukoy kung paano isagawa ang pagkakabahagi ng pagpapabilis na dulot ng pananaliksik sa AI ay isang lubos na pulitikal na tanong.

· Ang "Amdahl's Law" ng ekonomiya: Habang dumadaan ang AI sa ekonomiya, makikita natin na ang ilang mga bahagi ay magkakaroon ng bottleneck sa harap ng mabilis na paglago, at kailangan nating maghanap ng paraan upang ayusin ang mga mahina na link sa chain. Ito ay maaaring lalong malinaw sa mga larangan kung деkailangan ang pag-uugnay sa mabilis na digital na mundo at ang mabagal na pisikal na mundo, tulad ng mga klinikal na pagsubok ng bagong gamot.

3. Pagkakabuo ng ekonomiya na may malaking kapital at maliit na lakas ng paggawa: Ang lahat ng ebidensya tungkol sa pag-aaral ng AI na nabanggit ay nagpapakita rin na ang mga sistema ng AI ay nagsisiguro na mas kayang mag-operate nang sarili nila ang mga negosyo.

Ibig sabihin nito na maaaring maghintay tayo na ang ilang bahagi ng ekonomiya ay tatanggap ng mga bagong henerasyon ng mga kumpanya, na maaaring kapital-intensibo (dahil sila ay may malaking bilang ng mga computer), o operasyonal na gastos-intensibo (dahil sila ay nagbabayad ng malaking halaga para sa AI services at nagpapalikha ng halaga dito), kumpara sa mga kasalukuyang kumpanya, na mas maliit ang kanilang pagkakasalalay sa paggawa—dahil habang patuloy na lumalago ang kakayahan ng mga AI system, ang marginal value ng pagpapakilala sa AI ay patuloy na tumataas.

Sa katotohanan, ito ay magiging isang “machine economy” na umuunlad sa loob ng mas malaking “human economy”; habang lumalipas ang panahon, ang mga kumpanyang pinapatakbo ng AI ay maaaring magsimulang magtrabaho isa’t isa, na magbabago sa istruktura ng ekonomiya at magdudulot ng iba’t ibang isyu tungkol sa hindi pagkakapantay-pantay at redistribusyon. Sa wakas, maaaring lumitaw ang mga kumpanyang ganap na pinapatakbo ng mga AI system, na magpapalalim sa mga nakalipas na isyu at magdadala ng maraming bagong hamon sa pamamahala.

Tingnan ang black hole

Batay sa mga pagsusuri na ito, naniniwala ang may-akda na may 60% na posibilidad na makikita natin ang automated AI research (kung saan ang mga advanced model ay makakapag-train ng sariling susunod na bersyon) bago ang dulo ng 2028. Bakit hindi ito inaasahang mangyari noong 2027?

Dahil sa paniniwala ng may-akda na kailangan pa rin ng pagkamalikhain at mga pananaw na nagmumula sa pagkakaiba ang pag-aaral sa AI upang makapag-advance, at hanggang sa ngayon ay hindi pa ipinakita ng mga sistema sa AI ang ganitong katangian sa isang makabago at malaking paraan (kahit na may ilang resulta sa pagpapabilis ng pag-aaral sa matematika na may kahulugan).

Kung kailangan niyang bigyan ang probabilidad para sa 2027, sasabihin niya ang 30%.

Kung hindi pa lumabas sa tapos ng 2028, maaaring ipakita namin ang ilang pangunahing kakulangan sa kasalukuyang teknolohikal na paradigma na nangangailangan ng pagpapalaganap ng tao para sa karagdagang pag-unlad.