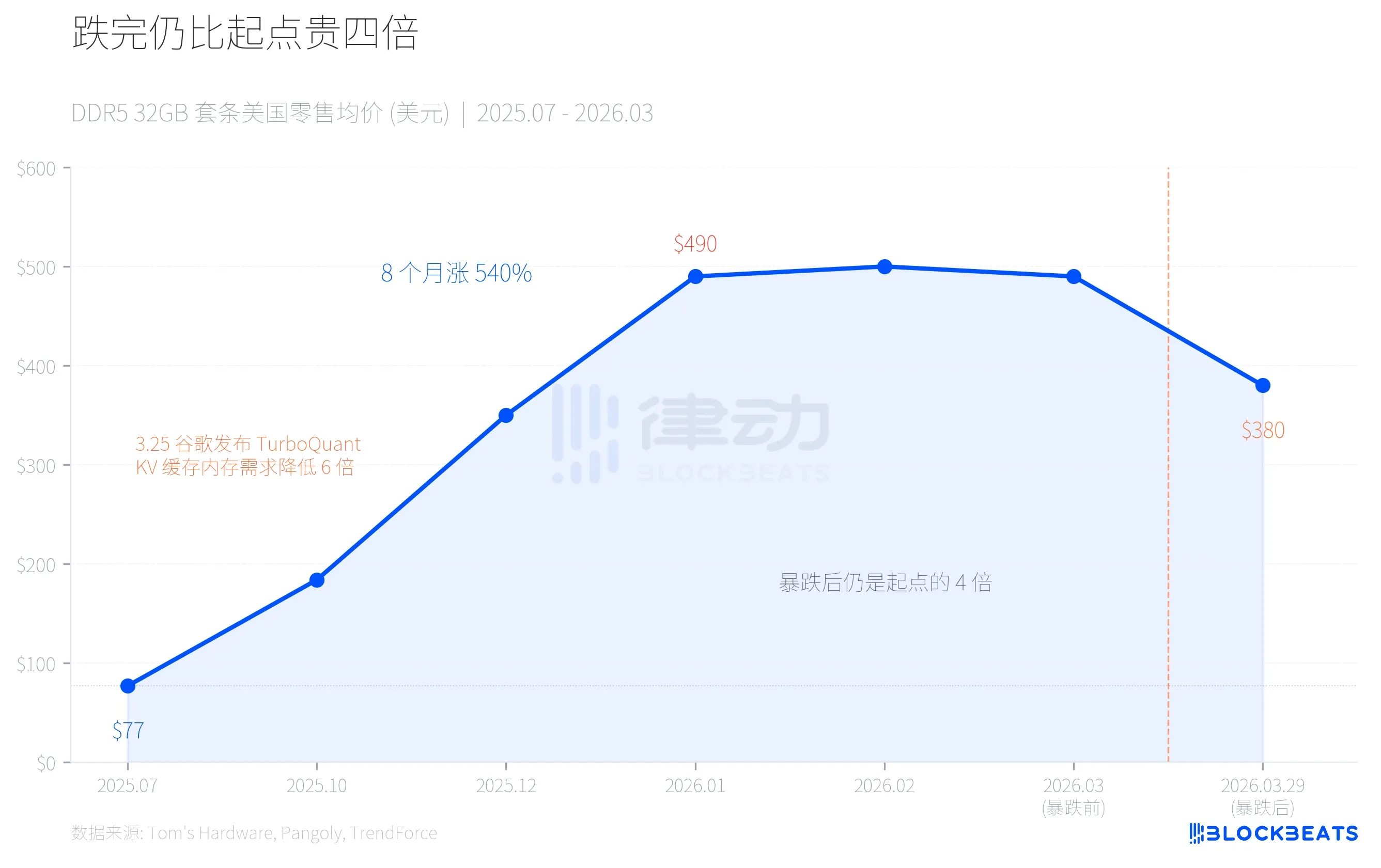

Noong Marso 29, parehong sinabayan ng merkado ng Huaqiangbei at ng Amerika ang isang malaking pagbaba ng presyo ng mga memory module. Bumaba ang Corsair 32GB DDR5-6400 kit mula sa $490 patungo sa $380, isang pagbaba ng 22% sa isang araw. Sa loob ng isang linggo, bumagsak ng 800 yuan ang presyo ng mga high-frequency 32GB DDR5 kit sa lokal, at nagsagawa ng panic selling ang mga distributor, na may isang dealer na nagsabi, “Bumaba ng higit sa isang daan sa isang araw.”

Ngunit kapag isinasaayos ang numero sa mas mahabang panahon, iba ang imahe: kahit na bumaba na, ang kasalukuyang presyo ng DDR5 ay apat na beses ang halaga nito noong Hulyo 2025. Ito ay isang eksaktong pagkakamali sa suplay at demand sa chain ng AI, kung saan ang iisang puwersa ay naglikha muna ng kakulangan, at pagkatapos ay nagdulot ng takot sa sobrang suplay.

Roller coaster: Nagtaas ng 540% sa loob ng walong buwan, bumaba ng 22% sa isang buwan

Noong Hulyo 2025, ang isang pangunahing set ng 32GB DDR5-6000 ay nagkakahalaga ng $77 lamang sa retail market sa Estados Unidos. Noong Enero 2026, tumaas ang presyo ng parehong set sa $490. Walong buwan, 540% na pagtaas.

Hindi dahil sa biglang pagtaas ng pag-upgrade ng mga kompyuter ng mga konsyumer. Ayon sa datos ng TrendForce, tumaas ang contract price ng DRAM sa unang quarter ng 2026 ng 90%-95% mula sa nakaraang quarter, kung saan ang PC DRAM ay tumataas ng higit sa 100%, na nagsisilbing pinakamalaking quarterly increase na nakarekord. Ang nagpapagalaw sa lahat ng ito ay ang malaking pangangailangan ng AI infrastructure para sa isang espesyal na uri ng memorya.

Pagkatapos, noong Marso 25, inilabas ng Google ang isang kompresyon algoritmo na tinatawag na TurboQuant. Apat na araw pagkatapos, bumagsak ang presyo ng memorya.

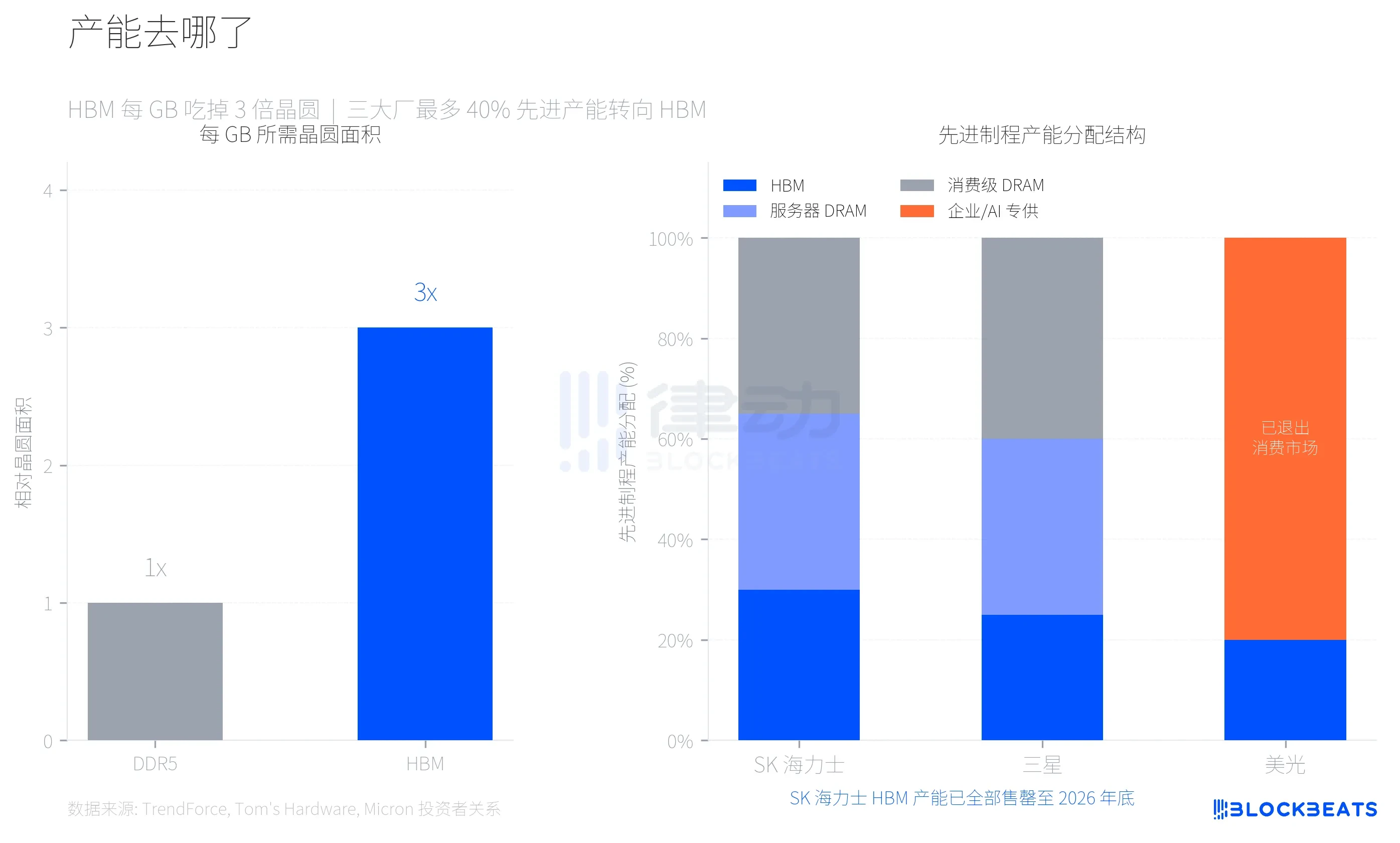

Nasaan ang kapasidad? Kinain ng HBM ang iyong RAM module

Upang maunawaan ang pagtaas na ito, kailangan mong maunawaan ang isang mahalagang teknikal na parameter. Ang HBM (High-Bandwidth Memory, isang espesyal na memorya na ginagamit sa AI chips ng NVIDIA) ay gumagamit ng tatlong beses ang dami ng wafer kada GB kumpara sa karaniwang DDR5. Ayon sa Tom's Hardware, ibig sabihin nito na sa isang magkakaparehong wafer, mas maliit ang kapasidad ng HBM na maaaring makagawa kumpara sa DDR5—tanging isang-katlo lamang.

Ang Samsung, SK Hynix, at Micron, ang mga pangunahing tagagawa ng memorya, ay gumawa ng rasyonal na desisyon na ilipat ang pinakamaraming 40% ng kanilang产能 sa advanced process patungo sa produksyon ng HBM. Ayon sa data ng TrendForce, hanggang sa unang kuartal ng 2026, inaasahan na lalampas ng HBM3e ang margin ng profit ng DDR5, na nagpapakita kung gaano kahina ang suplay ng memorya para sa konsumidor.

Ang pinakamalikhaing pagpili ng Micron ay ang pagpaputol ng Crucial, ang kanilang consumer brand na nagtatagal ng 29 taon, noong Disyembre 2025, at ang ganap na pagtatanggal sa consumer memory at storage market, na nakatuon sa enterprise at AI customers. Ayon sa pahayag ng Micron para sa mga investor, ang kabuuang kita ng kanilang fiscal year 2025 ay $37.38 bilyon, kung saan ang data center at AI applications ay umabot na sa 56% ng kabuuang kita. Ang consumer market, hindi na halaga.

Ang produksyon ng HBM ni SK Hynix ay naka-book na lahat hanggang sa katapusan ng 2026. Ang Samsung ay plano na pataasin ang buwanang produksyon ng HBM mula sa 170,000 wafer hanggang sa 250,000 wafer hanggang sa katapusan ng 2026. Ang mga bagong fab (Samsung P4L at SK Hynix M15X) ay hindi maaaring mag-produce sa malaking iskala hanggang sa 2027-2028. Sa ibang salita, ang kakulangan sa suplay ng DRAM para sa konsumidor ay struktural, at hindi maaaring mapalitan sa loob ng dalawa o tatlong kuwarter.

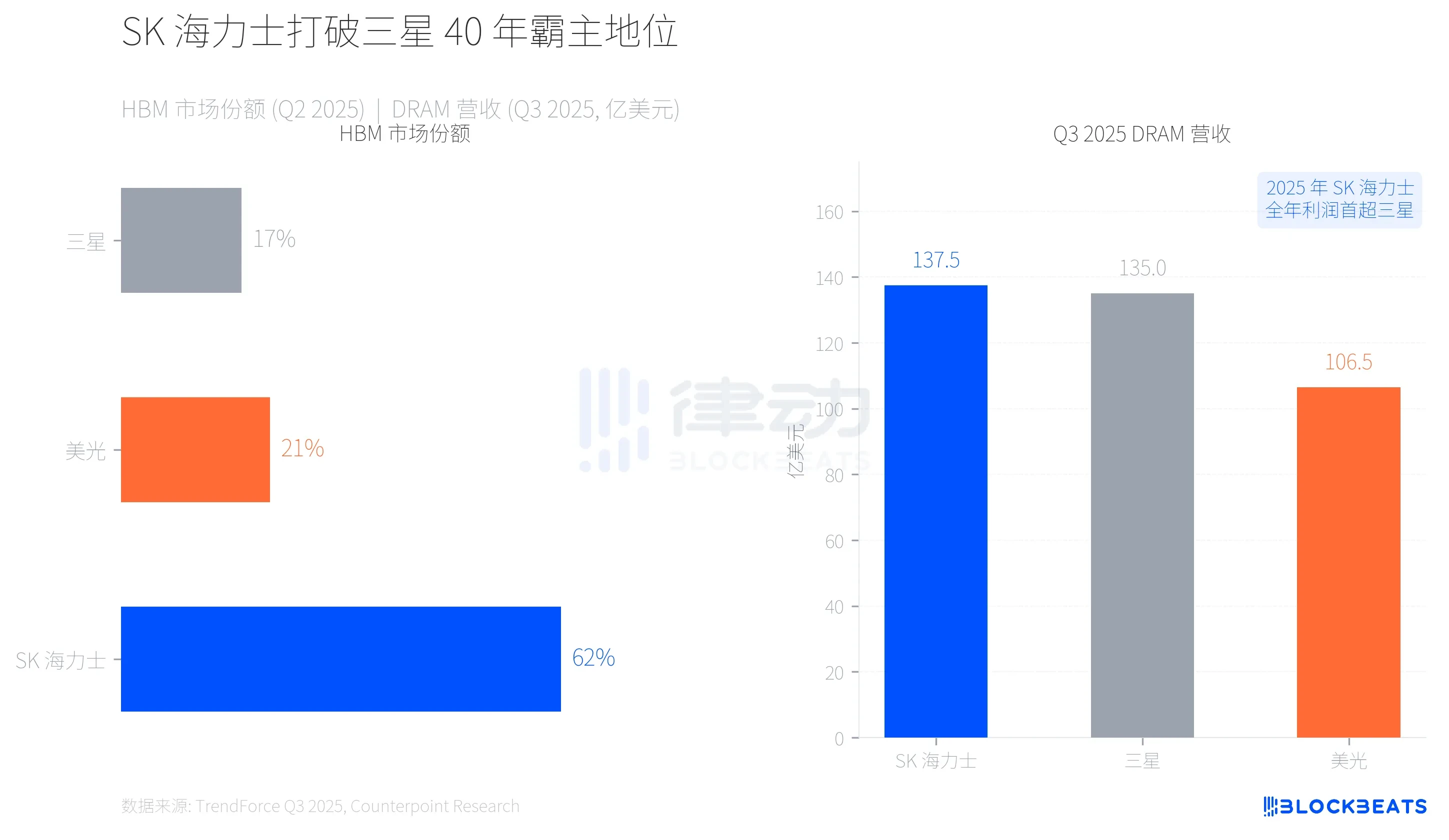

Balik ang sitwasyon, SK Hynix ay nagwagi sa 40 taon ng dominasyon ng Samsung

Ang paglipat ng produksyon ay nagbago rin sa mapa ng kapangyarihan sa industriya ng memorya. Ayon sa datos ng TrendForce, noong ikalawang kwartal ng 2025, nakakuha ang SK Hynix ng 62% na bahagi sa merkado ng HBM dahil sa malalim na pagkakaisa sa NVIDIA, samantalang ang Samsung ay may 17% at ang Micron ay may 21%.

Mas makabuluhan ang pagbabalik sa antas ng kita. Ayon sa ulat ng TrendForce noong Q3 2025, ang SK Hynix ay naging numero uno sa kanyang single-quarter DRAM revenue na $13.75 bilyon, habang ang Samsung ay sumunod na may $13.5 bilyon. Ang pagkakaiba ay lamang $250 milyon, ngunit ito ang unang beses na nawawala ang Samsung sa unang posisyon sa kita mula sa memorya sa loob ng halos 40 taon. Ayon sa CNBC, ang taunang operasyonal na kita ng SK Hynix noong 2025 ay unang lumampas sa Samsung.

Binigyan ng unang pagkakataon ni HBM ang SK Hynix ng sapat na mga kagamitan, ngunit ang paligsahan ay malayo pa sa pagtatapos. Pinapabilis ng Samsung ang pagpapalawak ng produksyon ng HBM4, habang binalewala ng Micron ang consumer market, ngunit ang pagtaas ng kita sa enterprise at AI (Q3环比 +53.2%) ay ang pinakamabilis sa tatlong kumpanya.

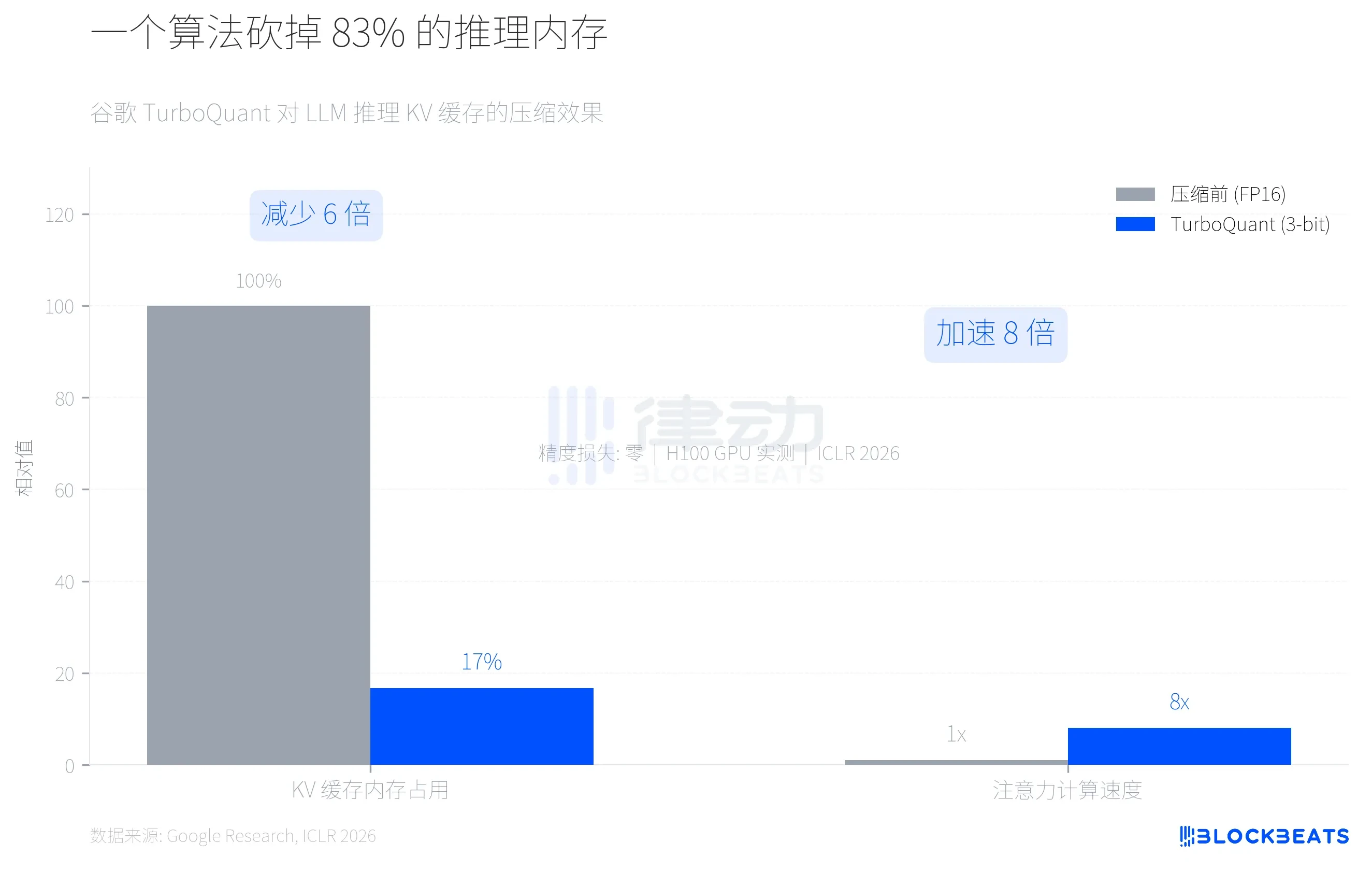

Paano binasag ng isang algorithm ang lohika ng pagtaas ng presyo?

Noong Marso 25, ipinakilala ng Google ang TurboQuant algorithm sa ICLR 2026. Ang algorithm na ito ay nagpapaliit sa KV cache (key-value cache, ang pinakamalaking bahagi ng memorya sa pagrerepresenta ng malalaking language model) mula sa FP16 precision patungo sa 3-bit, na nagbaba ng memorya usage ng hindi bababa sa 6 beses, habang nagtataglay ng pinakamataas na 8 beses na pagpapabilis sa pagkalkula ng attention sa H100 GPU. Ayon sa Google Research Blog, sa limang long-context benchmark tulad ng Needle-in-a-Haystack, ang pagkawala ng precision ay sero.

Agad na isinagawa ng merkado ang kalkulasyon. Kung ang TurboQuant o mga katulad na algoritmo ay malawakang matatanggap ng mga pangunahing AI company, ang karagdagang pangangailangan sa DRAM mula sa AI inference ay magiging malaki ang pagbaba. At ang pangunahing kuwento na nagtulak sa pagtaas ng presyo ng memorya sa nakaraang kalahating taon ay ang “ang AI infrastructure ay nagkonsumo ng sobrang kapasidad ng memorya.”

Apat na araw pagkatapos, bumagsak ang tiwala sa channel.

Dapat tandaan na ang TurboQuant ay nakatuon sa KV cache ng AI inference side, hindi sa HBM demand ng training side. Ang supply at demand ng HBM ay hindi magbabago sa maikling panahon dahil sa isang inference optimization algorithm. Ngunit ang merkado ay hindi laging nagkakaiba sa dalawa. Ayon sa Sina Financial News, sa panahon bago ang malaking pagbaba, dumating ang malaking bilang ng mga tagapag-imbak mula sa labas ng industriya dahil sa pagtaas ng presyo, at ang mataas na presyo ay nagdulot ng pagbaba ng retail sales ng higit sa 60%, na nagpapalakas ng pagbaba dahil sa chain reaction ng pagbebenta dahil sa kawalan ng cash flow.

Isang chain ng AI na naglikha ng parehong kakulangan at panikong sobra sa memorya. Ang pisikal na kapasidad ng HBM na nagdudulot ng kakulangan sa memorya para sa konsumidor, habang ang pagbubuo ng epekto ng algoritmo ng TurboQuant ay nagdulot ng biglaang pagbaba sa inaasahang pangangailangan sa memorya para sa AI. Ang parehong puwersa ang nagdudulot ng pagtaas ng presyo at pagbagsak.