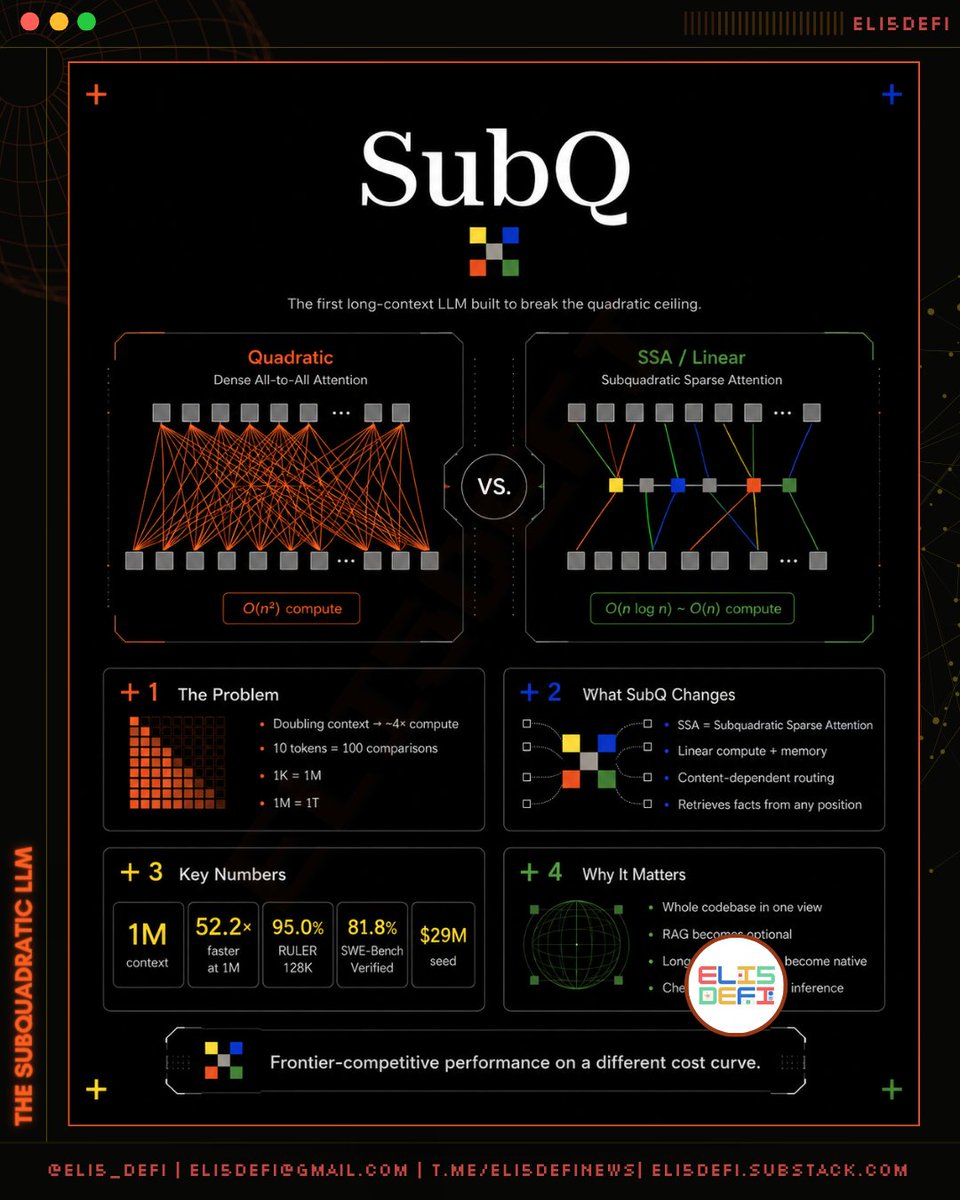

Una nueva empresa de IA llamada @subquadratic acaba de lanzar un modelo que rompe uno de los límites más antiguos en la IA moderna. Para entender por qué importa, necesitas comprender un solo problema matemático que ha estado moldeando silenciosamente cada chatbot que hayas usado alguna vez. — ➠ El Problema: La IA Lee en Pares, y los Pares No Escalan Cada LLM moderno (ChatGPT, Claude, Gemini) lee el texto verificando cómo cada palabra se relaciona con cada otra palabra. Eso suena bien hasta que haces las cuentas: ▸ 10 palabras → 100 comparaciones ▸ 1,000 palabras → 1 millón de comparaciones ▸ 1 millón de palabras → 1 billón de comparaciones Duplicar la entrada no duplica el trabajo. Lo cuadruplica. Esto se llama escalado cuadrático, y ha estado incorporado en la IA desde 2017. Lo que esto significa para ti: ▸ Los documentos largos se vuelven caros rápidamente ▸ Los modelos a menudo pierden hechos enterrados profundamente en entradas largas ▸ Bases de código completas o bibliotecas de investigación no caben Ahora sabes por qué, cuanto más largo sea el contexto, más tontos y más caros se vuelven tus LLMs. — ➠ Cómo la IA Actual Oculta el Problema La industria construyó soluciones alternativas en lugar de arreglar las matemáticas: ▸ RAG: un motor de búsqueda recupera algunos fragmentos relevantes y solo alimenta esos al modelo ▸ Fragmentación: documentos largos se cortan en piezas pequeñas ▸ Sistemas de agentes: múltiples llamadas de IA manejan diferentes partes, unidas con código ▸ FlashAttention: trucos inteligentes de memoria que hacen que el mismo cálculo costoso funcione más rápido Funcionan, pero ninguna soluciona el problema real. Toda la pila moderna de IA (bases de datos vectoriales, pipelines de recuperación, ingeniería de prompts) existe porque los modelos no pueden simplemente ver todo a la vez. — ➠ Qué Hace Diferente SubQ SubQ usa un nuevo enfoque llamado SSA (Atención Escasa Subcuadrática). La idea en una frase: en lugar de comparar cada palabra con cada otra palabra, el modelo determina qué palabras realmente importan para la pregunta e ignora el resto. Eso cambia la escala de cuadrática a lineal. Ahora, duplicar la entrada duplica el trabajo en lugar de cuadruplicarlo. La parte difícil no es la idea, ya que la gente ha intentado esto antes. Cada intento previo sacrificó algo: ya fuera precisión, la capacidad de encontrar hechos enterrados lejos en el texto, o la eficiencia misma. Subquadratic, cofundada por @alex_whedon, afirma que finalmente resolvieron los tres al mismo tiempo. — ➠ Las Pruebas Benchmark verificados por terceros: ▸ Empata con Claude Opus 4.6 en RULER 128K (una prueba de razonamiento con contexto largo) ▸ Supera a Opus 4.7, GPT 5.4 y Gemini 3.1 Pro en MRCR v2 (recuperación multi-evidencia), pero pierde contra Opus 4.6 y GPT 5.5 ▸ Supera a Opus 4.6 y Gemini 3.1 Pro en SWE-Bench (tareas reales de programación), pero queda atrás de Opus 4.7 ▸ 52× más rápido que FlashAttention con 1 millón de tokens ▸ Una versión de investigación maneja 12 millones de tokens con aproximadamente 1,000× menos cálculo de atención que otros modelos de vanguardia Para resumirlo brevemente: esto no es “el mejor modelo del mundo”. Es precisión de nivel de vanguardia con una curva de costo fundamentalmente más barata. — ➠ Dónde Entra Sam Altman Dos de las afirmaciones públicas más grandes de Altman apuntan al mismo problema que SubQ está resolviendo. Sobre costos: En su publicación de blog de febrero de 2025 “Three Observations”, Altman escribió que el costo de usar IA disminuye aproximadamente 10× cada 12 meses. Lo llamó “increíblemente más fuerte” que la Ley de Moore. Su tesis: la inferencia más barata es la fuerza dominante que da forma a lo que la IA puede llegar a ser. Sobre tamaño: Volviendo a 2023, Altman ha dicho que la era de modelos cada vez más grandes ha terminado, y la verdadera competencia es la capacidad por dólar. Comparó la carrera por el número de parámetros con la carrera por GHz en los chips de los años 90. Eje equivocado. SubQ toma ambas apuestas literalmente. Su lema es: “La eficiencia es inteligencia”. El detalle: La ruta declarada por Altman hacia una IA más barata es el progreso en hardware, optimización de software y destilación de modelos. No ha respaldado públicamente rediseñar las matemáticas de atención. Entonces, la propuesta de SubQ se alinea con su economía, pero también es una apuesta a que los grandes laboratorios dejaron un dólar arquitectónico sobre la mesa. — ➠ Por Qué Importa Si SubQ entrega a escala productiva: ▸ Bases de código como una sola conversación. Ya no más sistemas multi-agente manejando archivos. El modelo sostiene todo el repositorio. ▸ RAG se vuelve opcional. Mucha infraestructura actual de IA existe para compensar el techo cuadrático. Elimina el techo y el andamiaje se convierte en carga. ▸ Los agentes de larga duración ya no son un truco. Sesiones de días con memoria persistente se vuelven nativas. ▸ Se hacen posibles nuevas aplicaciones. Cargas de trabajo antes demasiado costosas (revisión completa de documentos, búsqueda exhaustiva de código, escaneo de cumplimiento) se vuelven rutinarias. — ➠ Las Advertencias Honestas ▸ Está en beta privada. La confiabilidad en el mundo real aún no ha sido probada. Por ahora, trata el anuncio como un adelanto; muchos sospechan que es solo un acto performático. ▸ La puntuación en MRCR v2 (65.9%) es buena, pero está por debajo de Opus 4.6 (78.3%) y GPT 5.5 (74%). SSA es más eficiente, no estrictamente más capaz. ▸ Los benchmarks son publicados por ellos mismos con verificación externa. La replicación académica es la prueba real. ▸ El resultado de 12M tokens es un modelo de investigación, no el producto final (que es de 1M). — ➠ Conclusión Durante nueve años, cada IA basada en transformer ha pagado el mismo impuesto cuadrático. Subquadratic afirma que finalmente descubrieron cómo evitarlo. Los benchmarks sugieren que al menos van en la dirección correcta. Altman ha estado diciéndole a la industria durante tres años que la capacidad por dólar es el nuevo campo de batalla. SubQ es una de las primeras empresas que intenta ganar esa batalla cambiando las matemáticas subyacentes en lugar de apilar soluciones alternativas. Si logran hacerlo ahora es una pregunta empírica pública.

Compartir

Fuente:Mostrar original

Descargo de responsabilidad: La información contenida en esta página puede proceder de terceros y no refleja necesariamente los puntos de vista u opiniones de KuCoin. Este contenido se proporciona solo con fines informativos generales, sin ninguna representación o garantía de ningún tipo, y tampoco debe interpretarse como asesoramiento financiero o de inversión. KuCoin no es responsable de ningún error u omisión, ni de ningún resultado derivado del uso de esta información.

Las inversiones en activos digitales pueden ser arriesgadas. Evalúa con cuidado los riesgos de un producto y tu tolerancia al riesgo en función de tus propias circunstancias financieras. Para más información, consulta nuestras Condiciones de uso y la Declaración de riesgos.