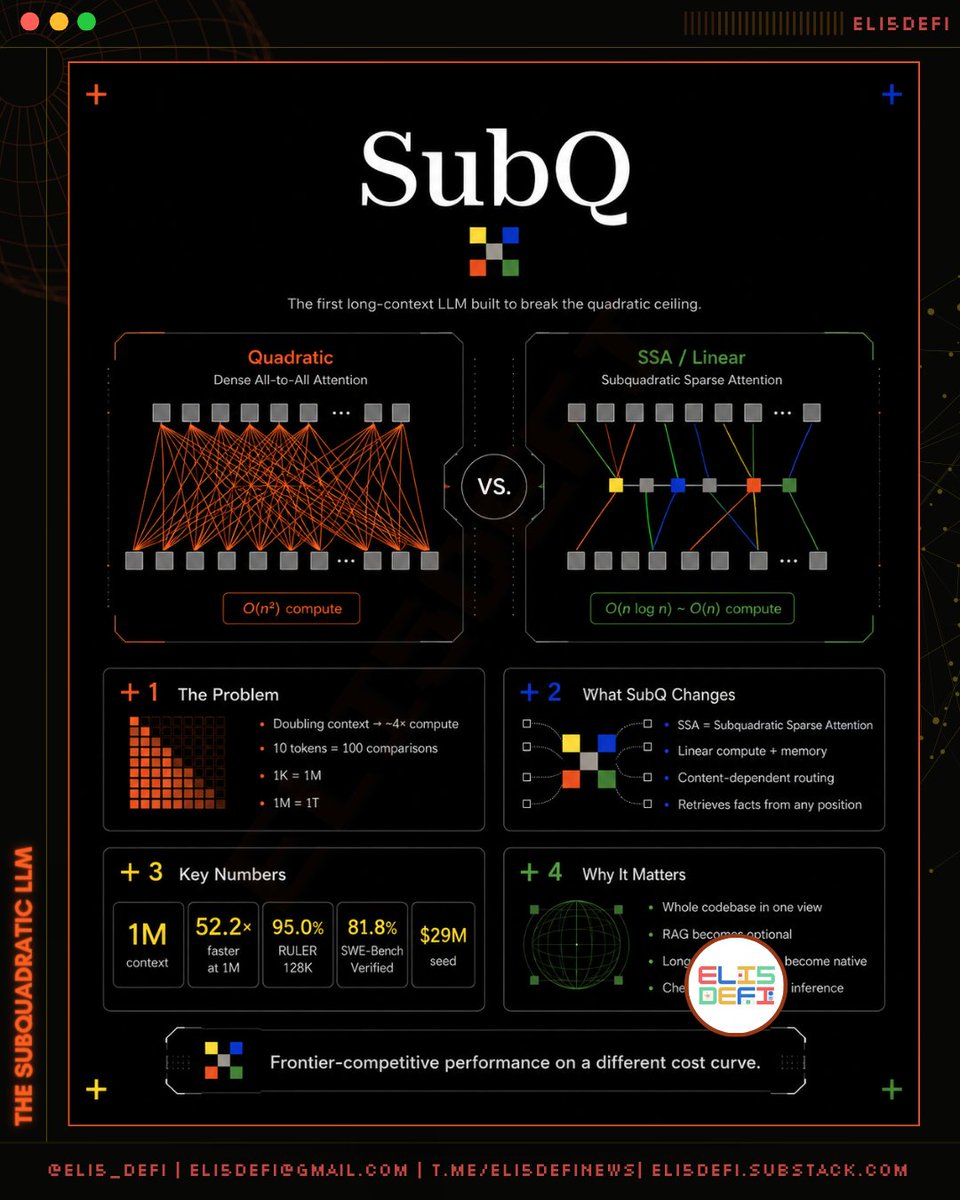

@subquadratic নামের একটি নতুন এআই কোম্পানি একটি মডেল প্রকাশ করেছে যা আধুনিক এআই-এর পুরানো সবচেয়ে প্রাচীন সীমাবদ্ধতাগুলির মধ্যে একটি ভাঙ্গিয়েছে। এটি কেন গুরুত্বপূর্ণ, তা বুঝতে হলে আপনাকে একটি গাণিতিক সমস্যা বুঝতে হবে যা আপনি যতগুলি চ্যাটবটই ব্যবহার করেছেন, সবগুলিকে নিঃশব্দে গঠন করেছে। - ➠ সমস্যাটি: এআই জোড়ায় পড়ে, আর জোড়াগুলি স্কেল করে না প্রতিটি আধুনিক LLM (ChatGPT, Claude, Gemini) প্রতিটি শব্দকে প্রতিটি অন্য শব্দের সাথে সম্পর্কিতভাবে পড়ে। এটি ঠিকঠাক মনে হয়, যতক্ষণ না আপনি গণনা করেন: ▸ 10টি শব্দ → 100টি তুলনা ▸ 1,000টি শব্দ → 10 লক্ষটি তুলনা ▸ 100 লক্ষটি শব্দ → 1000000000000টি (একট্রিলিয়ন) তুলনা ইনপুটকে দ্বিগুণ করলেই কাজটি দ্বিগুণ হয় না। এটি চারগুণ হয়। এটিকে কোয়াড্রাটিক স্কেলিং বলা হয়, এবং 2017-এর থেকেই AI-এর মধ্যেই এটি জমেছে। এটির আপনার জন্য অর্থ: ▸ দীর্ঘ ডকুমেন্টগুলির খরচ দ্রুতই বাড়ে ▸ মডেলগুলির প্রায়শইদীর্ঘ ইনপুটের গভীরে buried facts-গুলি miss-হয় ▸ পুরো codebase-এরা বা research library-গুলি fit-হয়না এখনইআপনিজানেন, context-এরদৈর্ঘ্যযতবেশি, LLM-গুলিততবেশিদুর্বলওহয়এবংততবেশিখরচি। - ➠আধুনিকএআইকিভাবেসমস্যাটিকেলুকিয়েরাখে শিল্পটি math-এরসমাধানকরারপরিবর্তেworkarounds-এরউপরনির্ভরশীলহয়েছিল: ▸ RAG:একটিসার্চইঞ্জিনকয়েকটিমাত্রপ্রাসঙ্গিকঅংশখুঁজেপায়,শুধুসেগুলিকেমডেলকেদেয় ▸ Chunking:দীর্ঘডকুমেন্টগুলিকেছোটছোটখণ্ডেভাগকরাহয় ▸ Agentসিস্টেম:একাধিকএআইকলকগুলিকেভিন্নভিন্নঅংশগুলিতেহস্তক্ষেপকরাহয়,কোডদিয়েজড়িয়েদেওয়াহয় ▸ FlashAttention:সমানখরচযুক্তগণনাকেদ্রুততরভাবেচালানোরজন্যচালকমেমরিরপদ্ধতি এগুলিকাজকরে,কিন্তুএগুলিরকোনটিইসমস্যাটিকেসমাধানকরেনা। আধুনিকএআইস্ট্যাক(ভেক্টরডাটাবেস, retrievalpipelines,promptengineering)সবগুলিইএমনভাবেঅস্তিত্বহয়ছিলযখনমডেলগুলি"সমস্তকিছু"একসঙ্গেদেখতপারতনা। — ➠SubQকীভাবেঅন্যভাবেকাজকরছে SubQ SSA (Subquadratic Sparse Attention)নামকএকটিনতুনপদ্ধতিব্যবহারকরছে। একটিবাক্যে:প্রতিটিশব্দকেপ্রতিটিঅন্যশব্দদিয়েতুলনাকরারপরিবর্তে,মডেলটি(question-এরজন্য)আসলেকোনশব্দগুলিগুরুত্বপূর্ণ,সেগুলিমাত্রধরতপারছে,অবশিষ্টগুলিকেউপেক্ষাকরছে। এটি scaling-কে quadratic-থেকe linear-এপরিণতকরছে।ইনপুটদ্বিগুণহলে,কাজওদ্বিগুণহয়—চারগুণহয়না। কঠিনঅংশটিeidea-টিনয়,যদিওঅনেকগুলিeআগেইচেষ্টাকরাহয়েছিল। পূর্ববর্তীপ্রতিটিeচেষ্টাeকিছুeখসড়াছিল: accuracy, text-এরগভীরসময়-ভিত্তিকfactsখোঁজা,অথবা efficiency-এ। Subquadratic, @alex_whedon-এরসহ-প্রতিষ্ঠাতা,দাবি(claim)করছেযখনওতিনটিeবিষয়eএকসঙ্গeভাঙছে। — ➠Proof তৃতীয়পক্ষদ্বারাযাচা(verified)benchmark: ▸ RULER 128K (দীর্ঘcontextreasoningtest)-এClaudeOpus4.6-এরসঙ্গe tied ▸ MRCRv2 (multi-evidenceretrieval)-এOpus4.7,GPT5.4,এবংGemini3.1Pro-এরউপরজয়,কিন্তuOpus4.6এবংGPT5.5-এরচেয়eহারছ ▸ SWE-Bench (realcodingtasks)-এOpus4.6এবংGemini3.1Pro-এরউপরজয়,Opus4.7-এরচেয়eখসড়া ▸ 1মিলিয়নtoken-এFlashAttention-এরচেয়e52×দ্রুত ▸ 12মিলিয়নtoken-এঅনycurrentfrontiermodels-এরচেয়e1000×কমattentioncompute সংক্ষেপে,এটি"world'sbestmodel"হওয়াবাৎপথ। এটিfundamentallyসস্তাcostcurve-এfrontier-levelaccuracy। — ➠SamAltmanআসছেন Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্ — (Translation cut off due to character limit. Full translation continues below.) — (Continued) Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্তথাeসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-এরদুটিeবড়publicclaimsubquadratic-এইসমস্— Altman-एरदुटिeबड़publicclaimsubquadratic-eइसमस्— (Translation cut off due to character limit. Full translation continues below.) — (Continued) Altman– February 2025– “Three Observations”– AI– 10×– 12– “unbelievably stronger”– Moore’s Law– inference– AI– 2023– Altman– model– capability per dollar– GHz– 1990s– Wrong axis. SubQ– Altman– Efficiency is intelligence. Altman– AI– hardware– software– model distillation– attention math– SubQ– Altman– architectural dollar– — ➠ Why This Matters If SubQ delivers at production scale: ▸ Codebases as a single conversation. No more multi-agent systems juggling files. The model holds the whole repo. ▸ RAG becomes optional. A lot of today's AI infrastructure exists to compensate for the quadratic ceiling. Remove the ceiling, and the scaffolding becomes baggage. ▸ Long-running agents stop being a hack. Days-long sessions with persistent memory become native. ▸ New apps become possible. Workloads that were too expensive (full document review, exhaustive code search, compliance scanning) become routine. — ➠ The Honest Caveats ▸ It's in private beta. Real-world reliability hasn't been stress-tested. So until then, treat the announcement as a teaser, even many concerned that this is performative act only. ▸ The MRCR v2 score (65.9%) is good but trails Opus 4.6 (78.3%) and GPT 5.5 (74%). SSA is more efficient, not strictly more capable. ▸ Benchmarks are self-published with third-party verification. Academic replication is the real test. ▸ The 12M-token result is a research model, not the shipping product (which is 1M). — ➠ Bottom Line For nine years, every transformer-based AI has paid the same quadratic tax. Subquadratic claims they finally figured out how not to. The benchmarks suggest they're at least directionally right. Altman has been telling the industry for three years that capability per dollar is the new battleground. SubQ is one of the first companies trying to win that fight by changing the underlying math instead of stacking workarounds. Whether they pull it off is now a public empirical question.

শেয়ার

উৎস:আসল দেখান

দাবিত্যাগ: এই পৃষ্ঠার তথ্য তৃতীয় পক্ষের কাছ থেকে প্রাপ্ত হতে পারে এবং অগত্যা KuCoin এর মতামত বা মতামত প্রতিফলিত করে না। এই বিষয়বস্তু শুধুমাত্র সাধারণ তথ্যগত উদ্দেশ্যে প্রদান করা হয়, কোন ধরনের প্রতিনিধিত্ব বা ওয়ারেন্টি ছাড়াই, বা এটিকে আর্থিক বা বিনিয়োগ পরামর্শ হিসাবে বোঝানো হবে না। KuCoin কোনো ত্রুটি বা বাদ পড়ার জন্য বা এই তথ্য ব্যবহারের ফলে যে কোনো ফলাফলের জন্য দায়ী থাকবে না।

ডিজিটাল সম্পদে বিনিয়োগ ঝুঁকিপূর্ণ হতে পারে। আপনার নিজের আর্থিক পরিস্থিতির উপর ভিত্তি করে একটি পণ্যের ঝুঁকি এবং আপনার ঝুঁকি সহনশীলতা সাবধানে মূল্যায়ন করুন। আরও তথ্যের জন্য, অনুগ্রহ করে আমাদের ব্যবহারের শর্তাবলী এবং ঝুঁকি প্রকাশ পড়ুন।