原文作者:庫里,深潮 TechFlow

幾天前有一張照片,在網上很火。

印度舉辦了一場 AI 峰會,總理莫迪站在台上,兩側站著一排矽谷大佬。在合影環節,莫迪拉起旁邊人的手高舉過頭,其他人也跟著手牽手,場面十分團結。

但,只有兩個人沒有牽手。

OpenAI 的 CEO 和 Anthropic 的 CEO,也就是 ChatGPT 和 Claude 背後兩家公司的老闆,站在彼此旁邊,各自舉了個拳頭。

不牽手,不對視,像兩個被老師安排坐同桌的冤家。

這兩家公司這些年打得不可開交,Claude 是由從 OpenAI 出走的團隊開發的,雙方爭搶用戶、企業客戶和融資,今年超級碗期間,Anthropic 更是專門花錢投放廣告諷刺 ChatGPT 要上廣告。

所以不牽手,正常。

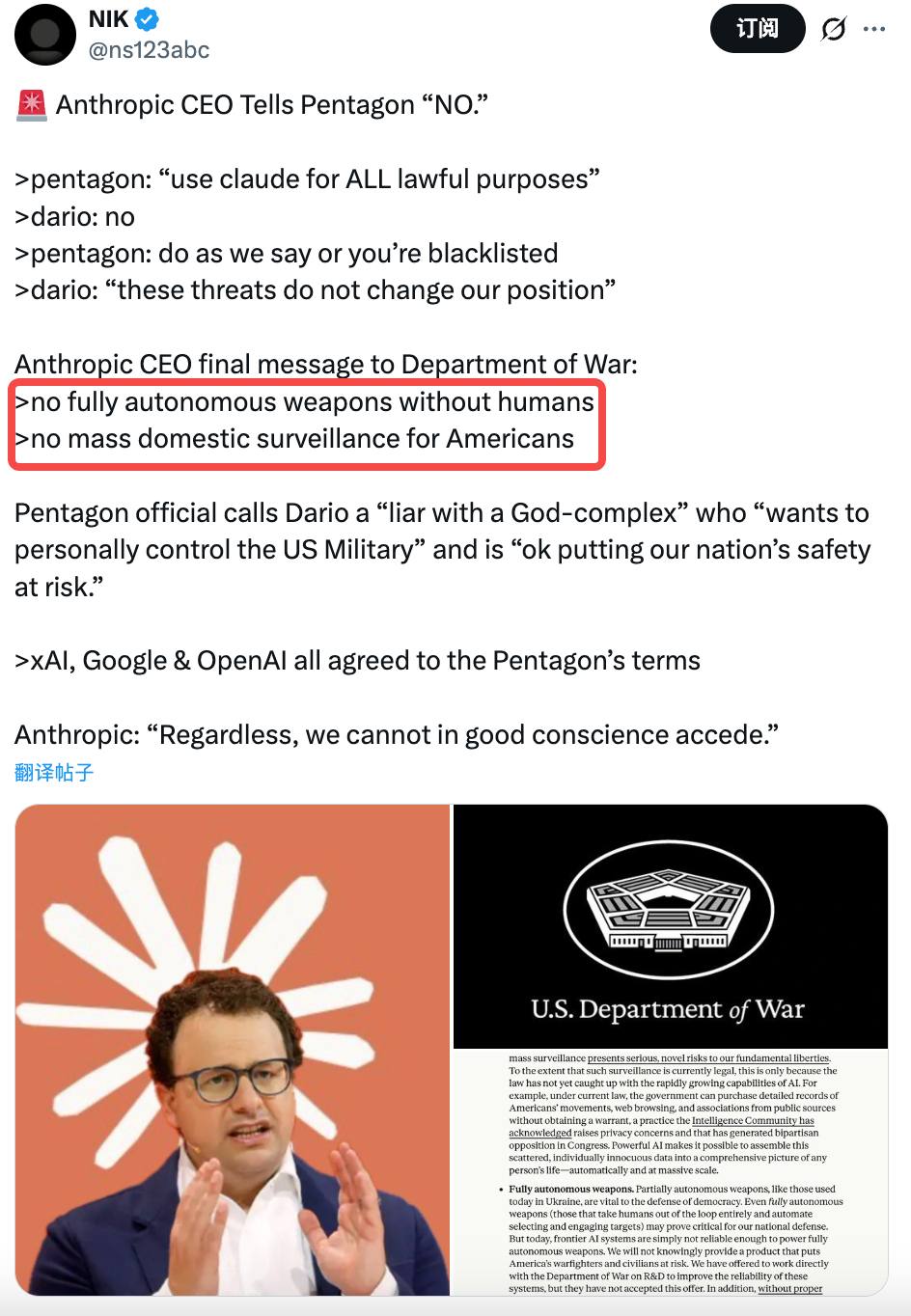

不過,今天他們牽手了。因為五角大樓。

事情是這樣的。

Anthropic,即 Claude 背後的公司,去年與美國國防部簽訂了一份最高達 2 億美元的合約。Claude 是第一個被部署至美軍機密網絡的 AI 模型,協助處理情報分析、任務規劃等工作。

但 Anthropic 在合同裡畫了兩條紅線:

Claude 不可用於大規模監控美國公民,也不可用於無人類參與的自主武器。(參考閱讀:Anthropic 身份危機的七十二小時)

但是,五角大樓不接受。

他們的要求是四個字:不受限制。買了工具就該隨便用,你一家科技公司憑什麼告訴美國軍方能做什麼不能做什麼。

上週二,國防部長 Hegseth 當面向 Anthropic 的首席執行官下達最後通牒:週五下午 5 點 01 分前答應,否則後果自負。

Anthropic 沒答應。

他們的 CEO 發出了一份公開聲明,大意是:我們深知 AI 對美國國防的重要性,但在少數情況下,AI 會損害而非捍衛民主價值。我們無法心安理得地接受這一要求。

五角大樓的談判代表、國防部副部長 Emil Michael 隨後在社群媒體上罵他是騙子,說他有救世主情結,拿國家安全開玩笑。

短暫的牽手

然後,意想不到的事情發生了。

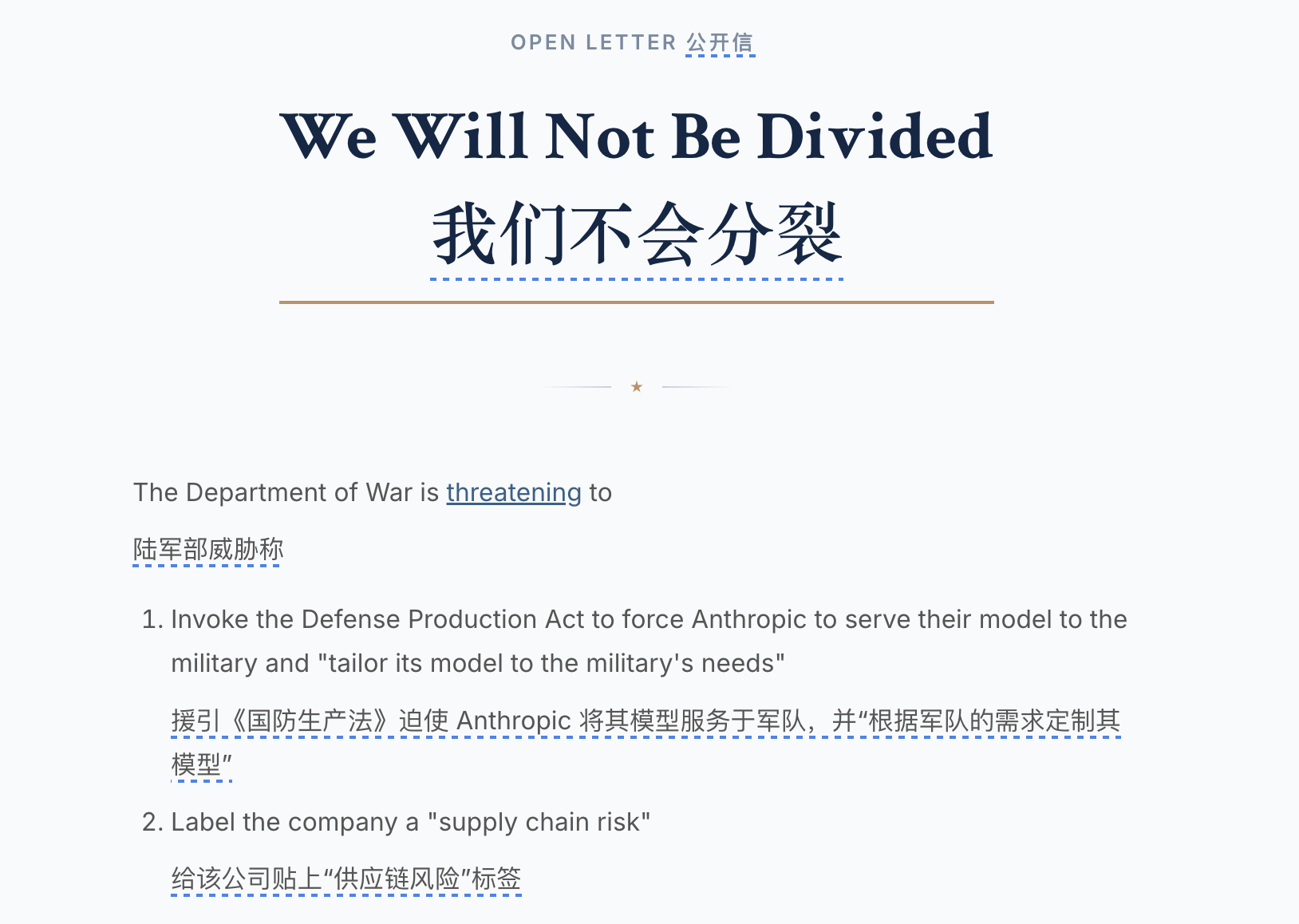

OpenAI 和 Google 的員工,總共 400 多人簽了一封聯名公開信,標題叫"我們不會被分化"。

信中提到,五角大樓正在逐一與 AI 公司談判,試圖讓其他人答應 Anthropic 不願接受的條件,並利用恐懼分化每家公司。

OpenAI 的 CEO 也給全體員工發了內部信,說 OpenAI 與 Anthropic 有同樣的紅線:

No mass surveillance, no autonomous lethal weapons.

就在幾天前還不願攜手的兩家公司,突然因為五角大樓站在了同一邊。

不過這種團結,可能也就持續了幾個小時。

Friday at 5:01 PM, the Pentagon's ultimatum expired. Anthropic did not sign.

一家估值 3800 億美元的美國科技公司,冒著 2 億美元合約作廢的風險,拒絕了美國國防部。放在以前,這種事最多就是解約換供應商。但這次華盛頓的反應完全不是商業層級的。

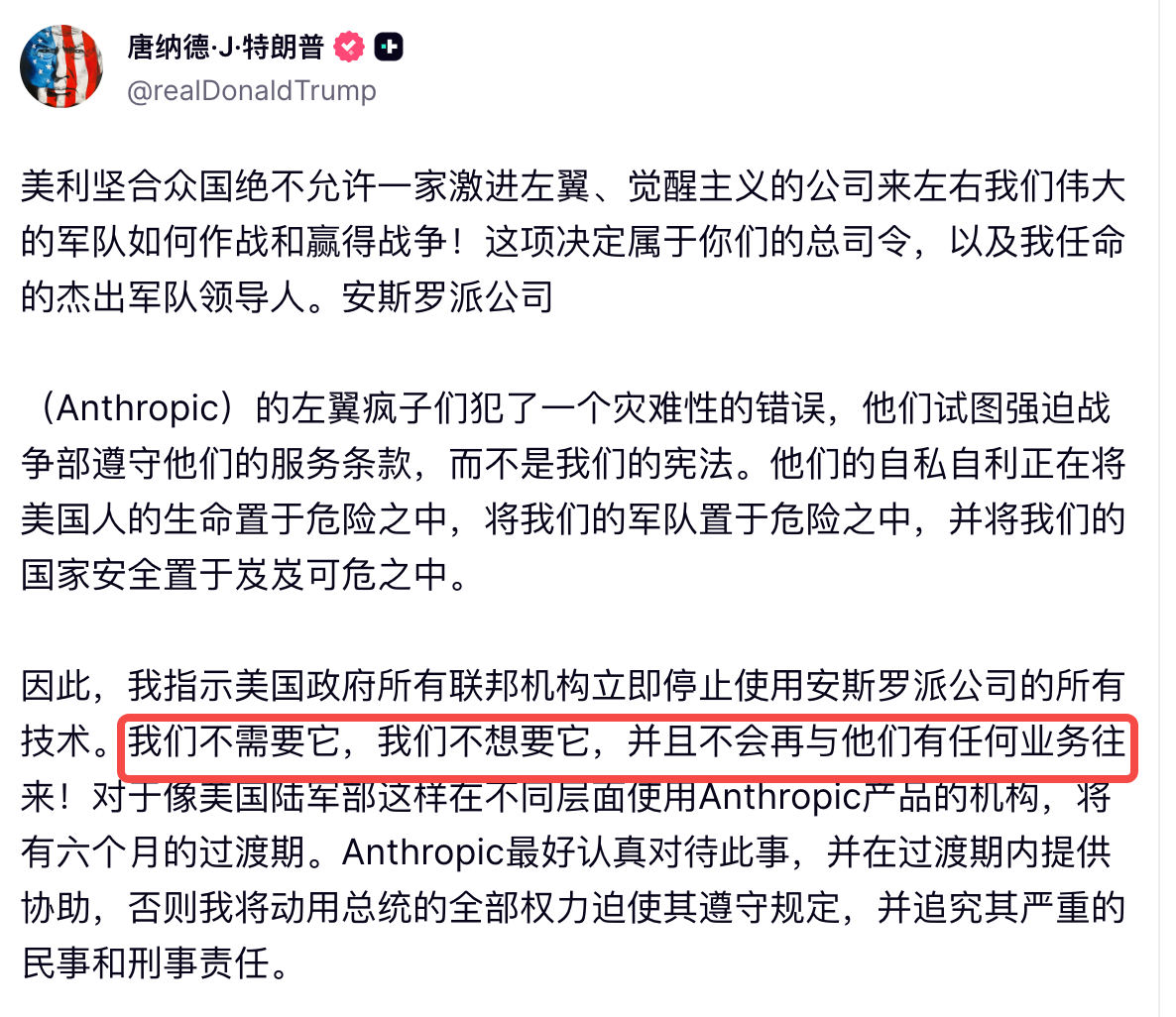

川普大約一個小時後在 Truth Social 上發帖,稱 Anthropic 為「左翼瘋子」,指他們試圖凌駕於憲法之上,拿美國軍人的生命開玩笑。

他要求所有聯邦機構立即停止使用 Anthropic 的技術。

隨後,美國國防部長 Hegseth 宣布將 Anthropic 列為「供應鏈安全風險」。這個標籤通常只用於華為之類的公司,意思很明確:所有與美軍合作的承包商,都不得再使用 Anthropic 的產品。

Anthropic 表示他們會打官司。

而同一個晚上,之前還保持同一立場的 OpenAI,卻跟五角大廈簽了協議。

意識形態問題

What did OpenAI receive?

Claude 被踢出後留下的位置:美國軍方機密網絡的 AI 供應商。不過 OpenAI 向五角大廈提出了三個條件:不進行大規模監控、不開發自主武器、高風險決策必須有人類參與。

五角大樓說,行。

你沒看錯。被 Anthropic 磨了幾週都不肯接受的條件,換一家公司提出來,幾天就談妥了?

當然,兩邊的方案不是完全一樣的。

Anthropic 多加了一層:他們認為現行法律跟不上 AI 的能力,例如 AI 可以合法購買、合法聚合你的定位數據、瀏覽記錄和社交媒體資訊,最終效果等同於監控,但每一步都不違法。

Anthropic 說你只寫「不搞監控」四個字沒用,這個漏洞得堵上。OpenAI 沒有堅持這一點,他們接受了五角大樓的說法,現行法律夠用了。

但如果你覺得這只是一個條款分歧,那就太天真了。這場談判從一開始就不只是談條款。

White House AI czar David Sacks has long publicly criticized Anthropic for creating "woke AI" (ideology-first, political correctness); a senior Pentagon official told the media that Dario's issue is ideology-driven, "We know who we're dealing with."

Elon Musk 的 xAI 本身就是 Anthropic 的直接競爭對手,他這週在 X 上反覆攻擊 Anthropic,說這家公司「仇恨西方文明」。

而 Anthropic 的 CEO 去年沒去特朗普的就職典禮。OpenAI 的 CEO 去了。

殺雞儆猴

所以我們來整理一下發生了什麼。

同樣的原則,同樣的紅線,Anthropic 因為多要了一層保障、站錯了隊、擺錯了姿態,被標記成了跟華為一個級別的所謂美國國家安全威脅。

OpenAI 少要了一層,關係處得好,拿到了合約。你說這是原則的勝利,還是原則的定價?

五角大樓的合約被抵制,其實也不是第一次了。

2018 年,Google 有 4000 多名員工簽了請願書,十幾個人辭職,抗議公司參與五角大樓一個叫 Project Maven 的項目。那個項目用 AI 分析無人機拍到的視頻,幫軍方更快地識別目標。

Google 最後退出了。沒續約走了。員工贏了。

8 年過去了,同樣的爭議又來了一輪。但這次規則完全變了。一家美國公司告訴我,我可以做軍方的生意,但有兩件事不能做。美國政府的回應是將其踢出整個聯邦體系。

而且「供應鏈安全風險」這個標籤的殺傷力遠不止丟掉一份 2 億美元的合約。

Anthropic 今年的收入大約在 140 億美元左右,2 億美元的合約連零頭都算不上。但這個標籤的意思是,任何與美國軍方有業務往來的公司,都不能使用 Claude。

這些公司不需要認同五角大廈的立場,它們只需要做一道風險評估:繼續使用 Claude,可能丟掉政府合約;換一個模型,什麼事都沒有。

選擇很簡單。這就是這件事真正的信號。

Anthropic 能否承受得住並不重要,重要的是下一家公司還敢不敢承受。它會觀察這個結果,評估堅持原則的代價,然後做出一個非常理性的決定。

再看那張印度的照片,所有人手拉手舉過頭頂,只有他們兩人各自握著拳頭。

也許這才是常態。

The principles of AI companies can be the same, but hands may not necessarily hold.