作者:danny

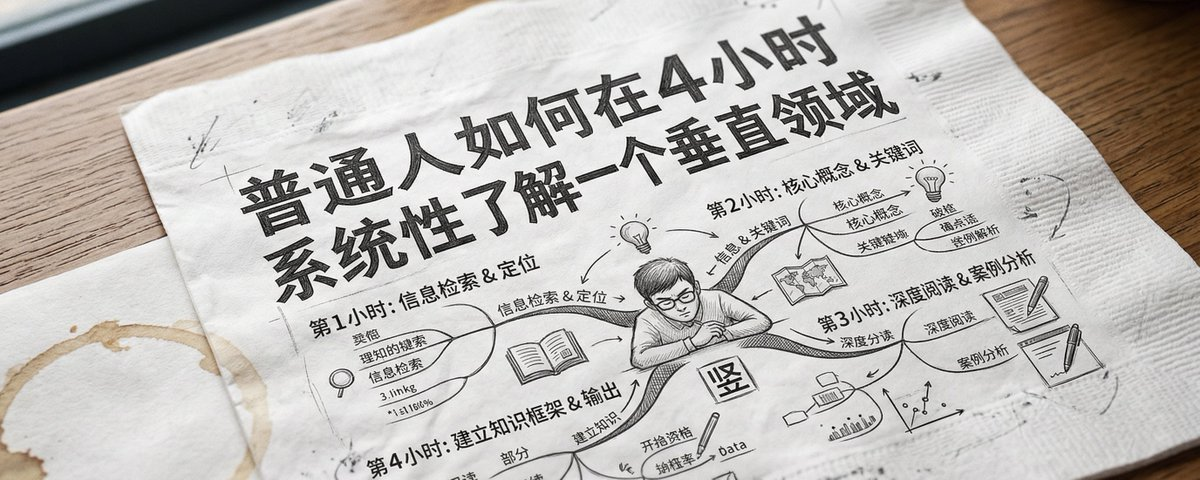

朋友問我,為什麼我好像什麼事情或領域都知道?除了過去的一些經歷或正在做的事情,其實很多时候,我都是現學現賣,今天就跟大家聊聊我是如何使用 AI 工具和 Notebooklm 完成普通人的自我學習之路。

首先我要說的是,這篇文是針對:系統性和結構化學習和了解一個細分領域/事物/概念,並且構建自己的知識體系和圖譜,如果你只需要稍微了解其中的一些概念,知道這個xx是個啥?那直接問市面上主流的AI可能都差不多。

使用AI學習,了解一個新事物目前來說有幾個瓶頸和局限:

第一是幻覺,AI(大概率)會給你一些胡編亂造的數據和事情,尤其是在細分領域,因為語料和學習資料不足;

第二是沒有這麼多細節,因為版權等問題,AI 不會自己去通讀整篇文章或整本書,訓練材料一般都是別人的評論、評論,尤其是細分領域這類資訊就特別少;

第 3 點無法精準描述問題,假設你之前沒有接觸過這個課題,你估計就沒辦法很好地描述你想了解的問題,也不知道這些事情的前因後果,更談不上系統性和結構化地收集資料和形成體系化的學習框架。

理論部分

我的方式其實也很簡單:利用學術界的「引文(quote/reference/impact factor)網絡」提純資訊,再用 AI 舉證和發散的思維來一場左右腦的「左右互搏」來結構化了解一個新事物。

省流版工作流:

找到有價值的論文 - 放入 Notebooklm - 用 AI 工具生成提示詞 - 在 Notebooklm 裡問答學習 - 補充有價值的論文放入 Notebooklm - 在 Notebooklm 學習 - 如此反覆

複雜版工作流程:

第一步:順藤摸瓜(耗時:0.25 小時)

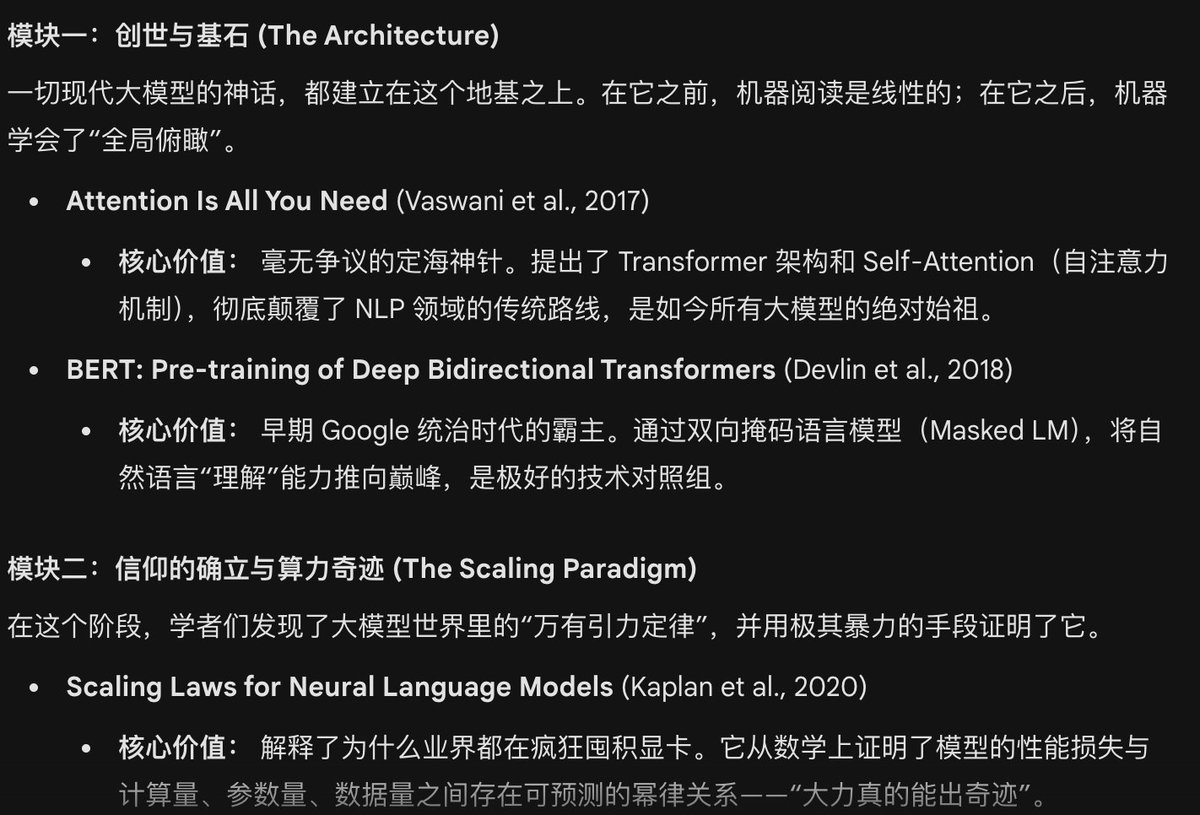

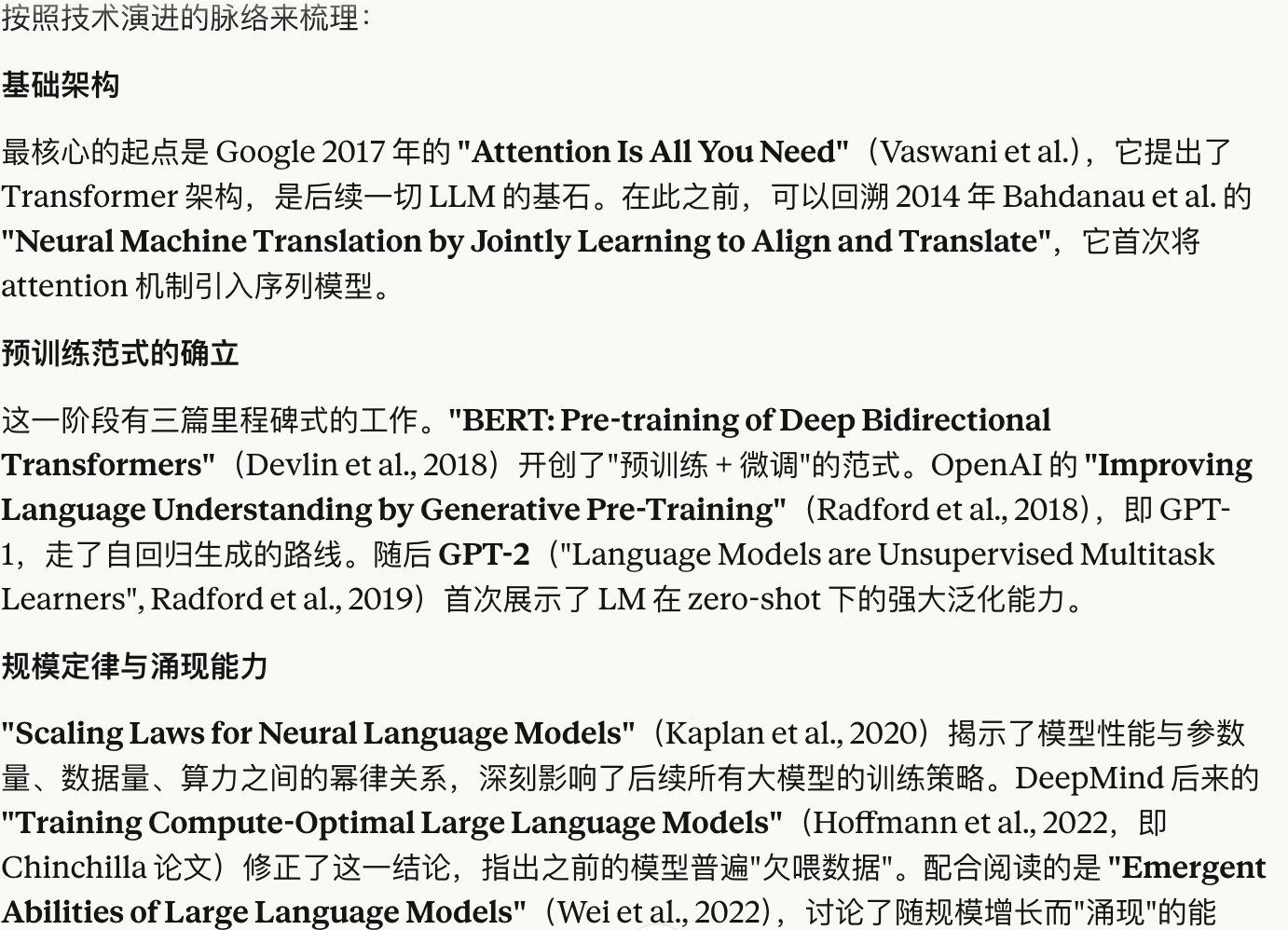

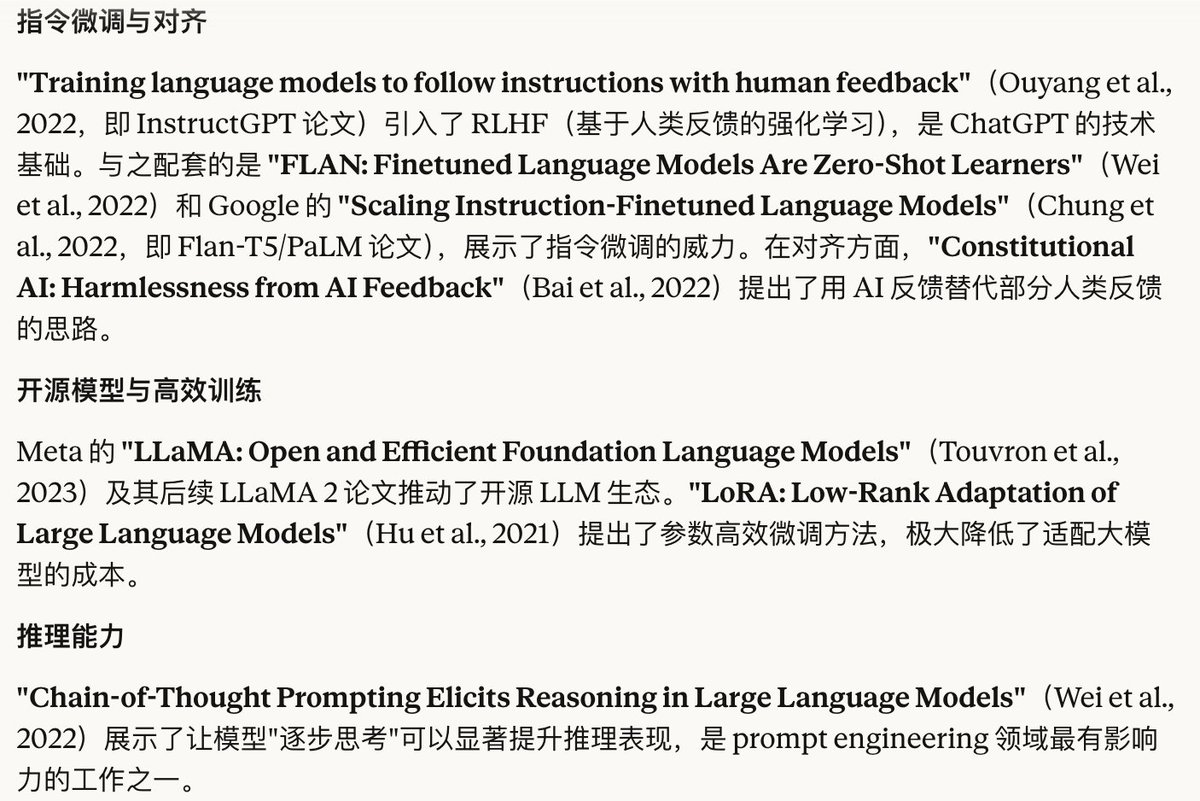

不要去搜「什麼是XX,這個的原理是什麼」,而是直接尋找該領域的「定海神針」。

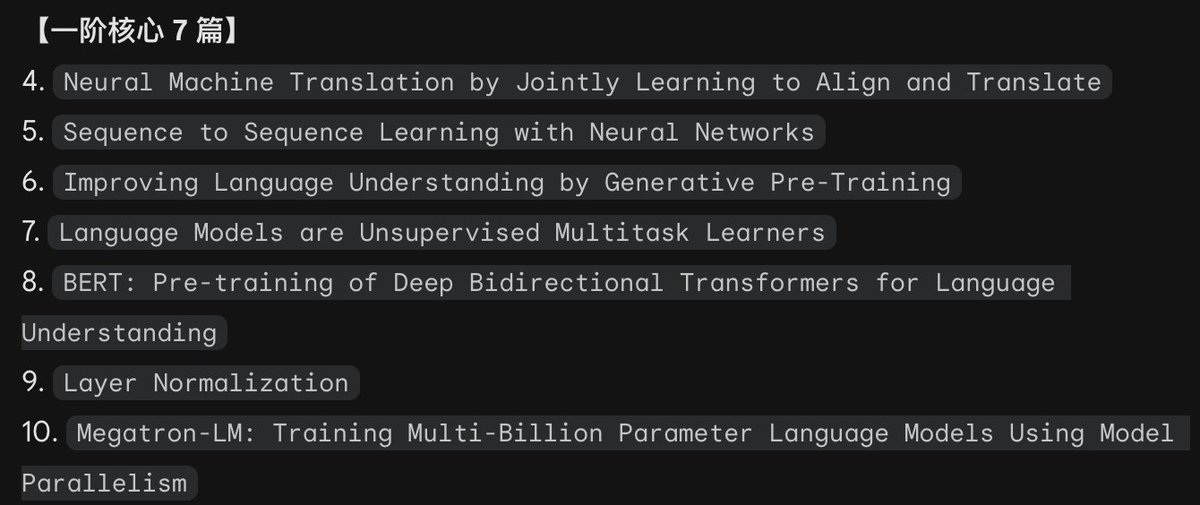

呼叫AI(Gemini / Perplexity): 直接提問:“在 [某細分領域] 中,哪三位是公認的泰山北斗?他們奠定該領域基礎的 1-3 篇高引經典文獻是什麼?”(例如在 LLM 領域,鎖定 Attention Is All You Need 等文獻)。代表了“今生”

下載一階文獻:提取這 1-3 篇核心文章的 Reference(參考文獻),把它們引用過的所有核心文獻全部下載。代表了“前世”。

提取高頻的二階文獻:在第一階文獻的參考文獻中進行交叉比對,篩選出被引用次數排名前 10、出現頻率最高的 Top 5 文章。

核心邏輯:順著大師的目光去看世界,是成本最低的捷徑。不要小看這一步,你下載的可是這個領域數十年來最核心的思想演進圖。

第二步:搭建結構化的知識庫(耗時:0.25 小時)

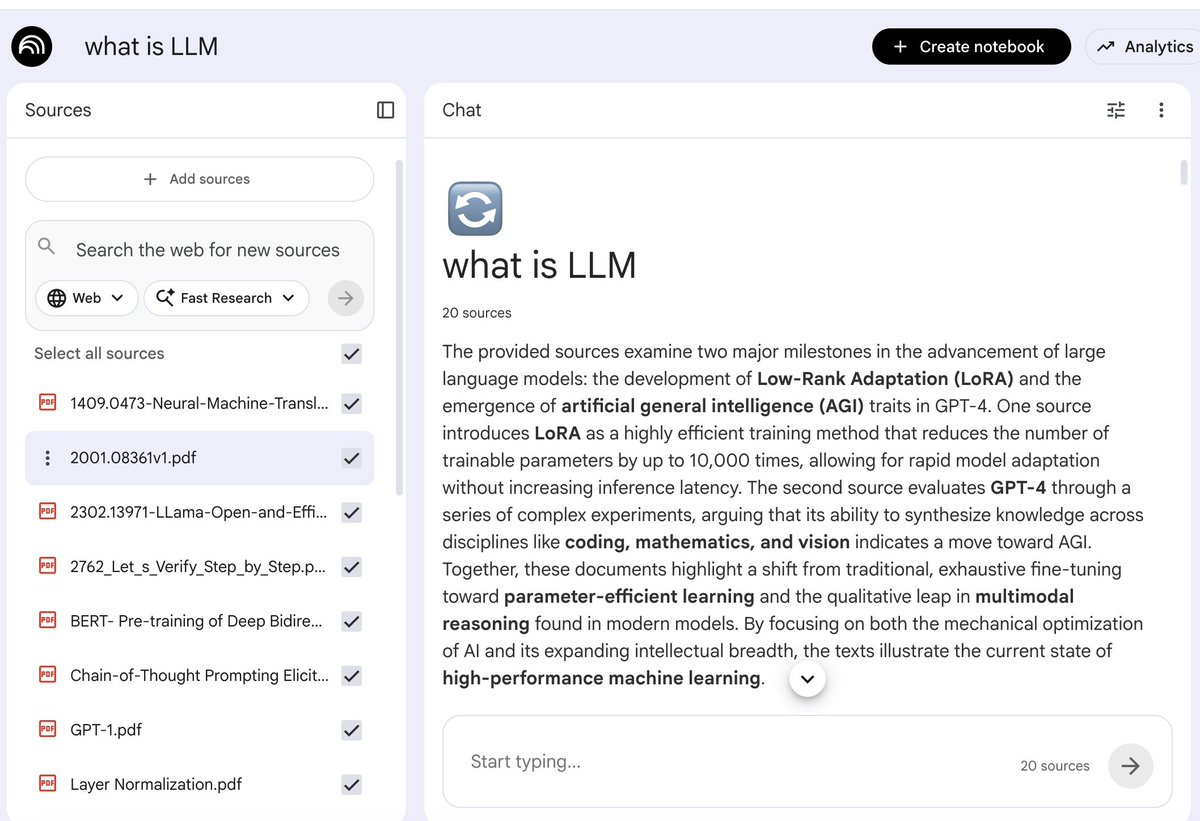

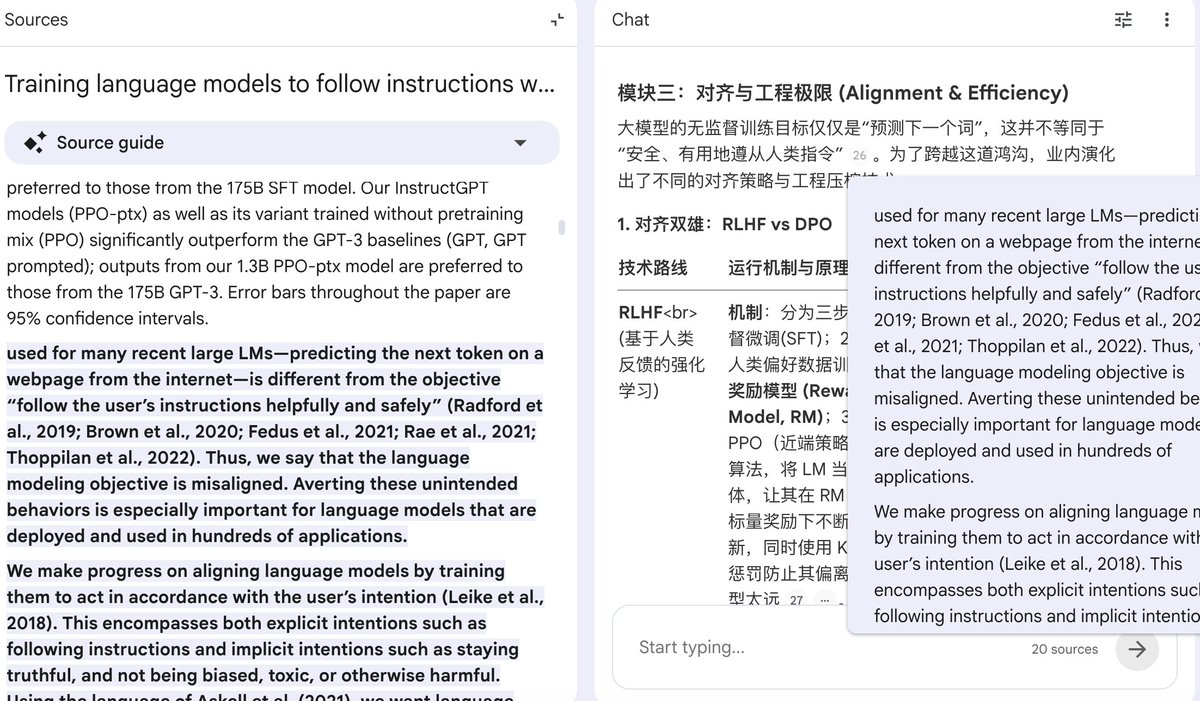

將第一步篩選出的所有經典文獻,一次性全部上傳至 Google NotebookLM。

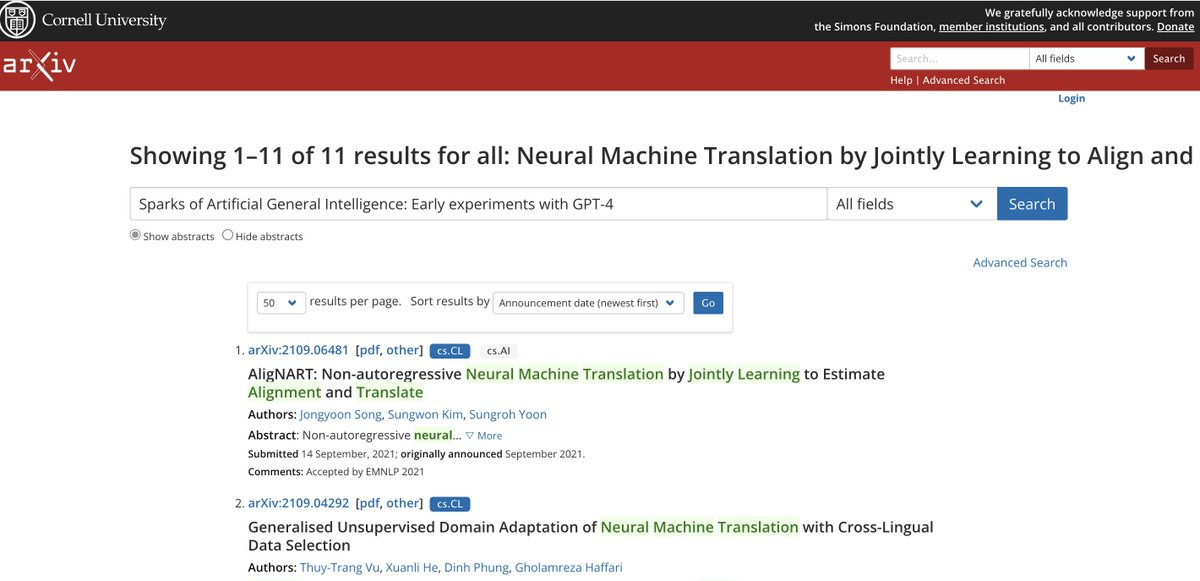

一般來說,只要是經典的文章,用這兩個就足夠了:https://scholar.google.com/ 或者 https://arxiv.org/

為什麼選擇 NotebookLM?因為它絕不產生幻覺(Hallucination)。它只根據你提供的資料回答問題。

Through rigorous literature screening, you manually cut off the noise on the internet, establishing a pure and highly focused knowledge base for this field.

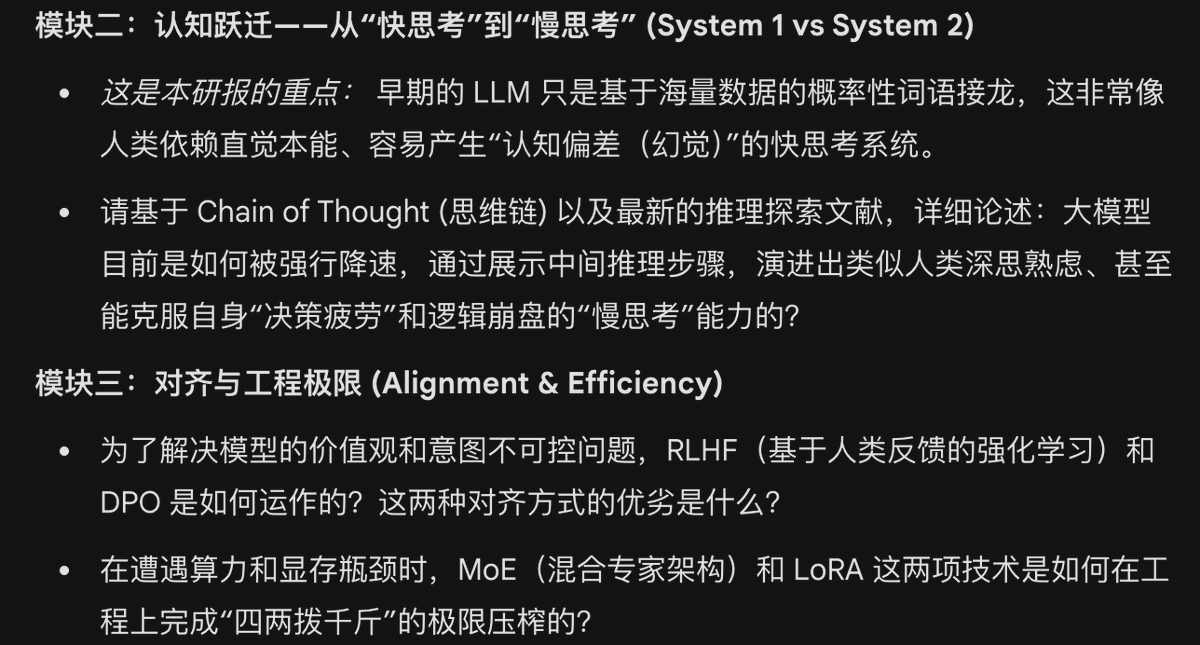

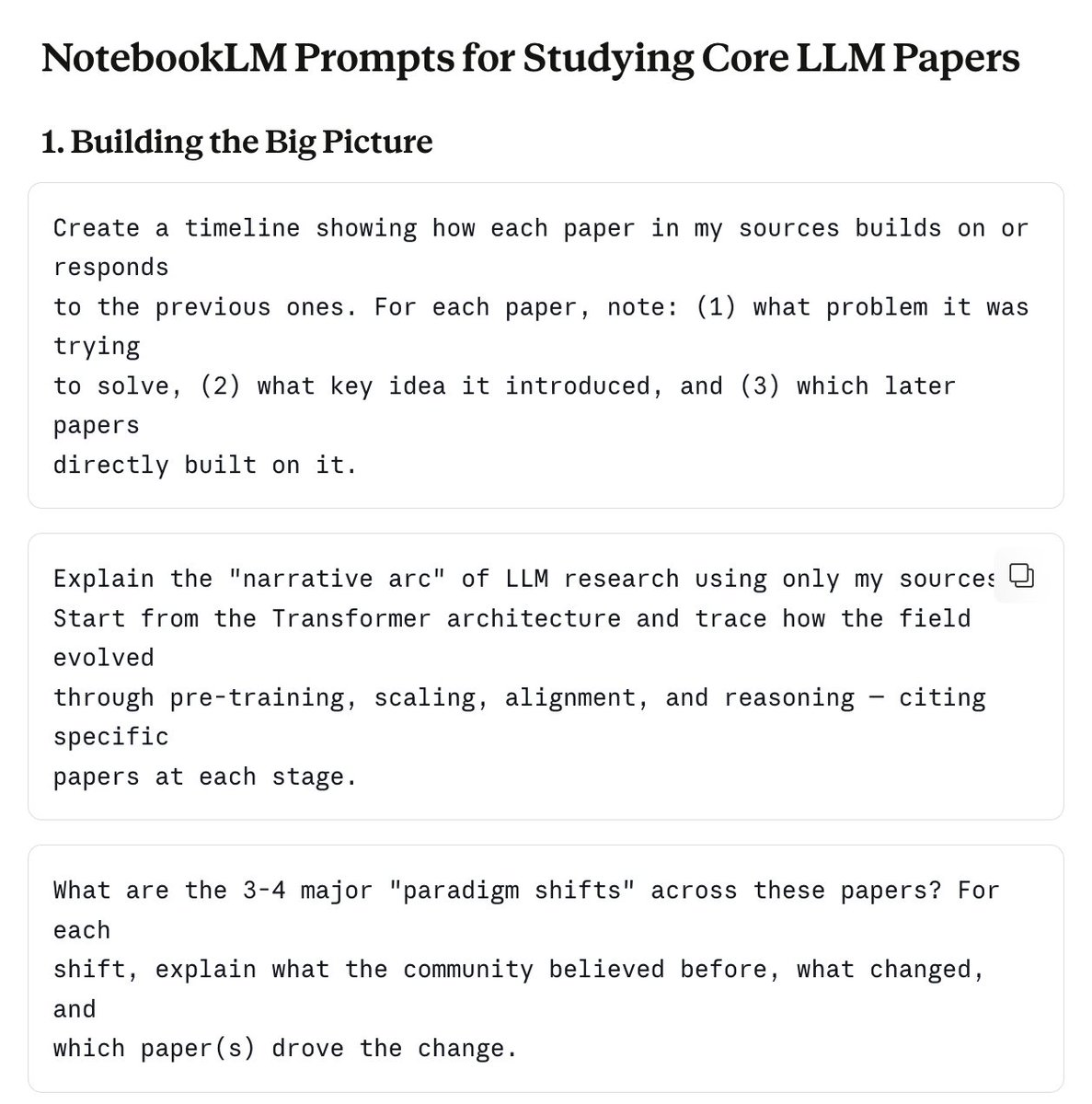

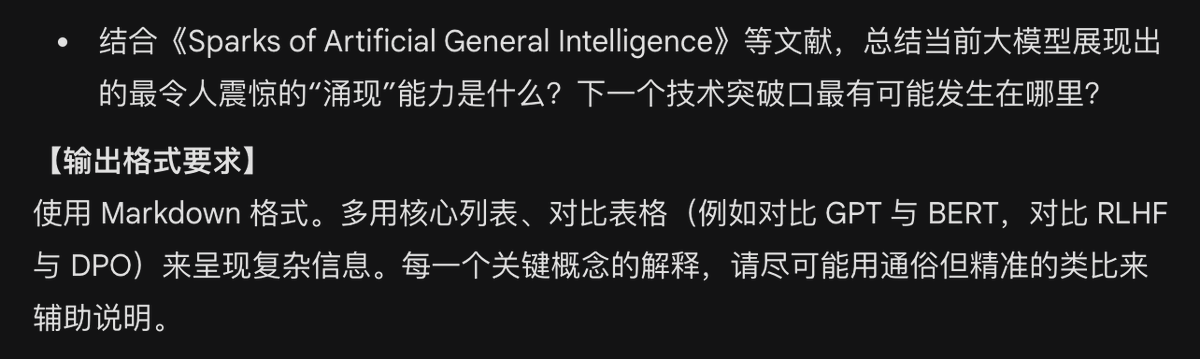

第三步:不同 AI 之間的左右互搏(耗時:1-3.5 小時)

這是整個工作流的核心。你讓不同特性的 AI 在你的知識庫裡做交叉質詢,形成結構化的知識路徑、邏輯推演,最終形成自己的見解。

以主動提問代替被動學習。主動提問(興趣)促進大腦的思考。

尋找錨點: 問 Claude、Deepseek、Gemini 或 Perplexity:「關於 xx 領域,目前學界/業界的核心爭議問題和底層理論框架是什麼?」

閉環叩問:拿著這些核心爭議,回到 NotebookLM 提問:「基於我上傳的文獻,大師們是如何解答這些核心爭議的?請給出具體的文獻來源和推演邏輯。」

降維審視:將 NotebookLM 生成的嚴謹回答複製出來,扔回給具備強邏輯分析能力的 Gemini 或 Claude。下達指令:「請以批判性思維審視這些觀點,指出其中的邏輯漏洞、時代局限性或盲區。基於此,我應該繼續追問哪 3 個更深層次的問題?」

認知螺旋上升:拿著 AI 挑出的漏洞和新問題,再次回到 NotebookLM 尋求解答。

實操

我用 “LLM(large language models)到底是个啥” 來舉個例子吧 😂

第一步:順藤摸瓜(耗時:0.25 小時)

我同時問了 Gemini 和 Claude – 嘿,您才這麼著,居然給出的答案

gemni

然後你突然想起初中老師曾說過,科學理論一定是承上啟下,有其前世、今生與後來。因此你讓 AI 幫你調查這些核心文章參考了哪些論文(通常位於「文獻綜述」中),以及後世有哪些文章引用了這些核心文章,並讓 AI 幫你篩選出來。

第二步:搭建結構化的知識庫

由於一些原LLM特性和AI權限的原因,我們需要自己手動下載(或者你可以讓你的龍蝦🦞代勞)

一般來說,https://scholar.google.com/ 和 https://arxiv.org/ 就完全夠了

你下載之後放到 notebooklm(目前一個庫支援 300 篇左右)

第三步:不同 AI 之間的左右互搏

你可以先在 Notebooklm 問一些比較簡單、直覺的問題,然後將你的理解與其他 AI 討論和探討,之後再把結論發給 Notebooklm,讓它去反駁、論證、補充和糾正。

Notebooklm 的回答和註釋:

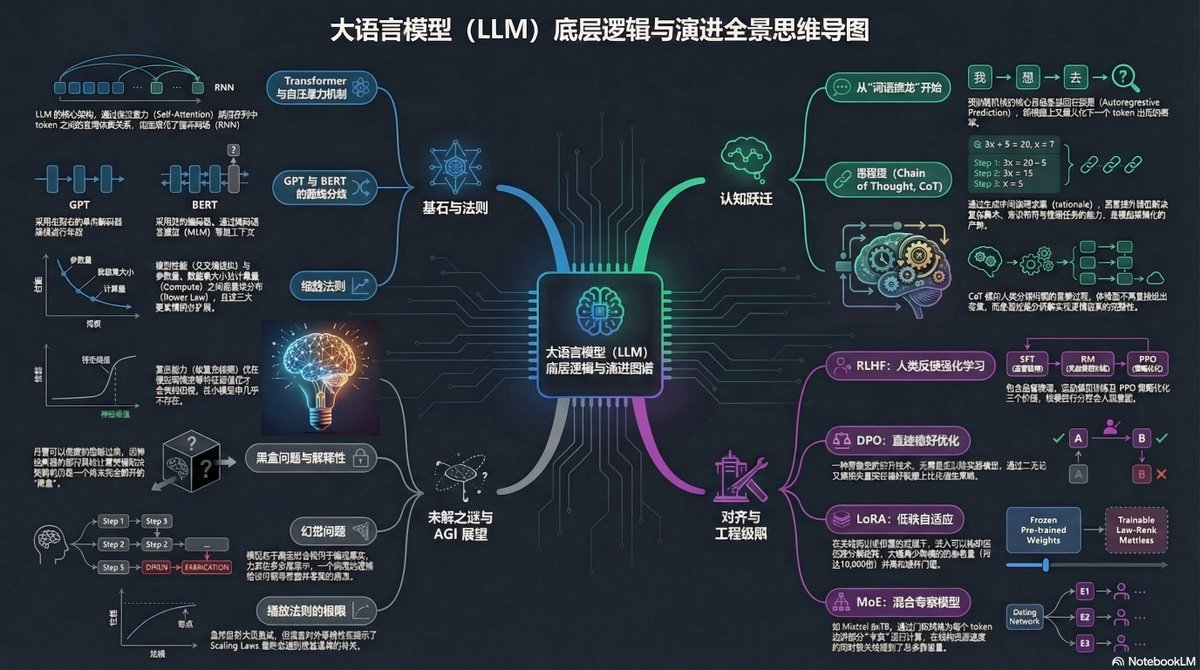

Repeat this several times until you can organize your own mind map.

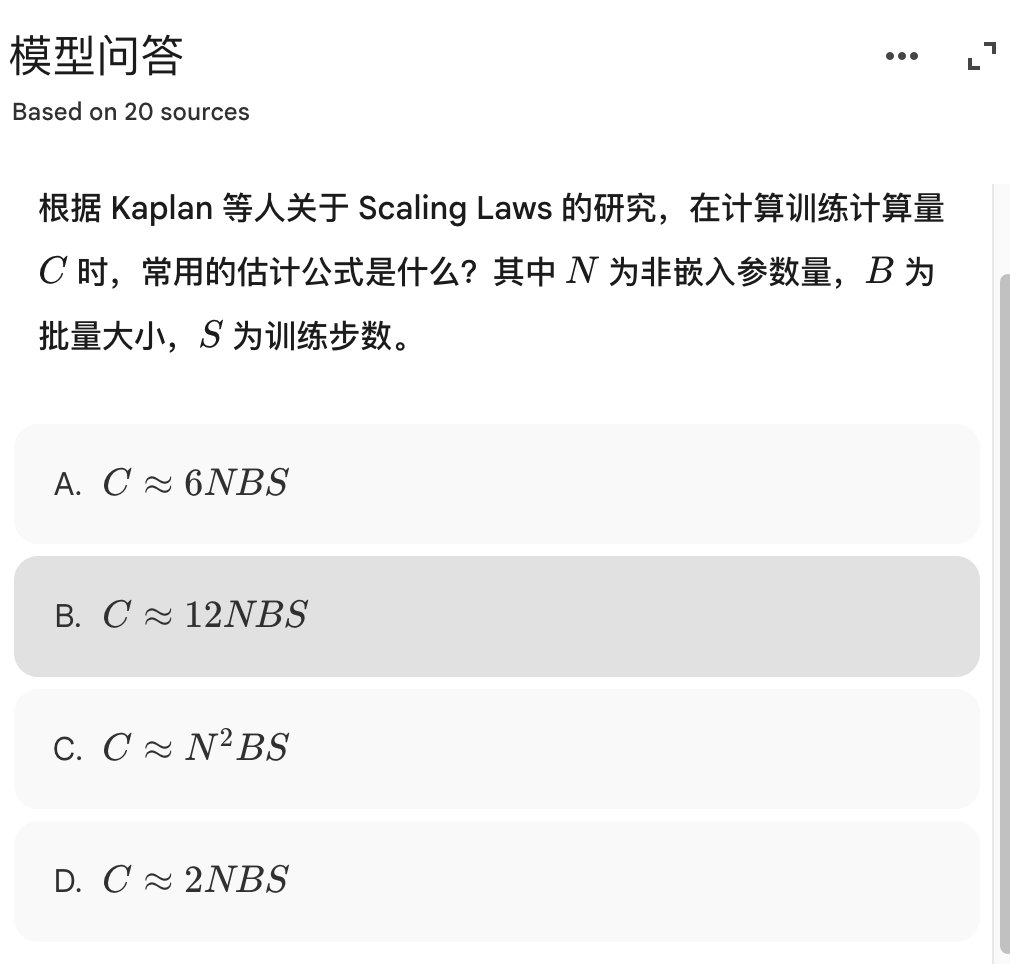

然後你要硬核一點的話,你再讓 Notebooklm 給你來份考題來測試一下。

至此,你對這個領域就有一定的了解了(至少知道了前世、今生和後來,當別人問起來的時候,你能多說5分鐘~)

後記

將你的「知識庫」保存起來(並實時更新,可讓龍蝦來處理),單獨開一個資料夾——例如我就把「合約交易」相關的理論文章單獨成冊,當需要分析事情時,只需調出這個資料夾,再描述數據和案例,就能基本「無幻覺」地分析。

不是目前的AI模型不能完成深層次的思考和分析,而是你沒有用對工具而已。(LLM裡有個很重要的參數就是約束條件和輸入條件)

運用AI是一種能力,但如何讓AI讓人類變得更強大是另一種能力。運用AI是一種能力,但如何讓AI讓人類變得更強大是另一種能力。