來源:CoinW 研究院

摘要

Gradients 是構建在 Bittensor 上的去中心化 AI 訓練子網(SN56),其核心在於通過「任務發布、礦工競爭、驗證篩選」等機制,將模型訓練從複雜的技術流程轉化為由市場驅動的網絡協作過程。在架構上,它結合 AutoML 與分散式算力,形成一個以激勵機制為核心的訓練市場,不僅降低了 AI 使用門檻,也提升了算力利用效率。從生態與數據表現來看,Gradients 已完成基礎網絡搭建,但目前激勵權重與資金流入相對有限。Gradients 弥補了 TAO 生態中的訓練基礎設施,並探索「市場驅動 AI 優化」的新範式,長期有潛力發展為去中心化 AI 訓練的重要入口層。

1. 從 Web2 AutoML 說起:AI 訓練的現狀與局限

1.1 什麼是 AutoML

在傳統認知中,訓練一個 AI 模型是一件門檻很高的事情,需要工程師處理數據、選擇模型、反覆調參數,還要評估效果,整個過程複雜且耗時。而 AutoML(自動化機器學習)的出現,本質上就是把這些繁瑣步驟“打包自動化”。可以把它理解為一個“自動做模型的工具”:用戶只需要提供數據,並告訴系統想要達成的目標,比如分類、預測或識別,剩下的流程包括選模型、調參數、訓練優化,都由系統自動完成。這讓 AI 從少數專業工程師的工具,逐漸變成普通開發者甚至企業都可以使用的能力,是 AI 走向普及的重要一步。

1.2 傳統 AutoML 的核心局限

目前 AutoML 的主流實現方式集中在雲廠商平台,例如 Google Vertex AI 和 AWS SageMaker,這些平台提供「AI 訓練即服務」。儘管 Web2 AutoML 顯著降低了 AI 使用門檻,但其底層模式仍存在明顯局限。首先是中心化問題,算力、定價與規則均由平台掌控,用戶對單一服務商依賴較強,缺乏議價能力。其次是成本高且不透明,AI 訓練依賴的 GPU 資源主要集中在雲廠商手中,價格機制缺乏市場化競爭。更關鍵的是,優化效率存在上限。傳統 AutoML 本質上仍然是「一個系統在幫你找最優解」,無論這個系統多麼複雜,本質上都屬於單一技術路徑的優化。它的探索空間是有限的,很難同時嘗試多種完全不同的思路。因此當前的 Web2 AI 訓練是一個「封閉系統」,模型的訓練、優化和資源調度,都發生在一個由單一平台控制的環境中。這種模式雖高效,但隨著需求增長,其邊界正逐漸顯現。

2. Gradients:用“網絡”重構 AI 訓練

2.1 Gradients 是什麼:一個去中心化的 AutoML 平台

在上一章中我們提到,傳統 Web2 AutoML 的核心問題在於「封閉系統」,模型訓練依賴平台、優化路徑有限、資源流動受限。Gradients 正是對這一模式的一種重構。Gradients 源自 WanderingWeights 發起的去中心化工程師社區,建基於 Bittensor 網絡之上,是運行於 Subnet 56 的 AI 訓練子網。與傳統平台不同,它並不提供中心化服務,而是將訓練過程拆解並交由一個開放網絡完成。用戶只需定義任務目標,例如模型類型與數據,其餘流程包括訓練執行、參數優化與結果篩選,均由網絡自動完成。在這種模式下,AI 訓練從複雜的工程流程被抽象為「提交需求、獲取結果」的簡單過程,更接近一種通用能力,而非專業門檻極高的技術工作。

2.2 從封閉系統到開放協作:Gradients 解決了什麼問題

Gradients 的核心改變,在於將原本封閉在單一平台內部的訓練過程,轉變為一個開放協作的網路過程。訓練任務不再由單一系統完成,而是被分發給多個參與者並行嘗試,再通過統一的評估機制篩選出最優結果。這種結構首先降低了對中心化服務商的依賴,使訓練建立在分佈式算力之上;同時,分散的 GPU 資源被整合進同一個網路,在競爭中形成更接近市場化的資源配置方式。更重要的是,模型優化不再局限於單一路徑,而是在多種方法的並行探索中不斷逼近更優解,從而提升整體優化上限。

2.3 本質變化:從工具到「訓練市場」

在傳統 AutoML 中,平台更像是一個工具,透過內部算法幫助用戶尋找最佳解。而在 Gradients 中,這一過程更接近一個持續運轉的「市場」:用戶發布需求,不同參與者圍繞同一任務展開競爭,並透過評估機制篩選結果。由此,模型效能不再依賴單一系統能力,而是來自多方參與下的持續競爭與迭代。AutoML 也從一個相對封閉的技術優化問題,轉變為一個由激勵驅動的動態過程,使優化能力可以隨著參與者增加不斷擴展。這種變化,使 AI 訓練開始具備類似市場的自我進化特徵。

2.4 在 TAO 生態中的角色:AI 訓練基礎設施層

在 Bittensor 的子網體系中,不同 Subnet 承擔著推理、數據處理與訓練等不同功能,而 Gradients 所處的位置是訓練層。它負責將分散的算力轉化為實際模型產出,並通過任務分發與評估機制,使這些資源能夠被持續調度與優化。同時它連接了算力供給與模型需求,使訓練從單純的資源消耗過程,轉變為一個可以被組織和優化的網絡協作過程。在這一体系中,Gradients 更像是一個中樞環節,將分佈式資源轉化為可用的 AI 能力,並支撐上層應用的發展。

3. 核心架構:AI 訓練是如何在網絡中完成的

在上一章中我們提到,Gradients 將 AI 訓練從「平台內完成」,轉變為「由網絡協作完成」。那麼,這個網絡具體是如何運作的?這一章的核心,就是把這個過程用更直觀的方式拆解清楚。

3.1 分布式訓練:一次任務是如何被「多人完成」的

您可以將 Gradients 想像成一個持續運行的「訓練協作網絡」。當用戶提交一個訓練任務後,該任務並不會交由單一系統完成,而是同時分發給網絡中的多個參與者。這些參與者會基於同一份數據和目標,各自嘗試不同的訓練方法,並在規定時間內提交結果。隨後,系統會對這些結果進行統一評估,篩選出表現最佳的方案。最終,表現更優的結果將獲得獎勵,而其他方案則被淘汰。從用戶的視角來看,這個過程只需發起一次任務,就等同於同時「調用」了多種不同的優化思路,並自動選出最優解。這種方式的關鍵不在於單個節點有多強,而在於透過多人並行嘗試 + 自動篩選,讓結果不斷逼近最優。

在這個網絡中,主要有三類參與者:用戶、礦工與驗證者。用戶負責提出訓練需求;礦工提供算力並嘗試不同訓練方法;驗證者負責評估結果並篩選最優模型。這種分工讓訓練過程可以持續運行,並不斷篩選出更優解。整體上,它構成了一個由“需求、供給、評估”驅動的協作網絡。

3.2 市場驅動的 AutoML

從前面的機制拆解中可見,Gradients 並非簡單地將 AutoML 搬到鏈上,而是透過引入多方參與與激勵機制,改變了模型優化的底層邏輯。傳統 AutoML 依賴單一系統在有限路徑中尋找最優解,而在 Gradients 中,這一過程被擴展至整個網絡:不同參與者圍繞同一任務持續嘗試不同方法,並透過統一評估不斷篩選與迭代。這使得模型優化不再是一次性的計算過程,而是一個可以反覆演進的動態過程。在這種機制下,性能更優的結果會獲得更高收益,從而持續吸引參與者優化策略,推動整體效果不斷提升。

4. 激勵與競爭機制:AI 訓練如何形成“正循環”

4.1 激勵機制(TAO 驅動):從訓練行為到收益回報

Gradients 能夠長期運轉的關鍵在於背後的激勵機制。這一點依賴於 Bittensor 提供的原生激勵體系。其中,TAO 是 Bittensor 網絡的原生代幣,是整個網絡中的「價值載體」:一方面用於獎勵提供算力與模型貢獻的參與者,另一方面也通過質押等方式參與子網權重的分配,影響資源如何在不同子網之間流動。

Bittensor 主網會持續產生新的激勵發行量(Emission),即 TAO(目前每日適當數量約為 3600 TAO),並根據特定規則分配給各個子網。每個子網能獲得多少,取決於其在整個網絡中的「表現」,例如活躍度、貢獻品質及資金支援情況等。對於 Gradients 所屬的子網而言,這部分分配到的 TAO 會在內部再次分配給參與者。分配的核心依據是誰貢獻的模型更優秀,誰就能獲得更多收益。

具體來看,礦工提交訓練結果,驗證者負責對這些結果進行測試和打分。系統會根據評分情況,計算出每個參與者的「貢獻權重」,再按照這個權重分配獎勵。表現更好的模型(例如泛化能力更強、效果更穩定)會獲得更高收益,而驗證者如果評分更準確、更能反映真實質量,也會獲得更多激勵。這種設計讓「做得更好」直接對應「賺得更多」,從而驅動參與者不斷優化模型。

4.2 子網之間的競爭:不僅是內部競爭,更是外部排名

除了子網內部的競爭,Gradients 還面臨整個 Bittensor 網絡中的「橫向競爭」。由於 TAO 的分配是動態的,不同子網之間會爭奪更高的權重。只有那些持續產出高質量結果、吸引更多參與者的子網,才能獲得更大的獎勵份額。因此,Gradients 的激勵不僅取決於內部模型表現,還取決於它在整個生態中的相對競爭力。整個系統形成了一個多層次的循環:子網內部有模型之間競爭;子網之間有整體的表現競爭。最終,算力投入、模型效果與經濟回報被綁定在一起,形成一個持續運轉的正反饋機制。

4.3 梯度 5.0:從競爭到「錦標賽機制」

在早期持續競爭的基礎上,Gradients 進一步演進出更結構化的機制,即「錦標賽式訓練」。可以將其理解為一種週期性的比賽:每輪訓練都會設定時間窗口,多個參與者圍繞同一任務展開競爭,並通過多輪篩選逐步淘汰,最終選出最優方案。這種形式強調階段性對比和集中評估。一個重要變化在於,礦工不再直接提交訓練結果,而是提交「訓練方法」(代碼),再由驗證節點統一執行。這樣做一方面提高了公平性,避免不同計算環境帶來的干擾,另一方面也更好地保護了數據和訓練過程的隱私。此外,優勝方案往往會被沉淀下來,成為可重用的方法,類似不斷累積的「最佳實踐」。長期來看,這種機制不僅是在篩選最優模型,也是在構建一個不斷進化的訓練方法庫。

5. 生態現狀

5.1 參與者結構:由需求、供給與評估構成的協作網絡

Gradients 生態由三類核心角色構成:用戶(需求側)、礦工(供給側)與驗證者(評估側)。用戶主要包括 AI 開發者、中小企業及 Web3 builder,這類群體通常具備一定技術基礎,但缺乏算力或完整的模型訓練能力,因此更傾向於通過 Gradients 以較低成本完成模型構建。礦工則提供 GPU 算力並參與訓練任務的競爭,其核心動機在於獲取 TAO 收益;驗證者負責對訓練結果進行評估與排序,是確保模型質量與機制有效運轉的關鍵一環。

從更細分的用戶畫像來看,Gradients 的實際使用群體呈現出明顯的「半開發者化」特徵:既不同於頂級 AI 實驗室,也非完全無技術背景的普通用戶,而是以具備一定工程能力的開發者與 Web3 技術用戶為主。這一點也體現在其社區結構上,當前生態以英文為主導,核心用戶主要分佈在北美與歐洲的開發者群體,同時覆蓋部分東南亞礦工與全球 GPU 資源提供者。整體而言接近一個技術驅動的開發者社區。

5.2 生態運行現狀

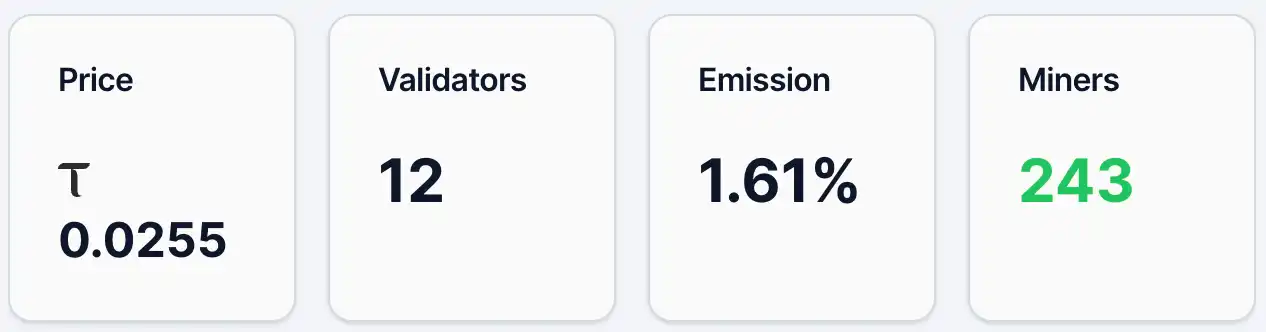

截至 5 月 12 日,Gradients 的 alpha token 價格約為 0.0255 TAO,持幣地址約 4,890 個,礦工 243 個、驗證者 12 個,Emission 占比為 1.61%。同時,其流動性池中 TAO 占比為 2.19%,Alpha 占比為 97.81%。從價格與持幣數來看,Gradients 已具備一定用戶基礎與關注度,但整體仍處於早期擴散階段。對比 TAO 生態中的頭部項目 Chutes,當日 alpha token 價格是 0.0877 TAO,持幣地址為 13,409 個。

圖 1. 漸層數據。

來源:https://bittensormarketcap.com/subnets/56

其次是 Emission 激勵機制。在 Bittensor 體系中,Emission 指該子網在全網新增獎勵中的實時分配權重。Bittensor 網絡會持續產生新的TAO,並按權重分配給各個子網,而 Gradients 當前的 1.61%,意味著其僅獲得全網新增激勵中的一小部分份額。該指標本質上反映的是市場通過資金流(如 staking)對不同子網進行的「投票結果」。因此,1.61% 的水平通常意味著當前市場認可度與資金流入相對有限,另一方面也意味著其未來仍存在提升權重的空間。從資金結構(流動性池)來看,TAO 占比僅 2.19%,而 Alpha 高達 97.81%,說明外部資金流入仍然有限,當前更多是子網內部供給主導。價格對新增資金較為敏感,一旦有更多 TAO 流入,可能帶來更明顯的放大效應。

6. 競爭格局與優劣勢

6.1 行業定位:去中心化 AutoML 的訓練基礎設施

Gradients 所處的是「AI 訓練基礎設施 + 去中心化 AutoML」這一細分賽道。它試圖將模型訓練從中心化平台中釋放出來,並通過網絡化機制實現更高效的資源利用與模型優化。在 Web2 體系中,這一賽道已經相對成熟,典型代表包括 Google Vertex AI 和 AWS SageMaker。這些平台通過雲計算為開發者提供一站式模型訓練與部署服務,但其本質仍是中心化架構。相比之下,Gradients 的差異不在於「功能更多」,而在於底層邏輯不同:它將訓練從「平台服務」轉變為「網絡協作」,並通過競爭機制篩選最優結果,使其更接近一個市場化運作的訓練系統。

6.2 橫向對比:Web2 與 Web3 AutoML 的差異

從更宏觀的角度看,Web2 與 Web3 在 AutoML 方向上的差異,本質是兩種不同範式的對比。Web2 模式強調效率與穩定性,通過集中資源與工程優化,提供可控且成熟的服务體驗;而 Web3 模式則更強調開放性與激勵機制,通過引入多方參與,讓模型優化在競爭中不斷演進。具體來看,Web2 AutoML 更像是「一個強大的工具」,用戶將任務交給平台,由系統內部完成最優解搜索;而以 Gradients 為代表的 Web3 AutoML,則更像是「一個開放市場」,用戶發布需求,由不同參與者提供解法,再通過評估機制篩選結果。這種差異帶來的直接影響在於:前者更穩定、可控,但優化路徑有限;後者探索空間更大,潛在上限更高,但在穩定性與成熟度上仍有提升空間。

6.3 Web3 中 Gradients 的差異化

在當前 Web3 AI 賽道中,大多數項目仍集中在推理層或 AI Agent 方向,而專注於「訓練基礎設施」的項目相對較少。部分項目嘗試結合算力網絡或數據網絡提供訓練能力,但整體來看,多數仍停留在資源調度或算力市場層面。Gradients 的差異在於,它不僅僅提供算力撮合,而是進一步向上延伸到「模型優化機制」本身,通過引入評估與競爭體系,使訓練過程具備持續演進能力。這意味著,它不僅在解決「算力從哪裡來」,還在解決「如何更高效地用這些算力」。從定位上看,Gradients 更接近一個「訓練結果導向」的網絡,而不是單純的算力市場或工具平台,這也是其與多數 Web3 AI 項目的核心區別。

6.4 核心優勢:機制驅動的效率提升

綜合來看,Gradients 的優勢主要體現在其機制設計上。首先,它通過任務抽象降低了使用門檻,使用戶無需深入參與複雜訓練流程,也能獲得模型結果,從而擴大了潛在用戶群體。其次,在資源層面,分佈式算力的引入,使訓練不再依賴單一雲廠商,理論上可以通過競爭形成更具彈性的成本結構。更重要的是其優化方式的變化。通過多參與者並行探索並結合篩選機制,Gradients 提供了一種不同於傳統單路徑優化的方案,使模型有機會在更短時間內達到更優性能。這種「競爭驅動優化」的模式,是其最核心的優勢所在。

6.5 潛在挑戰

模型品質可能存在穩定性問題。去中心化訓練依賴多方參與,雖然可提升上限,但也可能帶來結果波動,相較於中心化體系,在可控性上存在一定程度的不確定性。其次是企業級信任問題。對於企業用戶而言,數據安全與訓練過程的可驗證性至關重要,而在去中心化環境下如何確保數據不被濫用、結果可被審計,仍是關鍵考驗。最後是對 Token 經濟的依賴。Gradients 的運轉高度依賴激勵機制,如果 TAO 收益吸引力下降,可能影響礦工參與度與整體網路活躍性。因此,其長期可持續性在一定程度上取決於經濟模型是否能夠形成穩定正循環。

7. 未來展望:去中心化 AutoML 能否成立?

從當前階段來看,Gradients 仍處在早期,其未來能否真正跑通,取決於幾個關鍵點。最核心的是是否能持續吸引真實訓練需求,而不僅是圍繞激勵的參與;其次是模型質量,去中心化方式能否穩定產出可用、甚至更優的結果;以及經濟機制是否能夠形成正循環,讓算力供給與收益之間保持長期平衡。

在更大的行業背景下,AI 訓練正分化出兩種路徑。一種是 Web2 模式,由頭部科技公司主導,通過集中資源與工程能力不斷強化模型性能,優勢在於穩定和成熟;另一種則是以 Gradients 为代表的 Web3 路徑,通過開放網絡與激勵機制,讓更多參與者共同參與模型優化,在競爭中不斷提升上限。前者是在「打造更強系統」,後者更像是在「構建一個會自我進化的網絡」。

從這個角度看,Gradients 的探索代表了一種新的可能性:AI 訓練不再只是技術問題,而是「算力 + 數據 + 市場機制」的結合。如果這一模式能夠成立,它有潛力成為去中心化 AI 的訓練入口,並在 Bittensor 生態中扮演關鍵基礎設施角色。當然,這一方向仍需要時間驗證,但它已經為 AutoML 提供了一條不同於傳統路徑的演進思路。

參考

1. Bittensor 文件:https://docs.learnbittensor.org

2. Gradients 網站:https://www.gradients.io/

3. 漸層:https://bittensormarketcap.com/subnets/56

4. Gradients X: https://x.com/gradients_ai

5. Taostats:https://taostats.io/subnets/56/chart