這瘋狂的三十天,十一個大模型,就像是一場喧鬧的煙火秀。

文章作者、來源:0x9999in1,ME News

簡而言之

- 極致內捲的三十天:3月26日至4月24日,全球發布11款重磅大模型,平均2.7天一款。市場面臨嚴重的「參數疲勞」。

- 參數大胃王的「減肥手術」:V4-Pro 總參數達 1.6T,但僅激活 49B。透過 CSA+HCA 架構重塑,1M 上下文下 FLOPs 降至 27%,KV 緩存降至極其恐怖的 10%。

- 煉丹術的代差剝離:首創「先獨立強化學習,後在線蒸餾合併」的後訓練範式,V4-Pro-Max 在推理與 Agent 任務上直逼閉源天花板。

- 真金白銀的選票:GPT-5.5 僅帶動英偉達單日漲 4.2% 後見頂,而 V4 憑藉 MIT 完全開源,徹底點燃了中港本地算力鏈的持續暴漲。

- 深層博弈邏輯:閉源模型賣的是「稅」,開源大模型賣的是「鐵」。V4 的出現,讓全球企業級私有化部署的算力賬本,終於算得平了。

諸神狂飆的四月,與市場的審美疲勞

瘋了。都瘋了。

如果你是一個緊盯AI賽道的觀察者,剛過去的這三十天,大概率會讓你感到生理性不適。從2026年3月26日到4月24日,短短不到一個月的時間裡,全球至少有11個具備顯著影響力的大模型砸向市場。

名單長得像在報菜名:Anthropic Opus 4.6、谷歌 Gemini 3.1 Pro、OpenAI GPT-5.5、Mistral Large 3、Meta Llama 4、月之暗面 Kimi K2.6、阿里 Qwen3-Next、字節豆包 2.5 Pro、騰訊混元 3.0、Kimi K2.6 Plus。

以及,在4月23日凌晨,如一枚深水炸彈般悄然上線的 DeepSeek V4。

平均下來,每 2.7 天就有一個新模型推出。這速度連基金經理都來不及讀完發布稿。投資人剛聽完 A 公司的「參數超越」,B 公司的「跑分碾壓」就已經遞到桌前。市場其實已經麻木了。所謂的「Benchmark(基準測試)刷榜」,在高度內捲的當下,越來越像一場自娛自樂的數字遊戲。

但錢是聰明的。或者說,K線從不說謊。

翻一遍這30天的中美港AI資產K線,你會發現一個極其冷酷的現實:在這場「諸神之戰」中,真正能在盤面上留下持續痕跡的,只有兩個節點。

第一個,是 4 月 8 日大洋彼岸的 OpenAI 推出 GPT-5.5。這無可爭議的王者,直接帶動英偉達單日暴漲 4.2%。然後呢?沒有然後了,一日見頂,利好出盡。大家發現,再偉大的閉源大王,也難以像兩年前那樣,輕易撬動全球資本那座沉重的大山。

第二個節點,就是4月23日至24日。DeepSeek V4 預覽版發佈。沒有華麗的發佈會,沒有震撼的宣傳片。權重直接上線 Hugging Face 和 ModelScope,MIT 協議。

結果?它帶動了中港算力鏈走出連續跳漲。

為什麼?為什麼一群閉源巨頭都沒能辦到的事,卻被一個開源模型做到了?

要回答這個問題,我們得像說書人一樣,拋開那些枯燥的公關稿,扒開 DeepSeek V4 的引擎蓋,看看裡面到底裝了什麼怪物。

解剖 V4:不再迷信參數的暴力美學

大模型。很燒錢。這事兒人盡皆知。

過去一年,大模型廠商陷入了一種「火力不足恐懼症」。你做萬億,我就做兩萬億。大家都認為,只要力大磚飛,湧現出的智能就能解決一切問題。但隨之而來的是極其恐怖的算力成本。地主家的餘糧也不夠燒了。

DeepSeek V4 這次推出了兩款 MoE(混合專家)模型:V4-Pro 和 V4-Flash。我們先看幾組核心數據。

V4-Pro:總參數 1.6T(1.6 萬億),但每 token 激活參數僅 49B(490 億)。

V4-Flash:總參數 284B(2840 億),激活參數僅 13B(130 億)。

看懂了嗎?這是一種極度克制的「四兩撥千斤」。MoE 架構的本質,就是不用每次都拉響全部警報。遇到殺雞的任務,就調動幾位殺雞專家;遇到屠龍的任務,再請出屠龍刀。1.6 萬億的底座,保證了它「見過世面,知識淵博」;490 億的激活,保證了它「反應迅速,身手矯健」。

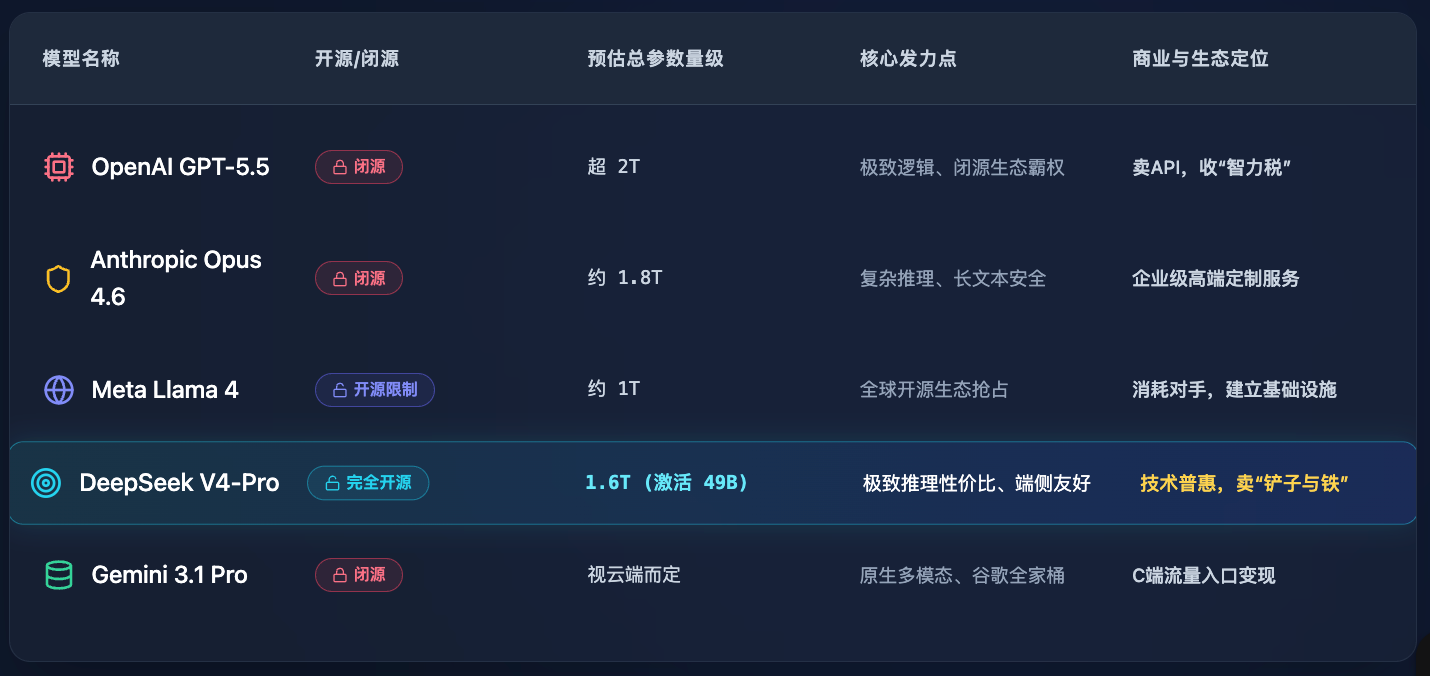

為了更直觀地看懂這種差距,我們拉一張表,對比一下當前市場上的主流路線(數據為市場公開預估及測算):

從表中可見,V4-Pro 在總參數上並未一味追求超越 GPT-5.5,但它把力氣全花在了「怎樣讓這頭巨獸吃得少、跑得快」上。

但這還不夠。真正讓懂行的人倒吸一口涼氣的,是它對「顯存刺客」的無情絞殺。

顯存刺客的末日:架構上的三把刮骨刀

什麼是顯存刺客?就是「長上下文(Long Context)」。

現在各家都在宣傳自己支援 1M(一百萬)token 的上下文。聽起來很爽,一整本《三國演義》塞進去,它幾秒鐘就能讀完。但代價呢?長文本在推理時,會產生龐大的 KV 緩存(推理時存儲歷史資訊的顯存佔用)。這就像你每讀一頁書,都要拿個大黑板把前一頁的內容抄下來擺在眼前。當你讀到第一百萬字時,黑板多得連中關村的機房都塞不下。

內存,比算力更貴。這是AI行業的潛規則。

DeepSeek V4 如何破解這個局面?他們直接對底層的注意力機制進行了「外科手術」。這就是他們架構升級的第一把,也是最狠的一把刀:混合注意力機制(CSA + HCA)。

CSA(壓縮稀疏注意力)加上 HCA(重度壓縮注意力),聽起來像火星文,翻譯成人話就是:它不再死記硬背了,而是學會了“劃重點”和“做極簡筆記”。

效果極其暴力:在 1M 上下文下,V4-Pro 單 token 推理的 FLOPs(浮點運算次數)僅為上一代 V3.2 的 27%!更恐怖的是,KV 緩存僅為 V3.2 的 10%!

這是什麼概念?原本需要 10 台頂級伺服器才能跑滿的百萬字長文本任務,現在 1 台伺服器就輕鬆搞定。算力成本直接降至一折。這是掀桌子級別的優化。

還有兩把刀。

第二把刀,叫「流形約束超連接(mHC)」。過去的大模型,層與層之間的資訊傳遞用的是「傳統殘差連接」,就像用老舊的生鏽鐵管通水,水壓一大就容易漏。面對 32T token 的海量預訓練數據,老管子扛不住。mHC 就像是換上了光纖網路,增強了跨層訊號傳播的穩定性。不丟包,不跑偏。

第三把刀,更換引擎機油。拋棄傳統,改用 Muon 優化器。這玩意兒的作用是加速收斂。同樣煉一爐丹,別人需要 77 天,它可能 20 天就起鍋了。時間就是金錢,機時就是美金。

這三把刀劈下去,V4 彻底治好了大模型的“富貴病”。

煉丹爐裡的秘密:從各自為戰到萬法歸宗

大模型圈內人都知道,預訓練只是把一個「文盲」變成「懂很多知識但不會說話的呆子」。真正讓它變成絕世高手的,是後訓練(Post-training)。

DeepSeek V4 在後訓練上,玩了一把極其硬核的「兩階段兵法」。

過去大家訓練 MoE,就像是一群老師圍著一個學生教,很容易打架。V4 怎麼幹?

第一階段:“各自為戰”。它利用 SFT(監督微調)和 GRPO(群組相對策略優化)強化學習,將模型中的各個“專家網絡”拆開來單獨訓練。寫代碼的專家就天天練寫代碼,做數學的專家就天天啃數學題。毫不相干,互不干擾。這叫把單點能力拉到極致。

第二階段:“萬法歸宗”。透過在線蒸餾技術,將這些已練成絕世武功的專家,統一合併成一個渾然一體的模型。不內耗,不卡頓。

讓我們來看看他們逼出的兩個“大招”。

一是 V4-Pro-Max 模式。這是最高推理力度模式。這就好比解開了基因鎖。據他們自稱(並且很快被社區驗證),在編碼基準測試上,V4-Pro 已經達到了頂級水平,而在複雜的推理和 Agent(智能體)任務上,與前沿閉源模型(比如 GPT-5.5、Opus 4.6)的差距顯著縮小。

二是 V4-Flash-Max。這個更有趣。它是一個僅有 284B 的小傢伙,但在「給足思考預算」後,推理表現竟可接近 Pro。這說明了什麼?說明了「算法的質量」開始戰勝「參數的體量」。只要你給它足夠的時間去思考,小腦瓜也能解出大難題。當然,在純粹的知識儲備和極度複雜的多步驟 Agent 任務上,它依然受限於參數規模(畢竟肚子就那麼大),但這對於絕大多數企業級日常應用來說,已經性能過剩了。

最後,權重存儲極其精明地採用了 FP4+FP8 混合精度存儲。既保住了精度,又省下了顯存。處處透著一種精打細算的理科生性感。

為了更清晰地對比這種後訓練帶來的工程效率提升,我們再拉一張硬核指標對比表:

資本的嗅覺:為何 V4 點燃了中港算力鏈?

講到這裡,技術層面的拆解差不多了。但我們還沒回答開篇的那個靈魂拷問:

為什麼 GPT-5.5 沒有讓算力板塊持續狂歡,而 DeepSeek V4 卻做到了?

這就需要我們跳出代碼,用資本和商業的眼光來看待這場博弈。

GPT-5.5 非常強大,無敵的強大。但它是閉源的。閉源意味著什麼?意味著 OpenAI 是一個巨大的「黑洞」。你想要使用它的能力,就得購買它的 API。這是一種「收稅」模式。利潤流向了矽谷,算力需求集中在微軟的雲端數據中心。這對全球的硬體廠商、本地算力中心、各國的伺服器代理商來說,除了仰望,分不到幾杯羹。GPT-5.5 再強,那也是別人的狂歡。英偉達漲一下,是因為大家覺得 OpenAI 還要買更多卡。

但 DeepSeek V4 不一樣。

它是開源的。而且是極其徹底的 MIT 許可。MIT 協議是開源界最慷慨的贈送,這意味著商業公司可以免費拿去用,去改,去賣,不用擔心法律風險。

更致命的是,我們前面花了大量篇幅論證了:V4 把模型的推理成本、顯存佔用砍到了腳踝。

把這兩點結合起來,你就會得出一個讓資本市場瘋狂的結論:私有化部署的臨界點,真正到來了。

過去,企業想自行部署一個 1T 以上的大模型,一看硬體報價表,默默合上,轉身去購買 API。現在,V4 告訴大家:你只需要很少的機器,就可以在本地運行一個無限接近 GPT-4 甚至挑戰 GPT-5.5 水平的超級大腦。數據不用出省,不用出國,絕對安全。

既然大家都能在本地跑得起了,那接下來會發生什麼?

買機器!買伺服器!買光模組!建智算中心!

閉源大廠賣的是智力稅,而開源大廠,本質上是在給全行業的硬體廠商「帶貨」。DeepSeek V4 就是那個扔下火種的人。它越是好用,越是開源,中港台等地的本地化算力需求就越是井噴。那些做伺服器組裝的、做液冷的、做資料中心運維的企業,終於看到了大規模落地的真金白銀。

這就是為什麼 V4 於 4 月 23 日上線後,中港算力鏈會連續跳漲。資本不是為情懷買單,資本是在為即將到來的「千行百業私有化部署狂潮」提前站位。

這,就是底層的商業陽謀。

結語:退潮與礁石

這瘋狂的三十天,十一個大模型,就像是一場喧鬧的煙火秀。

巨頭們在參數的擂台上互相揮舞著大洋,試圖用算力的重拳把對手砸倒。但喧囂過後,真正能留下來改變行業地貌的,往往不是最吵鬧的那個。

DeepSeek V4 的出現,就像一位冷靜的刺客。它不跟你比誰燒錢多,只在最痛的軟肋上動刀:砍掉無謂的顯存,拉平部署的門檻,把高端局變成平民局。

在這場被稱為“諸神黃昏”的 AI 大戰中,盲目堆疊參數的時代正加速落幕。未來的戰場,將屬於那些能在“極致性能”與“工程效率”之間找到絕佳平衡點的人。

風口總會退潮,退潮之後,才知道誰在裸泳,誰又是那塊堅不可摧的礁石。

V4 has already distributed the weapons to everyone. Now, it’s up to all the warlords to establish their bases on this new land.

看透了這一層,你再去聽那些動輒「震撼發布」、「重新定義」的喧嘩,或許就能多幾分灑脫,少幾分焦慮了。

After all, no matter how dazzling the magic, it ultimately comes down to the ledger, balancing out those few coins.

引用來源:

- DeepSeek V4 系列預覽正式發布,DeepSeek 團隊,GitHub/ModelScope/HuggingFace。(2026)。

- 四月AI熱潮:分析30天大型模型週期,ME News 市場觀察者。 (2026)。

- 擴展法則與訓練後範式轉變,《人工智慧經濟學期刊》。 (2026)。

- 全球計算供應鏈市場動態報告(2026 年 4 月),泛亞金融數據分析。(2026 年)。